文献来源: Wang Y, Xing S, Can C, et al. Generative ai for autonomous driving: Frontiers and opportunities[J]. arXiv preprint arXiv:2505.08854, 2025.

生成式人工智能(Generative AI)正在从根本上重塑自动驾驶技术的研发范式。从解决数据稀缺的合成数据生成,到端到端的智能驾驶决策,再到连接虚拟与现实的数字孪生系统,生成式AI的应用已渗透到自动驾驶的每一个关键环节。本文将系统梳理生成式AI在自动驾驶领域的六大核心应用场景,深入探讨其如何推动技术从实验室走向大规模商业部署。

一、合成数据生成:破解数据瓶颈的利器

自动驾驶系统的性能高度依赖于训练数据的规模与多样性,但真实世界数据的收集成本高昂,且难以覆盖所有关键场景,特别是极端天气、罕见交通事故等"长尾"情况。合成数据生成技术通过生成式AI创造了人工但逼真的数据集,为算法训练与验证提供了可扩展的解决方案。

1.1 从传统仿真到生成式AI的演进

早期的合成数据集主要依赖物理引擎和手工设计的场景。早在2010年,FRIDA数据集首次针对雾天环境下的深度估计任务提供了合成道路图像;2016年的Flying Things和Driving数据集利用ShapeNet数据库中的3D模型构建城市场景;同年,Virtual KITTI通过Unity引擎创建了真实KITTI数据集的虚拟版本,标志着商业游戏引擎开始成为合成数据的重要工具。2017年,基于GAN的Pix2Pix方法开创了使用生成对抗网络进行语义分割数据生成的先河。

随着生成式AI技术的爆发,数据合成进入了全新时代。现代方法能够生成高保真、多样化的传感器数据,显著降低了人工创建资产的需求,有效弥合了仿真与真实之间的域差距(Domain Gap)。

1.2 传感器级数据合成

传感器空间生成(Sensor-Space Generation)专注于合成原始传感器数据,主要包括相机图像、激光雷达点云等,直接用于训练与测试感知模型。

图像与视频合成

相机数据为自动驾驶系统提供了丰富的环境信息,支持目标检测、道路拓扑构建、交通标志识别等关键功能。然而,真实世界的图像采集需要数千小时的实际驾驶,成本极高,且难以捕捉边缘场景。

当前先进的图像生成方法通过可解释的先验条件(如鸟瞰图布局、道路地图或文本描述)来控制生成过程。例如,BEVGen、BEVControl、MagicDrive和DriveDiffusion等方法利用鸟瞰图(BEV)布局生成逼真的街景图像;UrbanGIRAFFE、Panoptic NeRF和UrbanRF则通过将静态基础设施(道路、建筑)与动态智能体(车辆、行人)分离,实现了分层且模块化的场景合成,支持对单个场景元素的结构化编辑与扰动,为模拟罕见事件和测试系统鲁棒性提供了便利。

视频生成在自动驾驶中尤为重要,但也面临确保时间一致性的挑战。Panacea、Delphi和DriveScape等模型能够基于多模态输入(图像、BEV布局、相机姿态、3D结构)生成高质量的驾驶视频,通过跨帧注意力机制、特征对齐的时间模块和双向Transformer等技术确保时序连贯性,为创建具有可控环境因素和智能体行为的多样化驾驶情境提供了可能。

激光雷达数据合成

激光雷达(LiDAR)提供了精确的3D空间信息,对于目标检测、语义分割和轨迹预测至关重要。与相机不同,LiDAR数据的合成需要模拟稀疏且非均匀的点云分布、射线丢失(Ray-drop)效应以及与反射表面的交互等独特特性。

当前研究主要采用三种技术路线:

基于扩散模型的方法:RangeLDM和LiDMs等潜在扩散框架通过曲线级压缩、点级坐标监督和块级编码来保留结构几何细节;LidarDM进一步将扩散模型扩展到4D激光雷达合成,能够生成3D场景和动态参与者,并模拟时间连贯的传感器观测。

基于神经辐射场的方法:NeRF-LiDAR和DyNFL利用隐式神经表示从多视图图像和稀疏激光雷达输入合成逼真的点云,通过点级和特征级对齐增强结构一致性,实现高保真、时间一致的动态场景重建。

基于VQ-VAE的方法:UltraLiDAR和LidarGRIT采用向量量化变分自编码器将稀疏点云编码为紧凑的离散token,再通过自回归Transformer建模,实现稀疏到稠密的补全和可控场景生成。

二、端到端自动驾驶:从感知到控制的一体化智能

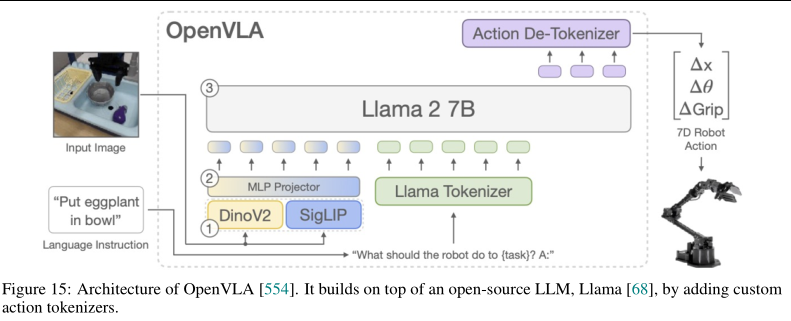

传统的自动驾驶系统采用模块化设计,将感知、预测、规划等任务分离处理,但这种方法在长程决策和复杂交互场景中存在信息损失和误差累积的问题。生成式AI,特别是多模态大语言模型(MLLM)的兴起,推动了端到端(End-to-End)自动驾驶范式的发展,实现了从原始传感器输入直接到控制输出的映射。

2.1 大语言模型驱动的驾驶决策

现代MLLM如GPT-4、LLaMA和Gemini等展现出强大的视觉理解和推理能力,被广泛应用于自动驾驶的端到端系统。DriveGPT4提出了基于问答的自动驾驶框架,通过视觉问答(VQA)形式提升系统的推理能力;DriveCoT构建了思维链(Chain-of-Thought)推理数据集,为模型的中间推理过程和最终决策提供标注。

更具代表性的是EMMA(End-to-end Multimodal Model for Autonomous driving)及其开源版本OpenEMMA。这些框架利用预训练的MLLM(如LLaVA、Qwen2-VL、GPT-4o)构建端到端系统,首先预测未来自车的速度和曲率,再积分得到轨迹点,而非直接生成路径。这种设计在零样本(Zero-shot)和无训练(Training-free)条件下实现了竞争性能,展现了极强的泛化能力。

2.2 多模态融合与系统集成

MLLM不仅可以独立完成任务,还能与传统端到端模型协同工作,增强场景理解能力和处理未见场景的能力。例如,通过视觉和文本理解能力增强自动驾驶系统的鲁棒性和适应性;利用语言增强的潜在空间编辑和模拟能力提升系统泛化性。

一些研究提出了双过程决策框架,结合大模型的分析推理能力和轻量级模型的快速 empirical 决策,模仿人类认知过程。SENNA框架则通过VLM提供元动作指导,与端到端驾驶模型协同工作;VDT利用VLM进行场景理解,辅助基于扩散模型的路径生成;Orion进一步将生成式规划器与上游VLM连接,实现训练时的端到端梯度反向传播。

三、个性化自动驾驶:千人千面的驾驶体验

自动驾驶产业正在经历向"以人为中心"的范式转变。车辆自动化不再仅仅关注传统安全和效率指标,而是致力于提供个性化的驾驶体验。这种转变反映了一个重要认知:自动驾驶技术的成功采用不仅需要技术上可靠的驾驶能力,还需要提供符合个人偏好和期望的人性化体验。

3.1 大语言模型赋能个性化交互

大语言模型在理解自然语言命令和常识推理方面的能力,使其成为实现个性化自动驾驶的关键技术。研究表明,LLM能够弥合数据驱动方法与人类决策之间的差距,通过语言理解和常识知识增强上下文理解、场景推理和决策可解释性。

在个性化自然语言交互方面,LLM作为中介理解人类用户的自然语言指令,实现更直观的人车交互。通过链式思维提示(Chain-of-Thought Prompting)技术,系统能够持续接收反馈并将人类意图转化为安全的车辆动作。更进一步,结合驾驶风格数据库和统计评估的奖励函数生成方法,可以实现与驾驶员偏好的策略对齐。

在轨迹和行为预测方面,TrajLLM利用LLM预测未来运动轨迹,结合车道感知的概率学习和多模态拉普拉斯解码器,有效模拟人类驾驶员的车道关注行为。通过多模态提示(结合视觉和激光雷达数据)让LLM帮助纠正驾驶错误,增强了类人化和个性化自动驾驶能力。

3.2 视觉语言模型与生成式深度学习

视觉语言模型(VLM)的集成是实现个性化驾驶的重要方向。VLM-Auto利用VLM的高级道路场景理解能力增强类人驾驶行为;pFedLVM框架将大视觉模型与联邦学习结合,在保护隐私的同时实现个性化驾驶特性学习;车载VLM系统能够为MPC和PID控制器提供个性化控制策略。

此外,生成式深度学习模型如条件变分自编码器(CVAE)和长短期记忆网络(LSTM)被用于预测个性化驾驶行为(速度、加速度、转向角),考虑个体驾驶风格和周围车辆交互。GARNN(生成对抗循环神经网络)模型在云端训练通用驾驶行为,再在边缘设备上微调个性化模型,实现了动态适应和隐私保护。

四、数字孪生:连接虚拟与现实的闭环桥梁

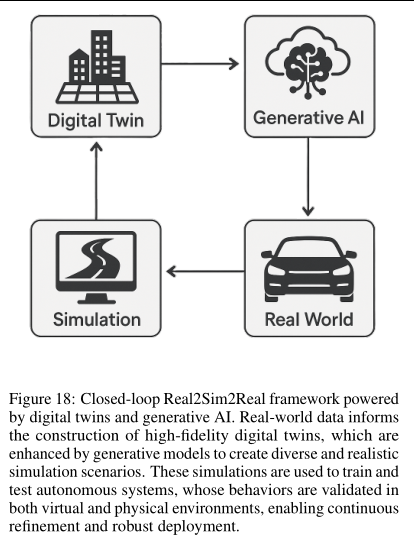

除了数据合成,自动驾驶还需要交互式、闭环的仿真环境进行强化学习训练和策略验证。数字孪生(Digital Twins)技术通过构建物理环境的虚拟副本,结合生成式AI实现了Real2Sim(真实到仿真)和Sim2Real(仿真到真实)的双向迁移。

4.1 Real2Sim:构建高保真虚拟世界

Real2Sim指将真实世界数据转换为虚拟环境的过程,是数字孪生的基础。现代Real2Sim流程涉及使用多模态传感器输入(激光雷达、相机、高精地图)重建驾驶环境,并填充动态智能体。

UrbanDiffusion、OccSora和DOME等方法能够基于轨迹或布局生成高分辨率3D占据场景,从真实数据中捕捉几何和语义真实感。基于NeRF的重建方法(如BlockNeRF、UrbanNeRF)和3D高斯溅射(3D-GS)模型(如OmniRe、DrivingGaussian)能够重建稠密的3D/4D环境,支持新视角合成和智能体模拟。

在行为层面,通过从日志中挖掘智能体轨迹并学习生成模型(如CVAE、Trajectron++、扩散模型如MotionDiffuser),可以复制合理的交互行为。语言条件框架如DriveLM、LMDrive和GPT-driver进一步将场景上下文抽象为语言输入,利用MLLM实现高层次理解和灵活仿真。这种空间、行为和语义保真度的融合,创造了语义丰富、可交互的数字孪生环境。

4.2 Sim2Real:弥合域差距

Sim2Real旨在将仿真中训练的模型迁移到真实世界部署。然而,仿真器常因简化物理、视觉真实感不足或智能体行为不匹配而遭受"现实差距"(Reality Gap)。

在图像和视频层面,BEVGen、MagicDrive3D和DriveDiffusion等方法通过使用BEV布局、文本提示或天气条件进行可控生成,提高了视觉真实感。扩散模型和3D-GS渲染允许生成多样化且逼真的场景,同时保留几何和时间一致性。结合NeRF或点云,Stag-1和ChatSim等方法能够生成语义一致的序列,模拟各种驾驶条件和环境,缩小仿真与真实的视觉差距。

对于激光雷达,RangeLDM和LiDMs等扩散模型提供高保真的点云仿真,建模射线丢失和稀疏性等传感器特定伪影;NeRF-LiDAR和DyNFL从隐式3D场景模型生成物理上合理的激光雷达信号。

在行为层面,TrafficSim和DJINN等模型仿真从真实数据学习的多智能体交通行为,提供随机但真实的交通流;BehaviorGPT利用Transformer自回归地仿真行为,捕捉长程依赖和上下文推理。

4.3 闭环仿真与持续学习

数字孪生的最高境界是实现闭环(Closed-loop)仿真,即自动驾驶车辆的行为实时影响仿真环境,实现交互式训练。传统开环数据重放无法捕捉AI驾驶员行为对其他智能体的影响。DriveArena和LimSim++等新仿真器使用生成式智能体模型,对自车动作做出响应而非遵循固定脚本,使研究人员能够测试反事实场景(如"如果自车在路口加速,周围车辆会如何反应")。

这种Real2Sim2Real的泛化目标是仿真中的闭环行为足够真实,使得在仿真中开发的控制策略可以最小微调地部署到现实世界,反之,真实世界数据也能持续更新和改进仿真器。Mcity数字孪生项目是这一方向的先驱,提供了真实自动驾驶测试设施的完整数字化副本,创建了双向反馈循环,模型可以在仿真中训练、在现实中测试,实现持续精炼和鲁棒部署。

五、场景理解:多模态大模型的视觉认知革命

利用多模态大语言模型(MLLM)进行场景理解是自动驾驶领域的前沿方向。与传统依赖特定任务架构(如目标检测、分割或意图估计)的感知模块不同,MLLM将强大的视觉编码器(如CLIP、BLIP-2、LLaVA)与预训练的大语言模型结合,实现了通过视觉和语言输入进行开放式理解的能力。

5.1 统一感知与高层推理

MLLM能够处理原始驾驶场景图像或视频序列以及自然语言查询,适用于风险识别、行为预测和语义理解等广泛任务。HiLM-D展示了MLLM执行统一感知和高层推理的能力,能够从驾驶视频中生成关于风险、意图和建议动作的自然语言描述。DriveLM引入了图视觉问答(Graph VQA)进行结构化推理,并在DriveVLM中进一步结合思维链提示(CoT)进行空间理解和轨迹预测。

Dolphins和TUMTrafficVideoQA将通用VQA数据集和特定领域驾驶数据相结合,增强细粒度视觉推理能力;EM-VLM4AD则引入了针对多帧分析优化的轻量级MLLM。这些模型擅长解释动态场景并生成上下文感知的预测或规划,有效弥合了感知与决策之间的鸿沟。

5.2 端到端驾驶堆栈集成

MLLM已被集成到端到端驾驶系统中。LMDrive将传感器输入和语言命令融合在闭环控制系统中;LeGo-Drive提出从语言中预测语义目标位置作为中间规划目标,实现灵活的目标导向导航;Cube-LLM则首次实现了开放词汇的3D定位(为图像中的物品提供3D边界框)。

这些MLLM驱动的方法代表了向认知信息场景理解的迈进,在复杂驾驶环境中提供了可解释性、灵活性和泛化能力。

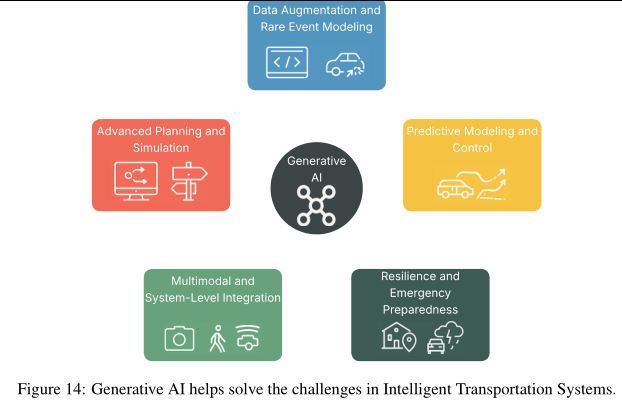

六、智慧交通系统:从单车智能到全局优化的跨越

将生成式AI置于更广泛的背景中,它与智慧交通系统(ITS)的交叉代表了从单车智能向系统级优化的重要扩展。ITS指将先进信息、通信和AI技术整合到交通基础设施和车辆中,以提升安全性、效率和可持续性的系统。与以车辆为中心的自动驾驶视角不同,ITS采用更全面的方法,强调系统级或网络级的协调与交通管理。

6.1 先进规划与仿真

生成式AI显著增强了ITS规划与仿真的能力。通过生成多样化且逼真的交通场景(包括罕见和极端条件),规划者和工程师能够更好地理解系统对不同情况的响应。这在虚拟测试交通控制策略、基础设施设计和出行政策方面尤为宝贵,避免了成本高昂或具有破坏性的真实世界试验。在城市规划中,生成模型允许模拟未来交通需求和新基础设施开发的影响,支持更主动和明智的决策。

6.2 数据增强与罕见事件建模

ITS面临的持续挑战是数据集的不平衡,特别是交通碰撞、未遂事故或基础设施故障等关键但罕见事件的稀缺性。生成式AI通过合成高质量、逼真的数据来增强现有数据集,解决了这一问题。这对于训练机器学习模型尤为重要,因为模型在代表性不足的场景中往往表现不佳。通过生成罕见事件数据,生成模型帮助提升系统鲁棒性、模型泛化能力和基于AI的交通应用的公平性,确保安全系统在低频但高影响的情况下依然可靠。

6.3 预测建模与控制

生成式AI通过学习交通动态的潜在分布,为ITS中更准确和自适应的预测建模做出贡献。它能够预测未来交通状态、生成合成交通流模式,并模拟不同时空条件下的出行者需求。这些预测对于实现主动交通管理策略(如动态路由、拥堵定价和自适应信号控制)至关重要。此外,通过生成不确定性下的合理控制动作,生成式AI支持实时决策和系统级优化,适用于人工驾驶和自动驾驶交通系统。

6.4 多模态与系统级集成

现代ITS必须整合和协调多种交通方式------车辆、公共交通、微出行和行人。生成式AI擅长建模这些方式之间的交互和依赖关系,允许对复杂的多模态环境进行仿真。例如,它可以生成联网自动驾驶车辆(CAV)、人工驾驶车辆和弱势道路使用者之间的真实交互。这有助于开发和测试协同驾驶策略、共享空间设计和交通控制系统,确保整个网络的无缝、高效和安全运行。

6.5 弹性与应急准备

生成式AI在使交通系统为紧急情况做好准备和增强基础设施弹性方面发挥着关键作用。它可以模拟大规模中断(如自然灾害、基础设施故障或网络攻击),帮助机构评估现有系统的性能和脆弱性。通过生成超越历史极值的"压力测试"场景,规划者能够识别弱点、测试疏散策略并设计更强大的应急响应系统。这些能力有助于建立能够适应和从意外事件中恢复的弹性ITS框架,保障出行能力和公共安全。

生成式AI正在从底层数据生成到高层系统优化的全栈式重塑自动驾驶技术。从解决长尾数据稀缺问题的合成数据生成,到实现类人决策的端到端大模型,再到连接虚实世界的数字孪生,这些应用不仅推动了技术边界的拓展,也为实现安全、高效、个性化的未来交通描绘了清晰蓝图。随着技术的持续演进,生成式AI与自动驾驶的深度融合必将开启智能出行的新纪元。