一、前置准备:明确核心前提与工具

1. 必备条件

- 已完成 DataEyes 平台注册与企业认证(个人开发者需完成实名认证)

- 开通目标 API 权限(如「联网搜索 API」「BI 数据导出 API」,部分接口需单独申请)

- 开发环境:Python 3.8+(推荐 3.10)、网络可访问 DataEyes API 网关(https://api.shuyanai.com)

- 工具包:requests(请求发送)、python-dotenv(密钥管理)、pandas(数据处理)、postman(接口调试)

2. 环境搭建(终端执行)

# 安装核心依赖

pip install requests python-dotenv pandas

# 若需Protobuf格式传输(大数据量场景),额外安装

pip install protobuf二、核心步骤:新 API 接入全流程

Step 1:获取 API 密钥(关键鉴权凭证)

- 登录 DataEyes 开放平台(https://dataeyes.ai/?promoter_code=tneyky63),进入「控制台→API 管理→应用创建」

- 填写应用名称(如「电商数据同步工具」)、选择接口类型(如「聚合搜索」),提交后获取 AppID 和 AppSecret

- 生成 Authorization Token:按平台规范拼接密钥(格式:Bearer {AppID}_{AppSecret}),该 Token 有效期 24 小时,需定期刷新

- 配置 IP 白名单(可选但推荐):在「安全设置」中添加服务器公网 IP,避免密钥泄露导致风险

Step 2:接口调试(Postman 预验证)

在编写代码前,先用 Postman 验证接口连通性,避免后续代码排查干扰:

- 新建 POST 请求,URL 填写目标 API 地址(以「联网搜索 API」为例:https://api.shuyanai.com/v1/search)

- 设置请求头:

- Authorization: Bearer {你的AppID}_{你的AppSecret}(替换实际密钥)

- Content-Type: application/json(默认格式)

3.填写请求体(JSON 格式,需符合参数规范):

bash

{

"query": "2025新能源汽车补贴政策", // 搜索关键词(必填)

"date_range": "past_month", // 时间范围(可选,支持past_hour/past_day等)

"output_format": "json" // 输出格式(支持json/markdown)

}4.发送请求,若返回code: 0则说明接口正常(响应示例见下文),若报错按「问题排查」章节处理

Step 3:Python 代码实战(核心功能实现)

以下以「调用 DataEyes 联网搜索 API 获取实时数据,并解析为结构化格式」为例,包含密钥安全管理、请求发送、数据解析、异常处理全逻辑:

3.1 项目结构

bash

dataeyes-api-demo/

├── .env # 存储密钥(不提交到代码仓库)

└── main.py # 核心代码3.2 配置.env 文件(密钥安全管理)

bash

# .env文件内容(替换为你的实际密钥)

DATAEYES_APPID=your_appid_here

DATAEYES_APPSECRET=your_appsecret_here

DATAEYES_API_URL=https://api.shuyanai.com/v1/search3.3 核心代码(main.py)

bash

import requests

import os

import json

from dotenv import load_dotenv

import pandas as pd

from datetime import datetime

# 加载环境变量(避免硬编码密钥)

load_dotenv()

APPID = os.getenv("DATAEYES_APPID")

APPSECRET = os.getenv("DATAEYES_APPSECRET")

API_URL = os.getenv("DATAEYES_API_URL")

def init_headers() -> dict:

"""初始化请求头(含鉴权信息)"""

return {

"Authorization": f"Bearer {APPID}_{APPSECRET}",

"Content-Type": "application/json",

"User-Agent": "DataEyes-API-Demo/1.0"

}

def call_dataeyes_api(query: str, date_range: str = "past_week") -> dict:

"""

调用DataEyes聚合API

:param query: 搜索关键词(必填)

:param date_range: 时间范围(可选)

:return: 结构化响应数据

"""

headers = init_headers()

# 构造请求参数(严格遵循API文档的必填/可选规则)

payload = {

"query": query,

"date_range": date_range,

"output_format": "json",

"exclude_site": ["unreliable-site.com"] # 可选:过滤低可信度站点

}

try:

# 发送POST请求(超时设置10秒,避免无限等待)

response = requests.post(

url=API_URL,

headers=headers,

json=payload,

timeout=10

)

response.raise_for_status() # 捕获HTTP请求错误(4xx/5xx)

result = response.json()

# 校验响应状态

if result.get("code") != 0:

raise Exception(f"API调用失败:{result.get('message', '未知错误')}")

return result.get("data", {})

except requests.exceptions.Timeout:

return {"error": "请求超时,请检查网络或接口状态"}

except requests.exceptions.ConnectionError:

return {"error": "连接失败,请确认API地址正确"}

except Exception as e:

return {"error": str(e)}

def parse_data(raw_data: dict) -> pd.DataFrame:

"""解析原始响应数据为DataFrame(便于后续分析)"""

if not raw_data or "results" not in raw_data:

return pd.DataFrame()

# 提取核心字段(标题、摘要、来源、发布时间)

parsed_list = []

for item in raw_data["results"]:

parsed_item = {

"title": item.get("title", ""),

"snippet": item.get("snippet", ""),

"source": item.get("metadata", {}).get("url", ""),

"publish_time": item.get("metadata", {}).get("publish_time", ""),

"fetch_time": datetime.now().strftime("%Y-%m-%d %H:%M:%S")

}

parsed_list.append(parsed_item)

return pd.DataFrame(parsed_list)

if __name__ == "__main__":

# 1. 调用API获取数据

raw_data = call_dataeyes_api(

query="2025电商大促活动政策",

date_range="past_month"

)

# 2. 处理响应结果

if "error" in raw_data:

print(f"执行失败:{raw_data['error']}")

else:

# 解析数据并保存为CSV

df = parse_data(raw_data)

if not df.empty:

df.to_csv("dataeyes_search_result.csv", index=False, encoding="utf-8-sig")

print(f"执行成功!获取{len(df)}条数据,已保存至dataeyes_search_result.csv")

print("\n数据预览:")

print(df[["title", "source", "publish_time"]].head())

else:

print("未获取到有效数据")Step 4:大数据量场景优化(Protobuf 格式)

若需同步百万级数据(如全量商品信息、历史订单),推荐使用 Protobuf 格式提升传输效率:

- 从 DataEyes 平台下载接口描述文件(dataeyes_api.proto),放入项目根目录

- 编译.proto 文件生成 Python 代码:

bash

protoc --python_out=. dataeyes_api.proto代码中修改请求格式(核心变更):

bash

# 导入编译后的Protobuf模块

import dataeyes_api_pb2

def call_protobuf_api(query: str) -> dict:

headers = {

"Authorization": f"Bearer {APPID}_{APPSECRET}",

"Content-Type": "application/x-protobuf" # Protobuf格式标识

}

# 构造Protobuf请求对象

request = dataeyes_api_pb2.SearchRequest()

request.query = query

request.date_range = "past_month"

request.output_format = "json"

# 序列化请求数据

request_bytes = request.SerializeToString()

response = requests.post(API_URL, headers=headers, data=request_bytes, timeout=30)

# 反序列化响应数据

response_proto = dataeyes_api_pb2.SearchResponse()

response_proto.ParseFromString(response.content)

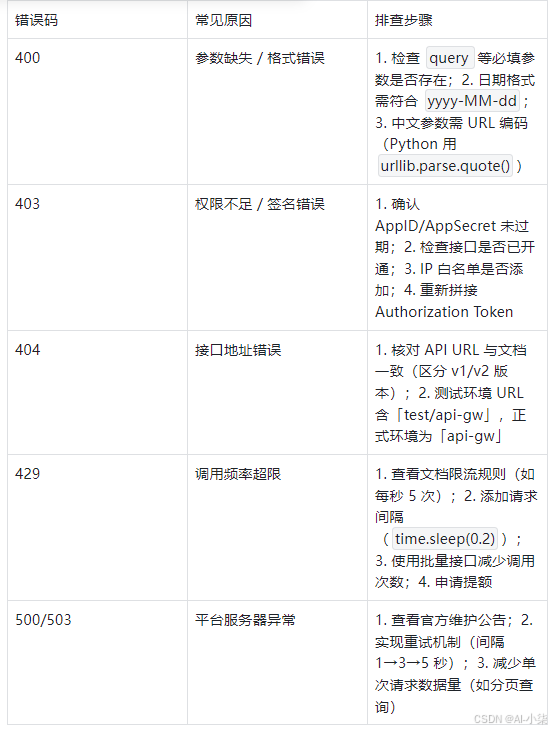

return response_proto.data.results三、问题排查:高频错误码解决方案

四、生产环境部署建议

- 密钥管理:使用环境变量或配置中心(如 Nacos),禁止硬编码到代码

- 异常处理:添加请求重试(最多 3 次)、服务降级(失败时返回缓存数据)

- 监控告警:用 Sentry 监控接口错误率,设置短信 / 邮件告警(如错误率超 5% 触发)

- 性能优化:非实时数据缓存至 Redis(过期时间 1 小时),批量任务拆分至凌晨执行

bash

以上实战已覆盖从调试到部署的完整流程,若你需要对接特定接口(如BI数据导出、多模型聚合),或使用Java/Node.js开发,可告诉我具体场景,我会补充对应代码示例和参数配置。另外,DataEyes平台支持私有化部署,若需内网环境接入,可提供部署文档和防火墙配置指南~