算法训练流程

一个成熟的算法训练流程通常包含以下 7 个核心阶段:

1. 问题定义与数据集准备 (The Foundation)

"垃圾进,垃圾出 (Garbage in, garbage out)" 是深度学习的金科玉律。

-

明确任务:是分类、回归、检测还是生成?(例如 CoIL 是为了预测车辆控制信号,属于回归任务)。

-

数据采集 :获取原始数据。高质量的顶会论文,往往不需要发明多么石破天惊的全新网络层,而是通过重新定义数据喂给模型的方式 ,就能让系统性能产生几何级数的暴涨。不要以为数据采集就只是一个很常规的操作,这里也可以玩出花来,如下

-

主动收集数据: 通过算法自动生成这些罕见但是重要的极端场景来喂给模型。如:模型发现每次遇到红灯时车速都为 0,它可能就会学成"只要车速为 0 就是红灯"。为了打破这种虚假的因果关系,工程师需要创新采样策略,故意给模型看"低速但绿灯"的罕见数据。

-

**数据闭环:**让模型自己去开,在它快要撞车或者画龙的时候,让人类专家(或规则算法)临时接管并记录下这瞬间的"纠偏"数据。这种动态采集策略能让性能产生质的飞跃。

-

DAgger (Dataset Aggregation) 算法 :这是一种极其经典的闭环采集策略。创新点在于,先用少量数据训练一个初代模型,让这个"半吊子"模型去 CARLA 里自己开车 。它肯定会犯错、会偏离车道。这时候,让人类专家(或底层的规则控制算法)在后台实时计算"如果现在是我开,我会怎么把车救回来"。把这种**"纠偏/救车"**的轨迹记录下来加入数据集。这样,模型就学会了在危险边缘如何自救。

-

时序堆叠(Temporal Stacking):单张图片看不出前车是在加速还是减速。将过去 3 帧或 5 帧的特征堆叠在一起(或者使用 RNN/历史轨迹向量)作为状态输入,赋予模型对动态物理世界的"记忆"。

-

-

特征工程与归一化:将图像像素缩放到 0, 1 或 -1, 1,对传感器数据进行标准化。

-

从图像到向量的革命:现在的特征工程创新,是把 2D 的摄像头画面,通过算法转化为 3D 的鸟瞰图(BEV),甚至直接转化为结构化的向量(如车道线的曲线方程、周围车辆的 Track Queries)。

-

特征传递的创新:不把原始数据直接扔进黑盒,而是设计一种能让"感知"、"预测"和"规划"模块互相听懂的统一的"特征语言"。这是目前端到端规划控制算法最核心的突破口。

-

-

数据集切分 :严格划分 训练集 (Train) 、验证集 (Val) 和 测试集 (Test)。验证集用于调参,测试集用于最终评估。

-

真实的驾驶数据是极度不平衡的:90% 的时间在直行,10% 的时间在转弯或刹车。如果你只是简单地把数据集按 8:2 随机切分成训练集和验证集,模型就会变成一个"只要永远输出直行,就能拿高分"的骗子。

-

基于指令的重采样(Intent-based Resampling) :这就是你可以在

Dataloader里做的核心创新。不要按顺序或随机取 Batch。你可以在加载数据时,强行设定一个比例:每个 Batch 里必须有 25% 的直行数据、25% 的左转、25% 的右转和 25% 的跟车/刹车数据。哪怕转弯的数据不够,也要把它们重复采样(Oversampling)抽出来。这能瞬间治好模型"不会拐弯"的毛病。

-

2. 数据输入管道设计 (Input Pipeline)与数据处理(清洗,增强,平衡)

数据清洗 (DataWash):去除坏样本(如损坏的图像、错误的标签)

-

数据加载 (DataLoader) :支持多线程读取(如代码中的

number_of_workers)。 -

数据增强 (Augmentation):通过旋转、缩放、对比度调整等手段,人工增加样本多样性,防止模型死记硬背。

-

数据平衡 (Balancing):如果某些场景(如左转)数据太少,需要通过采样策略让模型多看这些样本。

3. 模型架构设计 (Architecture Design)

这个地方是最容易花里胡哨没一点用,也是最容易出现惊天创新的地方

根据任务复杂度设计"大脑"结构。

-

感知层 (Backbone):使用 CNN(如 ResNet)提取视觉特征。

-

融合层 (Neck/Join):将视觉特征与其他模态(如速度、导航指令)合并。

-

任务头 (Head/Branches):输出最终结果。CoIL 采用了多分支设计,根据不同指令(左转/右转)走不同的分支。

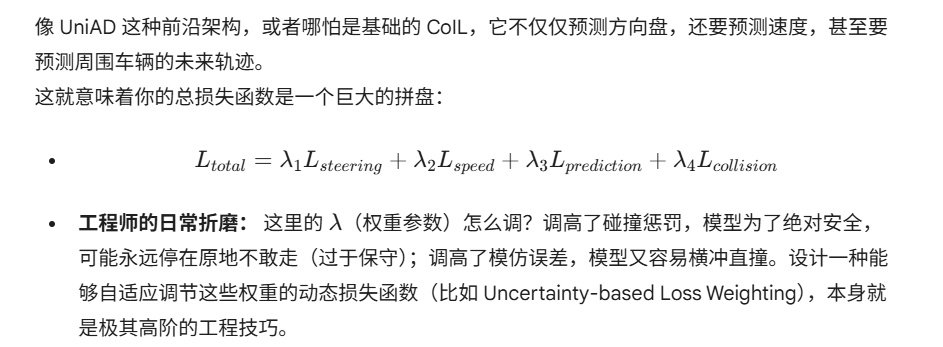

4. 损失函数与优化策略 (Optimization Strategy)

这决定了模型如何通过"犯错"来学习。

-

损失函数 (Loss Function):量化预测值与真实值的差距。

-

分类任务常用交叉熵 ( CrossEntropy )。

-

回归任务常用均方误差 (MSE) 或 L1 损失。

-

设计和调整损失函数(Loss Function),是端到端规控算法工程师最核心、也是含金量最高的工作重心之一!

为什么?因为从传统的、边界清晰的"基于规则(Rule-based)"架构,跨越到完全数据驱动的"基于学习(Learning-based)"架构时,我们失去了一个极其重要的东西:硬性约束(Hard Constraints)。

在传统算法里,你可以写一行极其简单的代码来保证安全和舒适:

if (distance_to_car < 5m) apply_brake(),或者if (lateral_accel > 0.3g) reduce_steering()。但在端到端的神经网络这个纯粹的"黑盒"里,你没法写if-else。你唯一能给神经网络立规矩、讲物理定律的地方,就是损失函数。 如果仅仅使用基础的 MSE 来计算预测轨迹和专家轨迹的误差,就会出现非常严重的情况。

工程师怎么解决? 需要设计安全感知损失(Safety-aware Loss)。比如引入环境的代价地图(Cost Map),如果预测的轨迹点落在了障碍物或者马路牙子上,即便它距离专家的轨迹只有 0.5 米,也要给予极其巨大的惩罚(Exponential Penalty)。

-

-

优化器 (Optimizer) :决定如何更新权重。常用的有 Adam (收敛快)和 SGD(更稳定)。

-

试图在优化器算法本身(比如发明一个新的 Adam)上做创新,通常是费力不讨好的,因为那是纯粹的数学/最优化理论领域的事情。作为应用算法工程师,我们绝大多数时候都是直接拿来主义:调用

optim.Adam或optim.AdamW,然后把精力花在其他地方。如果一个端到端模型表现不好,99% 的概率是数据脏了、Loss 没设计好、或者网络容量不对,极少是因为"Adam 算法不行"。

-

-

学习率调度 (LR Scheduler) :就是随着训练的推进,动态调整学习率大小的策略。

-

工业界一般用什么?

在真实的自动驾驶端到端工程中,我们绝对不会在这个环节上搞什么花里胡哨的创新。

大家用的基本就是余弦退火,直接调 PyTorch 的包

1. 目前的绝对主流:带热身的余弦退火(Cosine Annealing with Warmup)

如果你去扒如今最前沿的端到端大模型(比如 UniAD)的开源代码,90% 用的都是这个。它分为两个阶段:

第一阶段:热身(Warmup)。模型刚初始化时,权重是随机的,相当于它完全是个"瞎子"。这时候如果你直接给一个很大的学习率,它会瞬间跑飞(梯度爆炸)。所以前几个 Epoch,我们会让学习率从 0 慢慢爬升到最大值,给模型一个"热身"适应的时间。

第二阶段:余弦退火(Cosine Decay)。热身结束后,学习率会顺着一段余弦曲线(Cosine curve),非常平滑地、越来越慢地衰减。直到训练结束时,学习率降到接近于 0,确保模型能像老司机一样"稳稳地踩死刹车",精准停在最优解上。

实际工作中的用法:当你对这个模型非常熟悉,明确知道它在什么时候性能会遇到瓶颈停滞不前时,手动设一个衰减节点,强行让它缩小步子去精雕细琢。

模型如果在路上开得像个醉汉,规控工程师绝对不会 去怪学习率或者优化器。只要训练时 Loss 没有变成 NaN(梯度爆炸),我们就默认它们已经完成了使命。这绝对不是 你的工作重心,哪怕花一天时间去调这些超参数,在工业界都会被认为是浪费算力

回归到你的实际工作重心:

就像你刚才敏锐察觉到的那样,这玩意儿根本不需要你去找麻烦。在日常工程中,你只需要在配置代码里写下这两行

1.选定

CosineAnnealingLR。2.设定好初始学习率和总训练步数。

3.然后,彻底忘记它,把它抛到脑后。

-

5. 训练循环实现 (The Training Loop)

这是模型真正"进化"的过程。

- 前向传播:输入数据,计算预测结果。

在 PyTorch 框架里,大家嘴里说的"调整模型架构",本质上就是在改写前向传播(

forward函数)的内部代码!我们可以把写神经网络比作"搭乐高":

__init__函数:负责买零件(买几个卷积层、几个全连接层)。

forward函数:负责拼装图纸(决定这些零件是怎么连起来的,谁先拼,谁后拼)。所以,当你发现"模型不好,需要去调整模型"的时候,你点开代码,最终修改的其实就是那个

forward函数里的数据流向图。

-

计算损失:对比真值,计算误差。

-

调用loss函数,计算误差

-

-

反向传播:计算梯度并更新权重。

在实际应用中,反向传播(Backpropagation)绝对是最固定、最不需要你操心、也绝不是你工作重心的地方。

1. 反向传播到底是在干嘛?

前向传播(Forward) = 学生在考场上把整张试卷做完,交卷(模型给出预测的方向盘角度)。

计算损失(Loss) = 老师拿着红笔批改,算出来你这道题偏了多少度,扣了 20 分。

反向传播(Backward) = 考后订正与反思。 学生拿着扣了 20 分的卷子,开始在脑子里"往回推":"这道题做错,是因为我最后一步公式用错了;最后一步用错,是因为我中间那个变量算错了;中间算错,是因为我一开始审题就瞎了......" 在这个"往回推"的过程中,学生把大脑里负责每一道工序的神经元都揪出来挨个批评,并告诉它们:"下次遇到这种情况,你应该把权重调大/调小一点!"

在数学上,这就是高数里的链式求导法则(Chain Rule),把误差(Loss)的梯度一层一层地往回传给每一个网络参数。

2. 一般怎么写代码?它是固定的吗?

它是绝对、彻底、死死固定的。

在没有 PyTorch 这些深度学习框架的远古时代,写反向传播简直是程序员的噩梦,需要手动推导几百页的微积分公式。但现在,像 PyTorch 这样的框架拥有极其强大的自动求导机制(Autograd)。

在

train.py核心代码里,整个庞大复杂的反向传播,在代码里仅仅只有一行:

loss.backward()就这短短半行代码,PyTorch 在底层会自动帮你把几千万个参数的梯度全部算得清清楚楚。

3. 模型开不好,我们要找反向传播的麻烦吗?

绝对不找! 作为一名在工位上搬砖、致力于把车造出来的端到端规控算法工程师,只要你敲下

loss.backward()这行代码没有报错,你的反向传播任务就结束了。

- 模型快照 (Checkpointing):定期保存模型权重。这样如果程序崩溃(或发生欠拟合/过拟合),你可以随时回到之前的状态。

6. 验证、评估与监控 (Monitoring & Evaluation)

你需要一把尺子来衡量模型到底行不行。

-

实时监控 :使用 TensorBoard 或类似工具查看 Loss 曲线。如果训练 Loss 下降但验证 Loss 上升,说明发生了 过拟合。

-

多指标评估:除了 Loss,还要看业务指标(如自动驾驶中的碰撞率、离轴距离等)。

-

早停机制 (Early Stopping):如果模型性能连续多个周期不再提升,及时停止训练以节省资源。

7. 部署与闭环 (Deployment & Feedback)

模型训练好后,需要经受实战考验。

- 推理优化:通过量化 (Quantization) 或剪枝 (Pruning) 压缩模型,使其在嵌入式设备或车载电脑上跑得更快。

1. 量化和剪枝在干嘛?

我们在服务器(比如 A100 显卡)上训练出来的端到端模型,权重通常是 32 位浮点数(FP32),体积巨大,算起来极耗电、极占显存。

但真车上的边缘计算芯片(比如 NVIDIA Orin)资源极其宝贵,而且要求实时性(比如必须在 30 毫秒内出轨迹)。

剪枝(Pruning):找出网络里那些"划水"的神经元或连接(权重接近于 0 的),直接把它们咔嚓掉。

量化(Quantization):把极其精确的 32 位小数(FP32),粗暴地压缩成 8 位整数(INT8)。就像把一张 4K 高清图压缩成马赛克网图。

2. 这些代码是固定的吗?

极其固定!简直是死板!

在真实的工业界,绝对没有哪个规控工程师会去从零手写量化和剪枝的底层代码。业界全是用现成的标准工具链:

如果是 NVIDIA 芯片,就用 TensorRT。

如果是 Intel 芯片,就用 OpenVINO。

很多时候就是写几行配置脚本,把你的 PyTorch 模型(

.pth)导成通用的中间格式(.onnx),然后再交给这些厂商提供的编译工具,一键生成车端能跑的引擎文件。3. 部署效果不好,找谁的麻烦?

重点来了!这里有一个自动驾驶公司内部经典的"甩锅"与"合作"场景。

如果你的模型在本地电脑或服务器上(FP32)跑 CARLA 闭环简直是车神,但一经过量化部署到真车上(INT8)就画龙、撞墙,这确实是量化惹的祸(精度掉得太狠了)。

但是,你绝对不会去找量化代码的麻烦,你也不需要去改 TensorRT 的底层逻辑。 因为这是部署工程师(Deployment Engineer)或者AI 基建团队的活儿。

属于端到端规控算法工程师(E2E P&C)真正、唯一的核心腹地,就是被你牢牢锁定的那三样:

数据的清洗与重采样(教模型见世面)

前向规控分支的逻辑设计(教模型懂因果)

损失函数 Loss 的惩罚项设计(教模型懂规矩)

-

部署测试:在模拟器(如 CARLA)或真实环境中运行模型。

-

数据闭环:收集模型表现不好的"困难样本",重新标注并送回第一步,开启下一轮训练迭代。

总结:每个阶段都会影响模型的性能,并不是要死磕模型架构炼丹,在发现问题之后,要能够去思考到可能是哪里出了问题,在哪个地方可以去做优化解决这个问题。这个很需要经验,也很需要你对于深度学习原理的扎实理解

如何排查问题所在:

第一诊:看"体温"(Loss 曲线与基础指标)

这是最基础的排查,看模型在训练集和验证集上的 Loss 下降趋势。

症状 A:训练集 Loss 降不下去,模型什么都没学到(Underfitting)。

- 定位: 这通常是特征工程 或模型架构的问题。要么是你给的图像分辨率太低、关键特征被破坏了(比如没做归一化,导致梯度爆炸);要么是模型太小,也就是你用的卷积层或全连接层参数量不够,脑容量太小,记不住复杂的驾驶逻辑。

症状 B:训练集 Loss 极低,但验证集 Loss 很高(Overfitting)。

- 定位: 绝对是数据集的问题。这说明模型在"死记硬背"训练数据。原因要么是数据量太少,要么是数据缺乏多样性(比如只在晴天采集,一到雨天就瞎了)。此时你需要增加数据增强(Data Augmentation)或者去采集更多场景。

第二诊:看"临床表现"(CARLA 仿真中的 Error Analysis)

不要只看平均 Loss,平均值会掩盖很多真相。必须把模型放进 CARLA 里跑,或者在验证集上把预测错的那些帧单独拎出来看。

症状 C:模型在直道上开得极好,一到十字路口就画龙、撞墙,或者永远只会直行。

- 定位: 百分之百是数据集切分与采样 出了问题。这就是典型的"长尾分布"陷阱。因为你的数据里 90% 都是直行,转弯数据太少。模型发现"只要一直输出方向盘转角为 0,就能拿 90 分",它就懒得学转弯了。药方: 在 Dataloader 里加入重采样(Resampling),强行把转弯数据的比例拉高。

症状 D:明明前面是绿灯,而且没有车,模型却莫名其妙地踩死刹车。

- 定位: 极大概率是特征工程 出了问题,产生了"因果混淆(Causal Confusion)"。模型可能发现你训练集里刹车的时候,周围恰好都有建筑物的阴影,它就把"阴影"当成了"刹车信号"。药方: 这时需要剔除干扰特征,或者在采集阶段主动引入"有阴影但不刹车"的数据来打破这种伪因果。

第三诊:看"反应速度"(时序与动态表现)

端到端驾驶不仅是看单张图,还要看连续的动作。

症状 E:方向盘抖动极其剧烈,像在疯狂画"Z"字型。

- 定位: 这是特征输入或模型架构 的缺陷。如果模型只看当前这一帧图片,它根本不知道上一秒自己往哪打了方向盘,导致动作不连贯。药方: 在特征层面,把过去 3 帧的图像拼接起来作为输入;或者在架构层面,加入 RNN/LSTM 模块,让模型拥有"短期记忆"。

症状 F:遇到红绿灯反应总是慢半拍。

- 定位: 可能是感知特征 提取阶段出了问题。全连接层或普通的卷积池化可能把红绿灯这种在画面中只占几个像素的"高频小目标"给过滤掉了。药方: 考虑在网络架构中引入注意力机制(Attention),强迫模型盯住红绿灯区域。

第四诊:终极杀器 ------ 消融实验(Ablation Study)

如果你怀疑是某个环节出了问题,怎么证明你的直觉是对的?这就是学术界最看重的"消融实验"。

假设你怀疑是"数据不平衡"导致了模型转弯很烂。你怎么证明?

Baseline(控制变量): 用原始代码、原始数据集训练一个模型,记录转弯成功率(假设为 30%)。

Experiment(施加单一变量): 其他什么都不改,仅仅在

dataset.py里加一段代码,把转弯的数据复制 3 遍(Oversampling),重新训练。Result: 如果转弯成功率飙升到了 80%,你就完美证明了问题出在数据分布上!这就是一篇顶级会议论文里最核心的图表来源。

如何提高解决问题的能力:

学习别人的训练经验

多看看论文,看看别人是如何面对一些问题并解决的,学习他们的思路与创新想法

e2e算法工程师每天到底在干嘛?

在工业界,一个端到端规控工程师天天在工位上设计新的 Transformer 架构,他大概率连试用期都过不了。

现实情况哪有那么多惊天动地的创新?

大部分时候,随便改个网络结构,换来的都是仿真里极其惨烈的车祸,性能不升反降。

从传统的、边界清晰的基于规则(Rule-based)的系统,跨越到完全数据驱动的端到端网络,最大的工程痛点根本不是"模型不够fancy",而是"这玩意儿究竟为什么又撞了"。

真实的端到端规控算法工程师,日常 80% 的工程精力都花在以下这几件"接地气"甚至有点折磨人的事情上:

1. 疯狂的"挖数据"与"洗数据" (Data Engine)

这是日常最核心的工作。当一辆测试车(或者仿真车)在某个路口画龙了,或者前车急刹它没反应过来,你的工作不是去改代码加深网络,而是去海量的历史数据库里捞数据。

写脚本采数据:写 SQL 或者用专门的工具,从车队采集的千万公里数据里,挖出 1000 个类似的"前车急刹"或者"无保护左转"的场景。

洗掉"脏标签":人类司机在路口可能也会犹豫、顿挫、甚至违规。如果你把这些带有"人类坏习惯"的 Ground Truth 直接喂给模型,模型就会学坏。你需要写规则去过滤、平滑这些轨迹标签。

2. 解决开闭环的"貌合神离" (Metric Engineering)

这是端到端领域最让人头疼的日常。

现象:你在离线训练时,模型预测的轨迹和真实轨迹的误差(L1/L2 Loss)极小,指标漂亮得能发顶会。结果一上车(或者进 CARLA 闭环跑),模型起步就压实线、撞马路牙子。

日常工程 :你需要设计各种新的评估指标。比如,不能只看轨迹点的绝对距离误差,还要算碰撞率、偏航率、甚至是乘坐舒适度(加速度的导数 Jerk)。你需要不断调整,试图让"离线刷榜的指标"和"真实上路的效果"真正对齐。

3. 表征工程 (Representation Engineering)

也就是怎么把现实世界"翻译"给模型听。

图像进网络前,是保持原图,还是转成 BEV(鸟瞰图)?

导航指令怎么给?是给一个粗糙的"1代表左转,2代表直行"(像 CoIL 那样),还是给一条由十几个 GPS 坐标点组成的离散参考线?

工程师每天都在调这些输入的格式,因为输入特征的信噪比,直接决定了模型会不会产生幻觉。

4. 调试"黑盒"与兜底策略 (Debugging & Fallback)

在真正的商业落地中(哪怕是在大厂的自动驾驶子公司),没人敢把身家性命完全交给一个端到端的黑盒。

当端到端模型输出了一条轨迹,日常工程很大一部分是写一层轻量级的规则校验层。

比如,无论模型怎么预测,这层规则会强行校验:预测轨迹是否超过了物理极限?是否跨越了不可逾越的障碍物?工程师需要把深度学习和传统的安全兜底逻辑结合起来,保证系统不失控。

5. 模型轻量化与部署 (Deployment)

当你终于训出了一个好用的庞大模型,下一步就是把它塞进车端算力有限的芯片里。

剪枝、量化(把 FP32 压缩到 INT8)。

盯着算子耗时,把原本需要 100 毫秒推理的模型,硬生生优化到 30 毫秒以内,保证控制系统的实时性。

规控算法工程师的日常/遇到bad case如何处理?

假设现在测试团队提了一个工单:

场景 A(比如:主路直行时,右侧辅路突然有辆车强行加塞,我们的端到端模型没有减速避让,而是直直地冲过去,最后触发了安全员紧急接管)。

面对这种典型的实车 Bad Case,一线工程师的真实处理流程通常分为以下四步极其标准化的"流水线"操作:

第一步:案发现场重建(数据回放与对齐)

你绝对不能靠猜,也不能直接去改代码。第一步是把那段触发接管的行驶日志(Log / ROS Bag)从云端拉下来,放到本地的可视化工具里(比如 Foxglove 或公司自研的平台)进行逐帧回放。

在这个阶段,规控工程师必须盯着屏幕核对三件事:

当时的输入特征(Input):摄像头看到了什么?BEV(鸟瞰图)或 Occupancy(占用网格)建得对不对?加塞车的位置、速度和朝向是否准确?

人类老司机的真实操作(Ground Truth):当时安全员接管后,踩了多深的刹车?方向盘动了没有?

模型的案发预测(Prediction):把当时的环境数据重新喂给你的本地模型,看它在那几秒钟里,输出的轨迹点(Waypoints)和速度曲线到底长什么样。

第二步:极其现实的"分锅"环节(模块隔离分析)

虽然叫"端到端",但在工程落地时,为了能 Debug,绝大多数模型(如 UniAD 架构)中间是会输出感知结果的。这时候就要看是谁的锅了:

情况 1:感知模块瞎了(上游全责)。 如果可视化界面里,辅路那辆加塞的车根本没被识别出来,或者测距偏了 5 米。那你直接把这个 Case 打回给感知团队或者数据标注团队。这事儿规控工程师不管,直接结案。

情况 2:规控模块傻了(你的全责)。 如果 BEV 图极其清晰,加塞车的速度、轨迹预测得完美无缺,但你的规控分支依然输出了一段撞上去的加速轨迹。很好,案子落到你手里了,开始干活。

第三步:深挖规控的"病因"(Root Cause Analysis)

确认是 P&C(规划与控制)的问题后,你需要打开 VS Code 开始排查逻辑。在工业界,病因通常逃不出这三种:

见识太少(Data Distribution Bias):去查查你的训练集,可能 95% 都是跟车和空旷直行,这种"极限加塞"的数据占比不到 0.1%。模型根本没学过这种场景。

人类老师教坏了(Noisy Ground Truth):你顺藤摸瓜去数据库里搜"加塞"场景,发现以前人类司机遇到加塞时,操作也是千奇百怪:有的急刹,有的按喇叭加速抢道。数据里的标签充满了矛盾,模型直接学懵了(这叫多模态冲突)。

因果混淆(Causal Confusion):这个路口刚好有个奇怪的交通牌,模型在这个特定场景下,错误地把那个交通牌和"加速"强绑定了。

第四步:规控工程师的"解决三板斧"

病因找到后,怎么解决?在讲究落地效率的公司里,工程师有三套最常用的武器:

武器一:疯狂榨取数据引擎(Data Engine)------ 最常用、最有效

这通常占据了规控工程师 70% 的日常精力。不要去改网络结构,而是去洗数据。

写脚本挖数据: 连上公司的数据湖,写 SQL 或 Python 脚本,用特定的运动学条件(比如 TTC < 1.5s 且横向有车辆切入),从几千万公里的历史日志里,精准捞出 5000 个高质量的"加塞"片段。

清洗与重采样(Resampling): 写规则过滤掉那些人类司机操作犹豫、急刹顿挫的坏帧。然后在 DataLoader 里强行把这几千个场景的采样权重拉高。模型重新训一版,往往立马治病。

武器二:给 Loss 加物理外挂(Loss Engineering)------ 技术含量最高

如果洗数据还不够,就要在损失函数上动刀子。

纯粹的 L1/L2 误差不管用,你需要在代码里(比如

loss.py)写一个基于安全距离的惩罚项(Safety Penalty)。比如:计算模型预测轨迹与旁边加塞车辆的未来碰撞概率,如果轨迹侵入了加塞车的安全包络,给一个巨大的指数级惩罚(Exponential Cost)。逼着网络在更新权重时,刻在骨子里地学会"让速不让道"。

武器三:写规则兜底(Safety Fallback)------ 真实的工业遮羞布

明天就要给客户做 Demo,或者马上要发新的 OTA 版本,重新训模型根本来不及怎么办?

工程师会直接在端到端模型的输出端后面,用 C++ 或 Python 补一段极其传统的、基于规则的防碰撞代码。

比如:

if (Time_to_Collision < 1.0s) { override_model(); apply_hard_brake(0.8g); }。所有的顶级自动驾驶公司都在做这种事。端到端负责上限和拟人感,传统的规则代码负责守住安全的底线。

总结一下: 真实的规控工程师,日常就是在回放数据、写脚本捞长尾数据、洗特征标签、调 Loss 惩罚权重,以及写兜底的安全逻辑之间反复横跳。真实的工业界端到端规控工程师,是一个**"披着深度学习外衣的系统工程师与数据大厨"**。你的核心价值在于:用工程手段保证绝对安全,用数据手段解决长尾问题,用规控常识保证乘坐舒适。

不是有数据工程师吗,为什么规控也要管理数据?

我们可以把这个合作模式理解为**"修水管"和"调水质"**的区别:

1. 数据工程师:负责建水库和修水管 (Infrastructure)

数据工程师(或者大数据架构师)的核心能力在工程架构,而不是自动驾驶的规控逻辑。他们的日常是:

搭基建:维护庞大的 Hadoop/Spark 集群,管理 PB 级别在云端(如 AWS/阿里云)的数据存储。

写底层 Pipeline:写代码把车端硬盘里的 ROS bag 或者原始日志解包,存进分布式数据库里。

造工具:开发内部的数据标注平台,或者开发一个能让算法工程师快速通过 SQL 查数据的可视化网页。

他们解决的是:"如何让一天 1000 辆车跑出来的数据,快速、不丢失、低成本地存下来并能被搜到"。

2. 规控算法工程师:负责决定什么才是好水 (Domain Logic)

这就是你日常要做的核心工程。数据工程师不知道模型为什么在十字路口撞车,只有你知道。因此,"洗数据"和"挖数据"的规则,必须由算法工程师来定:

定义"坏数据":数据工程师可以帮你把所有左转的数据捞出来。但你要写脚本去筛掉其中"人类司机踩了一脚急刹导致加速度突变"的坏帧。因为只有你懂动力学约束,知道这种标签喂给模型会导致控制输出震荡。

挖掘"高价值数据":当你发现模型对"行人鬼探头"反应慢,你不能直接跟数据工程师说"给我弄点鬼探头的数据"。你需要自己写一段基于时空碰撞时间(TTC)的计算脚本,放到他们建好的数据平台上跑,精准地把那些 TTC < 1.5秒 的惊险瞬间提纯出来。

特征重构:数据工程师给你的是原始的 GPS 坐标和偏航角。你要自己写特征工程,把它们转换成自车坐标系下的相对轨迹点(Waypoints),或者做平滑滤波(如 Kalman Filter 处理),这直接决定了模型好不好收敛。

总结来说: 数据工程师提供铲子和矿场 ,但鉴别哪块是金矿、哪块是废石,并把粗糙的金矿打磨成可以喂给神经网络的完美特征,是端到端规控算法工程师的绝对主业。如果不亲自下场看数据、洗标签,是不可能训出能在实车上落地的模型的。

规控工程师的日常数据工作 (Data Pipeline)

在你的日常工作中,处理这种"视频数据"通常包含以下几个硬核步骤:

同步 (Synchronization):这是最烦人的工程活。相机的快门、惯导的数值、底盘的方向盘信号,采样频率都不一样(比如相机 20Hz,底盘 100Hz)。你得写脚本把它们按时间戳强行对齐到同一帧。

切片 (Slicing) :你不会把一整段 10 分钟的视频直接扔进去。你会把它切成无数个 2 到 5 秒的 "片段 (Clips)"。每个片段就是一个独立的模仿学习样本。

关键帧挖掘 (Mining):就像我们之前聊的,直行视频太多了。你会写个过滤器,把那些有转弯、有加塞、有急停的视频片段单独拎出来,给它们打上"高价值"标签。