近期以太坊创始人Vitalik Buterin提出的AI Agent安全模型在技术社区引起广泛讨论。作为开发者,我们不能仅仅停留在概念层面,更需要关注如何在工程实践中落地这一安全理念。本文将深入解析Human+LLM 2-of-2验证机制的技术实现细节。

为什么需要双重验证?

现代AI Agent与传统聊天机器人的本质区别在于自主性。自主Agent能够规划任务、调用工具、与外部系统交互,这些能力带来了新的安全挑战:

传统安全控制的局限性

早期的Agent安全主要依赖于简单的权限控制和关键词过滤。但对于自主Agent,这些方法明显不足:

- 误操作风险:Agent可能基于错误理解执行有害操作

- 权限滥用:Agent可能被诱导执行超出授权的操作

- 数据泄露:敏感数据可能在处理过程中意外暴露

- 责任归属:自主操作的法律责任难以界定

安全需求的演进路径

从安全控制的角度看,Agent安全经历了三个阶段:

- 静态权限控制:基于角色的访问控制

- 动态安全检查:操作级别的风险评估

- 双重验证机制:Human+LLM协同决策

Human+LLM 2-of-2验证架构设计

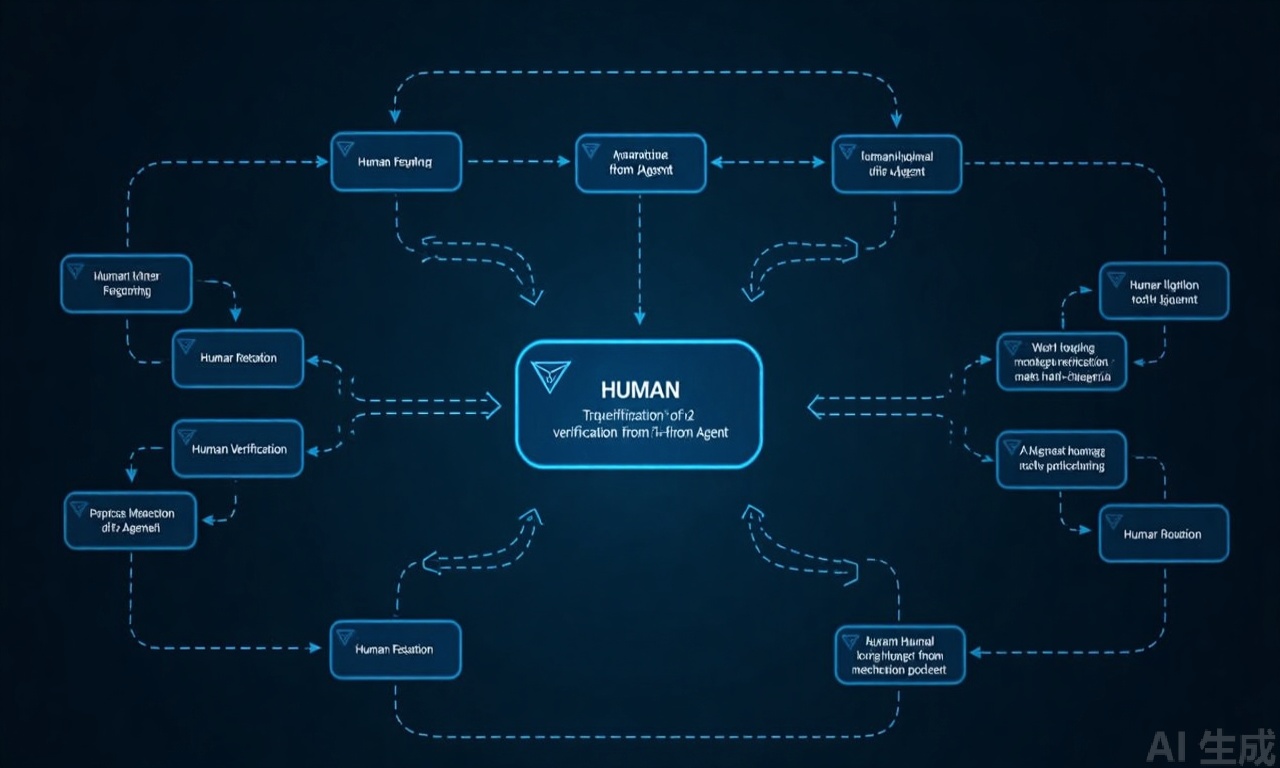

核心工作流设计

标准的双重验证流程包含五个关键步骤:

1. 操作拦截 → 2. 人类验证 → 3. AI验证 → 4. 联合决策 → 5. 审计记录每个环节都有具体的技术实现要求:

人类验证环节

- 提供完整的操作上下文信息

- 展示Agent的决策依据和推理过程

- 提供历史相关操作记录

- 给出风险评估和替代方案

AI验证环节

- 使用独立的LLM进行安全评估

- 检查是否符合安全策略约束

- 评估操作的具体风险等级

- 提供技术层面的改进建议

验证中间件实现

在现有Agent系统中集成2-of-2验证,需要设计专门的验证中间件:

python

class TwoOfTwoVerifier:

def __init__(self, human_validator, ai_validator, audit_logger):

self.human_validator = human_validator

self.ai_validator = ai_validator

self.audit_logger = audit_logger

async def verify_action(self, action, context):

# 并行启动人类和AI验证

human_task = self.human_validator.validate(action, context)

ai_task = self.ai_validator.validate(action, context)

human_result, ai_result = await asyncio.gather(human_task, ai_task)

# 检查双重验证结果

if human_result.approved and ai_result.approved:

self.audit_logger.log_approved(action, context, human_result, ai_result)

return ApprovalStatus.APPROVED

else:

self.audit_logger.log_rejected(action, context, human_result, ai_result)

return ApprovalStatus.REJECTED与传统RBAC的差异对比

很多开发者容易将双重验证理解为RBAC的升级版,但实际上两者有本质区别:

| 对比维度 | 传统RBAC | 2-of-2验证 |

|---|---|---|

| 决策机制 | 静态权限检查 | 动态风险评估 |

| 验证主体 | 单一权限系统 | 双重独立验证 |

| 上下文感知 | 权限标签为主 | 完整操作上下文 |

| 审计深度 | 简单操作记录 | 完整决策过程 |

分阶段实施指南

阶段一:基础安全拦截

对于尚未建立安全体系的Agent系统,建议从基础拦截开始:

- 识别高风险操作:定义需要验证的操作类型

- 实现简单拦截:在关键接口处添加验证拦截

- 配置通知机制:将验证请求发送给指定监督者

- 建立基础日志:记录所有拦截操作的基本信息

阶段二:集成AI风险评估

在基础拦截基础上增加AI安全评估:

- 选择安全模型:集成专门的安全评估LLM

- 设计评估接口:定义标准的安全评估协议

- 实现决策支持:为人类验证提供AI建议

- 建立反馈机制:持续优化风险评估准确性

阶段三:完整双重验证体系

建立完善的2-of-2验证系统:

- 部署验证服务:实现独立的验证中间件

- 优化验证界面:设计人类友好的验证界面

- 完善审计系统:构建完整的操作审计日志

- 制定应急流程:建立验证失败的安全处理机制

场景化安全配置策略

不同应用场景的安全需求差异很大,需要针对性配置:

金融交易Agent

- 验证严格度:最高级别,所有资金操作双重验证

- 响应要求:实时验证响应,超时自动拒绝

- 备份策略:多层验证机制,确保业务连续性

数据访问Agent

- 验证严格度:中等,敏感数据访问需要验证

- 隐私保护:验证过程加密,保护用户隐私

- 性能优化:验证结果缓存,减少重复验证

企业自动化Agent

- 配置灵活性:不同工作流可设置不同安全级别

- 批量处理:支持批量操作验证

- 系统集成:与企业现有安全系统对接

开源协作Agent

- 社区治理:验证角色分配给多个维护者

- 透明度:验证过程对社区公开

- 性能考虑:轻量级实现,减少系统开销

性能与安全的平衡优化

实施双重验证时,需要在安全性和性能之间找到平衡点:

验证响应时间优化

- 异步验证机制:验证不阻塞主业务流

- 结果缓存策略:对重复操作使用缓存结果

- 快速通道设计:为低风险操作设计快速验证

人工验证效率提升

- 智能验证分配:基于风险等级动态分配验证需求

- 信任度系统:减少已验证Agent的重复验证

- 批量验证界面:提高人类监督者的处理效率

紧急情况处理

- 快速验证通道:为紧急操作设计专用验证流程

- 超时安全策略:验证超时的自动安全处理

- 多级备份:设置多个验证备份节点

开发者安全自查清单

在实施双重验证前,建议完成以下技术评估:

风险评估基础

- 识别系统中的高风险操作类型

- 评估现有安全控制的覆盖范围

- 分析历史安全事件和风险点

- 确定不同场景的安全等级需求

技术实现准备

- 评估架构对验证中间件的支持程度

- 设计人类验证的界面实现方案

- 选择AI验证模型和技术方案

- 规划审计日志的存储和管理方案

团队流程建设

- 确定验证监督者的角色职责

- 制定验证流程的标准操作程序

- 设计安全事件响应和处理流程

- 建立定期安全审计机制

实施计划制定

- 选择低风险场景进行试点实施

- 设定验证性能的基线指标

- 规划安全覆盖的扩展路线图

- 制定实施问题的回滚方案

技术总结

Vitalik提出的Human+LLM 2-of-2验证模型为AI Agent安全提供了一个可行的技术框架。对于开发者来说,关键是将这一概念转化为可落地的工程实践。

从技术角度看,双重验证的核心价值在于:

- 降低误判风险:两个独立系统的协同决策

- 增强安全深度:从静态权限到动态风险评估

- 完善审计追踪:完整的决策过程记录

- 支持灵活配置:适应不同场景的安全需求

建议开发者从现在开始,评估现有Agent系统的安全状况,设计符合业务需求的安全验证机制。记住,安全不是一次性的项目,而是需要持续投入和优化的系统工程。