总目录 大模型相关研究 2025版:https://blog.csdn.net/WhiffeYF/article/details/142132328

https://arxiv.org/pdf/2502.00640v3

该论文由斯坦福大学、微软研究院与佐治亚理工的研究团队联合完成,发表于国际机器学习顶级会议ICML 2025。

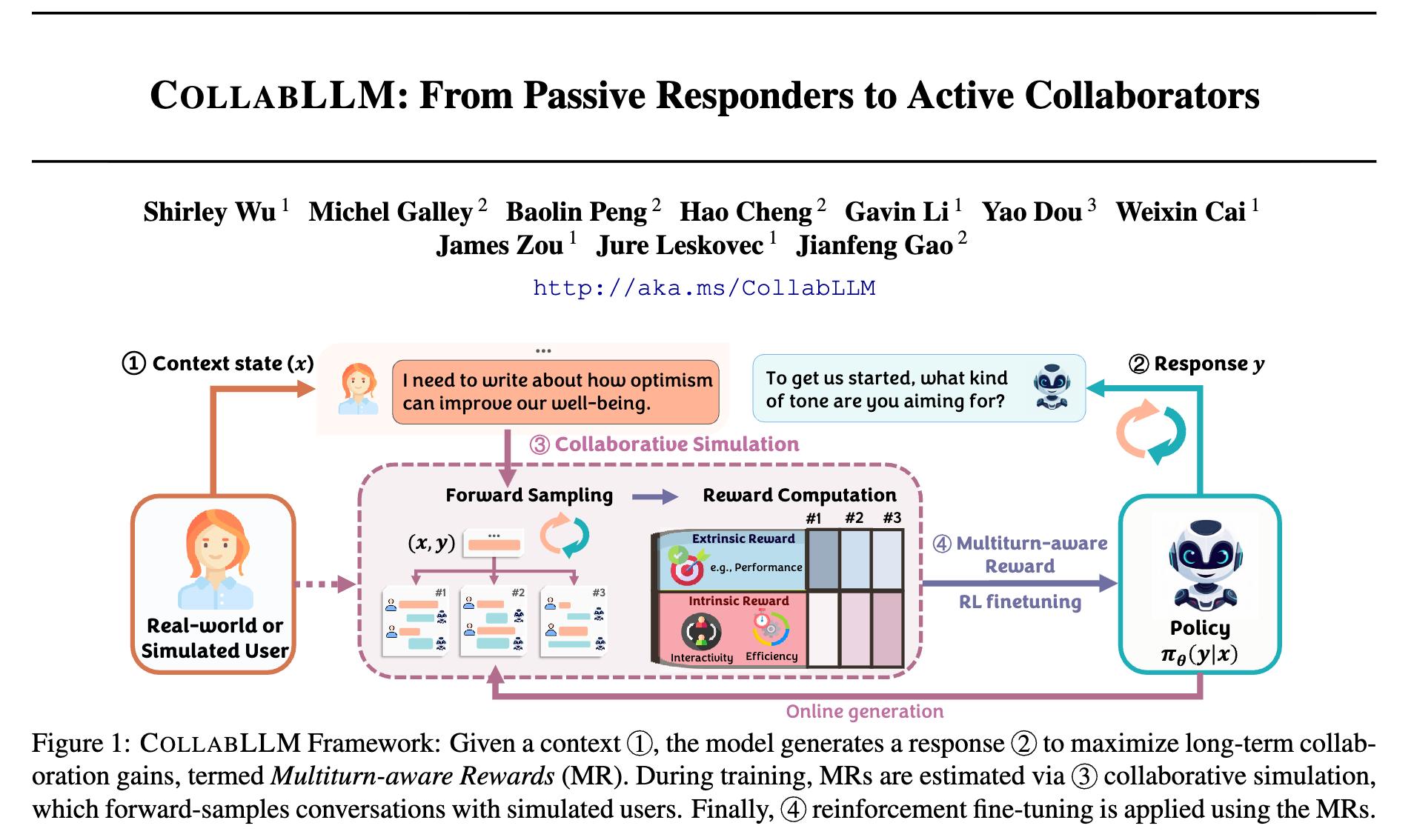

现有大语言模型通常针对单轮回复进行优化,面对用户模糊或开放性的需求时,往往被动地直接作答,导致用户需反复纠正,既耗时又影响体验。该论文提出的COLLABLLM框架,首次将"多轮感知奖励"(Multiturn-aware Rewards)引入模型训练,通过协作模拟预估每个回应对长期对话走向的影响,使AI从"问答工具"进化为"协作伙伴"。

以一个具体场景为例:当你说"我想写篇关于乐观主义的文章"时,传统AI可能直接生成长篇大论,结果风格不符你的预期,不得不推倒重来。而COLLABLLM会主动询问:"您希望文章是A.励志向上、B.温情治愈还是C.学术严谨?是否需要加入个人经历?"在确认关键细节后再精准创作,避免无效往返,显著提升协作效率与成品质量。

实验表明,该方法在文档编辑、编程辅助和数学解题等多轮任务中,平均提升任务表现18.5%、交互性46.3%,并让用户满意度提升17.6%,节省时间10.4%。