【大语言模型】 AVGen-Bench:一个用于文本到音频-视频生成的多粒度、任务驱动型评估基准

目录

文章目录

- [【大语言模型】 AVGen-Bench:一个用于文本到音频-视频生成的多粒度、任务驱动型评估基准](#【大语言模型】 AVGen-Bench:一个用于文本到音频-视频生成的多粒度、任务驱动型评估基准)

📌 文章信息

- 原始标题: AVGen-Bench: A Task-Driven Benchmark for Multi-Granular Evaluation of Text-to-Audio-Video Generation

- 中文翻译: AVGen-Bench:一个用于文本到音频-视频生成的多粒度、任务驱动型评估基准

| 项目 | 内容 |

|---|---|

| arXiv ID | 2604.08540v1 |

| 作者 | Ziwei Zhou, Zeyuan Lai, Rui Wang, Yifan Yang, Zhen Xing 等 (9位作者) |

| 发布日期 | 2026-04-09 |

| 搜索日期 | 2026-04-12 |

| arXiv 链接 | https://arxiv.org/abs/2604.08540v1 |

📄 摘要信息

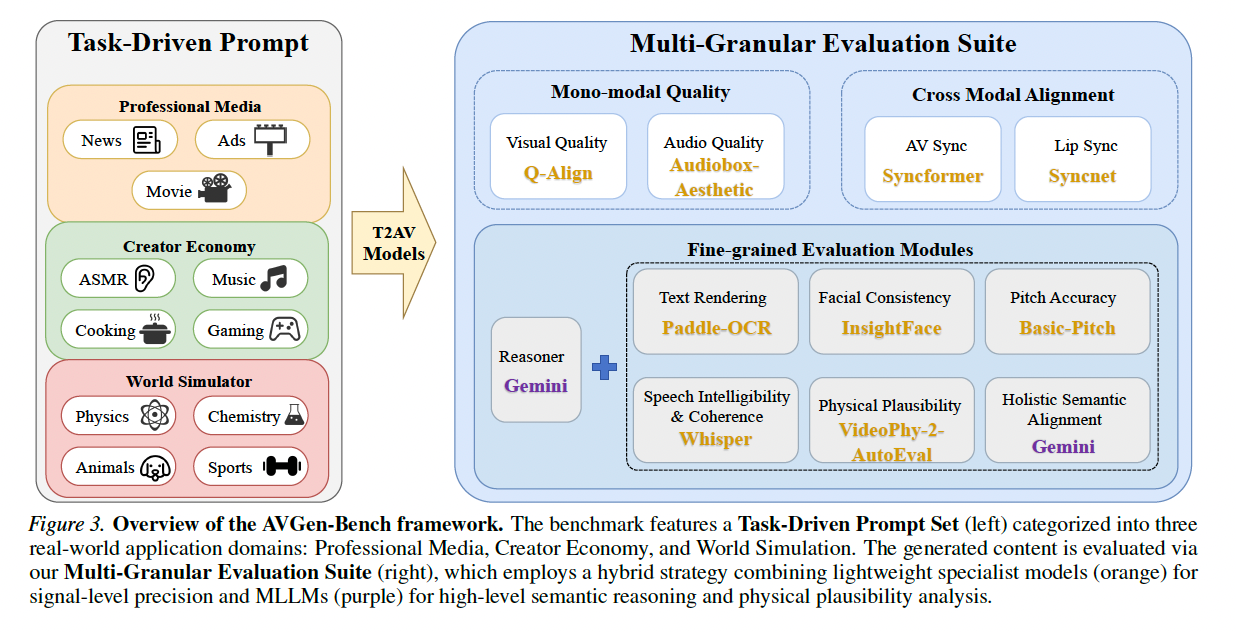

文本到音频-视频(T2AV)生成正迅速成为媒体创作的核心接口,然而其评估体系仍然支离破碎。现有的基准测试主要在隔离状态下评估音频和视频,或依赖粗糙的嵌入相似度,无法捕捉真实场景提示词所要求的细粒度联合正确性。为此,我们引入了AVGen-Bench,一个面向T2AV生成的任务驱动型基准测试,其特点是涵盖了11个真实世界类别的高质量提示词。为了支持全面的评估,我们提出了一个多粒度评估框架,该框架结合了轻量级专家模型和多模态大语言模型(MLLMs),能够实现从感知质量到细粒度语义可控性的评估。我们的评估揭示了模型在强大的视听美学表现与薄弱的语义可靠性之间存在显著差距,包括在文本渲染、语音连贯性、物理推理方面的持续性失败,以及在音高控制方面的普遍性失效。代码和基准资源已在上发布。

1. 🔍 研究背景

生成式视频领域正经历着一场根本性的转变:从无声的"文本到视频"(T2V)生成,迈向多模态的"文本到音频-视频"(T2AV)生成。这种转变并非简单的功能升级,因为在许多真实世界的AIGC场景中,音频对于传递信息、营造真实感和沉浸感至关重要。一个没有声音的、视觉上合理的视频往往是平淡且信息量不足的,而同步且语义正确的音频则能极大地增强沉浸感(例如,水果切片视频中清脆的切割声,或对话场景中清晰的语音)。

随着Sora 2、Veo 3.1、Kling 2.6等前沿模型的出现,T2AV生成正迅速成为面向用户的创作的标准接口。然而,该领域面临着一个关键瓶颈:缺乏一个严谨且全面的T2AV评估框架。现有的视觉基准(如VBench)和音频基准无法处理联合的视听信息。尽管最近的一些工作(如HarmonyBench、UniAVGen)试图结合音频和视频评估,但它们仍然存在两大不足:一是依赖粗粒度指标,只能评估整体质量,无法区分具体的模型能力或失效模式;二是联合评估通常简化为使用CLIP或CLAP等模型的嵌入相似度,这对于验证真实复杂提示词所需的细粒度语义对齐是远远不够的。

用户通常提供一个交织了视觉和听觉需求的单一文本提示,而当前的模型在这种设定下会反复出现一些未被充分研究的失效模式,如语音内容错误、环境音与视觉事件不匹配、嘴型不同步、物理逻辑违反等。因此,需要一个明确针对这些联合、细粒度行为的基准测试,以诊断模型弱点并指导未来研究方向。

2. ❗问题与挑战

本论文精准地识别并系统性地阐述了当前T2AV生成领域面临的几大核心问题与挑战:

-

现有基准测试的碎片化与粗粒度性:

- 模态隔离: 大部分现有基准要么只关注视频(如VBench),要么只关注音频(如TTA-Bench),无法对生成的视听内容进行联合评估。

- 评估指标粗糙: 即使是少数尝试联合评估的基准(如VerseBench),也通常只提供"整体视听质量"这样一个笼统的分数,而无法诊断出具体的错误类型,例如音高不准、文本渲染失败、物理逻辑错误等。这种"黑盒"式的评估对于模型改进指导意义有限。

- 评估方法单一: 许多基准依赖CLIP/CLAP等嵌入模型计算相似度,这种方法对于验证"特定音符是否被正确演奏"或"特定单词是否被准确渲染"等细粒度约束无能为力,容易忽略模型产生的"幻觉"。

-

缺乏真实、复杂、任务驱动的提示词:

- 许多基准的提示词设计是为了适应现有的评估指标(例如,因为有文本检测器就大量使用文字提示),而非反映真实用户需求。这导致评估结果与用户实际体验脱节。

- 真实世界的用户提示词通常是复杂且隐式地交织了视觉和听觉信息,而现有基准的提示词往往过于简单或单一,无法探测模型在处理多模态、多约束、多镜头叙事等复杂任务时的真实能力边界。

-

模型在细粒度语义控制上的系统性失效:

- 论文通过实验揭示了当前SOTA模型普遍存在的"美学-语义"鸿沟:模型能够生成视觉效果惊艳、音频质量尚可的内容,但在需要精确遵循语义指令的任务上表现极差。

- 具体失效模式 包括:

- 文本渲染: 难以生成清晰、准确的指定文本,尤其对背景中"偶然出现的文本"几乎完全失效,常渲染为乱码。

- 音高控制: 几乎所有模型都无法根据提示词生成特定的音符、音阶或和弦,表现出对基本乐理知识的缺失。

- 语音生成: 无法准确生成指定的对话内容,或在隐含语音的场景中生成无意义的"外星语"。

- 物理逻辑: 模型无法模拟正确的物理动态(如牛顿摆、钠与水反应),生成的物体运动常常违反基本物理定律。

- 面部一致性: 在镜头切换或多人物场景中,模型难以维持同一角色面部特征的稳定性,常出现身份漂移。

3. ⚙️ 算法模型

为了解决上述挑战,论文提出了AVGen-Bench,其核心并非一个单一的算法模型,而是一个 "任务驱动的基准数据集 + 多粒度混合评估框架"。该框架本身是一个复杂的算法系统,用于对T2AV模型进行自动化、多维度的量化评估。

其核心算法流程可以概括为:给定一个生成模型M和一个复杂提示词P,生成音视频样本S,然后通过一系列专用"专家"模型和多模态大模型(MLLM)构成的管线,对S在多个维度上进行打分。

核心组件解析:

-

任务驱动的提示词集(数据层):

- 采用自上而下的"意图优先"策展策略,定义了3大领域(专业媒体、创作者经济、世界模拟)、11个子类,共计235个高质量任务。提示词的设计与评估指标解耦,完全基于真实用户场景。

- 关键设计:在"乐器教程"类别中注入细粒度声学约束(如指定C大调音阶);在"物理/化学"类别中采用"欠指定提示"策略(如描述牛顿摆装置但不说明有几个球会弹起),迫使模型调用自身的"世界知识"来生成正确的物理效果。

-

多粒度混合评估框架(算法层) :

这是本工作的核心算法贡献。它摒弃了单一的评估模型,采用了"轻量级专家模型 + MLLM"的混合架构,从而实现了从底层信号保真度到高层语义推理的全覆盖。

-

基础评估模块:

- 单模态质量 : 使用 Q-Align (MLLM视觉评估器)评估视觉美学;使用 Audiobox-Aesthetic 评估音频质量。

- 跨模态对齐 : 使用 Syncformer 评估通用音视频同步;使用 SyncNet 评估唇部同步误差。

-

细粒度评估模块(核心算法创新) :

每个模块都是一个精心设计的算法管线,巧妙地串联了专家模型和MLLM。

-

a. 文本渲染质量:

- 算法管线 :

PaddleOCR(专家模型,提取文本) →时空聚类算法(去重聚合) →Gemini(MLLM,进行双重验证:1. 检查提示词中的指定文本;2. 评估偶然出现的文本的语义合理性)。 - 关键点: 不仅检查是否"写对了",还检查"写的是否符合场景",例如新闻滚动条是否合理。

- 算法管线 :

-

b. 面部一致性:

- 算法管线 :

InsightFace(专家模型,提取人脸嵌入和边界框) →混合跟踪算法(结合IoU和余弦相似度构建跟踪片段) →DBSCAN聚类 (识别不同角色) →Gemini(MLLM,预测提示词中的角色数量) →加权聚合(40% 角色数量准确性 + 60% 角色身份稳定性)。 - 关键点: 实现了无参考(reference-free)的面部一致性评估,可以自动发现"多出来"或"丢失"的角色。

- 算法管线 :

-

c. 音高准确性:

- 算法管线 :

Gemini(MLLM,从提示词中提取结构化音乐约束) →Basic-Pitch(专家模型,音频转MIDI符号) →Gemini(MLLM,进行符号逻辑验证,检查生成的音符序列是否符合乐理要求)。 - 关键点: 通过"符号-神经"管线,将抽象的音频波形转化为具体的音符事件,再用MLLM进行可解释的逻辑验证,彻底解决了黑盒模型无法验证音符正确性的问题。

- 算法管线 :

-

d. 语音清晰度与连贯性:

- 算法管线 :

Faster-Whisper(专家模型,带VAD的语音识别) →Gemini(MLLM,带自适应合规机制的语义审计:在"逐字模式"下进行严格词汇匹配;在"上下文模式"下评估语义连贯性)。 - 关键点: 能够区分"说了什么"和"说得对不对",并能检测出无意义的"外星语"。

- 算法管线 :

-

e. 物理合理性:

- 算法管线 :

VideoPhy2-AutoEval(专家模型,评估低层级运动平滑度和轨迹真实性) +Gemini(MLLM,两阶段高层因果推理:1. 从提示词提取"可观察预期";2. 基于预期与视频中观察事件的匹配度计算语义物理分数)。 - 关键点: 将物理评估解耦为"运动是否流畅"和"物理现象是否正确"两个层次,既能检测基础伪影,又能验证复杂的因果逻辑。

- 算法管线 :

-

f. 整体语义对齐:

- 算法管线 :

Gemini(MLLM,将复杂提示词分解为四个维度的可检查约束:叙事节拍、视觉属性、音频事件、摄影技术) →执行验证→综合评分。 - 关键点: 通过"分解-验证"管线,解决了嵌入相似度无法惩罚细微矛盾(如提示要求"红色汽车"而模型生成了"蓝色汽车")的问题。

- 算法管线 :

-

-

4. 💡 创新点

- 提出首个任务驱动的T2AV基准(AVGen-Bench): 与现有指标驱动的基准不同,AVGen-Bench的提示词完全基于真实世界的用户场景(如广告、教程、物理模拟)进行设计,确保了评估的相关性和挑战性。其平均提示词复杂度(88.54 tokens)远超现有基准。

- 设计了一套多粒度、混合式评估框架: 创新性地结合了轻量级专家模型和多模态大语言模型(MLLMs)的优势。专家模型保证了信号级测量的精确性(如音符、人脸特征、文本坐标),而MLLM提供了高层语义推理和整体意图验证的能力(如逻辑判断、因果分析)。这种"取长补短"的设计是评估复杂生成任务的关键。

- 引入并实现了六项全新的细粒度评估指标: 针对T2AV模型普遍存在的痛点,首次提出了可自动化、可解释的评估方案,包括:场景文本渲染(区分显式和隐式文本)、面部一致性(无参考的身份稳定性评估)、音高准确性(符号化乐理验证)、语音清晰度与连贯性(自适应语义审计)、物理合理性(高低层解耦评估)以及整体语义对齐(约束分解验证)。

- 系统性诊断并量化了当前SOTA模型的"美学-语义"鸿沟: 通过详尽的实验,首次用数据证实了顶尖模型在视觉美学上已接近完美,但在需要精确语义控制的任务(尤其是音高控制和文本渲染)上表现极差,为未来的研究指明了关键方向。

5. 📊 实验效果(重要数据与结论)

实验设置:

- 评估模型: 涵盖了闭源商业模型(Sora 2, Veo 3.1, Kling 2.6等)、开源统一模型(LTX-2, Ovi)以及级联管线(T2V+V2A, T2I+T2AV)。模型输出分辨率尽量标准化为720p,时长主要为10秒。

- 评估基准: AVGen-Bench的235个任务提示词。

- 评估指标: 前述的"基础+细粒度"共10个维度的指标,并给出了一个综合总分。

- 人类验证: 邀请10位专家对85个任务的子集进行标注,计算自动指标与人类判断的相关性(皮尔逊相关系数)和标注者间一致性(Cohen's κ)。

重要数据与结论:

-

美学与语义的巨大差距:

- 视觉质量高: 几乎所有模型在视觉美学得分上都接近满分(如Veo 3.1-quality达到0.96),表明当前模型生成高保真图像的能力已很强。

- 语义控制弱 : 在细粒度任务上表现堪忧。例如,音高准确性 所有模型得分均低于12/100,揭示模型完全不懂音乐理论。文本渲染 得分普遍在70-80分,但在处理"偶然文本"时几乎全部失败。面部一致性 最高分也仅57.33,身份漂移和人群退化现象严重。

-

不同模型的能力对比:

- Veo 3.1系列 在综合得分上领先,尤其在语音生成 (96.09分)和高阶层物理因果推理(68.53分)上表现突出,显示出其强大的世界知识储备。

- Sora 2 在整体语义对齐 (88.89分)和低层物理合理性(78.95分)上表现优异。

- 级联管线(T2V+V2A) 虽然视觉质量尚可,但在需要紧密音视频协同的任务上(如音乐、语音)与联合模型存在差距。

- 开源模型(如Ovi, LTX-2)在整体上与闭源模型有较大差距,尤其在处理复杂、多约束的提示词时,经常出现约束丢失的情况。

-

框架的有效性与稳定性:

- 高人类相关性: 自动指标与专家判断在5个维度上表现出极强的相关性(Pearson r > 0.82),文本渲染更是达到了0.9657,证明了框架的有效性。

- 高标注者一致性: 除了因"地板效应"导致分数集中而一致性偏低的音高外,其他维度的Cohen's κ均高于0.84,证明评估维度定义清晰,人工评价可信。

- 高运行稳定性: 对同一模型多次评估,各指标标准差很小(如Veo 3.1的文本指标标准差仅0.83),表明MLLM的评估结果稳定可靠。

- 基准规模鲁棒性: 通过随机子集采样测试,发现模型得分在小规模子集上依然稳定,证明235个任务的基准规模足够得出有统计意义的结论。

6. 📈 推荐阅读指数

推荐指数

⭐⭐⭐⭐⭐ (五星/强烈推荐)

推荐理由

- 领域前瞻性: T2AV是生成式AI的下一个前沿阵地,该论文精准地抓住了该领域缺乏高质量评估体系的痛点,具有极强的前瞻性和引领作用。

- 方法论创新: 提出的"专家模型+MLLM"的混合评估架构,为解决AIGC领域复杂、开放、多模态任务的评估问题提供了一个全新的、可扩展的范式。其"分解-验证"的思路极具启发性。

- 实践指导价值: 论文不仅指出了问题,更提供了具体的解决方案和开源基准。对于T2AV模型的研究者和开发者而言,这是一个可以直接使用的、权威的评估工具箱。其揭示的"美学-语义"鸿沟也为未来模型的优化方向提供了明确的指引(即从"生成好看的视频"转向"生成对的视频")。

- 实验严谨详实: 论文实验设计严谨,对比模型全面,数据分析透彻,并通过详尽的人类研究和稳定性分析,有力地证明了其评估框架的有效性和可靠性。附录中的失败案例分析(图7-9)极具教育意义。

7. 总结与展望

总结 :

本论文针对文本到音频-视频(T2AV)生成领域的评估空白,做出了里程碑式的贡献。作者提出了AVGen-Bench,一个任务驱动的、高质量的基准数据集,并构建了一套多粒度、混合式、自动化的评估框架。该框架通过巧妙结合轻量级专家模型和多模态大语言模型,首次实现了对T2AV模型在文本渲染、音高准确性、面部一致性、物理推理等细粒度语义控制能力上的量化评估。实验结果揭示了当前最先进的模型普遍存在"美学-语义"鸿沟,即在生成高质量视听内容的同时,对精确的语义指令执行能力严重不足。这项工作为T2AV领域提供了一个权威、可靠、可复现的评估标准。

未来展望 :

基于AVGen-Bench的发现,未来T2AV生成领域的研究有望在以下几个方向取得突破:

- 更强的细粒度语义控制机制: 未来的模型需要从目前的"概率纹理生成器"向"物理世界模拟器"进化。这可能意味着需要引入更精细的条件控制机制(如基于乐谱、动作捕捉数据、3D场景布局的条件生成),以及更强的跨模态对齐损失函数。

- 增强模型的内在"世界知识": 模型在物理、化学和文本渲染上的失败表明,它们缺乏对真实世界规律的理解。未来的研究可以探索如何将知识图谱、物理引擎或符号推理规则注入到生成模型中,使其具备更强的因果推理能力,而不是简单地依赖数据统计相关性。

- 统一的视频-语言-音频大模型: AVGen-Bench的评估框架本身也展示了MLLM的强大能力。未来有望看到统一的生成-理解模型,即同一个模型既能用于评估(如AVGen-Bench中的MLLM角色),也能用于生成,从而形成"生成-评估-反馈-改进"的闭环,实现自我迭代和优化。

- 评估框架的持续演进: AVGen-Bench为评估树立了标杆,但并非终点。随着模型能力的提升,评估基准也需要随之"进化",增加更难、更开放的任务(如长视频生成、情感表达、创意叙事等)。其提出的"混合评估"范式,为未来应对这些新挑战提供了坚实的基础和灵活的架构。

后记

- 如果您对我的博客内容感兴趣,欢迎三连击(点赞, 关注和评论) !!!

- 本博客将持续为您带来计算机人工智能前沿技术研究进展分享,助您更快了解 AI前沿技术。