一提到数据挖掘,很多人第一反应就是难。

公式很多,名词很绕,算法名字一个比一个像考试题。结果就是,明明知道这东西很重要,但一看就头大。

其实没那么玄乎。对很多刚入门的人来说,最难的不是算法本身,而是没人用人话把它讲明白。今天这篇文章,我就想用尽量直白的方式,把数据挖掘里常见的10个经典算法给你捋清楚。

开始之前,给你推荐一份数据仓库建设解决方案 ,里面不仅讲了数仓的技术架构、搭建过程中的重点内容,还有常用的数仓工具介绍。除此之外,它还把数据从业务系统到数据层,再到应用层的集成流程拆解得非常清楚,还带了一些数字化的核心概念解读和实操小技巧。如果你对数据集成或者数据挖掘还不太熟,里面也有不少算法相关的案例,能帮你更快上手,快速补课。 需要自取:https://s.fanruan.com/7igmg(复制到浏览器)

一、分类

虽然数据挖掘的算法很多,但常见的思路,基本可以分成几类。

一类是找关系。比如哪些东西经常一起出现,哪些页面影响力更大。

一类是做分类。也就是拿到一条新数据,判断它更像哪一类。

还有一类是做聚类。这个和分类不太一样,分类是先有标准答案,聚类是先把相似的东西自动分成堆。

你可以先这么理解。

分类,像给水果贴标签,苹果是苹果,橘子是橘子。

聚类,像把一堆长得像的水果先堆在一起,至于这一堆到底叫什么,后面再研究。

关联分析,像发现买了A的人,经常也会买B。

连接分析,像判断一个网页到底重不重要。

下面这10个算法,基本就分布在这些思路里。你不用一开始就记定义,先记住它们各自是干什么的,后面就容易多了。

二、入门级算法

PageRank

这个算法最早是用来判断网页重要性的。

道理不复杂。一个网页值不值钱,不光看有多少页面链接到它,还要看是谁链接了它。如果链接它的页面本身就很有分量,那它也更容易被认为重要。

说白了,不是谁给你投票都一样。普通人夸你一句,和行业大佬夸你一句,分量当然不同。

所以PageRank看的是两件事。

- 有多少页面指向你。

- 指向你的人自己是不是也有影响力。

你可以把它理解成社交平台上的影响力传递。关注你的人越多,而且这些人本身越有号召力,你的影响力也就越大。

Apriori

这个算法是做关联分析的,最经典的用法就是找商品之间的搭配关系。

比如,买面包的人是不是经常顺手买牛奶。买尿不湿的人是不是也容易买湿巾。它研究的就是这种一起出现的规律。

这里面有三个很常见的词。

- **支持度:**这个组合出现得多不多。

- **置信度:**买了A之后,再买B的概率高不高。

- **提升度:**A的出现,到底有没有明显带动B。

你不用死记概念,直接记一个场景就够了。超市想做促销,不是拍脑袋乱摆货,而是看历史交易数据,找到经常一起买的商品,把它们放近一点,或者直接做组合推荐。

这就是Apriori最接地气的用法。

AdaBoost

这个名字听起来有点吓人,其实思路很朴素。

它不是一下子找一个特别厉害的分类器,而是先找很多个一般般的小分类器,然后把它们组合起来,最后拼成一个更强的结果。

你可以把它想成公司开复盘会。

一个项目做完后,团队发现有些环节做得不错,有些环节总是出问题。下次再做类似项目时,大家就不会平均用力,而是会把更多精力放在上次出错的地方。

每一轮都盯着之前没做好的地方改,最后整个团队的项目成功率就会越来越高。

AdaBoost差不多就是这个逻辑。它会不断关注前一轮分错的数据,让后面的模型重点修正这些错误,最后组合成一个更强的模型。

三、分类算法

分类算法是数据挖掘里最常见的一类。简单说,就是给新数据判断类别。

C4.5

这是决策树算法里很经典的一个。

你可以把它想成一连串判断题。先看一个条件,再看下一个条件,最后一步步把数据分开。

比如公司要招销售,不会只看一个条件,而是会一步步判断。

先看沟通能力。如果沟通能力明显不行,可能就直接不合适。

如果沟通能力不错,再看抗压能力。

如果抗压能力也不错,再看有没有行业经验。

最后根据这些条件,判断这个人是否适合销售岗位。

C4.5 就像这样一套判断流程。它会从很多特征里挑出最关键的判断条件,一层一层往下分,最后把样本分到不同类别里。

CART

这也是决策树 的一种,但它比C4.5更通用。

为什么说更通用?因为它既能做分类,也能做预测数值。

如果是分类,比如判断一套房子是否值得买,那结果可能是值得买或不值得买。算法会根据地段、楼龄、交通、学区、价格等条件一步步判断。

如果是回归,比如预测这套房子的价格,那结果就不是一个类别,而是一个具体数值,比如大概值多少钱。

所以 CART 的特点是,它既可以帮你做选择题,也可以帮你做填空题。

朴素贝叶斯

这个算法很常见,尤其适合做文本分类,比如垃圾邮件识别、情感分析这类场景。

它背后的思路是概率判断。

比如现在来了一条短信,里面出现了账户异常、点击链接、立即验证、否则冻结这些词,那它是诈骗短信的概率就会升高。

如果短信里出现快递到了、取件码、驿站这些词,那它更可能是正常快递通知。

朴素贝叶斯就是根据这些特征,去计算这条短信更像哪一类。它不会像人一样真正理解短信内容,但会根据过去的数据,判断哪种可能性更大。

它有个朴素的地方,就是默认各个特征之间彼此独立。这个假设听起来有点理想化,但在很多场景里,它居然还挺好用。

SVM

SVM中文叫支持向量机,名字有点硬,但核心想法其实很直观。

假设一个广场上有两类摊位,一边是卖小吃的,一边是卖手工艺品的。现在要在中间留出一条通道,让两边顾客都能走,同时尽量不影响摊位。

这条通道不能贴着某一边太近,否则稍微有摊位扩出来,就容易混乱。最好的做法是让通道尽量处在两边中间,和两边都保持最大距离。

SVM 要找的就是这样一条最稳的分界线。它不只是把两类数据分开,还希望分界线离两边都远一点,这样新数据来了,也更不容易分错。

如果数据不是平面上能直接分开的,它还会想办法把数据换个角度看,映射到更高维的空间里,再去找分界面。

你不用一开始就理解维度怎么变。先记住一句话就行,SVM本质上是在找一条最稳的分界线。

KNN

KNN可以说是最容易入门的算法之一。

它的逻辑特别像现实生活中的一句话,近朱者赤,近墨者黑。

一个新同学刚来,老师不知道他适合加入哪个兴趣小组。于是看他平时喜欢什么、擅长什么、和哪些同学更像。

如果他最接近的几个同学大多都在篮球组,那他很可能也适合篮球组。

如果他最接近的几个同学大多都在绘画组,那他可能更适合绘画组。

KNN 就是这么判断的。它不急着总结复杂规则,而是先看离这个新样本最近的一批老样本属于哪一类,再根据多数结果做判断。

这个算法简单好懂,但也有个特点,就是很依赖距离怎么定义 ,以及K到底取几个更合适。

四、聚类算法

前面的分类,都是先有答案再判断。聚类不是这样,它是先把相似的数据自动分组。

K-Means

K-Means是最常见的聚类算法。

它会先随机找几个中心点,把每条数据分给离自己最近的那个中心。分完后再重新计算每一组的中心点,继续分配和优化,直到结果稳定下来。

你可以把这个过程想成健身房给会员分群,比如根据会员的来访频率和课程偏好,分成高频训练型、偶尔打卡型、团课偏好型,再用行为数据把相似的人聚到一起。

虽然一开始可能不够准确,但**算法会不断调整中心点,经过几轮优化后分组就越来越合理。**这样健身房可以根据人群特点推针对性的课程和活动,而不是给所有会员发同样的短信。

它的优点是直观、速度快 ,特别适合做用户分群、门店分层、商品分组这类事情。

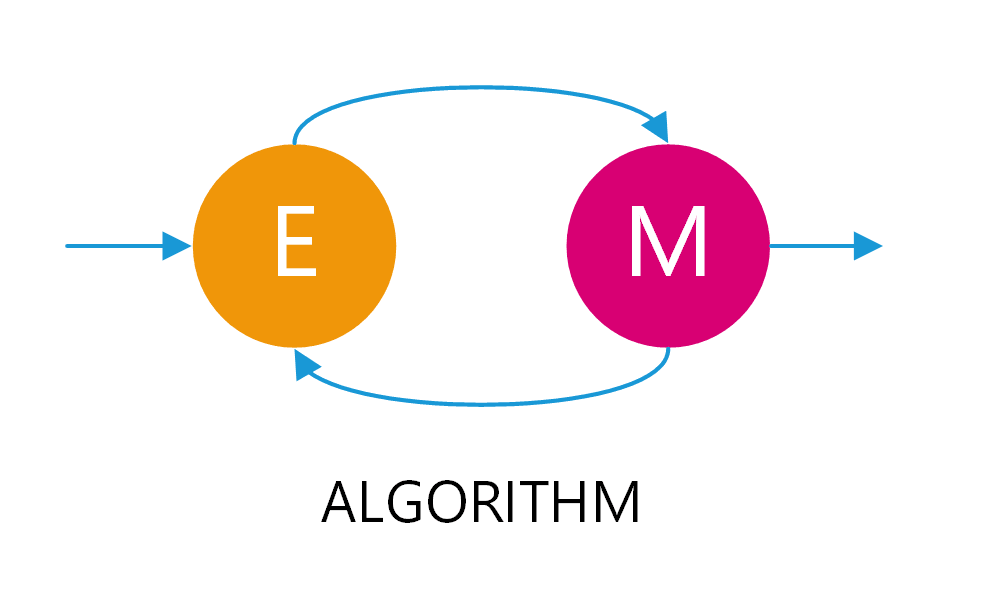

EM

EM也是聚类里很经典的算法,但它和K-Means不太一样。

K-Means更像硬分组。你只能属于这一组,不能同时属于另一组。

EM更像软分组 。它会告诉你,你属于A组的概率是多少,属于B组的概率又是多少。

这就更贴近现实。因为很多数据本来就不是非黑即白的。

比如一个用户,平时听歌很杂,既听流行,也听民谣,还偶尔听摇滚。那他到底属于哪类用户?如果只能分到一个类别里,就有点生硬。

EM 的思路更灵活。它不会直接说你就是流行用户,而是会计算你属于不同偏好人群的概率。比如你可能有 60% 像流行音乐用户,30% 像民谣用户,10% 像摇滚用户。

这样平台做推荐时,就不会只给你推一种歌,而是可以根据概率,推荐更符合你真实兴趣的内容。

EM的过程也可以理解成先做一个大概猜测,然后根据数据不断修正,修到结果基本不再变化为止。

五、总结

掌握这10个算法,数据挖掘也就没那么复杂了。建议刚入门的朋友先搞清楚每个算法的作用和解决的问题,尤其是和自己业务相关的那些,重点理解透彻再去实际应用。至于其他的算法,也不用急着硬背,直接先收藏起来,等用到的时候翻出来回顾一下就好。选择合适的算法解决问题这件事会慢慢地变得越来越得心应手了。

当然,实际工作里光知道算法还不够,前面的数据准备同样很关键。很多企业的数据分散在ERP、CRM、OA等系统里,整理起来既费时又麻烦。像 FineDataLink 这样的数据处理工具 ,就能帮忙把这些数据接起来,清洗、加工,统一口径,打好基础。这样后面不管是做日常分析,还是进一步做数据挖掘和算法应用,都会更容易落地。 工具的链接我放这里,感兴趣可以上手体验一下:https://s.fanruan.com/tx4dw(复制到浏览器打开)