目录

1.摘要

针对极具挑战性的高维动态优化问题,本文提出了融合变量分解、多子群搜索与机器学习预测的优化算法。为突破高维空间带来的维度瓶颈,该算法依据决策变量间的交互程度将复杂原问题降解为多个子问题,并引入多子群机制驱动各子问题独立进化以实现高效寻优。为响应环境的动态变化,算法构建了基于机器学习的预测策略,通过深度挖掘历史解信息来预测新环境下的潜在优质解。

2.算法

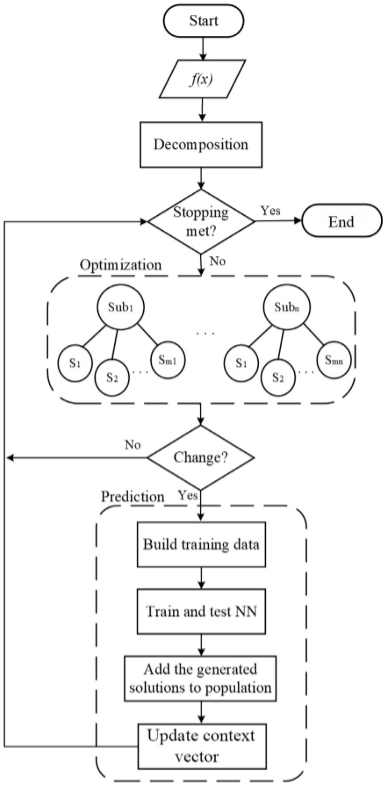

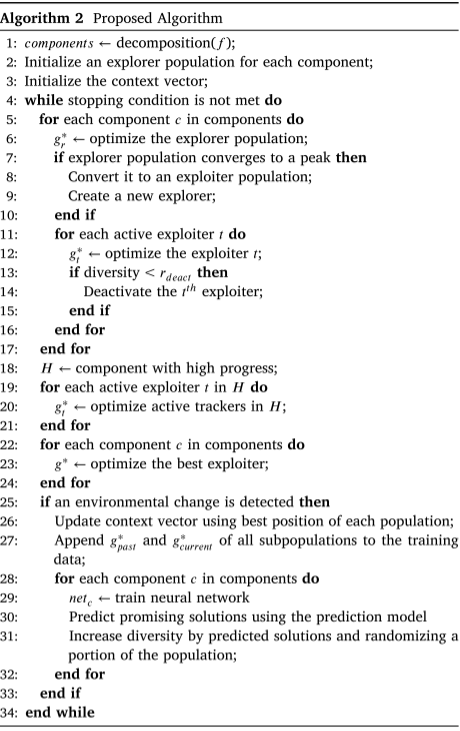

面向大规模动态优化问题(LSDOPs),本文提出的算法首先将高维复杂问题降解为多个子问题,随后利用多子群驱动各个子问题进行独立进化。

分解阶段

在优化阶段启动前,算法通过一种无参变量交互方法 (DG2)执行问题分解,确保子模块内部变量高度依赖且模块间耦合最小。相较于传统分解算法,该方法以更高的精度和更低的时间成本,通过近似舍入误差动态计算各变量对的误差下界 e i n f e_{inf} einf与上界 e s u p e_{sup} esup。为识别第 a a a 维和第 b b b 维变量间的交互性,需通过变量微扰计算适应度的变化量:

Δ ( 1 ) = f ( ... , x a ′ , ... ) − f ( x 1 , ... , x n ) \Delta^{(1)}=f(\ldots,x_a^{\prime},\ldots)-f(x_1,\ldots,x_n) Δ(1)=f(...,xa′,...)−f(x1,...,xn)

Δ ( 2 ) = f ( ... , x a ′ , ... , x b ′ , ... ) − f ( ... , x b ′ , ... ) \Delta^{(2)}=f(\ldots,x_a',\ldots,x_b',\ldots)-f(\ldots,x_b',\ldots) Δ(2)=f(...,xa′,...,xb′,...)−f(...,xb′,...)

根据绝对差值 λ = ∣ Δ ( 1 ) − Δ ( 2 ) ∣ \lambda=|\Delta^{(1)}-\Delta^{(2)}| λ=∣Δ(1)−Δ(2)∣完成可分性判定:当 λ < e i n f \lambda < e_{inf} λ<einf时,两变量被视为相互独立且可分;当 λ > e s u p \lambda>e_{sup} λ>esup时,则判定变量间存在交互;若 λ ∈ e i n f , e s u p \lambda\ine_{inf},e_{sup} λ∈einf,esup,则结合已有判定实例的总数,通过加权平均动态确定最终判定阈值。

优化阶段

在优化阶段,算法采用多子群策略处理动态优化问题,为每个子模块分配一个探索子群与多个开发子群以寻找并追踪所有峰值,且无需预先设定峰值数量。探索子群的多样性基于群体内个体间的欧氏距离进行评估,若低于预设阈值即视为发现潜在优势区域并完成收敛。

没有采用传统轮询策略,算法引入了基于贡献度的协同进化机制(CBCC),通过在组件与种群双层级上实施动态资源分配,算法将额外的迭代次数重点倾斜至高贡献度子模块及其内部表现最优的开发子群。

学习与预测

在学习与预测阶段,算法主要通过多样性补偿与历史信息学习双重机制应对环境动态变化。当环境更迭时,为弥补种群多样性的流失,算法以经过上一环境验证的最优解区域为基准,结合前两个连续环境全局最优解所估算的偏移严重度,于该区域周边随机生成新个体。

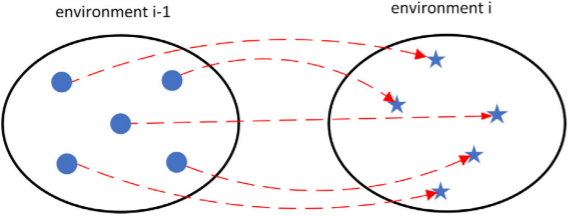

算法集成了基于神经网络的预测模型,在训练集构建环节,系统会归档各子问题在历史环境(从环境1至 t − 1 t-1 t−1)中求得的最终最优解,并将相邻环境(如环境 i − 1 i-1 i−1 跃迁至环境 i i i)间的最优解坐标点配对为输入输出样本。针对每个 n n n 维子组件,算法独立部署包含输入层、隐含层与输出层的三层神经网络结构。

鉴干动态优化问题对求解时效性的严苛要求,网络采用 Levenberg-Marquardt 算法进行高效训练。完成历史映射关系的学习后,算法将环境 t − 1 t-1 t−1的解向量馈入网络以预测当前新环境下的潜在优质解,并将该预测结果作为启发信息注入初始种群中。

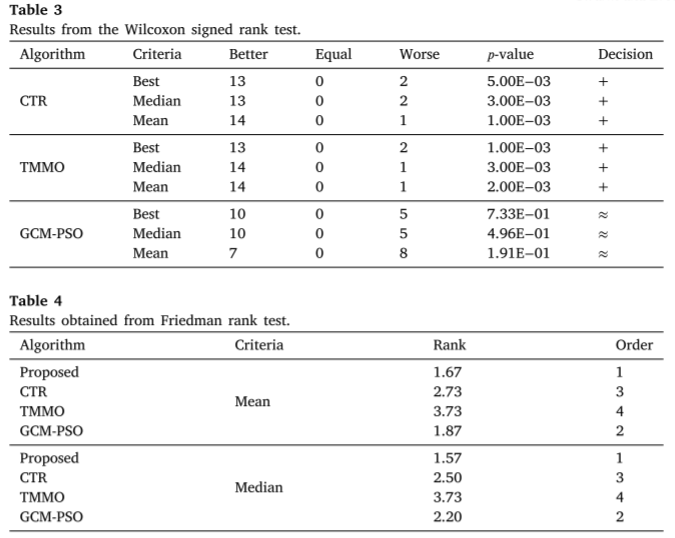

3.结果展示

4.参考文献

Radwan M, Elsayed S, Sarker R, et al. Neuro-PSO algorithm for large-scale dynamic optimizationJ. Swarm and Evolutionary Computation, 2025, 94: 101865.

5.代码获取

xx

6.算法辅导·应用定制·读者交流

xx