博主介绍:✌全网粉丝50W+,前互联网大厂软件研发、集结硕博英豪成立软件开发工作室,专注于计算机相关专业项目实战6年之久,累计开发项目作品上万套。凭借丰富的经验与专业实力,已帮助成千上万的学生顺利毕业,选择我们,就是选择放心、选择安心毕业✌

> 🍅想要获取完整文章或者源码,或者代做,拉到文章底部即可与我联系了。🍅🍅感兴趣的可以先收藏起来,点赞、关注不迷路,大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助同学们顺利毕业 。🍅

1、毕业设计:2026年计算机专业毕业设计选题汇总(建议收藏)✅

1、项目介绍

技术栈

采用 Python 语言开发,基于 Flask 框架搭建后端服务,通过 requests 爬虫从雪球网采集股票数据,运用 LSTM 预测算法结合 Keras 深度学习神经网络进行股价预测,前端使用 Echarts 实现数据可视化,并结合 HTML 构建页面。

功能模块

· 股票数据可视化分析(股价前10、成交额前20、股价区间占比分析)

· 股票数据可视化分析(股价和成交量散点图)

· 股票数据中心

· 股票价格预测(LSTM预测算法)

· 后台数据管理

· 股价历史数据管理

· 注册登录

项目介绍

本系统基于 Flask 框架构建股票数据可视化分析与预测平台,通过爬虫采集雪球网股票数据。系统提供股价前十与成交额前二十的柱状图、股价区间占比环形图、股价与成交量散点图等可视化分析功能,帮助用户直观了解股票市场分布特征。股票数据中心以表格形式展示股票代码、价格、涨跌幅、成交量、市值等指标并支持搜索。基于 LSTM 深度学习模型对历史股价数据进行训练,预测未来价格走势并以折线图展示。后台支持股票数据与历史数据的管理维护,包含注册登录功能。

2、项目界面

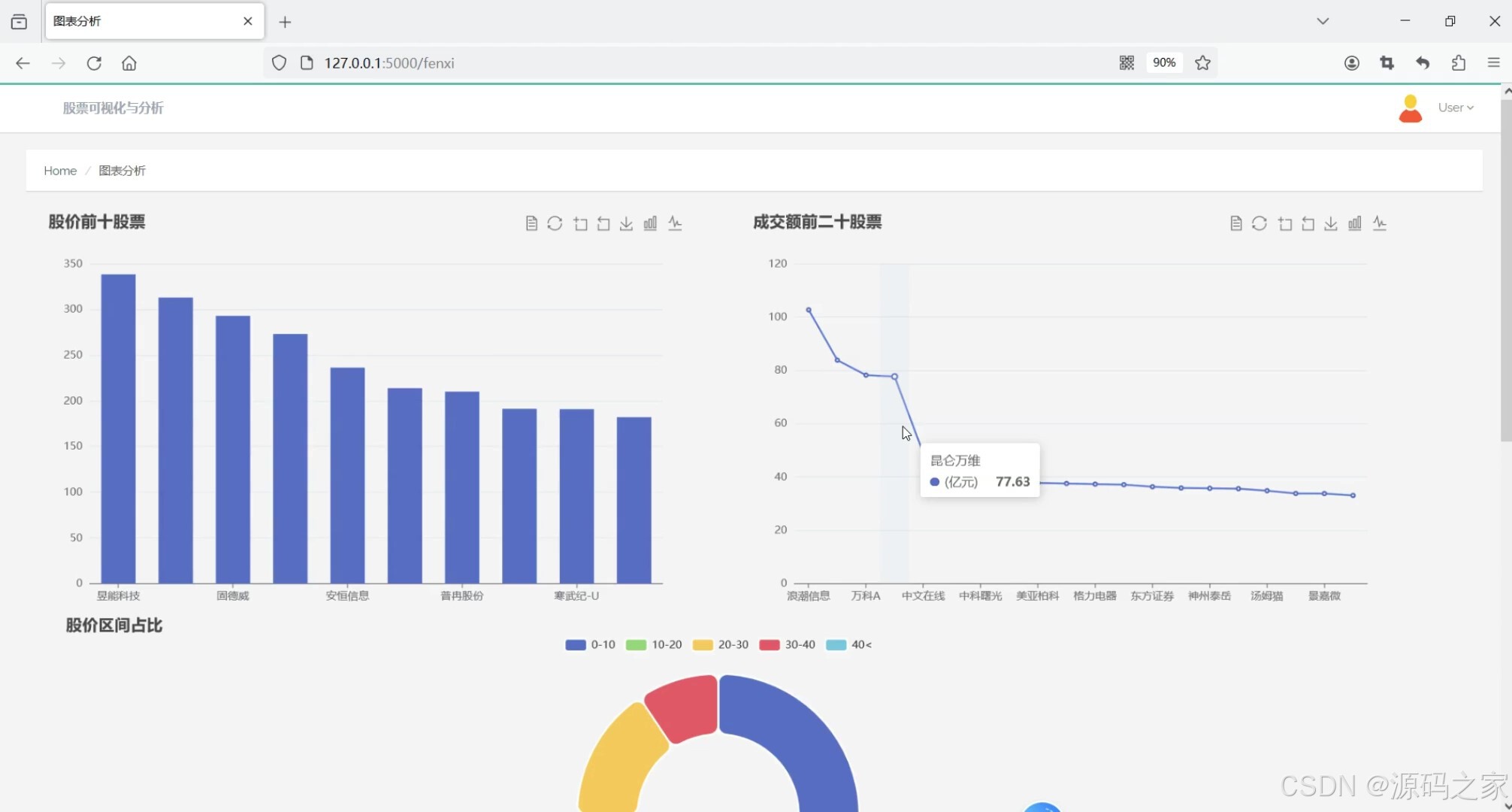

(1)股票数据可视化分析---股价前10、成交额前20、股价区间占比分析

该页面是股票可视化分析界面,通过柱状图展示股价前十股票,折线图呈现成交额前二十股票数据,同时用环形图统计股价区间占比,为用户提供多维度的股票数据直观对比与分布分析。

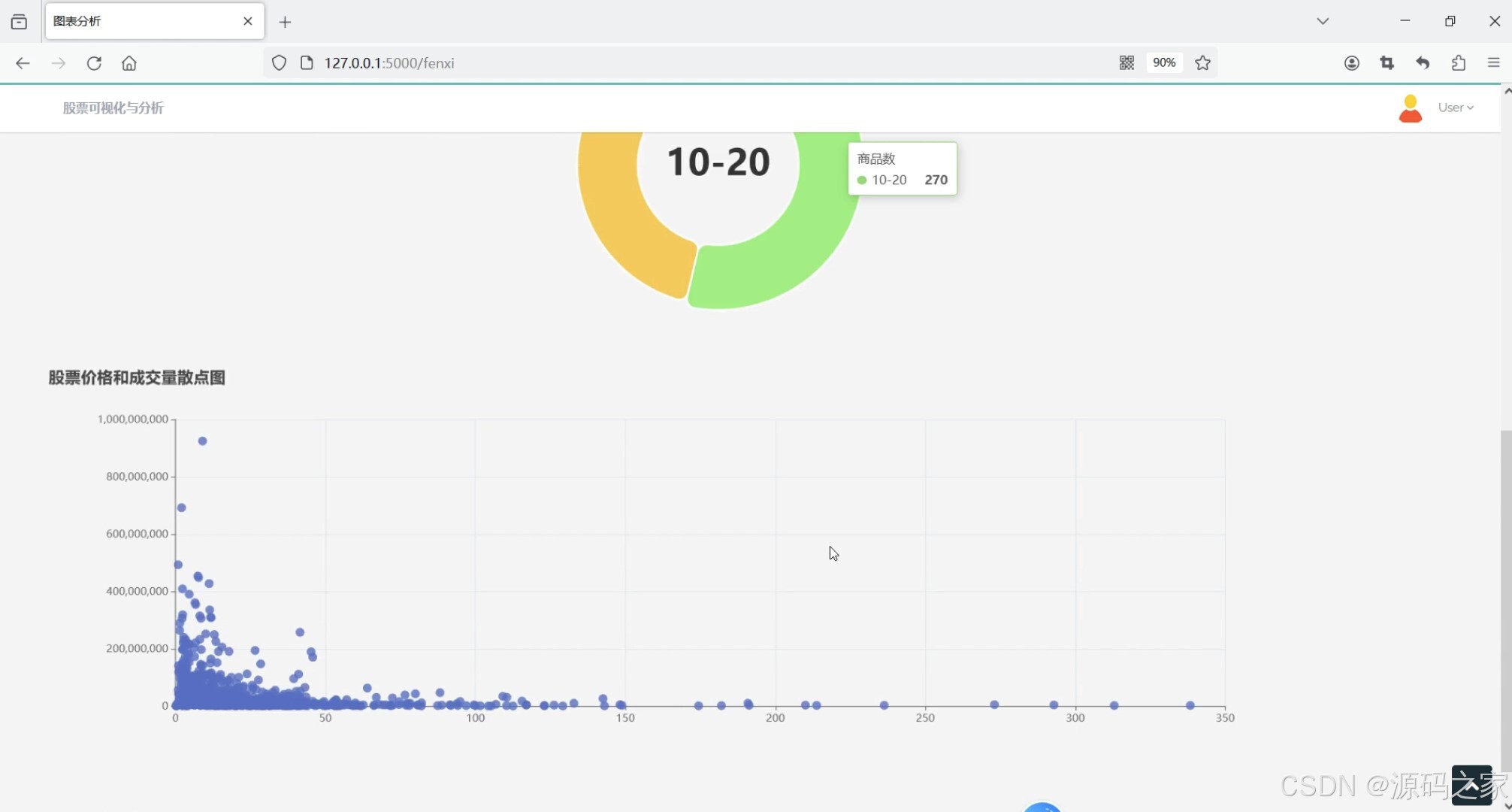

(2)股票数据可视化分析---股价和成交量散点图

该股票可视化分析页面,通过环形图展示不同股价区间的商品数量占比,同时用散点图直观呈现股票价格与成交量的分布关系,帮助用户分析两者间的关联与数据趋势。

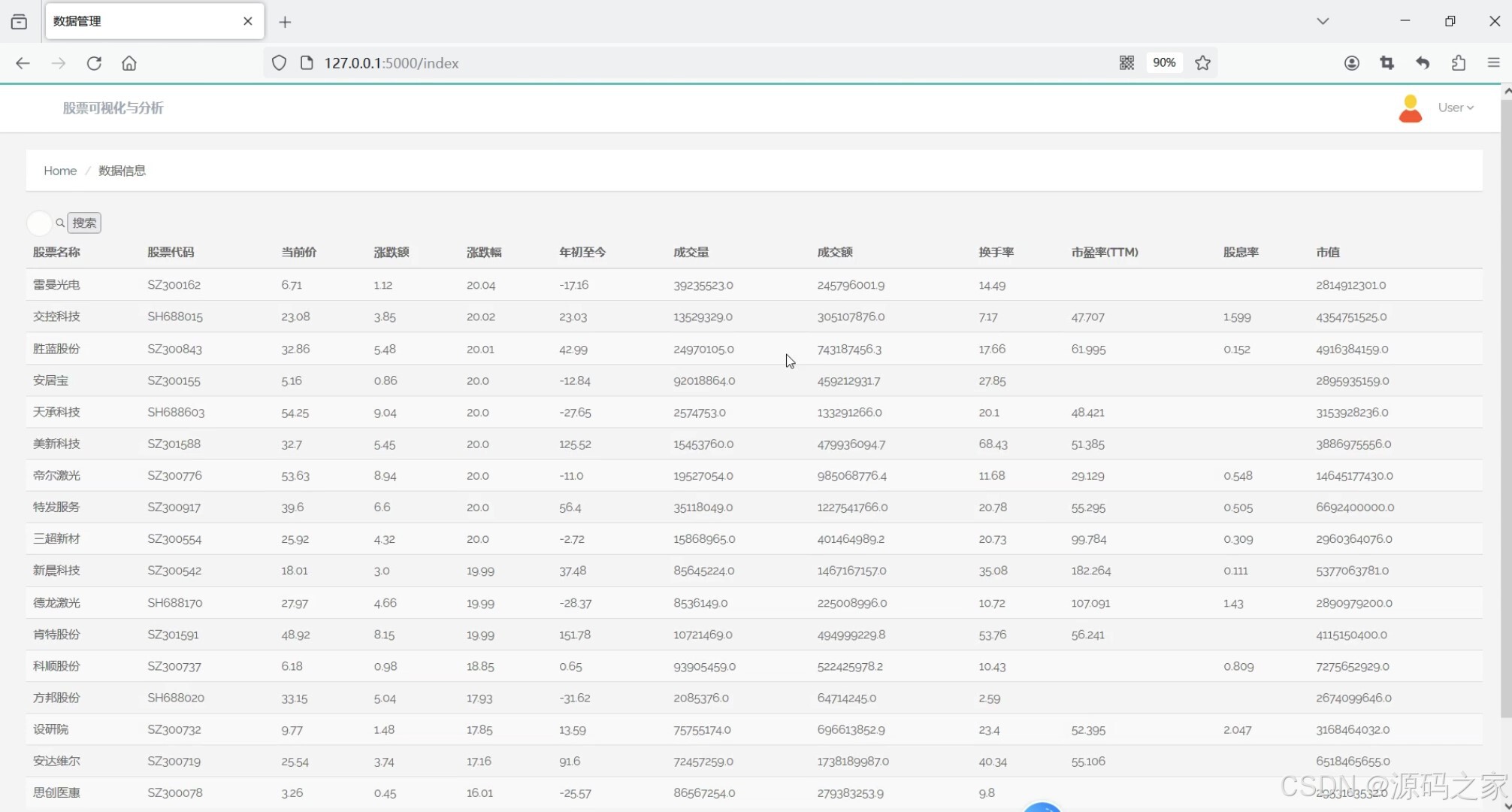

(3)股票数据中心

该股票数据管理页面以表格形式集中展示股票的名称、代码、价格、涨跌幅、成交量、成交额、市盈率、市值等多维度指标,并提供搜索功能,方便用户快速查询和查看股票的详细信息。

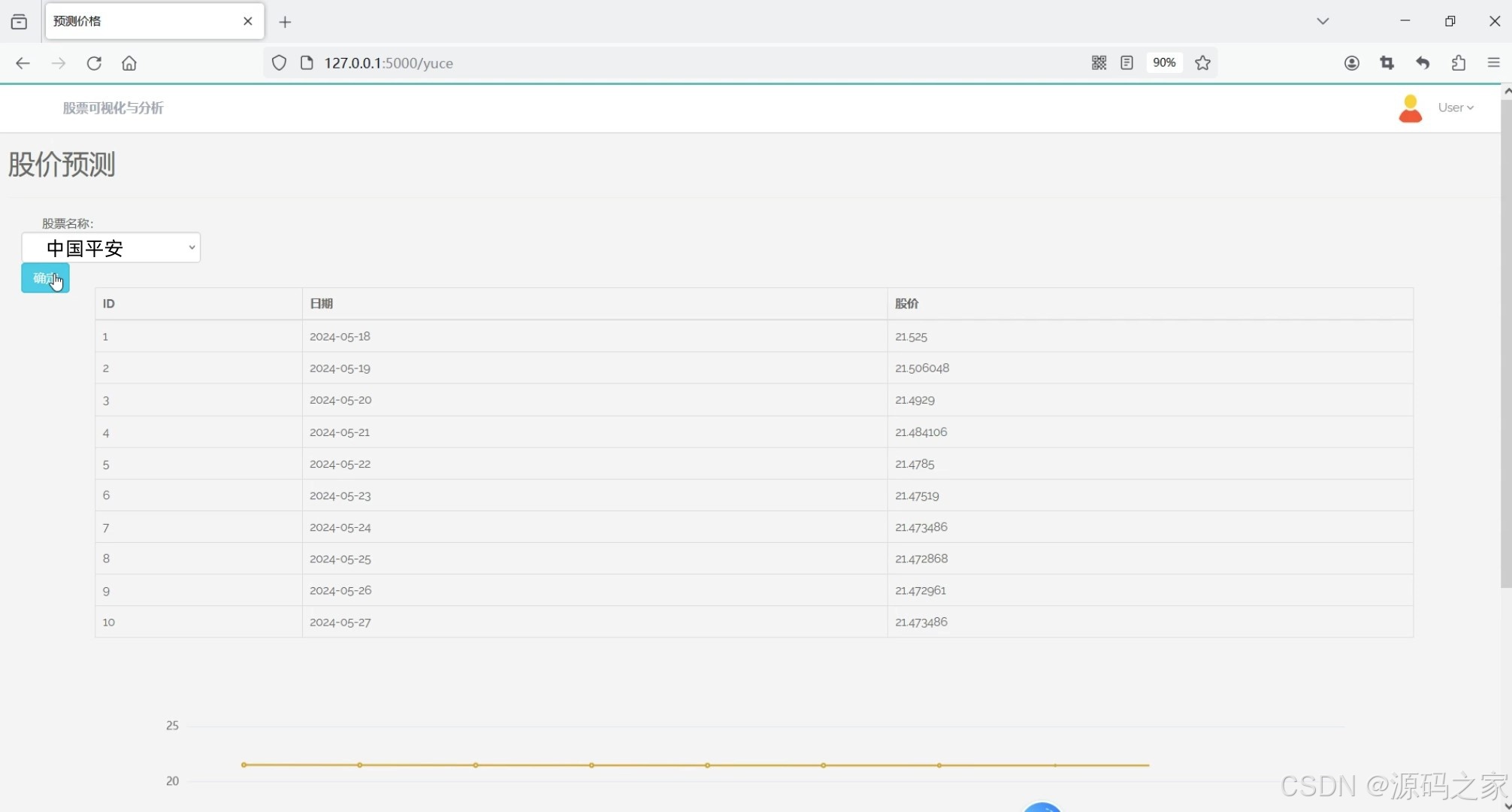

(4)股票价格预测---LSTM预测算法

该页面为股价预测功能模块,用户可通过下拉菜单选择股票,提交后以表格形式展示对应日期的预测股价,并通过折线图直观呈现股价的预测变化趋势。

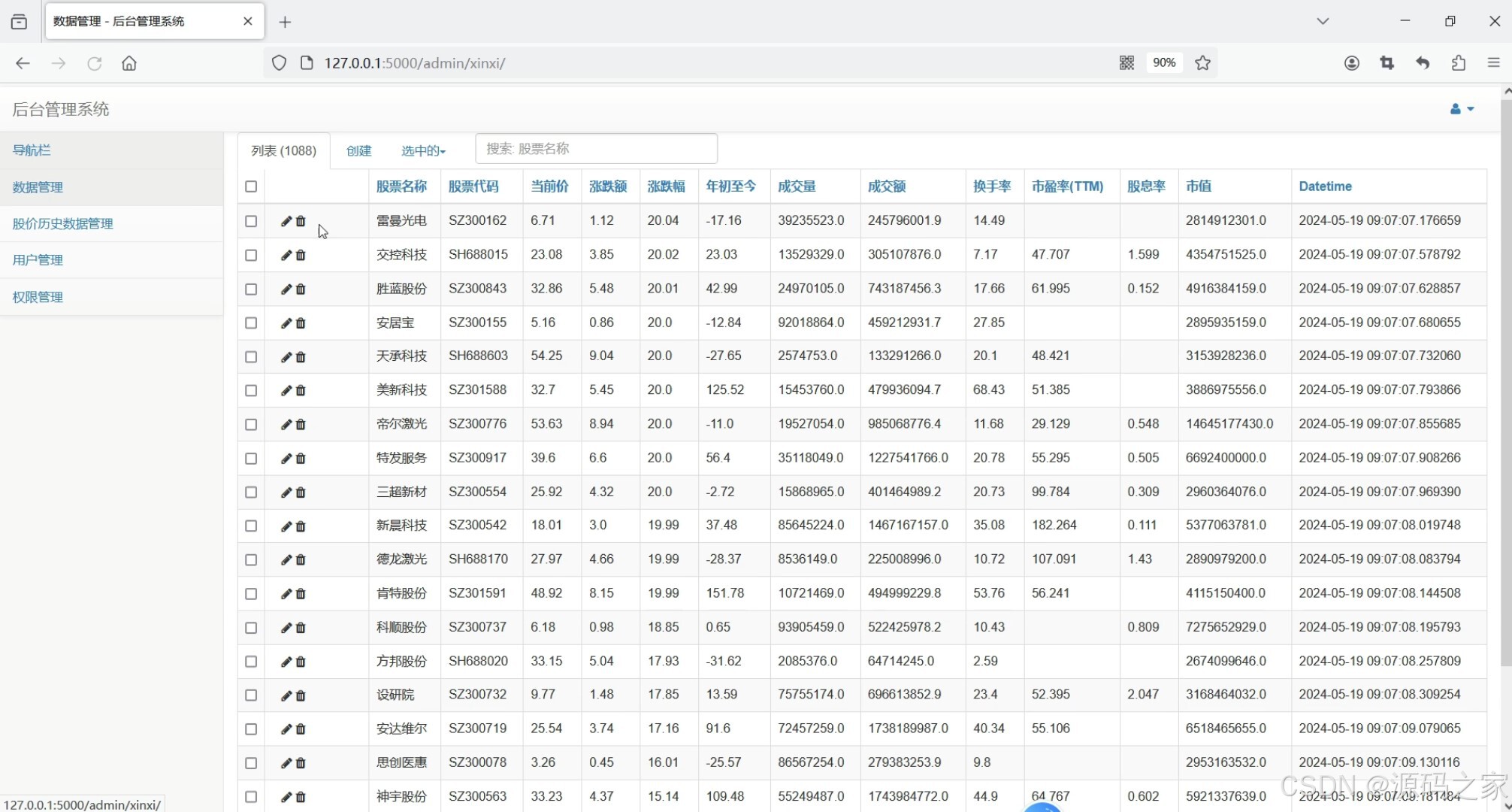

(5)后台数据管理

该后台管理系统页面提供股票数据管理功能,可查看、搜索股票信息,支持数据的创建、编辑与删除操作,同时通过左侧导航栏切换用户管理、权限管理等模块。

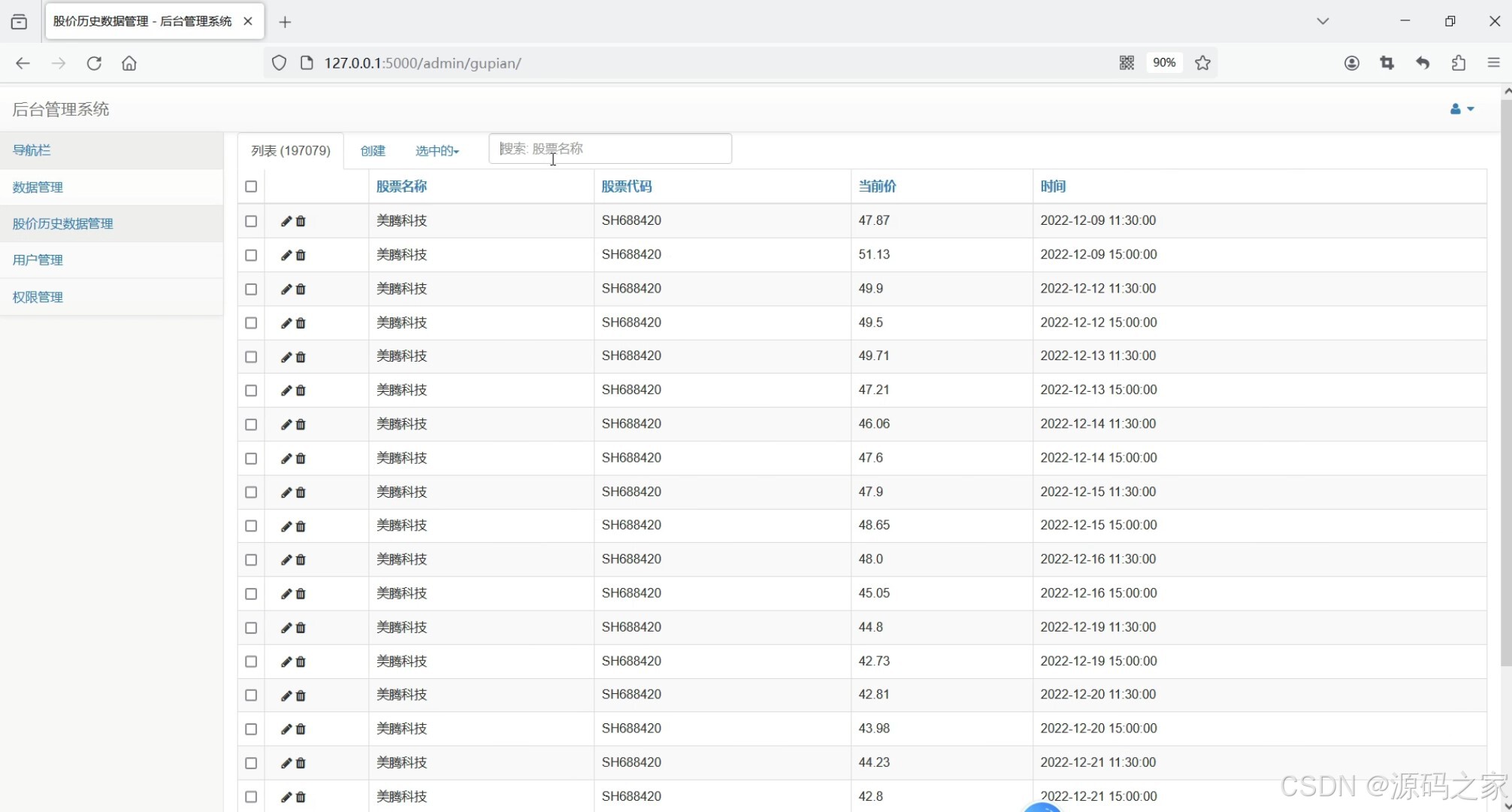

(6)股价历史数据管理(19万数据)

该后台股价历史数据管理页面,以表格形式展示股票名称、代码、价格与时间信息,支持数据的搜索、创建、编辑和删除操作,可高效管理与维护股票历史价格数据。

(7)注册登录

这是系统的登录页面,提供账号和密码输入框及登录按钮,支持用户输入凭证进行身份验证,登录后可访问系统功能,界面简洁直观,保障系统数据安全与用户权限管理。

3、项目说明

一、技术栈简要说明

本系统采用 Python 语言开发,基于 Flask 框架搭建后端服务,通过 requests 爬虫从雪球网采集股票数据,运用 LSTM 预测算法结合 Keras 深度学习神经网络进行股价预测,前端使用 Echarts 实现数据可视化,并结合 HTML 构建页面。

二、功能模块详细介绍

· 股票数据可视化分析(股价前10、成交额前20、股价区间占比分析)

该页面通过柱状图展示股价前十股票,折线图呈现成交额前二十股票数据,同时用环形图统计股价区间占比,为用户提供多维度的股票数据直观对比与分布分析,帮助快速识别高价股与高成交额股票。

· 股票数据可视化分析(股价和成交量散点图)

该页面通过环形图展示不同股价区间的股票数量占比,同时用散点图直观呈现股票价格与成交量的分布关系,帮助用户分析两者间的关联与数据趋势,辅助判断量价配合情况。

· 股票数据中心

该页面以表格形式集中展示股票的名称、代码、价格、涨跌幅、成交量、成交额、市盈率、市值等多维度指标,并提供搜索功能,方便用户快速查询和查看股票的详细信息,实现股票数据的集中管理与检索。

· 股票价格预测(LSTM预测算法)

该页面为股价预测功能模块,用户可通过下拉菜单选择股票,系统基于 LSTM 深度学习模型对历史股价数据进行训练,提交后以表格形式展示对应日期的预测股价,并通过折线图直观呈现股价的预测变化趋势,为用户提供投资决策参考。

· 后台数据管理

该后台管理系统页面提供股票数据管理功能,可查看、搜索股票信息,支持数据的创建、编辑与删除操作,同时通过左侧导航栏可切换用户管理、权限管理等模块,实现股票基础信息的系统化维护。

· 股价历史数据管理(19万数据)

该后台页面以表格形式展示股票名称、代码、价格与时间信息,支持对大规模历史数据(19万条)进行搜索、创建、编辑和删除操作,可高效管理与维护股票历史价格数据,保障数据完整性与查询效率。

· 注册登录

该页面为系统登录页面,提供账号和密码输入框及登录按钮,支持用户输入凭证进行身份验证,登录后可访问系统功能,界面简洁直观,保障系统数据安全与用户权限管理。

三、项目总结

本系统基于 Flask 框架构建股票数据可视化分析与预测平台,通过爬虫采集雪球网股票数据。系统提供股价前十与成交额前二十的柱状图、股价区间占比环形图、股价与成交量散点图等可视化分析功能,帮助用户直观了解股票市场分布特征与量价关系。股票数据中心以表格形式展示股票代码、价格、涨跌幅、成交量、市值等指标并支持搜索,方便数据查询。基于 LSTM 深度学习模型对历史股价数据进行训练,预测未来价格走势并以折线图展示,为用户提供智能化预测服务。后台支持股票基础信息与19万条历史数据的管理维护,包含数据增删改查功能。系统还包含注册登录模块,保障访问安全,为股票投资者提供了数据分析和决策支持工具。

4、核心代码

python

#!/usr/bin/env python

# coding: utf-8

import numpy as np # 导入库numpy用于数据格式化操作

import pandas as pd # 导入数据分析库pandas

import models

import datetime

def yuce(name='美腾科技'):

# 1.1读取源数据

df = models.GuPian.query.filter(models.GuPian.name=='美腾科技').order_by(models.GuPian.datetime).all()

# 2.训练模型前的准备:数据预处理

# 2.1格式转换为pandas的DataFrame

list1 = []

current = 0

new_data = pd.DataFrame(index=range(0, len(df)+10), columns=['Date','Close'])

for i in range(0, len(df)):

new_data['Date'][i] = df[i].datetime.strftime('%Y-%m-%d')

new_data['Close'][i] = df[i].current

start_date = df[i].datetime

current = df[i].current

count = 1

for i in range(len(df),len(df)+10):

new_data['Date'][i] = (start_date + datetime.timedelta(days=count)).strftime('%Y-%m-%d')

new_data['Close'][i] = current

list1.append((start_date + datetime.timedelta(days=count)).strftime('%Y-%m-%d'))

count += 1

print(new_data)

# 2.2为其设置索引

new_data.index = new_data.Date

# 2.3删除Date数据(只使用Close数据)

new_data.drop('Date', axis=1, inplace=True)

# 2.4创建训练和验证集(数据集的划分)

dataset = new_data.values

train = dataset[0:len(df), :] # 将最开始的数据作为训练集

valid = dataset[len(df):, :] # 之后的所有数据设置为验证集

# 2.5使用MinMaxScaler将数据的范围压缩至0到1之间,这么做的目的是为了防止数值爆炸

# (LSTM模型的计算中,时间步长越大,结果所迭代的次数就越多;如1.1的100次方为13 780.61233982,所以使用scaler()函数是必要的)

from sklearn.preprocessing import MinMaxScaler # 从sklearn.preprocessing库中导入MinMaxScaler

scaler = MinMaxScaler(feature_range=(0, 1))

scaled_data = scaler.fit_transform(dataset) # 传入dataset,将其用scaler()函数正则化后命名为scaled_data

#2.6 用数组表现数据的时间序列特性,步长设置为60

x_train, y_train = [], [] # 创建x_train, y_train

for i in range(60, len(train)): # 循环结构,i的值分别为60,61,......直至train的长度(1500)

x_train.append(scaled_data[i - 60:i, 0]) # 将scaled_data中的数据传递到x_train中(60个为一组)

y_train.append(scaled_data[i, 0]) # 将scaled_data中的数据传递到y_train中(从第60开始,每1个数据为一组)

x_train, y_train = np.array(x_train), np.array(y_train) # 使用numpy库中的array()函数将列表x_train和y_train格式化为数组(可以理解为矩阵)

x_train = np.reshape(x_train, (x_train.shape[0], x_train.shape[1], 1)) # 使用numpy库中的reshape()函数改变数组x_train的形状

# 上述的步骤将训练集的格式从列表(list)变成时间步长为60的时间序列(表现为数组)

# 3.模型的参数设置

# 3.1导入神经网络需要的包

from keras.models import Sequential # 从keras.models库中导入时间序列模型Sequential

from keras.layers import Dense, LSTM # 从keras.layers库中导入Dense, Dropout, LSTM用于构建神经网络

# 3.2创建LSTM神经网络

model = Sequential()

# 第一层网络设置

model.add(LSTM(units=50, return_sequences=True, input_shape=(x_train.shape[1], 1)))

# unit 决定了一层里面 LSTM 单元的数量。这些单元是并列的,一个时间步长里,输入这个层的信号,会被所有 unit 同时并行处理,形成若干个 unit 个输出。这个设置50个单元

# return_sequence参数表示是否返回LSTM的中间状态,这里设置为TRUE,返回的状态是最后计算后的状态

# input_shape参数包含两个元素的,第一个代表每个输入的样本序列长度,这里是x_train.shape[1],表示x_train数组中每一个元素的长度即时间步长,这里先前设置为了60

# 第二个元素代表每个序列里面的1个元素具有多少个输入数据(这里是1表示只有1个数据:时间)

# 第二层神经网络,设置50个LSTM单元

model.add(LSTM(units=50))

# 第三层为全连接层

model.add(Dense(1))

# 4.模型训练

model.compile(loss='mean_squared_error', optimizer='adam') # 设置损失函数compile()参数

# loss参数指标使用MSE(均方根误差) ,optimizer参数设置优化器为AdamOptimizer(自适应矩估计,梯度下降的一种变形)

model.fit(x_train, y_train, epochs=1, batch_size=1, verbose=2) # 传入数据开始训练模型

# 5.预测

#用过去的每60个数据预测接下来的数据(时间步长为60)

#5.1获取测试集数据,该步骤思路一样,这里不再赘述

inputs = new_data[len(new_data) - len(valid) - 60:].values

inputs = inputs.reshape(-1, 1)

inputs = scaler.transform(inputs)

X_test = []

for i in range(60, inputs.shape[0]):

X_test.append(inputs[i - 60:i, 0])

X_test = np.array(X_test)

X_test = np.reshape(X_test, (X_test.shape[0], X_test.shape[1], 1))

#5.2获取模型给出的预测值

closing_price = model.predict(X_test)

# 用scaler.inverse()函数将数据重新放大(因为之前使用了scaler()函数对数据进行了压缩)

closing_price = scaler.inverse_transform(closing_price)

# print(closing_price)

dicts = []

for i,resu in enumerate(closing_price):

dicts1 = {}

dicts1['riqi'] = list1[i]

dicts1['shuju'] = resu[0]

dicts.append(dicts1)

return dicts

# print(yuce())