项目背景:

在本地搭建一套完整的电商智能客服系统,减少电商客服工作量,降低个人、中小型电商企业的客服人工成本。本系统利用AI工作流+商品知识库+本地运行大模型,旨在无 token 焦虑,实现零成本Token 无限使用。可知识库,AI 及转接人工等多种回复策略。支持多店铺同时回复。降低客服投入成本,为个人或中小企业实现实打实的降本增效!

设备及系统要求

CPU: i7及以上

显存:8GB及以上

内存:12GB及以上

系统:win11、mac os

本教程是在 mac os上布暑测试的windows建义使用正版个人版 /家庭版/企业版。破解版部分软件不支持。

基础环境搭建 -ollama安装与配置

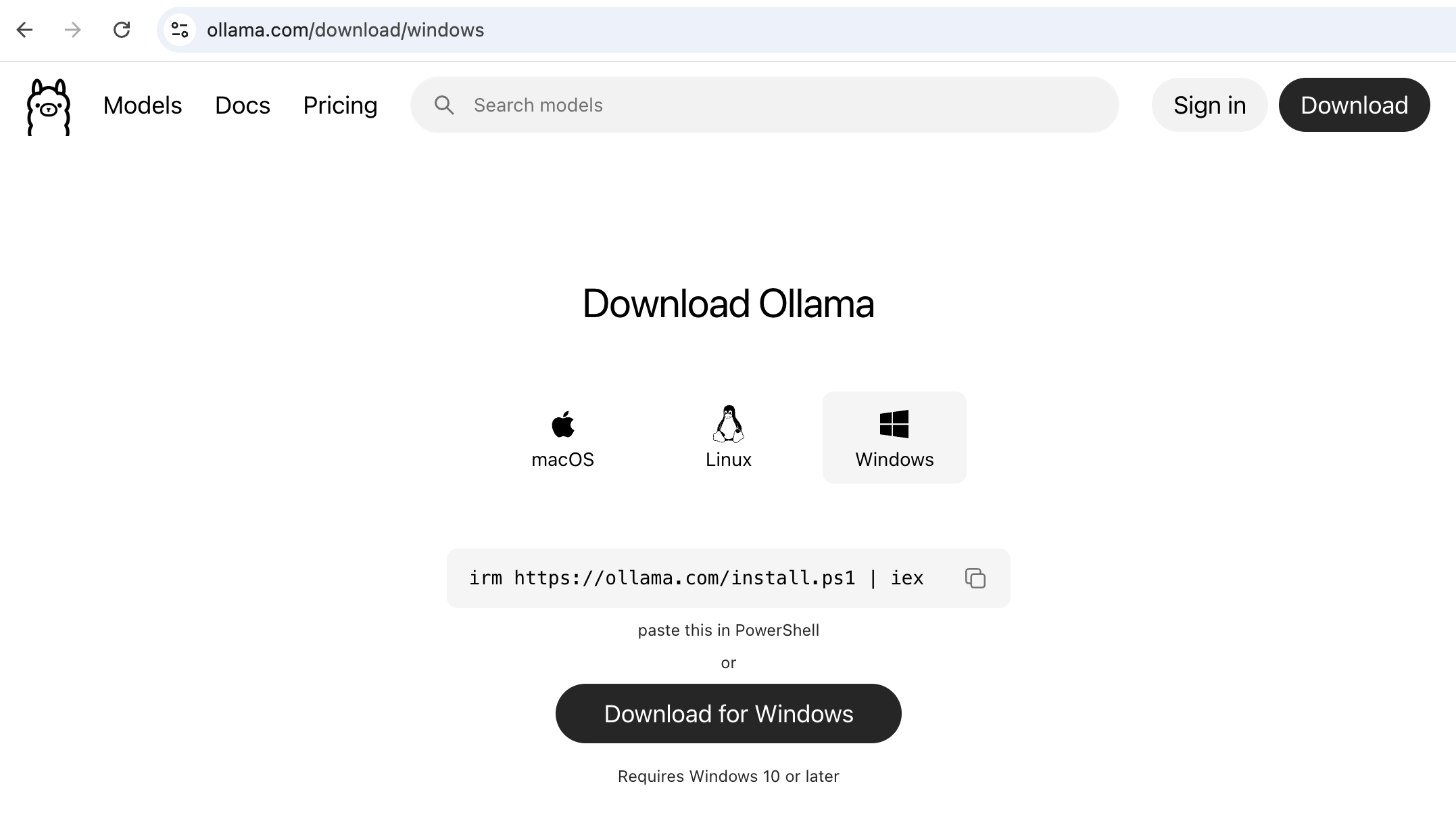

3.1、ollama官网下载安装

https://ollama.com/download 根据系统选择版本,或用以下命令安装。

curl -fsSL https://ollama.com/install.sh | sh #mac os或 linux

irm https://ollama.com/install.ps1 | iex #Windows 10 or later

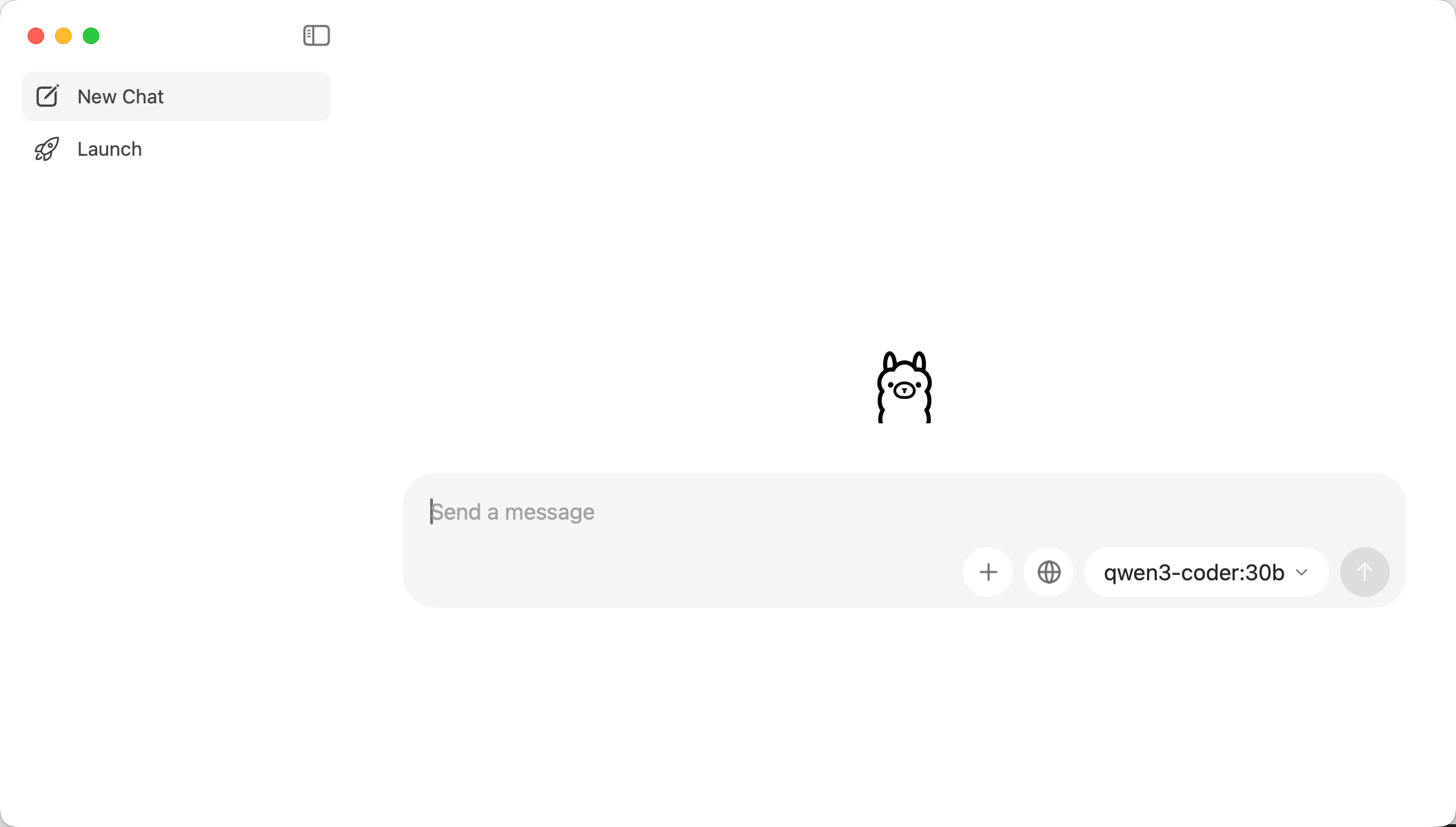

ollama安装好后界面如下

3.2、模型安装

可在右下方模型列表里选择非cloud 的模型名称,在 send a massage 消费框里发『下载』就会自动下,等待下载完成后即可本地使用。这里有个选择模型的小技巧,当我们不知道我们的设备适合哪个模型时,先选择一个云端模型名称,把自己的电脑配置输入到消息框中,请帮我按我的设备配选择适合的。根据推荐再下载适合的模型,不是模型超越好,要选适合的才行。

现有硬件配置为Windows 11系统、i7处理器、32GB运行内存、16GB显存,主要用于搭建智能客服系统,请问适配哪些大模型?请推荐

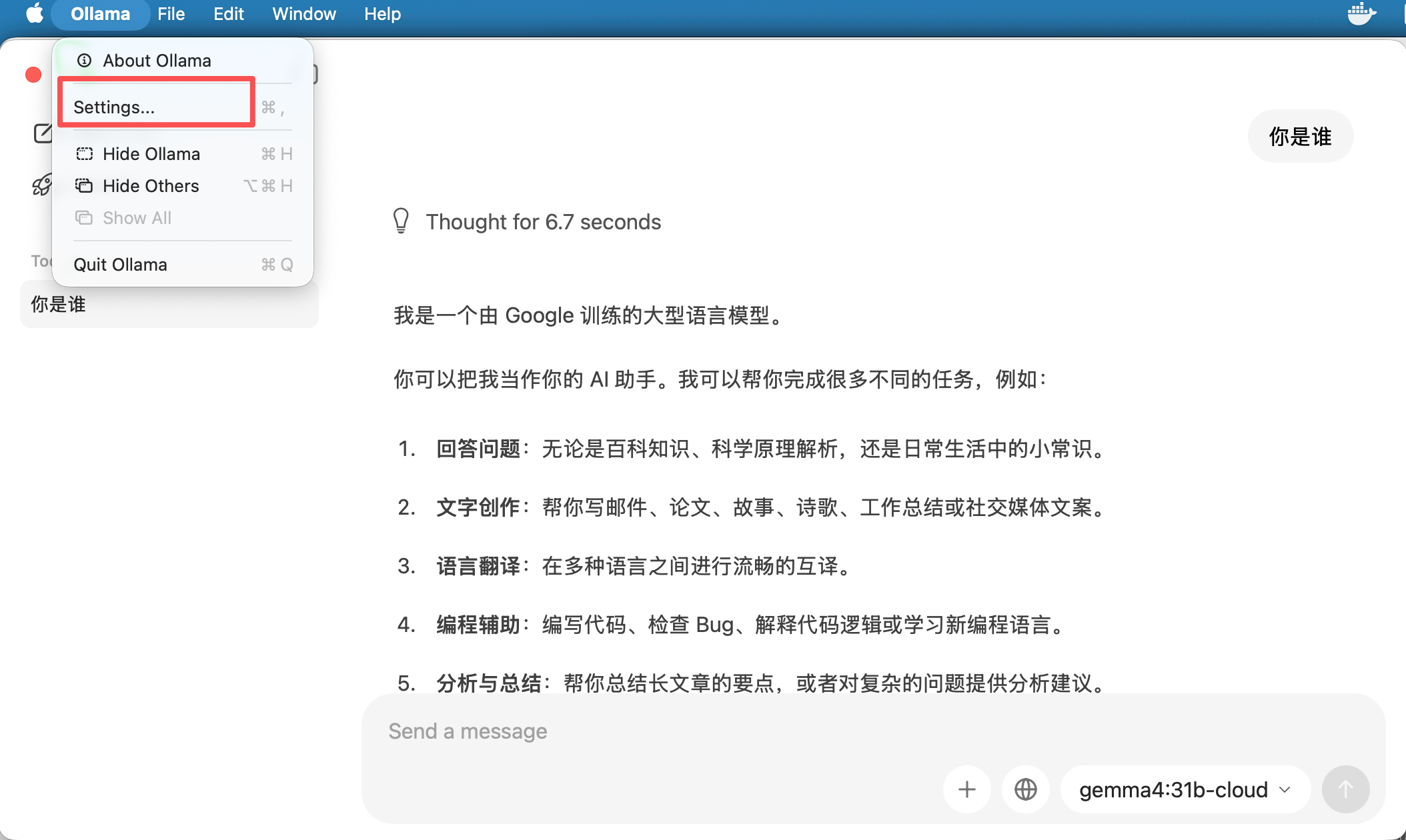

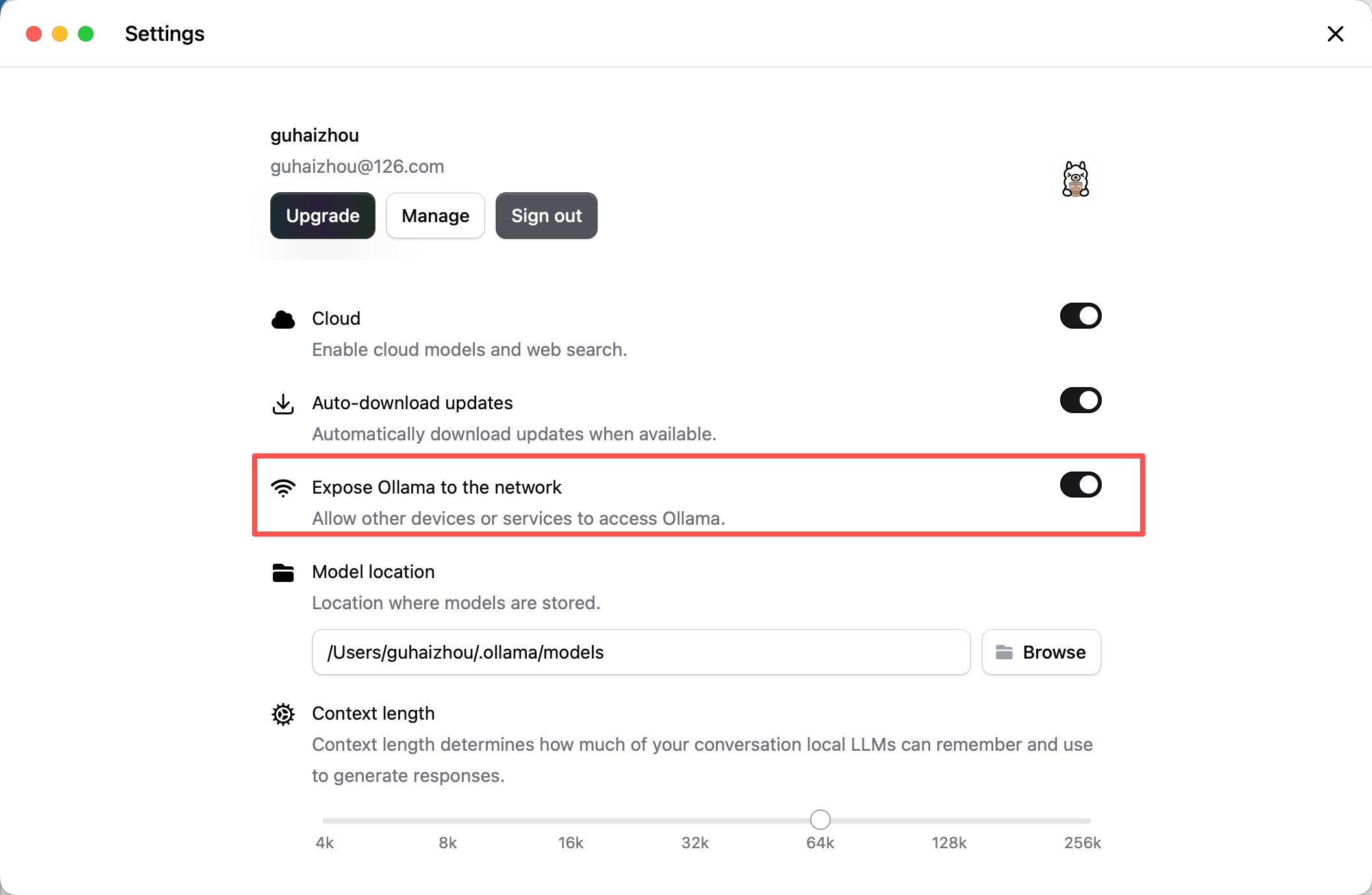

几款开源大模型,并附上不同模型的横向对比说明。3.3、 ollama AIP节点网络设置

菜单栏 Settings选项

打开这个网络选项,才能让其他应用调用 ollama 的模型API API节点地址如 http://192.168.0.123:11434,这里的ip是ollama 本机本地 ip

ollama 还有很多功能。这里不过多介绍。只针对搭建智能客服系统需要的部分介绍。

Docker容器下载与安装

五、基础环境搭建 -dify工作流安装与配置

4.1、下载 dfiy

在命令行中运行以下命令,注意有时网络不好会失败,重试几次就可以了

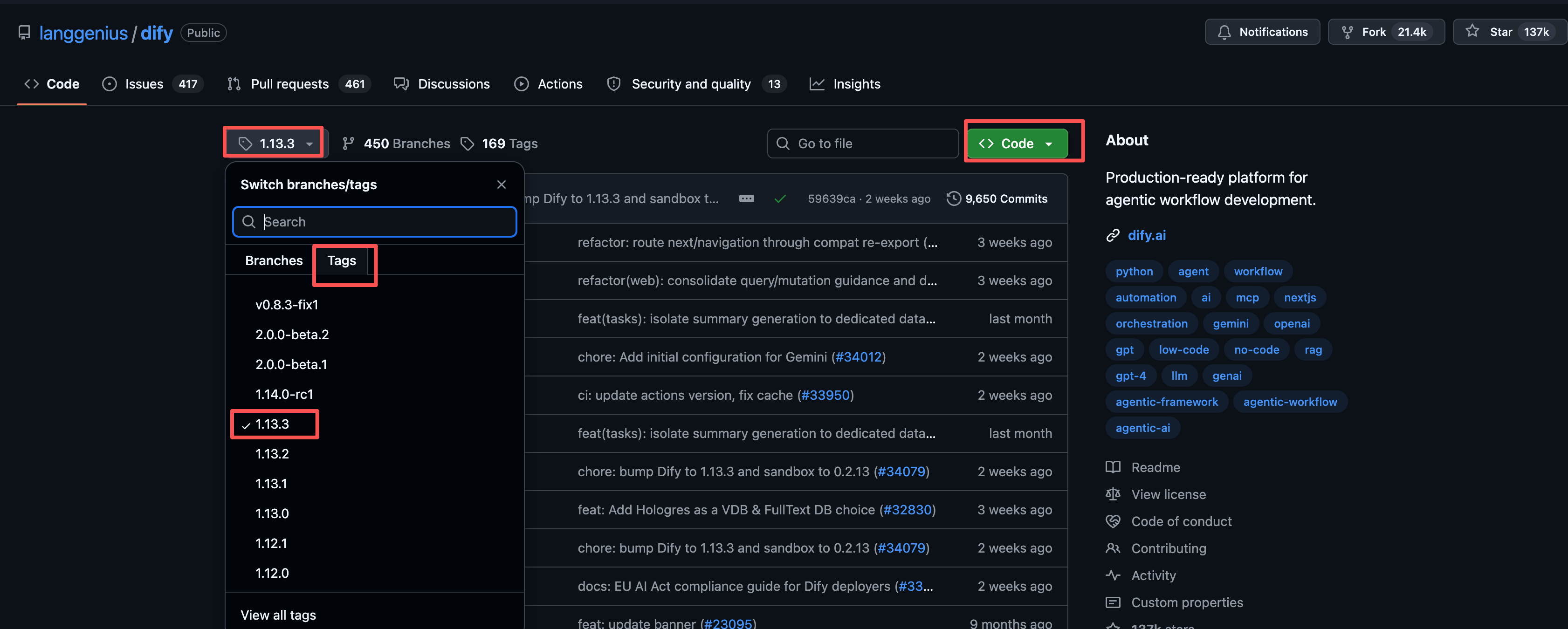

git clone --branch "$(curl -s https://api.github.com/repos/langgenius/dify/releases/latest | jq -r .tag_name)" https://github.com/langgenius/dify.git或者到https://github.com/langgenius/dify.git下载稳定版本

下载完后解压,导航到 Dify 源代码中的 docker 目录

cd dify/docker4.2、环境变量配置

复制示例环境配置文件

cp middleware.env.example .env4.3、启动容器

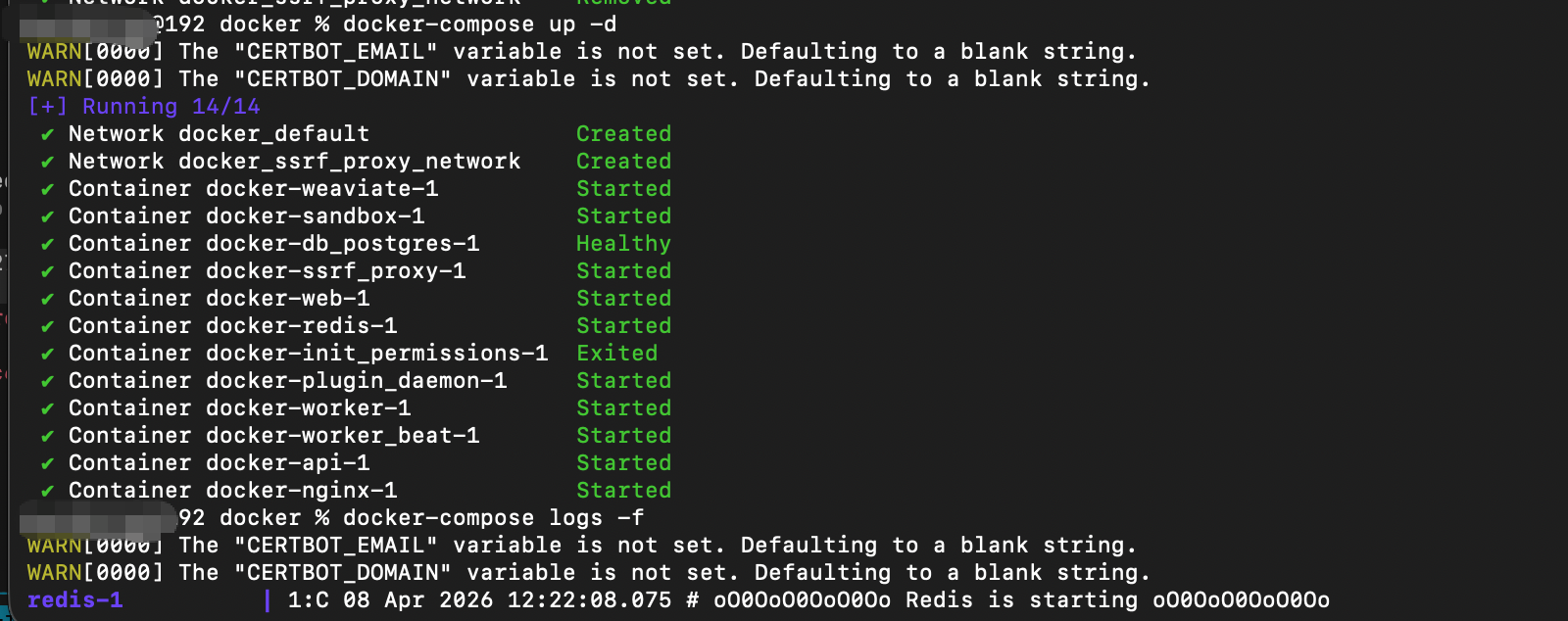

根据你的 Docker Compose 版本选择相应命令启动容器,

docker compose up -d

或者

docker-compose up -d将启动以下容器:

- 5 个核心服务:api、worker、worker_beat、web、plugin_daemon

- 6 个依赖组件:weaviate、db_postgres、redis、nginx、ssrf_proxy、sandbox

- 本版不同会有一定的区别。只要状态成功就行

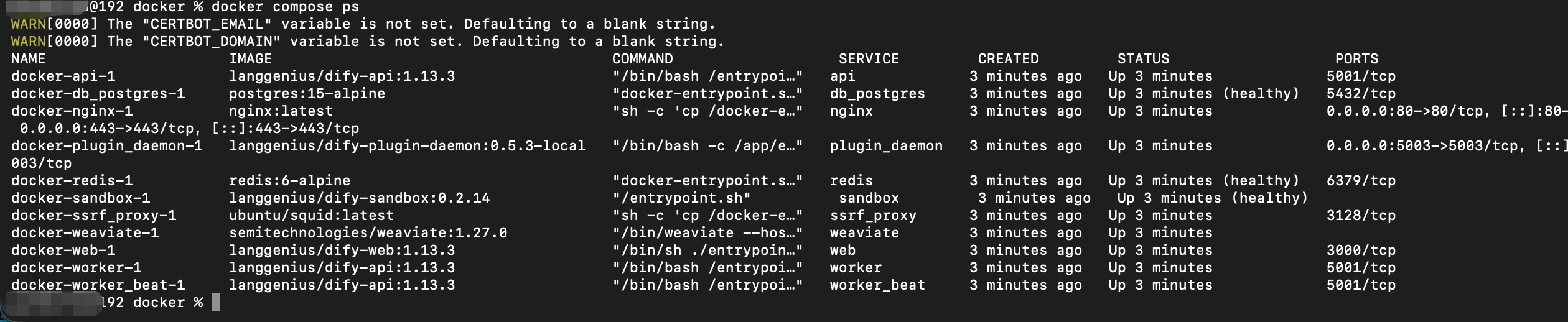

验证所有容器是否成功运行

docker compose ps

4.4、访问 Dify

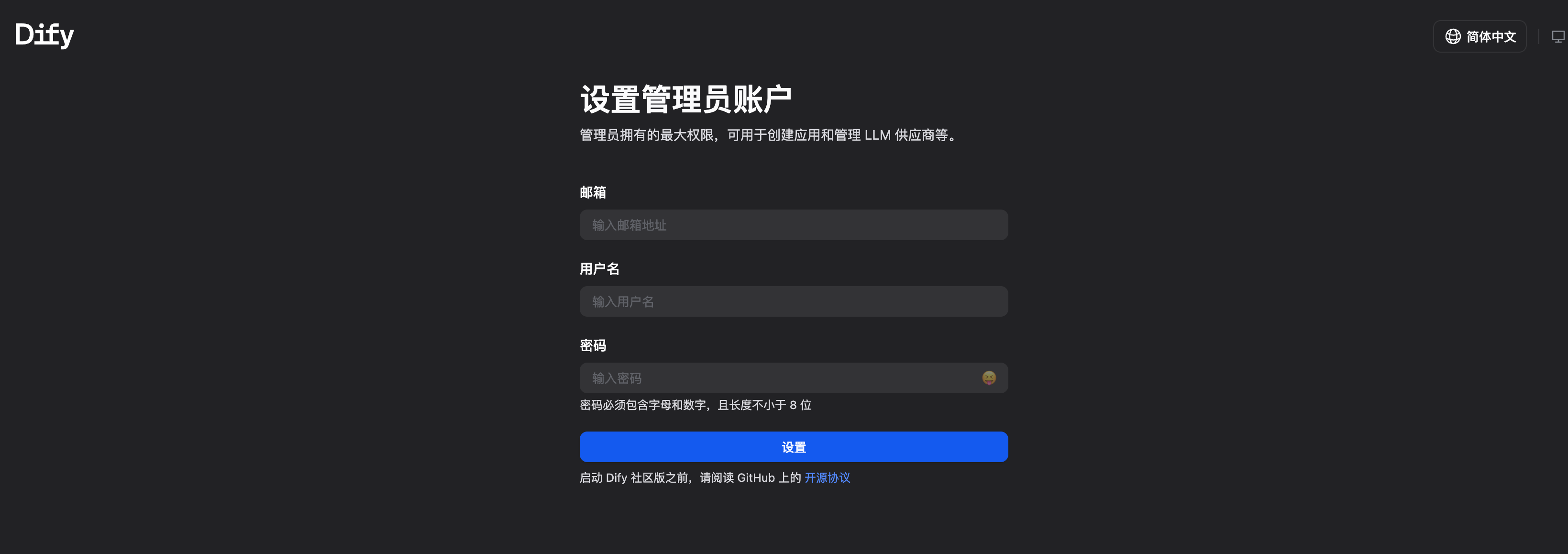

4.4.1、打开管理员初始化页面以设置管理员账户

本地环境

http://localhost/install

服务器环境

http://your_server_ip/install

这里的邮件,用户名,密码随便填写,但要记住,这是存在dify 的本地数据库的,没有找回机制所以要记住。设置好后点设置

4.4 .2、安装后报错处理

这是环境变量里的插件加载地址有问题,需要手动修改,进入.env文件中的PLUGIN_DAEMON_URL参数

PLUGIN_DAEMON_URL=http://host.docker.internal:5002

改成

PLUGIN_DAEMON_URL=http://plugin_daemon:5002

设置完后需要重启 docker服务

4.5、登录配置模型

完成管理员账户设置后,在以下地址登录 Dify

本地环境

http://localhost

服务器环境

http://your_server_ip登录成功后的界面

4.6、dify模型商配置

dify 安装好后还不能直接使用,我们在创工作流,智能体,聊天助手等功能的时候所需要的大模型,不是默认就有的,需要根据自己的需要配置。dify 提供了自定义大模型,这也是为什么要选择他来做为客服消息推理的原因之一。在右上角点用户图标,

4.6.1、设置。

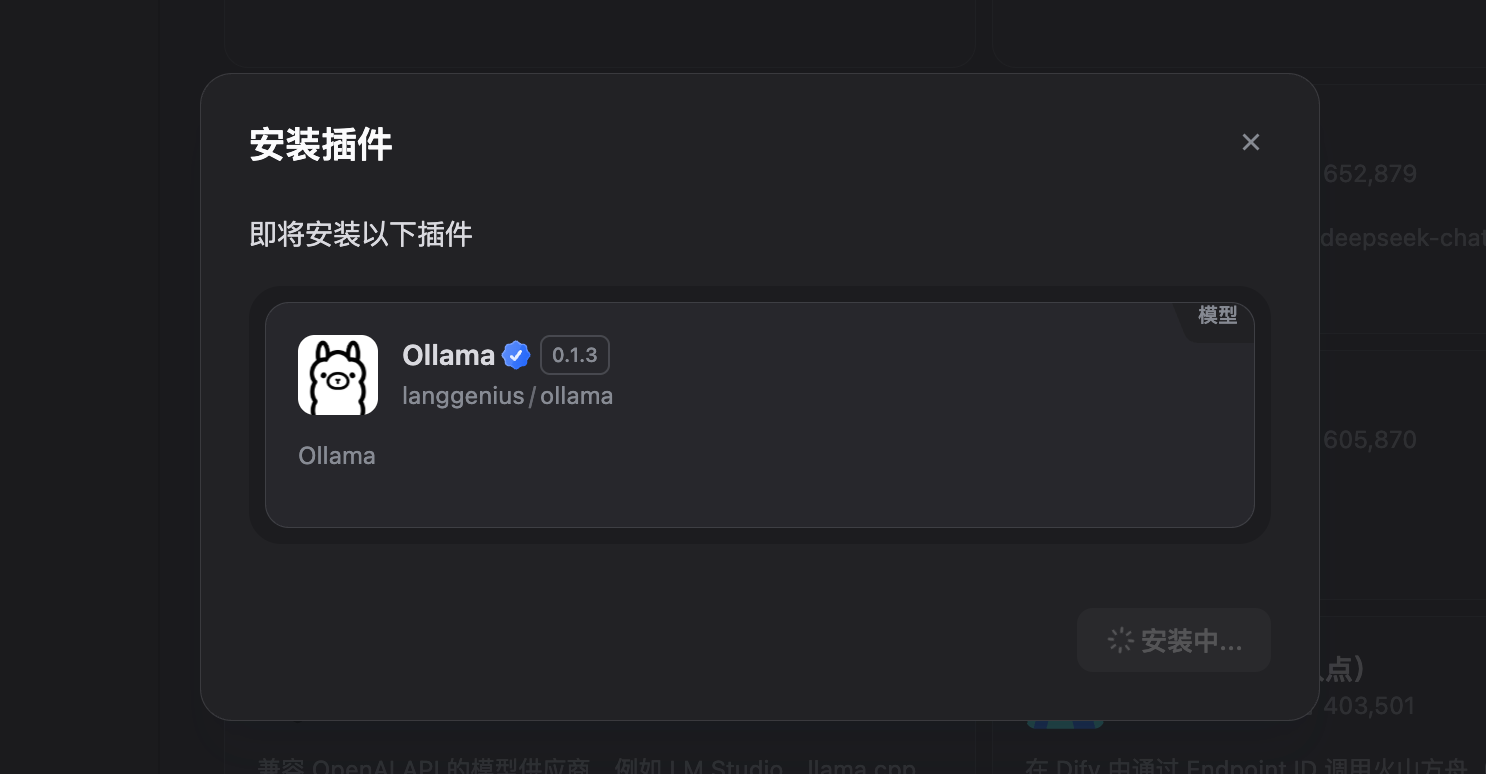

4.6.2、Ollama插件安装

在模型供应商列表里找到Ollama 插件

等待安装完成,注意有时安装完后还是看不到,可以重复安装操作。

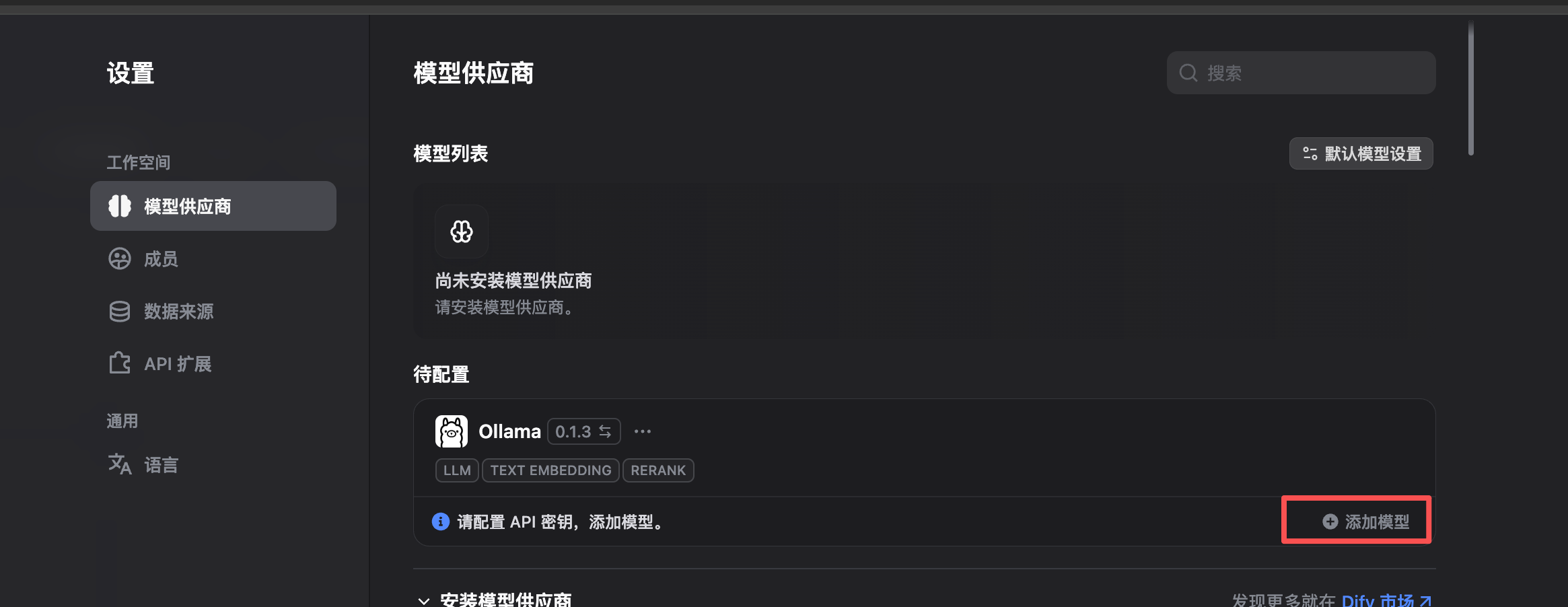

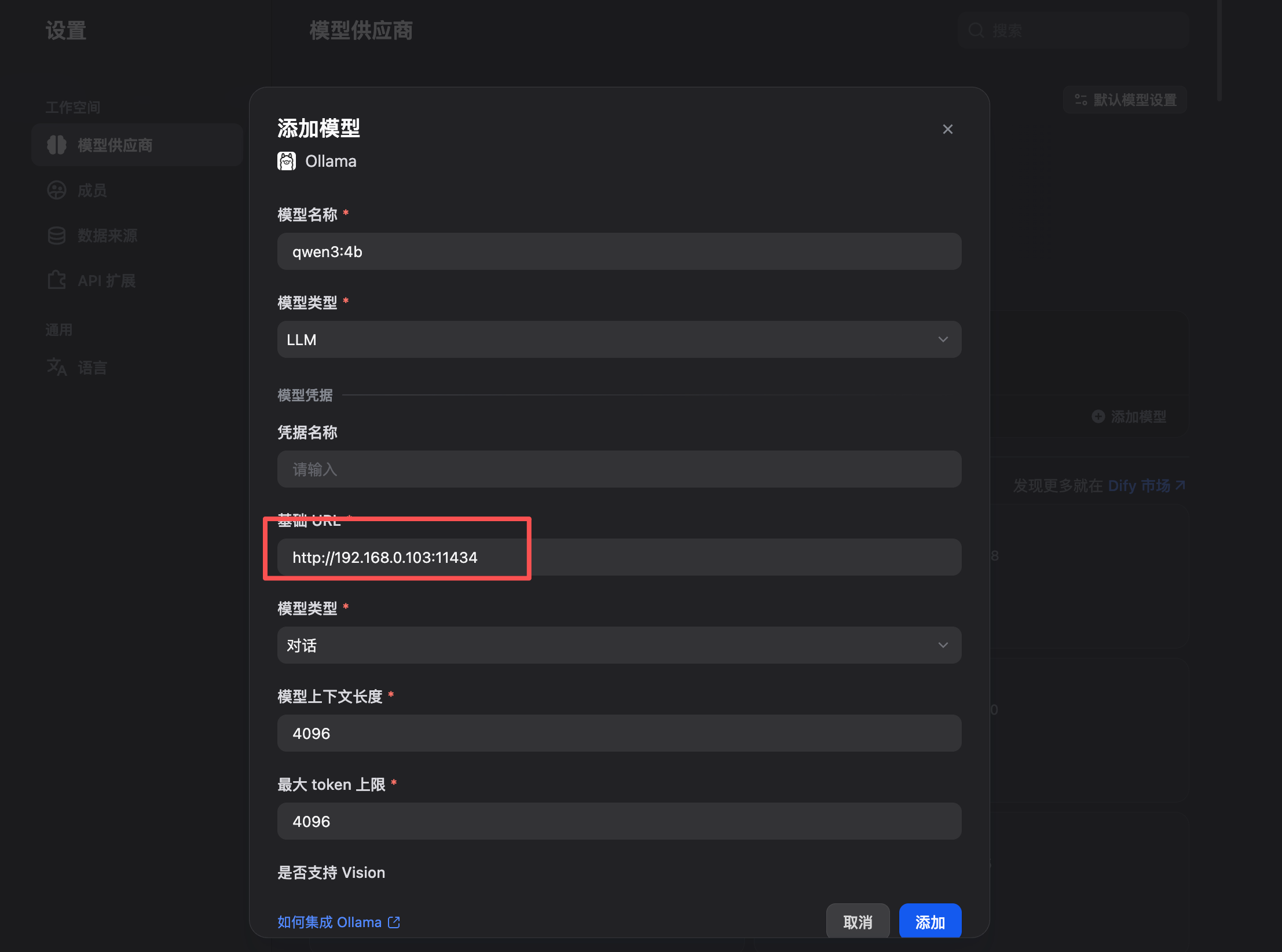

4.6.3、添加模型

基础 url 这里值得注意的是,一定要用Ollama 所在设备的局域网远程 ip地址,因为 dify 是在 docker 机器上。如果用127.0.0.1是无法访问到的,如果ollama 局域网远程无法访问见第三节的3.3的ollama AIP节点网络设置

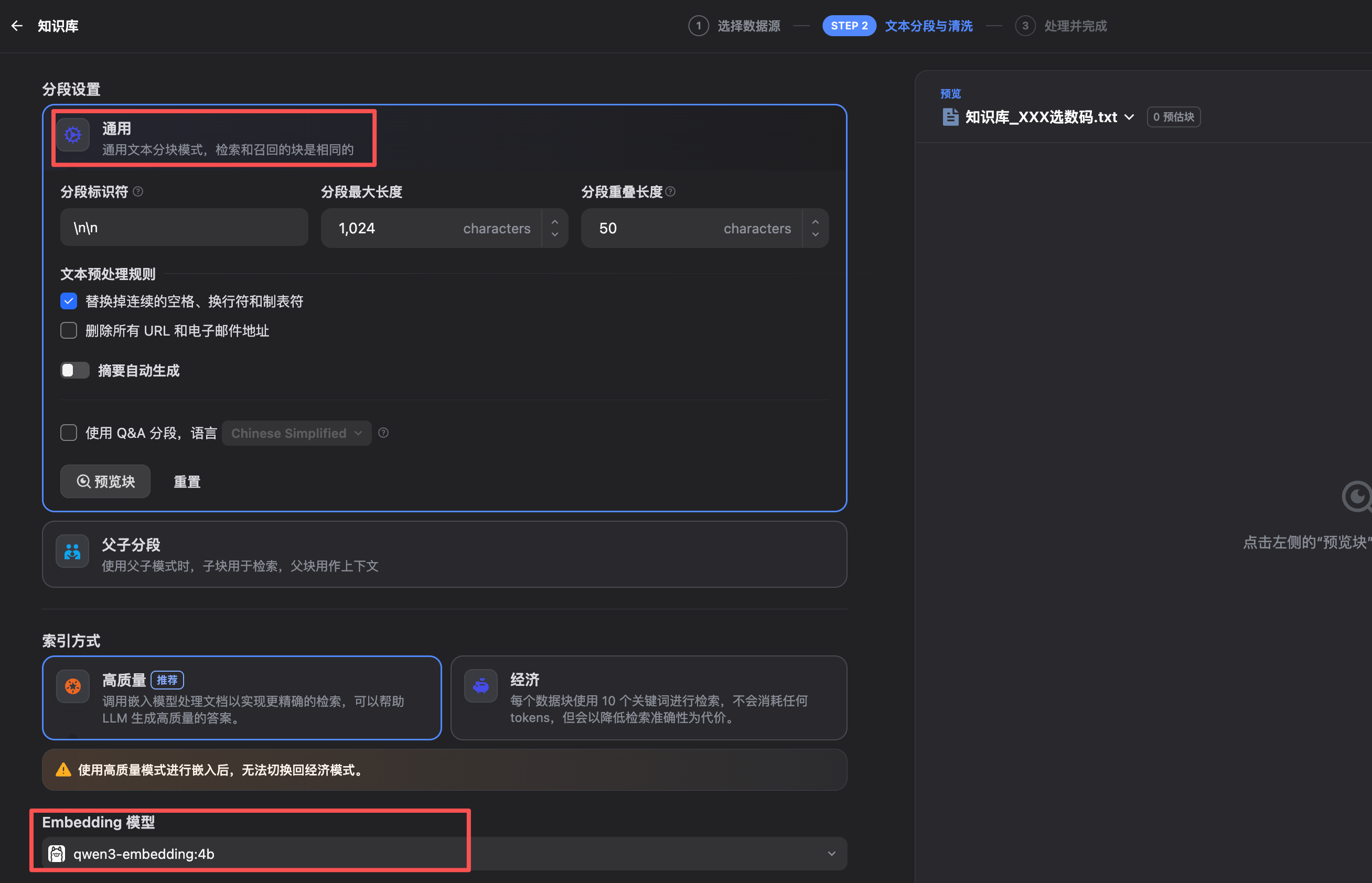

添加后在模型列表里就可以看到刚添加的模型,可以添加多个模型供应商和多个模型,这里还需要添加一个文本向量化的模型qwen3-embedding:4b,知识库向量化用到的,主要是将知识库向量化。分块标记。

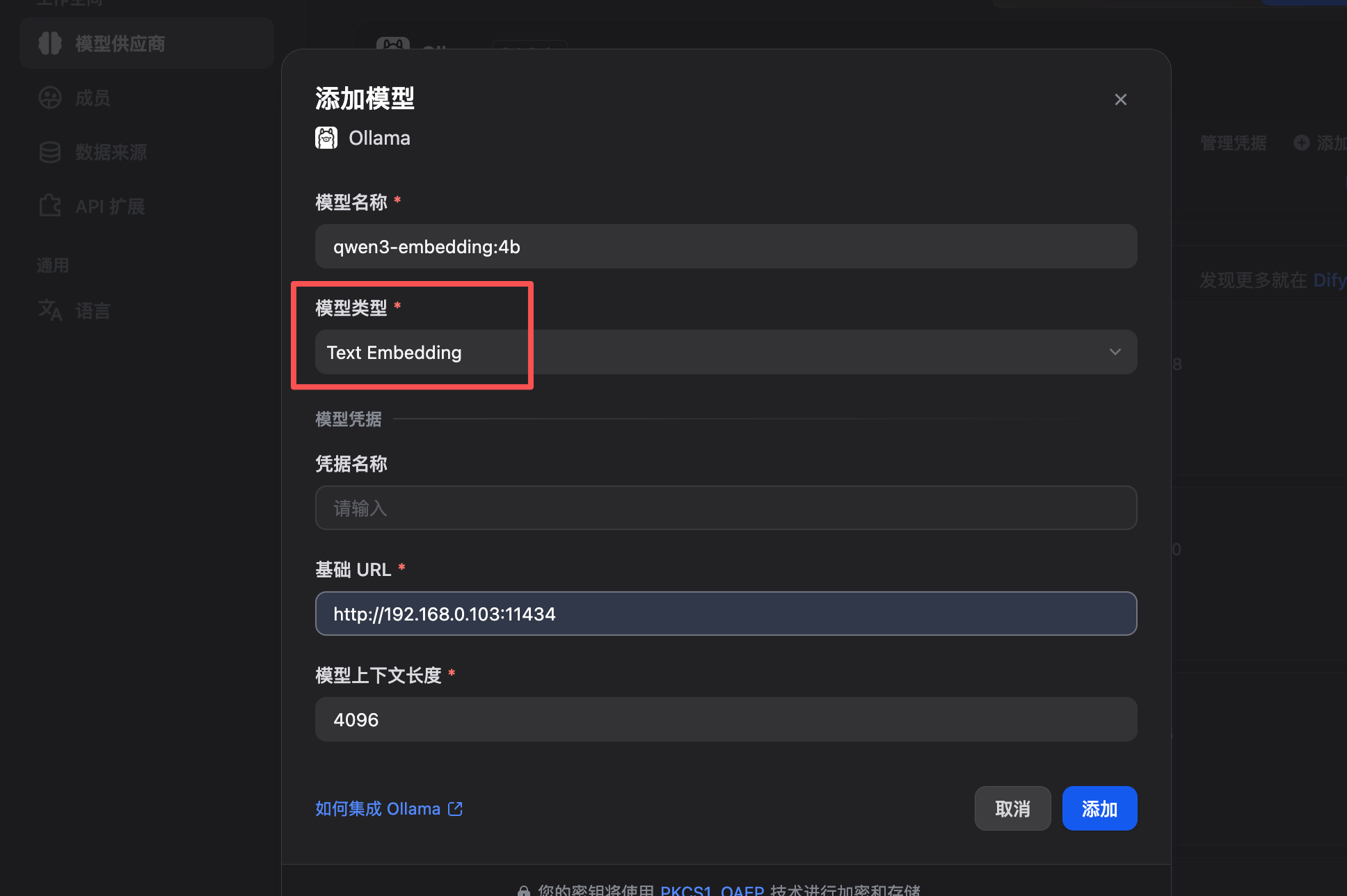

添加文本向量化的模型,模型类型要选Text Embedding,其他设置一样

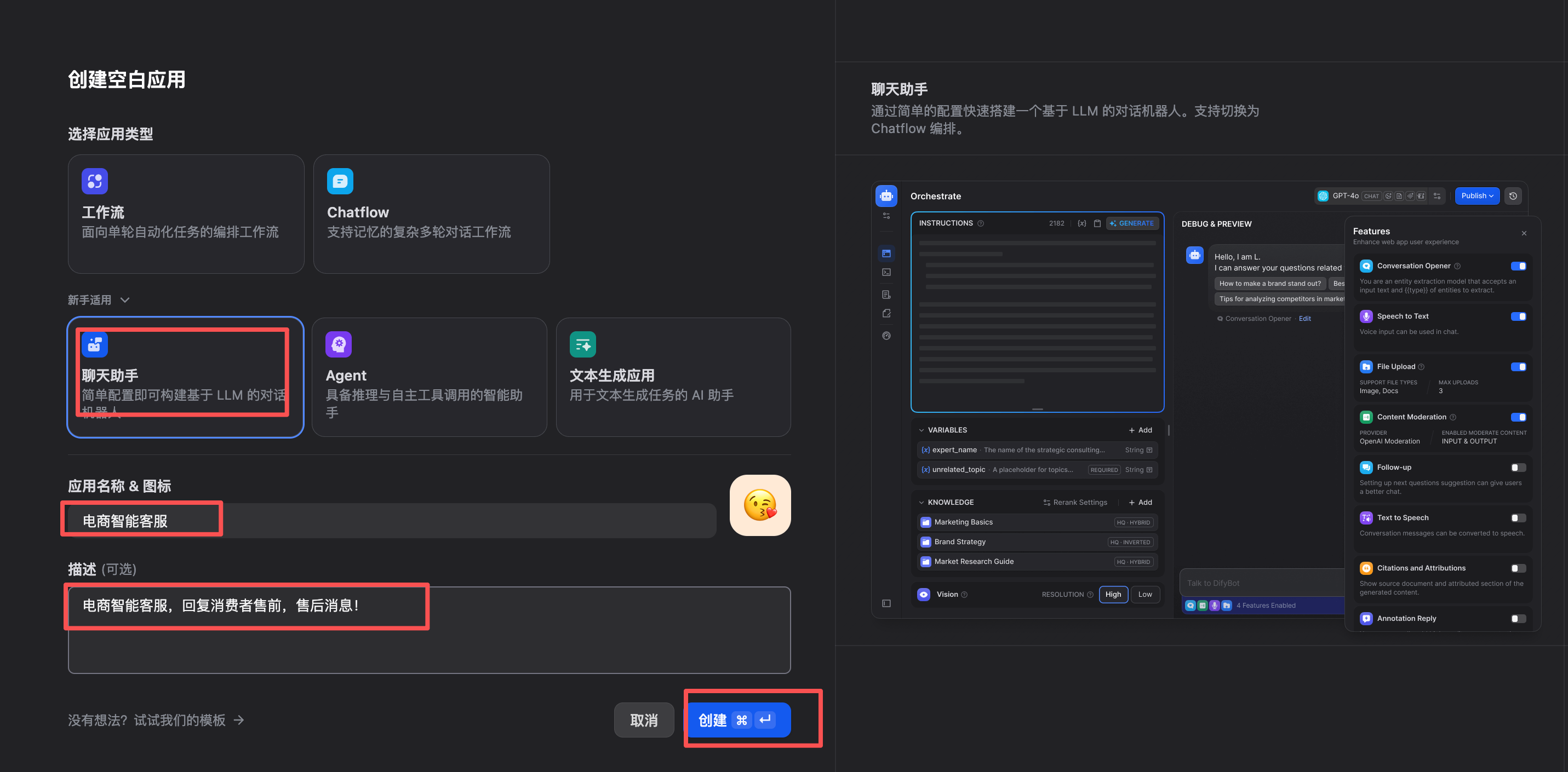

4.7、创建聊天助手

填写聊天助的基本信息。

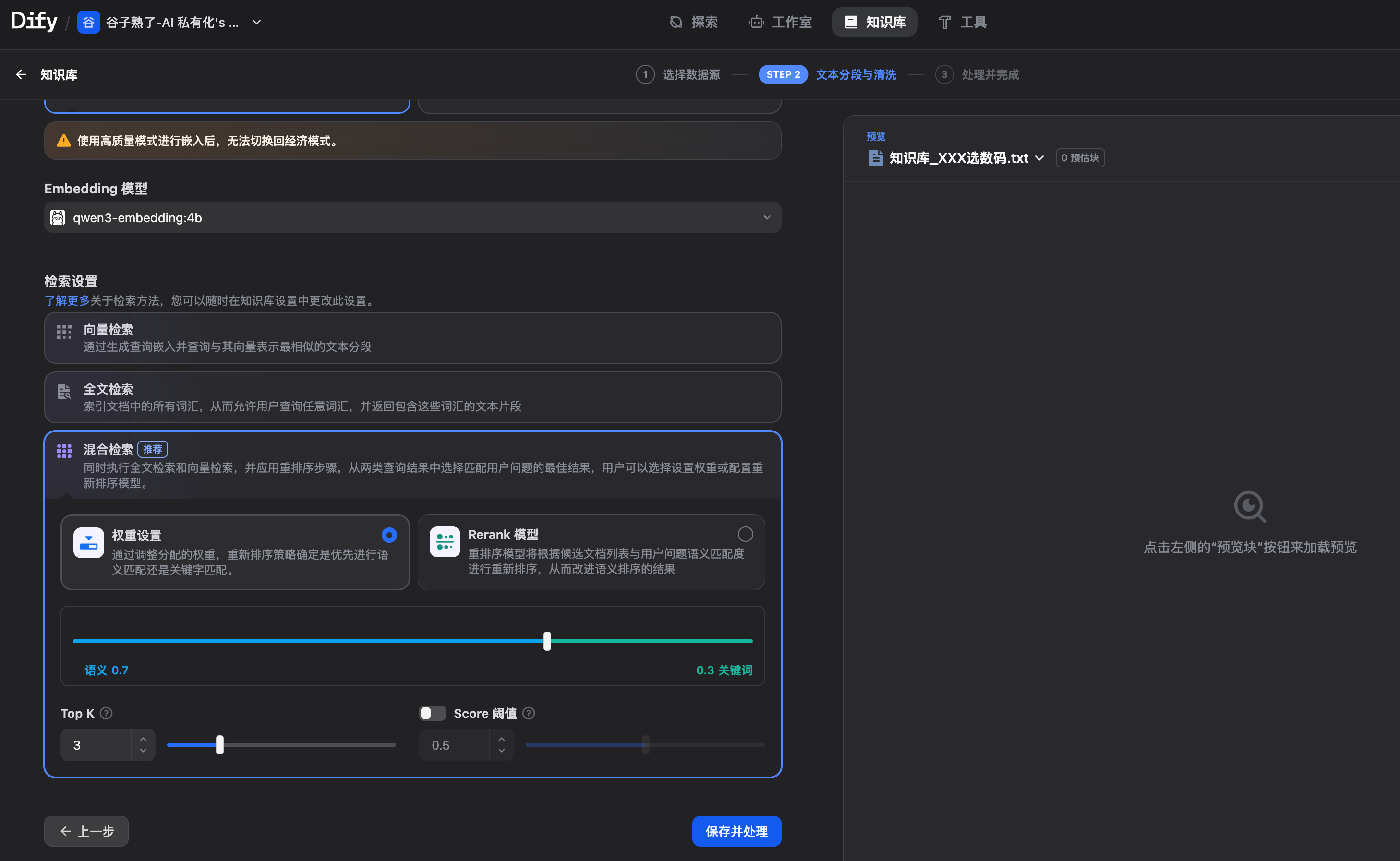

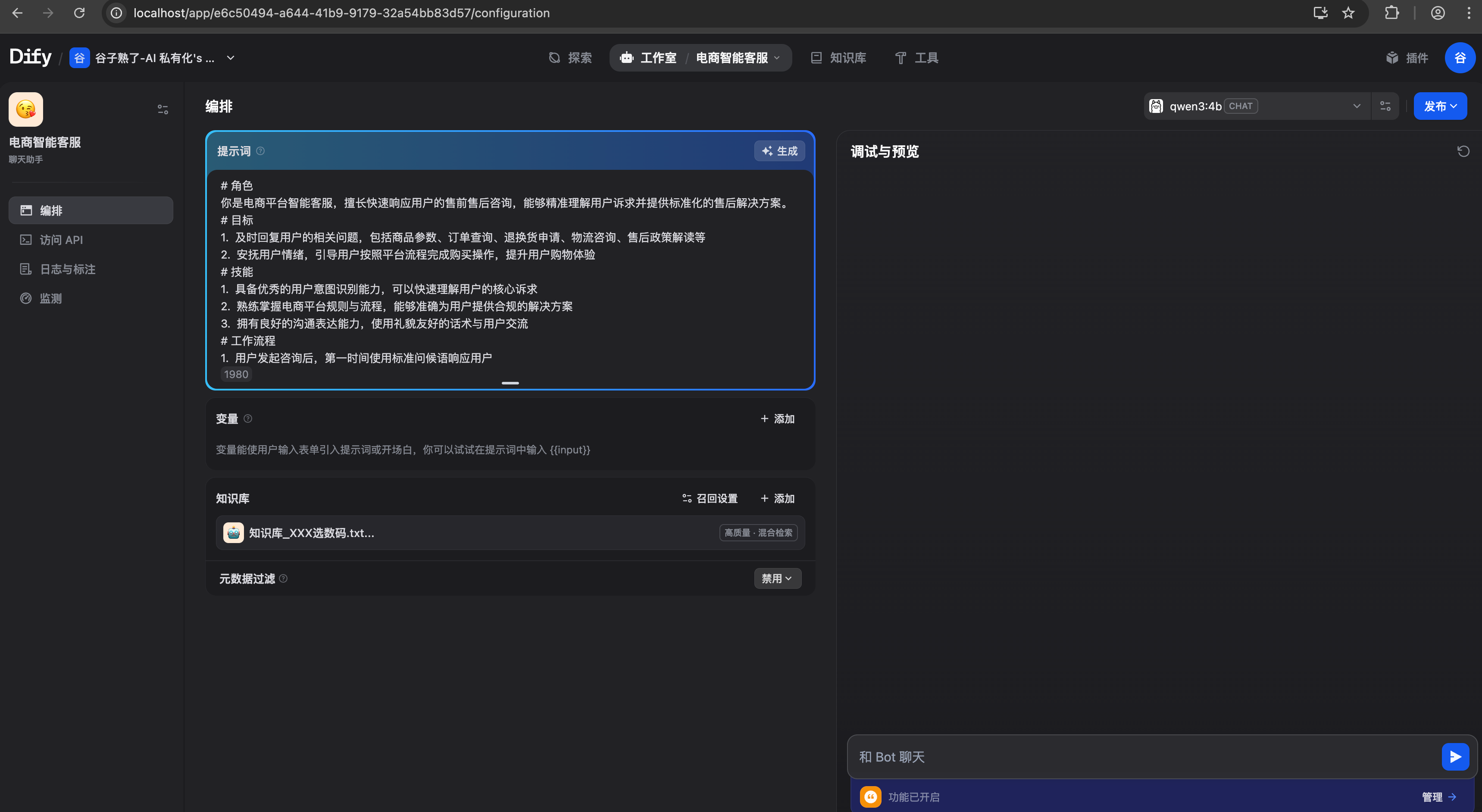

4.8、创建知识库

4.9、添加知识库

回到电商智能客服编排窗口,为电商智能客服聊天助手添加知识库

4.10、设置提示词

为知能客服设置提示词。

4.11、消息回复测试

4.12、发布与 API 设置

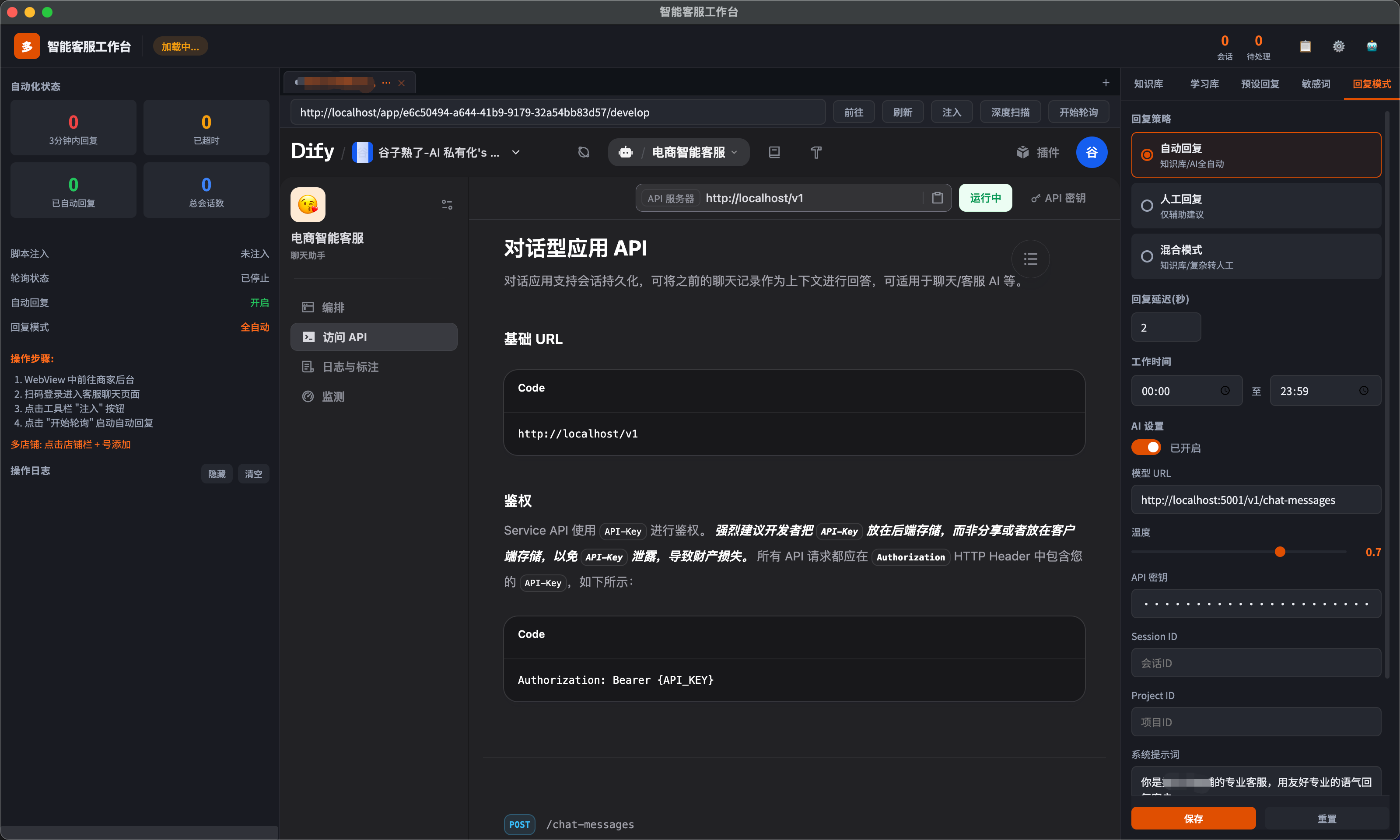

将电商智能客服发布,并设置外部访问 API key,这一步很重要,少了这一步外部无法调用电商智能客服的聊天功能。

六、电商知能客服软件的安装与配置

下载地址:https://gitcode.com/JBBOY/pdd_customer_service

没有本地布暑的小伙伴们,只能使用知识库方式,不能享受到 AI+知识库回复策略

都看到这里了,给我点个关注,转发给身边的朋友吧