随着AI技术的飞速迭代,3D场景重建已从工业级专业领域走向消费级应用,"拍一圈即生成可交互3D世界"不再是科幻场景。截至2026年,AI驱动的快速扫描与3D场景构建技术已实现从"离线小时级"到"在线分钟级/实时级"的跨越,消费级设备搭配AI算法即可生成厘米级甚至毫米级精度的高质量3D场景,同时支持流畅实时漫游。本文将全面拆解当前技术水平、主流实现途径、实时性差异,并给出可直接落地的选型方案,帮你快速掌握AI 3D扫描的核心逻辑与应用技巧。

一、当前技术水平:精度、速度与设备门槛全面突破

经过多年技术迭代,AI 3D场景扫描已形成"专业级精准、消费级便捷、实时级流畅"的三层格局,核心指标实现全面升级,同时设备门槛持续降低,让更多开发者和普通用户能够触达这项技术。

1. 精度层面:按需匹配,覆盖全场景需求

精度是3D场景重建的核心指标,不同场景对精度的要求差异较大,当前技术已能实现分层适配:

-

消费级(手机/单目相机):达到厘米级精度(1--5 cm),纹理还原达到照片级水准,足以满足日常场景预览、简单数字资产制作等需求,无需专业设备即可实现。

-

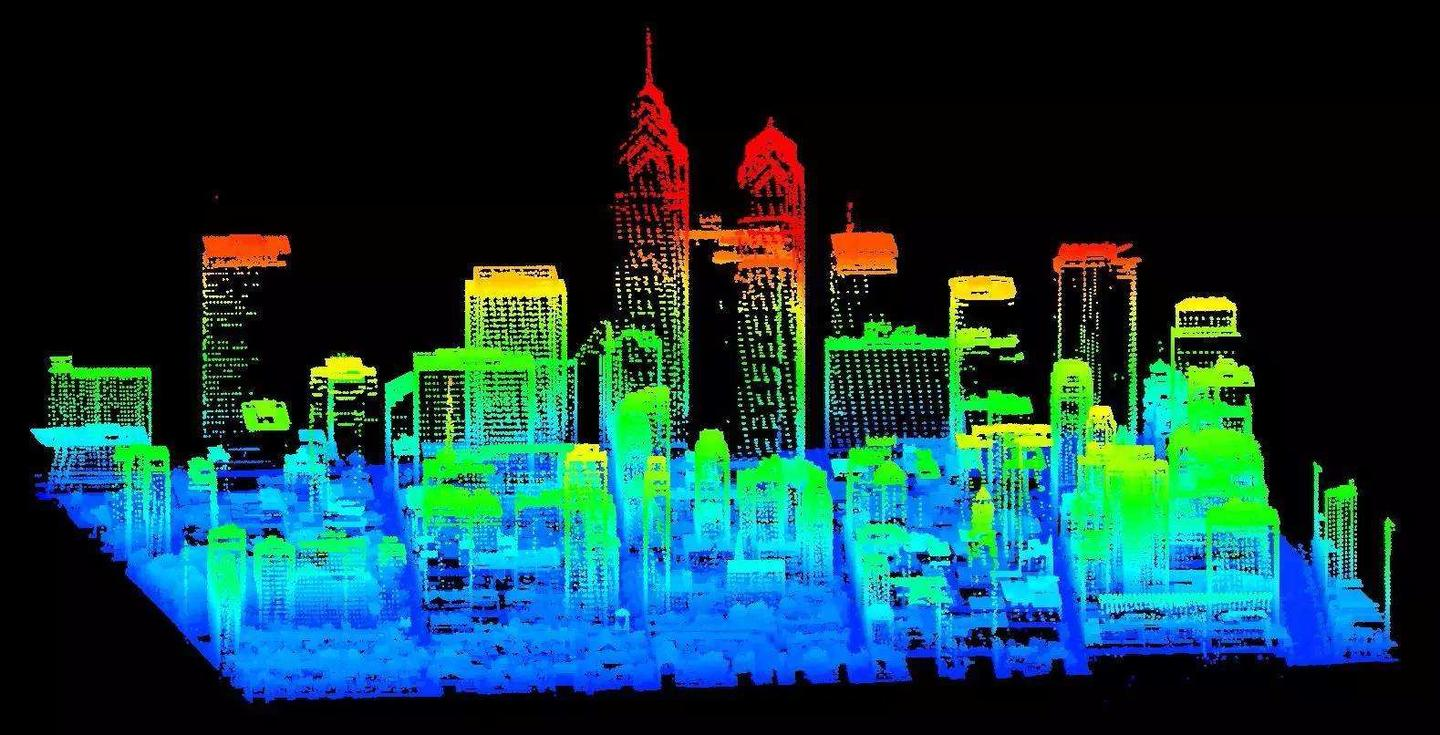

专业级(LiDAR/结构光扫描仪):实现毫米级精度(0.1--10 mm),属于工业测量级水准,可满足工业逆向工程、建筑测绘、文物数字化等高精度需求。

-

神经表示技术(NeRF/3DGS):可实现亚毫米级细节还原,且能保证光影效果的物理一致性,完美呈现砖墙颗粒感、树叶透光感等细腻细节,适合对画质要求极高的场景。

2. 速度层面:从离线到实时,效率翻倍

速度的提升是AI赋能3D重建的核心优势,彻底改变了传统重建"耗时久、效率低"的痛点,当前速度水平可分为三个梯度:

-

静态场景:分钟级完成重建与优化(1--30 min),依托AI算法对多视角图像或深度数据的快速处理,无需长时间等待即可获得完整3D场景。

-

动态/流式场景:准实时(15--30 FPS)或实时(60+ FPS)端到端重建,能够实现"边走边扫、边扫边建",满足AR实景、机器人漫游等实时需求。

-

极速预览:单张RGB图像即可实现1--10秒快速重建,虽精度有限,但能快速生成3D原型,适合移动端快速演示、低成本初稿制作等场景。

3. 设备门槛:全民可及,从手机到专业设备全覆盖

AI算法的优化大幅降低了3D重建的设备门槛,不同硬件条件均可找到适配方案,无需高额投入:

-

最低门槛:单目RGB手机/相机,无需深度传感器,依托AI深度估计算法,即可实现基础3D重建,人人都能上手操作。

-

主流配置:手机+LiDAR(如iPhone Pro系列)、消费级RGBD相机,兼顾便捷性与精度,是当前个人和小型团队的首选配置。

-

专业配置:激光雷达、结构光扫描仪、工业相机阵列,主要用于工业、测绘等专业领域,能够实现最高精度的重建效果。

二、四大主流技术途径:原理、实时性与适用场景拆解

当前AI快速扫描3D场景的实现途径主要分为四大类,各有侧重,实时性、优缺点差异显著,适配不同的应用场景。结合2026年最新技术进展(如Spark 2.0引擎、LiTo模型等),具体拆解如下:

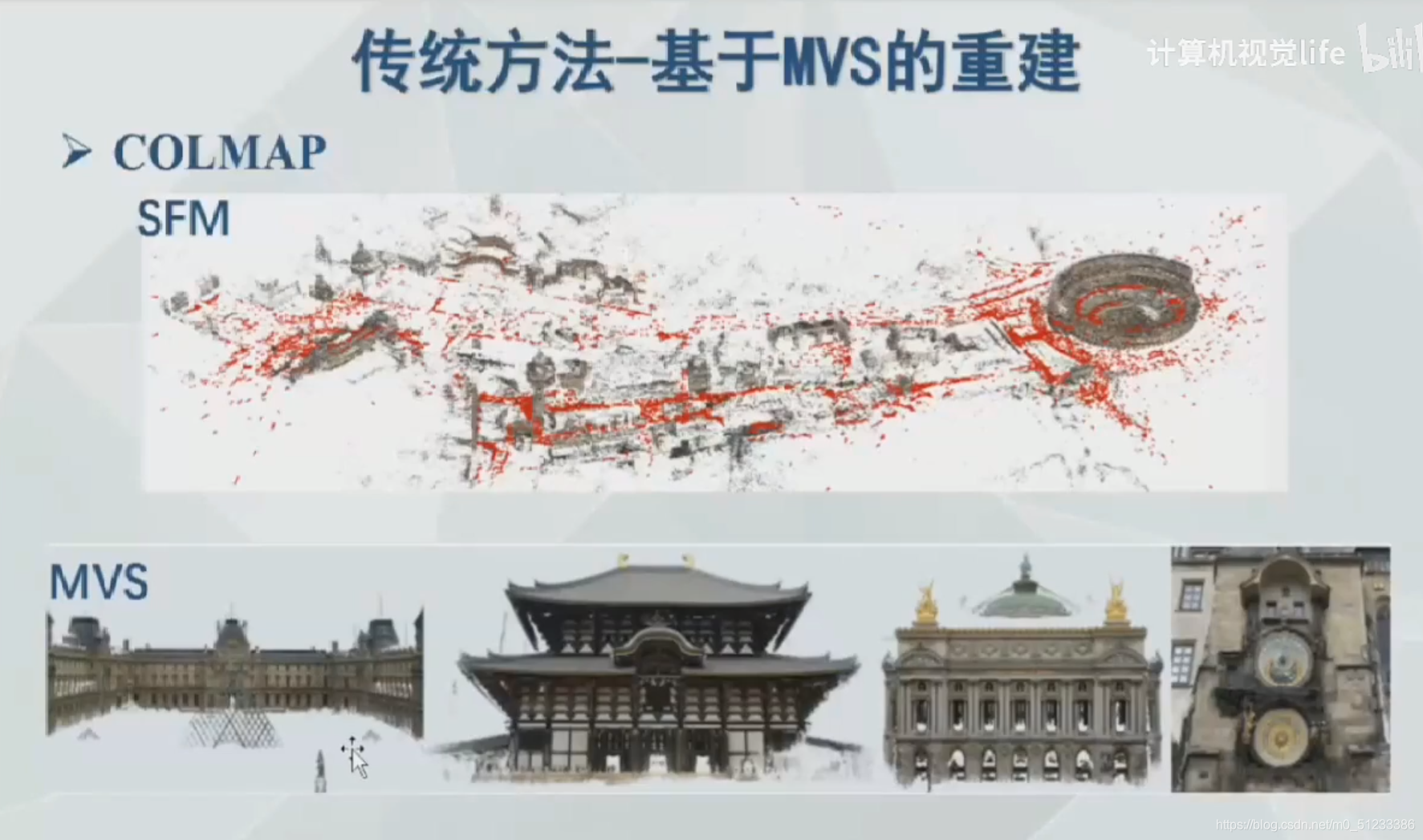

1. 传统几何重建(SfM/MVS + 点云/网格):精度稳定的"老牌方案"

这是最成熟的3D重建技术路线,核心依赖几何关系推导,至今仍是专业高精度场景的首选方案。

-

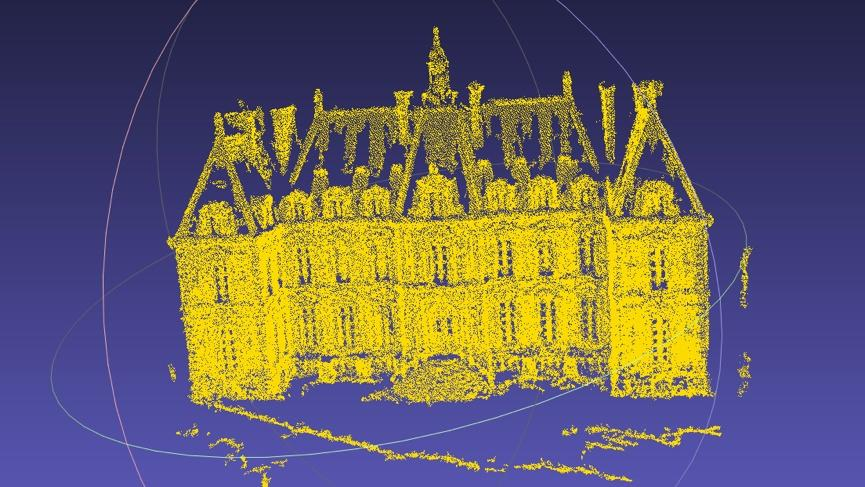

核心原理:通过多视角图像提取特征并匹配,估计相机位姿(SfM,运动恢复结构),再生成稠密点云(MVS,多视角立体视觉),最终构建网格与纹理,还原3D场景结构。

-

代表工具:COLMAP、OpenMVG、Meshroom、ContextCapture,均为开源成熟工具,社区支持完善。

-

实时性:整体偏离线,完整重建需小时级;流式SLAM变种(如ORB-SLAM3)可实现10--30 FPS的稀疏重建,但稠密重建仍低于5 FPS,无法满足实时需求。

-

优缺点:精度稳定、开源成熟,适合大规模静态场景的高精度重建;缺点是速度慢、需大量图像输入,在弱纹理、反光区域易失效,且渲染效率低。

-

适用场景:建筑测绘、工业逆向工程、文物数字化、无人机航拍建模等对精度要求高、不追求实时性的场景。

-

2. 神经辐射场(NeRF 及其变种):照片级画质的"写实方案"

NeRF(神经辐射场)是近年来的热门技术,通过隐式编码场景实现超高画质重建,解决了传统方法难以还原复杂光影的痛点,经过优化后已具备实用价值。

-

核心原理:用MLP(多层感知机)隐式编码场景,输入空间位置和观测视角,即可输出该点的颜色和密度,通过体渲染技术合成新视角图像,还原场景的真实光影效果。

-

代表模型:NeRF(原始版本)、Instant-NGP(极速优化版)、Mip-NeRF 360、NeRFacto,其中Instant-NGP是当前最常用的实用版本。

-

实时性:原始NeRF训练需数小时,渲染低于1 FPS,实用性较低;Instant-NGP大幅优化后,训练仅需5--15分钟,渲染可达60--100 FPS(需RTX 3090及以上显卡),具备实用价值。

-

优缺点:照片级画质、视角自由,对弱纹理区域鲁棒,能完美还原复杂光影;缺点是训练仍需一定时间,显存占用高,场景编辑难度大,不适合动态场景。

-

适用场景:静态小物体复刻(零件、摆件、文物)、特写写实渲染、VR场景制作等对画质要求极高的静态场景。

-

3. 3D高斯溅射(3DGS / 4DGS):当前综合最优的"主流方案"

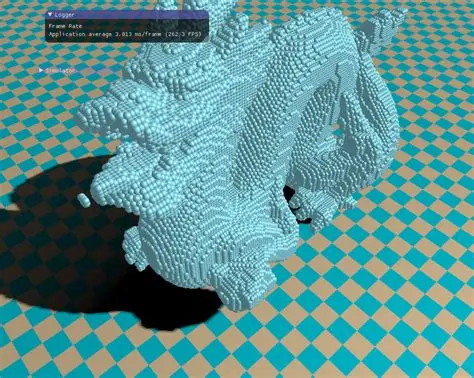

3DGS(3D Gaussian Splatting)是2026年最主流的技术路线,兼顾重建速度、画质和实时渲染,同时支持动态场景扩展,配合最新的Spark 2.0引擎,已能在手机浏览器流畅运行亿级粒子场景,生态持续完善。

-

核心原理:将场景表示为百万级3D高斯椭球(每个椭球包含位置、尺度、旋转、颜色、透明度等信息),通过可微分光栅化直接渲染,无需光线追踪,既能保证画质,又能提升渲染效率。与传统三角形面片建模不同,3DGS的"软边界"叠加方式,能呈现更真实的纹理细节和光影效果。

-

代表模型:3DGS(基础版本)、Mip-Splatting、Scaffold-GS、4D-GS(动态场景扩展版),搭配Spark 2.0渲染引擎,可实现跨设备流畅运行。

-

实时性:静态场景重建需5--30分钟(单卡RTX 3090);流式重建(如SLAM3R)可达20--25 FPS,实现准实时建图;渲染速度方面,桌面端可达80--150 FPS,移动端/浏览器可达30--60 FPS,配合Spark 2.0的LoD细节层级、流式加载等技术,可在手机上流畅渲染亿级粒子场景。

-

优缺点:重建快、渲染实时、画质接近NeRF,支持场景编辑和Web/AR加载,适配多设备;缺点是高密度场景显存占用高,动态场景需依赖4D-GS扩展,文件体积较大(需通过Spark 2.0的.RAD格式压缩优化)。

-

适用场景:室内外静态场景、元宇宙场景、VR/AR漫游、数字孪生、动态场景(搭配4D-GS),是当前综合性价比最高的方案。

-

4. 单目/单图3D重建:极致便捷的"极速方案"

依托AI深度估计技术,实现"单图秒级出3D",门槛极低,是普通用户和快速原型制作的首选,2026年随着苹果LiTo、World Labs Marble等模型的推出,精度和效果进一步提升。

-

核心原理:通过深度估计网络(如MiDaS、DPT)提取单张RGB图像的深度信息,结合NeRF或3DGS先验模型,快速生成3D场景或模型,无需多视角拍摄。其中苹果LiTo模型可通过单张图像生成具备物理一致光影效果的3D对象,World Labs Marble可将单张图片生成可探索的3D场景。

-

代表模型:MiDaS、DPT、LiTo(苹果)、One2345、Instant-NGP单图微调,均支持快速推理。

-

实时性:推理仅需1--10秒/图,快速生成3D原型;渲染速度可达30--60 FPS(网格渲染),适合快速预览。

-

优缺点:极致便捷、无设备依赖,秒级出结果,适合非专业用户;缺点是精度较低(厘米级),视角受限,细节缺失,无法满足高精度需求。

-

适用场景:移动端快速预览、低成本3D原型制作、游戏关卡快速迭代、沉浸式培训内容搭建等对精度要求不高的场景。

-

三、四大途径实时性对比(2026年,基于RTX 3090显卡)

为了更清晰地对比四大技术路线的实时性差异,结合2026年最新硬件配置,整理核心指标对比表,方便快速选型:

|---------------------|----------------------------|------------------------|------------------------|---------------------|

| 技术路线 | 重建速度 | 渲染FPS(1080p) | 设备要求 | 核心适用场景 |

| 传统SfM/MVS | 小时级(离线) | <5(离线) | 多视角图像、普通电脑 | 静态大场景、测绘、工业测量 |

| NeRF(Instant-NGP) | 5--15分钟(离线) | 60--100 | 单目/RGBD相机、中高端显卡 | 静态物体、小场景、VR写实渲染 |

| 3DGS(主流) | 5--30分钟(离线)/20--25 FPS(流式) | 80--150(桌面)/30--60(移动) | 单目/RGBD/LiDAR、中低端显卡/手机 | 静态/动态场景、元宇宙、AR、数字孪生 |

| 单目AI快速重建 | 1--10秒/图(极速离线) | 30--60(网格) | 单目RGB手机/相机 | 快速预览、移动端、低成本原型 |

| 流式SLAM3R/LongStream | 20--25 FPS(边扫边建) | 20--30 | 单目RGB/深度相机 | 实时漫游、机器人导航、AR实景 |

四、2026年AI 3D扫描选型决策树

结合设备条件、实时性要求、场景类型、精度需求四大核心维度,整理极简选型决策树,无需专业知识,即可快速匹配最优方案,同时结合2026年最新技术进展(如Spark 2.0、语音驱动生成等),补充最新选型建议:

第一层:判断核心需求------是否需要"边扫描、边实时重建"

分支A:需要实时同步建图(边走边扫、AR实景、机器人漫游、现场实时预览)

-

有硬件(手机LiDAR / RGBD深度相机 / 工业激光雷达):

-

首选:AI稠密RGBD-SLAM(如Real-time SLAM3R、Niantic AR),实时性20~30FPS,精度2~5cm(消费级),支持空间定位,适配AR实景和机器人导航。

-

备选:轻量化流式3DGS增量重建,实时性15~25FPS,中端显卡即可,配合Spark 2.0引擎可实现跨设备流畅运行。

无深度硬件,只有普通单目手机摄像头:

-

首选:单目AI深度估计+实时网格重建,实时性15~30FPS,便捷性高;也可尝试港大研发的语音驱动实时生成技术,仅凭语音指令即可生成3D场景,无需专业操作。

-

短板:无绝对尺度、弱纹理区域容易变形,适合简单实时预览。

分支B:不需要实时,允许"拍完再重建"(室内房间、外景空间、物体复刻、数字孪生素材)

进入第二层:区分"场景形态"

第二层:区分场景:静态大空间 / 静态小物体 / 动态人物/物件

1. 静态大场景(全屋、园区、厂房、户外街道)

-

追求画质+自由视角漫游:首选3D高斯溅射(3DGS),搭配Spark 2.0引擎,可实现亿级粒子场景流畅渲染,重建耗时5~25分钟,渲染帧率桌面80~150FPS、移动端30~60FPS,支持Web/AR加载,适合数字孪生和VR漫游。

-

追求工程测量、高精度尺寸:首选传统SfM+MVS几何重建,重建耗时1~3小时(离线),精度0.5~5mm工业级,适合航空/建筑测绘、工业逆向。

-

追求极速出图、不要显卡:首选AI单图/多图快速网格,重建耗时10秒~3分钟,精度5~10cm,仅用于展示预览;也可使用智元牵头研发的MANSION框架,通过文本指令生成整栋建筑的3D场景,适合大型建筑场景快速生成。

2. 静态小物体(零件、摆件、文物、产品建模)

-

超高细节、光影写实:首选Instant-NGP极速NeRF,训练3~10分钟,渲染60FPS+,还原物体细腻纹理和光影。

-

轻量化、易编辑、可导出模型:首选小型3DGS,操作便捷,支持模型编辑和二次创作。

-

低成本快速建模:首选单目AI三维重建(One2345、LiTo等),单张图片即可生成3D模型,无需多视角拍摄,适合产品原型快速制作。

3. 动态场景(人走动、设备运动、动态工位)

-

首选:4D-GS动态高斯溅射,重建10~30分钟,动态渲染60FPS+,可完美还原动态场景的运动轨迹。

-

实时动态捕捉:首选多目RGBD实时融合重建,配合南大MorphAny3D技术,可实现跨类别物体平滑变形,适合动画制作和动态场景特效。

第三层:按硬件门槛 快速兜底选型

-

纯手机、无电脑、无LiDAR:单目AI深度重建 / 云端3DGS(上传照片云端计算),也可使用语音驱动生成技术,张嘴即可生成3D场景,无需专业设备。

-

手机带LiDAR(iPhone Pro/安卓旗舰):本地AR稠密SLAM + 后期3DGS优化(兼顾实时+画质),可直接使用手机完成高质量重建。

-

有独立游戏显卡(RTX3060/4060以上):全场景通吃,3DGS / Instant-NGP / 增量式实时重建均可,可搭配Spark 2.0引擎实现更高效率的渲染。

-

无显卡、办公本低配:传统几何离线重建、云端AI重建,放弃实时渲染,优先保证重建精度。

五、核心方案关键指标总览

|------------------|------|---------|--------|---------|----------------|

| 技术方案 | 重建模式 | 重建耗时 | 渲染FPS | 精度 | 核心适用场景 |

| 实时RGBD-SLAM | 边扫边建 | 毫秒级增量 | 20~30 | 2~5cm | AR空间、机器人、现场踏勘 |

| 流式增量3DGS | 准实时 | 秒级迭代 | 15~25 | 1~3cm | 展厅/全屋实时数字孪生 |

| 标准3DGS | 离线后置 | 5~25分钟 | 80~150 | 1~3cm | 室内外场景、元宇宙、VR漫游 |

| Instant-NGP NeRF | 离线后置 | 3~10分钟 | 60~100 | 亚厘米级 | 小件物体、特写写实渲染 |

| SfM/MVS几何重建 | 全离线 | 1~3小时 | <5 | 0.5~5mm | 工业测量、测绘、逆向工程 |

| 单目AI快速重建 | 极速离线 | 10秒~3分钟 | 30~60 | 5~10cm | 快速演示、低成本初稿 |

六、2026年技术趋势与落地建议

当前AI 3D扫描技术正处于高速迭代期,结合2026年最新行业动态(如巨头入场、资本抢滩、开源生态完善),未来趋势和落地建议如下:

1. 技术趋势

-

3DGS持续领跑:随着Spark 2.0等引擎的优化,3DGS将进一步降低显存占用、提升动态场景处理能力,成为消费级和专业级场景的"通用方案",开源生态将持续完善。

-

多模态交互普及:语音驱动、文本驱动的3D生成技术将逐步成熟,用户无需专业操作,仅凭口述或文字指令即可生成3D场景,进一步降低创作门槛。

-

设备门槛持续降低:手机、平板等消费级设备的重建精度将进一步提升,配合云端算力,实现"无显卡也能做高质量3D重建",全民3D创作时代即将到来。

-

商业化加速:阿里、腾讯、苹果等巨头持续布局,3D生成技术将广泛应用于游戏开发、影视制作、电子商务、具身智能等领域,市场规模持续增长。

2. 落地建议

-

要边走边看、实时AR → 带深度传感器+RGBD-SLAM,或使用语音驱动实时生成技术。

-

要效果好、漫游流畅、做数字场景资产 → 3DGS(当前综合最优,搭配Spark 2.0引擎效果更佳)。

-

要测量尺寸、工业精度 → 传统SfM+激光重建,或专业LiDAR设备。

-

要最便宜、最快、随便拍几张 → 通用AI单目3D重建(LiTo、One2345等),或云端3DGS。

总结来说,2026年AI快速扫描3D场景技术已实现"精度、速度、便捷性"的三重突破,四大技术路线各有侧重,选型的核心是"匹配自身场景与硬件条件"。无论是专业开发者、企业用户,还是普通小白,都能找到适合自己的方案。随着技术的持续迭代,3D场景重建将彻底融入我们的工作和生活,成为元宇宙、AR/VR、数字孪生等领域的核心支撑技术。