感受野 (Receptive Field, RF) 是卷积神经网络 (CNN) 中最核心的概念之一。它决定了网络每一层能够"看到"输入图像的范围大小。简单来说,如果一个神经元的感受野较小,它只能捕捉到局部的细节(如边缘、纹理);如果感受野较大,它则能捕捉到更宏观的语义信息(如物体的轮廓、背景关系)。

感受野的生物学基础

感受野的概念最早并非源于计算机科学,而是生理学。

- Hubel & Wiesel 的贡献:1950-60 年代,两位科学家通过对猫视觉皮层细胞的研究,发现视觉系统中的神经元并非对整个视野都有反应,而是只对视网膜上特定区域的刺激产生兴奋。

- 层次化处理:生物视觉系统具有明显的层次结构。视网膜上的光敏细胞感知极小的点,而初级视觉皮层(V1)的神经元则响应特定方向的线条。随着信号向高级皮层传递,神经元的感受野逐渐增大,处理的信息也从简单的几何特征转向复杂的物体识别。

这种"局部感知、层级堆叠"的机制,直接启发了后来卷积神经网络的设计思路。

深度学习中的感受野定义

在 CNN 中,某一层输出特征图(Feature Map)上的一个像素点,在原始输入图像上所能映射到的区域大小,即为该像素点的感受野。

核心属性

- 大小 (Size):通常用 R * R 表示。

- 中心位置 (Center):感受野在输入图像上的几何中心。

- 步长 (Stride):相邻感受野之间的位移。

计算公式

计算感受野通常采用自底向上 (从输入层推导输出层)或自顶向下(从输出层反推输入层)的方法。

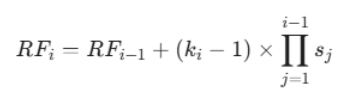

设 RFᵢ 为第 i 层的感受野,ki 为第 i 层的卷积核大小,si 为步长,则计算公式为:

当前层的感受野等于前一层的感受野,加上由当前卷积核扩展出的增量。这个增量会受到之前所有层累计步长的乘积影响。

影响感受野大小的关键因素

要增加网络捕捉大尺度特征的能力,通常有以下几种手段:

-

增加层数 (Depth):

通过堆叠多个小型卷积核(如 3 * 3)来代替一个大型卷积核(如 7 * 7)。这样做既能获得相同的感受野,又能减少参数量并增加非线性表达能力。

-

步长 (Stride) > 1:

步长越大,后续层感受野增长的速度越快,但代价是特征图分辨率的迅速下降。

-

池化层 (Pooling):

池化层本质上是通过下采样来扩大感受野。例如,2 * 2 的最大池化会将感受野扩大一倍。

-

扩张卷积 (Dilated Convolution):

这是在不增加参数量、不降低分辨率的前提下,盲目扩大感受野的"黑科技"。通过在卷积核元素间插入空洞(Dilation Rate),使其能覆盖更广的范围。

理论感受野 vs. 有效感受野 (Effective Receptive Field)

虽然我们可以通过公式算出"理论感受野",但研究发现,并非感受野内的所有像素贡献都是相等的。

- 高斯分布特性:由 N. Luo 等人在 2016 年提出,有效感受野(ERF)在中心区域的权重远大于边缘。其影响分布呈现出类似高斯分布的状态。

- 实际意义 :这意味着网络实际上更关注中心区域。随着网络加深,虽然理论感受野覆盖了整张图片,但有效感受野可能只占据一小部分。这对密集预测任务(如语义分割)提出了挑战,也是为什么我们需要引入 Attention 机制 或 非局部神经网络 (Non-local NN) 来增强全局依赖的原因。

感受野在不同任务中的角色

| 任务类型 | 感受野需求 | 原因 |

|---|---|---|

| 图像分类 | 极大(通常需覆盖全图) | 需要识别物体整体,忽略背景干扰。 |

| 目标检测 | 中等偏大 | 既要定位(局部细节),又要分类(全局信息)。 |

| 语义分割 | 大且密集 | 需要上下文信息(Context)来辅助判断像素类别。 |

| 超分辨率/去噪 | 较小 | 主要依赖局部纹理恢复,过大的感受野可能引入噪声。 |

总结与前瞻

感受野是连接空间几何与语义理解的桥梁。在设计深度学习模型时,感受野的设计直接决定了模型的"视野":

- 过小:会导致"盲人摸象",无法识别大物体。

- 过大:可能引入过多的背景噪声,弱化局部特征。

未来趋势 : 随着 Transformer 在计算机视觉领域的崛起,传统的卷积感受野正在演变为基于 自注意力机制 (Self-Attention) 的动态感受野。Transformer 理论上拥有"无限大"的全局感受野,这打破了物理感受野的层级限制,但也带来了巨大的计算开销。如何在局部细节的精准度 与全局上下文的广度之间找到平衡,依然是当前计算机视觉研究的核心命题。