AI 智能体问题排查指南:ChatGPT、API 调用到 Agent 上线失灵的全流程修复手册

结合 2026 年 4 月热点,拆出 5 类故障、6 个高频原因和 7 步可复现排查法,解决"会聊不会干、时快时慢、输出难看"

如果你现在遇到的情况是:ChatGPT 网页里回答挺顺,一进自动化流程就开始装糊涂;API 调用白天像高铁,晚高峰像挤地铁;多语言输出内容没错,但前端换行丑得像被猫踩过键盘------这篇文章就是给这种真实问题准备的。看完你应该拿到 3 个产出:一套问题分类法、一份高频原因清单、一条 7 步排查流程。本文不是聊哪个模型更神,而是帮你把"能聊不会干、时快时慢、输出乱"的问题定位出来。

工具资源导航

如果你看完这波热点,想顺手把方案跑起来或者把账号环境补齐,这两个入口可以先收藏:

文末资源导航属于工具信息整理,请结合平台规则和自身需求判断。

一、问题定义与适用范围

本文解决什么

- ChatGPT 或类似 AI 在对话里表现正常,但进入智能体、多步任务、工具调用后不稳定。

- API 调用延迟抖动、吞吐不稳、上下文一长就容易出怪问题。

- 多智能体协作场景中,角色分工、状态传递、执行结果对不上。

- 多语言文本输出本身没错,但网页或 HTML 展示时换行、分段、可读性异常。

- 团队准备上线 agent,却不知道该先测什么、怎么判断"能不能用"。

本文不解决什么

- 账号申诉、订阅支付、平台封禁这类账户问题。

- 各家模型供应商的未公开限流规则。

- 详细硬件采购方案和成本测算。

- 任何没有公开摘要支撑的"内部消息"。

二、热点拆解:为什么 2026 年的排查重点变了

1)评测正在从"会回答"转向"会完成"

- 事实描述:2026-04-26,MarkTechPost 讨论了大型语言模型中对 agentic reasoning 真正重要的 7 类 benchmark,并提出一个核心问题:当 AI agent 从研究 demo 走向生产部署,究竟该怎么判断它是否有效。

- 观点分析:这对开发者的提醒很直接:如果你还只拿单轮问答、主观观感、几条漂亮截图评估 agent,排查一开始就歪了。模型不是突然叛逆,而是你的考试卷还停留在背课文阶段。

2)智能体已经开始跟智能体打交道

- 事实描述:2026-04-25,TechCrunch 报道 Anthropic 做了一个实验性分类市场,让 AI agents 分别代表买家和卖家,并且达成真实交易。

- 观点分析:这说明很多故障不再是"模型答错一道题",而是"多主体协作失灵"。一旦进入买卖、协商、工具调用、状态同步,排查重点就会从 prompt 本身,扩展到流程编排、权限边界和状态一致性。

3)你以为是模型变慢,可能其实是服务层在喘气

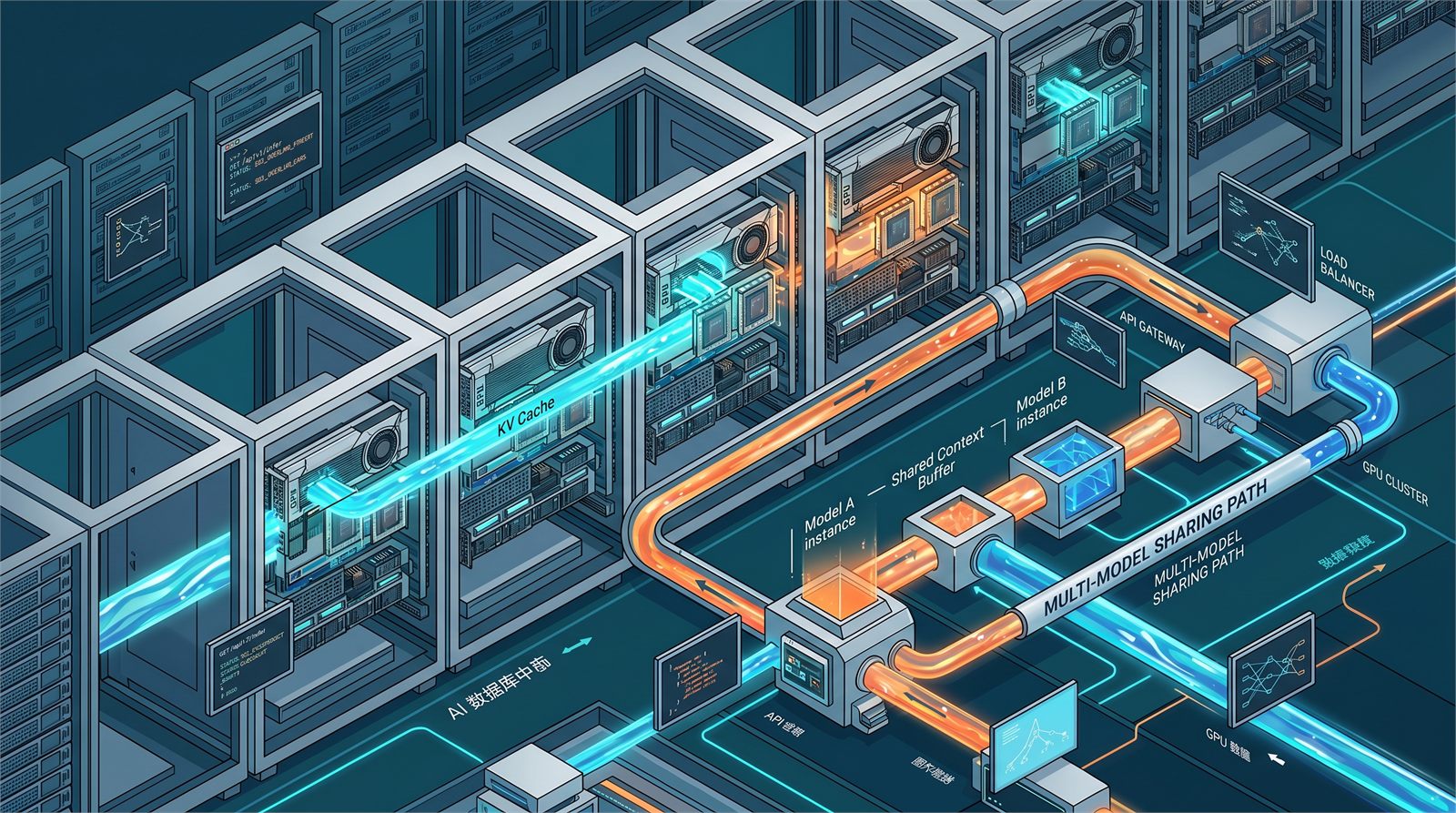

- 事实描述:2026-04-25,MarkTechPost 介绍了 kvcached:它是在 vLLM 之上的动态 KV-cache 实现,目标包括弹性 KV Cache 内存、应对突发型 LLM 服务,以及多模型 GPU 共享。

- 观点分析:很多"同样的请求今天快、明天慢"的问题,根子不在模型智商,而在推理服务资源调度。尤其是突发流量、长上下文、多模型混跑场景,KV cache 和显存策略很容易把响应体验搅成一锅粥。

4)输出看起来不专业,不一定是模型不会写

- 事实描述:2026-04-26,MarkTechPost 还介绍了 BudouX 在多语言文本换行上的做法,涉及解析、HTML 渲染、模型内省和 toy training。

- 观点分析:这类信息很重要,因为不少团队会把"页面展示难看"误判为"模型生成质量差"。事实上,原始文本可能没问题,真正翻车的是分词、换行和渲染层。

三、趋势判断:AI 很热,但真正难的是稳定交付

- 事实描述:2026-04-26,一则 Google News AI 摘要提到,AI 投资需求带动的半导体景气正在快速扩张;同日另一则摘要提到,旧金山作为"AI 之都",经济表现却并不亮眼。

- 观点分析:把这两条放在一起看,结论很朴素:投入很热,不等于产出自动发生。对开发者、技术运营和副业项目实践者来说,真正的壁垒不是"会不会接模型",而是"能不能稳定、可测、可复盘地交付结果"。

对从业者/开发者的启发

- 先补评测,再谈模型切换。

- 先做可观测性,再上多智能体。

- 先把展示链路测通,再批评模型文风。

四、先判断问题类型:别一上来就改 prompt

你可以先把故障归到下面 5 类之一:

- 评测失真型:离线演示很惊艳,上线后任务完成率不稳定。

- 执行链断裂型:模型能解释步骤,但真正调用工具、跨轮推进时断掉。

- 协作冲突型:多个 agent 或角色之间互相覆盖状态,像三个人同时改一份表格。

- 服务抖动型:延迟忽高忽低、长上下文报错增多、并发一上来就变慢。

- 展示后处理型:文本内容基本正确,但多语言换行、HTML 渲染、前端呈现效果很差。

先分型的好处是:你会更快知道该看日志、看评测、看服务层,还是看前端。否则很容易出现经典场面:后端查半天,最后发现是 CSS 在整活。

五、高频原因清单:按风险和出现概率排序

-

把聊天能力当成任务能力

单轮回答顺,不代表多步执行稳。

-

没有任务级成功标准

只说"效果不好",却没有完成率、正确率、重试率等明确指标。

-

工具调用和状态传递缺少校验

参数错、返回值缺字段、角色状态被覆盖,都会让 agent 看起来像"随机失忆"。

-

服务层资源策略不稳

突发流量、长上下文、多模型共享 GPU,都可能放大延迟与失败率。

-

一次性改太多变量

同时换模型、换 prompt、换工具、换缓存策略,最后谁是元凶根本说不清。

-

把渲染问题误当成生成问题

尤其是中日韩等非空格分词语言,排版链路没测透,效果会很别扭。

六、可执行排查流程:7 步把问题缩到最小

步骤 1:先固定一个最小失败样本

- 如何做:挑 3 到 5 条最稳定复现的失败请求,固定输入、工具配置、上下文长度和期望结果。

- 预期结果:你会得到一组"每次都能测"的样本,而不是靠记忆追 bug。

步骤 2:先分离模型问题,还是编排问题

- 如何做:同一条任务,分别走两遍:一遍直接调用模型;一遍走完整 agent 流程。

- 预期结果:如果直连模型正常、agent 流程异常,优先查工具调用、状态机、重试逻辑;如果两边都异常,再看模型输出与输入设计。

步骤 3:补上任务级评测,而不是只看"像不像"

- 如何做:给每类任务定义最小指标,例如完成率、步骤遗漏数、工具调用成功率、人工复核通过率。

- 预期结果:你能把"感觉变差了"转换成可量化变化,后续优化才有抓手。这里正好呼应 2026-04-26 关于 agentic reasoning benchmark 的讨论:任务型系统必须按任务测。

步骤 4:检查多智能体或工具链的状态一致性

- 如何做:把每一步日志最少记 5 项:输入、工具名、参数、返回结果、当前状态。多角色场景再加上角色身份和接棒时刻。

- 预期结果:能快速看出问题出在谁那里:是买家 agent 没发起请求,还是卖家 agent 回了但没被主流程接住。Anthropic 那类 agent-on-agent 场景,最怕的就是链路看起来热闹,实则没人真正完成交接。

步骤 5:排查服务层抖动,重点看上下文和突发流量

- 如何做:对固定请求连续压测,至少记录总延迟、首 token 时间、报错率,以及不同上下文长度下的差异。如果你在用类似 vLLM 的服务层,还要关注 KV cache 是否在高峰期被挤压,以及多模型混跑时是否互相影响。

- 预期结果:你会知道问题是"模型慢",还是"服务在忙着搬家"。2026-04-25 关于 kvcached 的信息,本质上就在提醒我们:缓存和显存策略会直接改变用户体感。

步骤 6:把原始输出和最终展示拆开看

- 如何做:同时保存原始文本、后端清洗结果、前端渲染结果,尤其测试中英日等多语言混排页面。

- 预期结果:如果原始文本正常、页面显示异常,就优先查换行、分段和 HTML 渲染,而不是继续折腾 prompt。BudouX 相关讨论给的启发很实用:排版本身就是一层独立工程问题。

步骤 7:做灰度回归,不要一次梭哈

- 如何做:每次只改一个变量,然后用前面的失败样本和评测集回归验证。

- 预期结果:你能明确知道是哪一个改动带来改善,避免"修好了一个 bug,顺手放出两个新 bug"。

七、不建议做法:这些坑非常常见

- 不建议只看通用榜单就直接上线:榜单好看,不等于你的业务链路就稳。

- 不建议把所有故障都怪到 prompt 上:prompt 很重要,但它不是万能背锅侠。

- 不建议同时改模型、框架和缓存策略:排查最怕"全家桶式优化"。

- 不建议忽略前端展示测试:模型写得再好,页面像车祸现场,用户只会记住车祸。

- 不建议在没有监控和日志的情况下上多 agent:那不是自动化,是自动失踪。

八、常见问题速查(FAQ)

Q1:ChatGPT 网页端能跑通,为什么 API 智能体总失败?

A:优先怀疑编排链路而不是模型本体。网页端通常是单轮或少量上下文交互,agent 流程则叠加了工具调用、状态管理和重试逻辑。

Q2:延迟忽高忽低,是不是只能加机器?

A:不一定。先看是不是突发流量、长上下文或多模型混跑造成的资源争用。服务层策略没理顺,盲目加机器很可能只是把问题放大得更贵。

Q3:多语言排版难看,说明模型不会写中文或日文吗?

A:不一定。先比对原始输出和最终渲染结果。很多时候,问题出在换行、分段和 HTML 展示层。

Q4:多智能体一定比单智能体强吗?

A:不能这么下结论。2026-04-25 的 Anthropic 实验说明多智能体场景已经有现实意义,但复杂度也同步上升。能用一个 agent 解决的事,别急着上三个。

Q5:最小可用的评测集怎么建?

A:先从 20 条高频真实任务开始,按成功、失败、边界样本各取一部分,保证每次改动都能回归验证。评测集不必大,关键是稳定复现。

九、结语:别迷信"更强模型",先拿回问题定位能力

2026 年这波热点其实给了我们同一个信号:AI 已经不只是"回答问题的模型",而是在往评测体系、多主体协作、推理服务优化和多语言产品化一路延伸。对开发者来说,真正值钱的不是追最新名词,而是建立一套能复现、能拆因、能回归的排查方法。

如果你今天就要动手,我建议按这个顺序开始:先做问题分型,再固定失败样本,接着补任务级评测,最后才去动模型和服务层配置。这样排查虽然不炫技,但很有效。毕竟线上故障最怕的不是复杂,而是你根本不知道它复杂在哪。