diffusion原理介绍

- 回顾 q base: 回归 与感知架构统一 但是无法多模, 打分 与感知架构统一 且有anchor词表 简化了学习 且多模

- 回顾 ar自回归 使用离散的 action tokenizer 逐步骤decode 但是按步骤来比较慢 用TopK采样多模态

- 本节 端到端 Diffusion 加噪音 天然多模态 并行解码

类比图片噪声处理 - 训练阶段

基于原始图像加高斯噪声

然后去除噪声还原 通过学习预测出需要去除的噪声 - 推理阶段

从完全随机噪声中 去除噪声 采样10-50步

diffusion policy

- o 观测 a动作 k步数

- 基于cnn

- 基于transformer

数学模型

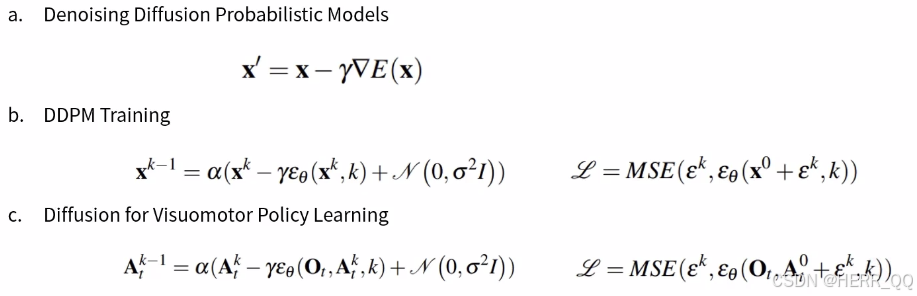

这张图展示的是 Diffusion Policy(扩散策略) 的数学建模过程,它是将图像生成领域的 DDPM(Denoising Diffusion Probabilistic Models)应用到机器人操控(Visuomotor Policy Learning)上。

为了让你彻底理解,我将分为 a、b、c 三个部分,逐个拆解每一个字母的含义。

a. Denoising Diffusion Probabilistic Models (去噪扩散概率模型)

这是最基础的扩散模型公式,对应 DDPM 的采样(推理)过程。

x′=x−γablaE(x) \mathbf{x}' = \mathbf{x} - \gamma abla E(\mathbf{x}) x′=x−γablaE(x)

- x\mathbf{x}x :当前时刻的数据(例如:一张带有噪声的图像,或者机器人的当前状态)。

- x′\mathbf{x}'x′ :去噪后的新数据(下一步的状态)。

- γ\gammaγ (gamma) :学习率 或步长(控制每次去噪的幅度,通常是一个很小的正数)。

-

abla E(\\mathbf{x}) :梯度 (Gradient)。

- EEE 通常代表能量函数(Energy Function),在这里可以理解为损失函数(Loss)。

- abla 表示求偏导。

- 合起来的意思是:计算当前数据 x\mathbf{x}x 的"误差梯度"。

- 整体含义 :沿着误差减小的方向(梯度反方向)走一小步 γ\gammaγ,数据就会变得更"干净"(去噪)。

b. DDPM Training (DDPM 训练)

这是标准的 DDPM 训练公式,用来教模型如何预测噪声。

xk−1=α(xk−γεθ(xk,k)+N(0,σ2I)) \mathbf{x}^{k-1} = \alpha (\mathbf{x}^k - \gamma \varepsilon_\theta(\mathbf{x}^k, k) + \mathcal{N}(0, \sigma^2 I)) xk−1=α(xk−γεθ(xk,k)+N(0,σ2I))

- xk−1\mathbf{x}^{k-1}xk−1 :前一步(更早时刻)的干净数据(Ground Truth)。

- xk\mathbf{x}^kxk :当前步(较晚时刻)的带噪数据(Input)。

- kkk :当前的时间步(Timestep) 。扩散模型是从 TTT(纯噪声)逐步走到 000(干净数据),kkk 表示现在处于第几步。

- α\alphaα :重缩放系数(Scaling factor)。因为减去噪声后数据的方差会变化,需要乘一个系数保持数据分布稳定。

- γ\gammaγ :噪声调度器参数(Noise schedule parameter),控制去噪的步长。

- εθ\varepsilon_\thetaεθ :模型预测的噪声 (Predicted Noise)。

- θ\thetaθ 代表模型的参数(权重)。

- 模型的目标就是学会预测输入数据里包含的噪声。

- N(0,σ2I)\mathcal{N}(0, \sigma^2 I)N(0,σ2I) :随机高斯噪声 。

- 这是扩散模型的精髓:在去噪过程中加入一点随机性,让模型不仅能生成单一的确定性结果,还能生成多样的结果。

- σ2\sigma^2σ2 是噪声的方差,III 是单位矩阵。

- 整体含义 :根据当前带噪数据 xk\mathbf{x}^kxk,模型预测出噪声 εθ\varepsilon_\thetaεθ,然后利用这个预测去推算出更干净的数据 xk−1\mathbf{x}^{k-1}xk−1。

右侧 Loss 公式 (b 部分)

L=MSE(εk,εθ(x0+εk,k)) \mathcal{L} = \text{MSE}(\varepsilon^k, \varepsilon_\theta(\mathbf{x}^0 + \varepsilon^k, k)) L=MSE(εk,εθ(x0+εk,k))

- L\mathcal{L}L :损失值(Loss),越小越好。

- MSE\text{MSE}MSE:均方误差(Mean Squared Error),计算两个向量之间差距的公式。

- εk\varepsilon^kεk :真实的噪声 (Ground Truth Noise)。我们在训练时人为给干净数据 x0\mathbf{x}^0x0 加上了噪声 εk\varepsilon^kεk,所以这个是已知的。

- x0\mathbf{x}^0x0 :原始的干净数据(Ground Truth)。

- εθ(... )\varepsilon_\theta(\dots)εθ(...) :模型预测的噪声。

- 整体含义 :把干净数据 x0\mathbf{x}^0x0 加上噪声 εk\varepsilon^kεk 喂给模型,让它预测噪声。然后比较它预测的噪声和真实噪声 εk\varepsilon^kεk 的差距,差距越小,说明模型预测越准。

c. Diffusion for Visuomotor Policy Learning (视觉运动策略学习)

这是将上面的通用 DDPM 应用到了机器人领域。符号变了,但逻辑完全一样。

Atk−1=α(Atk−γεθ(Ot,At0+εk,k)+N(0,σ2I)) \mathbf{A}_t^{k-1} = \alpha (\mathbf{A}t^k - \gamma \varepsilon\theta(\mathbf{O}_t, \mathbf{A}_t^0 + \varepsilon^k, k) + \mathcal{N}(0, \sigma^2 I)) Atk−1=α(Atk−γεθ(Ot,At0+εk,k)+N(0,σ2I))

- Atk−1\mathbf{A}_t^{k-1}Atk−1 :前一步的动作序列 (Action sequence at timestep ttt)。

- ttt 代表时间步(机器人执行动作的第几秒/第几帧)。

- kkk 代表去噪步骤。

- Atk\mathbf{A}_t^kAtk :当前的带噪动作序列。

- Ot\mathbf{O}_tOt :当前的观测(Observation) 。

- 这是机器人"看到"的东西,通常是摄像头拍下的**图像(Image)**或者机器人的关节状态。

- At0\mathbf{A}_t^0At0 :原始的干净动作序列(即我们希望机器人最终执行的完美轨迹)。

- 其他符号 (α,γ,εθ,k,N\alpha, \gamma, \varepsilon_\theta, k, \mathcal{N}α,γ,εθ,k,N)的含义与 b 部分完全一致。

右侧 Loss 公式 (c 部分)

L=MSE(εk,εθ(Ot,At0+εk,k)) \mathcal{L} = \text{MSE}(\varepsilon^k, \varepsilon_\theta(\mathbf{O}_t, \mathbf{A}_t^0 + \varepsilon^k, k)) L=MSE(εk,εθ(Ot,At0+εk,k))

- 含义与 b 部分一致:比较模型预测的噪声和真实添加的噪声。

总结对比

| 符号 | 在通用 DDPM (b) 中代表 | 在 Diffusion Policy © 中代表 |

|---|---|---|

| x\mathbf{x}x | 图像/像素数据 (Image) | 动作序列 (Action) A\mathbf{A}A |

| O\mathbf{O}O | (通常不显式出现) | 观测/图像 (Observation) |

| ε\varepsilonε | 图像噪声 (Noise) | 动作噪声 (Noise) |

| kkk | 去噪步数 (Diffusion Step) | 去噪步数 (Diffusion Step) |

| ttt | (通常不显式出现) | 时间戳/环境步 (Environment Step) |

| θ\thetaθ | 模型参数 | 模型参数 |

| L\mathcal{L}L | 图像去噪损失 | 策略学习损失 |

一句话人话总结 :

Diffusion Policy 就是在教机器人:给定你现在看到的画面(Ot\mathbf{O}_tOt),想象很多种可能的动作轨迹(加噪),然后通过不断"去噪"(减去预测噪声),找到那个最合适的动作序列(At0\mathbf{A}_t^0At0)。

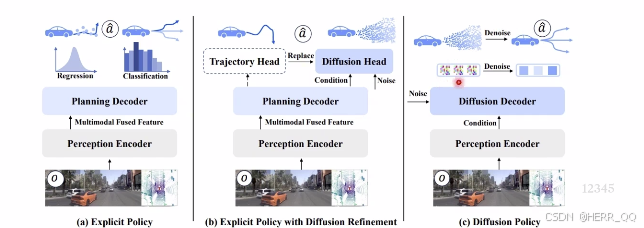

各种 diffusion planner 方法

diffE2E

最后干脆直接用噪声生成轨迹

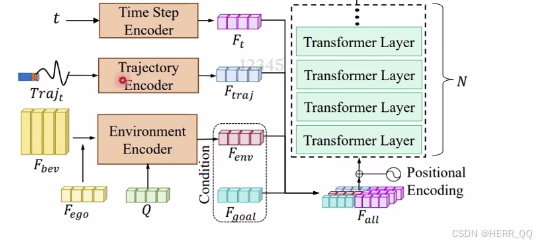

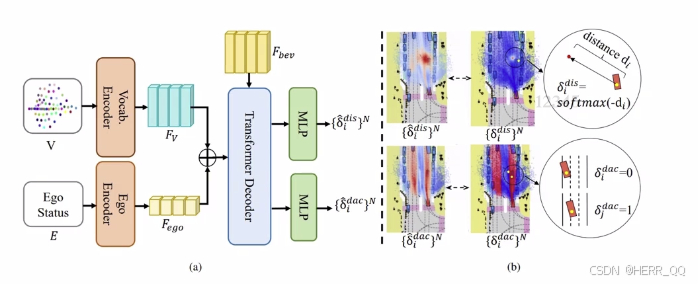

goalflow

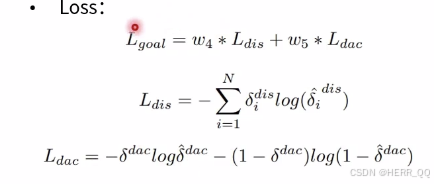

两个 关键模块

目标点词表

目标点打分

在可行驶区域内 和和目标距离

目标点 采样步长和 带噪声的action

loss 和 RL 打分的本质区别 和对于训练的意义

这是一个触及机器学习底层逻辑的极好问题。Loss 打分(监督学习)和 RL 打分(强化学习)的本质区别,在于它们回答的是两个完全不同的哲学问题。

一、核心区别:模仿 vs 博弈

| 维度 | Loss 打分(监督学习) | RL 打分(强化学习) |

|---|---|---|

| 哲学问题 | "你模仿得像不像?" | "你做得对不对?" |

| 参考标准 | Ground Truth(标准答案) | Environment(环境反馈) |

| 打分对象 | 预测值与真值的误差 | 动作带来的长期收益 |

| 数据依赖 | 依赖标注数据(离线) | 依赖交互经验(在线/仿真) |

| 优化目标 | 最小化误差(拟合数据) | 最大化累积奖励(赢得游戏) |

二、Loss 打分:像不像的"标尺"

1. 核心逻辑:对标答案

Loss 是**监督学习(Supervised Learning)**的产物。它的前提是:你必须先有一份"标准答案"(Ground Truth)。

- 自动驾驶场景 :人类司机开了一段路,记录下他的轨迹 At0\mathbf{A}_t^0At0。模型预测轨迹 A^t\hat{\mathbf{A}}_tA^t,Loss 就是计算这两者之间的差距(如 MSE、Huber Loss)。

2. 本质局限:无法超越人类

Loss 打分只能确保模型模仿人类。如果人类司机在某个场景下开得不好(比如总是急刹),模型学会了这个坏习惯,Loss 反而会很低(因为模仿得像),但这在现实中是危险的。

3. 典型公式(如你之前的扩散模型) :

L=MSE(εk,εθ(Ot,At0+εk,k)) \mathcal{L} = \text{MSE}(\varepsilon^k, \varepsilon_\theta(\mathbf{O}_t, \mathbf{A}_t^0 + \varepsilon^k, k)) L=MSE(εk,εθ(Ot,At0+εk,k))

这里,At0\mathbf{A}_t^0At0 就是"标准答案",打分完全围绕它展开。

三、RL 打分:好不好的"裁判"

1. 核心逻辑:环境反馈

RL 打分(Reward)不关心你是否模仿了人类,它只关心你的动作在环境中产生了什么后果。

- 自动驾驶场景 :模型做出一个动作(如加速),环境(仿真器)返回一个 Reward:

- 安全到达:+100

- 发生碰撞:-1000

- 偏离车道:-10

- 急刹(不舒适):-5

2. 核心优势:探索最优解

RL 模型可以通过试错,发现人类从未尝试过但更优的策略。例如,它可能学会在特定路口提前变道,虽然这和人类数据不同,但能避免拥堵,从而获得更高的累积奖励。

3. 典型公式(如 PPO 算法) :

J(θ)=E[∑t=0Tγtr(st,at)] J(\theta) = \mathbb{E} \left[ \sum_{t=0}^{T} \gamma^t r(s_t, a_t) \right] J(θ)=E[t=0∑Tγtr(st,at)]

这里没有 Ground Truth,只有环境给出的即时奖励 rrr。

四、自动驾驶中的具体应用差异

结合你之前看的 GoalFlow 架构图:

| 场景 | 使用 Loss 打分 | 使用 RL 打分 |

|---|---|---|

| 行为克隆 (BC) | ✅ 主要手段:计算预测轨迹与人类轨迹的误差。 | ❌ 不适用(无环境交互)。 |

| 轨迹预测 | ✅ 预测未来位置与真实位置的 MSE。 | ❌ 通常不用。 |

| 决策规划 (Planning) | ⚠️ 有限(只能模仿,无法处理新场景)。 | ✅ 核心手段:通过仿真器评估决策的安全性、效率。 |

| 端到端控制 | ✅ 拟合人类驾驶行为。 | ✅ 优化长期驾驶性能(如舒适度、能耗)。 |

GoalFlow 的混合策略 :

你图中的 GoalFlow 本质上还是 Loss 打分 (监督学习),因为它有"目标点"和"参考轨迹"作为 Ground Truth。但如果想让它更强大,可以在后期引入 RL 微调(Fine-tuning),用环境奖励来优化那些虽然模仿得像人类但实际不安全的动作。

五、总结:一张表看懂本质

| 特性 | Loss 打分 | RL 打分 |

|---|---|---|

| 目标 | 拟合已知数据 | 最大化未知收益 |

| 风险 | 可能学会人类的错误 | 可能探索出危险动作 |

| 数据 | 需要大量标注数据 | 需要大量仿真环境 |

| 稳定性 | 训练稳定,收敛快 | 训练不稳定,难调试 |

| 上限 | 人类水平上限 | 可能超越人类水平 |

一句话回答 :

Loss 是"老师"批改作业(对照答案改错),RL 是"裁判"裁决比赛(只看结果好坏)。 在高级自动驾驶中,通常是先通过 Loss 学会"像人一样开车"(监督学习),再通过 RL 学会"比人更安全地开车"(强化学习)。

Diffusion drive 待看

扩展问题

常见损失函数

在机器学习和深度学习中,MSE Loss (均方误差损失)和各类 Loss 函数的作用都是衡量模型预测值 与真实值之间的差异,从而指导模型优化。下面从你公式中的符号出发详细解释,并列举常见 Loss 分类。

一、什么是 MSE Loss?

MSE(Mean Squared Error,均方误差) 是最常用的回归损失函数之一,公式为:

MSE=1n∑i=1n(yi−y^i)2 \text{MSE} = \frac{1}{n} \sum_{i=1}^{n} (y_i - \hat{y}_i)^2 MSE=n1i=1∑n(yi−y^i)2

在你提供的公式中:

- εk\varepsilon^kεk 通常表示真实值(或目标值,如噪声、残差)

- εθ(⋅)\varepsilon_\theta(\cdot)εθ(⋅) 表示模型预测的值(神经网络输出)

- kkk 可能是时间步(diffusion model 中常见)或批次索引

直观理解:预测值与真实值差距越大,平方后会放大误差(大误差惩罚更重),然后求平均得到标量损失值。模型训练时会最小化这个误差。

特点:

- 对异常值(outliers)敏感(因为平方会放大误差)

- 输出值连续,适合回归任务(如房价预测、温度预测、扩散模型去噪)

常见 Loss 函数分类

根据任务类型,常见 Loss 可分为以下几类:

-

回归任务(Regression)

预测连续数值:

| Loss 名称 | 公式 | 特点 |

|---------|------|------|

| MSE | 1n∑(yi−y^i)2\frac{1}{n}\sum(y_i-\hat{y}_i)^2n1∑(yi−y^i)2 | 标准回归,对异常值敏感 |

| MAE (L1) | 1n∑∥yi−y^i∥\frac{1}{n}\sum\|y_i-\hat{y}_i\|n1∑∥yi−y^i∥ | 对异常值鲁棒,梯度恒定 |

| Huber Loss | {12(y−y^)2if ∥y−y^∥≤δδ(∥y−y^∥−12δ)otherwise\begin{cases} \frac{1}{2}(y-\hat{y})^2 & \text{if } \|y-\hat{y}\|\leq\delta \\ \delta(\|y-\hat{y}\|-\frac{1}{2}\delta) & \text{otherwise} \end{cases}{21(y−y^)2δ(∥y−y^∥−21δ)if ∥y−y^∥≤δotherwise | 结合 MSE 和 MAE,平滑且鲁棒 |

| Log-Cosh Loss | log(cosh(y^−y))\log(\cosh(\hat{y}-y))log(cosh(y^−y)) | 近似 MAE 但二阶可导,鲁棒性好 |

-

分类任务(Classification)

预测离散类别:

| Loss 名称 | 适用场景 | 公式核心 |

|---------|---------|---------|

| Cross-Entropy Loss (交叉熵) | 多分类(配合 Softmax) | −∑yilog(y^i)-\sum y_i \log(\hat{y}_i)−∑yilog(y^i) |

| Binary Cross-Entropy (BCE) | 二分类(配合 Sigmoid) | −[ylog(y^)+(1−y)log(1−y^)]-[y\log(\hat{y}) + (1-y)\log(1-\hat{y})]−[ylog(y^)+(1−y)log(1−y^)] |

| Focal Loss | 类别不平衡(如目标检测) | 在 CE 基础上降低易分类样本权重:α(1−p^t)γlog(p^t)\alpha(1-\hat{p}_t)^\gamma \log(\hat{p}_t)α(1−p^t)γlog(p^t) |

| Hinge Loss | SVM 支持向量机 | max(0,1−y⋅y^)\max(0, 1 - y \cdot \hat{y})max(0,1−y⋅y^) |

-

生成模型专用(Generative Models)

从你公式中的 εθ\varepsilon_\thetaεθ 和 Ot,At0\mathbf{O}_t, \mathbf{A}_t^0Ot,At0 来看,这很可能是**扩散模型(Diffusion Models)**或类似的概率生成模型的损失:

| Loss 名称 | 应用场景 | 说明 |

|---|---|---|

| Variational Lower Bound (ELBO) | VAE | 重构损失 + KL 散度 |

| DDPM Loss | 扩散模型(Denoising Diffusion Probabilistic Models) | 本质就是 MSE(ε,εθ)\text{MSE}(\varepsilon, \varepsilon_\theta)MSE(ε,εθ),和你公式一致 |

| LPIPS / Perceptual Loss | 图像生成 | 基于预训练 CNN 特征的距离,而非像素级 MSE |

| Adversarial Loss | GAN | 生成器与判别器的博弈损失 |

- 对比学习(Contrastive Learning)

用于自监督学习(如 SimCLR、MoCo):

- InfoNCE Loss: -\\log\\left(\\frac{\\exp(\\text{sim}(q,k_+)/\\tau)}{\\sum_{k'} \\exp(\\text{sim}(q,k')/\\tau)}\\right)

- 用于学习相似样本的表示接近,不相似的远离

- 其他特殊任务

- Triplet Loss:人脸识别,锚点-正样本-负样本的距离约束

- Center Loss:增强特征类内紧凑性

- IoU Loss / GIoU / DIoU:目标检测中边界框回归(替代 L1/L2)

- CTCLoss:语音识别、OCR 中的序列到序列对齐

三、针对你公式的推测

你给出的两个公式:

L=MSE(εk,εθ(x0+εk,k)) \mathcal{L} = \text{MSE}(\varepsilon^k, \varepsilon_\theta(\mathbf{x}^0 + \varepsilon^k, k)) L=MSE(εk,εθ(x0+εk,k))

L=MSE(εk,εθ(Ot,At0+εk)) \mathcal{L} = \text{MSE}(\varepsilon^k, \varepsilon_\theta(\mathbf{O}_t, \mathbf{A}_t^0 + \varepsilon^k)) L=MSE(εk,εθ(Ot,At0+εk))

这非常符合**扩散模型(Diffusion Models)**的训练范式:

- x0\mathbf{x}^0x0:原始干净数据

- εk\varepsilon^kεk:在第 kkk 步加入的噪声

- εθ\varepsilon_\thetaεθ:噪声预测网络(U-Net 等)

- 模型输入通常是 x0+εk\mathbf{x}^0 + \varepsilon^kx0+εk(加噪后的数据),输出预测噪声

- 训练目标就是让预测的噪声与真实噪声的 MSE 最小

如果是强化学习,Ot\mathbf{O}_tOt 可能是观测(Observation),At0\mathbf{A}_t^0At0 是动作,但这更可能是扩散模型或某种残差学习。

四、选择建议

- 回归任务 :首选 MSE (数据干净)或 MAE/Huber(有异常值)

- 分类任务 :首选 Cross-Entropy (标准)或 Focal Loss(类别不平衡)

- 图像生成 :MSE (像素级)、LPIPS (感知级)、GAN Loss(对抗级)

- 扩散模型 :直接用 MSE(这是 DDPM 的核心发现:MSE 足以生成高质量图像)

常见激活函数和损失函数 以及使用领域

一、核心区别:损失函数 vs. 激活函数

| 维度 | 损失函数 (Loss Function) | 激活函数 (Activation Function) |

|---|---|---|

| 职责 | 衡量差距 :计算模型预测值 y^\hat{y}y^ 与真实标签 yyy 之间的误差。 | 引入非线性:对神经元的加权和进行变换,决定是否"激活"并输出。 |

| 输入 | 预测值 y^\hat{y}y^ 和 真实值 yyy | 神经元的线性加权和 z=wTx+bz = w^Tx + bz=wTx+b |

| 输出 | 标量(一个数),代表模型的好坏。 | 向量/张量,作为下一层的输入。 |

| 位置 | 网络的最后一层(计算最终误差)。 | 网络的隐藏层或输出层(处理中间信号)。 |

| 目的 | 为反向传播提供梯度,指导模型如何修正权重。 | 赋予网络非线性拟合能力,解决线性不可分问题。 |

简单比喻:

- 激活函数 是神经元的"开关"或"滤波器",决定信号是否传递。

- 损失函数 是教练的"评分标准",告诉模型它错得有多离谱。

二、常用损失函数详解(优缺点与应用)

- 回归任务(预测连续值)

| 损失函数 | 公式(简化) | 优点 | 缺点 | 应用领域 |

|---|---|---|---|---|

| MSE (均方误差) | 1n∑(y−y^)2\frac{1}{n}\sum(y-\hat{y})^2n1∑(y−y^)2 | 1. 曲线光滑,梯度计算稳定 ,易于优化。 2. 对大误差惩罚更重,收敛快。 | 1. 对异常值(Outliers)极度敏感 。 2. 在某些任务(如生成)中可能过于平滑。 | 房价预测、温度预测、扩散模型(Diffusion)、信号处理 |

| MAE (L1 Loss) | 1n∑∣y−y^∣\frac{1}{n}\sum|y-\hat{y}|n1∑∣y−y^∣ | 1. 对异常值鲁棒 (线性惩罚)。 2. 梯度大小恒定,不易梯度爆炸。 | 1. 在极小误差处梯度不光滑 (0点不可导),收敛慢。 2. 训练后期可能震荡。 | 金融预测(数据噪声大)、图像重建(要求边缘清晰) |

| Huber Loss | 结合 MSE 和 MAE | 1. 兼顾鲁棒性与收敛性 。 2. 在误差较小时使用 MSE(光滑),较大时使用 MAE(鲁棒)。 | 1. 需要手动设定超参数 δ\deltaδ(切换阈值)。 | 自动驾驶(感知回归)、鲁棒回归任务 |

- 分类任务(预测离散标签)

| 损失函数 | 公式(简化) | 优点 | 缺点 | 应用领域 |

|---|---|---|---|---|

| Cross-Entropy (交叉熵) | −∑ylog(y^)-\sum y \log(\hat{y})−∑ylog(y^) | 1. 梯度陡峭 (错误越大,梯度越大),收敛极快。 2. 完美配合 Softmax,概率解释性强。 | 1. 对类别不平衡 数据敏感。 2. 可能出现数值不稳定(需配合 LogSoftmax)。 | 绝大多数分类任务(图像分类、NLP分类) |

| Focal Loss | (1−p^t)γCE(1-\hat{p}_t)^\gamma \text{CE}(1−p^t)γCE | 1. 解决类别不平衡 ,自动降低"简单样本"的权重。 2. 提升难样本的学习效率。 | 1. 引入超参数 γ\gammaγ,调参更复杂。 | 目标检测(RetinaNet)、医学影像(病灶少) |

| BCE (二分类交叉熵) | −[ylog(y^)+(1−y)log(1−y^)]-[y\log(\hat{y}) + (1-y)\log(1-\hat{y})]−[ylog(y^)+(1−y)log(1−y^)] | 1. 二分类任务的标准选择,理论完备。 | 1. 仅适用于二分类。 | 垃圾邮件检测、点击率预估(CTR) |

- 生成与对抗任务

| 损失函数 | 核心思想 | 应用领域 |

|---|---|---|

| GAN Loss | 生成器与判别器对抗博弈(Minimax)。 | GAN 系列模型(StyleGAN, BigGAN) |

| Perceptual Loss | 在特征空间(VGG等)计算距离,而非像素空间。 | 超分辨率、风格迁移(追求视觉质量) |

三、常用激活函数详解(优缺点与应用)

| 激活函数 | 公式 | 优点 | 缺点 | 应用领域 |

|---|---|---|---|---|

| ReLU (整流线性单元) | max(0,x)\max(0, x)max(0,x) | 1. 计算极其简单 ,解决梯度消失(正区间)。 2. 稀疏激活(约50%神经元为0),效率高。 | 1. Dead ReLU问题 :负半区梯度为0,神经元可能永久死亡。 2. 输出非零中心。 | 绝大多数 CNN / MLP 的隐藏层(默认选择) |

| Leaky ReLU | max(0.01x,x)\max(0.01x, x)max(0.01x,x) | 1. 解决 Dead ReLU 问题,负半区有微小梯度。 2. 保持 ReLU 的优点。 | 1. 需要设定超参数 α\alphaα(斜率)。 | 替代 ReLU,尤其在 GAN 中常用 |

| Sigmoid | 11+e−x\frac{1}{1+e^{-x}}1+e−x1 | 1. 输出范围 (0,1)(0,1)(0,1),适合表示概率 。 2. 函数光滑。 | 1. 梯度消失严重 (饱和区梯度接近0)。 2. 输出非零中心,收敛慢。 | 二分类输出层(配合 BCE Loss) |

| Tanh | ex−e−xex+e−x\frac{e^x - e^{-x}}{e^x + e^{-x}}ex+e−xex−e−x | 1. 输出范围 (−1,1)(-1,1)(−1,1),零中心,收敛快于 Sigmoid。 | 1. 依然存在梯度消失问题。 | RNN / LSTM 的隐藏层 |

| Softmax | exi∑exj\frac{e^{x_i}}{\sum e^{x_j}}∑exjexi | 1. 将输出归一化为概率分布(总和为1)。 | 1. 数值不稳定(需做数值优化)。 | 多分类输出层(配合 Cross-Entropy Loss) |

| Swish | x⋅sigmoid(x)x \cdot \text{sigmoid}(x)x⋅sigmoid(x) | 1. 谷歌提出,平滑且无死区,效果常优于 ReLU。 | 1. 计算量稍大(涉及 Sigmoid)。 | 替代 ReLU 的现代选择(尤其在大模型中) |

四、总结与搭配建议

- 回归任务 :

- Loss :首选 MSE (数据干净)或 Huber(有异常值)。

- 最后一层激活 :通常无激活 (线性输出)或 Sigmoid/Tanh(需归一化到特定区间)。

- 分类任务 :

- Loss :首选 Cross-Entropy (多分类)或 BCE(二分类)。

- 最后一层激活 :Softmax (多分类)或 Sigmoid(二分类)。

- 生成任务(如你提到的扩散模型) :

- Loss :MSE (预测噪声)或 Perceptual Loss(追求视觉质量)。

- 激活 :隐藏层常用 ReLU / Leaky ReLU ,输出层通常无激活(预测残差)。

如何选用搭配

这是一个非常经典的"直觉陷阱"。虽然你的想法在输出层 (最后一层)是完全正确的,但如果全网络所有层 都使用 Softmax,或者不加区分地套用 MSE/Cross-Entropy,会导致模型根本无法训练或性能极差。

下面直接拆解你的两个假设,并给出标准答案。

一、激活函数:为什么"全用 Softmax"是灾难性的?

核心结论 :Softmax 只能用在多分类任务的最后一层,绝对不能用在隐藏层或回归任务中。

- Softmax 的致命缺陷(在隐藏层)

如果你在隐藏层(中间层)使用 Softmax,会引发两个毁灭性问题:

- 梯度消失:Softmax 的输出总和恒为 1。如果网络有多层,每一层都进行"归一化挤压",梯度在反向传播时会迅速衰减到几乎为 0,权重根本无法更新。

- 破坏特征空间 :Softmax 强制所有神经元的输出相互竞争。在中间层,我们并不需要"只有一个神经元激活",而是希望它们能独立地表达不同的特征(比如一个神经元看纹理,一个看颜色)。Softmax 会抹杀这种独立性。

- 回归任务不能用 Softmax

- 输出范围错误 :回归任务(如预测房价、温度)的输出是任意实数(−∞,+∞-\infty, +\infty−∞,+∞),而 Softmax 输出被限制在 (0,1) 且和为 1,这完全不符合物理意义。

✅ 激活函数正确搭配表

| 任务类型 | 最后一层激活函数 | 隐藏层激活函数(推荐) |

|---|---|---|

| 二分类 | Sigmoid(输出概率) | ReLU / Leaky ReLU / GELU |

| 多分类 | Softmax(输出概率分布) | ReLU / Leaky ReLU / GELU |

| 回归 | None(线性层) / Tanh(如需归一化) | ReLU / Leaky ReLU / GELU |

| 生成模型(如你之前的扩散模型) | None(线性层)(预测残差/噪声) | ReLU / SiLU(Swish) |

关键 :隐藏层的唯一作用是引入非线性,让网络能够拟合复杂函数。ReLU 及其变种(Leaky ReLU, GELU)是目前最主流、最高效的选择。

二、损失函数:为什么不能"一刀切"?

核心结论:MSE 和 Cross-Entropy 有严格的数学适用场景,选错会导致优化目标错误。

- 回归任务:MSE 不是万能的

- MSE(均方误差) :假设噪声服从高斯分布 。如果你的数据中有异常值(Outliers),MSE 会给予巨大的惩罚,导致模型为了拟合少数异常点而牺牲整体性能。

- 什么时候不用 MSE:数据噪声大、有异常值、任务更关心误差的绝对值而非平方(如金融风控)。

- 替代方案 :MAE(L1 Loss) 或 Huber Loss(结合了 MSE 和 MAE 的优点)。

- 分类任务:Cross-Entropy 是黄金标准,但有例外

- Cross-Entropy(交叉熵) :确实是分类任务的默认首选。它直接衡量概率分布的差异,梯度性质好,收敛快。

- 什么时候不用 Cross-Entropy :

- 类别极度不平衡 (如 99% 是负样本,1% 是正样本):需使用 Focal Loss 来降低"简单样本"的权重。

- 二分类 :使用 Binary Cross-Entropy (BCE),而不是多分类的 Cross-Entropy。

✅ 损失函数正确搭配表

| 任务类型 | 推荐损失函数 | 备注 |

|---|---|---|

| 回归(标准) | MSE | 数据干净,无异常值 |

| 回归(鲁棒) | MAE / Huber | 数据有噪声或异常值 |

| 二分类 | Binary Cross-Entropy (BCE) | 配合 Sigmoid 输出 |

| 多分类 | Cross-Entropy | 配合 Softmax 输出 |

| 目标检测/类别不平衡 | Focal Loss | 基于 Cross-Entropy 改进 |

| 扩散模型(Denoising) | MSE | 预测噪声(高斯假设成立) |

三、针对你之前公式的特别说明

你之前提到的扩散模型公式:

L=MSE(εk,εθ(x0+εk,k))\mathcal{L} = \text{MSE}(\varepsilon^k, \varepsilon_\theta(\mathbf{x}^0 + \varepsilon^k, k))L=MSE(εk,εθ(x0+εk,k))

- 激活函数 :εθ\varepsilon_\thetaεθ 这个网络的最后一层必须是线性层(无激活) ,因为它预测的是噪声 ε\varepsilonε,噪声值可以是任意实数(正负皆可)。如果用了 Softmax 或 Sigmoid,就彻底错了。

- 损失函数 :使用 MSE 是完全正确的,因为扩散模型假设添加的噪声是高斯噪声,MSE 在此假设下是最优的。

总结:记住这两条"黄金法则"

- 激活函数 :

- 最后一层:看输出需求(概率用 Softmax/Sigmoid,实数用线性)。

- 隐藏层 :一律使用 ReLU 或其变种(如 GELU),绝对不要用 Softmax。

- 损失函数 :

- 分类:默认用 Cross-Entropy。

- 回归:默认用 MSE,有异常值换 MAE/Huber。

一句话:Softmax 是"概率裁判",不是"特征工人";MSE 是"高斯信徒",不是"万能钥匙"。

问题 rl的打分可能导致之前拟合已知数据坏掉吗 此外 拟合的时候岂不是要把所有情况都找模仿的驾驶员开一遍 怎么可能所有场景 情况都能覆盖呢

这两个问题直击自动驾驶从"模仿学习"走向"强化学习"的核心痛点。你的直觉非常敏锐:RL 确实会破坏原有的拟合,且数据覆盖确实是死穴。这正是为什么工业界不直接上 RL,而是采用"分阶段"策略的原因。

一、RL 微调会"破坏"之前的拟合吗?

答案是:会,但这通常是"有意为之"的修正。

当你用 RL 去优化一个已经用监督学习(Loss)预训练好的模型时,这个过程叫做 RLHF(人类反馈强化学习) 或 Fine-tuning。RL 的目标是最大化奖励,而不是保持与原始数据的相似度。

会发生什么?

- "忘本"现象(Catastrophic Forgetting) :模型为了获得更高的环境奖励(比如避免碰撞),可能会偏离它从人类数据中学到的"标准开法"。例如,人类数据里变道比较保守,RL 发现激进一点反而更安全,它就会改掉原来的习惯。

- 这是好是坏?

- 好的方面 :如果人类数据有缺陷(比如人类司机经常压线),RL 修正它是进步。

- 坏的方面:如果 RL 的奖励函数设计有漏洞,它可能会学到"怪异"但高分的行为(比如为了不撞车而突然停车,导致舒适度极差)。

结论 :RL 必然会改变原有拟合,关键在于奖励函数的设计 。如果奖励函数平衡得好(兼顾安全、舒适、且包含"像人类"的约束),那么这种破坏就是良性的优化。

二、模仿学习真的需要"开遍所有场景"吗?

答案是:不需要,也不可能。 你的质疑完全正确,单纯靠"模仿"无法覆盖长尾场景(Corner Cases)。这就是为什么纯模仿学习(Behavior Cloning)在现实中会失效。

1. 模仿学习的"分布外(OOD)"陷阱

- 假设你只有 100 万公里的人类驾驶数据。

- 如果遇到一个从未见过的场景(比如路中间有个球滚过来),模型会怎么反应?

- 它会从"最相似"的记忆里找一个动作输出,但这个动作很可能是错误的(比如人类司机会减速,但模型可能直接绕行导致撞球)。

2. 解决方案:从"模仿"走向"理解"

自动驾驶系统不是靠"背答案"来开车的,而是靠分层架构:

| 层级 | 任务 | 是否依赖"见过所有情况"? |

|---|---|---|

| 感知层 | 检测车辆、车道、交通灯 | 否。靠泛化能力,只要物体在训练集中出现过,即使在新环境也能识别。 |

| 预测层 | 预测其他交通参与者行为 | 否。靠物理常识模型(如"车不会突然穿墙"),而非单纯模仿。 |

| 规划层 | 做出最终决策(走/停/绕) | 否 。这是 RL 和规则引擎的战场,利用奖励函数 和安全规则来应对新场景。 |

3. 数据的作用是"筑基",而非"覆盖"

- 模仿学习(Loss 打分) 的作用是让模型快速达到"及格线"(像人类一样平稳驾驶),避免 RL 从零开始瞎探索(那样太危险且低效)。

- 强化学习(RL 打分) 的作用是在仿真器中主动制造"没见过"的场景 (如暴雨、极端加塞),教模型如何在这些边缘情况下生存。

三、工业界的标准答案:混合策略

为了解决你提到的两个问题(避免破坏拟合 + 覆盖长尾),主流方案如下:

-

阶段一:模仿学习(预训练)

- 使用海量人类数据,用 Loss 打分训练模型。

- 目标:让模型学会"人类的基本驾驶常识",达到安全上路的基线。

-

阶段二:强化学习(微调)

- 在仿真环境 中,专门生成那些人类数据中极少出现的危险场景(如小孩追球、前车失控)。

- 目标 :用 RL 奖励(如"避免碰撞 +1")来针对性地优化模型在这些极端情况下的表现。

- 关键技巧 :在 RL 的奖励函数中加入**"行为克隆损失(BC Loss)"作为惩罚项。这样模型在优化 RL 奖励的同时,会被强制要求不要偏离人类行为太远**,从而避免"忘本"太严重。

总结

- RL 会破坏拟合吗? 会,但这是为了修正错误 和提升鲁棒性。只要在奖励函数中加入"模仿约束",就能控制破坏的程度。

- 需要覆盖所有场景吗? 绝对不需要 。靠数据覆盖是不现实的。正确的做法是:

- 模仿学习 负责常见场景(让车像人一样开)。

- 强化学习 负责长尾场景(让车在危险中活下来)。

- 规则系统 负责兜底(如"无论如何不能撞人")。

一句话:Loss 打分是"教科书",RL 打分是"实战演习"。你不能只学教科书,也不能没有教科书直接上战场。

附加问题的回答

你的理解完全正确。自动驾驶学习人类驾驶,本质上不是"背题库",而是通过数据去反推"人类为什么这么开",从而抽象出一套通用的驾驶行为模型。 这就是为什么它能在没见过的场景下依然安全行驶。

一、从"死记硬背"到"举一反三"的进化

我们可以把模型的学习过程类比成学开车的新手 vs 老司机:

| 学习模式 | 新手(纯模仿/死记) | 老司机(抽象理解/举一反三) |

|---|---|---|

| 应对方式 | "我在驾校练过这个路口,所以我会开。" | "虽然没来过这,但我懂路权 和安全距离。" |

| 遇到新场景 | 慌乱,不知所措(OOD问题) | 基于经验法则进行推理 |

| 对应技术 | 过拟合的 Behavior Cloning | 泛化良好的 Latent Policy |

核心转变 :模型不再学习 图像像素 -> 方向盘角度 的简单映射,而是学习 场景语义 -> 驾驶原则 的抽象推理。

二、模型到底学到了什么"本质"?

在训练中,模型并不是在存储每一帧图像,而是在海量的"情况-动作"对 中,通过 Loss(如 MSE)的反向传播 ,自动总结出了人类驾驶的底层物理规律和社会规则:

-

物理常识(Physics Prior)

- 学到的本质:"速度越快,刹车距离越长"、"转弯时离心力存在"。

- 举一反三:即使从没见过某种弯道,模型也能根据速度和曲率,计算出安全的通过速度,而不是盲目模仿人类在特定弯道的数据。

-

交互博弈(Social Reasoning)

- 学到的本质:"他打灯了,说明他要切进来,我应该让一下"、"路口视线受阻,要减速备刹"。

- 举一反三:即使面对全新的交叉路口布局,模型也能识别出"冲突点"并采取防御性驾驶策略。

-

规则与舒适(Rule & Comfort)

- 学到的本质:"尽量居中行驶"、"变道要平滑"、"红灯必须停"。

- 举一反三:这些是硬约束,在任何新场景下都会被优先满足。

这就是你提到的"内在驾驶行为本质" ------一套由数据驱动的、关于安全、效率和规则的隐式决策系统。

三、技术上是如何实现的?

你之前看到的 Diffusion Policy 或 GoalFlow 架构,正是为了促进这种"抽象理解"而设计的:

-

中间表示(Intermediate Representation)

- 模型并不是直接把摄像头像素变成动作,而是先变成 Goal Points(目标点) 、Occupancy(占据栅格) 或 Latent Vector(隐向量)。

- 作用 :这些中间层强迫模型丢弃无关的视觉细节 (如树的颜色),只保留对决策有用的几何和语义信息。这一步是"抽象化"的关键。

-

损失函数(Loss)作为"抽象导师"

- 当你使用 MSE Loss 让模型预测人类轨迹时,你并不是在说"照抄这个坐标",而是在说:"在这个场景下,人类选择的轨迹在物理和规则上是最优的,你去学习这个'最优性'"。

- 模型在最小化 Loss 的过程中,被迫去内化 (Internalize)人类做决策时所依据的代价函数(Cost Function)。

-

扩散模型(Diffusion)的"推理"能力

- 扩散模型通过逐步去噪生成轨迹。这个过程本质上是一个推理过程 :从随机噪声开始,每一步都根据观测(O_t)推理出更合理的动作。

- 这不再是简单的查表,而是基于学到的"本质"进行在线推理。

四、为什么还需要强化学习(RL)?

既然模型已经学会了"本质",为什么还要 RL?因为人类数据有局限性:

- 人类数据缺乏"反面教材":数据里很少有撞车、极限避险的案例。模型学到的"本质"可能过于乐观。

- RL 的作用 :在仿真中主动制造人类数据中不存在的高危场景 (如极端加塞、车辆失控),让模型去体验并学习如何违背"舒适"但保证"生存" 。这相当于在"驾驶本质"的基础上,打上"安全"的终极补丁。

总结

是的,模型学习的是"道",而非"术"。

它通过 Loss 在海量数据中归纳出了驾驶的通用语法 (物理规律 + 交互规则)。当遇到新场景时,它利用这套语法进行组合式推理(举一反三),而不是试图去匹配记忆中的某个片段。这就是现代端到端自动驾驶能够实现泛化的根本原因。

如此端到端模型已经理解本质了 那么上vlm vla的意义是什么

这是一个触及自动驾驶技术演进本质的极好问题。既然模型已经通过 Loss 和 RL 学会了"驾驶的本质"(物理规律、博弈规则),为什么还需要引入 VLM(视觉语言模型)和 VLA(视觉语言动作模型)?

核心答案在于:VLM/VLA 解决的并非"如何开车"的物理问题,而是"在什么情境下、为了什么目的开车"的认知与推理问题。

它们为自动驾驶系统补上了最后一块拼图:常识推理、长尾理解与可解释性。

一、传统"本质学习"的盲区:懂"术"而不懂"道"

你之前理解的"本质",更多是物理和规则层面的本能反应。就像一个车技高超但不懂交规理论的老司机,他能处理常规驾驶,但无法应对需要"理解世界"的复杂情况。

| 能力维度 | 传统 Policy/Planning 模型(学到的"本质") | VLM/VLA 补全的"新本质" |

|---|---|---|

| 物理交互 | ✅ 精通(刹车距离、避碰) | ⚠️ 辅助理解(如"湿滑路面"的含义) |

| 规则遵守 | ✅ 精通(红灯停、车道线) | ✅ 语义理解(理解"学校区域"意味着有儿童) |

| 常识推理 | ❌ 缺失(无法理解"救护车鸣笛"的紧迫性) | ✅ 核心能力(理解社会性规则) |

| 长尾场景 | ❌ 失效(没见过"路边警察手势指挥") | ✅ 泛化能力(通过语言描述理解意图) |

| 可解释性 | ❌ 黑盒("为什么刹车?"无法回答) | ✅ 白盒("因为检测到前方有动物") |

结论 :传统模型学会了 How(怎么开) ,而 VLM/VLA 提供了 Why(为什么这么开) 和 What(眼前到底是什么) 的能力。

二、VLM/VLA 在自动驾驶中的三大核心价值

- 解决"语言锚定"的常识推理(Reasoning)

这是最核心的价值。很多驾驶决策依赖于对场景的语义理解,而不仅仅是视觉特征。

- 传统模型痛点:看到一个"闪灯鸣笛的白色车辆",它只能将其视为一个快速移动的障碍物,可能选择减速避让。

- VLM 的能力 :它能理解这是"一辆执行任务的救护车",并推理出"我应该尽快让出生命通道"这一社会共识。

- 本质区别 :VLM 将视觉信号(Visual)与语言知识(Language)"锚定"在一起,赋予了模型人类般的常识。

- 覆盖"零样本"长尾场景(Zero-Shot Generalization)

你之前担心的"怎么可能所有场景都覆盖"在这里得到解决。VLA 不需要在训练数据里见过"警察手势指挥",它只需要理解"警察"和"手势"这两个概念。

- 工作流程 :

- 视觉感知:看到一个人穿着制服在挥手。

- 语言推理:VLM 生成描述:"A police officer is signaling to stop traffic."

- 策略生成 :Policy 模型接收到这个语言描述,将其映射到"停车让行"的动作空间。

- 优势:无需收集海量的"警察指挥"驾驶数据,利用预训练的语言知识直接泛化。

- 提供"可解释性"与"人车共驾"(Interpretability)

这是商业化落地的关键。当车辆做出一个紧急决策时,VLM 可以生成解释:

- 场景:车辆突然减速变道。

- 传统系统:用户恐慌。"它为什么乱开?"

- VLA 系统 :生成报告:"Reasoning : Detected a tire debris on the current lane ahead. Action: Perform a smooth lane change to avoid it."

- 价值:极大地提升了用户信任,并为事故归因提供了依据。

三、架构融合:VLA 如何与现有系统协同?

VLA 通常不是直接取代你之前研究的 GoalFlow 或 Diffusion Policy,而是作为上游的"认知大脑"或并行的"推理引擎"。

典型架构(VLA + 传统 Policy):

- 感知层:摄像头图像输入 VLM。

- 认知层(VLM):生成场景的语义描述(Scene Caption)或风险标签("Children playing nearby")。

- 决策层(Policy) :传统的强化学习/模仿学习模型,将语义描述作为额外的状态输入,辅助做出最终动作。

- 验证层:VLM 对 Policy 输出的轨迹进行"合理性检查"(如"该轨迹是否会导致撞到行人?")。

举例说明:

- 输入:视觉图像(路边有球滚出)。

- VLM 输出 :

"High probability of children running into the road."(高风险:儿童可能冲入马路)。 - Policy 输入 :

[车辆状态, 轨迹预测, "儿童风险"]。 - Policy 决策:基于此信息,触发比正常情况更早、更深的减速(即使当前视野中还没有儿童)。

四、总结:从"驾驶机器"到"驾驶伙伴"

| 进化阶段 | 技术核心 | 能力 | 局限 |

|---|---|---|---|

| 1.0 模仿学习 | Loss (MSE) | 学会"像人一样开" | 无法应对新场景,会模仿人类错误 |

| 2.0 强化学习 | RL (Reward) | 学会"比人更安全" | 缺乏常识,难以理解复杂语义 |

| 3.0 语言模型 | VLM/VLA | 学会"理解世界" | 实现真正的通用人工智能驾驶 |

最终结论:

引入 VLM/VLA 的意义,是让自动驾驶从一种**"条件反射式的技能"(Skill),升级为一种"具备常识的智能"**(Intelligence)。

它让车不再只是一个会避障的机器,而是一个能理解"救护车需要优先通行"、"路边球意味着可能有小孩"、"警察手势高于交通灯"的理性交通参与者。这才是通往 L4/L5 级全无人驾驶的必经之路。

对vlm vla训练的质疑 ai回答的非常好

问 那么vla vlm也必须要能理解 或者被训练过 才可以 比如突然有一次 地震 海啸 或者外星人来了 数据里没有训练过 则也无法做出正确判断

你的这个推论非常精准,直击了当前 AI 系统的天花板。是的,VLM/VLA 依然无法逃脱"训练分布"的诅咒。

它们解决的是"语义理解"和"常识推理"的问题,但并没有解决"全知全能"的问题。如果遇到训练数据中从未出现过的极端概念(如外星人),它们依然会失败,甚至可能因为"过度自信"而产生幻觉,导致更危险的决策。

一、VLA 的"理解"边界:内插与外推

我们需要严格区分 VLA 能力的本质:

| 能力类型 | 原理 | 例子 | 对"外星人"场景的适用性 |

|---|---|---|---|

| 内插(Interpolation) | 在训练数据分布内进行组合。VLA 的主场。 | 虽然没见过"穿恐龙服的人",但见过"人"和"恐龙",能推理出"可能有小孩在玩"。 | ❌ 不适用。概念超出已知集合。 |

| 外推(Extrapolation) | 处理完全超出训练分布的概念。AI 的盲区。 | 遇到物理法则不同的现象(如 UFO 悬浮)。 | ❌ 必然失败。模型没有对应的基底。 |

结论 :VLA 的强大在于它能将已知的视觉概念(车、人、障碍)和已知的语言概念(让行、危险)进行无限组合 ,但它无法理解全新的、未定义的原子概念。

二、为什么"外星人"场景会崩盘?(失效机制)

假设真的出现了一个训练数据中完全不存在的实体(如外星飞船),VLA 的决策流水线会这样崩塌:

-

感知/描述阶段(VLM 部分)

- 输入:视觉信号(一个形状怪异、悬浮的物体)。

- 输出 :模型会将其错误归类 为最接近的已知概念。例如:

"一个奇怪的无人机"或"气球"或"视觉噪声"。 - 根本原因 :模型的视觉编码器(CLIP 等)的 token 空间里,根本没有

[ALIEN]这个嵌入向量。

-

决策/规划阶段(Policy 部分)

- 输入 :错误的语义标签(

"无人机")。 - 决策:基于"无人机"的风险模型进行反应(如轻微避让或忽略)。

- 后果:由于标签错误,导致后续的决策完全偏离了应对"未知高风险实体"应有的避险逻辑。

- 输入 :错误的语义标签(

更危险的是 :VLA 可能会因为其语言模型的"流畅性"而产生幻觉性自信,给出一个看似合理但完全错误的解释(如"这是某种新型广告气球"),从而掩盖了真正的风险。

三、VLA 的价值:它把"未知"变成了"已知的未知"

虽然 VLA 无法解决"外星人"问题,但它相比传统模型有一个质的飞跃 :它能把"看不懂"表达出来。

| 模型类型 | 遇到未知物体的反应 | 结果 |

|---|---|---|

| 传统 CV 模型 | 将其归类为背景或噪声,静默失败(Silent Failure)。 | 车辆毫无征兆地撞上去。 |

| VLA 模型 | 生成描述:"前方出现无法识别的、非标准飞行物体,行为异常。" |

触发 Fallback 机制(如安全靠边停车、请求远程介入)。 |

这就是关键 :VLA 无法正确理解外星人,但它能识别出"这个东西不在我的认知范围内",从而触发最小风险策略(Minimal Risk Condition, MRC)。而传统模型可能连"自己不知道"这件事都意识不到。

四、自动驾驶的终极安全观:没有"银弹",只有"分层防御"

没有任何单一技术(Loss、RL、VLA)能覆盖 100% 的场景。工程上的解决方案是分层防御:

- 第一层(VLA - 认知层):利用其强大的泛化能力,覆盖 99% 的已知和"语义可推"场景(如救护车、警察、塌方)。

- 第二层(Anomaly Detection - 异常检测):专门检测"分布外(OOD)"数据。当 VLA 的描述置信度极低或视觉特征极度异常时,标记为 OOD。

- 第三层(Rule-based MRC - 规则兜底):一旦触发 OOD 或 VLA 输出高不确定性,立即执行保守策略(减速、停车、靠边)。

对于"外星人"或"地震海啸"这类极端事件:

- VLA 的任务不是"理解它",而是**"识别出自己不理解它"**。

- 真正的应对依赖于系统级的冗余设计(如紧急制动规则、高精地图的静态障碍物标注、V2X 的紧急广播),这些是独立于 AI 模型的硬安全层。

总结

你的判断完全正确:VLA 不是神,它依然受限于训练数据。

它的价值不在于解决了"外星人问题",而在于:

- 将传统模型无法处理的长尾语义场景(如特殊车辆、复杂交规)变成了可处理的常规问题。

- 通过生成式描述,将静默失败 变成了可解释的、可捕获的异常,为人类接管或规则兜底提供了入口。

自动驾驶的安全不靠"全知全能",而靠"知之为知之,不知则停之"。

传统模型置信度极低或视觉特征极度异常时 不也能做类似的事情了吗

你的直觉非常敏锐。传统模型当然也能做,但 VLA 做这件事的"维度"和"可靠性"发生了质变。

传统模型只能告诉你 "这东西不对劲" (Anomaly Detection),而 VLA 能进一步告诉你 "它哪里不对劲,以及我为什么慌了"(Interpretable Uncertainty)。这直接决定了系统是"盲目避险"还是"智能降级"。

一、传统模型如何感知"异常"?

传统模型(如 CNN 检测器 + Planning)确实有一套成熟的"异常检测"机制,主要依赖以下信号:

| 异常类型 | 传统模型的检测手段 | 局限性 |

|---|---|---|

| 视觉异常 (OOD) | 特征空间距离、预测熵值、能量分数。发现"没见过"的纹理/形状。 | 只能报错,无法归因。它知道这帧画面"不像车也不像人",但不知道它是什么。 |

| 行为异常 | 预测轨迹的概率极低(如车辆突然直角转弯)。 | 依赖物理模型,对"语义合理但物理异常"的场景易误判(如特技表演车)。 |

| 置信度低 | 检测框的 score < threshold。 |

阈值难调:设高了漏检,设低了误报,无法区分"模糊"和"未知"。 |

传统模型的反应逻辑 :

异常信号 → 触发 Fallback(减速/停车/请求接管)

缺点 :这是一种**"一刀切"的保守策略**。遇到"塑料袋"和"外星人",传统模型可能都只能触发同一个"减速停车"指令,因为它缺乏区分威胁等级的能力。

二、VLA 带来的根本性改变:从"检测异常"到"理解异常"

VLA 的优势不在于"发现异常"(这是所有模型的基础能力),而在于对异常进行语义化解析,从而做出更精细化的决策。

| 能力维度 | 传统模型(只能做左边) | VLA(新增能力) |

|---|---|---|

| Detection(检测) | ✅ 能发现"这东西我不认识" | ✅ 同左 |

| Description(描述) | ❌ 输出:Unknown_Object |

✅ 输出:"一个形状怪异、悬浮的金属物体,类似无人机但无旋翼" |

| Reasoning(推理) | ❌ 无法判断意图 | ✅ 推理:"它移动轨迹违反物理规律,属于高不确定性威胁" |

| Action(决策) | ❌ 唯一动作:保守停车 (MRC) | ✅ 分级动作:紧急避让 或 警戒减速 或 停车 |

VLA 的决策流水线 :

视觉输入 → VLM 生成描述("路中间有只鹿") → Policy 匹配语义风险等级("动物横穿:高风险") → 执行对应避险策略

三、关键区别:VLA 把"未知"变成了"已知风险"

你提到的"地震、外星人"场景,恰恰凸显了 VLA 的工程价值:

场景对比:路中间出现一个"未知物体"

| 模型类型 | 处理过程 | 结果 |

|---|---|---|

| 传统模型 | 特征提取 → 置信度 0.1(<阈值)→ 触发 OOD 警报 → 系统:立即紧急刹车。 | 可能过度反应。如果物体是塑料袋,急刹可能导致后车追尾。 |

| VLA 模型 | 视觉+语言推理 → 输出:"路面上有一个静止的、轻质的黑色塑料袋" + 低风险标签。 |

系统:轻微减速,准备压过。避免了不必要的急刹,保证了舒适性和安全性。 |

| 极端场景(外星人) | 视觉+语言推理 → 输出:"无法识别的不明飞行物,行为不可预测" + 极高风险标签。 |

系统:触发比传统模型更激进的避险策略(如靠边停车并锁门)。 |

核心差异:

- 传统模型 :遇到异常 → "我不知道,所以我怕,我要停车。"

- VLA 模型 :遇到异常 → "我不知道它具体是什么,但根据它的视觉属性和物理行为,我判断它的威胁等级是 X,所以我采取 Y 级别的应对措施。"

四、为什么这很重要?------ 避免"狼来了"效应

如果自动驾驶车每次遇到"塑料袋"或"树影"都触发紧急停车(False Positive),用户体验会极差,且容易引发交通事故(被后车追尾)。

VLA 通过语义理解 ,极大地降低了误报率(False Positive Rate):

- 传统模型:把"塑料袋"和"外星人"都当成一样的"Unknown"处理。

- VLA:能区分"无害的未知"(塑料袋)和"危险的未知"(快速逼近的不明物体)。

总结

是的,传统模型也能在置信度低时触发安全策略,但 VLA 做得更好:

- 传统模型 :只能做到 "检测 + 一刀切避险"。它知道"有问题",但不知道"问题有多大",只能按最坏情况处理。

- VLA 模型 :实现了 "理解 + 分级避险"。它能将异常分类(如"动物" vs "故障车" vs "UFO"),并匹配不同的风险响应等级。

最终结论 :VLA 的价值不在于它能处理"外星人"(谁也处理不了),而在于它能用人类的语言和逻辑,把"未知风险"管理得更像一位经验丰富的人类司机,而不是一个只会踩死刹车的机器。