🔥 个人主页: 杨利杰YJlio

❄️ 个人专栏: 《Sysinternals实战教程》 《Windows PowerShell 实战》 《WINDOWS教程》 《IOS教程》

《微信助手》 《锤子助手》 《Python》 《Kali Linux》

《那些年未解决的Windows疑难杂症》

🌟 让复杂的事情更简单,让重复的工作自动化

2023-09-25:ChatGPT 开始支持"看、听、说",从纯文本正式迈向多模态交互

- [1、2023-09-25:ChatGPT 迎来一次关键能力升级](#1、2023-09-25:ChatGPT 迎来一次关键能力升级)

- 2、什么是多模态交互?本质上变了什么

- [3、用户和 ChatGPT 的交互流程是怎么升级的](#3、用户和 ChatGPT 的交互流程是怎么升级的)

- 4、从纯文本到多模态:到底升级了哪些维度

-

- [4.1 输入方式升级](#4.1 输入方式升级)

- [4.2 理解能力升级](#4.2 理解能力升级)

- [4.3 交互体验升级](#4.3 交互体验升级)

- [4.4 应用场景升级](#4.4 应用场景升级)

- 5、多模态能力能落到哪些真实场景里

-

- [5.1 识图问答](#5.1 识图问答)

- [5.2 语音助手](#5.2 语音助手)

- [5.3 学习辅导](#5.3 学习辅导)

- [5.4 内容创作](#5.4 内容创作)

- [5.5 无障碍交流](#5.5 无障碍交流)

- 6、这次升级对普通用户意味着什么

-

- [6.1 表达成本更低了](#6.1 表达成本更低了)

- [6.2 信息理解更完整了](#6.2 信息理解更完整了)

- [6.3 回答形式更多样了](#6.3 回答形式更多样了)

- [6.4 AI 更像助手,而不是工具](#6.4 AI 更像助手,而不是工具)

- [7、我的理解:9 月 25 日真正开启的是"交互范式升级"](#7、我的理解:9 月 25 日真正开启的是“交互范式升级”)

- 8、总结

1、2023-09-25:ChatGPT 迎来一次关键能力升级

2023 年 9 月 25 日,ChatGPT 开始逐步支持**"看、听、说"**能力,也就是支持图像理解、语音输入和语音回应。

这不是一次普通的小功能更新,而是一次交互方式的升级。

过去我们使用 ChatGPT,更多是:

- 输入文字;

- 等待文字回答;

- 依赖键盘和屏幕完成整套交互。

而从这一天开始,ChatGPT 开始从**"纯文本对话工具"走向"多模态智能助手"**。

我认为,这次升级最值得关注的地方,不是单独某个按钮能不能点,而是 AI 和用户之间的交互边界被真正打开了:

- 它开始能"看懂"图片;

- 它开始能"听懂"语音;

- 它开始能"说出来"回应;

- 它开始更像一个可以自然交流的助手,而不只是一个问答窗口。

2、什么是多模态交互?本质上变了什么

所谓多模态,简单理解就是:模型不再只处理文字,而是同时处理文本、图像、语音等多种信息。

在纯文本时代,信息流很简单:

text

文字输入 → 模型理解 → 文字输出而在多模态时代,信息流开始变成:

text

文本 / 图片 / 语音输入 → 统一模型理解 → 文本 / 语音 / 图文反馈输出这意味着模型处理信息的方式发生了变化。以前它只需要理解"你写了什么",现在它还需要理解:

- 你看到了什么;

- 你说了什么;

- 你上传的图片里有什么;

- 这些信息之间是否存在上下文关联。

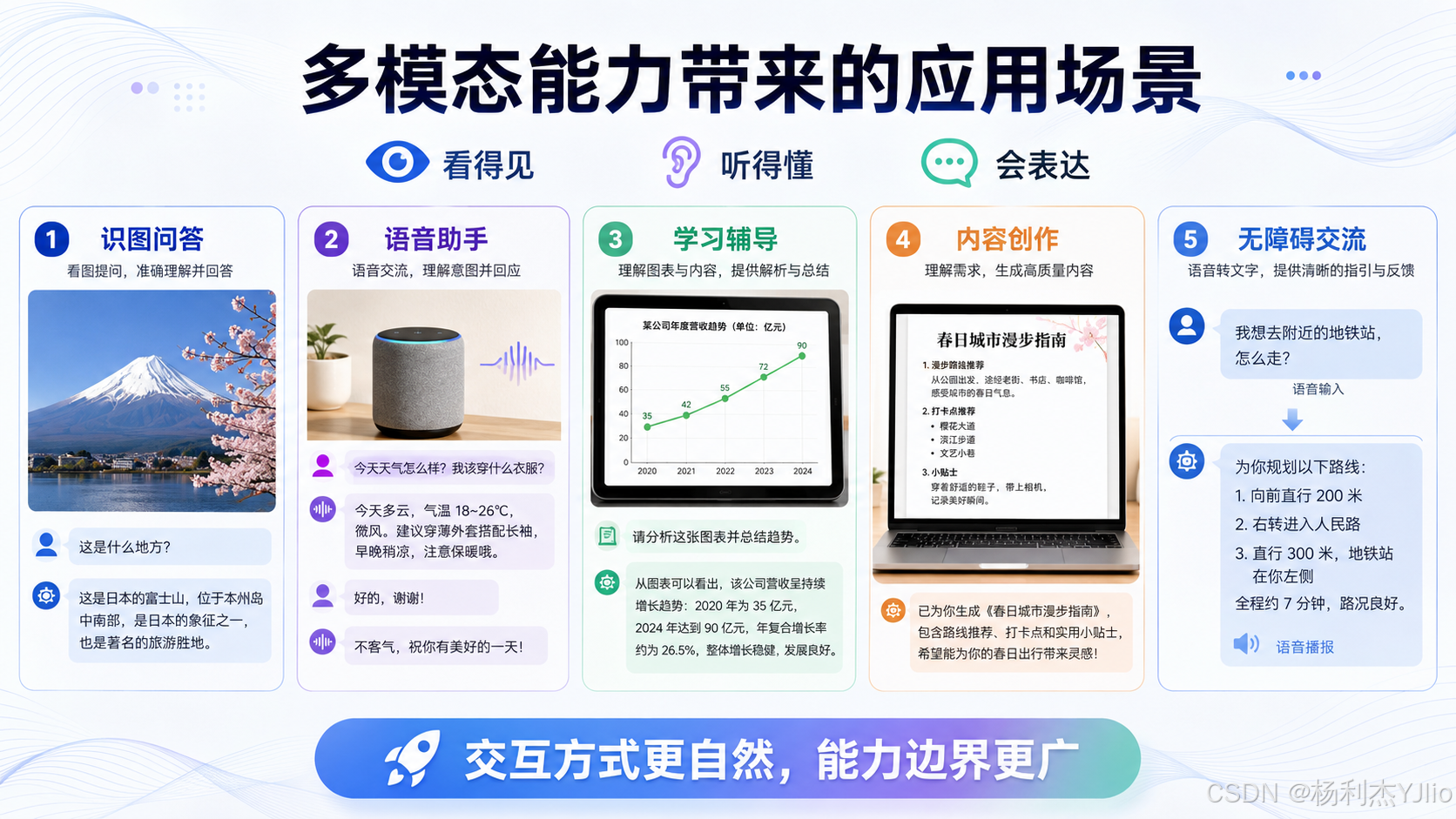

从这张结构图可以看出,整个多模态交互能力大致可以拆成三部分:

| 模块 | 作用 | 说明 |

|---|---|---|

| 文本输入 | 接收问题与指令 | 仍然保留传统文字交互方式 |

| 图像理解 | 看懂图片内容 | 能识别场景、元素、细节和含义 |

| 语音输入 | 听懂语音内容 | 支持更自然的提问方式 |

| 统一模型处理 | 融合并理解多种信息 | 这是多模态能力的核心 |

| 自然对话 / 语音输出 | 输出回答 | 可以是文字,也可以是语音 |

本质变化只有一句话: AI 不再只理解"文字",而是开始理解"更接近真实世界的信息"。

3、用户和 ChatGPT 的交互流程是怎么升级的

站在用户视角,多模态交互的流程可以理解成 5 步:

- 提出问题

- 上传图片或输入语音

- 模型统一理解

- 生成回答

- 返回语音播报或图文反馈

和以前相比,最大的区别在于: 用户不必先把所有东西翻译成文字,才能让 AI 理解。

比如以前你遇到一个问题,必须自己描述:

- 报错是什么;

- 图片里是什么;

- 图表表达了什么;

- 某个界面长什么样。

现在则可以更直接:

- 直接上传图片;

- 直接说出问题;

- 直接得到文字或语音反馈。

这就是为什么我说,多模态不是"功能堆叠",而是交互路径被缩短了。

用户提问

输入方式

文字输入

图片上传

语音输入

统一模型理解

输出方式

文本回答

语音播报

图文反馈

更清晰

更自然

更直观

4、从纯文本到多模态:到底升级了哪些维度

如果你只从表面看,这次变化像是新增了几个入口:

- 可以上传图片;

- 可以输入语音;

- 可以听语音回答。

但如果从产品形态看,它实际上升级了 4 个关键维度。

4.1 输入方式升级

以前主要依赖键盘打字。

现在支持图片、拍照、语音等多种输入方式。

4.2 理解能力升级

以前更偏向关键词和文字上下文理解。

现在开始能同时处理文字、图像、语音,理解范围更广。

4.3 交互体验升级

以前更像"查资料、问问题"。

现在更像"交流、陪伴、辅助完成任务"。

4.4 应用场景升级

以前主要集中在问答和文本创作。

现在开始覆盖:

- 学习教育

- 旅行出行

- 生活助手

- 健康医疗

- 办公创作

这说明一件很关键的事:

从这一天起,ChatGPT 的竞争力不再只是"会写",而是"会理解、会交互、会适应场景"。

5、多模态能力能落到哪些真实场景里

抽象地讲"多模态"很容易空,但如果落到实际场景,就很清楚了。

5.1 识图问答

这是最直观的一类应用。

用户上传一张图片,AI 就能围绕这张图做解释、识别与回答。

比如:

- 这是什么地方?

- 这张图表达了什么信息?

- 这张图里的对象有什么特征?

- 这类截图里的问题出在哪里?

对于技术类博客、Windows 运维、故障排查场景来说,识图能力非常实用。

5.2 语音助手

语音输入 + 语音回应,会让 ChatGPT 更像一个能对话的助手。

适合的场景包括:

- 临时提问;

- 移动端交流;

- 英语口语练习;

- 知识讲解;

- 轻量陪练和提醒。

过去你必须"打字给 AI 看",现在你可以"直接说给 AI 听"。

5.3 学习辅导

学习场景会因为多模态能力而明显增强。

例如:

- 上传图表,让 AI 分析趋势;

- 上传题目截图,让 AI 辅助讲解;

- 用语音追问不会的知识点;

- 用图文结合的方式理解抽象内容。

这意味着知识学习会更直观,反馈也会更及时。

5.4 内容创作

内容创作也不再只是"让 AI 写一段话"。

现在可以扩展成:

- 让 AI 看图写文;

- 根据语音想法生成初稿;

- 根据截图整理教程步骤;

- 根据图表提炼结论;

- 基于不同输入形式做内容重组。

对于经常写 CSDN 博客、知识笔记、教程文章的人来说,这个能力会非常有价值。

5.5 无障碍交流

这部分其实很容易被忽略,但非常重要。

多模态能力可以帮助实现:

- 语音转文字;

- 文字转语音;

- 语音问路与语音导航;

- 降低阅读门槛;

- 提升信息获取效率。

它不仅仅是"更方便",更是"让更多人更容易使用 AI"。

6、这次升级对普通用户意味着什么

如果把这次能力升级压缩成几句话,我认为可以总结为以下 4 点:

6.1 表达成本更低了

以前用户要尽量"把问题写清楚",现在用户可以直接上传图片、直接说语音。 表达方式更接近自然沟通。

6.2 信息理解更完整了

以前模型看到的是"你描述的世界"。

现在模型开始直接接触"世界本身的一部分",比如图像、声音、界面、场景。

6.3 回答形式更多样了

以前答案主要靠阅读。

现在则可以通过:

- 文字回答

- 图文反馈

- 语音播报

来适配不同使用场景。

6.4 AI 更像助手,而不是工具

这个变化是最深的。

一个只会文字问答的系统,更像工具;一个能看、能听、能说、能理解场景的系统,更像助手。

7、我的理解:9 月 25 日真正开启的是"交互范式升级"

很多人看产品更新,只看见新增功能。

但真正关键的问题不是"多了什么按钮",而是产品的底层交互逻辑变了没有。

在我看来,2023-09-25 这次更新的意义就在这里:

- 它让 ChatGPT 从"只会读写"走向"能看、能听、能说";

- 它让 AI 从"文本工具"开始走向"综合智能助手";

- 它让用户从"适应工具"逐步转变为"让工具适应人的表达方式"。

这就是为什么我认为这一天是一个非常值得记录的节点。

8、总结

2023 年 9 月 25 日,ChatGPT 开始支持"看、听、说",这标志着它从纯文本对话正式迈向多模态交互。

这次升级的核心,不是单个功能的新增,而是三件事:

- 输入方式变多了

- 理解能力变强了

- 交互体验变自然了

最终带来的结果就是:

AI 不再只是一个回答问题的窗口,而开始变成一个能理解更多信息、适应更多场景、支持更多交互方式的智能助手。

如果说早期 ChatGPT 改变的是"我们如何获取答案",

那么从多模态开始,它改变的就是"我们如何与 AI 交流"。

文章小结

为了方便快速回顾,我再用一张表把这篇文章压缩一下:

| 维度 | 纯文本时代 | 多模态时代 |

|---|---|---|

| 输入 | 文字 | 文字 + 图片 + 语音 |

| 理解 | 文字语义 | 融合图像、语音、文本 |

| 输出 | 文字回答 | 文字、语音、图文反馈 |

| 体验 | 查资料式 | 助手式 |

| 场景 | 问答、写作 | 学习、创作、识图、语音交流、无障碍等 |

如果你也在持续关注 ChatGPT、AI 工具和自动化能力,那么这一天的更新,确实是一个不该忽略的重要时间点。

🔝 返回顶部