文章目录

-

- 内容概述

- methods

-

- 离线多目标强化学习作为条件生成式规划

- [基于偏好 - 回报归一化方法的精细化引导](#基于偏好 - 回报归一化方法的精细化引导)

- 基于滑动引导提升分布外偏好泛化能力

- 实验

- 结论

- 补充

内容概述

多目标强化学习(MORL)需通过大量在线交互优化多冲突目标,离线 MORL 虽可依托预收集数据集训练、部署时泛化至任意偏好,但现实离线数据集分布保守狭窄,会产生分布外(OOD)偏好区域,现有算法对该类偏好泛化能力极差,导致策略与用户偏好不匹配。

为此,本文作者提出MODULI(带滑动引导的多目标扩散规划器):以偏好条件扩散模型为规划器 ,生成匹配各类偏好的轨迹并推导决策动作;设计两种多偏好回报归一化方法优化生成引导 ,同时提出滑动引导机制 ,通过训练滑动适配器捕捉偏好变化方向,实现从分布内(ID)偏好到分布外偏好的平滑生成,修补并拓展不完整的帕累托前沿。

在 D4MORL 基准数据集上的实验证明,MODULI 性能超越当前最优离线 MORL 基线方法,在分布外偏好泛化上表现优异。

methods

为解决离线多目标强化学习的表达能力与泛化性 难题,作者提出MODULI 框架:基于条件扩散模型生成面向偏好的轨迹 ,构建适配广泛偏好的通用策略并实现分布外偏好泛化 ;先搭建条件生成规划框架并设计偏好 - 回报归一化方法 ,再通过滑动引导机制与滑动适配器主动调整数据分布,实现从分布内到分布外偏好的过渡,避免模型单纯记忆数据。

离线多目标强化学习作为条件生成式规划

基于离线多目标强化学习数据集 D \mathcal{D} D学习策略,使其部署后可响应任意目标偏好 ω ∈ Ω \omega \in \Omega ω∈Ω。现有离线 MORL 算法普遍存在表达能力不足 的问题,无法用单一通用偏好条件策略适配广泛偏好,导致帕累托前沿近似效果欠佳。

受扩散模型优异表达能力启发,MODULI 采用扩散模型建模策略,将序贯决策转化为条件生成任务:

传统RL旨在学习一个策略函数来最大化累计奖励,而本文不是直接预测动作,而是将决策过程建模为生成一段未来状态的轨迹 x 0 ( τ ) = s 0 , ... , s H − 1 x^0(\tau) = s_0, \\dots, s_{H-1} x0(τ)=s0,...,sH−1)。

max θ E τ ∼ D log p θ ( x 0 ( τ ) ∣ y ( τ ) ) \max_\theta \mathbb{E}_{\tau \sim \mathcal{D}} \\log p_\\theta(x\^0(\\tau) \| y(\\tau)) maxθEτ∼Dlogpθ(x0(τ)∣y(τ))。其中,扩散规划的目标是生成长度为 H H H、满足偏好 ω \omega ω与后续回报 g g g条件的状态序列 x 0 ( τ ) = s 0 , ... , s H − 1 x^0(\tau) = s_0, \\dots, s_{H-1} x0(τ)=s0,...,sH−1, g g g为轨迹平均后续回报(RTG)。

生成过程受到两个关键条件 y = ω , g y = \\omega, g y=ω,g 的约束 。 g g g 代表多目标的回报(Returns-to-Go, RTG)。轨迹的 RTG 是每一步 RTG 的平均值. ---- 目标是最大化在给定偏好和回报条件下,生成数据集中真实高质量轨迹的对数概率 。

训练阶段 :从数据集采样样本,通过 L S M ( θ ) = E t ∼ U ( 0 , T ) , x 0 ∼ q 0 ( x 0 ) , ϵ ∼ N ( 0 , I ) ∣ ϵ θ ( x t , t ) − ϵ ∣ 2 2 \mathcal{L}{SM}(\theta) = \mathbb{E}{t \sim U(0,T), x^0 \sim q_0(x^0), \epsilon \sim \mathcal{N}(0,I)} \left \\left\| \\epsilon_\\theta(x\^t, t) - \\epsilon \\right\|_2\^2 \\right LSM(θ)=Et∼U(0,T),x0∼q0(x0),ϵ∼N(0,I) ϵθ(xt,t)−ϵ 22的修正得分匹配目标更新 p θ p_\theta pθ:

L ( θ ) = E ( x 0 , ω , g ) ∼ D , t ∼ U ( 0 , T ) , ϵ ∼ N ( 0 , I ) ∣ ϵ θ ( x t , t , ω , g ) − ϵ ∣ 2 2 . (8) \mathcal{L}(\theta) = \mathbb{E}_{(x^0, \omega, g) \sim \mathcal{D}, t \sim U(0, T), \epsilon \sim \mathcal{N}(0, I)} \left \\left\| \\epsilon_\\theta(x\^t, t, \\omega, g) - \\epsilon \\right\|_2\^2 \\right. \tag{8} L(θ)=E(x0,ω,g)∼D,t∼U(0,T),ϵ∼N(0,I) ϵθ(xt,t,ω,g)−ϵ 22.(8)

在训练时,算法会从离线数据集 D \mathcal{D} D 中采样真实的轨迹 x 0 x^0 x0、偏好 ω \omega ω 和回报 g g g 。 向真实轨迹中添加一个随机采样的标准高斯噪声 ϵ \epsilon ϵ,得到加噪后的状态 x t x^t xt 。 神经网络 ϵ θ ( x t , t , ω , g ) \epsilon_\theta(x^t, t, \omega, g) ϵθ(xt,t,ω,g) 的任务就是预测并逼近这个被添加的真实噪声 ϵ \epsilon ϵ 。

MODULI 采用无分类器引导(CFG)实现条件生成,训练时同步学习条件与无条件噪声预测器,并通过掩码机制模拟无条件生成场景。模型选用生成精度更高的DiT1d 架构 替代 U-Net,同时使用损失加权技巧 ,提升对动作执行关键状态 s 1 s_1 s1的学习权重。

模型不仅需要学习带条件 y y y 的噪声预测 ϵ θ ( x t , t , ω , g ) \epsilon_\theta(x^t, t, \omega, g) ϵθ(xt,t,ω,g),还需要学习不带任何条件的无条件噪声预测 ϵ θ ( x t , t , ∅ ) \epsilon_\theta(x^t, t, \emptyset) ϵθ(xt,t,∅) 。 ---- 在训练过程中,算法会以一定的概率 p p p( 0 < p < 1 0 < p < 1 0<p<1)强制将条件数据(偏好和回报)置为空(即零化条件)。这种机制迫使同一个神经网络同时掌握有条件和无条件两种分布的生成能力,为后续推理阶段按权重混合这两种预测(以增强条件控制力)打下基础 。

更多内容可以参考这篇文章:【NeurIPS 2023】离线强化学习的高效扩散策略 EDP --- Efficient Diffusion Policies for Offline Reinforcement Learning

基于偏好 - 回报归一化方法的精细化引导

全局归一化

为在不同尺度和物理量纲的目标下实现生成,建立合适的引导条件 至关重要,回报归一化是关键环节。本文作者首先将单目标归一化方案拓展至多目标场景,提出全局归一化:

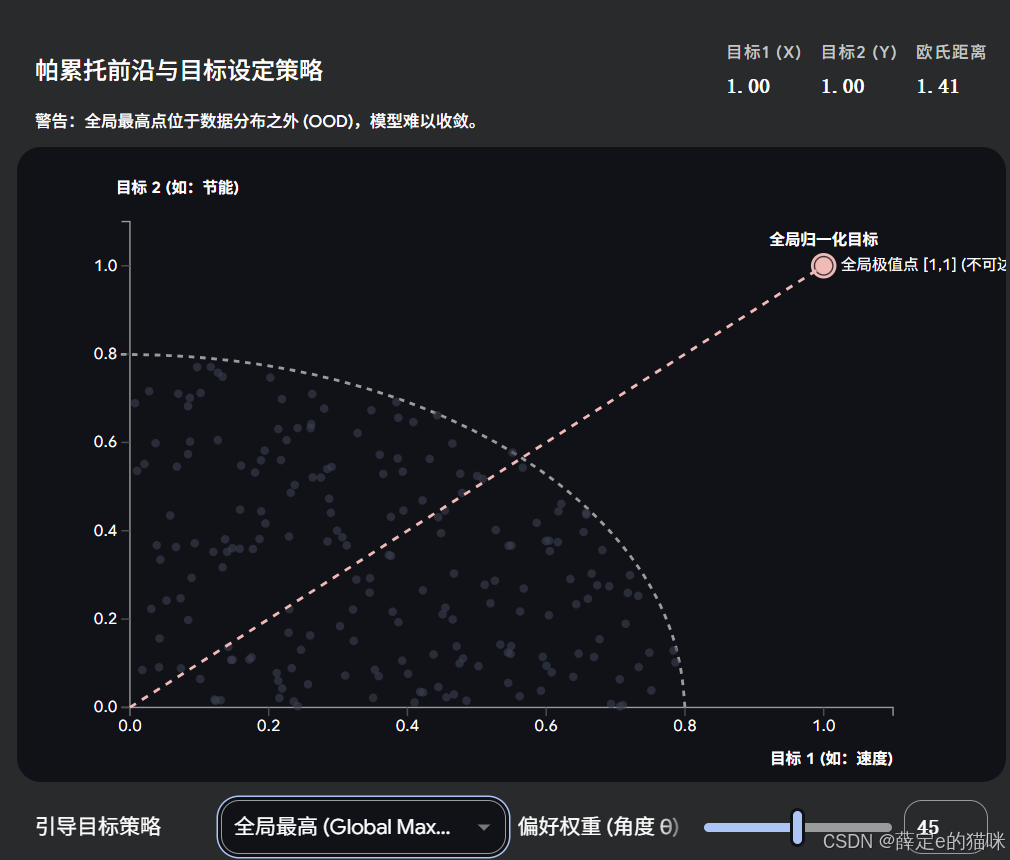

计算离线数据集中每个目标后续回报(RTG)的全局最大值 g max = g 1 max , ... , g n max g^\text{max} = g_1\^\\text{max}, \\dots, g_n\^\\text{max} gmax=g1max,...,gnmax与全局最小值 g min g^\text{min} gmin,通过最小 - 最大归一化将 RTG 缩放至 ( g − g min ) / ( g max − g min ) ∈ 0 , 1 n (g - g^\text{min}) / (g^\text{max} - g^\text{min}) \in 0, 1^n (g−gmin)/(gmax−gmin)∈0,1n,再与偏好 ω \omega ω拼接作为输入;部署时,以最高 RTG 条件 g = 1 n g = \mathbf{1}^n g=1n为目标,为给定偏好 ω target \omega_\text{target} ωtarget生成轨迹。

部署阶段假设想要最好的策略,那在让扩散模型生成轨迹时,直接把条件拉满,也就是设 g = 1 n g = \mathbf{1}^n g=1n(例如在双目标任务里,设置条件为 1.0, 1.0),期望模型能生成同时在所有目标上都达到最完美的轨迹。

但全局极值基于离线数据集计算,未必是各目标实际可达极值,且部分目标天然冲突、无法同时最大化,直接使用 y = ω target , 1 n y = \\omega_\\text{target}, \\mathbf{1}\^n y=ωtarget,1n引导会导致性能下降。为此,本文作者提出偏好预测归一化 与邻域偏好归一化两种适配多目标场景的方法,实现偏好相关的回报归一化以提供精细引导。

数据集中根本不存在同时满足所有目标均达到 1.0 的真实轨迹(即帕累托前沿到不那个位置)。当你用 y = ω target , 1 n y = \\omega_{\\text{target}}, \\mathbf{1}\^n y=ωtarget,1n 引导扩散模型时,相当于给了一个超出其训练分布(OOD)的荒谬条件,这会导致模型产生幻觉,从而给出不知所云的劣质轨迹。

虽然存在上面的问题,但有趣的是,MODULI 在部署时依然输入了 g = 1 n g = \mathbf{1}^n g=1n 作为条件,但它通过重新定义归一化方式,巧妙地改变了 1 n \mathbf{1}^n 1n 的含义。

偏好预测归一化

训练一个通用回报预测器 g max ( ω ) = R ψ ( ω ) g^\text{max}(\omega) = R_\psi(\omega) gmax(ω)=Rψ(ω)来预测在给定特定偏好 ω \omega ω 下,能够达到的最大期望回报 。

首先识别数据集中所有非支配解轨迹 τ P ∈ D P \tau_P \in D_P τP∈DP(其中 D P ⊆ D D_P \subseteq D DP⊆D, P P P代表帕累托前沿);然后,以偏好 ω \omega ω为条件,通过最小化回报预测误差来训练通用回报预测器:

L ( ψ ) = E ( ω , g ^ ) ∼ D P ∣ R ψ ( ω ) − g \^ ∣ 2 2 , (9) \mathcal{L}(\psi) = \mathbb{E}_{(\omega, \hat{g}) \sim D_P} \left \\left\| R_\\psi(\\omega) - \\hat{g} \\right\|_2\^2 \\right, \tag{9} L(ψ)=E(ω,g^)∼DP∣Rψ(ω)−g\^∣22,(9)

它的工作原理是:从精英数据集 D P D_P DP 中拿出真实的偏好 ω \omega ω 和它对应的真实最高回报 g ^ \hat{g} g^,让网络输出一个预测值 R ψ ( ω ) R_\psi(\omega) Rψ(ω)。通过不断最小化这两者的差值,这个网络就学会了:只要输入任意一个偏好方向,它就能精准预测出该方向上的"理论最高分"。

随后,计算每条轨迹 τ \tau τ在偏好 ω \omega ω下的归一化 RTG: g τ / g max ( ω ) ∈ 0 , 1 n g_\tau / g^\text{max}(\omega) \in 0, 1^n gτ/gmax(ω)∈0,1n。借助 RTG 预测,模型能更贴合训练分布,通过为每种偏好指定不同的最大向量回报来引导生成。

算法回头对所有普通轨迹进行重新打分。直接用轨迹的实际得分 g τ g_\tau gτ,除以刚刚预测出的该偏好下的"理论最高分" g max ( ω ) g^\text{max}(\omega) gmax(ω)

邻域偏好归一化

基于"相似的偏好通常导致相似行为"的直觉 ,它直接在数据集中圈定一个相似偏好的"邻域",用这些邻居轨迹里表现最好的返回值来估算最高分 。

对于轨迹 τ \tau τ及其对应的偏好 ω τ \omega_\tau ωτ,定义 ε \varepsilon ε- 邻域:

B ε ( τ ) = τ ′ ∣ ∣ ω τ ′ − ω τ ∣ ≤ ε . (10) \mathcal{B}\varepsilon(\tau) = {\tau' \mid |\omega{\tau'} - \omega_\tau| \leq \varepsilon}. \tag{10} Bε(τ)=τ′∣∣ωτ′−ωτ∣≤ε.(10)

定义了一个半径为 ε \varepsilon ε 的邻域。对于某条轨迹的特定偏好 ω τ \omega_\tau ωτ(例如高度看重速度),我们只寻找那些偏好差异小于 ε \varepsilon ε 的其他轨迹 τ ′ \tau' τ′。

因此,可以使用邻域轨迹内的最大期望回报来近似最大期望 RTG,归一化方式如下:

g τ = g τ − min ( g B ε ( τ ) ) max ( g B ε ( τ ) ) − min ( g B ε ( τ ) ) ∈ 0 , 1 , (11) g_\tau = \frac{g_\tau - \min\left(g_{\mathcal{B}\varepsilon(\tau)}\right)}{\max\left(g{\mathcal{B}\varepsilon(\tau)}\right) - \min\left(g{\mathcal{B}\varepsilon(\tau)}\right)} \in 0, 1, \tag{11} gτ=max(gBε(τ))−min(gBε(τ))gτ−min(gBε(τ))∈0,1,(11) g B ε ( τ ) = g τ ′ ∣ τ ′ ∈ B ε ( τ ) . (12) g{\mathcal{B}\varepsilon(\tau)} = {g{\tau'} \mid \tau' \in \mathcal{B}_\varepsilon(\tau)}. \tag{12} gBε(τ)=gτ′∣τ′∈Bε(τ).(12)

经过这样的"偏好定制化"处理后,当一条轨迹的归一化得分为 1.0 1.0 1.0 时,它代表的不再是不可达的情况,而是"在当前指定偏好方向上,做到了 100 % 100\% 100% 的最好表现" 。此时,训练目标与部署时的采样目标(输入 g = 1 n g = \mathbf{1}^n g=1n)就实现了完美的逻辑对齐,且切实可行 。

把刚才圈定好的那些"邻居"的实际回报(RTG)全部提取出来,形成一个局部的成绩池 g B ε ( τ ) g_{\mathcal{B}_\varepsilon(\tau)} gBε(τ)。

不再使用整个数据集的历史最高/最低分,而是严格使用局部成绩池里的最大值 max \max max 和最小值 min \min min。这意味着,一条轨迹能拿多少分,完全取决于它在自己这个小圈子里的相对表现。

动作提取

MODULI 可通过无分类器引导机制,结合任意偏好与回报‑目标‑梯度(RTG)精准生成目标轨迹。随后训练逆动力学模型 a t = h ( s t , s t + 1 ) a_t = h(s_t, s_{t+1}) at=h(st,st+1),从生成轨迹 x 中提取执行动作 a t a_t at;同时固定初始状态 x k 0 = x 0 0 x^k0 = x^00 xk0=x00,增强轨迹生成的一致性。

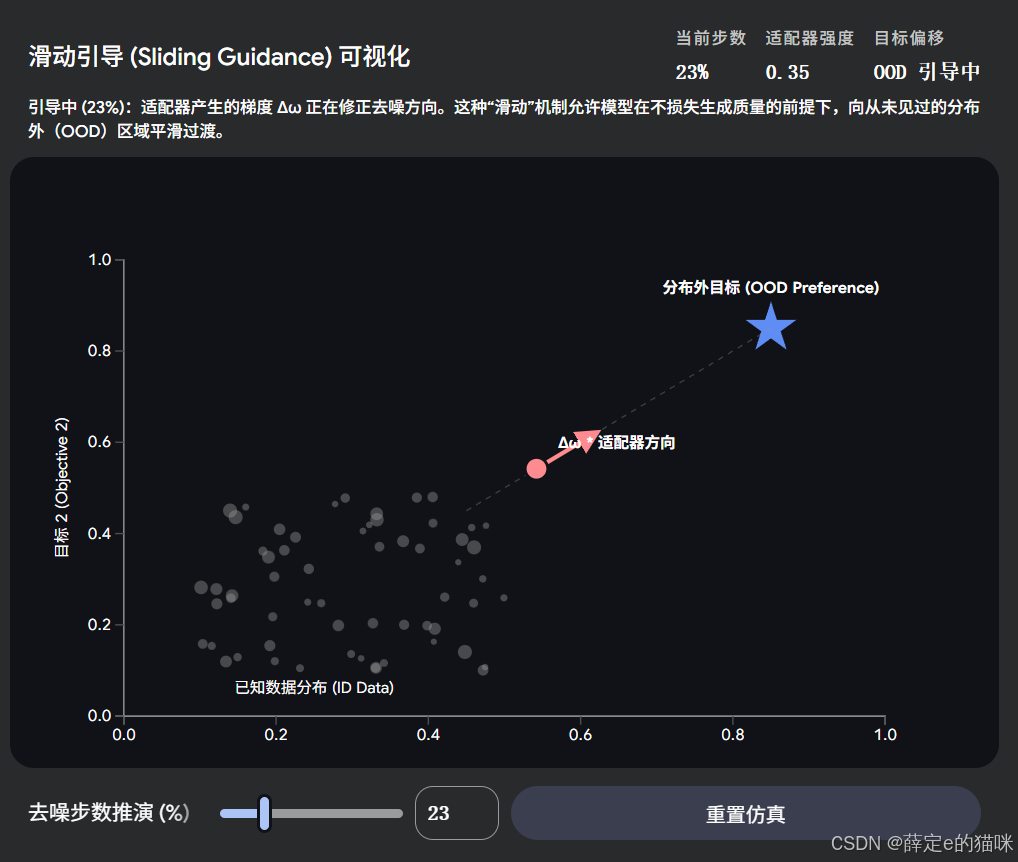

基于滑动引导提升分布外偏好泛化能力

采用适配归一化的扩散模型后,MODULI 具备优异表达能力,可完整覆盖数据集内的分布内偏好。但面对分布外偏好 时,模型易保守生成贴近分布内的轨迹,存在过拟合问题。为此,本文作者借鉴已有研究,提出滑动引导机制以提升泛化能力。

在预训练扩散模型 p θ p_\theta pθ 后,额外训练结构一致的即插即用滑动适配器 p θ ∗ p_{\theta^*} pθ∗,学习偏好变化的潜在方向,通过主动调整目标分布避免单纯数据记忆 。条件 c 下通过式 (13) 提升正向属性 (c_+)、抑制负向属性 (c_-) 的生成概率: p θ ( x 0 ( τ ) ∣ c ) ← p θ ( x 0 ( τ ) ∣ c ) ⋅ ( p θ ∗ ( c + ∣ x 0 ( τ ) ) p θ ∗ ( c − ∣ x 0 ( τ ) ) ) η (13) p_\theta\left(x^0(\tau) \mid c\right) \leftarrow p_\theta\left(x^0(\tau) \mid c\right) \cdot \left( \frac{p_{\theta^*}(c_+ \mid x^0(\tau))}{p_{\theta^*}(c_- \mid x^0(\tau))} \right)^\eta \tag{13} pθ(x0(τ)∣c)←pθ(x0(τ)∣c)⋅(pθ∗(c−∣x0(τ))pθ∗(c+∣x0(τ)))η(13)其中 η \eta η 为引导强度权重。

改变概率:相当于给原来的概率分布施加了一个外力,推着模型往 c + c_+ c+ 的方向走,同时拉着它远离 c − c_- c− 的方向。 η \eta η 就是这个外力的强度。

进一步推导得到等价噪声预测微调形式 (14),通过修正得分函数实现分布偏移。

令适配器输出为单位长度偏好偏移方向: ϵ θ ∗ ( x t , c , t ) = ϵ θ ( x t , c + , t ) − ϵ θ ( x t , c − , t ) c + − c − . (14) \epsilon_{\theta^*}\left(x^t, c, t\right) = \frac{\epsilon_\theta\left(x^t, c_+, t\right) - \epsilon_\theta\left(x^t, c_-, t\right)}{c_+ - c_-}\tag{14}. ϵθ∗(xt,c,t)=c+−c−ϵθ(xt,c+,t)−ϵθ(xt,c−,t).(14)

求导数:它计算的是"当偏好条件发生单位变化时,模型预测的噪声应该发生多大的偏移"。这个 ϵ θ ∗ \epsilon_{\theta^*} ϵθ∗ 就是偏好变化的单位方向向量。

针对多目标强化学习,将条件映射为偏好 ω \omega ω,以式 (15) 的均方误差损失训练适配器,拟合偏好变化梯度: L ( θ ∗ ) = E ( ω , Δ ω ) ∼ D ∣ ϵ θ ∗ ( x t , ω , t ) − ϵ θ ( x t , ω + Δ ω , t ) − ϵ θ ( x t , ω − Δ ω , t ) 2 Δ ω ∣ 2 2 (15) \mathcal{L}(\theta^*) = \mathbb{E}_{(\omega, \Delta\omega) \sim D} \left \\left\| \\epsilon_{\\theta\^\*}\\left(x\^t, \\omega, t\\right) - \\frac{\\epsilon_\\theta\\left(x\^t, \\omega+\\Delta\\omega, t\\right) - \\epsilon_\\theta\\left(x\^t, \\omega-\\Delta\\omega, t\\right)}{2\\Delta\\omega} \\right\|_2\^2 \\right \tag{15} L(θ∗)=E(ω,Δω)∼D ϵθ∗(xt,ω,t)−2Δωϵθ(xt,ω+Δω,t)−ϵθ(xt,ω−Δω,t) 22(15)

训练模型:这是一个均方误差(MSE)损失函数。减号右边使用的是中心差分法,计算出原始扩散模型在偏好微小变动( + Δ ω +\Delta\omega +Δω 和 − Δ ω -\Delta\omega −Δω)时的实际变化率。

专门训练一个独立的小网络 θ ∗ \theta^* θ∗(滑动适配器),让它的输出去逼近这个"变化率"。训练好之后,这个适配器就完全掌握了偏好偏移的规律。

部署时,对分布外偏好 ω OOD \omega_\text{OOD} ωOOD,从邻近分布内偏好 ω ID \omega_\text{ID} ωID 平滑过渡,计算偏好差值 Δ ω \Delta\omega Δω,在去噪阶段联合使用扩散模型与适配器 ϵ θ + Δ ω ϵ θ ∗ \epsilon_\theta + \Delta\omega \epsilon_{\theta^*} ϵθ+Δωϵθ∗,实现分布外偏好的稳定泛化,完整流程伪代码见附录 E。

实验

在各类离线多目标强化学习任务上开展实验,以研究以下研究问题(RQ):

-

表达能力(RQ1):在完整数据集上,MODULI 与其他基线方法相比表现如何?

-

泛化能力(RQ2):在破碎或狭窄数据集的分布外偏好上,MODULI 是否展现出领先的泛化性能?

-

归一化方法(RQ3):不同归一化方法对性能有何影响?

MODULI 的所有实验细节详见附录 B。

数据集与基线

在 D4MORL(Zhu 等人,2023a)基准上评估 MODULI,该基准是一个离线多目标强化学习基准,包含来自 6 个多目标 MuJoCo 环境的离线轨迹。D4MORL 包含两种质量的数据集:

-

专家数据集:由预训练的专家行为策略收集;

-

业余数据集:由扰动的行为策略收集。

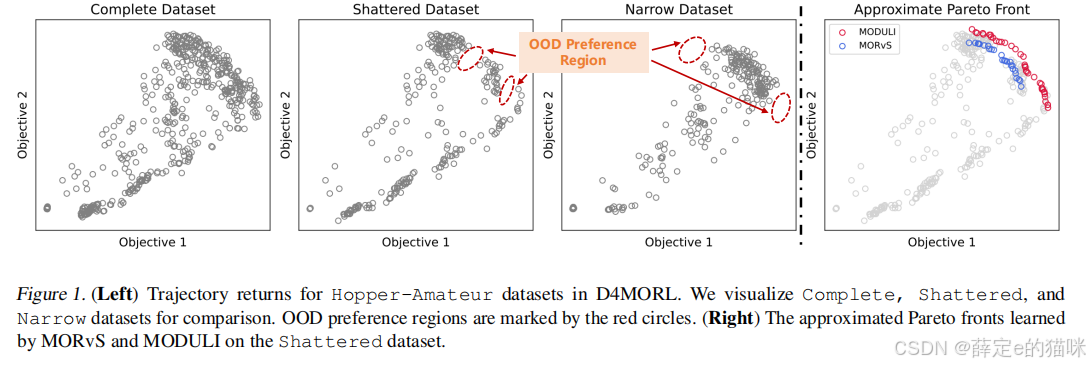

将 D4MORL 的原始数据集命名为完整数据集 ,用于验证模型处理多目标任务的表达能力。此外,为评估算法对分布外(OOD)偏好的泛化能力,与图 1 类似,我们收集了两种偏好缺失数据集,即破碎数据集(Shattered)和狭窄数据集(Narrow)。

数据集的生成方式详见附录 A.2。

-

破碎数据集 :通过从完整数据集中移除部分轨迹,模拟不完整的偏好分布,创建存在偏好缺失的区域。它主要评估插值型分布外泛化能力,即当遇到部分缺失的未知偏好时,算法的泛化表现。

-

狭窄数据集 :与破碎数据集类似,但主要评估外推型分布外泛化能力。该数据集通过从完整数据集的两端移除部分轨迹生成,导致偏好分布更狭窄。

数据集和基线方法的更多细节详见附录 A。

评估指标

使用两个常用指标 超体积(HV)和稀疏度(SP)来评估经验帕累托前沿,并新增一个指标回报偏差(RD)来评估分布外偏好区域的泛化能力:

-

超体积(HV) : H ( P ) \mathcal{H}(P) H(P) 衡量帕累托前沿 P P P中解所包围的空间,定义为:

H ( P ) = ∫ R n 1 H ( P ) ( z ) d z \mathcal{H}(P) = \int_{\mathbb{R}^n} \mathbf{1}{H(P)}(z) dz H(P)=∫Rn1H(P)(z)dz 其中 H ( P ) = z ∈ R n ∣ ∃ i : 1 ≤ i ≤ ∣ P ∣ , r 0 ⪯ z ⪯ P ( i ) H(P) = {z \in \mathbb{R}^n | \exists i: 1 \leq i \leq |P|, r_0 \preceq z \preceq P(i)} H(P)=z∈Rn∣∃i:1≤i≤∣P∣,r0⪯z⪯P(i), r 0 r_0 r0为环境确定的参考点, ⪯ \preceq ⪯为支配关系算子, 1 H ( P ) \mathbf{1}{H(P)} 1H(P)为指示函数(若 z ∈ H ( P ) z \in H(P) z∈H(P)则为 1,否则为 0)。HV 越高越好,代表经验帕累托前沿拓展范围更大。 -

稀疏度(SP) : S ( P ) \mathcal{S}(P) S(P) 衡量帕累托前沿 P P P的密度,定义为:

S ( P ) = 1 ∣ P ∣ − 1 ∑ i = 1 n ∑ k = 1 ∣ P ∣ − 1 ( P ~ i ( k ) − P ~ i ( k + 1 ) ) 2 \mathcal{S}(P) = \frac{1}{|P|-1} \sum_{i=1}^n \sum_{k=1}^{|P|-1} \left( \tilde{P}_i(k) - \tilde{P}_i(k+1) \right)^2 S(P)=∣P∣−11i=1∑nk=1∑∣P∣−1(P~i(k)−P~i(k+1))2 其中 P ~ i \tilde{P}_i P~i代表 P P P中第 i i i个目标值的排序列表, P ~ i ( k ) \tilde{P}_i(k) P~i(k)为 P ~ i \tilde{P}_i P~i中的第 k k k个值。SP 越低越好,代表帕累托前沿近似更密集。 -

回报偏差(RD) : R ( O ) \mathcal{R}(O) R(O) 衡量分布外偏好区域的解集 O O O与预测最大值之间的差异,定义为:

R ( O ) = 1 ∣ O ∣ ∑ k = 1 ∣ O ∣ ∣ O ( k ) − R ψ ( ω O ( k ) ) ∣ 2 2 \mathcal{R}(O) = \frac{1}{|O|} \sum_{k=1}^{|O|} \left| O(k) - R_\psi(\omega_{O(k)}) \right|2^2 R(O)=∣O∣1k=1∑∣O∣ O(k)−Rψ(ωO(k)) 22 其中 R ψ R\psi Rψ是第 4.2 节中提到的预训练通用回报预测器, ω O ( k ) \omega_{O(k)} ωO(k)是 O ( k ) O(k) O(k)对应的偏好。RD 越低越好,代表分布外偏好下的解性能越接近预测最大值,泛化能力越强。

参照 Zhu 等人(2023a)的工作,双目标环境统一选取 501 个偏好点,三目标环境选取 325 个偏好点;所有实验采用 3 个随机种子,报告均值与标准差。

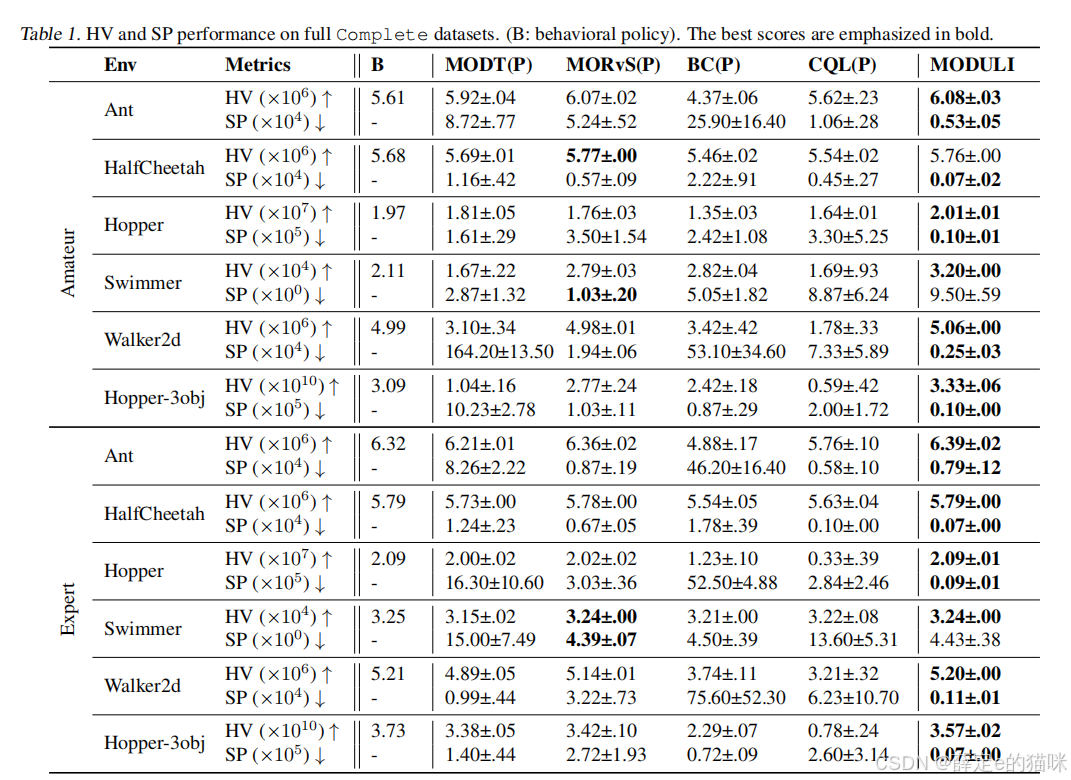

在完整数据集上评估表达能力

首先在完整数据集上对比 MODULI 与各类基线。在该数据集版本中,轨迹的偏好覆盖全面,策略需要具备充足的表达能力,以覆盖广泛偏好下的复杂分布。

如表 1 所示,多数基线方法(MOCQL、MOBC、MODT)表现次优,无法达到与行为策略接近的超体积(HV),且易出现偏好空间塌陷,无法得到密集解。MORvS 的 HV 和 SP 表现更优,但因上下文策略表达能力不足,无法与行为策略竞争。

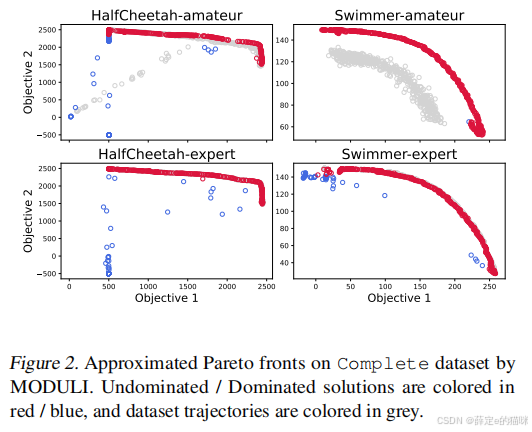

总体而言,MODULI 根据 HV 指标取得了最优的策略性能,同时以最低的 SP 值获得了最密集的解。在图 2 中可视化了经验帕累托前沿,证明 MODULI 在不同数据质量下都是优秀的近似器:在专家数据集上,MODULI 能精准复现行为策略;在业余数据集上,由于包含大量次优解,MODULI 显著拓展了帕累托前沿,展现出拼接并引导生成高质量轨迹的能力。

在破碎与狭窄数据集上评估泛化能力

性能表现

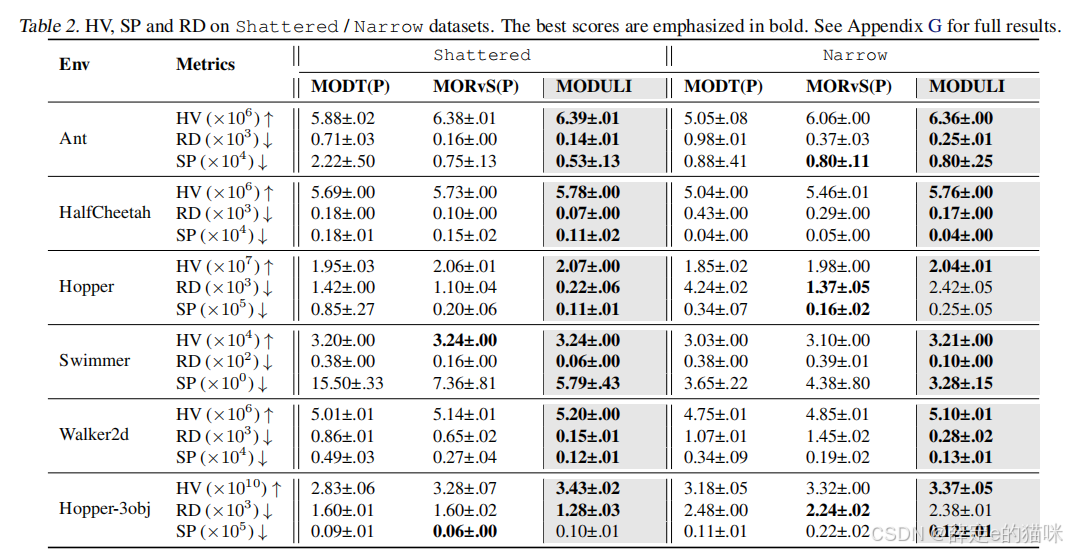

在破碎与狭窄数据集上评估泛化性能。表 2 展示了专家数据集上的对比结果,其中 MODULI 在所有基线上仍保持最优性能。具体而言,MODULI 在新增的 RD 指标上取得了显著提升,说明其泛化能力更强,对分布外偏好区域的帕累托前沿近似效果更优。我们进一步可视化了 MODULI 强大的分布外偏好泛化能力。

分布外泛化可视化

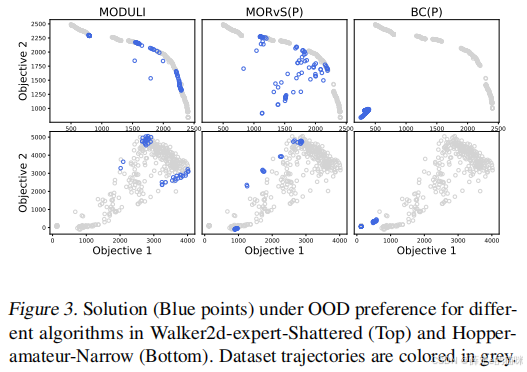

在图 3 中,可视化了不同算法在分布外偏好下的实际解。灰色点代表数据集中的轨迹,其中数据集的偏好是不完整的。我们观察到:BC (P) 面对分布外偏好时出现策略塌陷,回报极低且与偏好不匹配;MORvS (P) 的泛化能力有限,多数解仍无法满足偏好要求;仅 MODULI 能在分布外偏好下生成正确解:在破碎数据集上修补部分分布外偏好区域,在狭窄数据集上小幅向两侧拓展帕累托前沿。

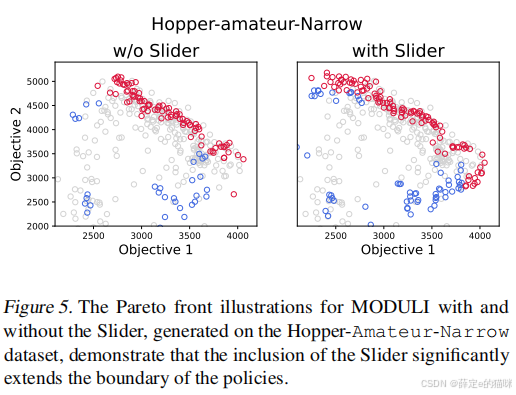

滑动引导消融实验

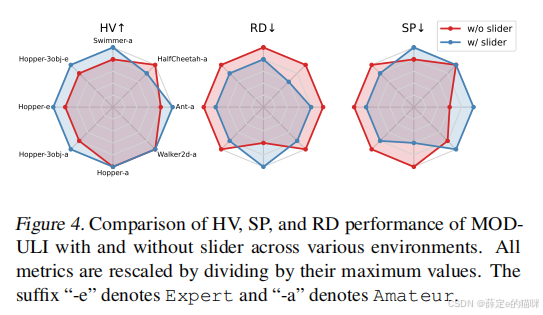

在狭窄数据集的 9 个任务上对滑动引导机制进行了消融研究,结果呈现在图 4 的雷达图中。在大多数任务中,带滑动适配器的 MODULI 展现出更高的 HV 和更低的 RD,表明其在多目标任务中性能领先。同时,滑动适配器的有无对 SP 性能影响极小,说明滑动引导机制不会损害模型对分布内偏好的表达能力。此外,在图 5 中可视化了 Hopper-Narrow 数据集的经验帕累托前沿,滑动引导机制显著拓展了分布外偏好区域的帕累托集,展现出更优的泛化能力。

在附录 H 中提供了不同引导机制(CG、CG+CFG)的更多对比实验。

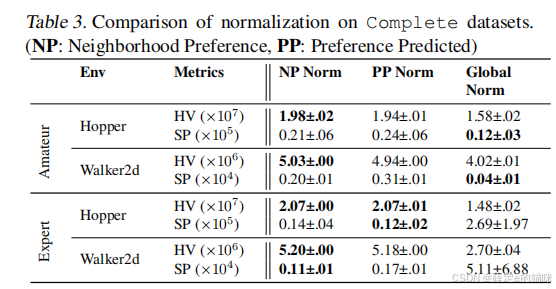

不同归一化方法对比

在完整数据集上对比了不同回报归一化方法对 MODULI 性能的影响。如表 3 所示,邻域偏好归一化(NP Norm)的 HV 性能始终最高。在专家数据集上,NP Norm 与偏好预测归一化(PP Norm)的 HV 值非常接近,因为它们都能通过预测或邻域分析精准估计每种偏好对应的最高回报。然而,在业余数据集上,PP Norm 无法准确预测,导致性能下降。我们还发现,简单的全局归一化(Global Norm)无法良好近似帕累托前沿,但在部分数据集上,它得到了更密集的解(SP 更小)。我们认为这是因为全局归一化提供的引导信息不准确且同质化,导致不同偏好生成相似解,最终得到的是密集但质量低下的解。深度可视化分析详见附录 C。

| 数据集 | 环境 | 指标 | NP Norm | PP Norm | Global Norm |

|---|---|---|---|---|---|

| Amateur | Hopper | HV ( × 10 7 \times 10^7 ×107) | 1.98±.02 | 1.94±.01 | 1.58±.02 |

| SP ( × 10 5 \times 10^5 ×105) | 0.21±.06 | 0.24±.06 | 0.12±.03 | ||

| Walker2d | HV ( × 10 6 \times 10^6 ×106) | 5.03±.00 | 4.94±.00 | 4.02±.01 | |

| SP ( × 10 4 \times 10^4 ×104) | 0.20±.01 | 0.31±.01 | 0.04±.01 | ||

| Expert | Hopper | HV ( × 10 7 \times 10^7 ×107) | 2.07±.00 | 2.07±.01 | 1.48±.02 |

| SP ( × 10 5 \times 10^5 ×105) | 0.14±.04 | 0.12±.02 | 2.69±1.97 | ||

| Walker2d | HV ( × 10 6 \times 10^6 ×106) | 5.20±.00 | 5.18±.00 | 2.70±.04 | |

| SP ( × 10 4 \times 10^4 ×104) | 0.11±.01 | 0.17±.01 | 5.11±6.88 |

表 3. 完整数据集上不同归一化方法的性能对比(NP:邻域偏好归一化,PP:偏好预测归一化)

结论

本文提出了MODULI:一种融合两种多目标归一化方案的扩散规划框架,实现偏好 - 回报条件引导的轨迹生成与决策。为实现更优的分布外偏好泛化,MODULI 加入了滑动引导机制,额外训练一个滑动适配器实现主动分布调整。

我们在完整、破碎、狭窄三类数据集上开展了大量实验,证明了 MODULI 具备优异的表达与泛化能力。结果表明,MODULI 是一种出色的帕累托前沿近似器,能够拓展帕累托前沿并得到高质量、密集的解。

然而,本文仍存在局限性:实验仅在低维状态空间与连续动作空间开展,未来计划拓展到含图像输入的多目标任务,进一步提升泛化能力;此外,非线性偏好空间也将是新的挑战。

补充

实际的离线数据集质量往往参差不齐(比如混杂了许多表现糟糕、随机探索的次优轨迹),依赖神经网络预测的 PPN 和依赖实际邻居数据的 NPN,哪一种在面对低质量数据集时表现会更稳定呢?

PPN(偏好归一化) 依赖训练一个神经网络来预测最大期望回报,它的训练数据仅仅是数据集里的非支配解。如果离线数据集质量很低,这些高质量的非支配解就会非常稀疏 。神经网络在面对这种稀疏且低质量的数据时会产生严重的预测误差 。这会导致归一化后的数据出现畸变

NPN 是一种完全无需学习的方法 。它不试图去预测一个理论上的极限值,而是直接在连续的偏好空间中圈定一个邻域,使用这些真实存在的"邻居"轨迹里的最大期望回报来进行近似归一化 。这种直接依赖局部实际极值的方式,完美避开了因数据稀疏而导致的神经网络预测误差 。

正如论文实验所证实的,NPN 在不同质量的数据集上都能保持稳定优异的性能,是作者的首选方法;而 PPN 仅在高质量数据集上才能表现良好 。