1 介绍

-

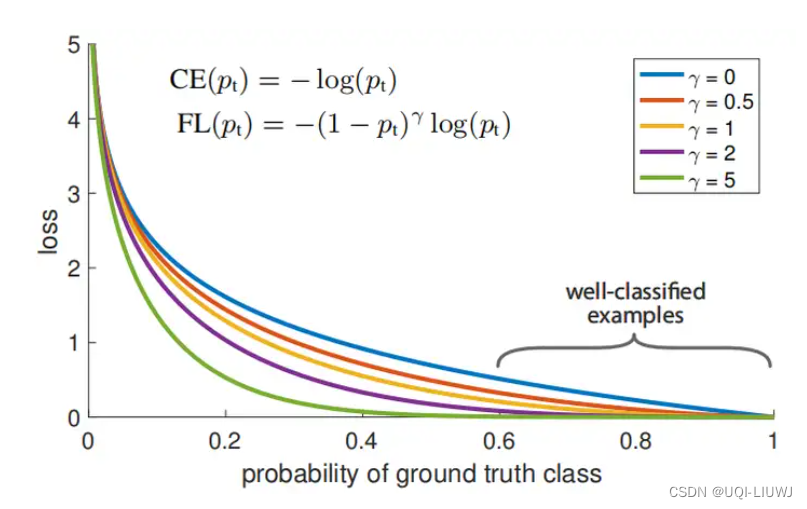

Focal Loss 是一种在类别不平衡的情况下改善模型性能的损失函数

-

最初在 2017 年的论文《Focal Loss for Dense Object Detection》中提出

-

这种损失函数主要用于解决在有挑战性的对象检测任务中,易分类的负样本占据主导地位的问题,从而导致模型难以学习到难分类样本的特征

-

Focal Loss 修改了标准的交叉熵损失函数,通过减少易分类样本的相对损失来增加对难分类样本的关注

- 其基本形式为如下FL的部分

- γ 是调节因子,用于控制易分类样本对损失的贡献减小的速率。

- 通过引入

,Focal Loss 能够降低那些已经被正确分类的样本(pt 较高)的损失贡献,使得模型更加关注那些难以正确分类的样本。