目录

要从文本中获取特征,需要先拆分文本。这里的特征是来自文本的词条,一个词条是字符的任意组合。可以把词条想象为单词,也可以使用非单词词条,如URL、IP地址或者任意其他字符串。然后将每一个文本片段表示为一个词条向量,其中值为1表示词条出现在文本中,0表示词条未出现。

以社区的留言板为例。为了不影响社区的发展,我们要屏蔽侮辱性的言论,所以要构建一个快速过滤器,如果发现某条留言使用了负面或者侮辱性的语言,那么就将该留言标识为内容不当。过滤这类内容是一个很常见的需求。对此问题建立两个类别:侮辱性和非侮辱性,使用1和0分别表示。

下面是将文本转换为数字向量的过程,然后基于这些向量来计算条件概率,并在此基础上构建分类器,最后是一些利用Python实现朴素贝叶斯过程中需要考虑的问题。

准备文本:从文本中构建词向量

我们将把文本看成单词向量或者词条向量,也就是说将句子转换成向量。考虑出现在所有文档中的所有单词,再决定将哪些词纳入词汇表或者说所要的词汇集合,然后必须要将每一篇文档转换成词汇表上的向量。

python

def loadDataSet():

postingList=[['my', 'dog', 'has', 'flea', 'problems', 'help', 'please'],

['maybe', 'not', 'take', 'him', 'to', 'dog', 'park', 'stupid'],

['my', 'dalmation', 'is', 'so', 'cute', 'I', 'love', 'him'],

['stop', 'posting', 'stupid', 'worthless', 'garbage'],

['mr', 'licks', 'ate', 'my', 'steak', 'how', 'to', 'stop', 'him'],

['quit', 'buying', 'worthless', 'dog', 'food', 'stupid']]

classVec = [0,1,0,1,0,1] #1 is abusive, 0 not

return postingList,classVec

def createVocabList(dataSet):

#创建一个空集

vocabSet=set([])

for document in dataSet:

#创建两个集合的并集

vocabSet=vocabSet|set(document)

return list(vocabSet)

def setOfWords2Vec(vocabList,inputSet):

#创建一个其中包含元素都是0的向量

returnVec=[0]*len(vocabList)

for word in inputSet:

if word in vocabList:

#如果词汇出现在词汇表中,向量对应值为1,否则为0

returnVec[vocabList.index(word)]=1

else:

print('%s 这个单词不在词汇表中!')

return returnVec上述代码中,第一个函数loadDataSet()创建了一些实验样本。该函数返回的第一个变量是进行词条切割后的文档集合,这些文档来自够累爱好者留言板。这些留言文本被切分成一系列的此条集合,标点符号从文本中去掉。loadDataSet()返回的第二个变量是一个类别标签的集合。这里有两类:侮辱性和非侮辱性。这些文本的类别由人工标注,这些标注信息用于训练程序一遍自动检测侮辱性留言。

createVocabList(dataSet)会创建一个包含在所有文档中出现的不重复词的列表,为此使用了Python的set数据类型。将词条列表输给set构造函数,set就会返回一个不重复词表。

获得词表后,使用setOfWords2Vec(vocabList,inputSet),该函数的输入参数为词汇表及某个文档,输出的是文档向量,向量的每一元素为1或0,分别表示词汇表中的单词在输入文档中是否出现。

观察效果:

python

listOPosts,listClasses=loadDataSet()

myVocabList=createVocabList(listOPosts)

print(myVocabList)

检查词表,可以看到这里没有重复的单词。

看下setOfWords2Vec()效果:

python

print(setOfWords2Vec(myVocabList,listOPosts[0]))

print(setOfWords2Vec(myVocabList,listOPosts[3]))

训练算法:从词向量计算概率

上面是将一组单词转换为数字的过程,接下来看如何使用数字计算概率。

现在已经知道一个词是否出现在一篇文档中,也知道该文档所属的类别,我们就可以计算贝叶斯公式:

我们使用上述公式,对每个类计算该值,然后比较这两个概率值的大小。首先可以通过类别i(侮辱性留言或非侮辱性留言)中文档数除以总的文档数来计算概率。接下来计算

,这里就要用到朴素贝叶斯假设。如果将w展开为一个个独立特征,那么就可以将上述概率写作

。这里假设所有词都相互独立,该假设也称为条件独立性假设,它意味着可以使用

来计算上述概率,这就极大地简化了计算过程。

函数的伪代码如下:

计算每个类别中的文档数目

对每篇训练文档:

对每个类别:

如果词条出现在文档中->增加该词条的计数值

增加所有词条的计数值

对每个类别:

对每个词条:

将该词条的数目除以总词条数目得到条件概率

返回每个类别的条件概率

下面,开始实现上述伪代码:

python

def trainNBO(trainMatrix,trainCategory):

numTrainDocs=len(trainMatrix)

numWords=len(trainMatrix[0])

pAbusive=sum(trainCategory)/float(numTrainDocs)

#初始化概率

p0Num=zeros(numWords)

p1Num=zeros(numWords)

p0Denom=0.0

p1Denom=0.0

#对每篇训练文档

for i in range(numTrainDocs):

#如果词条出现在文档中

if trainCategory[i]==1:

p1Num=p1Num+trainMatrix[i]

p1Denom=p1Denom+sum(trainMatrix[i])

else:

p0Num=p0Num+trainMatrix[i]

p0Denom=p0Denom+sum(trainMatrix[i])

#对每个元素做除法

p1Vect=p1Num/p1Denom

p0Vect=p0Num/p0Denom

return p0Vect,p1Vect,pAbusive代码函数中的输入参数为文档矩阵trainMatrix以及由每篇文档类别标签所构成的向量trainCategory。首先,计算文档属于侮辱性文档(class=1)的概率,即P(1)。因为这是一个二类分类问题,所以可以通过1-P(1)得到P(0)。对于多分类问题,则需要对代码进行修改。

计算和

,需要初始化程序中的分子变量和分母变量。由于w中元素非常多,因此可以使用NumPy数组快速计算这些值。分母变量是一个元素个数等于词汇表大小的NumPy素组。在gor循环中,要遍历训练集trainMatrix中所有的文档。一旦某个词语(侮辱性或者正常词语)在某一文档出现,则该词对应的个数(p1Num或者p0Num)就加一。而且在所有的文档中,该文档的总次数也相应加一。对于两个类别都要进行同样的处理。

最后,对每个元素除以该类别中的总次数。利用NumPy很好实现,用一个数组除以浮点数即可,最后函数会返回两个向量和一个概率。

运行:

python

listOPosts,listClasses=loadDataSet()

myVocabList=createVocabList(listOPosts)

trainMat=[]

for postinDoc in listOPosts:

trainMat.append(setOfWords2Vec(myVocabList,postinDoc))

p0V,p1V,pAb=trainNBO(trainMat,listClasses)

print(pAb)

print(p0V)

这就是任意文档属于侮辱性文档的概率。

我们发现文档属于侮辱性文档的概率pAb为0.5。下面是给定文档类别条件下词汇表中单词出现的频率。

测试算法:根据现实情况修改分类器

利用贝叶斯 分类器对文档进行分类时,要计算多个概率的乘积以获得文档属于某个类别的概率,即计算。如果其中一个概率值为0,那么最后的乘积也为0.为降低这种影响,可以将所有词的出现初始化为1,并将分母初始化为2.

修改代码:

python

p0Num=ones(numWords)

p1Num=ones(numWords)

p0Denom=2.0

p1Denom=2.0另一个问题是下溢出,这是由于太多很小的数相乘造成的。当计算乘积时,由于大部分因子都非常小,所以程序会下溢出或者得到不正确的答案。一种解决办法是对乘积取自然对数。在代数中有ln(a*b)=ln(a)+ln(b),于是通过求对数可以避免下溢出或者浮点数舍入导致的错误。同时,采用自然对数进行处理不会有任何损失。

修改代码:

python

p1Vect=log(p1Num/p1Denom)

p0Vect=log(p0Num/p0Denom)现在已经准备好构造完整的分类器了。当使用NumPy向量处理功能时,这会十分简单:

python

def classifyNB(vec2Classify,p0Vec,p1Vec,pClass1):

#元素相乘

p1=sum(vec2Classify*p1Vec)+log(pClass1)

p0=sum(vec2Classify*p0Vec)+log(1.0-pClass1)

if p1>p0:

return 1

else:

return 0

def testingNB():

listOPosts,listClasses=loadDataSet()

myVocabList=createVocabList(listOPosts)

trainMat=[]

for postinDoc in listOPosts:

trainMat.append(setOfWords2Vec(myVocabList, postinDoc))

p0V, p1V, pAb = trainNBO(trainMat, listClasses)

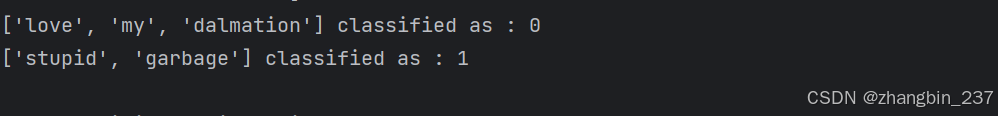

testEntry=['love','my','dalmation']

thisDoc=array(setOfWords2Vec(myVocabList,testEntry))

print(testEntry,'classified as :',classifyNB(thisDoc,p0V,p1V,pAb))

testEntry=['stupid','garbage']

thisDoc=array(setOfWords2Vec(myVocabList,testEntry))

print(testEntry,'classified as :',classifyNB(thisDoc,p0V,p1V,pAb))classifyNB()函数有4个输入参数:要分类的向量vec2Classify,以及使用函数trainNB0()计算得到的三个概率值。使用NumPy的数组来计算两个向量相乘的结果。这里的相乘是指对应元素相乘,即先将两个向量中的第一个元素相乘,然后将第二个元素相乘,以此类推。接下来将词汇表中所有词的对应值相加,然后将该值加到类别的对数概率上。最后,比较类别的概率返回大概率对应的类别标签。

代码的第二个函数是一个便利函数,该函数封装所有操作,以节省时间。

运行结果:

上述例子展示了朴素贝叶斯分类器的工作原理。

准备数据:文档词袋模型

我们将每个词的出现与否作为一个特征,这可以被表述了词集模型 。如果一个词在文档中出现不止一次,这可能意味着包含该词是否出现在文档中所不能表达的某种信息,这种方法被称为词袋模型。在词袋中,每个单词可以出现多次,而在词集中,每个词只能出现一次。为了适应词袋模型,需要对上面的setOfWords2Vec()稍作修改,修改后的函数称为bagOfWords2Vec()。

python

def bagOfWords2Vec(vocabList,inputSet):

#创建一个其中包含元素都是0的向量

returnVec=[0]*len(vocabList)

for word in inputSet:

if word in vocabList:

#如果词汇出现在词汇表中,向量加1

returnVec[vocabList.index(word)]=returnVec[vocabList.index(word)]+1

return returnVec