01 AI OCR的历史及概念

OCR(Optical Character Recognition,光学字符识别)是指采用光学的方式将纸质文档中的文字转换成为黑白点阵的图像文件,通过检测暗、亮的模式确定其形状,然后用字符识别方法将形状翻译成计算机文字的过程。

2012年AlexNet在ImageNet竞赛夺冠以来,深度学习方法开始在图像视频领域大幅超越传统算法,基于CV(计算机视觉)和NLP(自然语言处理)卷积神经网络和基于长短期记忆的方法开始扩张到OCR领域。在AI OCR系统中,人工神经网络主要充当特征提取器和分类器的功能,输入是字符图像,输出是识别结果,且识别率很高,不需要花大量时间去设计字符特征。

OCR处理分为:图像预处理、文本检测(Detection)、文本识别(Recognition)这三大步骤。

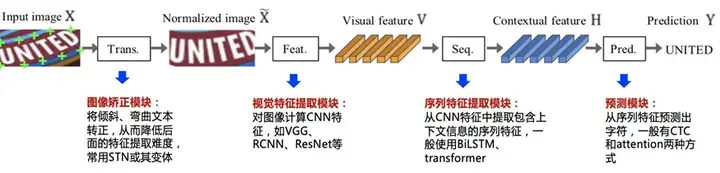

图像预处理,用于对待处理的原始图像进行一些矫正操作,以助于降低后续的检测和识别难度。例如调整图像对比度、旋转对齐、进行局部裁剪、折痕和墨点等干扰信息的淡化等。现有多数深度学习识别算法具体流程包括图像校正、特征提取、序列预测等模块,流程如图所示:

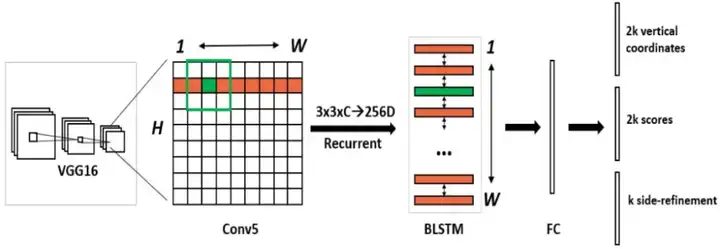

文件检测算法,CTPN是在ECCV 2016提出的一种文字检测算法,是目前流传最广、影响最大的开源文本检测模型,可以检测水平或微斜的文本行。CTPN结合CNN与LSTM深度网络,能有效的检测出复杂场景的横向分布的文字。CTPN模型主要包括三个部分,分别是卷积层、Bi-LSTM层、全连接层,其结构如下图所示:

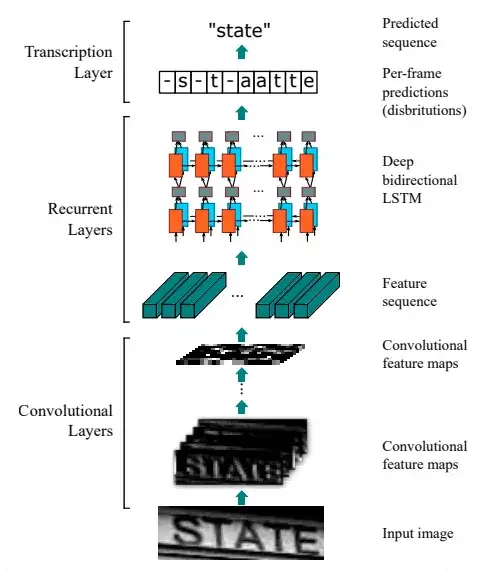

文字识别,使用CRNN网络(循环卷积神经网络)的技术思想是用深度卷积来生成图像基础特征,再使用Bi-LSTM循环网络(双向长短时记忆网络,能吸收上下文语义信息)进行时序特征训练(这一步利用文本序列的前后特征能有效提升效果),最后引入CTC损失函数来实现端对端的不定长序列识别,解决训练时字符无法对齐的问题。CRNN网络结构包含三部分,从下到上依次为:卷积层、循环层、转录层。其结构如下图所示:

02 AI OCR助力企业降本增效

传统财务报销场景下,企业员工在日常差旅报销时,需要手动将火车票、住宿费发票中的金额、坐席等信息录入到系统中。会计再根据员工录入的信息,核验员工职级与报销标准是否匹配。以往手动录入信息的方式需要员工反复核对信息的准确性及完整性,同时审核人员也需要花费大量的时间进行人工校对,极大影响了工作效率。

当前,随着企业新发展阶段需要,使用人工智能等技术助力企业提高效率,降低成本,已成为企业数智化转型的战略方向。

很多企业已开始将银行单证处理、财务发票报销等场景,从原来人工手动处理方式,转换到为使用AI OCR系统处理方式。用户通过前端系统上送图片文件到AI OCR系统,AI OCR系统通过人工智能深度算法模型对非结构化的图片特征检测、识别类型、提取文字、形成结构化数据,再经过智能审核系统查重验真,最后将结果数据发送给前端系统自动填单。使用AI OCR系统,可以极大的提高人工录入准确率、降低过程中的人工错误、极大提高了财务报销场景的处理效率和准确率。

AI OCR系统,大量使用深度学习模型,GPU作为AI算力重要引擎,利用并行计算架构,极大地提升了提高识别准确率和速度,这大大帮助企业实现流程自动化处理、节省人员成本、高效率处理数据信息。

03 AI OCR应用痛点

随着AI OCR技术的大量应用及需求增加,产生了大量算力需求。然而当前的GPU算力资源大多是都是分配给单个项目,存在着大量浪费和运维难题:

- GPU算力资源目前采用物理机模式或单业务系统分配,分配粒度粗、利用率低;

- GPU算力资源分配不灵活,不能有效共享和安全隔离分配算力资源;

- 没有统一GPU算力资源管理平台,平台团队无法及时和周期性掌握GPU资源利用率和任务运行情况;

- GPU算力资源在机柜资源、用电等,生命周期内的综合运营成本非常高;

- 硬件采购流程周期长,不能及时响应业务场景创新需求;新采购的GPU算力资源,都要按照系统需要安装部署、安全加固、定期升级,平台团队工作强度高。

04 GPU池化助力AI OCR技术高效应用

趋动科技致力于为用户提供国际领先的AI算力资源池化解决方案,并将GPU资源池化能力拓展到整个数据中心。

OrionX通过软件定义AI算力,颠覆了原有的AI应用直接调用物理GPU的架构,增加软件层,将AI应用与物理GPU解耦合,通过构建GPU资源池,对资源池中的GPU资源进行统一管理、维护和调配,资源池的大小可以根据系统管理需求而定,比如,可以将数据中心内所有的物理GPU纳入资源池中,也可以将一个GPU服务器作为一个资源池。该架构实现了GPU资源池化,让用户高效、智能、灵活地使用GPU资源,达到了降本增效的目的。

OrionX还支持"隔空取物"功能,即OrionX支持将虚拟机或者容器运行在一台没有物理GPU的服务器上。用户可以通过计算机网络,透明地使用其他服务器上的GPU 资源,且无需修改该虚拟机或者容器内 AI 应用的代码。也是通过这个功能,OrionX 帮助用户实现了数据中心级的 GPU 资源池,实现了AI 应用和 GPU 物理资源的解耦合,AI 应用在一个不满足训练条件的纯 CUP 服务器上,也一样能够快速调集多个 GPU 卡完成训练任务。

05 OrionX创新点及收益

1 改变GPU算力资源使用方式

通过软件定义算力的方式,将传统GPU资源以整卡为单位进行分配,变为以算力1%,显存1MB为基本单位进行资源提供,实现GPU按需分配,整体利用率提升明显。

2 GPU算力资源池化

支持GPU的跨节点调用,AI应用可以部署到数据中心的任意位置,不管所在的节点上有没有GPU。GPU资源供应范围从单个节点扩展到由网络互联起来的整个数据中心,优化管理模式,简化运维操作。

3 GPU资源云化

数据中心内GPU资源按需调用,动态伸缩,用完释放。AI应用可以根据负载需求调用任意大小的GPU,甚至可以聚合多个物理节点的GPU;在容器或虚机创建之后,仍然可以调整虚拟GPU的数量和大小;在AI应用停止的时候,立刻释放GPU资源回到整个GPU资源池,以便于资源高效流转,充分利用。

06 OrionX预期收益

1 提升AI场景效能

通过实现GPU池化,实现让用户共享数据中心内所有服务器上的GPU,大幅提升资源利用率、降低GPU服务器采购成本、机柜密度。AI相关业务人员不必再关心底层资源状况,能够专注于更有价值的业务层面,让应用开发变得更加便捷和简洁。

2 提升AI应用支撑能力

通过GPU资源切分和资源按需分配,AI推理场景下有利于多模型并行,业务运行效率显著提高,在同等AI算力条件下可以支撑数倍业务量的弹性扩展。

3 加速项目周期

GPU资源池化后支持动态秒级分配和回收GPU算力和显存资源,大大提升GPU资源分配效率。同时,AI程序代码无需改动,这可以有效提高项目上线时间。

4 优化GPU算力资源使用方式

通过软件定义算力的方式,将传统GPU资源以整卡为单位进行分配,变为以算力1%,显存1MB为基本单位进行资源提供,实现GPU按需分配,整体利用率提升明显。

5 提升运维管理人效提升

OrionX AI GPU算力资源池化技术提供统一UI管理运维页面。通过管理终端,运维人员可以快速可视化的采集所有GPU服务器和GPU资源的分配情况和运行利用率,且支持定期输出GPU资源池运行报表。资源池化、管理全流程、系统平台级、运维可视化的管理模式,收缩的边界范围,都将加倍提升管理效率。

6 节能减排

归功于OrionX调度引擎的高效轮转,可大幅提升AI应用支撑数量,并由此降低GPU服务器采购成本及相应服务器能源消耗和机房环境能耗成本,减少业务系统总体运营成本,提升投资效能,助力国家2050双碳减排目标实现。

建设AI算力资源池可以更好支持人工智能场景在企业经营数智化升级过程中业务系统创新的敏捷增长,具体表现在提升基础设施利用率、减少设备运行和人员运维的费用、减少重复建设、优化资源配置、提升服务能力等,能有效加速客户在人工智能领域的创新速度!