文章目录

前言

deepseek最近火的一塌糊涂,谁还不知道deepseek感觉就已经是上古时期的人了,趁着有时间我赶紧研究了一下本地部署,deepseek有很多蒸馏版的模型,对硬件要求不是很高,这就让本地部署变成了可能,于是我迫不及待的在我的mac电脑上试了一下,嘿,还挺丝滑。

现在将部署的过程分享如下:

电脑配置:

芯片 Apple M1 pro

内存 16G

macOs Sequoia 版本15.3.1

安装的Deepseek版本:

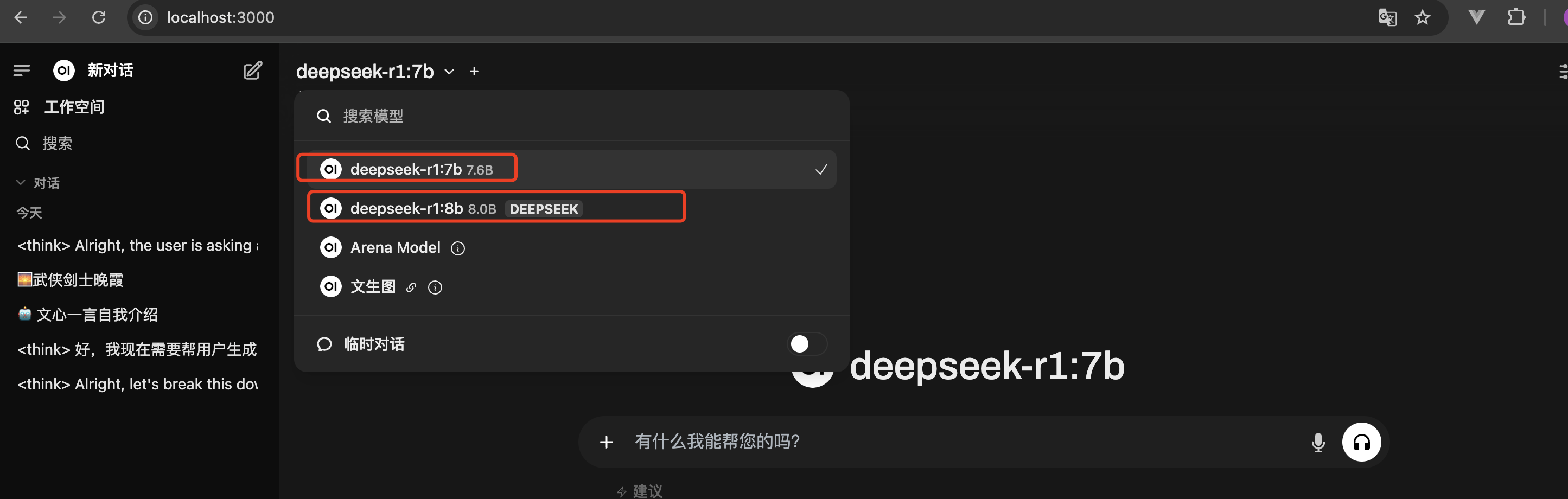

Deepseek-r1:8b(我之前装的是8b版本)

Deepseek-r1:7b(为了演示截图,我再装一个7b版本)

使用的UI框架:

Openwebui(基于docker部署的)

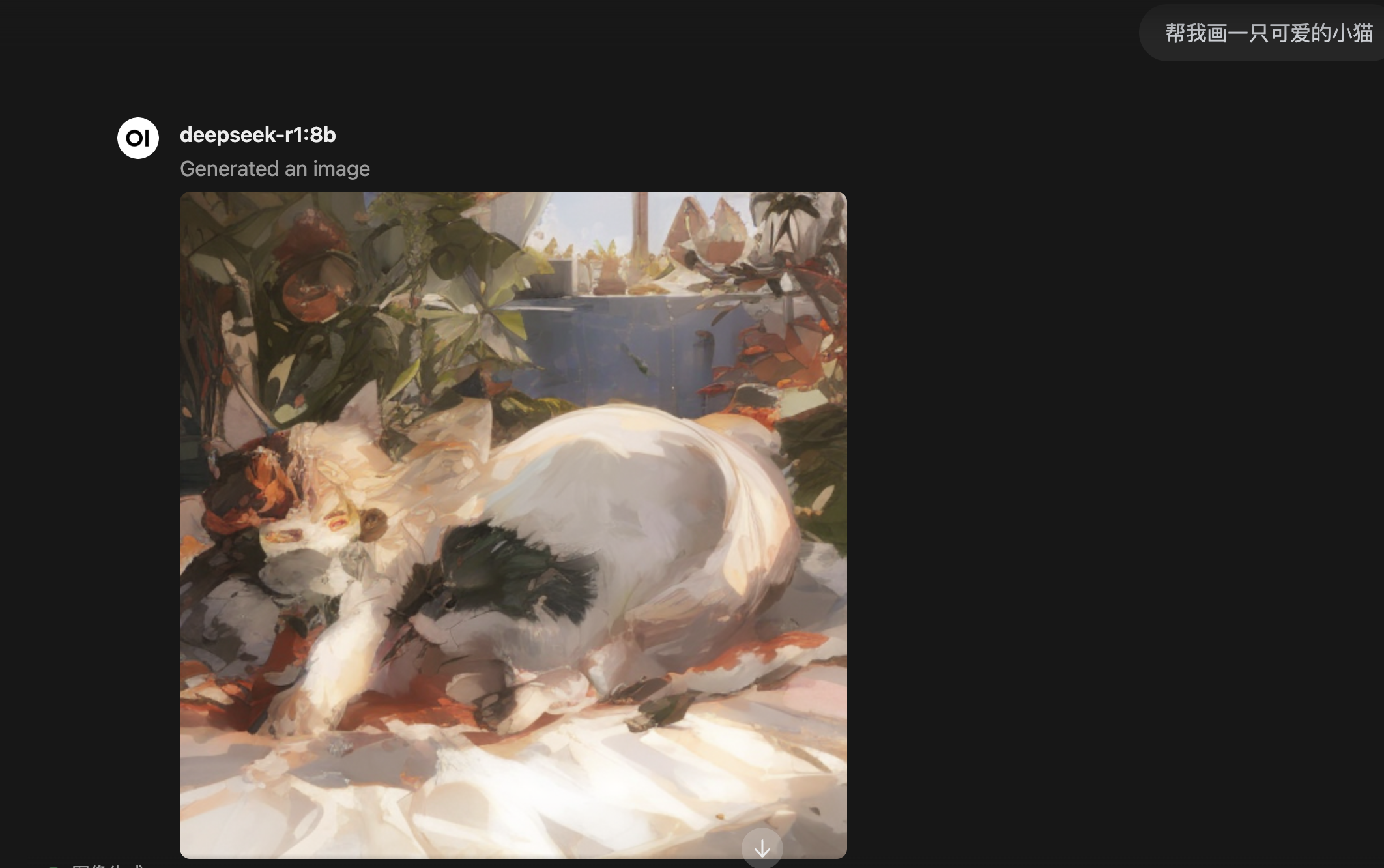

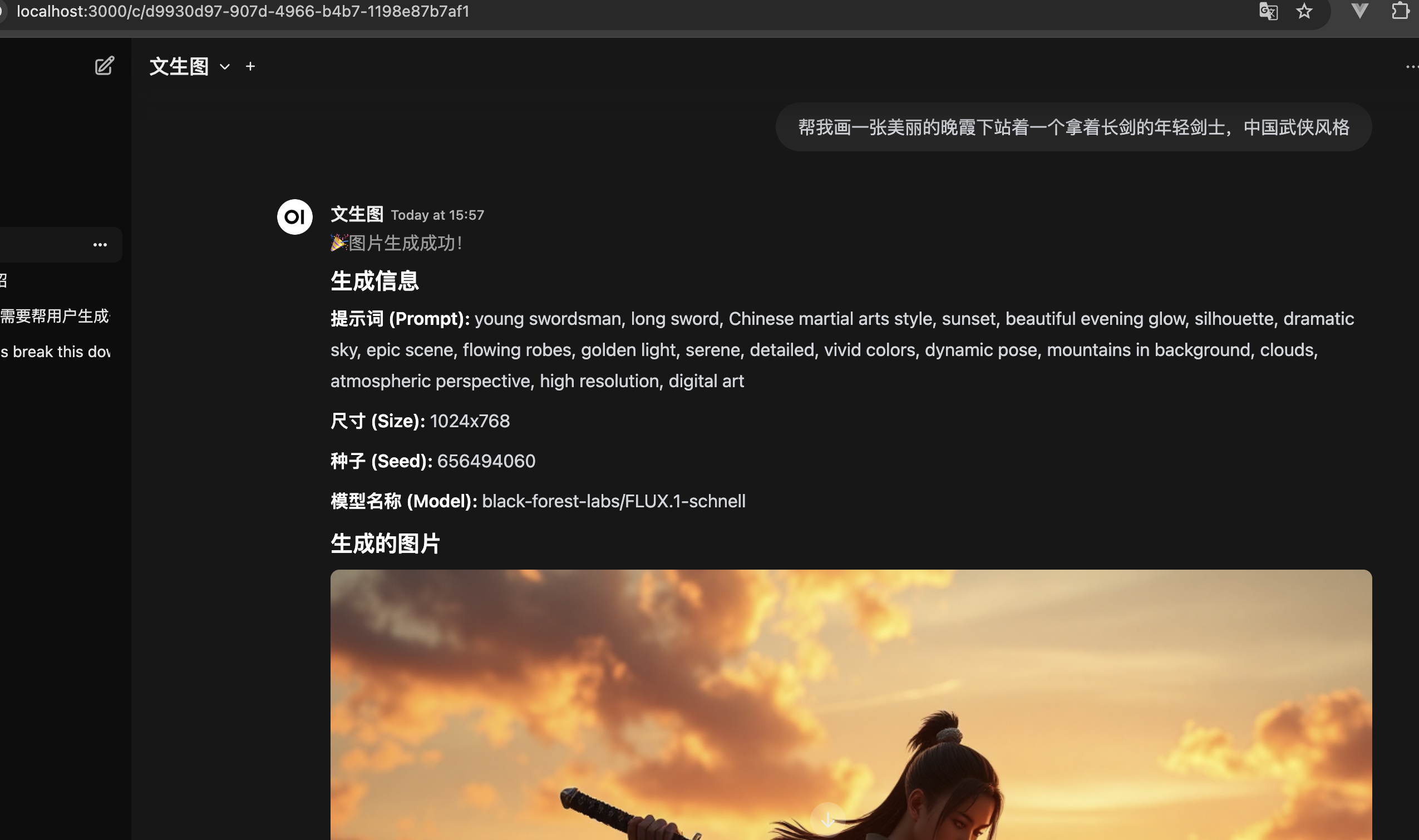

体验效果展示:

整体来说部署到本地是可以玩的,响应的速度也在可以接受的范围内,配合上openwebui,还可以有文生图,联网搜索,调用API接口等玩法。

本地部署体验总结

由于机器配置有限,我仅仅部署了7b的模型,智商非常有限,所以仅限于玩玩了,如果有比较土豪的大佬,部署更大参数的模型,那部署在本地,作为生产力工具也是可以的。

但是真正的处理工作啥的,我建议还是老实用线上版本,毕竟线上是满血版,不是咱们这些小破电脑能跑起来的。

deepseek线上版:https://chat.deepseek.com/

如果老是显示服务器繁忙,也可以找平替,有很多大厂都已经接入了deepseek,响应速度都还非常不错,比如:

腾讯元宝:https://yuanbao.tencent.com/(默认是混元大模型,需要自己手动切换成deepseek-r1)

秘塔AI搜索:https://metaso.cn/

360纳米AI搜索:https://www.n.cn/

部署过程

废话不多说,直接来跟着我一步步进行部署:

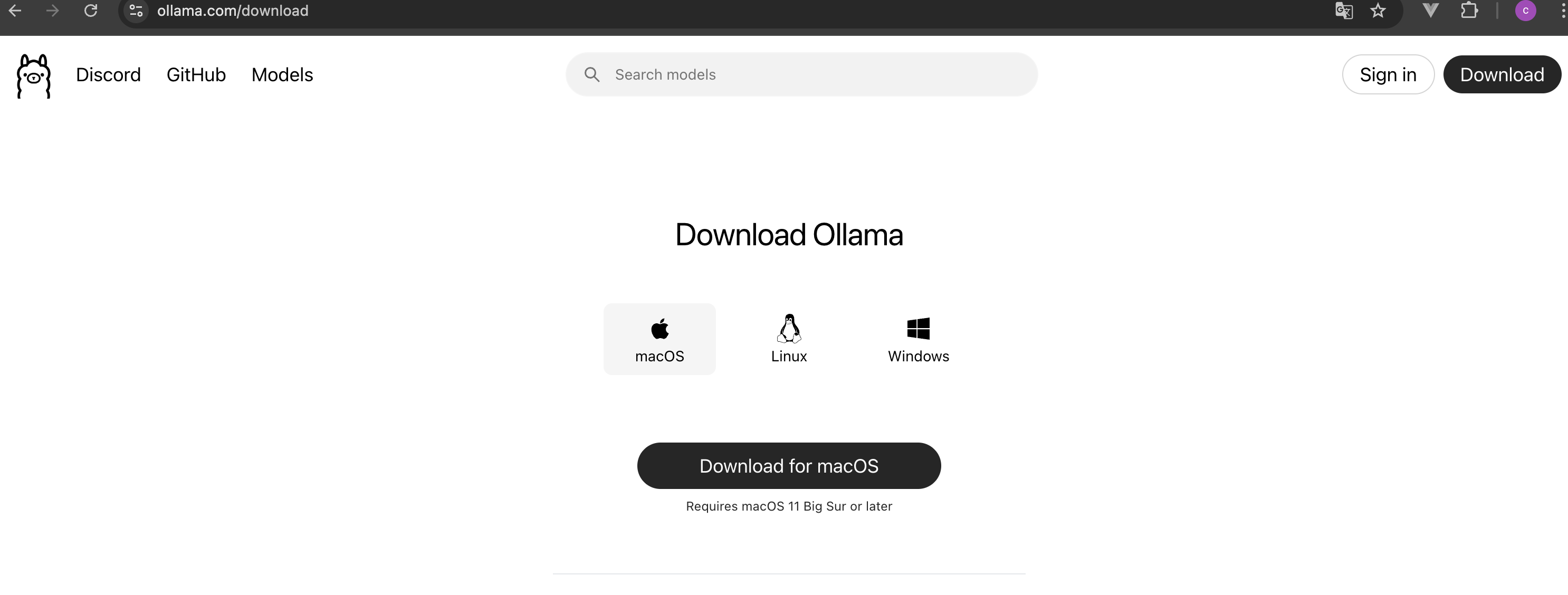

Ollama部署

直接上官网:https://ollama.com/download,然后下载自己电脑适合的版本,安装即可。

下载完成后,解压,然后安装:

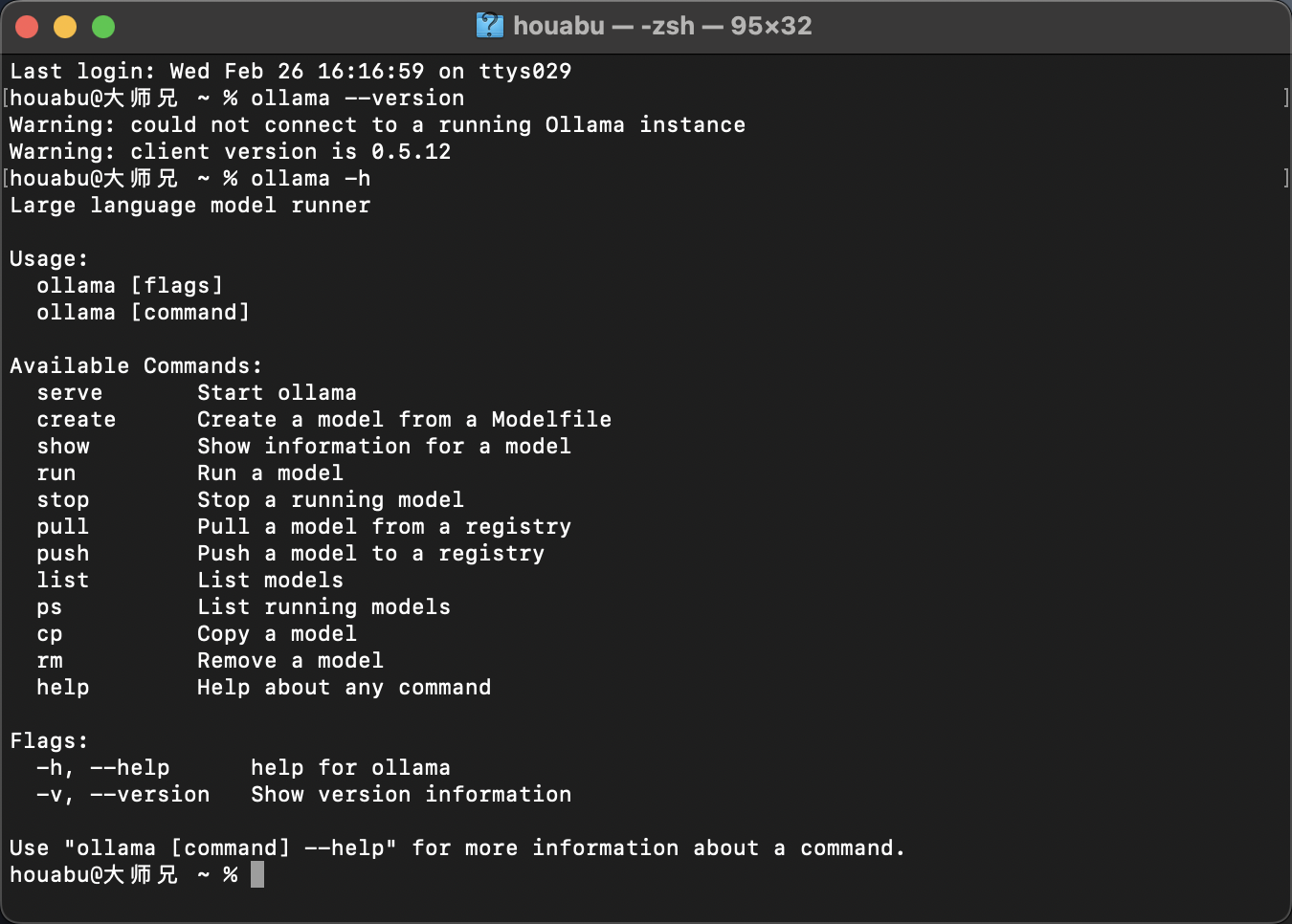

安装成功后,即可在终端进行调用了。

bash

# 查看 Ollama 版本

ollama --version

# Ollama 命令帮助

ollama -h

如此,ollama的安装就搞定了。

接下来我们就来拉取deepseek的模型

拉取模型

bash

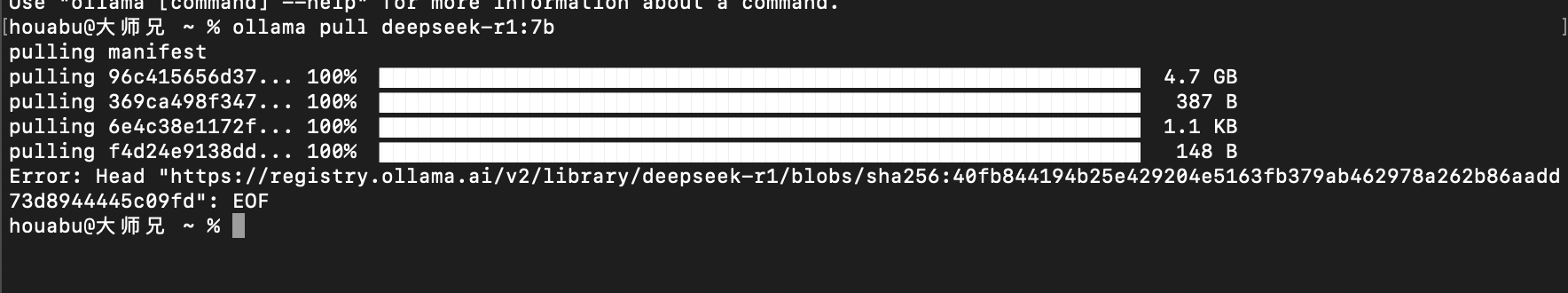

# 拉取模型(我这里用的是先拉取,再运行)

ollama pull deepseek-r1:7b

运行模型

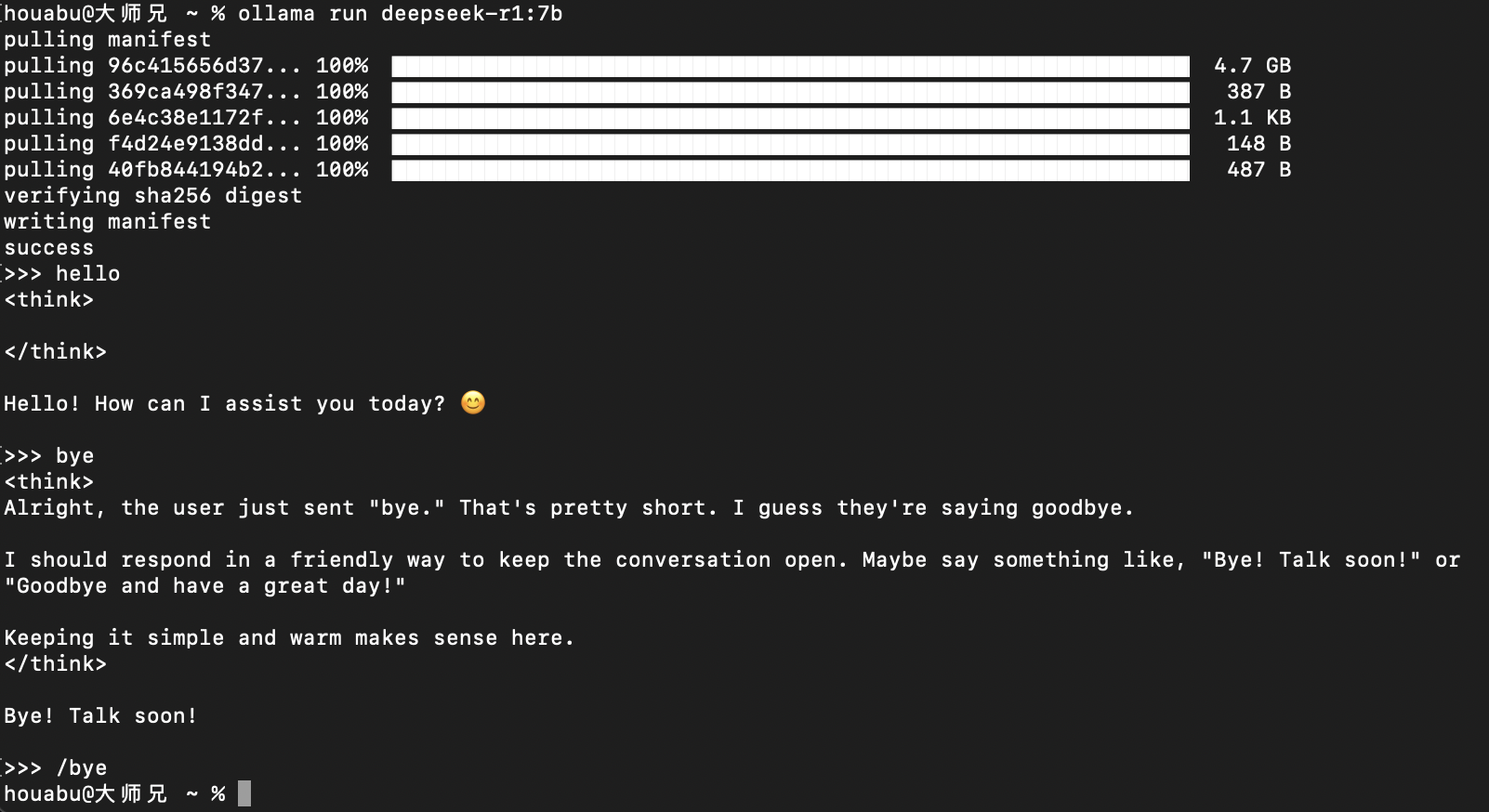

等待拉取结束,运行模型

bash

#运行 deepseek-r1:7b模型

ollama run deepseek-r1:7b

可以看到已经模型已经正常运行了,可以正常进行对话了。输入 /bye 可以结束在终端的对话。

此时已经成功将deepseek-r1:7b模型在本地跑起来了,但是这和别人用的都不太一样,而且在终端对话始终不是那么的方便,那么怎么办呢?

Openwebui部署

接下来就祭出 Openwebui,相对可玩性比较高的一个大语言模型的UI框架,我们来用ollama作为服务端,Openwebui作为前端,部署起来进行访问。

这里我只介绍使用docker进行部署,因为比较方便,其他方式有兴趣的朋友自己研究即可。

什么?电脑没有安装docker?mac电脑安装docker可以说是有手就会,我就不过多介绍了,实在不会的,参考这个教程:https://www.runoob.com/docker/macos-docker-install.html

docker安装成功后,我们来使用docker安装Openwebui

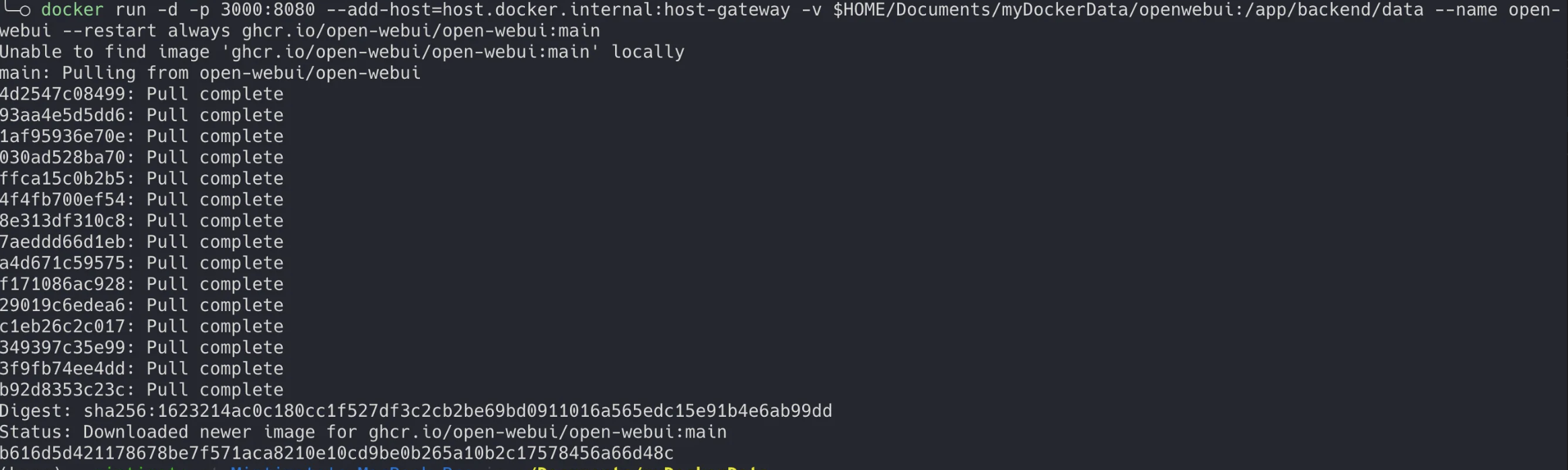

bash

# 拉取镜像并映射端口运行

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v $HOME/Documents/myDockerData/openwebui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

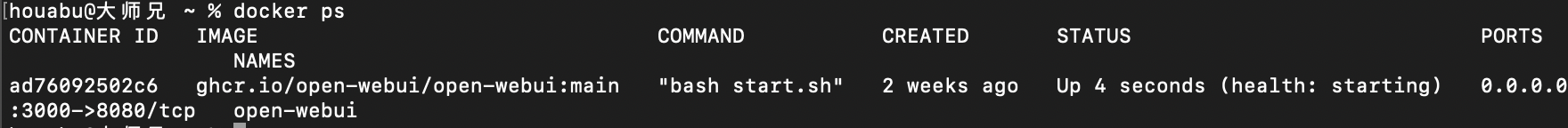

可以看到 已经拉取镜像成功,并且端口映射好,而且启动起来了

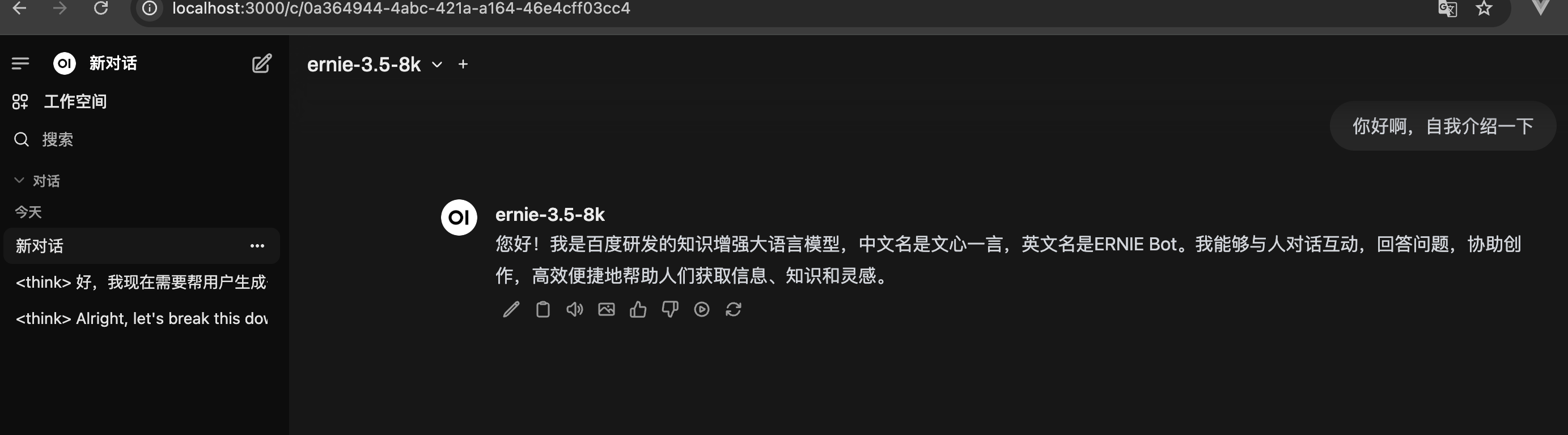

此时访问 http://localhost:3000/ 就可以进入到Openwebui的界面了。

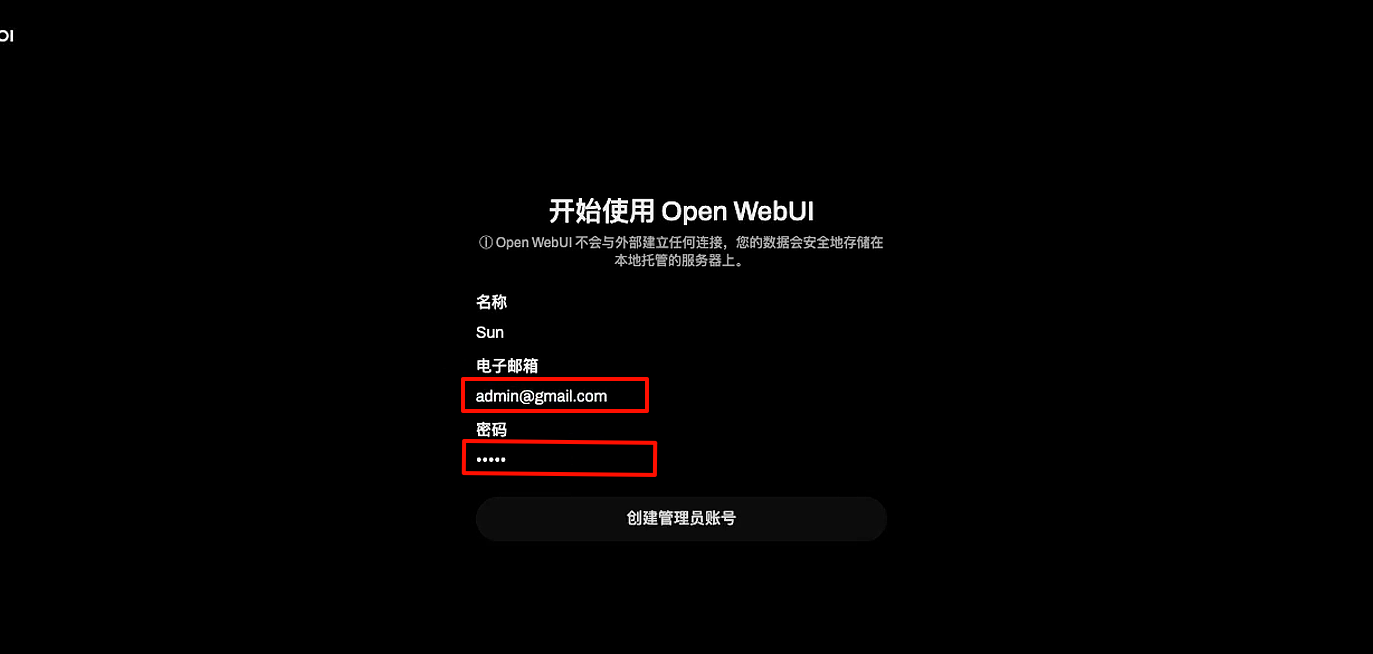

首次进入可能需要稍微等待几分钟,然后就会出来界面,

点击开始使用,然后进行注册,登录即可使用。首次注册的账号即为管理员账号。

运行Ollama服务

我们需要使用Ollama作为后端,提供API接口的服务,所以需要将这个服务启动起来。

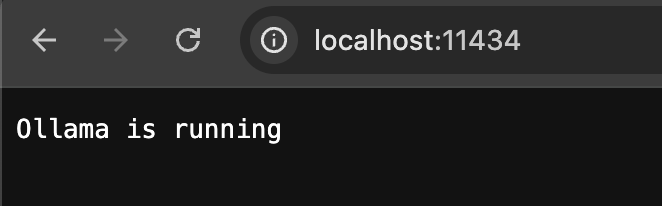

bash

#启动ollama服务,默认监听端口是11434

ollama serve访问http://localhost:11434/可以看到服务是否启动成功:

显示Ollama is running 说明服务已经成功启动了。

在Openwebui中配置ollama的服务

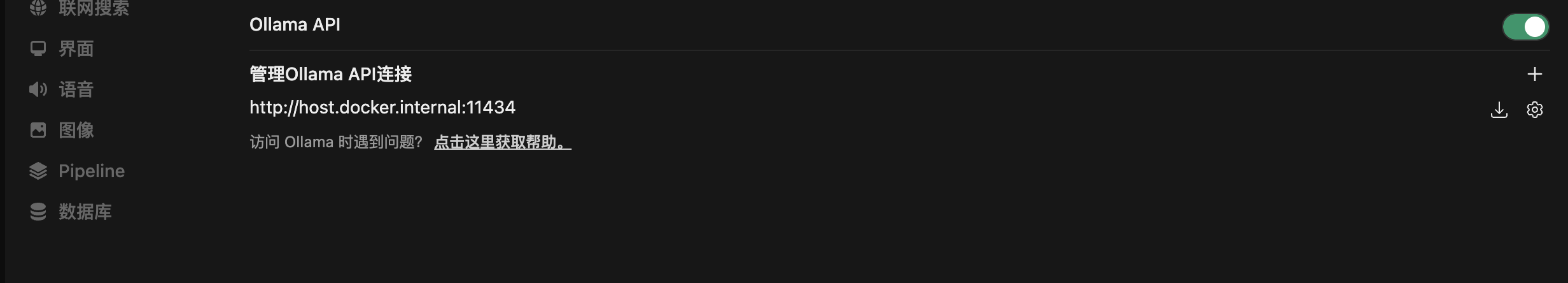

在个人头像-设置-管理员面板-外部连接页面,打开Ollama API的开关,填写API的地址:http://host.docker.internal:11434

注意:由于此处是在docker中进行运行的Openwebui,但是ollama是在本地直接运行的,所以配置到这里必须这样配置才可以生效,如果配置为localhost:3000 是不起作用的。

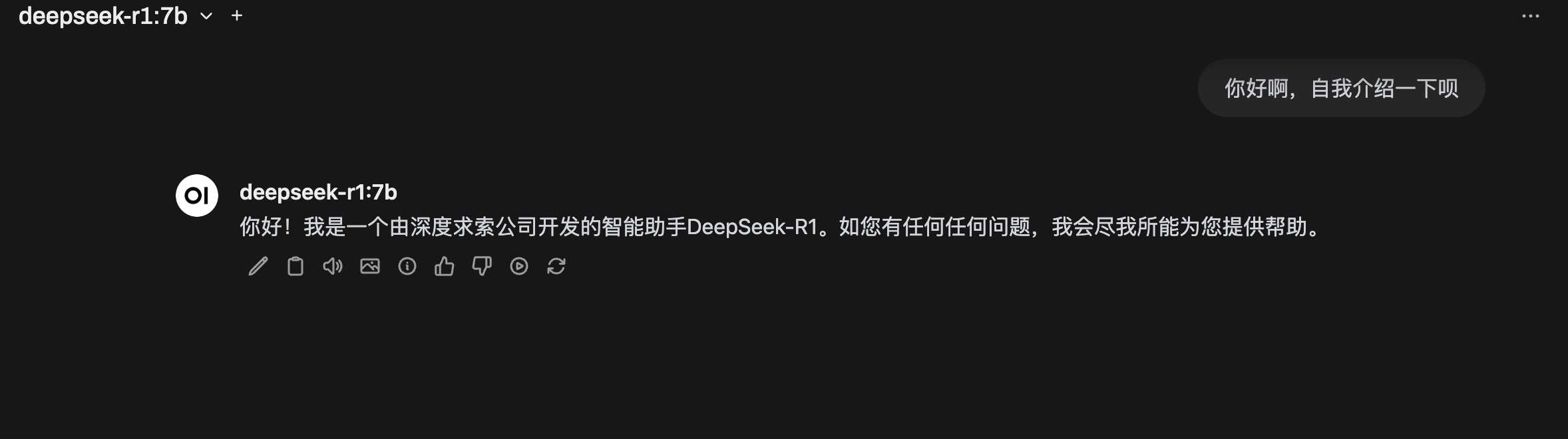

配置完成之后,就可以测试聊天了。

选择相应的模型,然后直接开始对话即可。

至此,大功告成!你已经可以在本地运行大模型,并且可以使用网页进行对话了。

后话

至于文章开始展示的集成本地文生图模型、调用api文生图功能,或者调用api接口chat,以及调用联网搜索功能的这些分支,还需要再逐一进行讲解。

如果你有以上某方面的需要,请在评论区进行留言,我将视情况再做后续的文章更新。

感谢各位大佬的观看~ 下期再见~