AI图像生成是一个非常有趣且前沿的领域,结合了深度学习和计算机视觉技术。以下是一些使用Python和相关库进行AI图像生成的创意和实现思路:

1. 使用GAN(生成对抗网络)

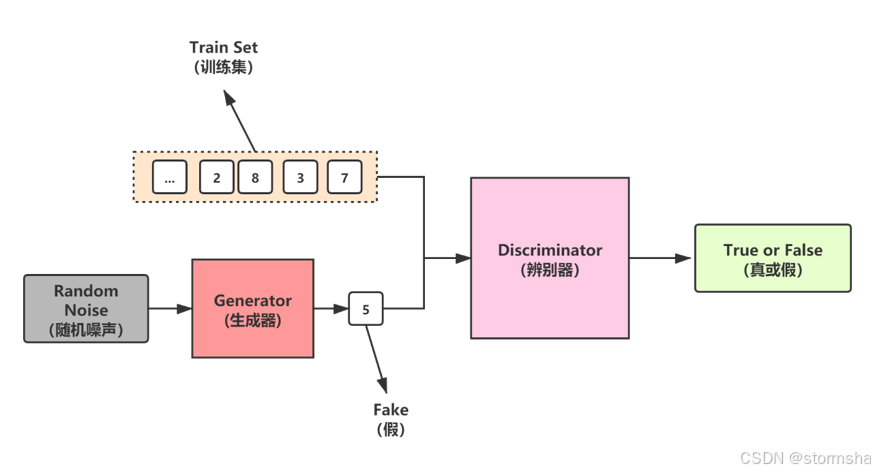

基本概念:GAN由两个神经网络组成:生成器和判别器。生成器尝试生成逼真的图像,而判别器则试图区分真实图像和生成图像。

实现步骤:

-

安装必要的库:

bashpip install tensorflow keras matplotlib -

训练一个简单的GAN模型。例如,可以使用MNIST数据集来生成手写数字。

-

代码示例:

pythonimport numpy as np import matplotlib.pyplot as plt from keras.datasets import mnist from keras.models import Sequential from keras.layers import Dense, Reshape, Flatten, Dropout from keras.optimizers import Adam # 加载数据集 (X_train, _), (_, _) = mnist.load_data() X_train = X_train / 255.0 X_train = X_train.reshape(X_train.shape[0], 784) # 将图片展平 # 创建生成器 def create_generator(): model = Sequential() model.add(Dense(256, input_dim=100, activation='relu')) model.add(Dense(512, activation='relu')) model.add(Dense(1024, activation='relu')) model.add(Dense(784, activation='sigmoid')) model.add(Reshape((28, 28))) return model # 创建判别器 def create_discriminator(): model = Sequential() model.add(Flatten(input_shape=(28, 28))) model.add(Dense(512, activation='relu')) model.add(Dropout(0.3)) model.add(Dense(256, activation='relu')) model.add(Dense(1, activation='sigmoid')) return model # 构建GAN generator = create_generator() discriminator = create_discriminator() discriminator.compile(loss='binary_crossentropy', optimizer=Adam(), metrics=['accuracy']) discriminator.trainable = False gan_input = Input(shape=(100,)) generated_image = generator(gan_input) gan_output = discriminator(generated_image) gan = Model(gan_input, gan_output) gan.compile(loss='binary_crossentropy', optimizer=Adam()) # 训练GAN for epoch in range(10000): noise = np.random.normal(0, 1, size=[128, 100]) generated_images = generator.predict(noise) X_fake_vs_real = np.concatenate([generated_images, X_train[:128]]) y1 = np.zeros(128) # 假数据 y2 = np.ones(128) # 真实数据 y_combined = np.concatenate([y1, y2]) discriminator.trainable = True d_loss = discriminator.train_on_batch(X_fake_vs_real, y_combined) noise = np.random.normal(0, 1, size=[128, 100]) y_mislabeled = np.ones(128) # 将所有的假图像标记为真实 discriminator.trainable = False g_loss = gan.train_on_batch(noise, y_mislabeled) if epoch % 1000 == 0: print(f"Epoch {epoch}, D Loss: {d_loss[0]}, G Loss: {g_loss}") # 生成图像 noise = np.random.normal(0, 1, size=[25, 100]) generated_images = generator.predict(noise) plt.figure(figsize=(10, 10)) for i in range(25): plt.subplot(5, 5, i + 1) plt.imshow(generated_images[i], cmap='gray') plt.axis('off') plt.show()

2. 使用预训练的模型

基本概念:可以使用像StyleGAN、BigGAN或DALL-E这样的预训练模型,直接生成高质量的图像。

实现步骤:

-

使用Hugging Face的Transformers库加载预训练模型。

-

安装必要的库:

bashpip install transformers torch torchvision -

代码示例(使用DALL-E):

pythonfrom transformers import DallEProcessor, DallETokenizer, DallEModel import torch # 加载模型和处理器 processor = DallEProcessor.from_pretrained("dalle-mini/dalle-mini") model = DallEModel.from_pretrained("dalle-mini/dalle-mini") # 生成图像 text = "A futuristic city skyline" inputs = processor(text, return_tensors="pt") outputs = model.generate(**inputs) # 显示结果 image = outputs.images[0] image.show()

3. 图像风格迁移

基本概念:通过将一幅图像的风格应用到另一幅图像上,生成新的艺术作品。

实现步骤:

-

使用TensorFlow或PyTorch实现风格迁移。

-

代码示例(使用TensorFlow):

pythonimport tensorflow as tf import matplotlib.pyplot as plt # 加载内容图像和风格图像 content_image = load_image("content.jpg") style_image = load_image("style.jpg") # 使用预训练的VGG模型进行风格迁移 model = tf.keras.applications.VGG19(include_top=False, weights='imagenet') # 定义风格和内容层 content_layers = ['block5_conv2'] style_layers = ['block1_conv1', 'block2_conv1', 'block3_conv1', 'block4_conv1', 'block5_conv1'] # 风格迁移函数 def style_transfer(content, style): # 进行风格迁移的步骤 # ... return generated_image generated_image = style_transfer(content_image, style_image) # 显示结果 plt.imshow(generated_image) plt.axis('off') plt.show()

总结

以上是一些使用Python进行AI图像生成的创意与实现方法。这些项目既可以作为学习深度学习的实践,也可以作为开发创意图像生成应用的基础。希望这些想法能激发你的创造力,帮助你在AI图像生成领域探索更多可能性!