- Arxiv日期:2024.9.25

关键词

-

长度泛化

-

transformer结构优化

核心结论

-

RASP-L限制transformer无法处理包含循环的任务的长度泛化

-

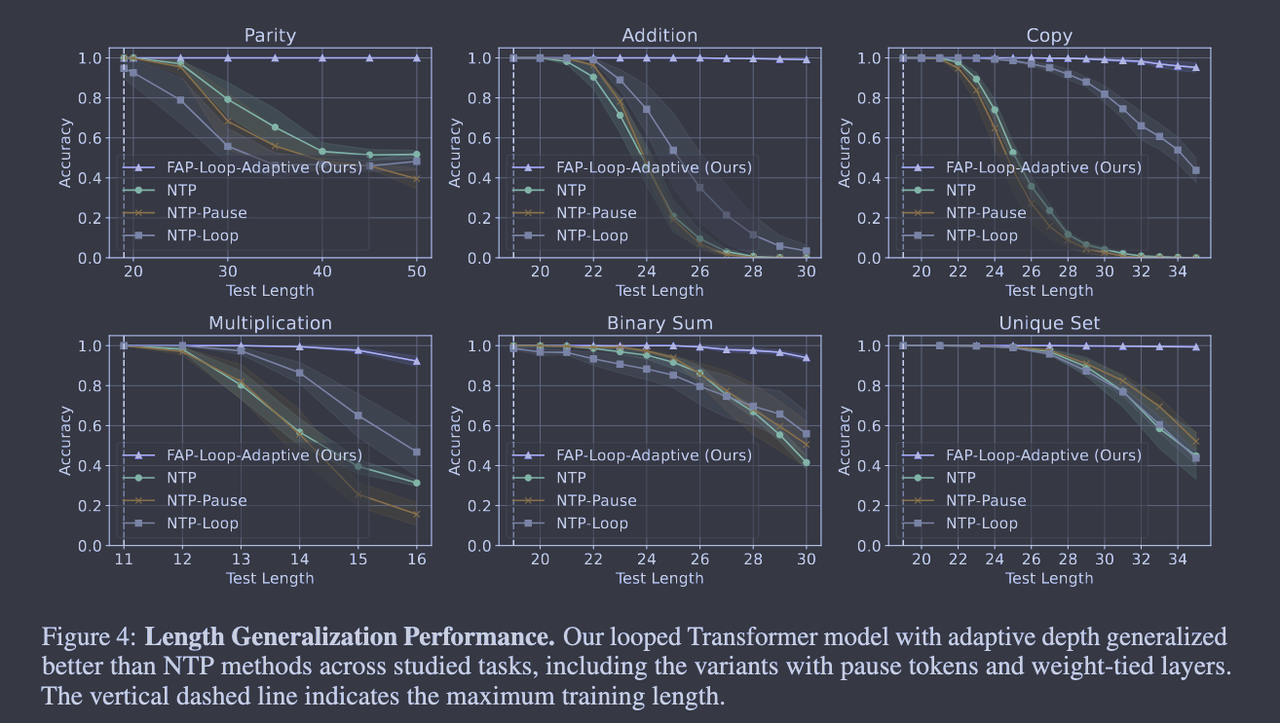

Loop Transformer显著提升了长度泛化能力

-

Input Injection显著提升了模型的长度泛化性能,尤其在二进制加法等复杂任务上效果显著

-

在推理中,通过输出置信度判断迭代停止点的策略能够实现接近最佳的性能

主要方法

Transformer在长度泛化(length generalization)上表现有限,尤其是对未见长度的输入。本文重点研究解决这一问题的Loop Transformer架构(Looped Transformers),通过循环处理增加模型对输入长度的适应能力。

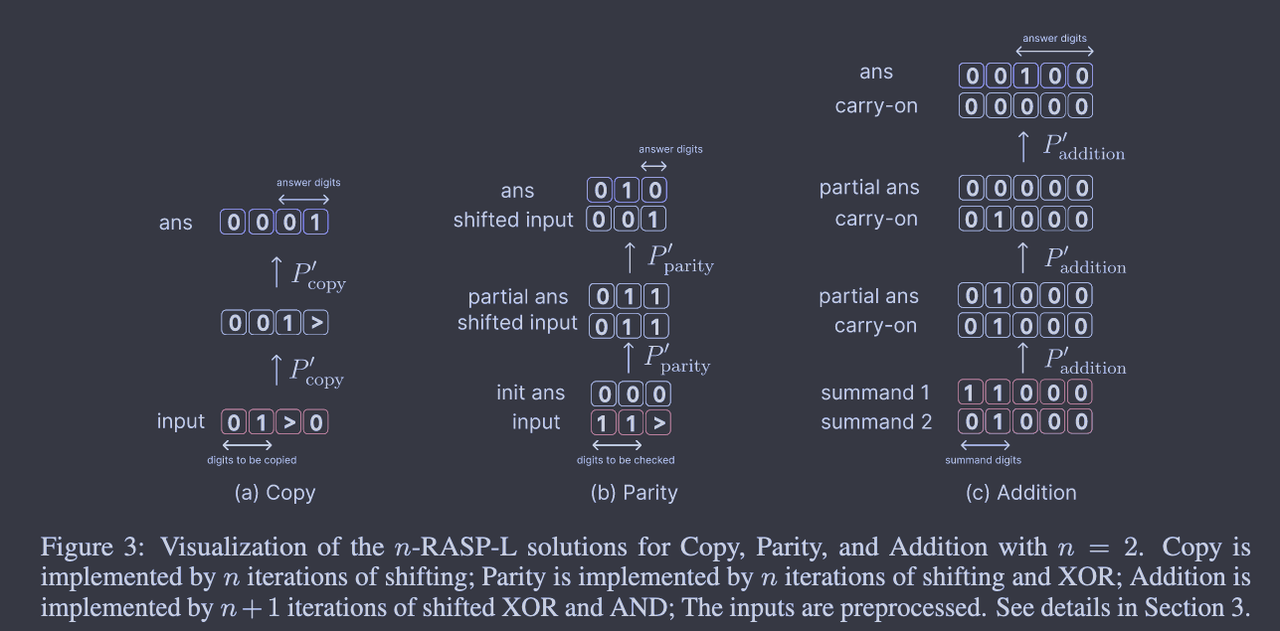

n-RASP-L问题 :(=n循环RASP-L问 题)定义了一类任务,这些任务可以通过多次迭代应用某些基础操作(RASP-L操作)来解决。这些任务包括复制、求和、二进制加法等。

本质上是将内部无法处理的循环替换到外部,做到"n次transformer"

注:本系列不包括基础的知识点讲解,为笔记/大纲性质而非教程,用于论文知识点和思想和快速记忆和回顾,更多细节建议阅读论文原文