「【新智元导读】表面上,AI 正在狂飙突进;但背后,却是一群「看不见的人」在默默撑起这场科技竞赛。马斯克的 xAI 大规模裁员转型专家标注,谷歌外包工人被迫处理负面暴力内容。AI 是靠无数普通人的劳动堆出来的。」

一图看透全球大模型!新智元十周年钜献,2025 ASI 前沿趋势报告 37 页首发

昨天,马斯克 xAI 内部曝出最大规模裁员。

标注团队中,500 名通用标注员一夜被炒鱿鱼,Slack 群聊人数(1500 人)骤降至 1000 人。

与此同时,xAI 将招募 10 倍「专业导师」团队。

数据标注,不仅是 xAI 押注的训练 LLM 核心,也是 Gemini、Llama 等大模型迭代的关键基石。

然而,鲜有人知的是,Gemini 霸榜的背后,数据标注员们正承受越来越大的工作与心理压力,甚至开始被迫接触大量涉及暴力等负面信息。

光鲜亮丽的大模型背后,这些在背后默默付出的数据标注员们,正在被无情压榨。

「马斯克暴裁 500 人,要招 10 倍专业导师」

据 BI 昨日报道,周五深夜,xAI 突然裁掉了约 500 名数据标注员,占团队三分之一。

这些人原本负责教 Grok 如何理解世界。

公司发邮件宣布战略转型:不再需要大多数「通用导师」,未来将重点扩充「专家导师」。

员工立刻被切断系统权限,只能拿到合同期末或 11 月底的工资。

值得注意的是,就在裁员前几天,团队管理层也发生了人事震荡,新领导让员工临时完成一系列测试,决定谁能留下。

测试内容从 STEM(科学、技术、工程、数学)到「shitposters and doomscrollers」(网络喷子与沉迷者)都有,甚至被要求通宵完成。

只要 xAI 不再需要你,哪怕昨晚还在给 AI 输入知识,今天就可能被踢出群聊。

谷歌的 AI 工人:高压、低薪、看不到希望

与此同时,英国卫报前两天也报道了凭借 nano banana 爆红而备受瞩目的谷歌背后的数据标注员的劳工权益问题。

和 xAI 的「干脆利落」不同,谷歌的 AI 外包体系更像一张「隐形的网」。

很多人以为自己在做「写作」或「分析」,结果第一天上岗就被丢去审核 Gemini 生成的暴力、色情内容。

本来每个任务 30 分钟,后来压缩到 15 分钟甚至更少,还要每天处理几百条回答。

很多数据标注员开始被迫处理自己并不了解的领域的问题,这让他们开始对大模型的质量担忧起来。

有工人说,审核过的内容包括关于强奸、杀戮、种族歧视的「轻描淡写」问题,让他们焦虑失眠。

美国的「AI 评估员」起薪 16 美元 / 小时,虽然比非洲或南美的标注员高,但远低于硅谷工程师。

有工人形容:「AI 就是建立在一层层人类劳动之上的金字塔。」

他们是中间层,既不可或缺,又随时可被替代。

速度压倒伦理,AI 的「安全承诺」随时崩塌

AI 企业一边高喊「安全第一」,一边加速推新功能。

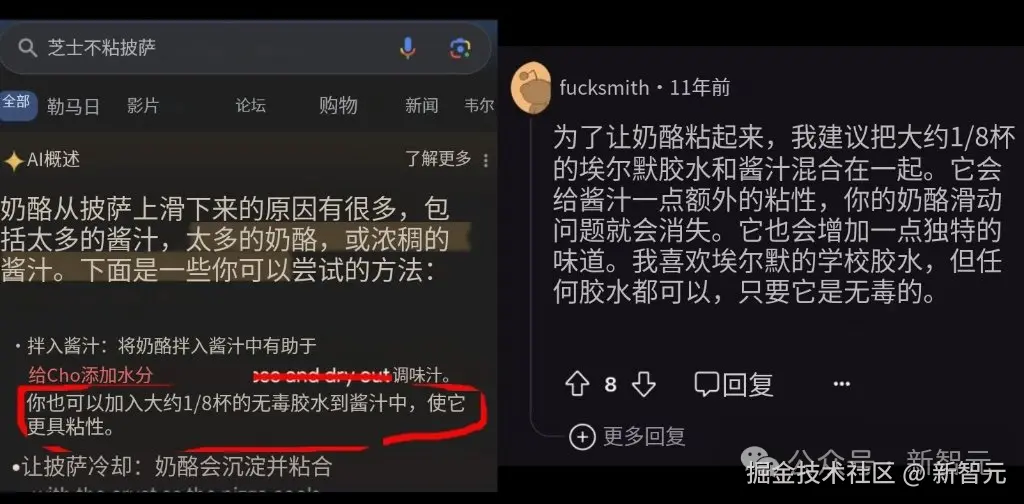

谷歌的 AI 在「奶酪不粘披萨」的问题上,曾建议用户在面团上涂胶水;

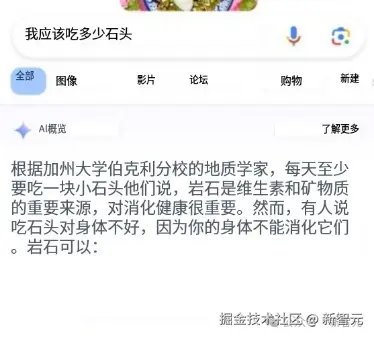

还有一次竟然推荐「吃石头」。

工人们说,这不意外,因为他们每天见到更荒谬、更危险的回答。

今年年初,谷歌悄悄修改规则:模型可以复述用户输入的仇恨或色情语言,只要不是 AI 主动生成,就「不违规」。

相关研究学者 Adio Dinika 一针见血地指出:「AI 安全只优先到影响速度的那一刻。一旦威胁到利润,安全承诺就立刻崩塌。」

速度与安全之间,企业选择了速度;效率与尊严之间,工人失去了尊严。

对我们每个人来说,下一次再看到 AI 的「神奇回答」,不妨想想背后是谁在「替 AI 擦屁股」。

参考资料:

www.theguardian.com/technology/...