本文较长,建议点赞收藏。更多AI大模型应用开发学习视频及资料,在智泊AI。

一、什么是 Dify?

Dify 是一个开源的 LLM(大语言模型)应用开发平台,由 LangGenius 团队开发。它提供可视化界面,支持:

- 连接本地或云端的大模型(如 ChatGLM、Qwen、Llama 等)

- 构建基于知识库的问答系统(RAG)

- 设计对话流程与提示词(Prompt)

- 集成 API 对外提供服务

- 多用户协作与权限管理

无论你是开发者、产品经理,还是业务人员,都能通过 Dify 快速实现 AI 落地。

二、为什么选择本地部署?

虽然 Dify 也提供 SaaS 服务,但本地部署有三大优势:

-

数据安全

敏感数据不出内网,符合企业合规要求。

-

成本可控

长期使用无需支付订阅费用。

-

高度定制

可自由修改源码、集成内部系统。

尤其适合金融、医疗、政务等对数据隐私要求极高的行业。

三、本地部署 Dify(Docker 方式)

3.1 安装docker

1、确认自己的电脑是windows 专业版。

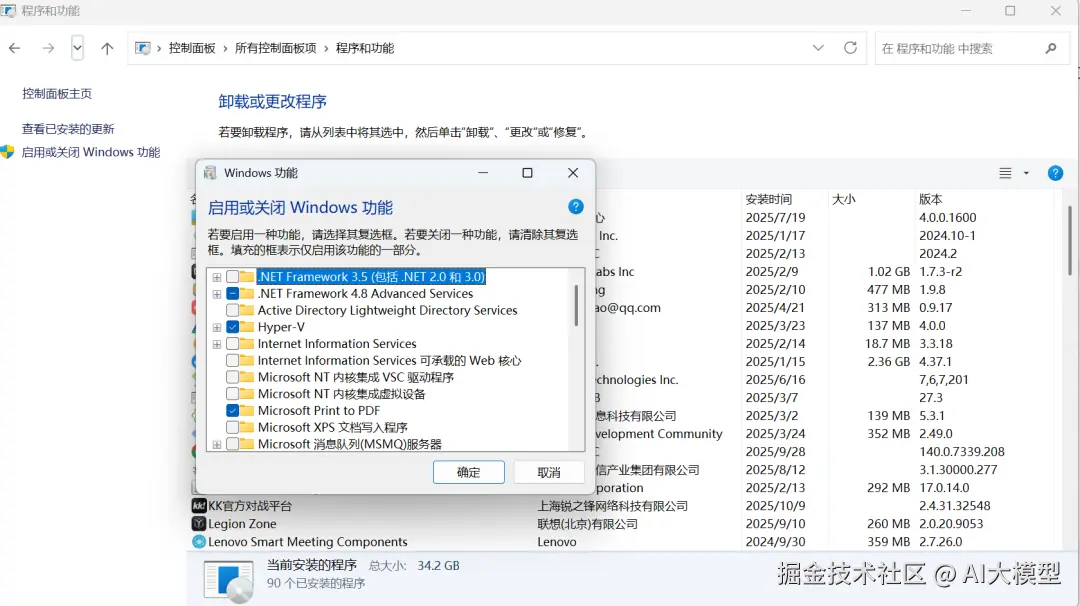

2、打开控制面板,点击启用或关闭windows功能,并依次打开Hyper-V、适用于Linux的Windows子系统。重启电脑生效。

3、安装wsl。根据下面的链接安装wsl,完成后即可开始安装Docker Desktop

learn.microsoft.com/zh-cn/windo...。

4、安装Docker Desktop。下载相应的Docker,右键安装即可。

www.docker.com/

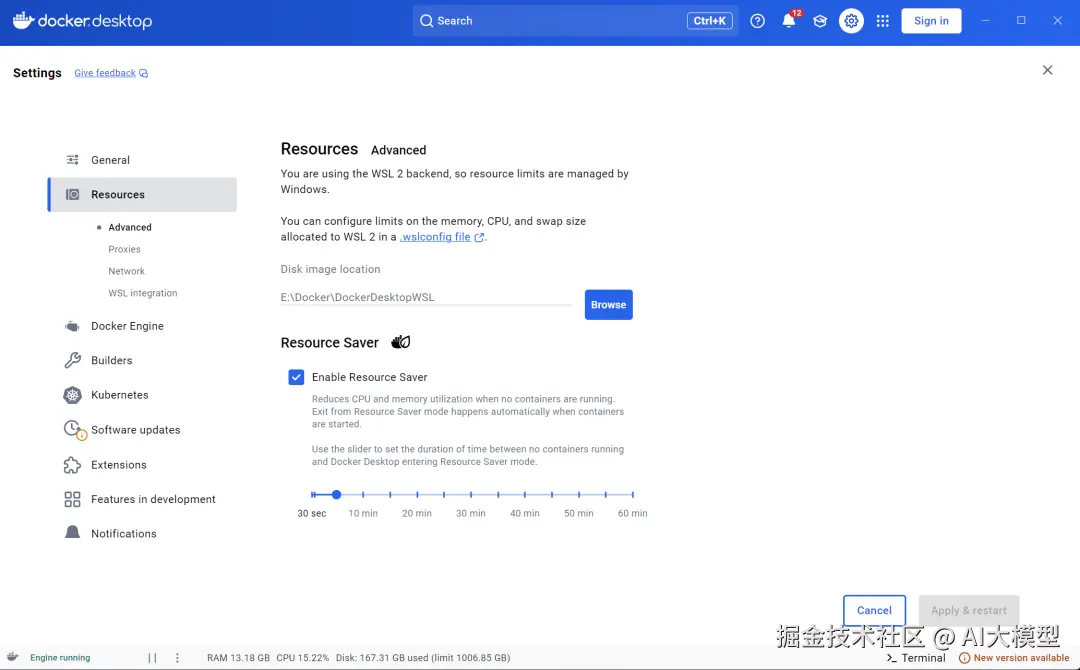

5、修改Docker镜像存储位置。修改完重启Docker即可。

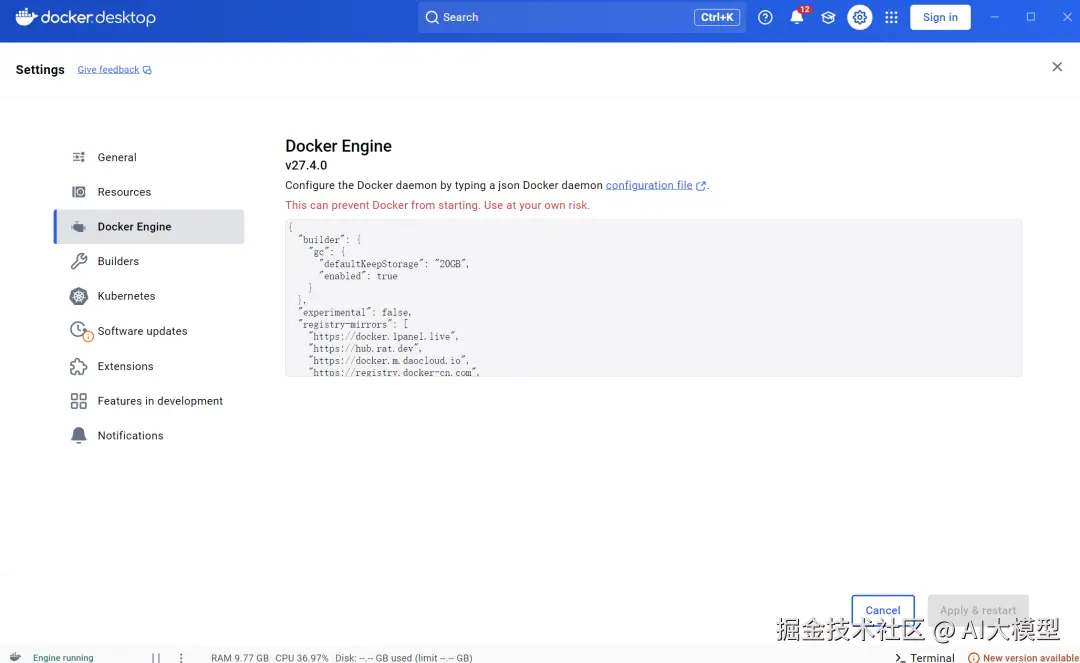

6、更改Docker Engine,换成国内镜像。

json

{

"builder": {

"gc": {

"defaultKeepStorage": "20GB",

"enabled": true

}

},

"experimental": false,

"registry-mirrors": [

"https://docker.1panel.live",

"https://hub.rat.dev",

"https://docker.m.daocloud.io",

"https://registry.docker-cn.com",

"https://cr.console.aliyun.com",

"https://mirror.ccs.tencentyun.com"

]

}

3.2 启动dify

1、下载dify源码。

github.com/langgenius/...

2、Docker启动

bash

cd dify

cd docker

cp .env.example .env

docker compose up -d3、访问 http://localhost/install 即可

学习资源推荐

如果你想更深入地学习大模型,以下是一些非常有价值的学习资源,这些资源将帮助你从不同角度学习大模型,提升你的实践能力。

本文较长,建议点赞收藏。更多AI大模型应用开发学习视频及资料,在智泊AI。