在图像卷积操作中,当卷积计算结果超过 255(或低于 0,因为像素值通常在 0-255 的整数范围,对应 8 位图像)时,需要通过特定策略处理,以确保结果能正确表示为有效的像素值。常见的处理方法如下:

1. 截断(Clamping)

- 原理:直接将超出范围的数值 "截断" 到有效区间内,即:

-

- 若结果 > 255,强制设为 255;

-

- 若结果 < 0,强制设为 0。

- 优点:简单高效,计算成本低,适用于对动态范围要求不高的场景(如平滑滤波、简单边缘检测)。

- 缺点:可能丢失超出范围的细节(如强边缘的对比度),导致图像信息损失。

2. 线性归一化(Normalization)

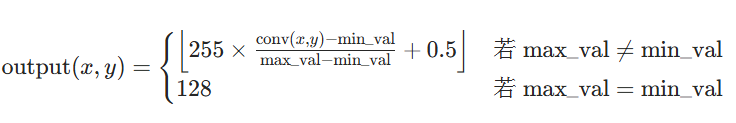

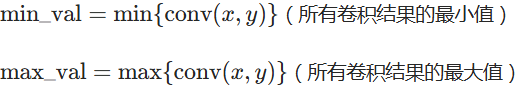

- 原理:将卷积结果的动态范围(从最小值min_val到最大值max_val)线性映射到 0-255 区间,公式为:

- 优点:保留了卷积结果的相对差异,避免信息丢失,适用于结果动态范围较大的场景(如复杂特征提取、边缘增强)。

- 缺点:需要先计算所有卷积结果的min_val和max_val,增加了额外计算;若结果分布极端(如少数值过大),可能导致整体对比度失真。

3. 卷积核预归一化

- 原理:在设计卷积核时,通过调整权重确保卷积结果天然落在 0-255 范围内。例如:

-

- 对均值滤波核,将每个权重除以核的总面积(如 3x3 核除以 9),避免结果累加后过大;

-

- 对边缘检测核(如 Sobel),通过调整权重比例(如总和为 0 或较小值),减少超出范围的概率。

- 优点:从源头避免数值溢出,无需后续处理,适用于已知核功能的场景。

- 缺点:仅适用于固定功能的卷积核,灵活性较低。

4. 非线性映射

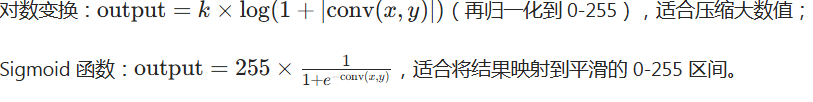

- 原理:通过非线性函数(如对数变换、Sigmoid 函数)压缩数值范围。例如:

- 优点:可根据需求调整映射曲线,增强特定范围内的细节。

- 缺点:计算复杂,且可能引入非线性失真,需根据场景设计函数。

选择原则

- 若追求效率且允许少量信息损失,优先用截断;

- 若需保留完整动态范围,优先用线性归一化;

- 若卷积核功能固定(如平滑、模糊),优先用核预归一化;

- 若需增强特定特征(如微弱边缘),可尝试非线性映射。

实际应用中,需根据卷积的目的(如滤波、特征提取、边缘检测)和图像特性选择合适的方法。