在三维重建领域,从二维图像中恢复真实场景的三维结构始终面临维度缺失、信息歧义与噪声干扰等核心挑战。传统基于几何的方法虽技术成熟,但在实时性与复杂场景处理上存在明显局限,而主流神经渲染技术在稀疏视角输入下易产生伪影与结构模糊。

据了解,微美全息(NASDAQ:WIMI)眼下正在研究多视图三维重建算法,通过创新网络架构设计与优化策略,旨在实现重建精度、效率与泛化能力的三重突破,为智能制造、医疗影像、元宇宙等领域提供核心技术支撑。

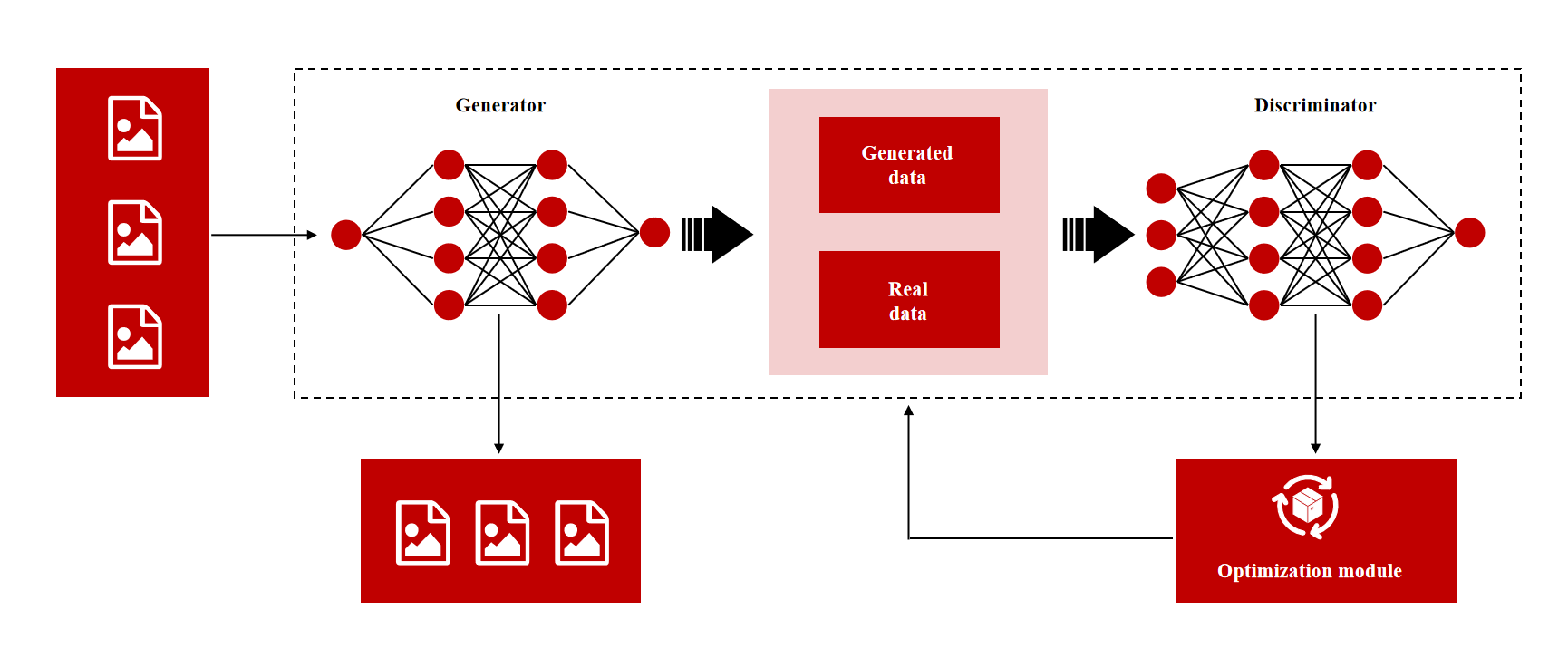

目前,微美全息研究的多视图三维重建算法以生成对抗网络(GAN)的对抗学习机制为核心,创新性融合卷积神经网络(CNN)与变分自编码器(VAE)的技术优势,构建了从数据处理到三维生成的全流程优化架构,有效解决了传统方法数据依赖强、鲁棒性不足的问题。

在数据准备阶段,采用真实采集与合成增强的双轨数据构建策略。一方面通过多相机阵列同步采集不同视角的RGB图像与深度图,结合相机内参标定与外参校准确保数据精度;

另一方面基于物理引擎模拟复杂光照与遮挡场景,生成大规模带标注的合成数据集,解决了真实场景数据采集成本高、场景覆盖不全的难题。相较于传统单一数据源方案,该策略使训练数据的场景多样性大幅提升,模型对极端视角与复杂光照的适应性显著增强。

生成器网络作为算法核心,采用"VAE编码-CNN生成-分层解码"的三段式架构。前端VAE模块负责从多视图图像中提取全局语义特征与局部细节特征,通过隐空间映射实现特征维度压缩与关键信息保留;中间层采用改进型卷积结构,引入跨视角注意力机制,有效融合不同视角的几何约束信息,解决了传统对视角一致性建模不足的问题;后端解码模块支持体素网格与点云双格式输出,满足不同应用场景的精度需求。

判别器网络设计上,摒弃传统单一判别结构,创新采用多尺度几何判别与一致性校验的双判别机制。几何判别分支通过CNN提取生成三维模型的深度图、法向量图等几何特征,与真实模型特征进行比对,判别分支则通过神经渲染技术生成虚拟视角图像,校验其与真实图像的颜色、纹理一致性。双判别机制的引入使模型对几何畸变与纹理失真的识别准确率大幅提升,为对抗训练提供更精准的梯度信号。

针对生成对抗网络训练不稳定、复杂场景重建精度低等行业共性问题,微美全息通过三大创新策略构建高效训练体系,实现了模型性能的跨越式提升。在对抗训练机制上,引入优化器与动态权重调整策略,使模型在各训练阶段均能实现精准优化。

而针对稀疏视角与复杂场景的重建难题,微美全息借鉴扩散模型的图像修复能力,创新提出伪视图生成与三维蒸馏的增强模块。在后处理优化环节,进行了自适应降噪与特征增强等技术处理。

总之,微美全息研究的基于生成对抗网络的多视图三维重建技术凭借突出的性能优势,已在医疗影像、工业制造及元宇宙内容创作等多个行业领域展现出广阔的应用前景,将成为推动行业数字化转型的核心动力。未来,微美全息将持续深化GAN与量子计算的技术融合,进一步突破重建效率与精度的边界,为三维数字化产业发展注入新动能。