在视觉 SLAM(同步定位与地图构建)领域,单目 SLAM 因仅依赖单摄像头输入、硬件成本低且适用场景广泛,成为最基础但极具挑战性的研究方向。长期以来,研究者们致力于实现单目 SLAM 的近照片级重建保真度,这一目标的达成将为空间人工智能、机器人技术等领域带来革命性突破。

传统 SLAM 方法往往依赖多种 3D 表示形式的组合,或在跟踪、建图、渲染等核心模块采用不同的技术路径,导致系统复杂度高、一致性难以保证。而近年来在离线场景重建中大放异彩的 3D 高斯溅射(3D Gaussian Splatting, 3DGS)技术,以其高效的渲染速度和优异的重建保真度,为解决这一问题提供了新的思路。

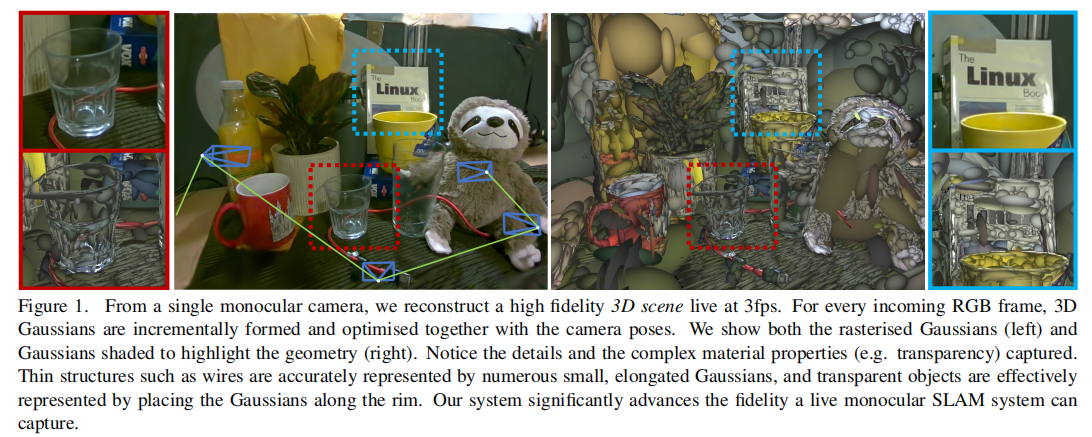

本文将详细精读《Gaussian Splatting SLAM》这篇开创性论文,该论文首次将 3D 高斯溅射技术应用于单目 SLAM,实现了以 3fps 实时运行的高保真场景重建系统。

原文链接:2312.06741

沐小含持续分享前沿算法论文,欢迎关注...

一、论文核心贡献

论文的核心贡献可概括为以下三点,这也是其区别于传统 SLAM 方法的关键创新点:

-

首个基于 3DGS 的实时单目 SLAM 系统:首次将 3D 高斯溅射作为唯一的 3D 场景表示形式,统一了跟踪、建图、渲染等 SLAM 核心模块,无需依赖预训练深度预测器或其他跟踪模块,仅通过 RGB 图像输入即可实现高保真重建,同时支持 RGB-D 输入的无缝扩展。

-

SLAM 框架内的关键技术创新:

- 提出了基于李群的解析雅可比矩阵,实现了直接相机位姿估计,确保位姿优化的高效性和鲁棒性;

- 引入高斯各向同性形状正则化,解决了增量重建中的几何一致性问题;

- 设计了几何验证和高斯资源分配与剪枝策略,保证了地图的清洁度和跟踪精度。

-

全面的实验验证:在单目和 RGB-D 两种设置下,通过多个真实和合成数据集进行了广泛评估,证明了系统在相机轨迹估计、新颖视图合成等任务上的最先进性能,尤其在真实场景中表现突出。

二、相关工作回顾

为更好地理解论文的技术定位,我们首先回顾 SLAM 领域的相关工作,重点对比不同 3D 表示形式和技术路径的优缺点。

2.1 稠密 SLAM 方法分类

稠密 SLAM 致力于重建详细的 3D 地图,区别于仅注重位姿估计的稀疏 SLAM,其生成的交互式地图可广泛应用于增强现实(AR)、机器人导航等场景。根据地图表示形式,稠密 SLAM 主要分为两类:

| 类型 | 核心思想 | 代表方法 | 优点 | 缺点 |

|---|---|---|---|---|

| 帧中心型(Frame-centric) | 最小化连续帧间的光度误差,联合估计每帧深度和相机运动 | DeepFactors、DROID-SLAM | 效率高,适合长会话 SLAM | 缺乏全局一致性,需额外拼接才能形成全局地图 |

| 地图中心型(Map-centric) | 采用统一的 3D 表示形式,通过与重建的全局一致地图对齐实现跟踪 | ElasticFusion、iMAP | 系统紧凑,全局一致性好 | 依赖高效的 3D 表示和渲染技术 |

传统地图中心型方法的 3D 表示形式各有局限:

- 体素网格(Voxel Grids):3D 特征查找快,但内存消耗大,分辨率固定,难以灵活调整;

- 网格(Meshes):拓扑结构复杂,融合新信息难度大;

- 点云 / 面元云(Point/Surfel Clouds):不连续,融合和优化困难;

- 神经场(Neural Fields):需逐像素光线投射,渲染成本高。

2.2 可微渲染技术

可微渲染是实现端到端 SLAM 优化的关键技术,其核心是通过可微的渲染过程,为相机位姿和地图参数提供梯度信息,从而实现联合优化。

- 神经辐射场(NeRF):采用多层感知机(MLP)表示场景,通过体积渲染实现高保真视图合成,但训练速度慢,逐像素光线投射导致渲染效率极低,难以满足 SLAM 实时性要求;

- 显式体积结构:如多分辨率体素网格、哈希编码等,减少了 MLP 的依赖,提升了渲染速度,但仍未解决光线投射的瓶颈;

- 3D 高斯溅射(3DGS):通过迭代高斯基元而非光线投射实现可微光栅化,利用 3D 场景的稀疏性,在保证高保真重建的同时,实现了 1080p 分辨率下 200fps 的渲染速度,为实时 SLAM 提供了可能。

2.3 3DGS 的现有应用

此前,3DGS 仅用于离线场景重建,且需要已知相机位姿(通常由离线运动恢复结构(SfM)系统提供)。部分工作将其扩展到动态场景捕获、3D 生成等任务,但均未涉及在线 SLAM 的核心挑战 ------ 实时相机位姿估计与增量地图构建的联合优化。

三、核心技术细节

论文的技术框架围绕 3D 高斯溅射这一核心表示形式展开,通过三大关键模块(高斯溅射表示、相机位姿优化、SLAM 系统集成)实现实时高保真重建。

3.1 高斯溅射表示(Gaussian Splatting Representation)

论文采用各向异性高斯集合  作为场景的唯一 3D 表示形式,每个高斯

作为场景的唯一 3D 表示形式,每个高斯  包含以下参数:

包含以下参数:

- 光学参数:颜色

、不透明度

;

- 几何参数:世界坐标系下的均值

(位置)和协方差

(位置)和协方差 (椭球形状)。

(椭球形状)。

为简化计算,论文暂时忽略了表示视角相关辐射度的球谐函数(SHs),并在补充材料中提供了相关消融实验。

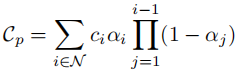

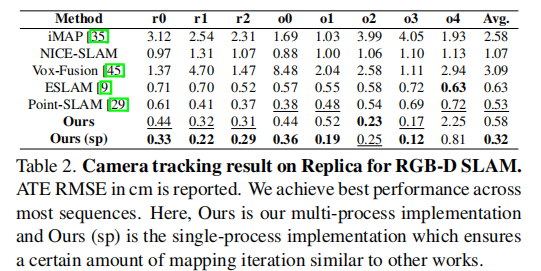

3.1.1 像素颜色合成

通过对 个高斯进行溅射和混合,合成图像像素颜色

:

:

其中, 是对该像素有贡献的高斯集合,乘积项表示前

个高斯未完全遮挡当前高斯的概率,体现了高斯的可见性排序。

3.1.2 3D 到 2D 的投影变换

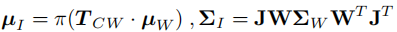

世界坐标系下的 3D 高斯  通过投影变换转换为图像平面上的 2D 高斯

通过投影变换转换为图像平面上的 2D 高斯  ,变换关系如下:

,变换关系如下:

其中:

为投影操作;

为相机位姿(从世界坐标系到相机坐标系的变换);

为相机位姿(从世界坐标系到相机坐标系的变换);是投影变换线性近似的雅可比矩阵;

是

的旋转分量。

这一变换使得 3D 高斯具有可微性,混合操作能够为高斯参数提供梯度流,通过一阶梯度下降(Adam 优化器),高斯的光学和几何参数可逐步优化,以高保真度表示场景。

3.2 相机位姿优化(Camera Pose Optimization)

相机位姿估计是 SLAM 的核心任务之一,论文为实现高效准确的位姿优化,提出了基于李群的解析雅可比矩阵推导,避免了自动微分的 overhead,确保了实时性。

3.2.1 优化目标

为实现准确跟踪,每帧通常需要至少 50 次梯度下降迭代,这要求表示形式具备高效的视图合成和梯度计算能力 ------3DGS 的快速可微渲染恰好满足这一需求。

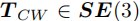

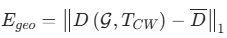

在单目设置下,优化目标为光度残差最小化:

其中, 是从位姿

是从位姿 渲染的图像,

是观测图像。

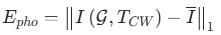

在 RGB-D 设置下,联合优化光度残差和几何残差:

其中,几何残差定义为渲染深度与观测深度的L1距离:

为平衡两个残差的超参数。

为平衡两个残差的超参数。

3.2.2 深度渲染

与颜色合成类似,像素深度  通过不透明度混合计算:

通过不透明度混合计算:

其中, 是高斯均值

沿相机光线的距离。

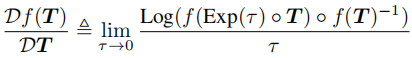

3.2.3 李群上的解析雅可比矩阵

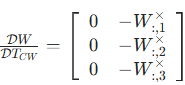

论文首次推导了SE(3)相机位姿相对于 3D 高斯地图的解析雅可比矩阵,这是实现直接位姿优化的关键。

利用李代数推导最小参数化的雅可比矩阵,避免冗余计算。定义流形上的偏导数:

其中,∘为群运算,Exp和Log分别是李代数与李群之间的指数映射和对数映射。

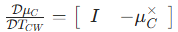

最终得到两个核心雅可比矩阵:

-

相机坐标系下高斯均值

相对于位姿

的雅可比:

其中,×表示 3D 向量的反对称矩阵。

-

旋转分量

相对于位姿

的雅可比:

其中,

表示矩阵

表示矩阵 的第

列。

这些雅可比矩阵被无缝集成到现有的可微光栅化流水线中,实现了相机位姿与场景几何的联合优化。

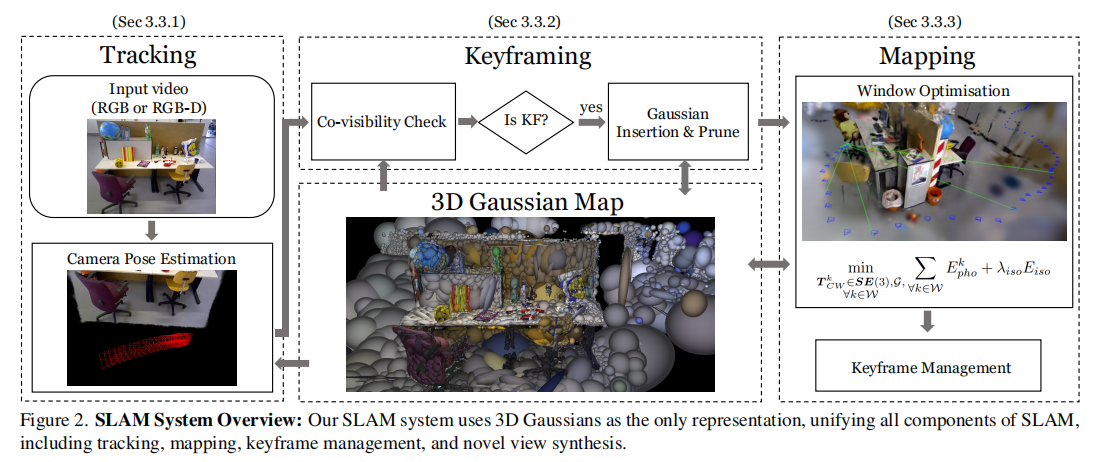

3.3 SLAM 系统框架

论文设计的 SLAM 系统统一了跟踪、关键帧管理、建图等核心模块,系统概述如图 2 所示。

3.3.1 跟踪模块(Tracking)

跟踪阶段仅优化当前相机位姿,不更新地图表示,以保证实时性。

- 单目设置 :最小化光度残差

,同时优化仿射亮度参数以适应曝光变化,并对非边缘或低不透明度像素进行惩罚;

- RGB-D 设置:联合优化光度残差和几何残差,利用深度观测提升位姿估计精度;

- 位姿优化通过前文推导的解析雅可比矩阵实现,确保每帧 50 次迭代下的高效计算。

3.3.2 关键帧管理(Keyframing)

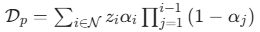

由于无法在线联合优化视频流中的所有图像,系统维护一个由关键帧组成的小窗口  ,关键帧的选择基于帧间共视性,以保证多视图约束的有效性。

,关键帧的选择基于帧间共视性,以保证多视图约束的有效性。

(1)关键帧选择与管理

每帧跟踪后,通过以下标准判断是否成为关键帧:

- 共视性阈值:当前帧与最后一个关键帧的观测高斯交集 - over - 并集(IOU)低于阈值;

- 相对平移阈值:当前帧与最后一个关键帧的相对平移相对于中值深度较大。

为保证效率,参考 DSO 的关键帧管理策略,当关键帧与最新关键帧的重叠系数低于阈值时,将其从窗口中移除。

(2)高斯共视性估计

3D 高斯沿相机光线的排序特性自然处理了遮挡问题,简化了共视性估计:

- 若高斯在光栅化过程中被使用,且光线累积不透明度未达到 0.5,则标记为该视图可见;

- 共视性通过可见高斯的交集和并集计算,无需额外的遮挡处理启发式方法。

(3)高斯插入与剪枝

-

插入策略:每个关键帧插入新高斯以捕获新可见场景元素和细节:

- RGB-D 设置:通过深度反投影初始化高斯均值

;

- 单目设置:渲染当前帧深度,对有深度估计的像素,在对应深度附近以低方差初始化

;对无深度估计的像素,在渲染图像的中值深度附近以高方差初始化。

- RGB-D 设置:通过深度反投影初始化高斯均值

-

剪枝策略:单目设置下,新插入的高斯位置可能不准确,除优化过程中自然淘汰不符合多视图一致性的高斯外,额外剪枝在最近 3 个关键帧中被少于 3 个其他帧观测到的高斯,以去除几何不稳定的高斯。

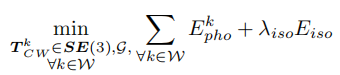

3.3.3 建图模块(Mapping)

建图的目标是维护一致的 3D 结构并优化新插入的高斯,优化目标如下:

在 RGB-D 设置下,加入几何残差:

其中, (

( 为每次迭代随机选择的两个历史关键帧,避免遗忘全局地图),

为每次迭代随机选择的两个历史关键帧,避免遗忘全局地图),为各向同性正则化项。

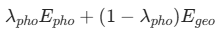

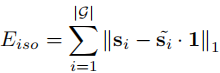

(1)各向同性正则化

由于 3DGS 的光栅化在观察光线方向上对高斯没有约束,在光度约束不足时,高斯容易沿观察方向过度拉伸,导致新颖视图渲染伪影和跟踪精度下降。论文引入各向同性正则化:

其中, 是高斯的缩放参数,

是缩放参数的均值,该正则化惩罚高斯的拉伸,鼓励球形性,如图 3 所示。

是缩放参数的均值,该正则化惩罚高斯的拉伸,鼓励球形性,如图 3 所示。

四、实验验证

论文通过定量和定性实验,全面验证了系统在单目和 RGB-D 设置下的性能,实验平台为 Intel Core i9 12900K CPU 和 NVIDIA GeForce RTX 4090 GPU,核心代码基于 PyTorch 实现,时间关键的光栅化和梯度计算采用 CUDA 加速。

4.1 实验设置

(1)数据集

- 定量评估:

- TUM RGB-D 数据集:3 个序列,用于单目和 RGB-D 评估;

- Replica 数据集:8 个合成序列,含纯旋转相机运动,用于 RGB-D 评估。

- 定性评估:Intel Realsense d455 拍摄的真实场景序列,含透明物体、细结构等挑战性元素。

(2)评估指标

- 相机跟踪精度:关键帧绝对轨迹误差(ATE)的均方根误差(RMSE);

- 地图质量:新颖视图合成的 PSNR(峰值信噪比)、SSIM(结构相似性)、LPIPS(感知相似度);

- 实时性:帧率(FPS)、每帧渲染时间。

(3)基线方法

- 单目设置:DSO、DepthCov-VO、DROID-VO(无回环检测),DROID-SLAM、ORB-SLAM2(有回环检测);

- RGB-D 设置:iMAP、NICE-SLAM、DI-Fusion、Vox-Fusion 等地图中心型、渲染基、无回环检测的神经隐式 SLAM 方法。

4.2 定量评估结果

4.2.1 相机跟踪精度

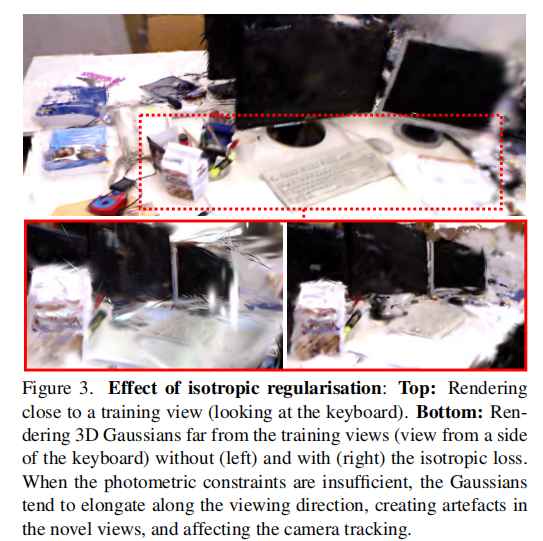

TUM RGB-D 数据集结果(表 1):

- 单目设置:论文方法(Ours)的 ATE RMSE 平均为 3.96cm,优于所有无回环检测的基线方法(DSO:11.0cm,DROID-VO:7.73cm,DepthCov-VO:25.2cm),且接近有回环检测的方法(DROID-SLAM:1.70cm,ORB-SLAM2:1.60cm);

- RGB-D 设置:论文方法的 ATE RMSE 平均为 1.47cm,优于所有基线方法,甚至在 fr1 序列中超过 ORB-SLAM2。

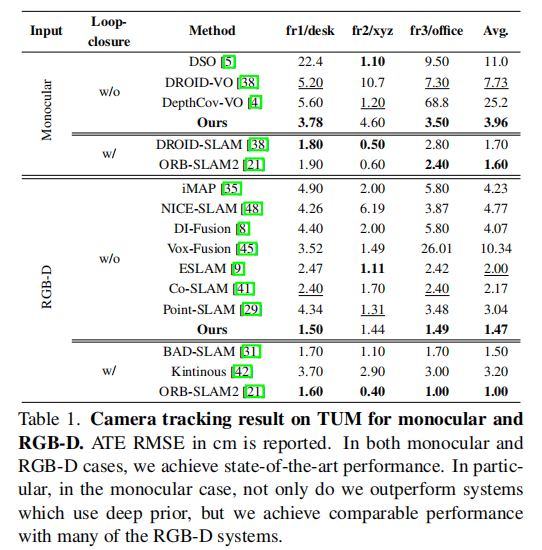

Replica 数据集结果(表 2):

- 多进程实现(Ours)的 ATE RMSE 平均为 0.58cm,单进程实现(Ours (sp))平均为 0.32cm,在 8 个序列中的 6 个序列取得最佳结果;

- 相比其他基线方法(如 ESLAM:0.63cm,Point-SLAM:0.53cm),论文方法在真实场景(TUM)和合成场景(Replica)中均表现稳定,这得益于高斯位置优化对传感器噪声的补偿。

4.2.2 新颖视图渲染性能

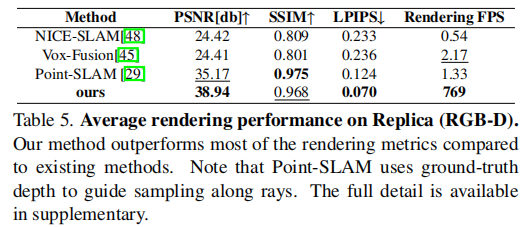

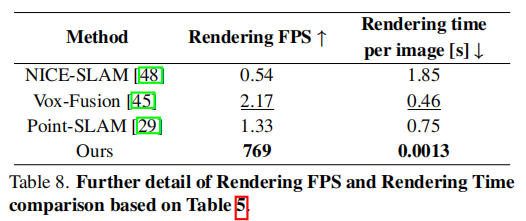

Replica 数据集 RGB-D 设置结果(表 5、表 7、表 8):

- 论文方法的 PSNR 平均为 37.50dB,SSIM 为 0.960,LPIPS 为 0.070,全面优于所有基线方法;

- 渲染速度达到 769fps,每帧渲染时间仅 0.0013 秒,是其他方法的数百倍(如 NICE-SLAM:0.54fps,Point-SLAM:1.33fps)。

表 5 Replica 数据集 RGB-D 设置下的平均渲染性能

表 8 渲染 FPS 和每帧渲染时间对比

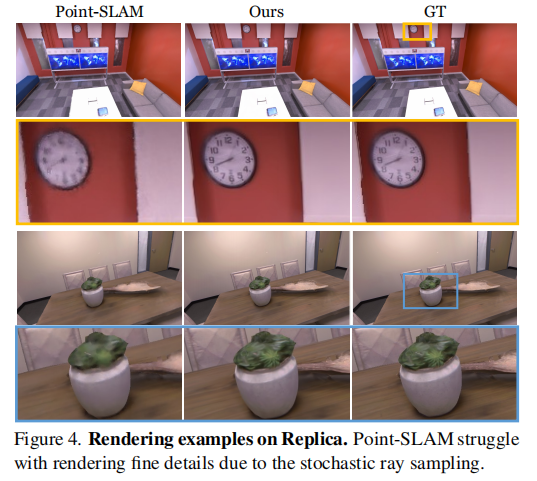

值得注意的是,Point-SLAM 依赖深度引导的光线采样,限制了其新颖视图合成能力,而论文的光栅化方法无需深度引导,即可实现高效高保真的新颖视图渲染(图 4)。

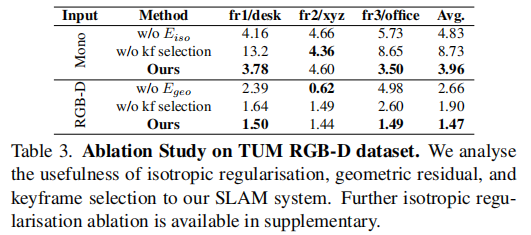

4.2.3 消融实验

论文通过消融实验验证了关键技术的有效性(表 3):

- 各向同性正则化(Eiso):单目设置下,加入正则化后 ATE RMSE 从 4.83cm 降至 3.96cm,有效提升了跟踪精度;

- 几何残差(Egeo):RGB-D 设置下,加入几何残差后 ATE RMSE 从 2.66cm 降至 1.47cm;

- 关键帧选择:单目和 RGB-D 设置下,无关键帧选择时性能均显著下降,证明了关键帧管理的重要性。

此外,论文还验证了高斯剪枝、球谐函数(SH)、与 ORB-SLAM 结合等设置的影响:

- 高斯剪枝:单目设置下,无剪枝时 ATE RMSE 平均为 46.6cm,远高于有剪枝的 3.96cm(表 11);

- 球谐函数:加入 SH 后,渲染质量略有提升(PSNR 从 21.89dB 升至 24.37dB),但内存消耗增加,位姿估计精度略有下降(表 15a、表 16);

- 与 ORB-SLAM 结合:ORB-SLAM 提供位姿,3DGS 用于建图,渲染质量与论文方法接近,但失去了 3DGS 在整个系统中的统一优势(表 15b)。

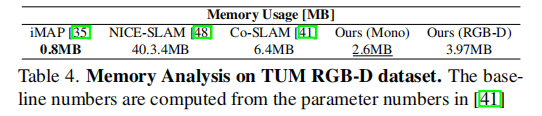

4.2.4 内存占用分析

论文方法的内存占用远低于其他神经隐式 SLAM 方法(表 4):

- 单目设置:2.6MB;

- RGB-D 设置:3.97MB;

- 相比 NICE-SLAM(40.3MB)、Co-SLAM(6.4MB),内存效率显著提升,这得益于高斯的动态分配和剪枝策略。

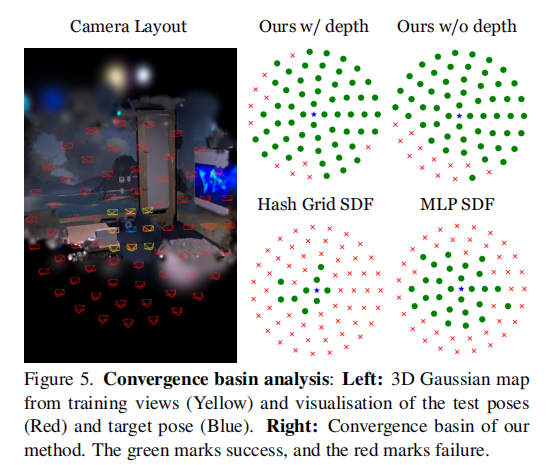

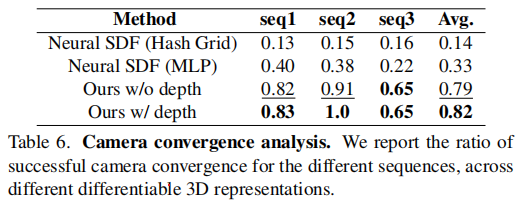

4.2.5 收敛域分析

论文发现 3D 高斯地图具有极大的相机定位收敛域,这对地图 - based 相机定位至关重要。通过收敛漏斗分析(图 5),在训练视图形成的 0.5m 正方形区域外,测试相机半径范围 0.2m-1.2m,论文方法的收敛成功率远高于神经 SDF 方法(表 6):

- 单目设置(Ours w/o depth):平均收敛成功率 79%;

- RGB-D 设置(Ours w/depth):平均收敛成功率 82%;

- 神经 SDF(Hash Grid):14%;

- 神经 SDF(MLP):33%。

这一优势源于各向异性高斯在 3D 空间中形成的平滑梯度,避免了哈希编码等方法中的信号冲突。

表 6 不同 3D 表示形式的相机收敛成功率

4.3 定性评估结果

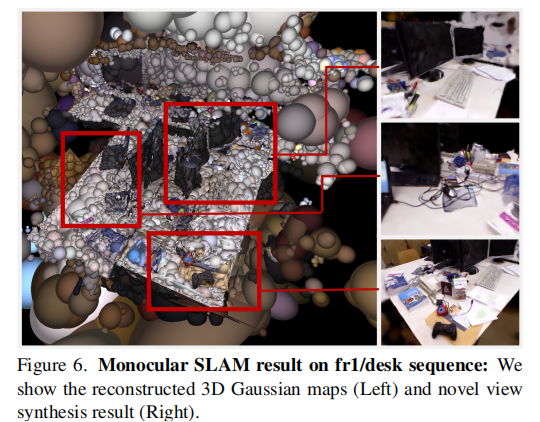

(1)单目 SLAM 重建结果

图 6 展示了 TUM fr1/desk 序列的单目重建结果,高斯的位置分布符合几何合理性,3D 一致性好,新颖视图合成能够准确还原场景细节。

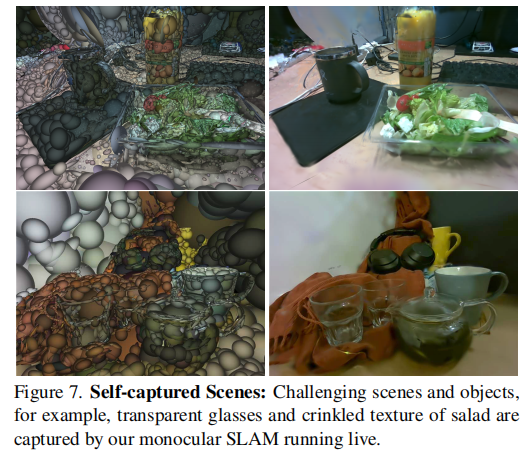

(2)挑战性场景重建

图 7 展示了真实场景中挑战性元素的重建结果,论文方法能够自然处理透明物体(如玻璃杯)和褶皱纹理(如沙拉),这是许多传统 SLAM 方法难以实现的。

(3)与其他方法的渲染对比

图 10、12、14、16 对比了论文方法与 ESLAM、Point-SLAM 在 TUM 和 Replica 数据集上的渲染结果,论文方法在细节还原、纹理一致性等方面均优于基线方法。

五、局限性与未来工作

5.1 局限性

- 场景规模限制:目前仅在小型室内场景中验证,大型真实场景中不可避免会出现轨迹漂移,需引入回环检测模块;

- 实时性优化空间:虽实现 3fps 的实时运行,但未达到硬实时要求(如 TUM 序列 30fps),需探索二阶优化器等加速策略;

- 表面表示缺失:高斯不直接表示表面,难以提取表面法向量等几何信息;

- 单目初始化依赖:单目设置下,高斯初始位置的准确性依赖深度渲染,可能影响初始跟踪精度。

5.2 未来工作方向

- 集成回环检测模块,处理大规模场景的轨迹漂移问题;

- 探索二阶优化器和更高效的并行计算策略,提升帧率至硬实时水平;

- 研究基于高斯地图的表面提取方法,丰富几何信息输出;

- 优化单目初始化策略,结合运动恢复结构(SfM)等技术提升初始位姿和高斯位置的准确性;

- 扩展到动态场景 SLAM,结合动态 3D 高斯技术实现运动物体的跟踪与重建。

六、总结

《Gaussian Splatting SLAM》是首篇将 3D 高斯溅射技术应用于单目 SLAM 的开创性论文,通过三大核心创新 ------ 统一的 3D 高斯表示、李群上的解析雅可比位姿优化、各向同性正则化与高斯剪枝策略,实现了实时、高保真的单目 3D 重建。

论文的核心价值在于证明了 3D 高斯溅射能够同时满足 SLAM 对跟踪精度、建图一致性和渲染效率的要求,打破了传统 SLAM 中多表示形式组合的局限。实验结果表明,该系统在单目和 RGB-D 设置下均达到最先进性能,渲染速度较现有方法提升数百倍,且能够处理透明物体、细结构等挑战性场景。

尽管存在场景规模和实时性方面的局限,该论文为 SLAM 领域提供了新的技术路径,未来通过回环检测、优化器改进等扩展,有望在机器人导航、增强现实、数字孪生等领域得到广泛应用。