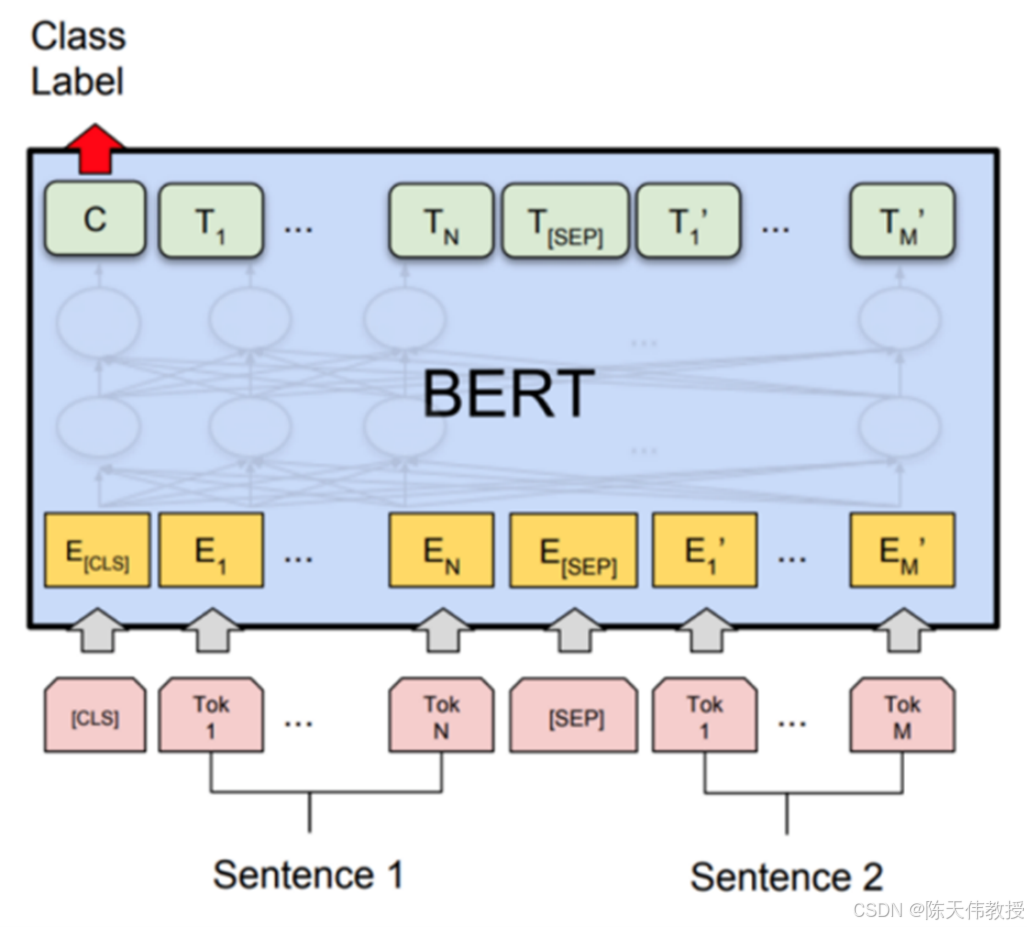

图 **:**自然语言处理领域中的 BERT 模型

BERT(Bidirectional Encoder Representations from Transformers)是一种深度学习模型,最初应用于自然语言处理领域。该模型的核心思想是对输入文本进行双向编码,从而提高对上下文语义的理解能力。

具体而言,BERT 是一个基于 Transformer 结构的预训练模型,能够对输入序列进行层次性编码。在每一层编码时,序列中的每个元素都可以参考序列中其他元素的信息,从而有效聚合上下文信息。BERT 的独特之处在于,它能够同时考虑序列的前后文,使模型对序列的理解更加完整和准确。

在 BERT 模型中,CLS 符号用于表示整个序列的语义。SEP 符号用于分隔两段具有相关性的文本,例如问答系统中的问题和答案,帮助模型判断它们的语义关联。经过训练后,CLS 符号对应的输出向量可以用来表示整个序列的含义。基于这一向量,可以训练一个分类器(如线性分类器或神经网络分类器),实现序列数据的自动分类。