我整理好的1000+面试题,请看

大模型面试题总结-CSDN博客

或者

https://gitee.com/lilitom/ai_interview_questions/blob/master/README.md

最好将URL复制到浏览器中打开,不然可能无法直接打开

好了,我们今天针对上面的问题,

prefixDecoder、causalDecoder和Encoder-Decoder的区别是什么?

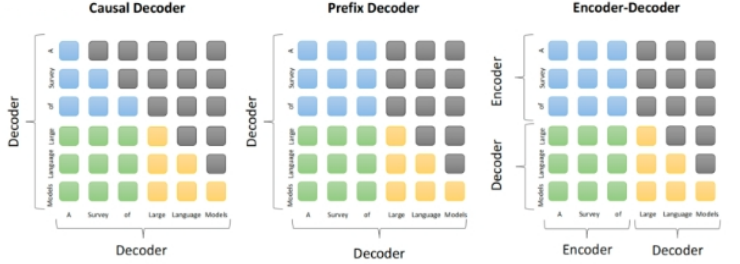

prefix Decoder、causal Decoder 和 Encoder-Decoder 的区别在于 attention mask 不同:

Encoder-Decoder

-

介绍:输入双向注意力,输出单向注意力

-

代表模型:T5、Flan-T5、BART

-

特点 :

-

在输入上采用双向注意力,对问题的编码理解更充分

-

适用任务:在偏理解的 NLP 任务上效果好

-

缺点:在长文本生成任务上效果差,训练效率低

-

causal Decoder

- 特点 :

-

自回归语言模型,预训练和下游应用是完全一致的,严格遵守只有后面的 token 才能看到前面的 token 的规则

-

适用任务:文本生成任务效果好

-

优点:训练效率高,zero-shot 能力更强,具有涌现能力

-

prefix Decoder

-

特点:prefix 部分的 token 互相能看到,是 causal Decoder 和 Encoder-Decoder 的折中

-

缺点:训练效率低