一句话概括,当大家还在为主模型的Token窗口受限和频繁失忆而焦虑时,这帮狠人直接把大模型降级成了没有记忆的"计算CPU",并通过构建一个标准化读写的"代理文件系统"来统管上下文流水线,强行给黑盒AI套上了操作系统的精确性 buff。

第一阶段:识别核心概念

论文的motivation分析行业正在从微调模型(Fine-tuning)时代跨入上下文工程(Context Engineering)时代。当前的挑战不再是如何训练模型,而是如何将外部知识、长期记忆、工具调用甚至是人类的干预,有条理且安全地输送给大模型。现有的工程框架(如LangChain、AutoGen)在处理这些信息时非常碎片化,生成的临时数据难以追踪、难以审查。这导致在工业级应用中,AI的记忆极易出现腐化(Context rot),且系统管理者根本无法知晓AI是基于哪条数据得出了特定结论。

论文主要贡献点分析

- 核心创新:提出了"代理文件系统"(Agentic File System,简称AFS)的架构抽象。该架构借鉴了Unix操作系统中"一切皆文件"的经典哲学,把AI调用的各种异构上下文资源(如历史聊天记录、知识图谱、API工具、人类备忘录)全部统一封装成标准化的"文件"和"目录"。

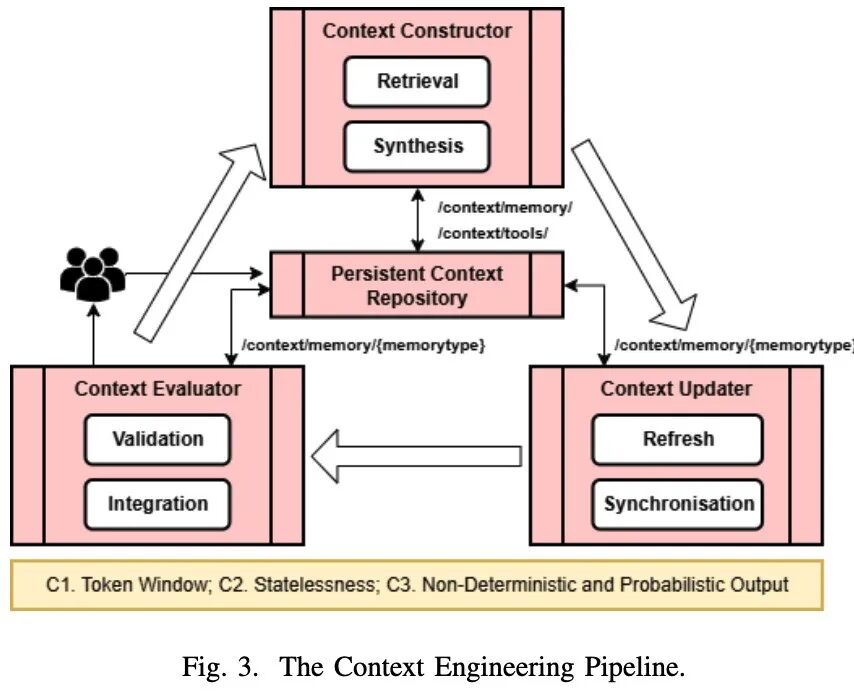

- 关键技术支撑:构建了一套闭环的上下文工程流水线(Context Engineering Pipeline)。这套流水线包含构造器(Constructor)、更新器(Updater)和评估器(Evaluator)三大核心组件,它们在这个统一的文件系统上进行标准的读取、压缩、加载和验证操作。

- 重大突破:彻底改变了提示词工程的零散现状,让AI系统从一个黑盒式的"提示词拼接机",变成了一个可追溯、可审计、可治理、且支持人类随时介入审查的透明化工程软件。

理解难点识别

- 思维转换难点:传统的开发思维往往将大模型视为核心,将外围数据视为数据库表。理解本论文的关键在于必须进行架构视角的反转:将大模型看作是操作系统的计算单元(CPU),而将一切外围环境(无论是静态数据还是动态的执行工具)都看作是挂载(Mount)在文件系统上的只读或可执行文件。

- 最具挑战性的部分:代理文件系统(AFS)的统一命名空间逻辑,以及在其约束下运行的上下文工程流水线的动态更新机制。

- 重点解释的核心概念:代理文件系统抽象(AFS)与上下文工程流水线(Context Engineering Pipeline)。

概念依赖关系

- 大语言模型存在物理Token窗口限制且本身无状态。

- 必须依赖外部的持久化存储来维持交互连贯性。

- 外部数据格式和工具接口过于庞杂,直接对接会导致系统崩溃。

- 引入统一的文件系统抽象(AFS)屏蔽异构复杂性。

- 需要一个标准化的流水线机制,将文件系统中的海量内容安全、精准地输送给受限的模型大脑。

第二阶段:深入解释核心概念

设计生活化比喻想象一家米其林高级餐厅的后厨。大语言模型(LLM)就是这家餐厅里拥有顶级厨艺的主厨(Chef)。这位主厨极其聪明,但他面临两个严峻的物理限制:第一,他的砧板非常小(有限的Token窗口),放不下太多食材;第二,他做完一道菜就会把刚才的处理过程忘得一干二净(无状态性)。为了让主厨能够连续不断地为老顾客做出一桌好菜,餐厅必须建立一套极其严密的后厨食材调度管理系统。

建立比喻与实际技术的对应关系

- 统一规格的保鲜盒(代理文件系统):后厨彻底废除了大小不一的塑料袋和麻袋,规定所有食材(API接口、数据库记录、本地文件)必须装入统一规格、贴着标准标签的保鲜盒中。底层无论是什么异构数据,代理文件系统(AFS)都会对外暴露统一的列表、读取、写入和搜索接口,让模型和代理像读取普通文件一样获取资源。

- 进货流水账本(历史记录):记录每一车菜进货的准确时间和源头,所有记录只能追加,不可篡改(Immutable)。

- 分类冷库(记忆):把账本里的生肉进行初步切配、分类、贴上保质期存起来,转化为高密度的可用资源,供后续档口快速调用。

- 临时备菜盘(草稿本):主厨做菜时临时放置佐料的盘子,记录单次任务的中间状态,做完菜即可倒掉或总结为长期经验。

- 帮厨团队(上下文流水线):由配菜员(构造器)、传菜员(更新器)和质检员(评估器)组成的流水线,负责将冷库里的食材精简、搬运到砧板上,并对菜品进行把关。

深入技术细节

自然语言替换版本:

当前激活的上下文容量预算截断函数压缩聚合函数搜集所有相关的代理文件系统记忆数据

技术实现中的关键步骤: 第一步:系统触发查询机制,在统一的代理文件系统(AFS)架构下,通过标准化的搜索指令遍历所有被授权的上下文记忆节点,提取与当前任务相关的历史上下文要素。 第二步:对提取出的庞杂数据施加压缩聚合处理(如大模型文本摘要、核心实体抽取或向量聚类),以剔除冗余噪音。 第三步:引入严格的物理阈值进行容量预算截断。该机制强制将压缩后的内容裁剪至大模型当前支持的最大Token窗口限度之内,确保推理过程不会因内存溢出而崩溃。

将技术细节与比喻相互映射

- 搜集所有记忆数据直接对应配菜员(构造器)在统一的保鲜盒仓库中检索当晚所需的全部原料,标准化文件接口让寻找食材变得极其高效。

- 压缩聚合函数对应配菜员对庞大的食材进行切丝、浓缩的高级加工,剥离不可食用的边角料,提取最精华的部分。

- 容量预算截断函数对应由于主厨砧板尺寸的绝对限制,传菜员(更新器)必须死死盯住送上砧板的餐盘大小,绝不允许任何一块多余的食材挤占空间。

- 当菜品口味出现偏差(模型出现幻觉)时,质检员(评估器)可以通过保鲜盒上的溯源标签(元数据),立刻查出是哪一批进货流水(历史记录)导致的污染,这使得黑盒系统的内部错误无处遁形。

总结这套系统架构将一切异构的上下文资源强制降维成标准化的文件节点,通过极其克制且解耦的流水线机制进行调度。公式揭示了在物理算力(Token)存在天花板的客观条件下,如何通过严格的检索、高压的浓缩与硬性的边界裁剪,实现从广阔的外部世界向狭窄的AI大脑进行高密度的知识投递。

第三阶段:详细说明流程步骤

具体流程伪代码

- 步骤1:捕获与历史固化

- 输入:用户发出的原始指令(例如:"帮我总结一下昨天讨论的那个代码漏洞")。

- 处理逻辑:系统拦截该输入,并自动附加时间戳、系统状态标识和用户ID等环境元数据。接着,采用严格的只追加(Append-only)模式,将这段完整信息封装为一个文件节点,写入代理文件系统的

/context/history/目录下。 - 输出:一条附带完整溯源元数据的不可篡改历史日志文件(作为下一步的输入池)。

- 步骤2:上下文构造加工

- 输入:用户核心指令、全局的系统日志文件池、以及当前大模型的Token预算限制参数。

- 处理逻辑:构造器(Constructor)组件发起标准查询指令,在

/context/memory/(历史记忆区)和/context/tool/(可用工具库)中检索强相关的对话记录文件与GitHub工具调用说明。提取出这些文件后,调用内部摘要算法对长文本数据进行切片与浓缩处理。 - 输出:一份结构化的JSON格式上下文清单(Manifest)。该清单精准记录了即将被调用的文件片段路径、排列顺序以及各自的预估Token消耗量。

- 步骤3:上下文动态注入

- 输入:步骤2生成的JSON格式上下文清单(Manifest)。

- 处理逻辑:更新器(Updater)接管清单,严格按照预估的Token容量,将各个文件片段的真实内容读取出来。它将压缩后的背景知识和执行指令按顺序拼接,映射成适配当前大模型的规范提示词格式。若发现上下文存在动态依赖,会触发渐进式流式加载。

- 输出:一段符合大模型物理视窗限制且内容完整的成品提示词(Prompt)。

- 步骤4:模型推理与临时推演

- 输入:成品提示词(Prompt)。

- 处理逻辑:大模型接收提示词启动推理引擎。当遇到需要中间演算的复杂逻辑时,模型会在代理文件系统的

/context/pad/taskID目录下动态创建一个临时工作区文件(草稿本),将推演的中间状态写入其中。若需查阅远程代码,直接调用文件系统中已映射的GitHub模块接口执行查询。 - 输出:存有中间演算步骤的临时草稿文件,以及大模型的初步推理结论。

- 步骤5:闭环评估与知识沉淀

- 输入:初步推理结论、临时草稿文件以及步骤1留存的溯源元数据标签。

- 处理逻辑:评估器(Evaluator)对推理结论进行事实一致性与置信度校验。如果置信度低于安全阈值,系统流水线自动挂起,请求人类专家介入审核;人类的批注会被作为新文件写入

/context/human/目录。当结论通过验证后,系统提取有效信息并执行格式化转化。 - 输出:将最终验证通过的知识单元覆盖写入

/context/memory/fact/目录,完成长期记忆库的闭环演进,并向前端用户输出精准答复。

第四阶段:实验设计与验证分析

主实验设计解读:核心论点的验证本研究的核心主张在于证明"代理文件系统"这一架构抽象能够根本性地解决大模型上下文管理的碎片化难题。作为一篇软件工程领域的架构论文,作者并未采用传统机器学习中刷榜跑分(如对比Accuracy指标)的范式。其主实验直接聚焦于工业级架构验证,通过在自研的开源AIGNE框架内搭建两个高度还原真实开发场景的验证原型(Case Studies),定性且直观地验证了架构的可扩展性和解耦能力。

深度/创新性实验剖析:洞察方法的内在特性

- 验证原型1:支持持久化记忆的上下文构造

- 实验目的:证明天生无状态的大语言模型,可以通过极低侵入性的文件系统挂载操作,获得跨越不同交互会话的长期记忆能力。

- 实验设计:实验极其巧妙地规避了繁杂的数据库对接逻辑。开发人员仅仅通过一句代码,就将一个底层的SQLite持久化数据库伪装并挂载成了代理文件系统下的一个实体目录。此时的AI代理被分配了对应的目录读写权限,即可直接进行历史会话的查阅与续写。

- 实验结论:揭示了将记忆数据转化为文件系统节点后,系统自然获得了极其强大的可治理性(Governance)。架构层可以通过标准的文件系统权限控制,完美实现多Agent之间的数据隔离;同时也证明了统一命名空间能极大降低模型对接外部记忆库的工程门槛。

- 验证原型2:基于MCP(模型上下文协议)的GitHub无缝集成

- 实验目的:通过高难度的外部工具集成测试,检验本架构在应对异构环境时的组合性(Composability)与边界突破能力。

- 实验设计:作者选取了工业界高频使用的GitHub代码库交互场景。将GitHub官方提供的MCP Server封装在Docker容器中,随后直接作为可执行资源挂载到文件系统的

/modules/github-mcp/路径下。 - 实验结论:实验展示出极为惊艳的工程效果。大语言模型在查询GitHub时,完全不需要理解底层的REST API构造逻辑与Token鉴权流程,它仅仅发出了最普通的文件执行指令,就完成了复杂的代码库搜索。该实验充分证明文件系统抽象成功将底层异构操作的复杂性全部屏蔽在了模型视野之外,这在大幅降低提示词构建复杂度的同时,为AI节约了极其宝贵的Token推理窗口空间。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

👇👇扫码免费领取全部内容👇👇

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图 ,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础 。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程 ,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2026行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

7. 资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇