总目录 大模型相关研究:https://blog.csdn.net/WhiffeYF/article/details/142132328

https://aclanthology.org/2025.acl-long.572/

该论文题为"PaSa: An LLM Agent for Comprehensive Academic Paper Search",由字节跳动Seed团队的何逸辰、黄冠华、冯沛源、林源等人与北京大学鄂维南院士合作完成,发表于ACL 2025主会长文。

该论文聚焦一个科研人员的日常痛点:面对复杂、细粒度的学术检索需求,Google Scholar等传统搜索引擎往往力不从心,研究者需要花费大量时间反复搜索、阅读论文、追踪引用才能完成一次完整的文献调研。为此,该论文提出了PaSa(Paper Search Agent),一个能像人类研究者一样自主搜索论文的LLM智能体。

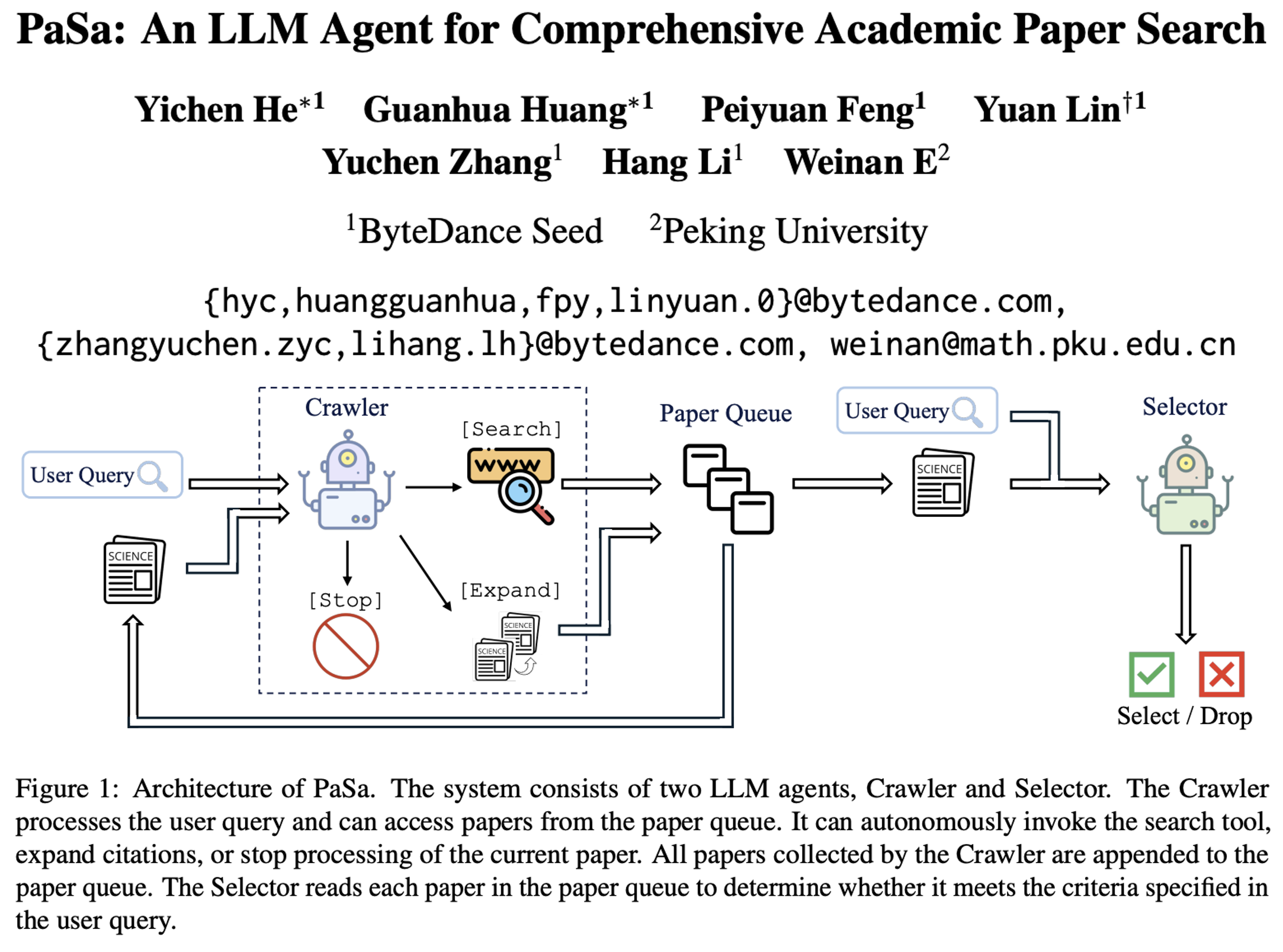

PaSa的核心设计非常直观。想象你要调研一个冷门课题,你会先用关键词搜几篇论文,然后打开其中一篇,翻到相关工作部分,发现它引用了几篇更相关的文章,于是你又去读那些引用------PaSa做的就是这件事。它由两个智能体组成:Crawler(爬虫)负责不断搜索和沿着引用网络"爬取"论文,把找到的论文放入一个待审队列;Selector(筛选器)则逐篇阅读队列中的论文,判断其是否真正满足用户的查询需求。Crawler有三个核心动作:发起搜索、展开某篇论文的引用、以及停止当前论文转向下一篇。

该论文在训练方法上也有创新。团队构建了AutoScholarQuery数据集,从ICLR、ICML、NeurIPS、ACL、CVPR等顶会论文的相关工作章节中,利用GPT-4o自动生成了3.5万条细粒度学术查询及对应论文。在此基础上,团队设计了一种会话级PPO强化学习算法来训练Crawler,有效解决了论文搜索任务中奖励稀疏和轨迹过长两大难题。

该论文还构建了RealScholarQuery基准,包含50条真实的学术查询,由计算机系教授逐篇标注。实验结果令人印象深刻:仅7B参数的PaSa在Recall@20上超越Google+GPT-4o基线37.78%,在Recall@50上超越39.90%,同时在召回率和精确率上均大幅超过用GPT-4o直接实现的PaSa-GPT-4o版本。消融实验表明,引用网络探索、强化学习训练和Selector辅助奖励三个组件均不可或缺,其中引用网络探索对召回率的贡献最为显著。

该论文展示了将LLM智能体与强化学习结合用于复杂学术搜索的巨大潜力,为科研人员的文献调研工作提供了一个强有力的自动化工具。

QA

作者是怎么做的对比实验,用的什么数据集呢?

这篇论文介绍的是 PaSa(Paper Search Agent),我来梳理一下他们的对比实验设计。

数据集

作者构建了两个数据集:

AutoScholarQuery(合成数据集):从 ICLR 2023、ICML 2023、NeurIPS 2023、ACL 2024、CVPR 2024 的论文相关工作章节中,用 GPT-4o 自动生成学术查询,答案就是该章节引用的论文。最终包含约 33,551 / 1,000 / 1,000 条训练/验证/测试数据。

RealScholarQuery(真实数据集):在 PaSa 上线 demo 后,邀请真实 AI 研究者提交查询,人工筛选出 50 条细粒度问题,再由顶校计算机系教授手工标注相关论文,平均每条查询关联约 15.82 篇论文,标注成本约每条 $304。

对比基线

作者选了六类对比方法,大体分三个层次:

- 传统搜索引擎:Google、Google Scholar

- LLM 增强搜索:Google with GPT-4o(先改写查询再搜索)、ChatGPT(搜索增强版 GPT-4o)、GPT-o1(无外部工具)

- Agent 方法:PaSa-GPT-4o(用 GPT-4o 实现同款 PaSa 框架,用于剥离 RL 训练的贡献)

评估指标

- 对有排序的搜索引擎类方法,用 Recall@20 / @50 / @100

- 对无排序的 Agent 类方法,用整体 Precision 和 Recall

- 额外比较 Crawler Recall(衡量爬取阶段的覆盖率)

主要结论

PaSa-7B 在两个数据集上全面超越所有基线。在 RealScholarQuery 上,相比最强的 Google+GPT-4o 基线,Recall@20 提升 37.78%;相比同架构的 PaSa-GPT-4o,Recall 提升 30.36%,说明 RL 训练本身贡献显著。此外消融实验还单独验证了 Expand(引用网络扩展)、RL 训练、Selector 作为奖励模型三个组件各自的作用。

AutoScholarQuery、RealScholarQuery这两个数据集,你举几个数据集的例子,这样我能更快理解数据集是什么样子。

论文里直接给了具体例子,我来列举一下:

AutoScholarQuery 示例(论文 Table 1)

例子1:

- Query: Could you provide me some studies that proposed hierarchical neural models to capture spatiotemporal features in sign videos?

- Query Date: 2023-05-02

- Answer Papers :

- TSPNet: Hierarchical Feature Learning via Temporal Semantic Pyramid for Sign Language Translation

- Sign Language Translation with Hierarchical Spatio-Temporal Graph Neural Network

- 来源论文: SLTUnet: A Simple Unified Model for Sign Language Translation, ICLR 2023

例子2:

- Query: Which studies have focused on nonstationary RL using value-based methods, specifically UCB-based algorithms?

- Query Date: 2023-08-10

- Answer Papers :

- Reinforcement Learning for Non-Stationary Markov Decision Processes: The Blessing of (More) Optimism

- Efficient Learning in Non-Stationary Linear Markov Decision Processes

- Nonstationary Reinforcement Learning with Linear Function Approximation

- 来源论文: Provably Efficient Algorithm for Nonstationary Low-Rank MDPs, NeurIPS 2023

RealScholarQuery 示例(论文 Table 9)

- Query: Give me papers about how to rank search results by the use of LLM

- Query Date: 2024-10-01

- Answer Papers : 共39篇,例如:

- Large Language Models are Effective Text Rankers with Pairwise Ranking Prompting

- Is ChatGPT Good at Search? Investigating Large Language Models as Re-Ranking Agents

- RankVicuna: Zero-Shot Listwise Document Reranking with Open-Source Large Language Models

- ......(还有36篇)

两个数据集的核心区别一目了然:

| AutoScholarQuery | RealScholarQuery | |

|---|---|---|

| 查询来源 | GPT-4o 从论文相关工作自动生成 | 真实研究者提交 |

| 答案规模 | 平均每条 2~3 篇 | 平均每条 ~16 篇 |

| 标注方式 | 自动构建 | 教授人工标注 |

| 数据量 | 35,551 条 | 50 条 |

AutoScholarQuery 的答案少是因为它只收录了该论文相关工作里引用的那几篇,而 RealScholarQuery 是尽可能穷举所有相关论文,所以答案更全、更多。

例子,翻译为中文

AutoScholarQuery 示例

例子1:

- 查询: 能给我一些提出了层次化神经网络模型、用于捕捉手语视频时空特征的研究吗?

- 查询日期: 2023-05-02

- 答案论文 :

- TSPNet:通过时序语义金字塔进行层次化特征学习用于手语翻译

- 基于层次化时空图神经网络的手语翻译

- 来源论文: SLTUnet:一个用于手语翻译的简单统一模型,ICLR 2023

例子2:

- 查询: 有哪些研究关注了非平稳强化学习中基于值函数的方法,特别是基于UCB算法的方法?

- 查询日期: 2023-08-10

- 答案论文 :

- 非平稳马尔可夫决策过程的强化学习:(更多)乐观主义的福音

- 非平稳线性马尔可夫决策过程中的高效学习

- 带线性函数近似的非平稳强化学习

- 来源论文: 非平稳低秩MDP的可证明高效算法,NeurIPS 2023

RealScholarQuery 示例

- 查询: 给我一些关于如何用大语言模型对搜索结果进行排序的论文

- 查询日期: 2024-10-01

- 答案论文 (共39篇,举几个代表性的):

- 大语言模型是基于成对排序提示的高效文本排序器

- ChatGPT擅长搜索吗?研究大语言模型作为重排序智能体

- RankVicuna:基于开源大语言模型的零样本列表式文档重排序

理解这两个数据集之后,整篇论文的逻辑就很清晰了:AutoScholarQuery 用来训练和初步测试 (数据量大但答案不完整),RealScholarQuery 用来验证真实场景效果(数据量小但答案更完整可信)。PaSa 虽然只在合成数据上训练,却在真实数据上也取得了很好的效果,这也是论文的一个重要亮点。

如何判定检索结果是正确的,就是评估标准是啥

好问题!这涉及到论文里两个层面的评估。

第一层:Crawler 的评估(召回阶段)

Crawler 负责把尽可能多的相关论文放进"论文队列",评估指标是:

Crawler Recall = 被 Crawler 收集到的目标论文数 / 全部目标论文数

简单说就是:目标论文有没有被"捞进来",还没判断对不对,只看有没有找到。

第二层:最终结果的评估(精排阶段)

Selector 从论文队列里筛选出最终答案后,用以下指标评估:

针对有排序的搜索引擎类方法(Google等):

- Recall@20:返回前20篇里,答案论文占全部答案论文的比例

- Recall@50:返回前50篇里,答案论文占全部答案论文的比例

- Recall@100:返回前100篇里,答案论文占全部答案论文的比例

针对无排序的Agent类方法(PaSa等):

- Recall = 检索到的正确论文数 / 全部正确论文数(找全了吗?)

- Precision = 检索到的正确论文数 / 检索到的全部论文数(找准了吗?)

关键问题:怎么判定一篇论文是"正确答案"?

两个数据集的判定方式不同:

| AutoScholarQuery | RealScholarQuery | |

|---|---|---|

| 判定方式 | 看论文是否在预先构建的答案集合里 | 由教授人工审核判定 |

| 答案来源 | 从源论文的相关工作引用中自动提取 | 多种方法检索后人工筛选 |

| 问题 | 答案集合可能不完整(引用只是一部分相关论文) | 更接近真实、更完整 |

一个特别值得注意的细节

AutoScholarQuery 的答案集合天然是不完整的,因为一篇论文的相关工作只会引用部分相关论文,而不是所有相关论文。所以作者在训练时专门用 Selector 作为辅助奖励模型来弥补这个问题------即使一篇论文不在答案集合里,只要 Selector 判断它与查询相关,也给 Crawler 正向奖励,避免了稀疏奖励的问题。