文章目录

- 一、什么是"叠图"?

- 二、产生原因

-

- [1. 累积误差(漂移)](#1. 累积误差(漂移))

- [2. 回环检测失败](#2. 回环检测失败)

- [3. 回环校正失败或优化不充分](#3. 回环校正失败或优化不充分)

- [4. 传感器噪声或外点(outliers)](#4. 传感器噪声或外点(outliers))

- [5. 动态物体干扰](#5. 动态物体干扰)

- [6. 初始化不好](#6. 初始化不好)

- [7. 时间不同步(很隐蔽⚠️)](#7. 时间不同步(很隐蔽⚠️))

- [8. 里程计 / IMU 漂移(最常见)](#8. 里程计 / IMU 漂移(最常见))

- 三、叠图形成过程(流程图)

- 四、如何缓解叠图现象?

-

- [✅ 1. 提升定位精度](#✅ 1. 提升定位精度)

- [✅ 2. 强化匹配算法](#✅ 2. 强化匹配算法)

- [✅ 3. 加强回环检测](#✅ 3. 加强回环检测)

- [✅ 4. 做时间同步](#✅ 4. 做时间同步)

- [✅ 5. 后端优化(核心)](#✅ 5. 后端优化(核心))

- 五、回环检测如何修复叠图(动态过程)

- 六、总结

- [附录------激光 SLAM | 视觉 SLAM](#附录——激光 SLAM | 视觉 SLAM)

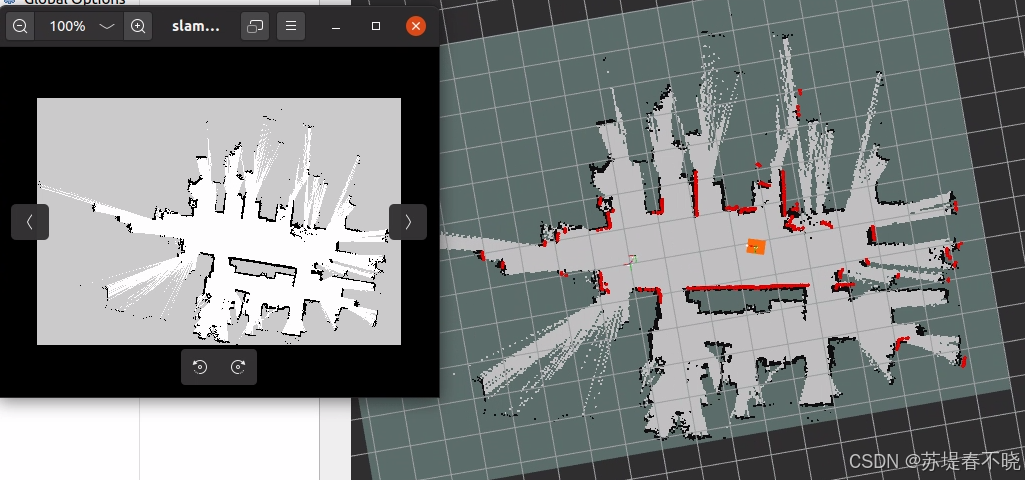

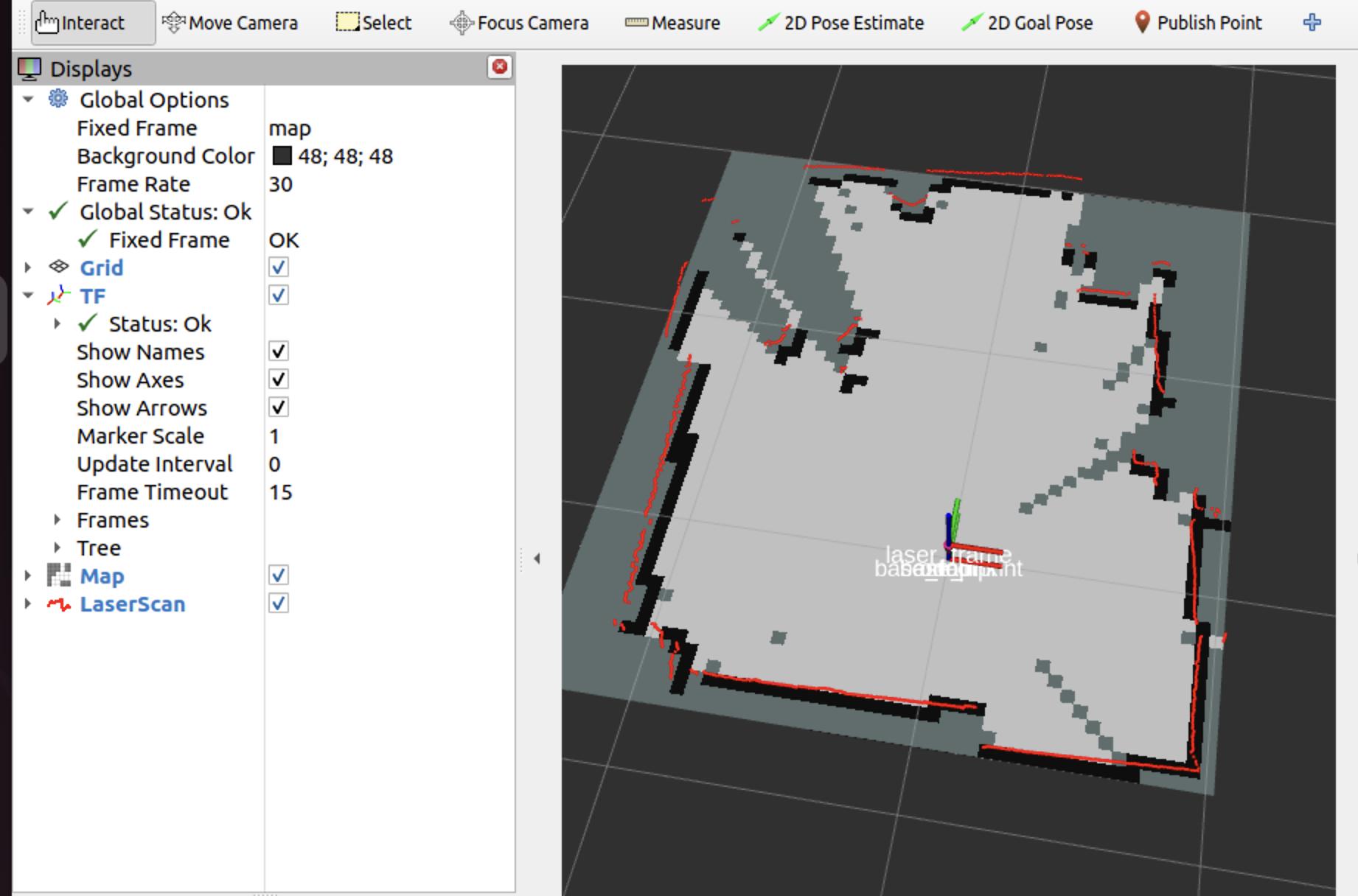

在 SLAM(Simultaneous Localization and Mapping,同时定位与建图)中,"叠图现象 "(也称为"重影"、"地图重叠"、"ghosting" 或 "map folding")是指环境中的同一物理区域在构建的地图中被错误地表示为多个不重合或部分重叠的副本。这会导致地图出现"重影"、结构错乱、走廊分叉、墙壁重复等明显失真。

本质可以理解为:系统"以为自己走到了新地方",其实是在原地附近打转

一、什么是"叠图"?

正常地图:

- 一面墙只出现一次 ✅

叠图:

- 同一面墙出现两条(甚至多条)❌

- 地图"错位叠加"

叠图现象的典型表现

- 同一条走廊在地图中出现两次,彼此平行但偏移;

- 一个房间被画成两个略微错开的矩形;

- 墙壁、门、障碍物等结构出现"双影";

- 机器人轨迹在回环处无法对齐,导致地图撕裂或折叠。

👁️ 视觉上就像把一张纸折了两下再展开------同一位置被"叠"了多次。

二、产生原因

核心原因

👉 位姿估计错了(定位漂移)

也就是:

text

机器人以为自己在 A 点

但实际上在 A' 点👉 于是:

- 新数据被画到了错误位置

- 就形成"叠图"

叠图的根本原因是 位姿估计漂移(pose drift) + 缺乏有效的回环检测(loop closure)或回环校正失败。

1. 累积误差(漂移)

- SLAM 系统通过传感器(如轮速计、IMU、激光雷达、相机)连续估计机器人的运动。

- 每一步都存在微小误差,长时间运行后这些误差累积,导致机器人认为自己走到了一个"新位置",而实际上它回到了之前经过的地方。

- 结果:系统将同一地点当作两个不同地点加入地图 → 叠图。

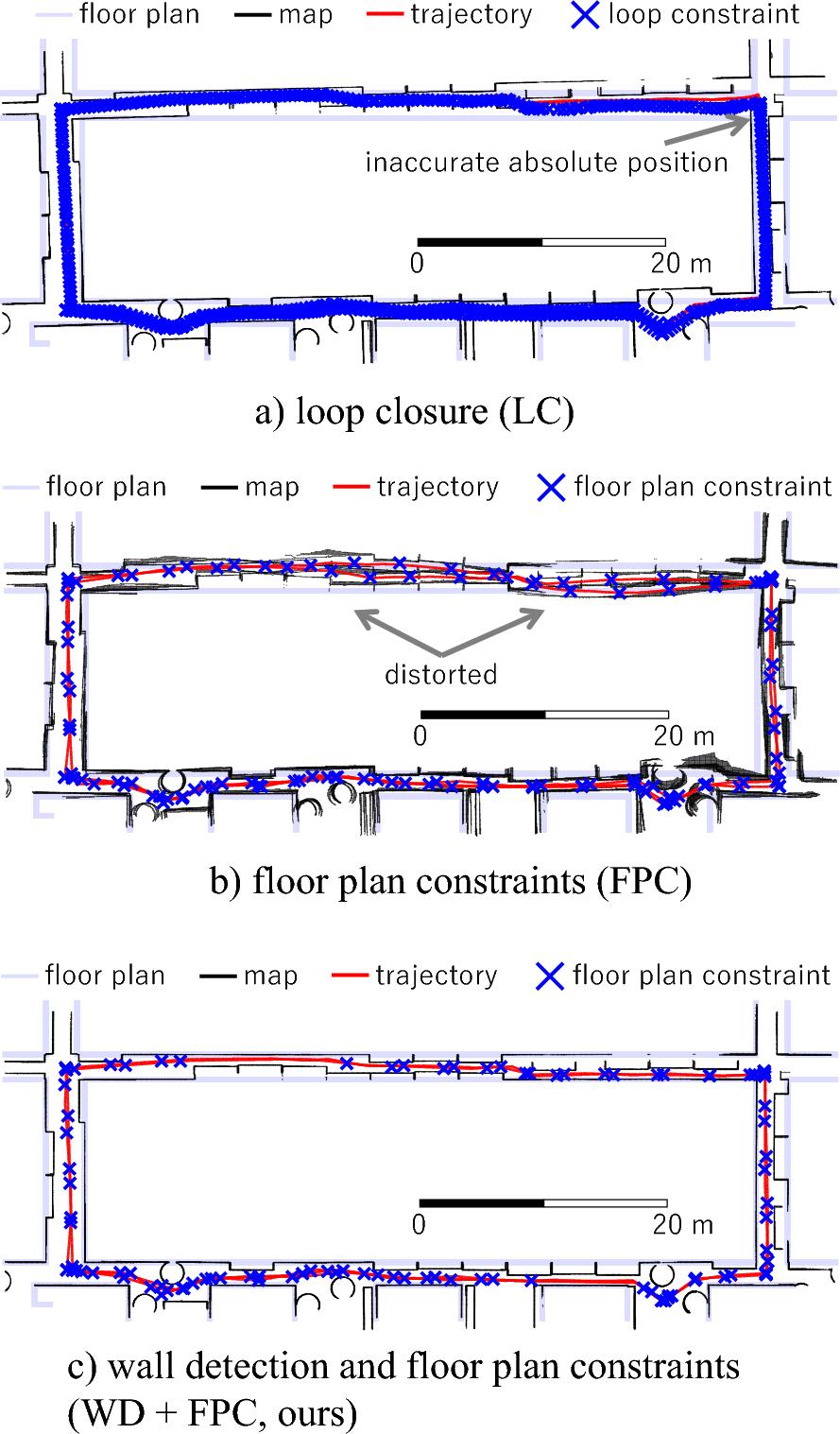

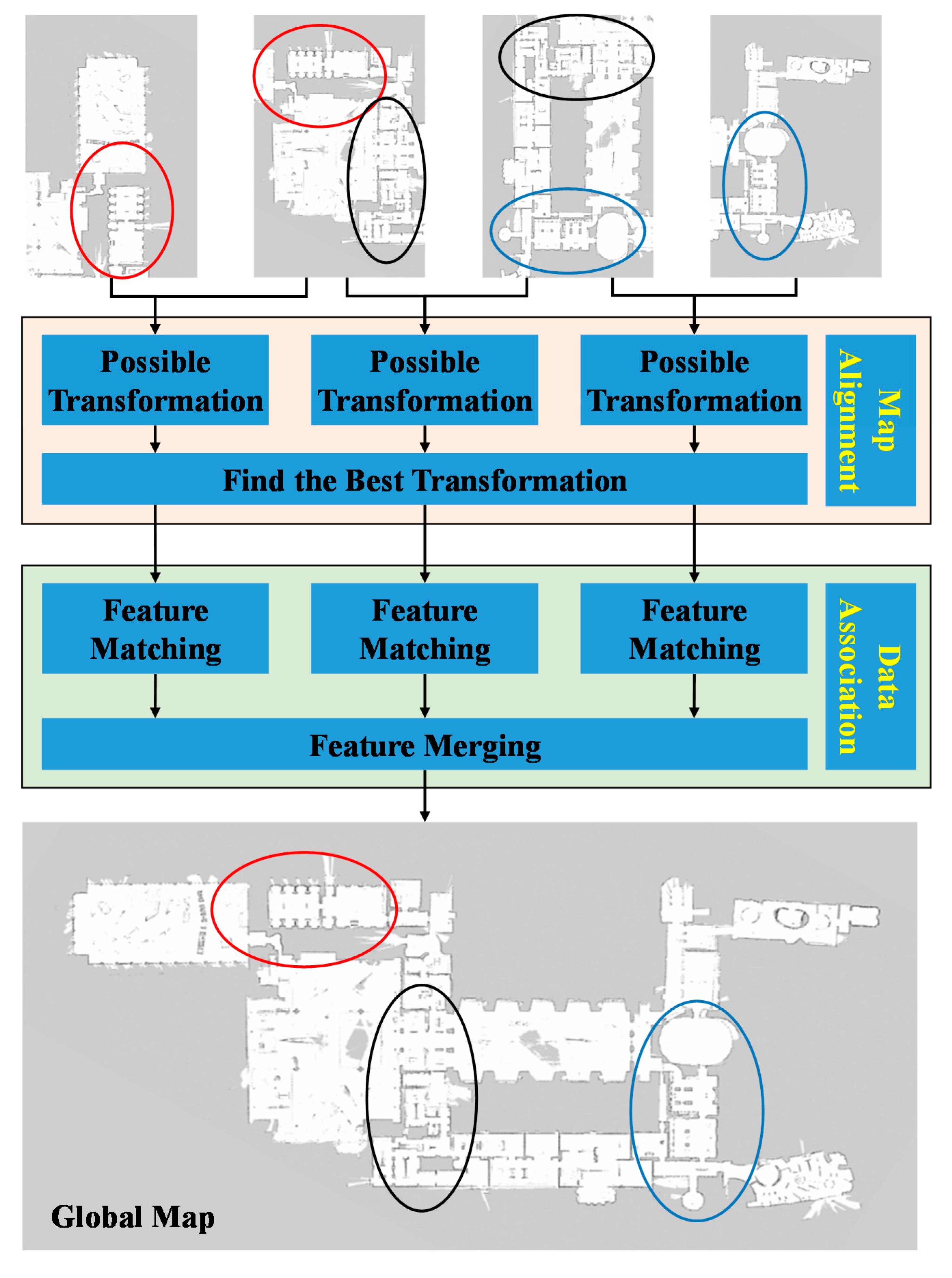

2. 回环检测失败

- 当机器人回到已访问区域时,SLAM 应该通过回环检测识别出"这里我来过"。

- 如果因为以下原因未能检测到回环:

- 环境纹理/特征不足(如长走廊、白墙);

- 光照、视角、季节、动态物体变化大;

- 特征匹配阈值过严或算法鲁棒性差;

- 则系统不会触发位姿图优化,无法纠正漂移 → 叠图。

3. 回环校正失败或优化不充分

- 即使检测到回环,如果:

- 回环约束的位姿误差过大;

- 优化器(如 g2o、Ceres)陷入局部最优;

- 图优化未全局收敛;

- 会导致地图只做局部调整,无法消除整体错位 → 仍出现叠图。

👉 图优化没收敛 / 权重不合理

📌 结果:

- 回环修正失败

- 地图无法对齐

4. 传感器噪声或外点(outliers)

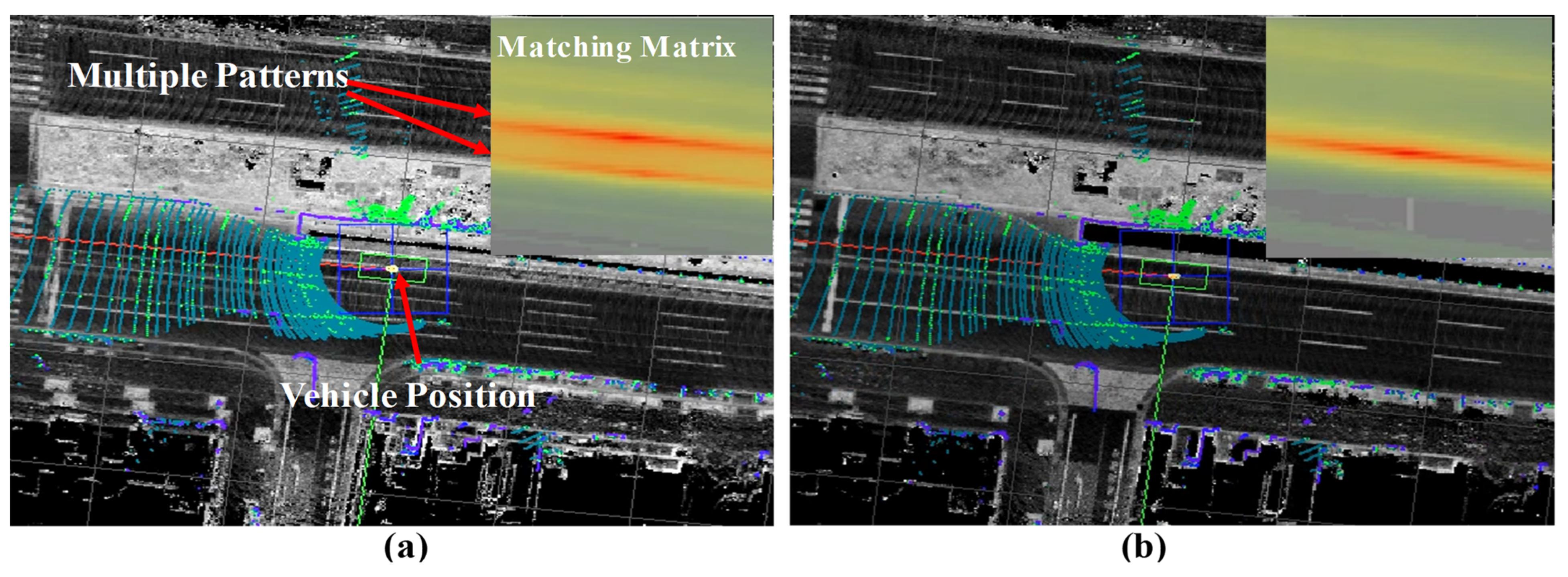

- 激光雷达受玻璃、镜面、透明物体干扰;

- 视觉 SLAM 在低纹理或快速运动下特征跟踪失败;

- 这些错误观测会误导位姿估计,加剧漂移。

激光 / 视觉匹配失败

👉 scan matching / feature matching 出错

📌 例如:

- ICP 对齐错了

- ORB 特征匹配错误

👉 结果:

text

这一帧被"贴"到了错误位置5. 动态物体干扰

- 地图中包含移动的人、车、家具等,若未过滤,会被当作静态结构建入地图。

- 当机器人再次经过时,动态物体已不在原位,导致特征不匹配,回环失败 → 叠图。

SLAM 以为环境变了,产生错误匹配

6. 初始化不好

👉 初始位姿估计不准

📌 结果:

- 从一开始就"歪了"

- 后面越来越错

7. 时间不同步(很隐蔽⚠️)

👉 传感器时间对不上

📌 比如:

- 激光是 t1

- 位姿是 t1+Δt

👉 结果:

- 数据错位 → 地图重影

8. 里程计 / IMU 漂移(最常见)

👉 轮子打滑、IMU误差

📌 结果:

- 每一步误差很小

- 但累积起来 → 地图错位

👉 类比:

你闭着眼走路,越走越偏

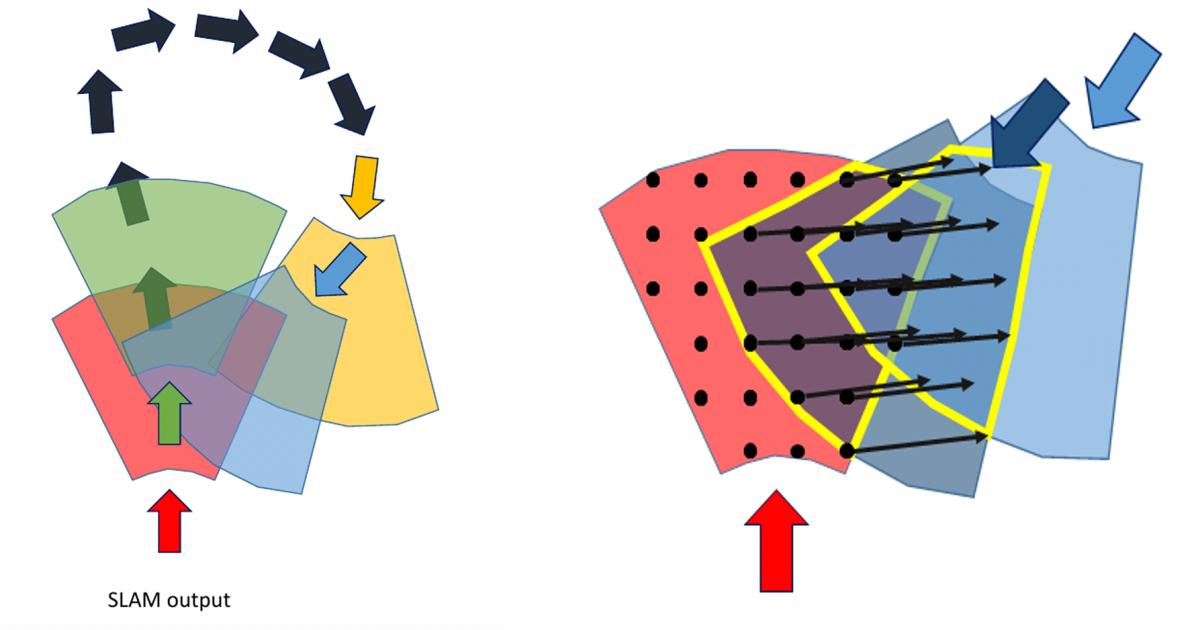

三、叠图形成过程(流程图)

text

机器人移动

↓

位姿估计有误差

↓

新数据加入地图

↓

放到了"错误位置"

↓

和旧地图重叠

↓

👉 产生叠图用一个特别好懂的比喻

👉 你在画地图:

- 每走一步画一笔

- 但你的位置"估错了"

结果:

text

本来应该画在这里

↓

你画到了旁边👉 画多了就变成:

text

两条墙(叠图)四、如何缓解叠图现象?

| 方法 | 说明 |

|---|---|

| 增强回环检测 | 使用更鲁棒的特征(如 ORB、SuperPoint)、词袋模型(BoW)、深度学习描述子等。 |

| 多传感器融合 | 融合 IMU、轮速、GPS(室外)等,减少单传感器漂移。 |

| 动态物体剔除 | 通过语义分割或运动一致性检测,滤除动态障碍物。 |

| 全局优化策略 | 使用位姿图优化(Pose Graph Optimization)或因子图,在检测到回环后全局调整轨迹。 |

| 地图管理机制 | 如子地图(submapping)、关键帧选择,避免冗余建图。 |

工程上怎么解决(重点🔥)

✅ 1. 提升定位精度

- 更好的 IMU

- 轮速计标定

- 视觉辅助

✅ 2. 强化匹配算法

- ICP 改进

- 特征筛选

- RANSAC

✅ 3. 加强回环检测

- Bag-of-Words(视觉)

- Scan Context(激光)

✅ 4. 做时间同步

- 硬件同步

- 时间戳对齐

✅ 5. 后端优化(核心)

- pose graph optimization

- g2o / ceres

五、回环检测如何修复叠图(动态过程)

第1帧:开始建图(正常)

text

起点 ●──────●──────●👉 一切正常,没有问题

第2帧:发生漂移(误差积累)

text

真实路径: ●──────●──────●

估计路径: ●──────●──────●

\

●(开始偏了)👉 机器人位置开始"歪了"

第3帧:形成叠图(问题出现❌)

text

真实地图: ████████(墙)

错误地图: ████████(偏移了一点)

👉 两堵墙重叠(叠图)第4帧:回到起点(关键时刻🔥)

text

机器人走了一圈:

●──────●

/ \

● ●

\ /

●──────●(回到起点附近)👉 但系统此时还不知道"这是同一个地方"

第5帧:触发回环检测(发现异常!)

text

系统发现:

当前位置 ≈ 之前某个位置

👉 "诶?我好像来过这里!"第6帧:建立"约束关系"(核心🔥)

text

当前位姿 ↔ 历史位姿

│ │

└──一致性约束──┘👉 意思是:

text

这两个位置应该是同一个地方!第7帧:全局优化(地图被"拉回去")

text

优化前(歪的):

●────●────●

\

●

优化后(修正):

●────●────●────●👉 整条轨迹被"拉直"了

第8帧:叠图消失(最终效果✅)

text

优化前:

████████

████████ ❌(两层墙)

优化后:

████████ ✅(只剩一层)整体"动画版流程总结"

text

移动 → 漂移 → 叠图 ❌

↓

回到旧位置

↓

回环检测触发 🔥

↓

建立位置约束

↓

全局图优化

↓

地图被拉正 ✅回环检测本质:

text

"你现在这个位置,其实就是你以前来过的地方"👉 然后系统做:

text

"那我就把整张地图拉回正确位置"超级形象的比喻

👉 你画地图画歪了:

- 一开始画直线

- 后来越画越偏

👉 突然你发现:

text

"我回到起点了!"👉 于是你做:

text

把整张图拉直 ✨六、总结

叠图现象 = 定位漂移 + 回环失效

它是 SLAM 系统在长时间、大范围运行中常见的病态问题,直接反映系统的鲁棒性与闭环能力。

高质量的 SLAM 系统必须有效抑制叠图,才能生成一致、准确的地图。

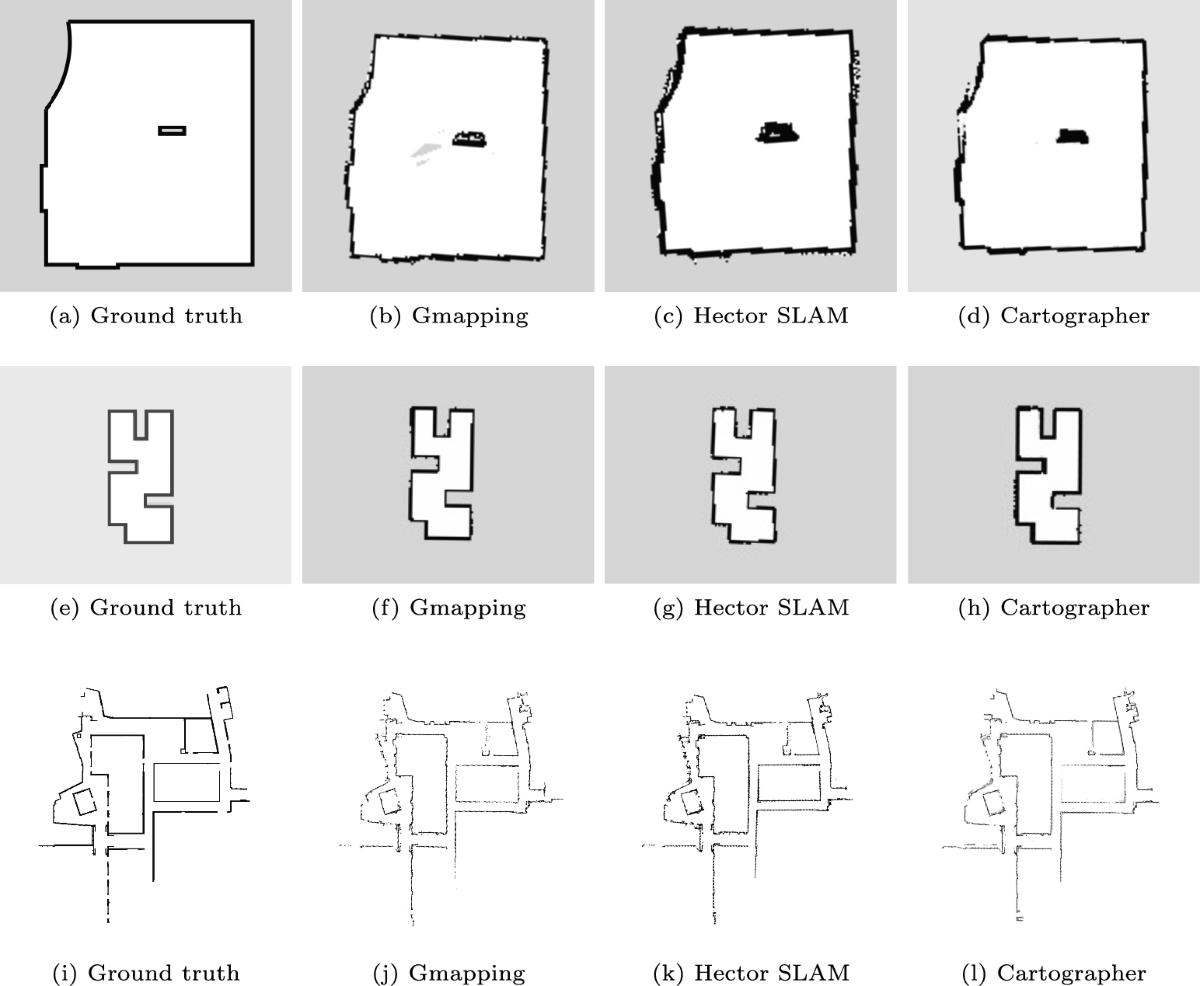

附录------激光 SLAM | 视觉 SLAM

text

激光SLAM 👉 用"几何形状"建约束

视觉SLAM 👉 用"图像特征"建约束| 对比点 | 激光 SLAM | 视觉 SLAM |

|---|---|---|

| 数据来源 | 激光点云 | 图像 |

| 边(约束) | 点云匹配(ICP) | 特征匹配 |

| 节点 | 每帧位姿 | 关键帧 |

| 精度 | 几何精度高 | 依赖纹理 |

| 漂移 | 小(稳定) | 较大 |

| 回环检测 | 几何匹配 | 图像识别(BoW) |

激光 SLAM(LiDAR)

text

节点(●):机器人位姿

边(---):激光 scan matching(ICP)

●───●───●───●

│ │

└───────────┘(回环)👉 特点:

- 边来自:点云匹配(ICP / NDT)

- 约束是:几何对齐(墙、边、角)

👉 在做:

text

"这两帧的点云形状能不能对齐?"👉 类比:

- 拼拼图(看形状)

视觉 SLAM(Camera)

text

节点(●):关键帧(keyframe)

边(---):特征匹配(ORB / SIFT)

●───●───●

\ │ /

●──●──●👉 特点:

- 边来自:特征点匹配

- 约束是:图像对应关系

👉 在做:

text

"这两张图有没有相同特征?"👉 类比:

- 找相同图案(找特征点)

误差来源差异

🔴 激光 SLAM 误差

text

- ICP 匹配失败

- 环境重复(长走廊)

- 动态物体干扰👉 结果:

- "几何对齐错了"

🔵 视觉 SLAM 误差

text

- 光照变化

- 纹理少(白墙)

- 特征匹配错误👉 结果:

- "看错了 / 认错了"

回环检测方式差异

🔴 激光 SLAM

👉 用:

- Scan Context

- 点云匹配

👉 本质:

text

形状相似 → 是同一个地方🔵 视觉 SLAM

👉 用:

- Bag of Words(BoW)

- 图像检索

👉 本质:

text

画面相似 → 是同一个地方工程上怎么选?

🏠 室内机器人

👉 激光 SLAM 更常用

- 稳定

- 不怕光照

🚗 自动驾驶 / AR

👉 视觉 SLAM 必须用

- 成本低

- 信息丰富

🤖 高端方案(融合)

👉 视觉 + 激光(VIO + LiDAR)🔥

text

视觉负责识别

激光负责精度