作为测试工程师,我们每天都在和测试用例打交道。一份好的测试用例,是保障软件质量的第一道防线。但你有没有想过,当AI能够帮我们快速生成测试用例时,我们的工作会发生怎样的变化?

过去一段时间,我尝试将AI工具融入测试用例设计工作流,发现这不仅仅是效率的提升,更是一种思维方式的转变。AI可以在几分钟内生成覆盖功能、边界、异常的测试用例初稿,而我们只需要扮演"审核者"和"优化者"的角色。

一、为什么测试工程师需要AI辅助?

传统用例设计的痛点

做过测试的朋友都知道,设计测试用例是个"苦力活"。但更让人头疼的,是那些"理想很丰满,现实很骨感"的场景:

痛点一:一句话需求,无从下手

"这个功能加个导出按钮"------就这么一句话,你敢设计测试用例吗?

导出什么格式?导出多少条数据?大数据量怎么处理?导出失败怎么办?权限怎么控制?这些关键信息一概没有。你去找产品问,产品说"你们测试专业,你们定";去找开发问,开发说"需求没说我就没做"。

最后还是测试工程师自己补全需求,心里那个苦啊。

痛点二:UI设计给的不好,看不懂

有些设计稿,颜色相近分不清层级,交互流程不标注,状态切换没说明。你拿着设计稿问设计师:"这个按钮点击后跳哪?"设计师回你:"这个还没定,你先按跳A页面测吧。"

更坑的是,设计稿和实际开发出来的界面不一样,开发说"这个改了",设计师说"我不知道",你夹在中间,用例写了也白写。

痛点三:需求复杂,拆不动

有些业务逻辑复杂得让人头皮发麻。比如一个订单流程:下单→支付→库存扣减→物流分配→状态同步→通知推送→售后入口......每个环节又有一堆分支:支付失败怎么办?库存不足怎么办?物流异常怎么办?

你想拆成测试用例,发现一个流程能拆出几十条,而且各个用例之间还有依赖关系。拆到最后,自己都绕晕了。

痛点四:验证链路太长,测不全

"用户注册→填写资料→审核→开通权限→使用功能→产生数据→数据同步→报表展示"------一个完整链路走下来,十几步操作。

问题来了:每一步都要验证吗?中间某个环节失败了,后续怎么处理?数据一致性怎么保证?环境依赖怎么解决?

痛点五:环境依赖,准备难

测一个功能,要求数据库有特定数据、Redis有特定缓存、第三方接口要mock、测试账号要特定权限......

光是准备测试环境,就花了一上午。等你准备好环境,开发说"代码有bug,我改一下",环境又要重新准备。

AI能解决什么问题

AI不是来替代你的,而是来当你的"超级助手"。面对上面那些痛点,AI能这样帮你:

针对"一句话需求":帮你补全思路

把"加个导出按钮"丢给AI,告诉它"帮我分析这个功能需要考虑哪些测试点"。AI会从功能、性能、安全、兼容性等多个维度帮你枚举,你拿着这些点去和产品、开发沟通,有理有据。

针对"UI设计不清晰":帮你梳理验证点

把设计稿截图发给支持多模态的AI(比如GPT-4V、智谱GLM-4Vision),让它帮你分析界面元素、交互流程。AI会告诉你:"这个界面有5个可点击区域,预计跳转路径是A→B→C",你再去找设计师确认。

针对"需求复杂拆不动":帮你拆解场景

把复杂业务流程描述给AI,让它帮你拆分成独立的测试场景。AI会告诉你:"这个订单流程可以拆成正常流程、支付失败分支、库存不足分支、物流异常分支......每个分支独立验证,互不影响。"

针对"验证链路长":帮你识别关键节点

把完整链路告诉AI,让它帮你识别哪些是核心验证点,哪些是辅助检查项。AI会建议:"用户注册后的权限校验是核心,建议单独设计用例;数据同步是后台任务,可以和主流程解耦。"

针对"环境依赖难":帮你准备数据模板

让AI帮你生成测试数据准备的SQL模板、mock接口的配置示例、测试账号的权限清单。虽然AI不能替你执行,但至少省去了写脚本的时间。

总结一下AI的核心能力:

| 能力 | 解决的问题 | 具体表现 |

|---|---|---|

| 快速生成初稿 | 耗时耗力 | 几分钟得到用例框架 |

| 穷举边界条件 | 容易遗漏 | AI枚举各种输入情况 |

| 提供多元视角 | 质量不稳定 | 从不同角度思考问题 |

| 统一输出格式 | 格式不统一 | 按要求输出规范格式 |

| 补全思路 | 一句话需求 | 帮你分析需要考虑的点 |

| 拆解场景 | 需求复杂 | 帮你拆分独立场景 |

| 识别关键点 | 链路太长 | 区分核心和辅助验证 |

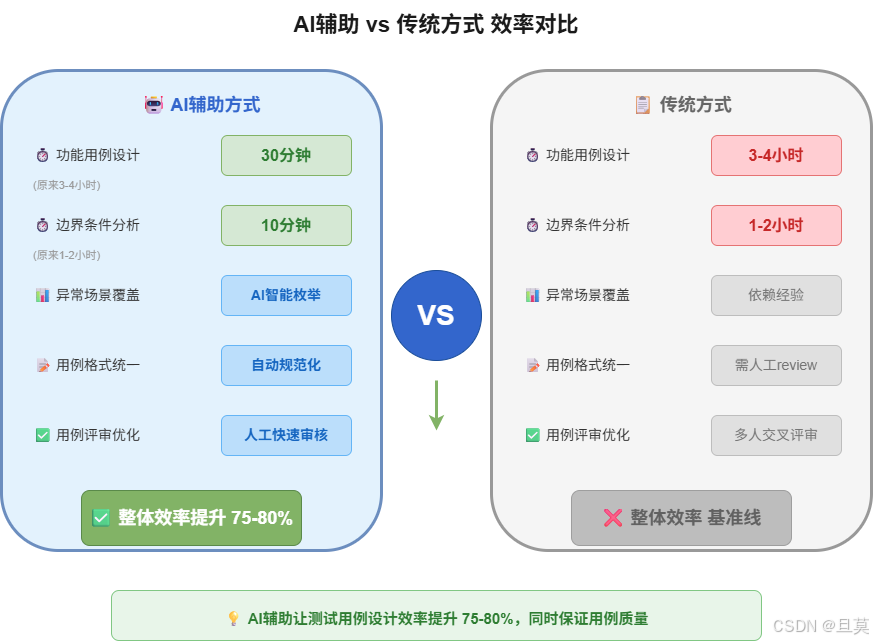

效率提升的真实数据

我统计了一下自己使用AI辅助前后的对比:

AI vs 人工对比:

| 工作环节 | 传统方式 | AI辅助方式 | 效率提升 |

|---|---|---|---|

| 功能测试用例设计 | 3-4小时/模块 | 30-50分钟 | 70-80% |

| 边界条件分析 | 1-2小时 | 10-15分钟 | 85%+ |

| 异常场景覆盖 | 依赖经验 | AI枚举+人工筛选 | 60%+ |

| 用例格式统一 | 需要专项review | 直接输出规范格式 | 90%+ |

注意: AI生成的是初稿,需要人工审核和优化。完全依赖AI、跳过审核环节是危险的。AI是好帮手,不是替代者。

二、AI生成测试用例的核心方法

提示词设计的基本原则

想让AI输出高质量的测试用例,关键在于提示词的设计。这里有几个基本原则:

1. 角色设定要明确

告诉AI"你是谁",它就会以相应的专业视角来回答。就像你让一个资深测试工程师帮你设计用例,他会从专业角度思考;同样,你让AI扮演这个角色,它也会遵循测试工程师的思维模式。

2. 任务描述要清晰

不要只说"帮我设计测试用例",要说明针对什么功能、用什么类型的用例、需要覆盖哪些方面。越具体,AI理解越准确。

3. 背景信息要完整

把相关的功能描述、业务规则、接口说明等一股脑儿提供给AI。信息越多,AI生成的用例越贴合实际。

4. 输出格式要规范

提前告诉AI你期望的用例格式,比如"前置条件-测试步骤-预期结果"三段式,或者表格形式。AI会严格按照你的要求输出。

5. 约束条件要说清

明确哪些是需要的,哪些是不需要的。比如"不需要自动化脚本"、"不包括性能测试用例",这样AI不会跑偏。

结构化思维

一个好的提示词,结构清晰是关键。我总结了一个"六段式"提示词结构:

角色设定 → 任务描述 → 背景信息 → 输出要求 → 参考示例 → 约束条件这六个部分层层递进,让AI从"我是谁"到"我要做什么"到"我该怎么做",逻辑清晰,输出稳定。

通用方法论

不管你用哪个AI工具(ChatGPT、Claude、文心一言等),这个方法论都适用:

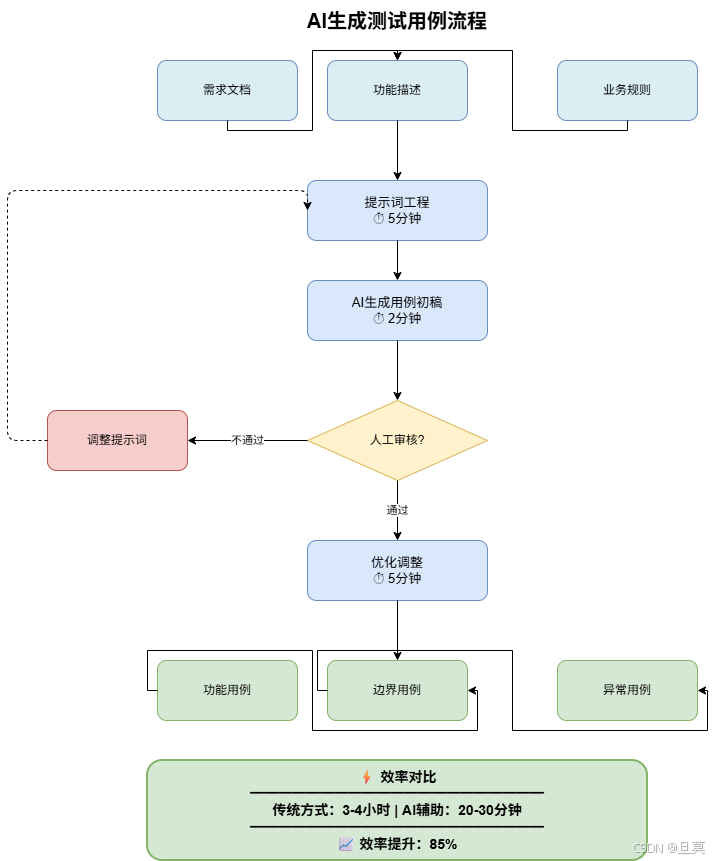

Step 1:准备需求材料

把功能描述、需求文档、业务规则等整理好,越详细越好。

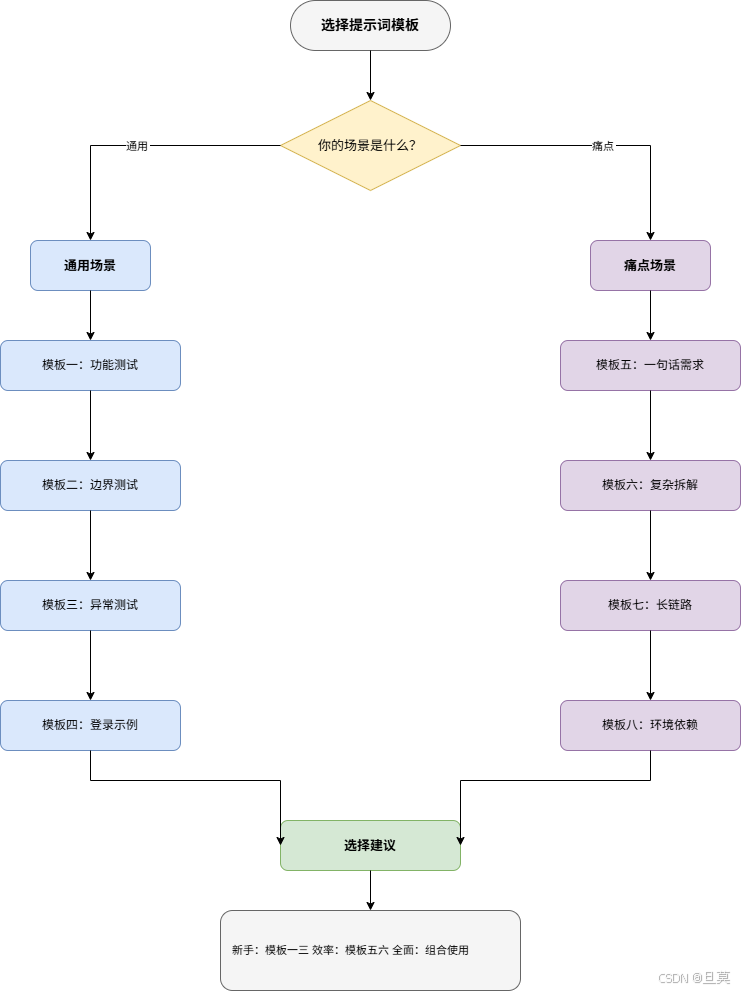

Step 2:选择合适的提示词模板

根据用例类型(功能测试、边界测试、异常测试),选择对应的模板。

Step 3:输入提示词并生成

把需求材料和问题一起丢给AI,等待生成结果。

Step 4:审核与优化

检查AI生成的用例,补充遗漏、修正错误、调整格式。

Step 5:沉淀为团队资产

把验证有效的提示词模板和输出结果存档,形成团队知识库。

AI生成测试用例流程图:

三、我的提示词模板分享

8个提示词模板选择指南:

终于到了重点环节!以下是我的实操模板,每个都经过多次验证,可以直接复制使用。

模板一:功能测试用例生成

你是一名资深软件测试工程师,拥有10年功能测试经验。

## 任务

请为以下功能设计完整的功能测试用例。

## 功能描述

【粘贴功能描述内容】

## 业务规则

【粘贴业务规则文档】

## 输出要求

1. 用例格式:编号 | 用例名称 | 前置条件 | 测试步骤 | 预期结果

2. 覆盖所有功能点

3. 每个功能点至少3个测试用例

4. 用例命名规范,清晰表达测试目的

## 参考格式

| TC001 | 验证正常登录 | 已注册用户 | 1. 打开登录页 | 2. 输入正确账号密码 | 3. 点击登录 | 跳转首页并显示用户信息 |使用说明:

- 将【】中的内容替换为你的实际需求

- 可以根据项目要求调整输出格式

- 如果不需要某些列,直接在要求中说明

模板二:边界测试用例生成

你是一名资深软件测试工程师,擅长边界值分析和等价类划分。

## 任务

请为以下功能设计边界测试用例,重点覆盖边界条件和极端情况。

## 功能描述

【粘贴功能描述内容】

## 输入参数说明

【描述各输入字段的类型、范围、格式要求】

## 输出要求

1. 用例格式:编号 | 测试场景 | 输入值 | 预期结果 | 测试类型

2. 测试类型包括:边界值、最大值、最小值、空值、超长输入、特殊字符等

3. 覆盖所有输入字段

4. 说明每个测试用例对应的边界分析思路

## 边界分析维度

- 最小值/最大值

- 空值和空字符串

- 首位/末位边界

- 超长输入(超过最大长度)

- 格式错误(不符合要求的格式)

- 特殊字符(<>;&等)使用说明:

- 边界测试是发现缺陷的"重灾区",一定要认真对待

- AI生成的边界值可能和你的分析一致,可以快速验证

- 关注AI给出的"边界分析思路",这是学习的过程

模板三:异常测试用例生成

你是一名资深软件测试工程师,擅长异常场景分析和故障保护测试。

## 任务

请为以下功能设计异常测试用例,覆盖各种错误情况和容错场景。

## 功能描述

【粘贴功能描述内容】

## 系统环境说明

【描述系统运行环境、依赖服务、网络条件等】

## 输出要求

1. 用例格式:编号 | 异常场景 | 触发条件 | 测试步骤 | 预期结果 | 严重程度

2. 严重程度:P0(致命)/ P1(严重)/ P2(一般)/ P3(轻微)

3. 覆盖以下异常类型:

- 网络异常(断开、超时、弱网)

- 数据异常(为空、格式错误、超限)

- 并发异常(多用户同时操作)

- 依赖服务异常(下游接口不可用)

- 权限异常(未登录、无权限)

## 容错设计关注点

- 错误提示是否友好清晰

- 是否提供重试机制

- 是否有数据保护措施

- 异常恢复后功能是否正常使用说明:

- 异常测试往往被忽略,但线上问题很多来自异常场景

- 可以让AI假设各种"不利条件",帮助你思考盲区

- 建议P0级别的异常用例必须100%覆盖

模板四:登录模块完整示例

为了让大家更直观地理解模板的使用,这里给一个完整的例子------登录模块的测试用例生成。

输入的提示词:

你是一名资深软件测试工程师,拥有10年功能测试经验。

## 任务

请为"用户登录"功能设计完整的测试用例。

## 功能描述

用户登录是系统的入口功能,支持手机号+验证码登录和账号+密码登录两种方式。

- 手机号必须是中国大陆11位手机号

- 验证码有效期5分钟,有效期内可重复使用

- 密码8-20位,必须包含字母和数字

- 连续输错5次密码,账号锁定30分钟

- 登录成功后生成token,有效期7天

## 输出要求

1. 用例格式:编号 | 用例名称 | 前置条件 | 测试步骤 | 预期结果

2. 分为功能测试、边界测试、异常测试三大类

3. 总用例数不少于30条

4. 每条用例清晰可执行

## 重点关注

- 两种登录方式的正常流程

- 手机号格式校验

- 验证码的各种状态(过期、错误、有效)

- 密码的各种校验(格式、次数限制)

- 并发登录场景AI生成的用例片段(部分示例):

| TC001 | 正常登录-手机号验证码 | 手机号已注册 | 1. 打开登录页 | 2. 选择手机号登录 | 3. 输入正确手机号和验证码 | 4. 点击登录 | 跳转首页并显示用户信息 |

| TC015 | 验证码过期 | 已获取验证码 | 1. 获取验证码 | 2. 等待超过5分钟 | 3. 输入验证码 | 4. 点击登录 | 提示"验证码已过期,请重新获取" |

| TC021 | 密码输错5次锁定 | 账号未锁定 | 1. 输入正确手机号 | 2. 连续输错5次密码 | 3. 输入正确密码 | 4. 点击登录 | 提示"账号已锁定,请30分钟后再试" |

后续优化:

AI生成的用例作为初稿,我通常会补充:

- 关联的测试数据准备说明

- 测试环境的特殊要求

- 与其他模块的集成测试点

模板五:一句话需求补全(解决痛点一)

当需求只有一句话时,用这个模板帮你把思路打开:

你是一名资深软件测试工程师,擅长从简单描述中挖掘完整测试点。

## 任务

我收到了一个一句话需求,请帮我分析需要考虑哪些测试点,并列出需要和产品确认的问题清单。

## 需求描述

【一句话需求,如:加个导出按钮】

## 输出要求

1. 测试点分析:从以下维度枚举需要测试的内容

- 功能测试点

- 边界测试点

- 性能测试点

- 安全测试点

- 兼容性测试点

- 用户体验测试点

2. 待确认问题清单:列出需要和产品、开发沟通确认的关键问题

3. 测试用例框架:基于已有信息,生成用例框架(标注假设部分)

## 输出格式

### 测试点分析

| 维度 | 测试点 |

|------|--------|

| 功能 | xxx |

### 待确认问题清单

1. xxx

### 测试用例框架

| 编号 | 用例名称 | 前置条件 | 测试步骤 | 预期结果 | 备注(假设) |使用场景:

- 需求描述过于简单,不知道从哪下手

- 需要和产品沟通但不知道问什么

- 快速建立测试思路框架

模板六:复杂场景拆解(解决痛点三)

当需求复杂得让你头皮发麻时,用这个模板帮你拆:

你是一名资深软件测试工程师,擅长复杂业务场景的拆解和分析。

## 任务

请帮我将以下复杂业务场景拆分成可独立测试的子场景。

## 业务场景描述

【粘贴复杂业务流程,如:下单→支付→库存扣减→物流分配→状态同步→通知推送→售后入口】

## 已知分支情况

【描述已知的分支条件,如:支付失败怎么办?库存不足怎么办?】

## 输出要求

1. 场景拆分:将复杂场景拆分成独立的测试场景,每个场景可独立验证

2. 依赖关系:标注场景之间的依赖关系和数据流向

3. 优先级排序:按P0/P1/P2标注各场景优先级

4. 测试策略建议:哪些场景需要联调,哪些可以独立测试

## 输出格式

### 场景拆分表

| 场景编号 | 场景名称 | 前置场景 | 关键验证点 | 优先级 |

|----------|----------|----------|------------|--------|

| S01 | 正常下单流程 | 无 | 订单创建成功 | P0 |

### 依赖关系图

用文字描述场景之间的依赖关系

### 测试策略

- 可独立测试的场景:xxx

- 需要联调的场景:xxx

- 建议的测试顺序:xxx使用场景:

- 业务流程复杂,用例拆分困难

- 各场景之间有依赖关系

- 需要制定测试优先级和策略

模板七:长链路验证点识别(解决痛点四)

当验证链路长得让你崩溃时,用这个模板帮你识别关键点:

你是一名资深软件测试工程师,擅长识别关键验证点和优化测试策略。

## 任务

请帮我分析以下测试链路,识别关键验证点,区分核心检查项和辅助检查项。

## 完整链路描述

【粘贴完整链路,如:用户注册→填写资料→审核→开通权限→使用功能→产生数据→数据同步→报表展示】

## 输出要求

1. 链路节点分析:分析每个节点的测试价值

2. 核心验证点:标注必须100%覆盖的核心验证点

3. 辅助检查项:标注可以抽检或降级验证的检查项

4. 数据一致性检查:识别需要验证数据一致性的节点

5. 环境依赖说明:标注需要特殊环境准备的节点

## 输出格式

### 链路节点分析

| 节点 | 验证价值 | 检查类型 | 环境要求 |

|------|----------|----------|----------|

| 用户注册 | 高 | 核心验证 | 无 |

### 核心验证点(必须100%覆盖)

1. xxx

### 辅助检查项(可抽检)

1. xxx

### 数据一致性检查点

1. xxx

### 环境依赖清单

| 节点 | 依赖项 | 准备方式 |

|------|--------|----------|使用场景:

- 测试链路长,不知道重点在哪

- 想区分核心和辅助验证点

- 需要评估测试工作量

模板八:环境依赖准备(解决痛点五)

当环境准备让你头疼时,用这个模板帮你生成准备清单:

你是一名资深软件测试工程师,擅长测试环境搭建和数据准备。

## 任务

请帮我梳理测试以下功能需要准备的环境和数据清单。

## 功能描述

【粘贴功能描述】

## 输出要求

1. 数据库准备:需要准备的表、字段、数据量

2. 缓存准备:Redis需要设置的key和value

3. Mock接口:需要mock的第三方接口列表

4. 测试账号:需要的测试账号类型和权限

5. 配置项:需要检查或修改的配置

6. 准备脚本模板:生成SQL和配置示例

## 输出格式

### 环境依赖清单

| 依赖类型 | 具体内容 | 准备方式 | 优先级 |

|----------|----------|----------|--------|

| 数据库 | xxx表需要100条测试数据 | 执行SQL | P0 |

### 数据库准备SQL模板

-- 这里会生成具体的SQL

### Mock接口配置示例

{

"接口名": "配置示例"

}

### 测试账号清单

| 账号类型 | 权限说明 | 用途 |

|----------|----------|------|使用场景:

- 不清楚需要准备哪些环境和数据

- 需要生成数据准备脚本

- 团队成员协作需要明确分工

特别说明:

以上8个模板覆盖了从简单到复杂的各种场景。使用时要注意:

-

根据实际情况选择模板:一句话需求用模板五,复杂场景用模板六,不要一刀切。

-

灵活组合使用:复杂功能可能需要先用模板六拆解,再用模板一生成具体用例。

-

持续积累优化:每次使用后记录效果,形成自己的模板库。

四、实战效果与建议

AI生成 vs 人工设计对比

| 对比维度 | AI生成 | 纯人工 |

|---|---|---|

| 效率 | ⭐⭐⭐⭐⭐ 几分钟生成初稿 | ⭐⭐ 半天到一天 |

| 覆盖率 | ⭐⭐⭐ 可能遗漏特殊边界 | ⭐⭐⭐⭐ 依赖个人经验 |

| 创新性 | ⭐⭐ 依赖训练数据 | ⭐⭐⭐⭐ 可发现隐藏场景 |

| 一致性 | ⭐⭐⭐⭐⭐ 格式统一规范 | ⭐⭐⭐ 因人而异 |

| 业务理解 | ⭐⭐ 需要详细背景 | ⭐⭐⭐⭐ 深入理解业务 |

结论: AI生成 + 人工审核 = 最优解。AI负责快速产出,人工负责质量把控和场景补充。

适用场景建议

AI辅助非常有效的场景:

- 新功能测试用例设计(需求文档完善)

- 边界值和等价类分析

- 回归测试用例批量生成

- 用例格式统一和规范化

- 测试点头脑风暴和发散思考

建议人工主导的场景:

- 业务流程复杂的核心功能

- 涉及安全性敏感性的测试

- 需要深入业务理解的场景

- 探索性测试和随机测试

- 经验依赖性强的领域测试

容易踩的坑

坑1:提示词太模糊

❌ "帮我设计登录测试用例"

✅ "为手机号+验证码登录功能设计测试用例,覆盖正常流程、验证码过期、格式校验等场景"

坑2:不给足够背景信息

❌ 只给功能名称

✅ 提供完整的功能描述、业务规则、输入输出说明

坑3:完全依赖AI不审核

❌ AI输出的用例直接使用

✅ AI生成是初稿,必须人工审核每一条用例的准确性和完整性

坑4:不分场景滥用模板

❌ 所有功能都用同一套提示词

✅ 根据功能复杂度、用例类型选择合适的模板

坑5:不积累自己的模板库

❌ 每次都重新写提示词

✅ 沉淀验证有效的模板,持续优化迭代