换个风格打开线性代数

- 矩阵 = 空间 / 图形 / 数据的变形控制器

- 特征向量 = 变形时绝不转向的固定主轴

- 特征值 = 每个主轴上的变形力度

- 编程的意义:不用手算复杂行列式、不用解高次方程,靠画图 + 计算,用眼睛看懂线性代数,从枯燥做题变成可视化兴趣学习。

如何理解特征值和特征向量呢?

用最直观的代码,解决 90% 同学听不懂的核心问题:

到底什么是特征向量?

特征值到底代表什么?矩阵变换里,它凭什么是「不变轴」?

1 特征值与特征向量求解

python

echo "

import numpy as np

import matplotlib.pyplot as plt

plt.switch_backend('Agg')

A = np.array([[2, 1], [1, 2]])

eigenvalues, eigenvectors = np.linalg.eig(A)

print('='*50)

print('Matrix A:')

print(A)

print('Eigenvalues:')

print(eigenvalues)

print('Eigenvectors:')

print(eigenvectors)

plt.figure(figsize=(6,4))

plt.bar(['λ1','λ2'], eigenvalues, color=['#ff7f0e','#2ca02c'])

plt.title('Eigenvalues of Matrix A')

plt.grid(alpha=0.3)

plt.savefig('eigenvalues.png', dpi=150, bbox_inches='tight')

print('Image saved: eigenvalues.png')

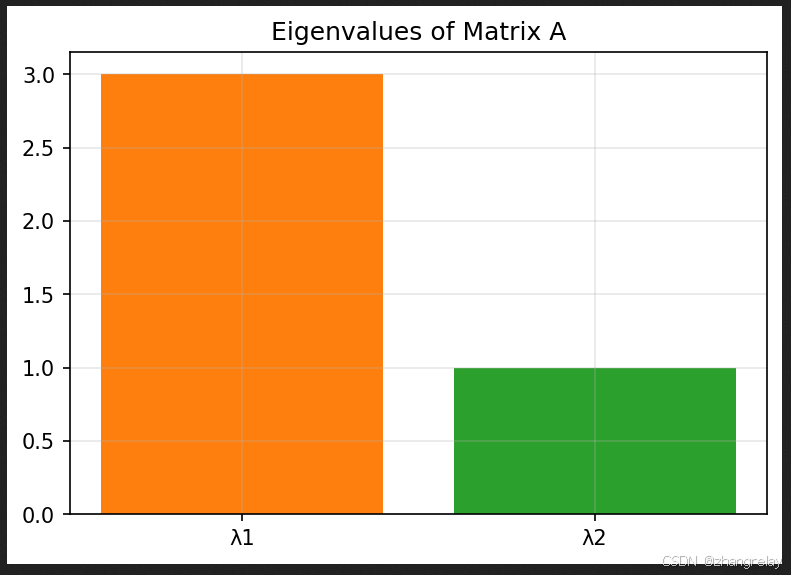

" > eigenvalues_demo.py && python3 eigenvalues_demo.py 图1 特征值

图1 特征值

我们随便写一个二阶二维矩阵,代码直接算出两组关键数据:特征值、特征向量。

你可以把矩阵想象成空间变形工具,它会把平面里所有点、所有向量进行拉伸、挤压、偏转。

但这个变形工具不是乱变的,它天生自带两个固定「核心方向」和「变形强度」:

- 特征向量 = 这个矩阵天生固定不变的两条主轴

- 特征值 = 对应主轴上的变形放大 / 缩小倍数

这段代码就是把矩阵隐藏的「先天属性」直接扒出来,还用柱状图画出特征值大小,肉眼就能看出:哪个方向拉伸更强、哪个方向变化更弱。

日常学习意义:复杂矩阵不用手算,代码一秒提取核心性质。

2 特征向量不变方向可视化

python

echo "

import numpy as np

import matplotlib.pyplot as plt

plt.switch_backend('Agg')

A = np.array([[2, 1], [1, 2]])

vals, vecs = np.linalg.eig(A)

plt.figure(figsize=(8, 8))

plt.axhline(0, color='gray', lw=0.5)

plt.axvline(0, color='gray', lw=0.5)

np.random.seed(0)

for _ in range(25):

v = np.random.randn(2)

Av = A @ v

plt.arrow(0, 0, v[0], v[1], color='deepskyblue', alpha=0.4, lw=1)

plt.arrow(0, 0, Av[0], Av[1], color='orange', alpha=0.6, lw=1.2)

for i in range(2):

ev = vecs[:, i]

plt.arrow(0, 0, ev[0]*5, ev[1]*5, color='red', lw=3)

plt.xlim(-7,7)

plt.ylim(-7,7)

plt.title('Eigenvectors remain in same direction')

plt.grid(alpha=0.2)

plt.savefig('eigenvector_direction.png', dpi=150, bbox_inches='tight')

print('Image saved: eigenvector_direction.png')

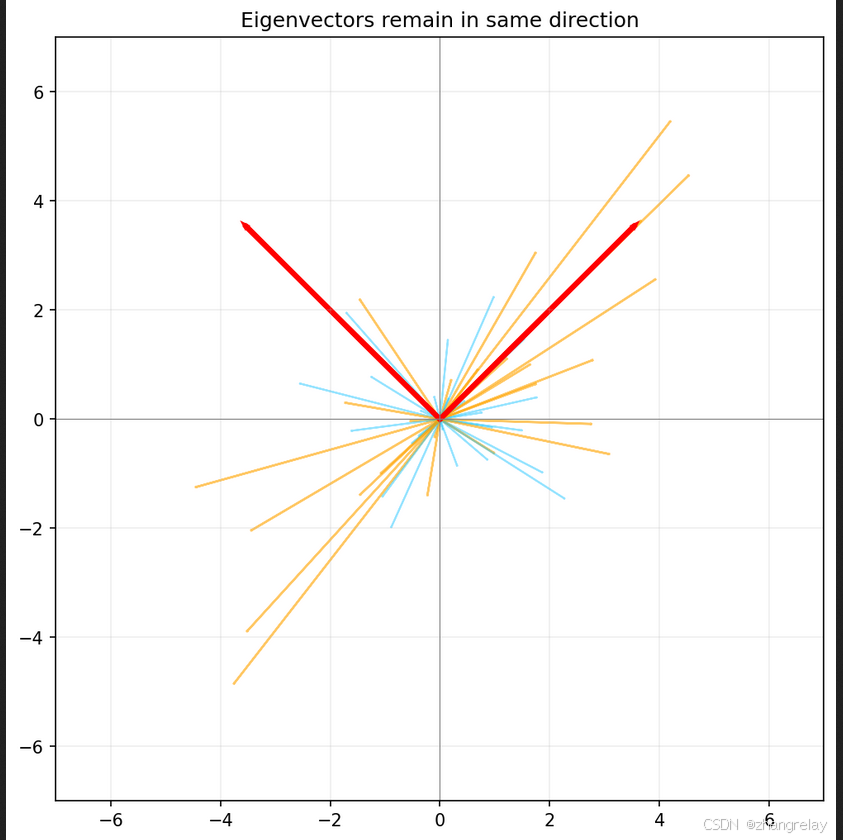

" > eigenvector_direction.py && python3 eigenvector_direction.py 图2 特征向量不变方向可视化

图2 特征向量不变方向可视化

这是最容易顿悟的一个案例。程序随机生成一大堆杂乱的蓝色小箭头,代表平面里普通的任意方向。

当矩阵开始作用(空间变形)后:

- 普通蓝色箭头,全部歪掉、转向、拉长变短,形态完全改变

- 唯独两条红色粗箭头,角度完全不动,只会单纯变长

通俗大白话:不管这个矩阵怎么扭曲整个平面,红色箭头的方向永远 "纹丝不动",它是变形过程里唯一不迷路、不转向的稳定方向 。这就是特征向量最本质的意义:全局变换里的稳定骨架。

3 验证 A・v = λ・v 公式

python

echo "

import numpy as np

A = np.array([[2, 1], [1, 2]])

vals, vecs = np.linalg.eig(A)

lambda1 = vals[0]

v1 = vecs[:, 0]

Av = A @ v1

lam_v = lambda1 * v1

print('='*50)

print('A @ v1 =', Av)

print('λ * v1 =', lam_v)

print('Error:', np.max(np.abs(Av - lam_v)))

print('='*50)

" > eigen_verify.py && python3 eigen_verify.py很多人上课背定义,但根本不知道式子是不是真的成立。这段代码直接做实测对比:

拿一条稳定的特征向量,一边用矩阵整体变换它,一边只用特征值单纯缩放它。

最后程序输出结果:两组数值几乎一模一样,误差接近 0。不用纠结数学推导,只用电脑计算就能证明:稳定方向的向量,整体变换 = 单纯缩放。彻底打消抽象感,知道课本结论是真实存在、可以被计算验证的。

4 矩阵变换拉伸主轴可视化

python

echo "

import numpy as np

import matplotlib.pyplot as plt

plt.switch_backend('Agg')

A = np.array([[1.5, 0.5], [0.5, 1.5]])

vals, vecs = np.linalg.eig(A)

square = np.array([[1,1],[-1,1],[-1,-1],[1,-1],[1,1]]).T

orig = square

trans = A @ square

plt.figure(figsize=(7,7))

plt.plot(orig[0], orig[1], 'c-', label='Original')

plt.plot(trans[0], trans[1], 'r-', label='Transformed')

for i in range(2):

ev = vecs[:,i]

plt.arrow(0,0, ev[0]*4, ev[1]*4, color='lime', lw=2)

plt.axis('equal')

plt.title('Eigenvectors = main stretch axes')

plt.legend()

plt.grid(alpha=0.3)

plt.savefig('eigen_stretch.png', dpi=150, bbox_inches='tight')

print('Image saved: eigen_stretch.png')

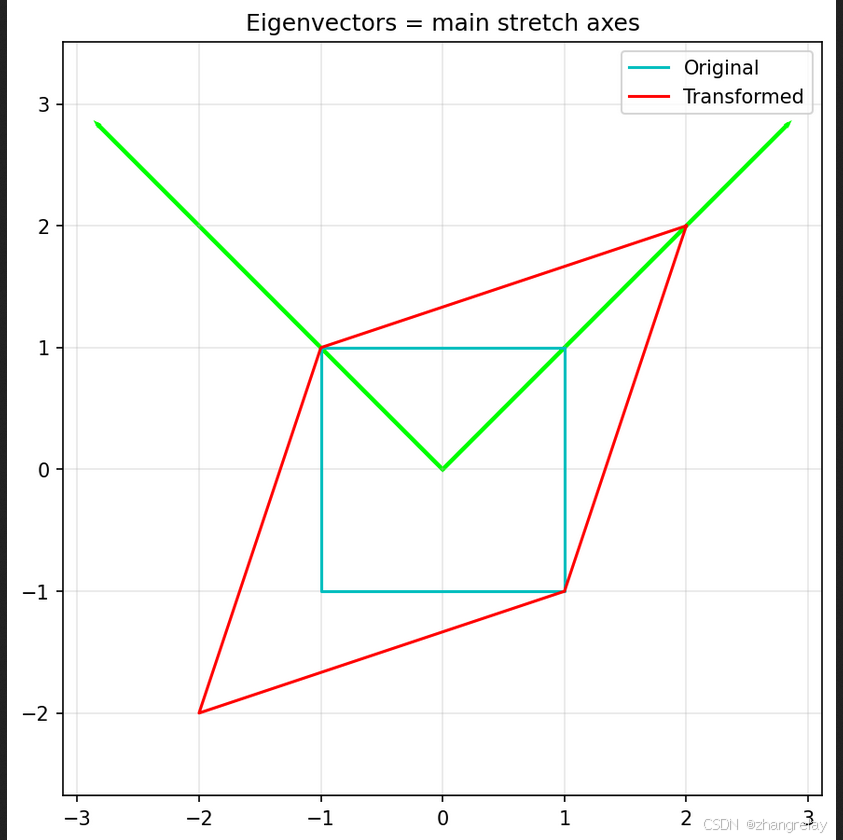

" > eigen_stretch.py && python3 eigen_stretch.py 图3 矩阵变换拉伸主轴可视化

图3 矩阵变换拉伸主轴可视化

我们画一个规规矩矩的正方块,代表原本平整标准的平面图形。

用矩阵做一次整体变换后,方块被拉斜、拉长、变成不规则四边形。

画面里两条绿色箭头,就是这个变形的核心控制轴:整个图形的拉长、挤压,全部顺着这两条绿色方向进行;

所有扭曲、形变,都是围绕这两个主轴展开。

放到现实更好理解:

- 图片压缩、画面拉伸、游戏模型形变

- 大数据降维、AI 特征提取底层全是靠「矩阵 + 特征主轴」实现,这也是线性代数在生活里真正的用途,不是单纯做题。

结合四个编程案例|通俗全面讲解:矩阵、特征值、特征向量(无公式、兴趣向、连贯概括)

结合你刚才四段可直接运行的可视化代码,我把矩阵到底是什么、矩阵能干什么、特征值与特征向量的实际意义、线性代数核心逻辑,完整串成一套通俗易懂、连贯好懂的整体讲解,完全脱离课本枯燥概念。

一、先搞懂:矩阵的本质到底是什么

不要把矩阵当成一堆枯燥数字表格。

从这四个可视化案例能直接看明白:

矩阵本质就是一套「空间变形规则」。

整个二维平面里,所有线段、图形、方向,只要被这个矩阵作用,就会统一发生一套固定变化:有的方向被拉长,有的被压缩,有的被掰弯旋转,有的被倾斜剪切。

一个矩阵,就代表一种独一无二的「扭曲、拉伸、挤压方案」。

普通数字只能做加减乘,矩阵可以批量改造整个空间,这就是线性代数之所以重要的根本原因。

二、普通向量:被矩阵随意篡改

参考案例 2、案例 4 的画面:

平面里随便取一个普通箭头、普通图形边,只要经过矩阵变换:方向会歪、角度会变、长短会乱、形态完全失控。

绝大多数方向,都会被这套变形规则随意改变,没有任何稳定性。

对应现实:

杂乱无章的原始数据、无规律的图像像素、随机信号,都会被规则改造,变得面目全非。

三、关键核心:矩阵永远藏着两条「不变主轴」

这是四个案例共同揭示的线性代数最核心秘密:

无论矩阵的扭曲多么复杂、变形多么混乱,

它一定存在若干个完全不会转向的固定方向。

放在画面里:案例 2 红色箭头、案例 4 绿色箭头,就是这两个特殊方向。整个空间乱变形、所有普通方向全部偏转,

唯独这两个方向,只变长或变短,绝不拐弯、绝不偏移。

这组「永远不被扭歪的特殊方向」,就是特征向量。你可以理解为:

一套混乱变形规则里,唯一保持立场不变的「骨架支撑」。

四、特征值:控制变形强度的刻度

有了不变的骨架方向,那变形有多剧烈?

答案就是特征值。

案例 1 专门把特征值做成柱状图展示:

- 特征值数值大:这个主轴方向会被大幅度拉伸

- 特征值数值小:这个方向会被压缩、收缩

- 特征值为负数:方向会直接反向翻转

简单总结:特征向量 = 不变的骨架方向

特征值 = 这个方向上的变形力度大小

二者绑定成对,是一个矩阵最核心的「天赋属性」。

五、代码验算证明:这套规则绝对成立

案例 3 做了纯数值验证:

我们用两种方式对待特征向量:

- 直接用完整矩阵做全套空间变形

- 不做扭曲,只靠特征值单纯缩放长度

最终计算结果几乎完全一致。这就用电脑实打实证明:

在特征向量这条特殊方向上,复杂矩阵变换 = 简单放大缩小。

原本复杂难懂的矩阵运算,在它自己的特征方向上,直接降级成最简单的倍数缩放。

这也是线性代数所有简化计算、数据降维、模型优化的底层逻辑。

六、结合图形案例:看懂矩阵的实际工作方式

案例 4 的正方形变换最贴近现实:

原本规整的正方形,被矩阵拉成倾斜菱形。

整个图形的歪斜、拉长、挤压,全部严格顺着特征主轴发生。

所有复杂形变,不是乱扭,而是:

以两个特征方向为核心,一个方向拉长、一个方向压缩,组合出来的整体效果。

放到真实应用场景就很好理解:

- 图片美颜、拉伸、畸变矫正 → 依靠矩阵主轴形变

- 游戏 3D 模型放大、旋转、扭曲 → 矩阵变换

- AI 数据分析、去除冗余信息 → 保留主要特征方向,删掉次要压缩方向

- 物理震动、力学结构、流体运动 → 靠矩阵特征方向判断稳定振动模式

七、整体大总结(全篇连贯浓缩)

- 矩阵不是数字表格,是整套空间与图形的标准化变形规则,能批量改变所有方向与图形。

- 绝大多数普通向量、普通方向,在矩阵作用下都会偏转、扭曲、失去原本形态。

- 任何一个矩阵,都自带固定数量的稳定骨架方向(特征向量),变形时方向永远不变。

- 每个骨架搭配一个强度系数(特征值),决定该方向拉伸、压缩、反向的程度。

- 在特征方向上,复杂矩阵运算会极度简化,这是线性代数一切简化算法的根源。

- 通过编程可视化,能直观看到形变、骨架、强度差异,彻底摆脱课本纯计算的枯燥,用兴趣理解线性代数:矩阵负责变形,特征向量负责定方向,特征值负责定强度。

纯通俗・无公式・兴趣驱动|线性代数「矩阵全通关概论」

完全沿用你要的讲解风格:

不写复杂公式、不搞课本硬推导、全靠画面逻辑 + 生活类比 + 结合之前 4 段可视化代码理解,一口气讲完线性代数全部核心知识点:矩阵、运算、秩、向量、方程组、特征值、特征向量、对角化、空间变换、实际用途,

从头到尾连贯、通俗、好吸收,彻底打通线代底层逻辑。

一、核心底层:到底什么是矩阵?

抛开课本定义:

矩阵就是一套标准化的「世界改造规则」。

你可以把它理解成一个「变形机器」「数据加工工厂」。

- 普通数字:只能做加减乘,改单一数值

- 矩阵:可以一次性批量改造一堆数据、一整个平面、一整个空间

里面每一行、每一列,都是改造规则的细节;

只要给定一个矩阵,整个空间的拉伸、挤压、旋转、倾斜、偏移,就全部被固定死,不会乱变。

所有线性代数,本质都是:

研究矩阵怎么改造世界,以及找到改造里的规律与漏洞。

二、矩阵基础:行列、类型,通俗理解

- 行数 & 列数

可以理解为:改造规则的「输入数量」和「输出数量」。

-

几行 = 输出几个结果,几列 = 接收几个原始数据。

-

方阵

-

行列相等的矩阵,就是正方形改造器 。只改造同维度空间,二维改二维、三维改三维,

-

我们之前特征值全部用方阵,因为只有方阵,才有「固定不变的主轴」。

-

零矩阵 / 单位矩阵

- 零矩阵:清空机器,不管输入什么,全部变成 0

- 单位矩阵:原装机器,完全不改造,输入啥输出啥,相当于没变形

三、矩阵两大基础运算:加法 & 乘法

1. 矩阵加法

两个改造规则叠加在一起,

相当于「双重变形叠加」,力度合并,规则合并,逻辑简单直白。

2. 矩阵乘法【线代第一重点】

绝对不是简单对应相乘

通俗理解:把「两套改造规则串联执行」。先用右边矩阵改造一次,再用左边矩阵改造一次,矩阵乘法 = 连续两次空间变形、连续两次数据筛选加工。

关键点:

顺序绝对不能换,先变形和后变形,最终效果完全不一样,所以矩阵乘法不满足交换律,这也是现实里机械、图形、数据改造的真实规律。

四、逆矩阵:变形的「还原按钮」

现实里:你把图形拉长、倾斜之后,总想恢复原样。

逆矩阵就是反向改造、撤销变形的工具。

- 普通矩阵:正向扭曲空间

- 逆矩阵:反向抵消扭曲,变回去

不是所有矩阵都有逆:

如果一个矩阵把空间「压塌了」「压缩成一条线、一个点」,信息直接丢失,就没法还原,这种没有逆的矩阵,就是奇异矩阵。

五、矩阵的灵魂:秩(最重要概念)

秩是整个线性代数的核心天花板,通俗解释:

秩 = 这个矩阵「真实有效改造能力的维度」

举个直白例子:

- 秩 = 2:完整二维改造,平面能正常拉伸、扭曲,信息完整

- 秩 = 1:二维被压成一条线,所有图形塌缩成线段,大量信息丢失

- 秩 = 0:直接压成一个点,全部清零

放到做题和应用里:

- 秩越小,改造越无力,信息压缩越严重

- 秩决定方程组有没有解、解多不多

- 秩决定矩阵能不能反向还原、能不能对角化

看懂秩,就看懂了一半线性代数。

六、向量与矩阵的关系

向量就是「一个方向、一组基础数据」。

矩阵和向量的关系:矩阵负责整体规则,向量负责被改造的个体。

- 随便一个普通向量:被矩阵改造后,方向乱转、长短乱变

- 一群向量组合在一起:就是一个空间

- 矩阵乘一组向量 = 整个空间集体变形

之前可视化案例里:

蓝色普通箭头,就是普通向量,全部被扭歪;完美对应这个逻辑。

七、线性方程组:矩阵最基础用途

课本天天解方程,本质很简单:

方程组 = 「已知改造结果,反推原始数据」

- 系数矩阵:改造规则

- 未知数:原始数据

- 等号右边:改造之后的结果

秩直接决定一切:

- 秩足够:信息完整,有唯一解

- 秩不够:信息被压缩,无穷多解

- 矛盾变形:规则冲突,无解

不用算行列式,用「空间有没有被压塌」就能理解方程组全部结论。

八、行列式:空间压缩比例

不用公式:

行列式就是整个空间被压缩 / 放大的总倍数。

- 行列式为正数:空间正常变形,方向不翻转

- 行列式为负数:整体镜像翻转、反向扭曲

- 行列式 = 0:空间直接塌缩,压成线或点 → 就是奇异矩阵,没有逆

它是快速判断矩阵「是否塌缩、能否还原」的快捷工具。

九、核心重难点:特征值 & 特征向量(结合你 4 个案例)

这是线代最高价值内容,结合之前可视化案例统一总结:

- 特征向量

整个空间疯狂扭曲、所有普通方向全部偏转时,完全不转向、只改变长短的固定骨架方向。

-

-

是矩阵改造规则里,最稳定、最核心、最本质的固有方向。

-

特征值

- 每一条骨架方向对应的「变形力度」:

- 数值大:强力拉伸

- 数值小:压缩收缩

- 负数:方向反向

- 底层规律

复杂的全局矩阵变形,在特征向量这条专属轴线上,会直接简化成单纯放大缩小。

-

这是大数据、AI、图形学能简化海量计算的根本。

-

代码验证

-

之前案例 3 纯数值证明:矩阵复杂变换 = 特征值简单缩放,

- 肉眼 + 计算双重实锤,不是课本空想理论。

十、相似矩阵 & 对角化

1. 相似矩阵

两套不一样的变形外壳,本质核心骨架完全一样。

只是换了一套观察角度,特征值完全相同,内在改造能力一致。

2. 对角化(线代终极简化)

绝大多数复杂扭曲矩阵,

都可以通过坐标变换,拆成「多个独立拉伸轴」。

把混乱的斜着扭曲,

拆解成几个互相垂直、互不干扰的单纯伸缩 ,计算量直接暴跌几十倍。而能对角化的关键:就是够数量的独立特征向量。

十一、特殊矩阵的现实意义

- 对称矩阵

最稳定的一类矩阵,特征方向互相垂直,改造规则工整,

-

物理力学、AI 数据、图像处理全是它。

-

正交矩阵

-

只旋转、不拉伸、不压缩,只改角度、不改大小,

- 游戏旋转、三维模型、地图导航全部依赖它。

十二、线性空间 & 基底(拔高理解)

整个平面、立体空间,都可以看成「向量组合出来的世界」。

基底就是空间的「基础骨架」,矩阵变换,本质就是更换空间骨架、修改基底规则。

换一组基底,就是换一种观察世界的角度,

相似矩阵、对角化,全都是在玩「换基底」的逻辑。

十三、全部知识串联:线性代数完整逻辑链

- 矩阵 = 空间 / 数据的一套变形规则

- 加减乘、逆矩阵 = 变形的叠加、串联、撤销

- 秩 & 行列式 = 判断空间有没有塌缩、信息丢没丢

- 方程组 = 已知变形结果,反推原始数据

- 向量 = 空间里的基础方向单元

- 特征向量 = 变形不变的核心骨架

- 特征值 = 骨架上的变形强度

- 对角化 = 把复杂扭曲拆成简单伸缩

- 空间基底 = 世界的基础构建框架

十四、现实落地:学矩阵到底能干什么

完全脱离做题,讲真实用途:

- 图像处理:拉伸、裁剪、滤镜、畸变矫正,全是矩阵变换

- 游戏建模:三维旋转、缩放、动作形变,依靠矩阵

- 人工智能:PCA 降维、特征提取,核心就是特征向量筛选核心数据

- 工程力学:结构稳定分析、震动频率,靠特征值判断

- 大数据:压缩冗余信息,保留核心特征

十五、最终极简总括(背诵级)

- 矩阵是改造规则,负责批量扭曲空间与数据;

- 运算就是变形叠加,逆矩阵负责还原;

- 秩看有效维度,行列式看整体伸缩;

- 普通向量会被扭歪,特征向量是不变骨架;

- 特征值控制骨架伸缩强度;

- 对角化简化复杂运算,对称 / 正交矩阵是工程常用稳定结构;

- 整个线性代数,就是:研究空间如何被线性规则改造,并找到改造里的稳定规律。

线性代数 + 矩阵|结合机器人工程专业 全通俗通关讲解

(全程无公式、纯大白话、连贯逻辑、结合你之前 4 个特征值可视化案例,

把线代每一个核心知识点,直接绑定机器人实际干活场景)

先定总基调:

机器人 = 从头到尾全是矩阵

机器人不是铁块电机,它是「多维度空间运动机器」。只要涉及:关节转动、手臂摆动、摄像头拍照、雷达定位、姿态平衡、自动导航、AI 识别底层全部是:

向量做位置、矩阵做变换、特征做稳定、秩做约束

不学矩阵,只能看懂电机转;

学懂矩阵,才能看懂机器人为什么这么动、怎么稳定、怎么避障、怎么精准抓取。

1. 矩阵到底是什么(机器人版理解)

普通理解:数字表格

机器人理解:

矩阵 = 机械运动的「统一变形 / 转动 / 偏移规则」

机器人每一个关节扭动、底盘旋转、机械臂伸缩,

全部都是在用一套矩阵,

把「原本的坐标」改成「运动后的新坐标」。

一台机械臂有 6 个关节,就是6 层矩阵叠加变形。

2. 矩阵加减、乘法|机器人怎么用

矩阵加法

多个微小运动叠加,比如:

小车一边缓慢前进、一边小幅偏移,两个小动作叠加。

矩阵乘法(机器人核心重中之重)

之前讲过:乘法 = 两次运动先后叠加

机器人最致命的知识点:

运动顺序绝对不能乱

- 先转身体再伸手臂

- 和先伸手臂再转身体位置完全不一样

所以机器人控制代码里,

所有旋转矩阵、变换矩阵严格按顺序相乘,

这就是为什么矩阵乘法不允许交换位置。

3. 逆矩阵|机器人「纠错 + 回零」

机器人工作一定会有误差、碰撞、偏移。

- 正向矩阵:正常运动,从原点跑到工作位置

- 逆矩阵:反向运算,从当前位置退回原点、抵消偏差

用处:

机械臂抓取失败、姿态歪斜、小车跑偏,

控制器靠逆矩阵反向修正坐标,自动归位、自动校准。

如果矩阵被 "压塌"(行列式为 0、秩不足),

逆矩阵不存在 → 机器人直接卡死、无解、报错宕机。

4. 秩|机器人「自由度限制」

通俗讲:

秩 = 机器人真实能活动的有效维度

- 秩足够:机械臂灵活,上下左右前后全能动,灵活抓取

- 秩缺失:结构被锁死,某些方向永远动不了(机械结构缺陷、关节限位)

- 秩坍塌:多关节冲突、机械干涉,一动就卡死

机器人设计、机械臂构型分析、并联机器人约束,

工程师全程看矩阵的秩,判断结构能不能正常运动。

5. 行列式|机器人运动是否会失控

通俗:

行列式 = 空间形变的挤压程度

- 行列式正常:运动平稳、不会畸形形变

- 行列式接近 0:关节接近奇异位置(机械臂伸成一条直线)→ 此时机器人用力巨大、控制失效、容易烧坏电机机器人控制算法会实时检测行列式,提前避开「奇异位形」防止损坏设备。

6. 向量 + 线性空间|机器人的坐标世界

- 向量 = 位置、速度、角速度、受力、姿态机械手里:末端坐标、关节角度、车轮转速、惯性数据,全部是向量。

整个机器人的工作空间,

就是无数向量组成的线性空间;

矩阵负责在这个空间里,来回切换、移动、旋转每一个点位。

7. 线性方程组|机器人求解运动学

课本解方程 → 机器人解「正逆运动学」

- 正运动学:已知关节角度,算末端抓手位置(矩阵相乘)

- 逆运动学:已知想要的抓手位置,反推每个关节该转多少度

本质就是线性方程组:

- 有唯一解:机器人只有一种姿势到达目标

- 无穷多解:机械臂冗余自由度,姿势随便换

- 无解:目标超出工作空间,够不到

所有协作机器人、机械臂控制器,底层全靠方程组求解。

8. 特征向量 + 特征值(结合你之前 4 段可视化案例)

用机器人大白话翻译:

- 特征向量 = 机器人结构里 天生的稳定方向、震动主轴

- 特征值 = 震动强弱、形变幅度

① 机器人结构振动

机械臂高速运动、负载重物会抖。

矩阵特征方向,就是它最容易抖、最不容易抖的固定方向。工程师通过特征值:

避开共振频率,防止手臂抖断、镜头抖动、抓取不稳。

② 姿态平衡、无人机稳定

无人机、双足机器人、平衡小车:

自身晃动有固定规律,特征向量找出稳定平衡轴,

控制程序专门锁住这个方向,实现自动平衡。

③ 视觉、激光雷达

摄像头拍照畸变、点云数据畸变,

用特征筛选主要结构,过滤噪音,

也就是机器人的「环境感知降噪」。

④ 核心总结(对应你之前代码案例)

所有复杂运动、结构形变,

都会在特征方向上简化成单纯拉伸 / 震动,控制器只需要控制这几个核心轴,

就能稳住整台机器人,不用控制全部杂乱方向。

9. 对角化 & 相似矩阵|机器人控制简化

机器人运动方程超级复杂、耦合严重:

一个关节动,会带动全身受力变化。

通过矩阵对角化:

把互相纠缠的复杂运动,拆成互相独立、互不干扰的简单运动。原本超级难算的控制方程,直接拆分成单条简单计算,

嵌入式芯片才能实时跑、低延迟控制机器人。

10. 特殊矩阵|机器人天天在用

对称矩阵

机器人力学、应力、惯性张量全是它,保证结构稳定计算。

正交矩阵

只旋转、不缩放:

机器人姿态变换、摄像头旋转、底盘航向角,100% 依赖正交矩阵。

无人机航向、自动驾驶转向、机械臂姿态全靠它。

11 机器人工程完整串联(终极打通)

- 机器人所有位置、角度、速度 → 都是向量

- 所有转动、平移、形变、关节联动 → 都是矩阵变换

- 运动先后顺序 → 对应矩阵乘法规则

- 运动校准、误差修正 → 靠逆矩阵

- 机械会不会卡死、有没有限位 → 看秩 & 行列式

- 抓手去哪、关节转多少 → 解线性方程组

- 机械震动、平衡稳定、抗抖动 → 靠特征值、特征向量

- 复杂控制简化、芯片实时运算 → 靠对角化

12 给机器人专业学生一句大实话

为什么机器人工程必修课强制学线性代数?

- 不学矩阵:你只能调库、套别人写好的机器人代码

- 学懂矩阵 + 特征这套逻辑:你能自己写运动学、自己做姿态解算、自己设计平衡算法、自己优化机械结构、自己处理雷达视觉数据

机械结构是机器人的骨头

电机是肌肉线性代数是机器人的神经与大脑

《可视化理解线性代数核心概念》

本文通过编程可视化揭示了线性代数的本质:矩阵是空间变形控制器,特征向量是变形中的稳定主轴,特征值则代表变形强度。四个Python案例生动展示了:

- 特征值计算直观呈现变形力度差异

- 特征向量在变换中保持方向不变的特性

- 公式A·v=λ·v的数值验证

- 矩阵变换对图形的拉伸效果

核心发现:任何矩阵变换都存在不随变形改变方向的"骨架"(特征向量),其变形强度由特征值决定。这种特性使得复杂矩阵运算在特征向量方向上简化为简单的缩放操作,这正是数据降维、图像处理等应用的基础原理。可视化方法让抽象的线性代数概念变得直观可感,有效提升了学习兴趣和理解深度。