戴上智能眼镜的第一秒,你期待看到什么?

不是悬浮的操作面板,不是单调的提示信息------而是一只蹲在你桌角、歪头看着你的虚拟仓鼠。你只需轻轻滑一下手指,它就会转身钻进一个凭空出现的透明迷宫,开始一场只属于你们俩的寻宝游戏。

这不是科幻片段,而是Rokid眼镜配合小游戏智能体正在实现的日常场景。但真正值得思考的问题藏在背后:为什么AR游戏迟迟没有爆发?答案不在显示技术,而在游戏逻辑的承载方式。

一、传统AR游戏的困境:太重了

过去几年,大部分AR游戏尝试都走向了同一个死胡同------把手机游戏的3D引擎、物理计算、资源包一股脑塞进眼镜。结果显而易见:设备发热、续航崩盘、交互延迟,最终用户只玩五分钟就摘下来。

问题的根源在于:我们把AR眼镜当成了"性能怪兽",而它天生应该是一个"交互终端"。 就像你不会让鼠标去运行Photoshop,也不该让眼镜去跑Unity全量渲染。

真正的解法正在发生逆转:把游戏逻辑从眼镜端剥离,交给一个极轻的"智能体"。这个智能体可以跑在眼镜本地、手机端甚至云端,但它与眼镜之间只传递最精简的信息------用户的动作指令、游戏状态的增量变化、渲染所需的低精度模型。眼镜只负责两件事:感知(识别手势、头部朝向、空间平面)和显示(在正确的位置画出应该出现的像素)。

二、智能体改变了"游戏是什么"

传统游戏里,所有的规则、数值、随机种子都写在代码里。但在AR眼镜+智能体的架构下,游戏变成了一个可对话、可推理、可适应环境的行为体。

举个例子:当你在客厅玩一个"房间寻宝"游戏,传统做法需要预先定义好所有可能的藏宝点和线索。而智能体可以在运行时通过眼镜的环境识别结果,实时分析当前房间的家具布局、光照条件,动态生成三条合理的藏宝路径------每次玩都不一样,甚至主动避开昨天已经用过的角落。

这种能力不是"程序生成内容"能概括的,它更接近一种轻量级的空间推理。智能体不需要理解美学,只需要理解什么位置对用户是"可触碰的""有趣的""难度适中的"。而这一切计算,对眼镜端的性能消耗几乎为零。

三、交互维度的降维打击

Rokid眼镜支持手势和头部动作,但很多游戏设计者仍在犯一个错误:试图映射手柄的按键逻辑。比如"握拳代表跳跃""向右滑代表射击"------这本质上是用AR做VR的拙劣模仿。

智能体可以做得更聪明。因为智能体拥有对用户意图的概率建模能力。当用户快速转头三次,智能体不一定要执行某个指令,而是可以判断"用户在寻找什么",主动在视野边缘显示一个闪烁的提示。当用户手指缓慢滑过桌面,智能体可以判定"这不是点击,而是抚摸",从而触发虚拟宠物的亲昵反馈,而不是误识别为移动指令。

这种模糊交互的精准解读,才是智能体带给AR游戏真正的质变:用户不再需要学习"怎么操作",而是像和真人互动一样自然。

四、从"单机"到"共生"

智能体还改变了游戏的边际成本。传统AR小游戏,每增加一个新玩法就需要重新写代码、打包、发布。而智能体可以通过自然语言描述来理解新规则。

未来的开发模式可能是这样的:设计师对智能体说,"我想玩一个游戏,用户用食指划过空中就能切水果,水果从地面弹起来而不是从天上掉下来。"智能体立即在运行时重新配置自己的逻辑模块,生成新的碰撞规则、给出手势校准提示、甚至自己调整UI布局。用户几乎不用等待更新。

这意味着游戏不再是固化的产品,而是一种持续演化的对话。开发者提供的是游戏"种子",智能体根据每个用户在每次游戏时的实时状态,长出不同的枝叶。

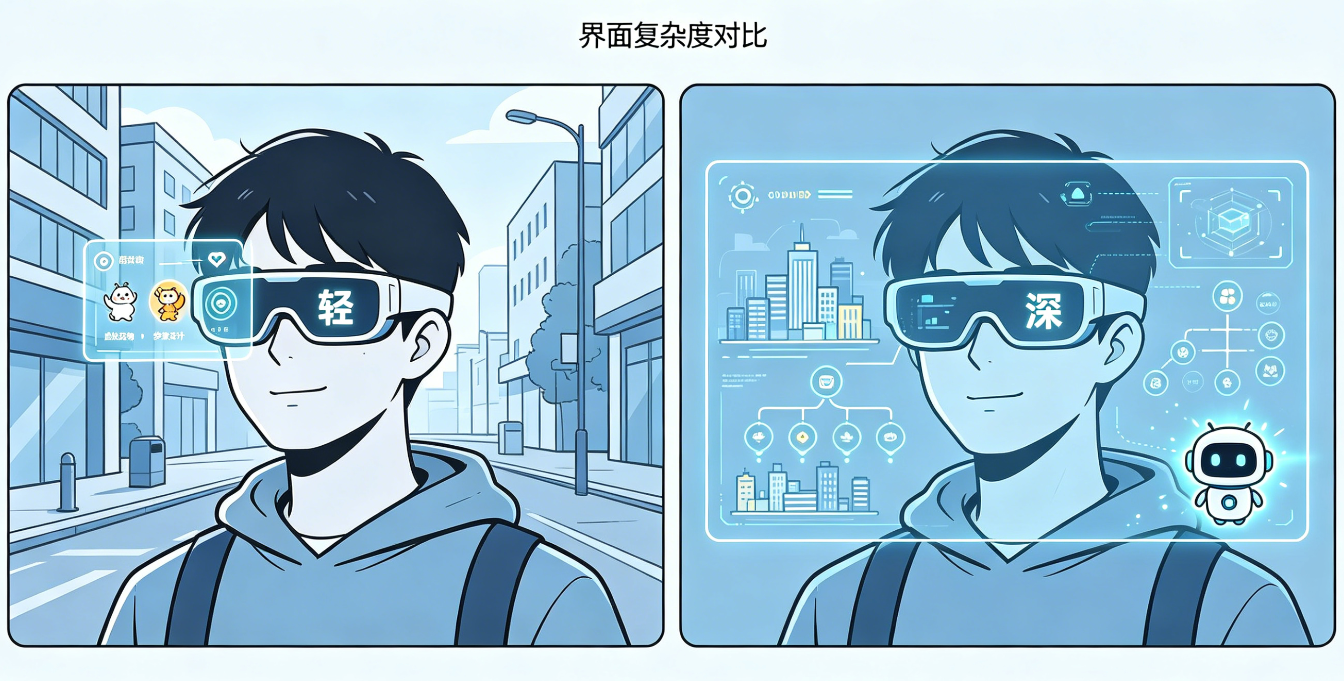

五、轻,才能深

Rokid眼镜加上小游戏智能体的组合,本质上是在倒逼一个认知转变:不要追求AR游戏看起来多酷炫,要追求它玩起来多"顺手"。当设备功耗只用来做两件纯粹的事(感知与显示),续航就能支撑碎片化场景------通勤时玩五分钟,午休时玩十分钟,不需要担心电量。

这恰恰打开了最深度的体验:高频、短时、无负担。那些每天被大量用户反复打开的游戏,往往不是画面最华丽的,而是门槛最低、上手最快的。智能体让AR小游戏具备了这种特质------说一句话开始,挥挥手就玩,放下眼镜即停,游戏状态自动保存,下次启动无缝衔接。

写在最后

我们总在想象AR眼镜的"杀手级应用",但它可能根本不是一款"大作",而是一群像宠物仓鼠一样轻盈、有性格、懂你习惯的小游戏智能体。它们不会消耗你太多时间,却会在你抬眼的瞬间,给你一个期待的微笑。

这或许就是AR游戏的终极形态:不是让你沉浸到另一个世界,而是让你觉得眼前的世界,突然变得有趣了一点点。