****论文题目:****基于IMSE-CNN-Transformer和免疫遗传算法优化的轴承故障诊断方法(Bearing fault diagnosis method based on IMSE-CNN-Transformer and immune genetic algorithm optimization)

****期刊:****Applied Soft Computing

****摘要:****确保轴承的可靠性对于旋转机械的安全运行至关重要,但由于振动信号的非平稳、经验模态分解(EMD)中的端点效应以及信号预处理和深度学习模型之间缺乏协调优化,准确的故障诊断仍然具有挑战性。现有的研究通常孤立地解决这些问题,这限制了噪声和可变操作条件下的鲁棒性。为了克服这些限制,本文提出了一种新的端到端集成框架,共同优化信号增强和模型学习。具体而言,采用改进的多目标Coati优化算法(IMOCOA)自适应调整支持向量回归(SVR)进行EMD边界扩展,有效抑制端点伪像;利用免疫遗传算法(IGA)对CNN-Transformer混合结构进行优化,鲁棒的提取局部和全局时间特征。关键的新颖之处在于在单个诊断管道中对信号分解和模型超参数进行统一的双阶段优化。在CWRU和MFPT轴承数据集上的实验结果表明,该方法的平均准确率分别为99.55%和99.38%,在−5 dB噪声下,该方法的准确率保持在98.44%。与现有的诊断方法相比,该方法具有更好的诊断准确率、噪声鲁棒性和泛化能力,突出了其在复杂工业环境下实际轴承故障诊断中的有效性。

端到端轴承故障诊断新框架:IMSE-IGA-CNN-Transformer 详解

一、研究背景与问题动机

滚动轴承是旋转机械的核心部件,其故障往往引发设备停机乃至灾难性损坏。然而,准确诊断轴承故障面临三大挑战:

1. 振动信号的非平稳性

轴承故障产生的振动信号具有强烈的非线性和非平稳特性,噪声污染严重,传统依赖手工特征和领域知识的方法在复杂工况下明显退化。

2. EMD 端点效应

经验模态分解(EMD)是处理非平稳信号的经典工具,能将信号自适应分解为若干固有模态函数(IMF)。然而,由于信号边界附近缺乏足够的极值点,三次样条插值在边界处发生外推误差,产生所谓的"端点效应"------边界附近的 IMF 发生幅值畸变、信息丢失,严重时导致模态混叠(Mode Mixing)。

现有的缓解策略(镜像延拓、波形匹配、AR建模、SVR延拓等)各有局限:镜像延拓对端点极值检测误差敏感;波形匹配在非周期信号上失效;SVR虽适合小样本非线性回归,但其超参数(C、γ、ε)对性能极为敏感,人工调参困难且耗时。

3. 信号预处理与深度学习模型缺乏协同优化

现有研究通常将信号预处理(EMD分解)和深度模型训练作为两个相互独立的阶段,缺乏统一的端到端优化框架。当输入信号质量不佳时,Transformer等强大模型反而会放大噪声和边界畸变,削弱故障判别能力。

本文的核心动机:构建一个统一的端到端框架,在信号层面和模型层面同步进行双阶段优化。

二、整体框架概览

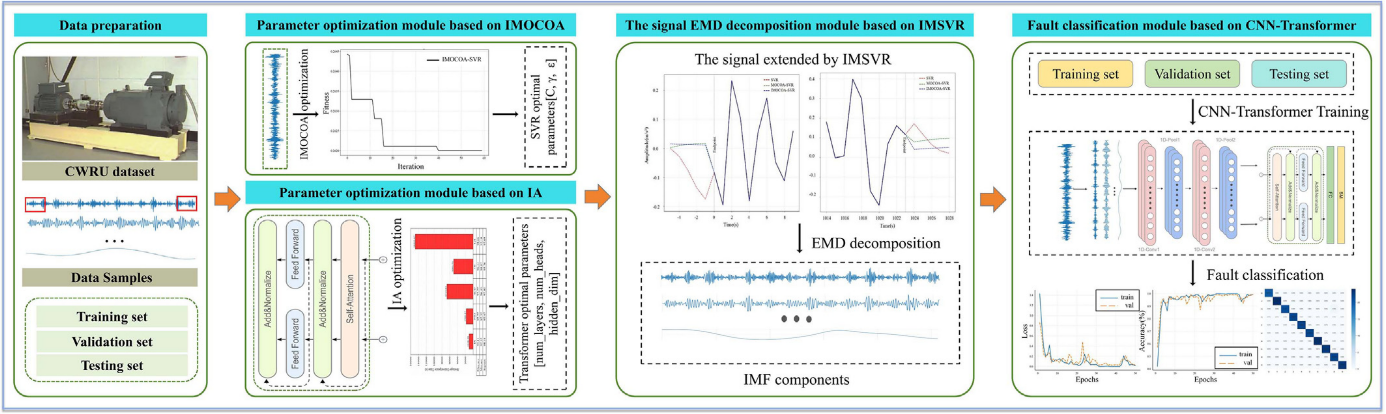

本文提出的 IMSE-IGA-CNN-Transformer 框架包含两大主要阶段:

原始振动信号

│

▼

【阶段一:信号预处理】

IMOCOA 优化 SVR 超参数

│

SVR 端点延拓(IMSE)

│

EMD 分解 → 精细化 IMF 分量

│

▼

【阶段二:智能诊断】

IGA 优化 Transformer 超参数

│

CNN-Transformer 混合网络

│

故障分类结果

论文 Fig. 2(整体诊断流程图)

三、核心创新一:改进多目标香鼬优化算法(IMOCOA)

3.1 原始 MOCOA 的局限

原始多目标香鼬优化算法(MOCOA)模拟香鼬捕食鬣蜥和逃避天敌的行为,具备一定的全局搜索能力,但存在两个突出问题:

- 种群初始化质量差:随机初始化导致个体分布不均匀,影响早期探索效率;

- 容易早熟收敛:进化后期缺乏有效的多样性维持机制。

3.2 改进策略一:Logistic 混沌映射初始化

IMOCOA 引入 Logistic 混沌序列生成初始种群:

生成的混沌值通过线性映射变换到决策空间:

该策略能显著提升初始种群在搜索空间中的覆盖率和多样性,为后续进化提供更好的起点。

3.3 改进策略二:量子变异算子

为了防止进化陷入局部最优并加速收敛,IMOCOA 在进化过程中引入量子变异算子:

- 将每个决策变量

编码为量子叠加态

;

- 对 Pareto 前沿个体,使用动态旋转角的量子旋转门更新量子态,引导搜索朝更优区域移动;

- 对非 Pareto 个体,施加指数衰减的混沌扰动,维持种群多样性。

3.4 IMOCOA 性能验证

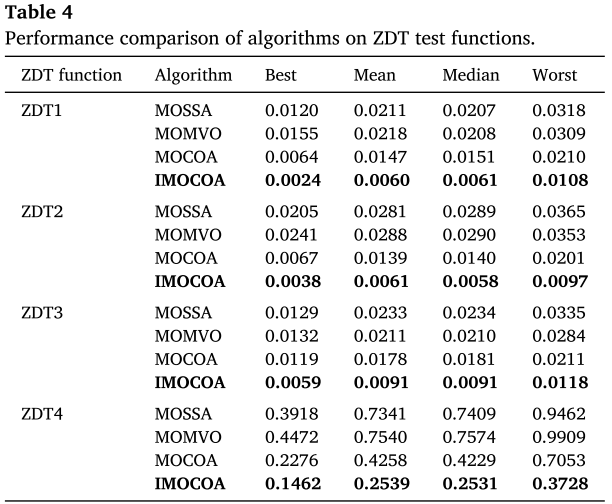

在 ZDT1~ZDT4 四个标准多目标测试函数上,IMOCOA 与 MOSSA、MOMVO、MOCOA 进行了对比,每种算法独立运行 30 次,使用 IGD 指标评估。

论文 Table 4(ZDT 测试函数性能对比表)

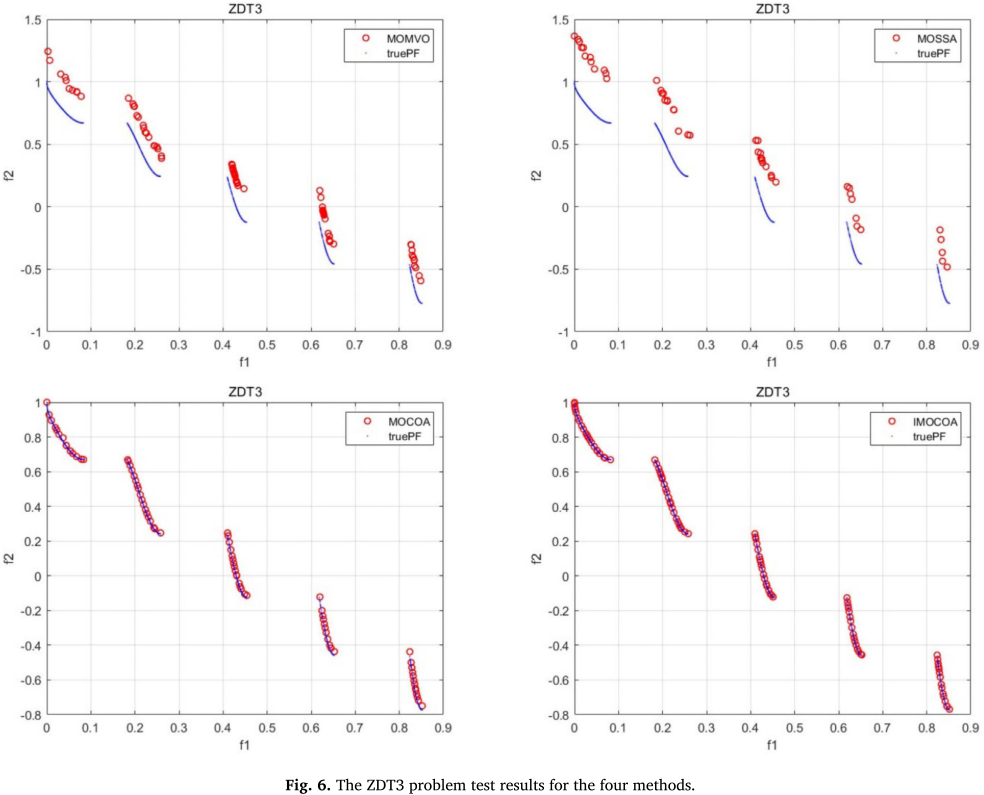

论文 Fig. 6(ZDT3 问题的 Pareto 前沿对比图)

关键结论:

- IMOCOA 在全部四个测试函数上均取得最低的最佳 IGD 值和平均 IGD 值;

- 在 ZDT1~ZDT3 上,IMOCOA 的 IGD 值比对比算法低约一个数量级;

- 在 ZDT4(最具挑战性)上,IMOCOA 的最佳 IGD 值(0.1462)比 MOSSA、MOPSO、MOCOA 分别低 62.7%、67.3%、35.8%;

- IMOCOA 的最佳值、中位值与平均值高度接近,说明优化行为极为稳定。

四、核心创新二:IMOCOA-SVR 端点延拓(IMSE)

4.1 SVR 延拓的基本原理

SVR 被用于预测信号端点处极值序列的延续:

- 提取原始信号的局部极大值(或极小值)序列;

- 用滑动时间窗口构造输入-输出样本对;

- 训练 SVR 模型;

- 向边界外推若干个极值点;

- 对延拓后的极值序列进行三次样条插值,构造更精确的包络线。

SVR 核函数选用 RBF(径向基函数),需调优的超参数为惩罚系数 C、核宽度 γ 和不敏感带宽 ε。

4.2 多目标适应度函数

为同时评估边界预测精度和 EMD 分解质量,IMOCOA 使用如下复合适应度向量:

其中:

- RMSE:均方根误差,衡量边界预测精度;

- IO(正交性指标):评估各 IMF 之间的正交程度,值越低表示模态混叠越少;

- HSE(Hilbert 谱熵):反映频谱复杂度,值越低表示频谱越集中;

- 权重系数

,种群大小 N=50,最大迭代 T=100。

4.3 SVR 参数优化结果

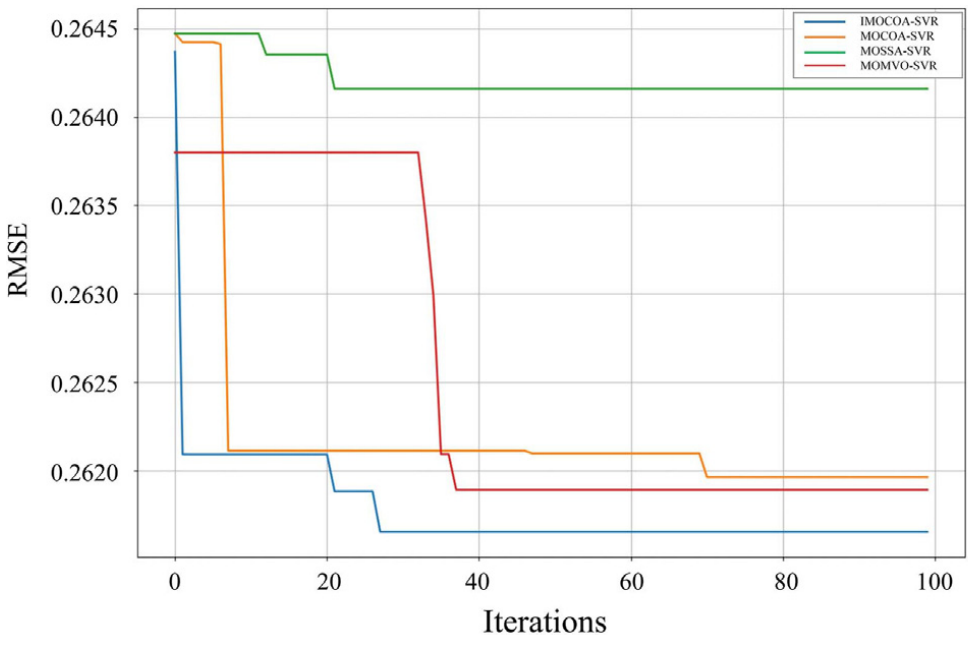

论文 Fig. 7(各算法 SVR 参数优化收敛曲线对比图)

IMOCOA 仅经过 27 次迭代即收敛,最小适应度值为 0.2617;而 MOCOA、MOSSA、MOMVO 分别在第 70、9、37 次迭代收敛,适应度值为 0.2619、0.2642、0.2620。IMOCOA 以最快速度达到了最低误差。

4.4 端点延拓效果对比

以 Fault 1 信号为参考,分别对比了无延拓 EMD、固定参数 SVR-EMD、MOCOA-SVR-EMD 和 IMOCOA-SVR-EMD 四种方案:

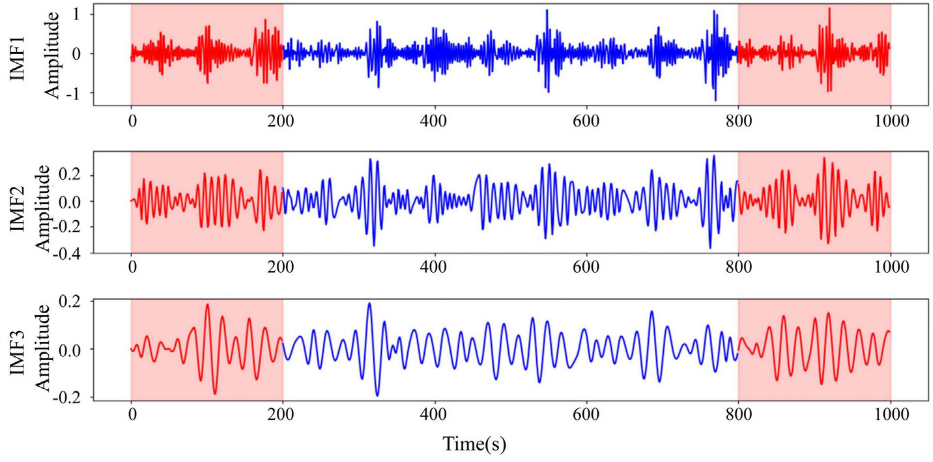

论文 Fig. 8(无延拓时 IMF1~IMF3 的端点效应示意图)

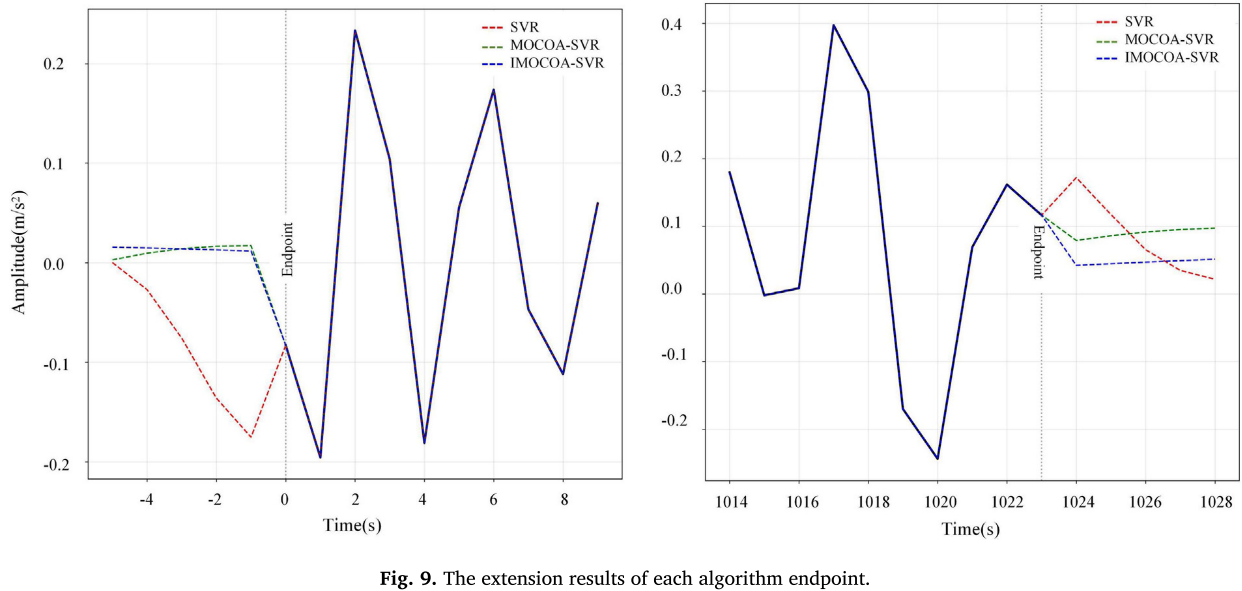

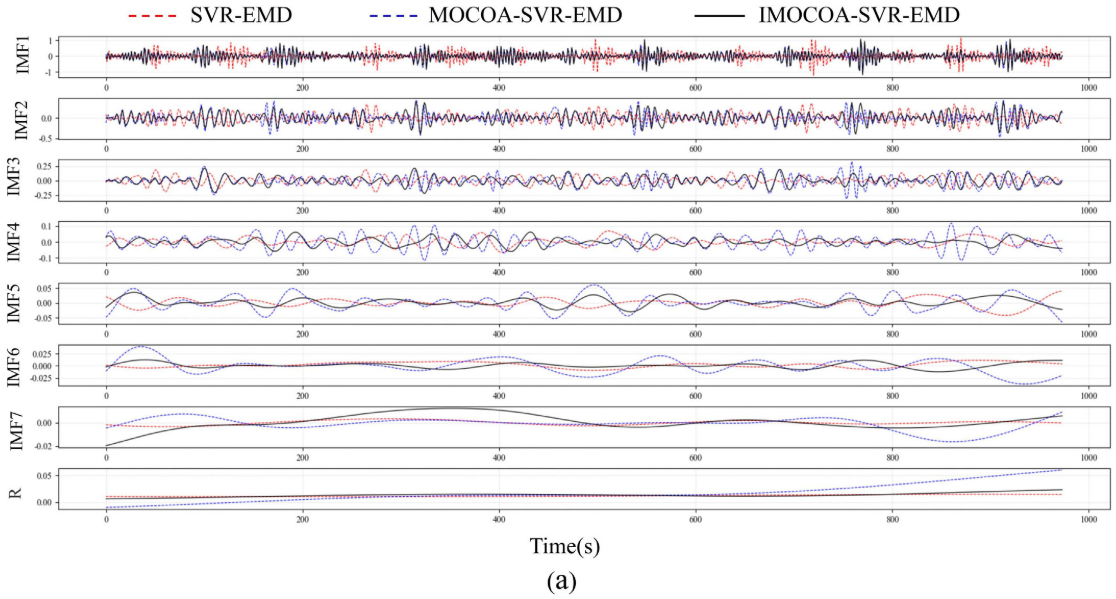

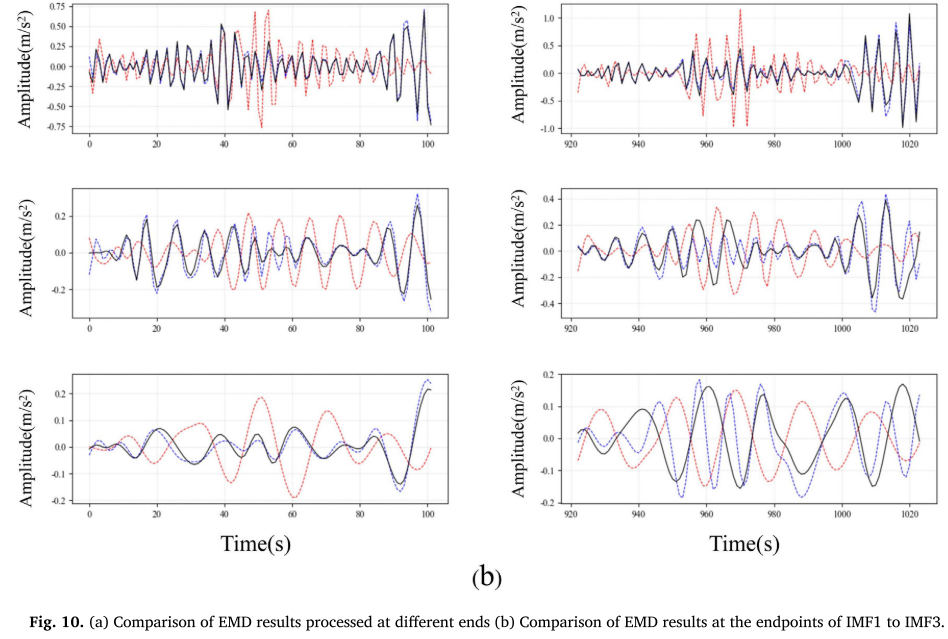

论文 Fig. 9 和 Fig. 10(各方案端点延拓结果及 IMF 对比图)

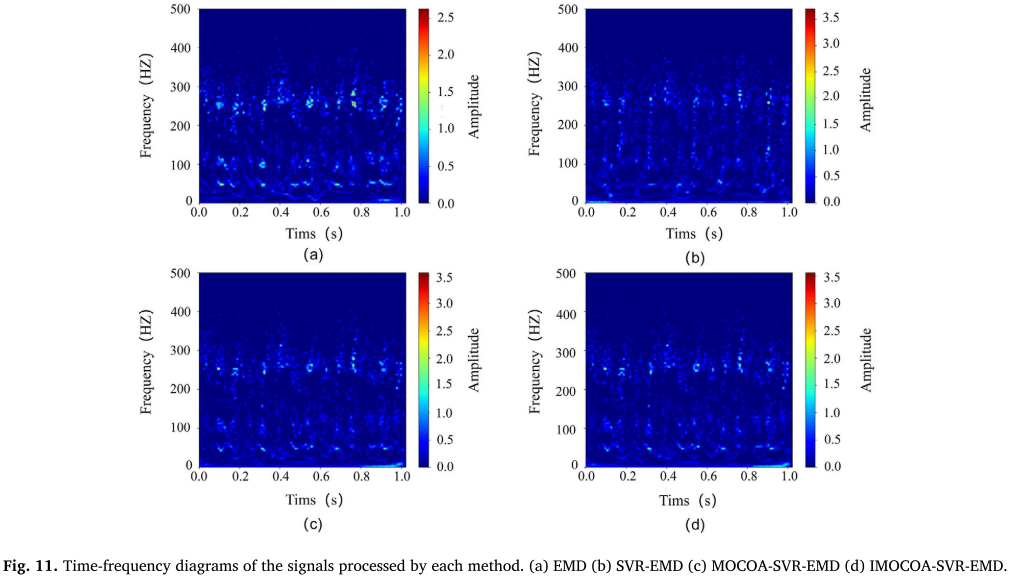

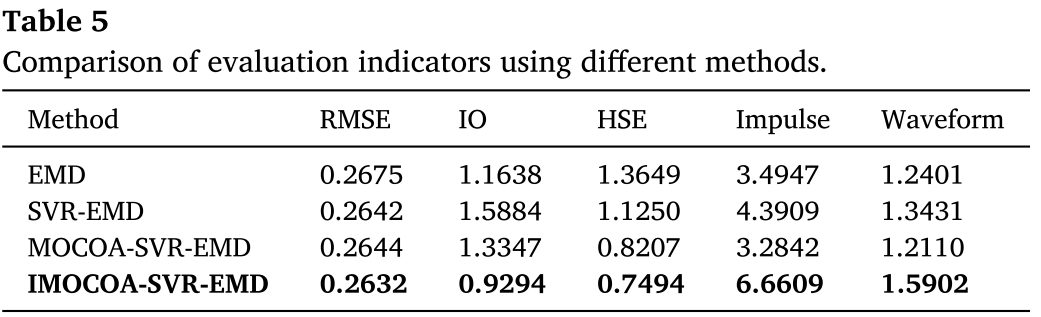

论文 Fig. 11(四种方案的时频谱图对比:(a) EMD、(b) SVR-EMD、(c) MOCOA-SVR-EMD、(d) IMOCOA-SVR-EMD)

五项量化指标的对比结果如下:

论文 Table 5(不同方法的信号分解评价指标对比表)

IMOCOA-SVR-EMD 在全部五项指标上均表现最优:RMSE 最低(0.2632),IO 最低(0.9294),HSE 最低(0.7494),冲击因子最高(6.6609),波形因子最高(1.5902)。尤其是时频谱图显示,IMOCOA-SVR-EMD 的背景噪声抑制能力最强,故障特征最为集中清晰。

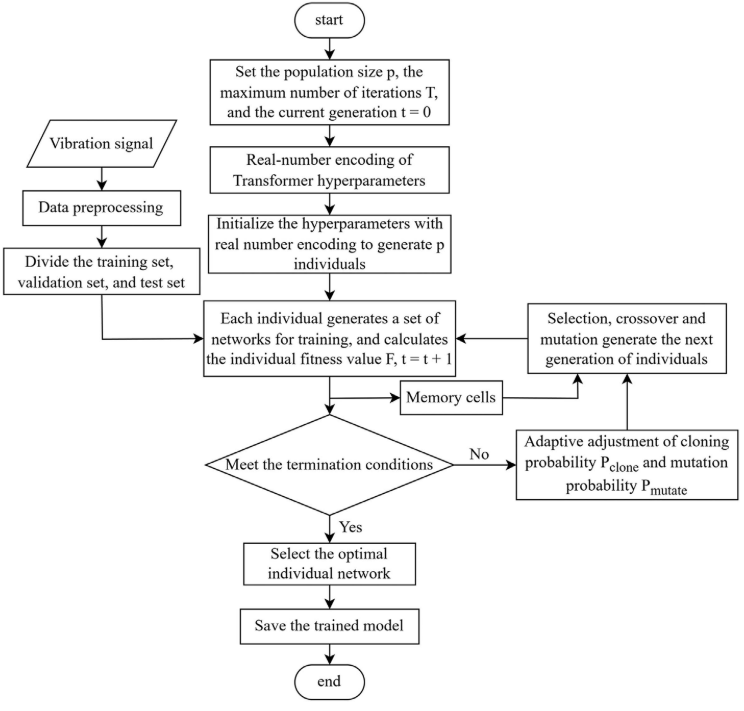

五、核心创新三:免疫遗传算法(IGA)优化 CNN-Transformer

5.1 为什么要用 IGA?

CNN 擅长提取局部空间特征,但受限于感受野大小,难以建模长程时序依赖;Transformer 的多头自注意力机制能全局建模时序关系,但其层数、隐藏维度、注意力头数等超参数对性能影响显著,传统调参方法(网格搜索、随机搜索)在高维搜索空间中效率低下。

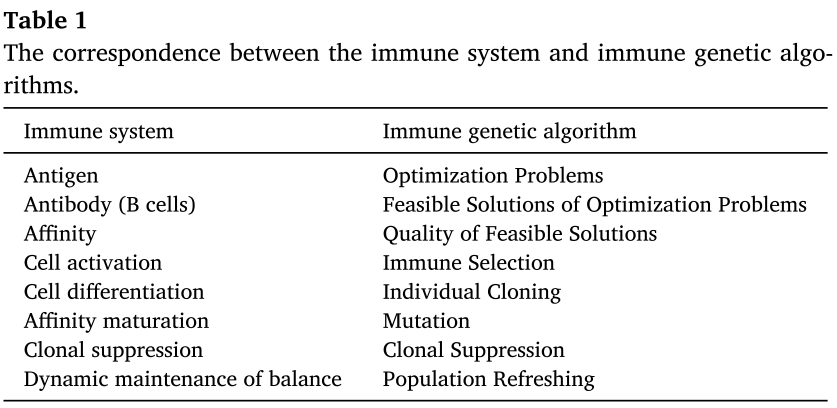

IGA 将优化问题视为"抗原",候选超参数组合视为"抗体",借鉴免疫系统的克隆选择、亲和力成熟和克隆抑制机制,实现高效的超参数自动搜索。

论文 Table 1(免疫系统与 IGA 的对应关系映射表)

5.2 IGA 关键机制

亲和力评估(Affinity):以 CNN-Transformer 在验证集上的分类精度作为亲和力得分,亲和力越高表示解的质量越好。

抗体浓度抑制 :定义浓度阈值 ,若个体间相似度超过阈值,则抑制高度相似的个体,防止早熟收敛,维持种群多样性。

动态变异率 :采用指数衰减变异率 (初始值

),早期高变异率促进广域探索,后期低变异率实现局部精细搜索。

记忆保留与精英策略:每代保留验证精度最高的 Top-10 个体,加速收敛并稳定解质量。

早停机制:若验证精度连续 5 代无提升则触发早停,防止过拟合并节省计算资源。

5.3 超参数搜索空间

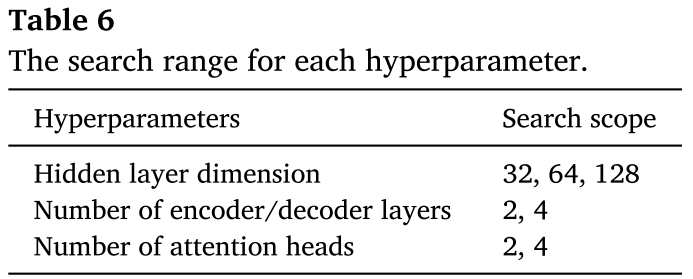

论文 Table 6(超参数搜索范围表)

搜索空间为:隐藏层维度 {32, 64, 128}、编解码层数 {2, 4}、注意力头数 {2, 4},种群大小 p=20,最大运行 50 代。

论文 Fig. 3(IGA 超参数优化流程图)

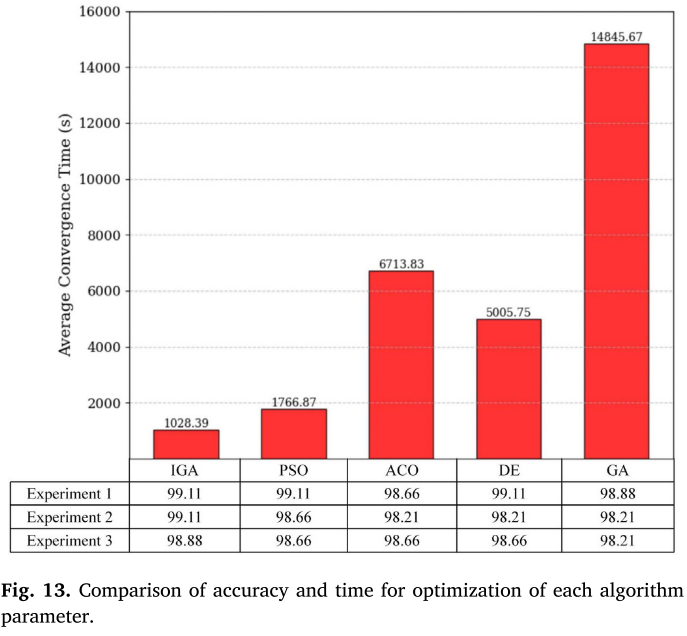

5.4 IGA vs 其他优化算法

IGA 与 PSO、ACO、DE、GA 四种主流优化算法在 CWRU 数据集上进行对比(每种算法运行 5 次):

论文 Fig. 13(各算法参数优化精度与收敛时间对比图)

- IGA 平均诊断精度(99.03%)比 PSO、ACO、DE、GA 分别高 0.22%、0.52%、0.37%、0.60%;

- IGA 平均收敛时间(1028.39s )比 PSO(1766.87s)、ACO(6713.83s)、DE(5005.75s)、GA(14845.67s)分别减少 41.8%、84.7%、79.5%、93.1%。

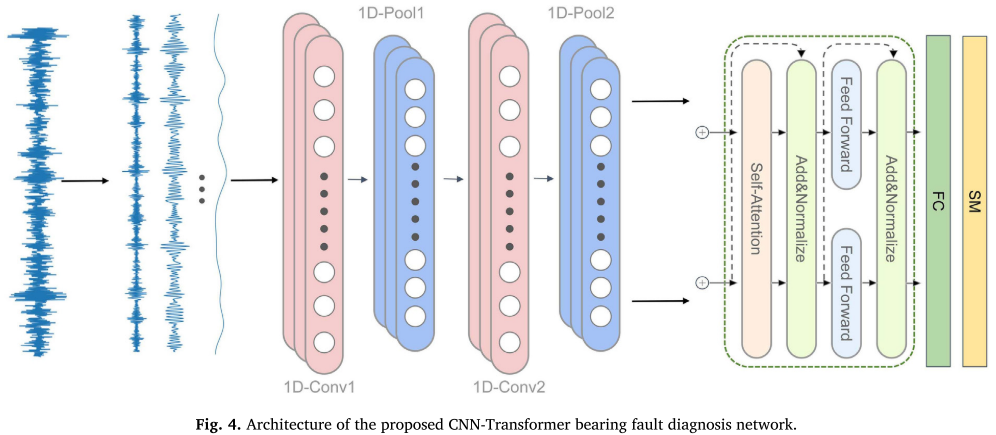

六、CNN-Transformer 网络架构

6.1 串行混合架构

论文 Fig. 4(CNN-Transformer 网络架构图)

网络由三个模块串联组成:

-

1D-CNN 特征提取模块:两组"Conv1D + MaxPool"卷积块(Conv1: 3×1 卷积核,Conv2: 3×1 卷积核,最大池化核 2×1),使用 ReLU 激活函数,逐步提取局部时序特征并压缩序列长度。

-

Transformer 编码器模块:将 CNN 输出的特征图经格式转换后,送入堆叠的多头自注意力 + 前馈网络编码器块,捕获长程时序依赖。

-

聚合与分类层:自适应平均池化将 Transformer 输出压缩为固定长度特征向量,最终经全连接层 + Softmax 输出各故障类别的概率。

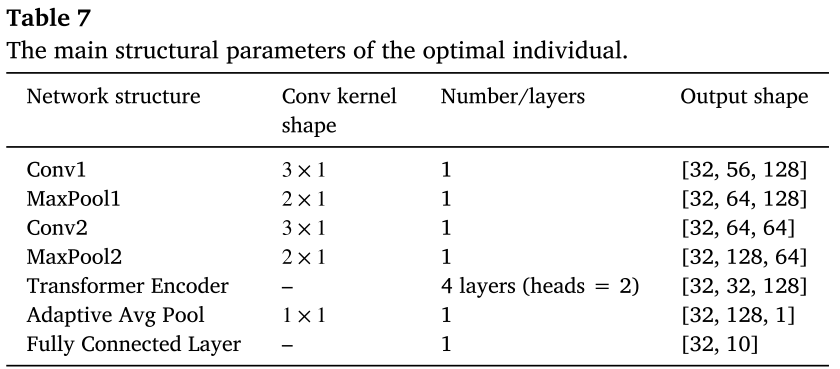

IGA 搜索得到的最优网络结构参数如下:

论文 Table 7(最优个体网络主要结构参数表)

最优配置为:隐藏维度 128、编码器层数 4、注意力头数 2,在测试集上最终分类精度为 98.88%。

七、实验设置与数据集

7.1 CWRU 数据集

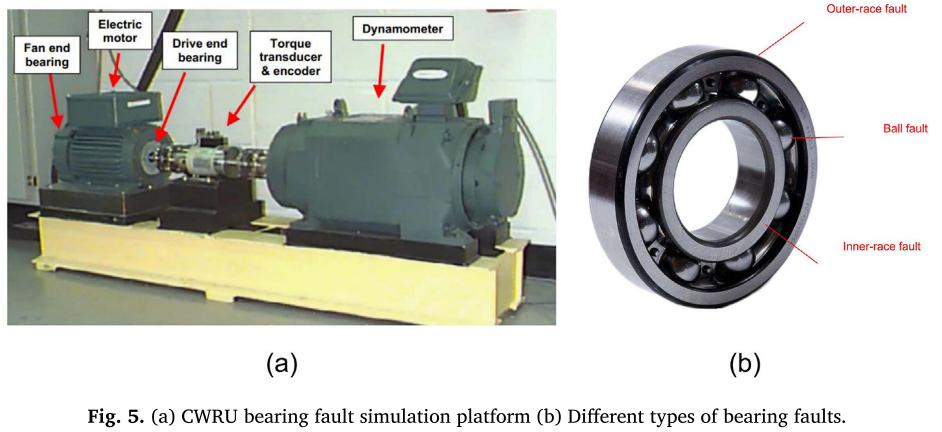

论文 Fig. 5(CWRU 轴承故障模拟平台及故障类型示意图)

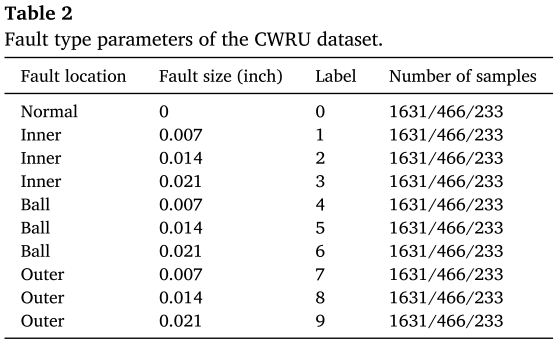

- 电机转速 1797 rpm,采样率 12 kHz,无外部负载;

- 共 10 类:1 类正常 + 9 类故障(内圈/滚球/外圈各 3 种损伤尺寸:0.007、0.014、0.021 英寸);

- 滑动窗口分割(1024 点,50% 重叠),共 2330 个样本(每类 233 个);

- 训练配置:Adam 优化器,批大小 32,Dropout 0.5,最多 50 轮,最小学习率 0.0003,固定随机种子 100;

- 评估策略:分层 5 折交叉验证,80% 训练 / 20% 测试,训练集中 10% 用作验证集(仅用于早停和 IGA 超参数选择)。

论文 Table 2(CWRU 数据集故障类型参数表)

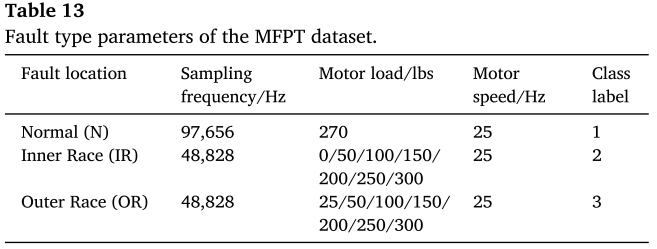

7.2 MFPT 数据集

- 由机械故障预防技术协会(MFPT)提供;

- 包含正常(97656 Hz,270 lbs)、内圈故障(48828 Hz,0~300 lbs,7种载荷)、外圈故障(48828 Hz,25~300 lbs,7种载荷)三类;

- 实验配置与 CWRU 保持一致。

论文 Table 13(MFPT 数据集故障类型参数表)

八、实验结果分析

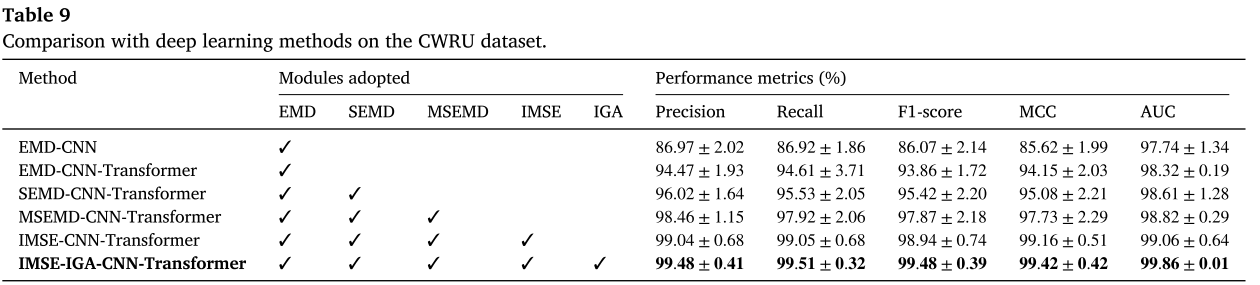

8.1 消融实验(CWRU)

为验证各模块的独立贡献,构建了六个消融变体,逐步累加各创新模块:

论文 Table 9(CWRU 数据集消融实验结果对比表)

关键观察:

- EMD-CNN → EMD-CNN-Transformer:引入 Transformer 后精确率从 86.97% 提升至 94.47%,验证了全局特征建模的重要性;

- → SEMD-CNN-Transformer:加入 SVR 延拓后提升至 96.02%,证明端点效应抑制有效;

- → MSEMD-CNN-Transformer:加入 MOCOA 优化后提升至 98.46%,多目标优化显现优势;

- → IMSE-CNN-Transformer:加入 IMOCOA 改进后达到 99.04%,混沌初始化与量子变异的改进效果明显;

- → IMSE-IGA-CNN-Transformer :最终引入 IGA 超参数优化后达到 99.48% ,AUC 达 99.86%,实现最优综合性能。

与 IMSE-CNN-Transformer 相比,IGA 优化分别带来精确率 +0.44%、召回率 +0.46%、F1 +0.44%、MCC +0.28%、AUC +0.80% 的提升。

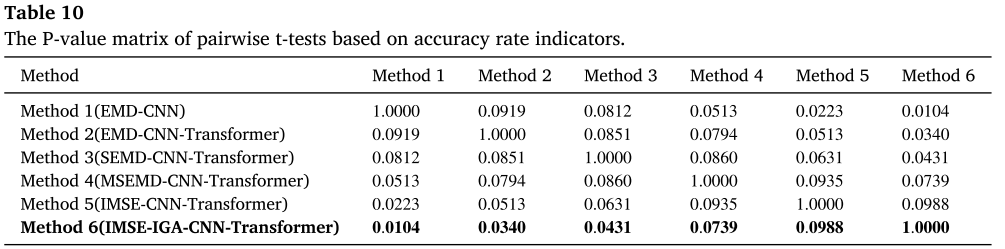

统计显著性方面,t 检验结果显示完整模型相对于 EMD-CNN(p=0.0104)、EMD-CNN-Transformer(p=0.0340)和 SEMD-CNN-Transformer(p=0.0431)均达到显著性水平(p<0.05)。

论文 Table 10(基于精度指标的配对 t 检验 P 值矩阵表)

8.2 各类故障诊断结果(CWRU)

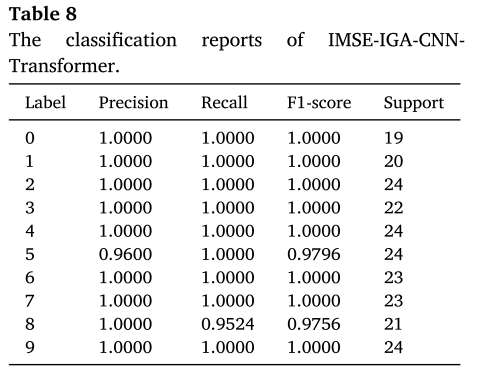

论文 Table 8(IMSE-IGA-CNN-Transformer 的分类报告表)

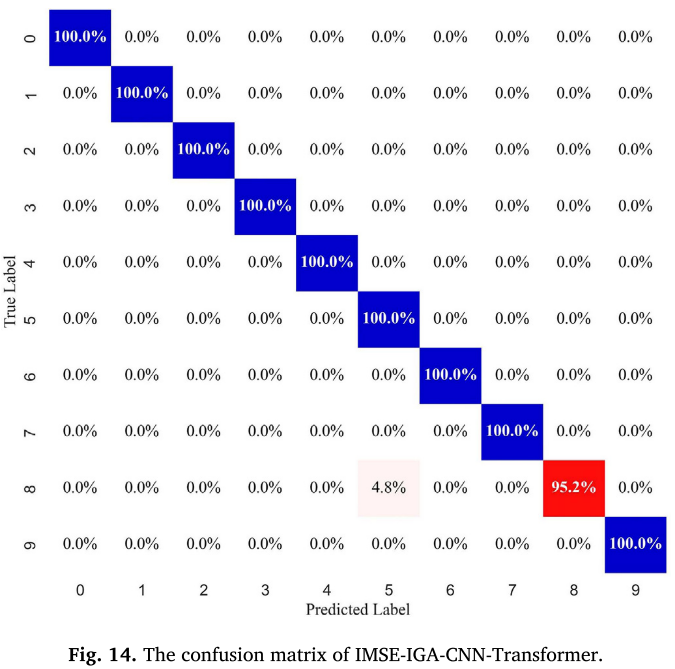

论文 Fig. 14(IMSE-IGA-CNN-Transformer 混淆矩阵)

几乎所有故障类别的精确率、召回率和 F1 值均达到 1.000,仅少数类别略低(仍在 0.97 以上),体现了极低的误分类率和强泛化能力。

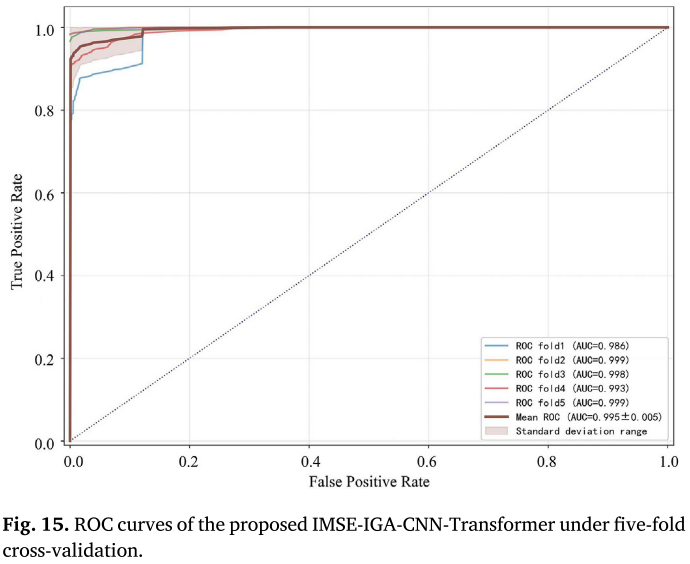

5 折交叉验证的 ROC 曲线显示,各折 AUC 值在 0.986 至 0.999 之间,均值为 0.995±0.005。

论文 Fig. 15(五折交叉验证 ROC 曲线图)

8.3 噪声鲁棒性测试(CWRU)

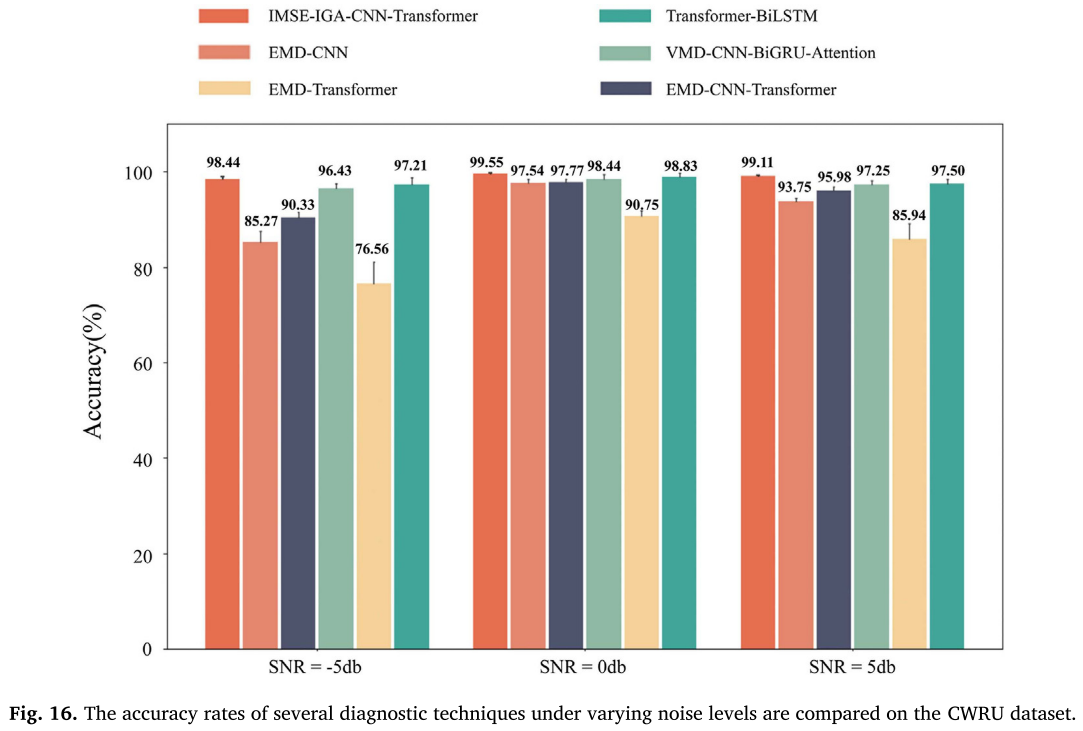

向原始数据集添加三种 SNR 级别的高斯白噪声(-5 dB、0 dB、5 dB),所有模型训练 100 轮,10 次独立运行取平均:

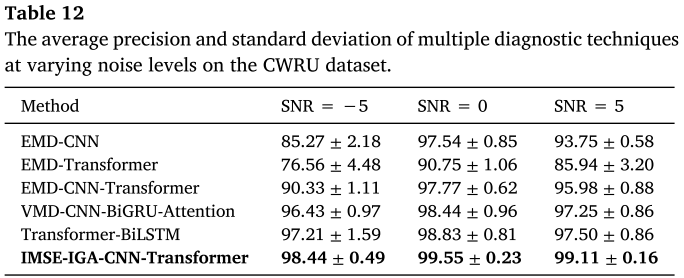

论文 Table 12(CWRU 数据集不同噪声水平下各方法的平均精度与标准差对比表)

论文 Fig. 16(CWRU 数据集不同噪声水平下各方法诊断精度对比柱状图)

| 噪声水平 | 本文方法精度 | 标准差 |

|---|---|---|

| SNR = 5 dB | 99.11% | 0.16 |

| SNR = 0 dB | 99.55% | 0.23 |

| SNR = -5 dB | 98.44% | 0.49 |

相比 EMD-CNN-Transformer,本文方法在 5 dB 和 -5 dB 条件下分别提升 3.13% 和 8.11%,且标准差最小,稳定性最优。

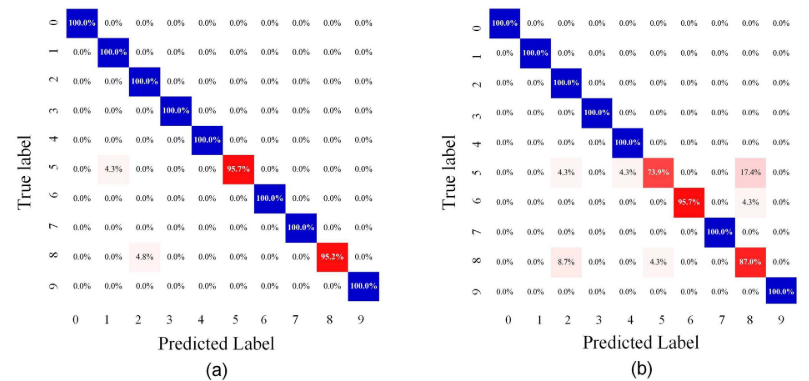

论文 Fig. 17(各方法在 5 dB SNR 下的混淆矩阵对比图,共6个子图)【提供2份】

在 5 dB 噪声条件下,EMD-CNN 对某些类别(如 Fault 5)的识别率仅有 36.4%,EMD-Transformer 对 Fault 7 的识别率仅 16.7%,而本文方法对 10 类故障中的 8 类达到 100% 识别率,其余两类也超过 95%。

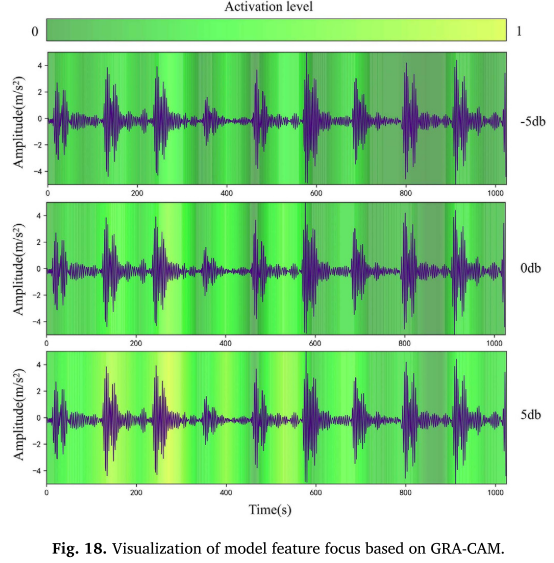

可解释性方面,GRA-CAM 热力图显示,即便在 -5 dB 强噪声下,模型的注意力热响应仍集中于振动信号的冲击特征位置,无明显漂移,展现出优异的特征聚焦能力。

论文 Fig. 18(不同噪声水平下 GRA-CAM 特征热力图可视化)

8.4 MFPT 数据集结果

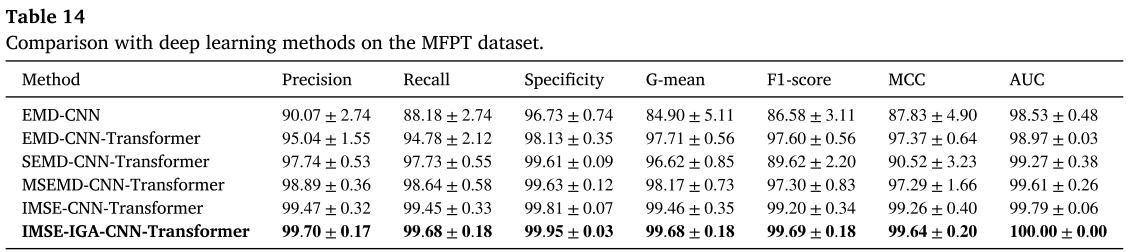

论文 Table 14(MFPT 数据集各方法对比结果表)

本文方法的精确率、召回率、特异性分别超越传统 EMD-CNN-Transformer 约 4.66%、4.90%、1.82%,AUC 达到 100.00%。

噪声鲁棒性测试结果:

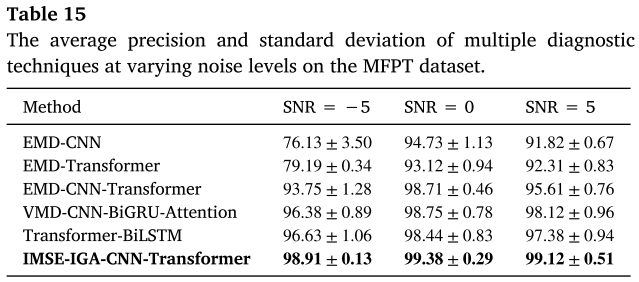

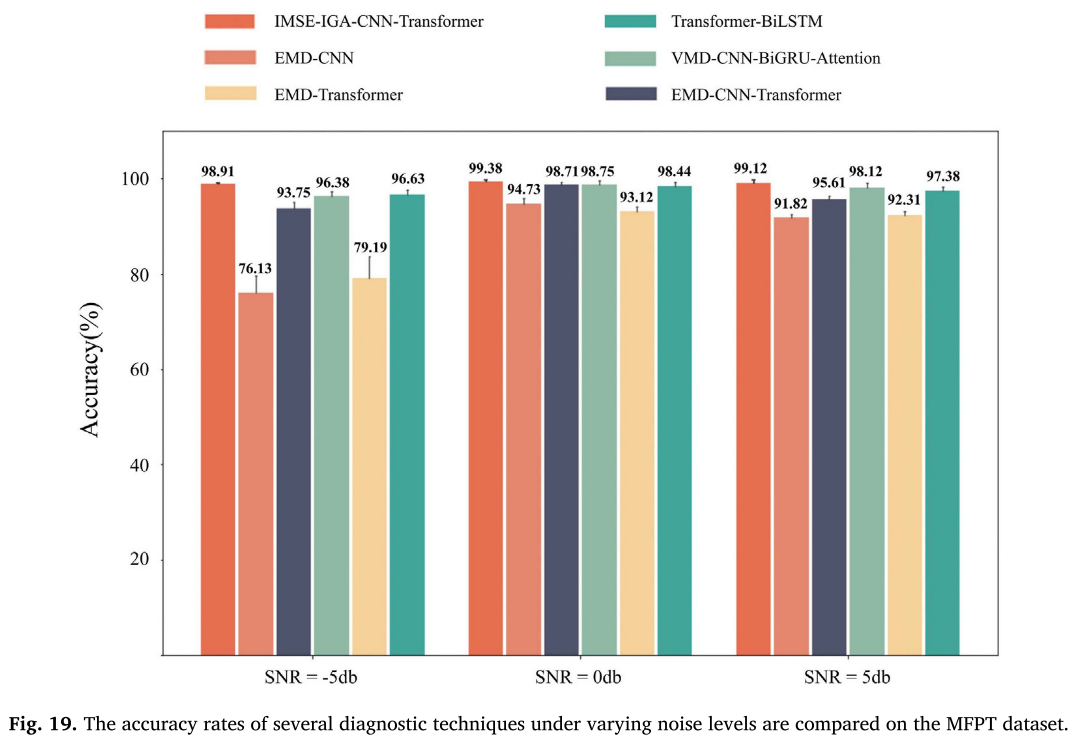

论文 Table 15(MFPT 数据集不同噪声水平下各方法的平均精度与标准差对比表)

论文 Fig. 19(MFPT 数据集不同噪声水平下各方法诊断精度对比柱状图)

在 SNR=-5 dB 下达到 98.91% (标准差仅 0.13),而 EMD-CNN 和 EMD-Transformer 在同等噪声下分别仅有 76.13% 和 79.19%。此外,本文方法在 -5 dB 与 0 dB 之间的精度差距仅为 0.47%,体现了极强的噪声鲁棒性。

九、计算成本分析

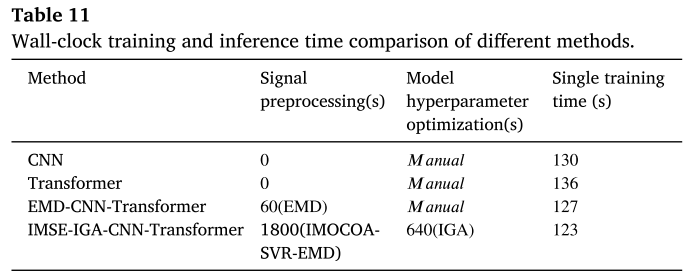

论文 Table 11(各方法的训练与推理时间对比表)

本文框架的信号预处理阶段(IMOCOA-SVR-EMD)耗时约 1800s,IGA 超参数优化耗时约 640s,但单次网络训练时间(123s)反而略低于基线方法(CNN: 130s,Transformer: 136s),说明优化后的超参数有助于加快网络收敛。

重要说明:IMOCOA 和 IGA 的优化开销均发生在离线训练和超参数搜索阶段,一旦获得最优参数,部署推理时无需重复运行进化算法。对于离线诊断、定期维护分析和安全关键监控等场景,这一额外开销是完全可接受的。

十、局限性与未来工作

作者坦诚了以下局限性:

- 计算复杂度:IMOCOA-SVR + IGA 的组合带来较高的离线优化开销,不适合直接部署于实时低延迟的工业边缘设备;

- 数据集范围:目前仅在两个标准基准数据集上验证,尚未系统评估变转速、变载荷等更复杂真实工况下的泛化能力;

- 框架复杂度:多模块集成(IMOCOA-SVR、EMD、CNN-Transformer、IGA)使系统较为复杂,工业部署需要谨慎的系统集成;

- 噪声类型假设:仅对高斯白噪声进行了测试,极端或非预期噪声类型下的性能有待进一步研究。

未来工作方向包括:多模态传感器融合(声发射、温度、电流信号)、实时在线监测部署、联邦学习隐私保护、纵向长期稳定性评估以及真实工业场景的前瞻性验证。

十一、总结

本文提出的 IMSE-IGA-CNN-Transformer 框架从以下四个层面进行了系统性创新:

| 层面 | 创新内容 | 核心贡献 |

|---|---|---|

| 信号层 | IMOCOA-SVR 端点延拓 | 有效抑制 EMD 端点效应,提升 IMF 质量 |

| 算法层 | IMOCOA(混沌初始化+量子变异) | 更快收敛、更强全局搜索能力 |

| 模型层 | IGA 优化 CNN-Transformer | 自适应超参数搜索,提升泛化性 |

| 系统层 | 端到端统一框架 | 信号预处理与模型学习协同优化 |

在 CWRU 和 MFPT 两个标准数据集上,该框架分别取得了 99.55% 和 99.38% 的平均诊断精度,并在 -5 dB 强噪声下仍保持 98.44% 的准确率,展示了其在复杂工业环境中实用化的潜力。