目录

[1.1 什么是模型](#1.1 什么是模型)

[1.2 认识大语言模型](#1.2 认识大语言模型)

[1.3 自监督学习和半监督学习](#1.3 自监督学习和半监督学习)

[1.4 大语言模型的核心特点](#1.4 大语言模型的核心特点)

[2.1 CO-STAR 结构化框架](#2.1 CO-STAR 结构化框架)

[2.2 少样本提示/多示例提示](#2.2 少样本提示/多示例提示)

[2.3 思维链提示](#2.3 思维链提示)

[2.4 自动推理与零样本链式思考](#2.4 自动推理与零样本链式思考)

[2.5 自我批判与迭代](#2.5 自我批判与迭代)

[3.2 嵌入模型应用场景](#3.2 嵌入模型应用场景)

**前言:**本文为学习AI agent开发的前置条件,笔者尽量用最简洁且犀利的语言,来带大家建立对LangChain和LangGraph框架的起源和前因后果,从为什么出现,到这部分是什么,最后怎么用,最后让大家能够进行搭建自己的智能体。

一、认识大语言模型

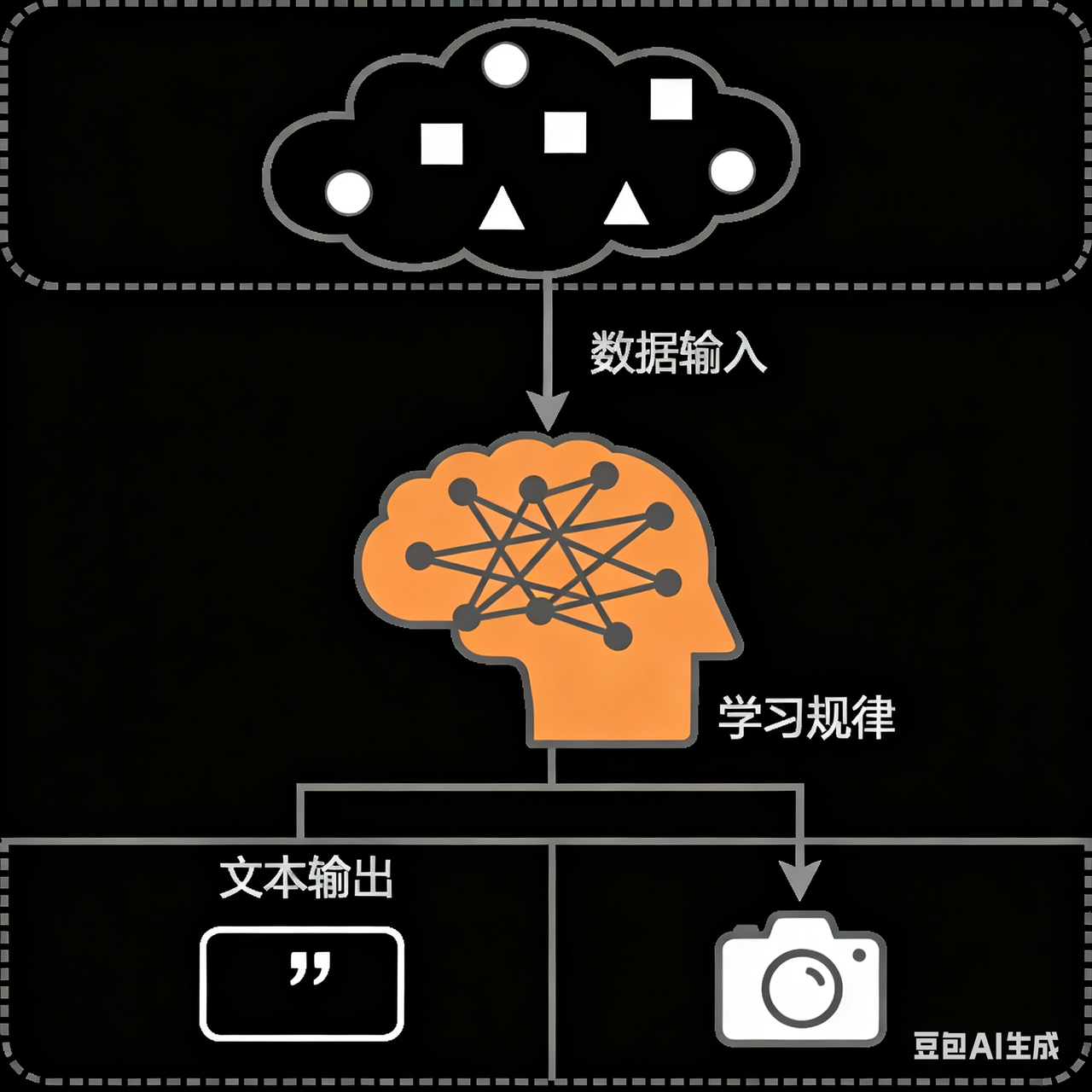

1.1 什么是模型

**模型是一个从数据中学习规律的"数学函数"或"程序"。**旨在处理和生成信息的算法,通常模仿人类的认知功能。通过从大型数据集中学习模式和洞察,这些模型可以进行预测、生成文本、图像或其他输出,从而增强各个行业的各种应用。

简单来说,模型就是我们常说的计算公式和函数的总称,类似于我们常说的经验,是无数次的测试和使用所总结下来的规律。

或者更广泛 的说:模型可以简单理解为模型是一个"超级加工厂" ,这个工厂是经过特殊训练的,训练师给它看了海量的例子数据),并告诉它该怎么做。通过看这些例子,它自己摸索出了一套规则,学会了完成某个"特定任务"。模型就是一套学到的"规则"或者"模式",它能根据你给的东西,产生你想要的东西。

所以我们就很自然的引出模型的关键特点应该是:

特定任务: 一个模型通常只擅长一件事。比如:一个模型专门识别图片里是不是猫。

一个模型专门预测明天会不会下雨。

一个模型专门判断一条评论是好评还是差评。

需要"标注数据": 训练这种模型需要大量"标准答案"。 (比如:成千上万张已经标注好"是猫"或"不是猫"的图片)。

参数较少: 参数是模型从数据中学到的"知识要点"或"内部规则"是"中间数")。参数较少说明模型的复杂度和能力相对有限。

1.2 认识大语言模型

所以,我们再来看大语言模型的定义就能十分清晰的理解,为什么LLM(Large Language Model)大语言模型是如此的受欢迎:

大语言模型(Large Language Model,LLM)是指基于大规模神经网络(参数规模通常达数十亿至万亿级别,例如GPT-3包含1750亿参数),通过自监督或半监督方式,对海量文本进行训练的语言模

这里的神经网络,就是模仿我们大脑的决策系统所构成的:举个例子。

神经网络你就把它理解成一套超级高效的团队协作流程,也可以说是大脑自带的条件反射链条。

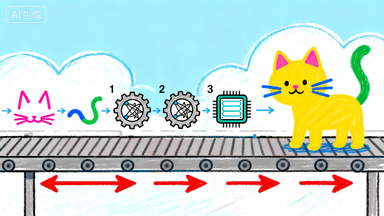

就好比教小孩子认猫:**咱们不会死板地只定一条规矩,**比如 "有胡子就是猫",因为兔子也有胡子,根本分不出来。

正确的做法是让小朋友看一大堆猫咪照片,他脑子里的视觉神经就会组团配合干活:有的神经元专门认尖尖的耳朵,有的专门认胡须,还有的专门认毛茸茸的尾巴。

这些神经一层层把信息传下去、拼在一起,最后大脑综合所有特征,直接判断出来:这就是猫。

而神经网络,就是照着人脑这套工作逻辑模仿做出来的。它里面有好多虚拟的 "神经元",还有互相之间的连接。每一个神经元都像一个小小的打工单元,只负责处理一点点信息。无数神经元分成好几层,上一层算出的结果,就传给下一层接着处理。

然后用海量的数据去训练它,网络会自己慢慢调节每一个神经元的权重、重要程度,最后练成一套特别复杂的判断流水线。就像认猫的神经网络,有的参数专门盯着猫的眼睛,有的专门分辨猫咪的外形轮廓。

一句话总结:神经网络就是靠大量数据慢慢训练出来,由超多参数组成的一套智能复杂决策系统。

那我们看到这里又会有一个疑问,如果人类是有逻辑思考的,如果仅仅是给出答案和计算公式,那和搜索引擎有什么区别,LLM是如何像人一样学习的呢?这就是现在主流的学习模式:自监督学习和半监督学习。

1.3 自监督学习和半监督学习

自监督学习:堪称完形填空顶级高手

给你打个通俗的比方:想学一门外语,身边既没老师出题,也没人帮你批改,该怎么学?

很简单,直接找一本外文小说,自己跟自己玩完形填空。随便遮住句子里一个词,靠着上下文的意思,去猜被遮住的是什么词。 刚开始肯定猜得一塌糊涂,完全摸不着头绪。但就这样反反复复练习,读了成千上万篇内容之后,慢慢就摸清了这门语言的语法规则、词语搭配还有行文逻辑。到最后不光能轻松猜出遮住的单词,甚至还能自己写出通顺自然的文字。

自监督学习就是模仿这个学习过程。 模型会面对网上海量、没有任何人工标注的原始文字内容。不用人安排任务,它自己给自己出题:随机遮挡句子里的字词,依靠前后的文本去预测被遮挡的内容。 经过亿万次这样的自我练习,模型自然而然吃透了语言的底层规律,根本不需要人工挨个给句子标注主谓宾、语法结构。 所以自监督学习,就是模型靠着原始数据自己摸索规律,自己当自己的老师。

半监督学习则是另外一个极端:师父领进门,修行在个人 。

用学做菜来理解再好不过: 师傅先手把手教你几道经典招牌菜,好比给了你少量带标注的数据 ,把基础做法、核心技巧都教给你 。 之后师傅不再逐一教学,而是让你去品尝各式各样的美食,自己琢磨食材搭配、口味层次,这就相当于接触海量无标注的数据 。 你靠着师傅教的基本功,再加上自己大量品鉴摸索的经验,不仅能完美复刻招牌菜,还能举一反三,研发出新菜品,这就是半监督学习的逻辑。 先靠少量有标签的数据,帮模型打好基础、摸清基本规则;再让模型自主在海量无标签数据里深度学习、自我精进。这也是大语言模型训练里很常用的方式。 半监督学习,就是少量人工指导,加上海量自主学习的结合模式。

这听起来好像很枯燥,没错,就是这么枯燥。

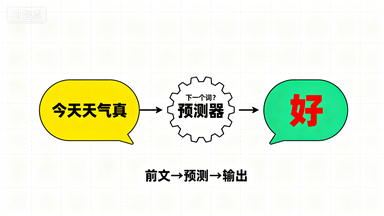

我们接下来再结合一下生活的知识,一切就都通了:我们在用手机打字的时候,输入"今天天气真",输入法会自动提示"好"、"不错"、"冷"等。这个输入法之所以能提示,就是因为它内部有一个小型的"语言模型",它根据你输入的前文,计算下一个词最可能是什么。

**而语言模型的核心任务就是预测下一个词。**一个强大的语言模型,能够根据一段话,预测出最合理、最通顺的下一个词是什么,这样一个个词接下去,就能生成一整段话、一篇文章。

所以我们再来串联一下逻辑:大语言模型,本质上就是

用 "超级团队工作流程"(大规模神经网络)搭建的,拥有数百亿甚至上万亿个 "脑细胞"(参数)的 "超级自动补全系统"(语言模型)。它学习的方式,主要是通过自己玩 "海量完形填空"(自监督学习),或者 "少量名师指导 + 海量自学" (半监督学习)......所以它从互联网上所有的文本数据中学会了语言的规律。

我们由此也能得出

1.4 大语言模型的核心特点

- **规模巨大:**它的"脑细胞"(参数)特别多(通常达到数十亿甚至万亿级别),所以思考问题更复杂、更全面,就像一支百万大军和一个小分队的区别。

- **通用性强:**它不是为单一任务训练的。因为它通过"完形填空"学会的是整个语言世界的底层规律(语法、逻辑、知识关联),而不是只背会了"猫的图片"。所以它能举一反三,把底层能力灵活应用到聊天、翻译、写代码等各种任务上。这种"涌现"能力,就像孩子通过大量阅读后,突然能写出意想不到的优美句子一样。

- **训练方式不同:**主要使用自监督学习,从海量无标注的原始文本中学习。它不依赖人工一张张地给图片标"这是猫",而是直接从原始文本中自学,效率极高,规模可以做得非常大。

- **交互方式革命:**我们不用点按钮、写代码,直接像对人说话一样给它指令(Prompt)它就能听懂并执行,比如你直接说"写一首关于春天的诗",它就能给你写出来。

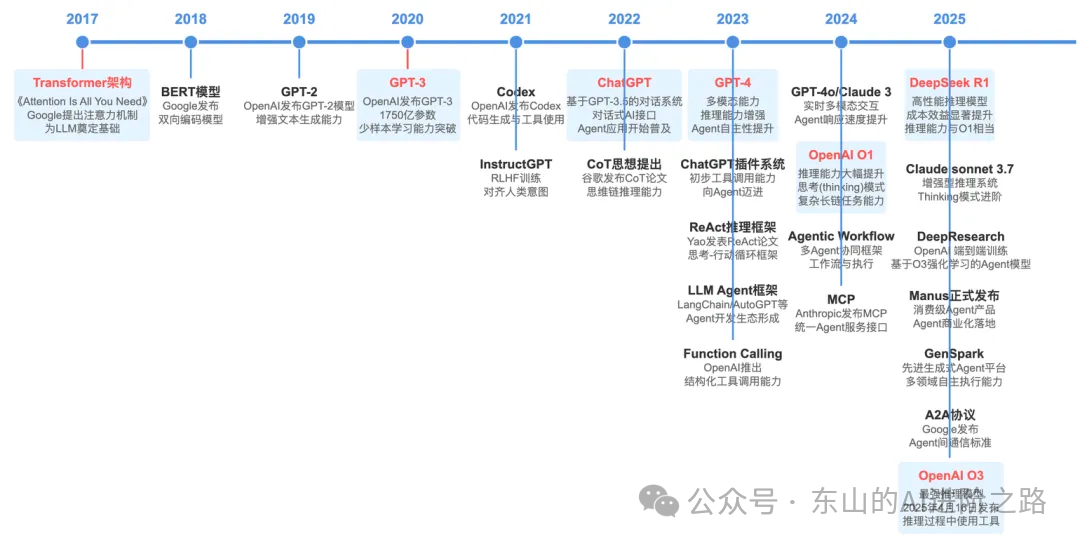

这是我找到的大语言模型的发展历程。

二、提示词的编写

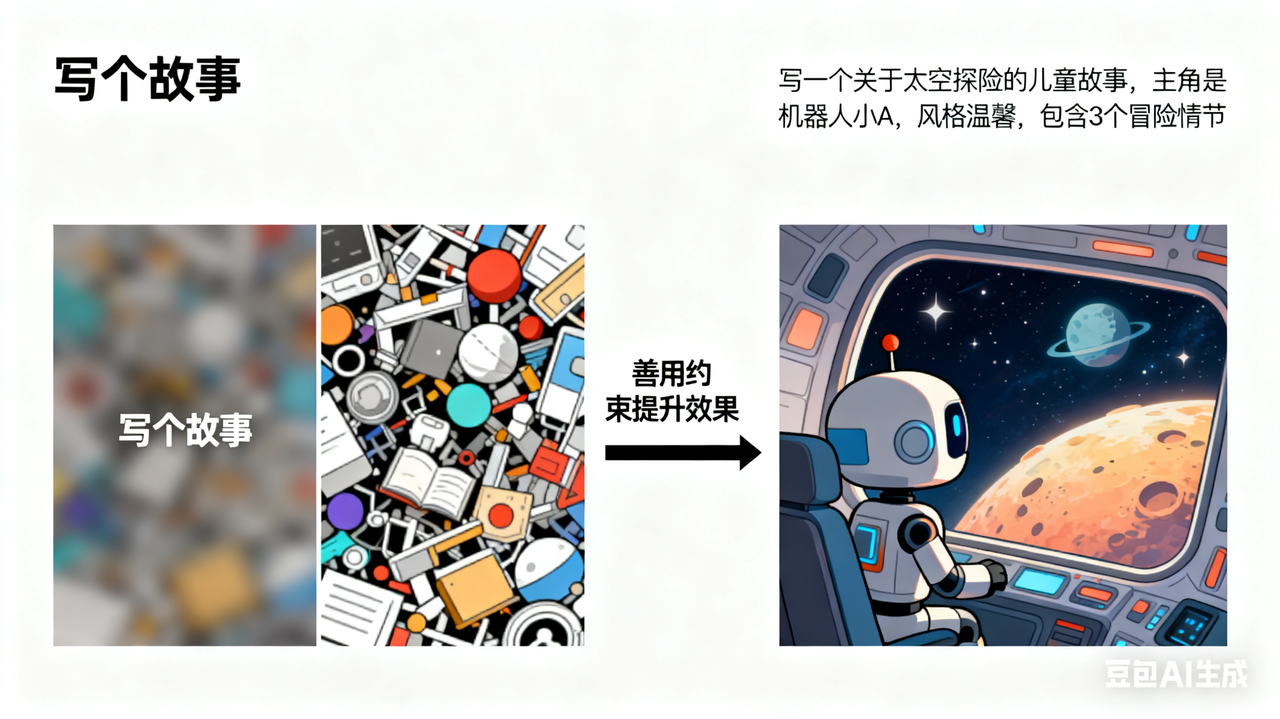

编写合理且有效的提示词,是我们与Al进行有效对话的第一步,好的提示词能显著提升模型输出的质量和相关性。宗旨就是**:将你的问题限定范围,让AI知道你要的答案具体要包含什么,提示词效果会大幅提升。**

核心在于换位思考:想象AI对你提供的信息一无所知,你需要清晰、具体、无歧义地告诉它你要什么、在什么背景下、以什么方式呈现。善用示例、角色扮演、具体约束和迭代优化。

其实我上面没写大语言模型做图片、对话这类功能,因为 AI 兴起之后大家或多或少都用过,但用起来总觉得没法完全称心如意。本质原因就是人类思维是跳跃性的 ,而 AI 的训练逻辑是纯线性的 。换句话说,AI 极度专注,不会像人一样做一件事时,突然灵光联想到另一件事。它只会死死朝着当下唯一目标推进,同一个目标能生成很多种答案,但不会衍生出额外的发散想法,这也正是 AI 缺少真正创造力的根本原因。

所以提示词的使用就显得尤为重要了。

下面是我翻阅论文和收集资料找到的三种提示词编写方式:

2.1 CO-STAR 结构化框架

在目标设定和问题解决的场景下,清晰性和结构性是至关重要的。 而有一种方法论,在这些方面表现都非常出色,那就是CO-STAR框架。这个提示词编写框架,由新加坡政府技术局(GovTech)的数据科学与AI团队开发,重点在于确保提供给LLM的提示词是全面且结构良好的,从而生成更相关和准确的回答。

CO-STAR可以拆解为六个维度。

| 模块 | 说明 | 示例 |

|---|---|---|

| Context 任务背景与上下文 | 交代任务所处场景、相关背景信息 | 你是电商客服,负责解答用户关于 iPhone 17 的咨询,可参照最新价格与库存知识库作答 |

| Objective 核心目标 | 明确本次任务要达成的最终目的 | 准确告知价格、发货时效,同时为用户推荐适配配件 |

| Steps 执行步骤 | 拆解完成任务的具体流程与操作逻辑 | 1. 识别用户咨询问题类型;2. 调取对应知识库信息;3. 用亲切语气整理话术回复 |

| Tone 语言风格 | 设定回复的语气、表达调性 | 口语化表达,少用专业术语,适当使用 "亲~""呢" 这类语气词 |

| Audience 目标用户 | 明确内容面向的人群特征、需求偏好 | 20-35 岁年轻消费群体,对价格敏感,注重性价比 |

| Response 输出格式 | 规定最终答案的排版、结构呈现形式 | 价格:XXX 元库存:XXX 件推荐配件:XXX(附链接) |

举个实际应用场景:需要做健康咨询、定制营养建议,用 CO-STAR 框架就能把模糊提问改成精准提示词。

优化前(模糊低效):我该怎么吃才能更健康?

优化后(清晰规范,套用 CO-STAR 逻辑):角色:你是具备科学依据的 AI 营养顾问。重要约束:所有建议仅作通用参考,不可替代专业医疗诊断,给出具体建议前必须先出示免责声明。任务背景:结合个人身体情况定制每日饮食原则方案。用户信息:・年龄:30 岁・性别:男性・身体目标:减脂增肌・日常状态:办公室久坐,每周 3 次力量训练

回答要求:

- 开篇固定输出免责声明:"请注意:以下建议为通用健康信息......"

- 核心建议围绕「控制总热量摄入,保证足量蛋白质」展开。

- 分别为早餐、午餐、晚餐、训练加餐各给出 1 条核心饮食建议。

- 推荐 2 种适配体质的健康零食。

- 不推荐任何保健品、药品类产品。

输出格式:

【免责声明】固定声明内容

【核心原则】・......

【分餐建议】・早餐:......・午餐:......・晚餐:......・训练加餐:......

【健康零食推荐】

- ......

- ......

这个例子就非常清晰了,我们需要重点看的是接下来两种:

2.2 少样本提示/多示例提示

这种方式通过给 AI 提供一两组输入 - 输出的例子,让它照葫芦画瓢。

核心思想:你不是单纯给它下指令,而是在教它你想要的格式、风格和逻辑。

适用场景:格式固定、风格独特、逻辑复杂的任务,比如文风仿写、数据提取、复杂格式生成等。

示例一

优化前(零样本提示):2 🦜 9 等于多少?

优化后(少样本提示):根据以下示例,处理问题。示例 1:2 🦜 3 = 5示例 2:4 🦜 7 = 11现在请分析这个:2 🦜 9 等于多少?

示例二优化前(零样本提示):请分析以下客户反馈,提取产品名称、情感倾向和具体问题。反馈:"我刚买的耳机,才用了一周左边就没声音了,太让人失望了。"

优化后(少样本提示):请根据以下示例,分析后续的客户反馈,并提取产品名称、情感倾向和具体问题。

示例 1:反馈:"笔记本的电池续航太差了,完全达不到宣传的 10 小时,最多就 4 小时。"

分析:

- 产品名称:笔记本电池

- 情感倾向:负面

- 具体问题:续航远低于宣传

示例 2:反馈:"客服响应很快,非常专业地帮我解决了软件激活问题,点赞!"

分析:

- 产品名称:客服服务

- 情感倾向:正面

- 具体问题:无

现在请分析这个:

・反馈:"我刚买的耳机,才用了一周左边就没声音了,太让人失望了。"

通过示范案例,AI 能清晰学会:"产品名称" 该如何概括、"情感倾向" 用什么标签、"具体问题" 该怎样精简描述。这种做法,比单纯用文字生硬罗列规则,要高效、准确得多。

2.3 思维链提示

提示工程的关键目标是让AI更好地理解复杂语义。

这种能力的高低,可以直接通过模型处理复杂逻辑推理题的表现来检验。

可以这样理解:当好的提示词能帮助模型解决原本解决不了的难题时,就说明它确实提升了模型的推理水平。并且,提示词设计得越出色,这种提升效果就越显著。通过设置不同难度的推理测试,可以很清晰地验证这一点。

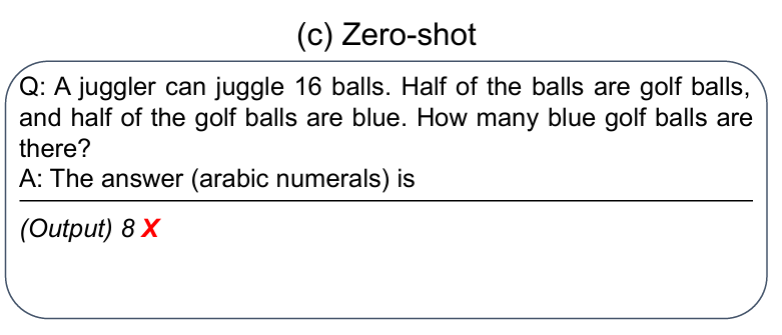

举个例子**(该示例来自论文:Large Language Models are Zero-Shot Reasoners)**

杂耍者可以杂耍 16 个球。其中一半的球是高尔夫球,其中一半的高尔夫球是蓝色的。请问总共有多少个蓝色高尔夫球?

推理结果:8 个蓝色高尔夫球

可以看到,答案错误。该逻辑题的数学计算过程并不复杂,但却设计了一个语言陷阱,即一半的一半是多少。

为了解决类似的逻辑问题,可以使用思维链提示。思维链提示相较于少样本提示是一种更好的提示方法,思维链提示最常用的两种方式:

- Few-shot-CoT:少样本思维链

- Zero-shot-CoT:零样本思维链

相比于少样本提示(Few-shot),少样本思维链(Few-shot-CoT)的不同之处只是在于需要在提示样本中不仅给出问题的答案、还同时需要给出问题推导的过程(即思维链),从而让模型学到思维链的推导过程,并将其应用到新的问题中。此技巧主要用于解决复杂推理问题,如数学、逻辑或多步骤规划。

核心思想:要求 AI "展示其工作过程",而不是直接给出最终答案。这模仿了人类解决问题时的思考方式。

适用场景:数学题、逻辑推理、复杂决策、需要解释过程的任务。

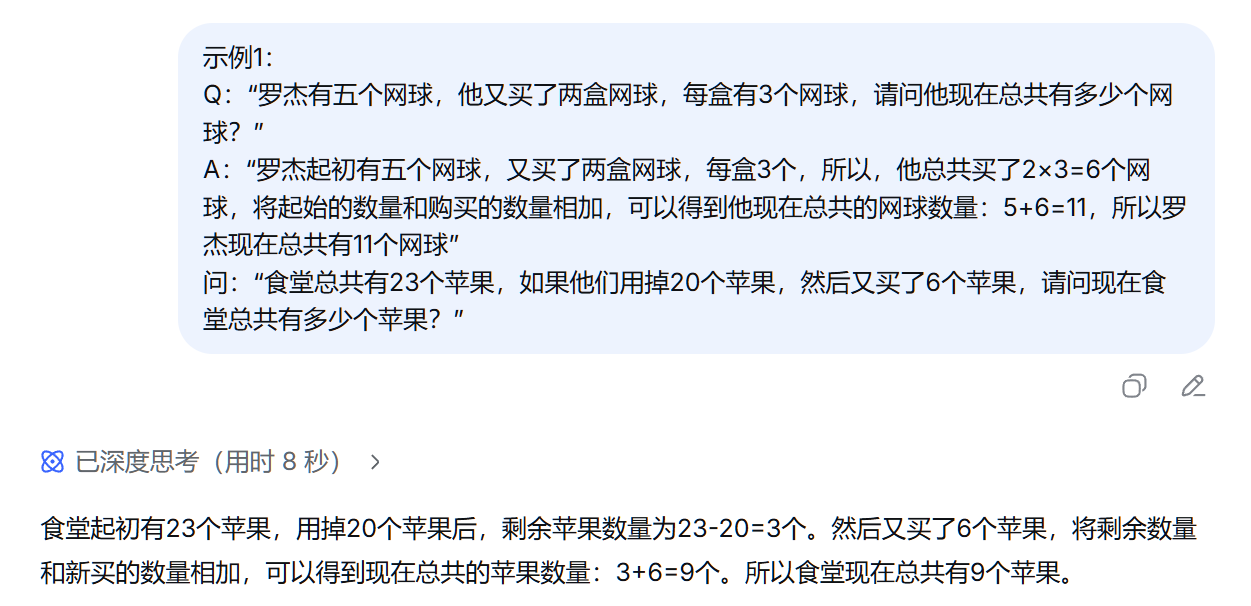

例如,手动写一个思维链作为少样本提示的示例:Q:"罗杰有五个网球,他又买了两盒网球,每盒有 3 个网球,请问他现在总共有多少个网球?"A:"罗杰起初有五个网球,又买了两盒网球,每盒 3 个,所以,他总共买了 2×3=6 个网球,将起始的数量和购买的数量相加,可以得到他现在总共的网球数量:5+6=11,所以罗杰现在总共有 11 个网球"

在获得了一个思维链示例后,就可以以此作为样本进行 Few-shot-CoT 来解决第二个推理问题,如下所示:示例 1:Q:"罗杰有五个网球,他又买了两盒网球,每盒有 3 个网球,请问他现在总共有多少个网球?"A:"罗杰起初有五个网球,又买了两盒网球,每盒 3 个,所以,他总共买了 2×3=6 个网球,将起始的数量和购买的数量相加,可以得到他现在总共的网球数量:5+6=11,所以罗杰现在总共有 11 个网球"

问:"食堂总共有 23 个苹果,如果他们用掉 20 个苹果,然后又买了 6 个苹果,请问现在食堂总共有多少个苹果?"

通过这个例子可以观察到,这就好像是 "把答案告诉了 AI"。从某种意义上说,是的,你告诉它的是回答这个问题的正确方式和步骤,而不仅仅是最终的答案。AI 会模仿你提供的范本结构和逻辑,来解决全新的同类问题。

实际上,Few-shot-CoT 的方式虽然有效,但并不一定始终稳定、精准。如果想要每次都拿到稳定的正确答案,就需要用到更高阶的提示方法。

你给出的思考范例越详细,AI 模仿还原的逻辑就越贴合,这本质上更像是一种手把手教学 和固定格式驯化。当遇到非常复杂的逻辑流程,或是要求 AI 必须严格遵循固定套路输出 ------ 比如先分析 A、再对比 B、最后总结 C 时,直接给它一份标准完整的 "思考全过程" 当作范例,就是最高效的做法。

2.4 自动推理与零样本链式思考

零样本思维链(Zero-shot-CoT)这是少样本思维链(Few-shot-CoT)的简化版。只需在提示词末尾

加上一句魔法短语,即可激发AI的推理能力。

核心思想:通过指令"请一步步进行推理并得出结论",强制AI在给出答案前先进行内部推理。

适用场景

任何需要逻辑推导思考的问题,哪怕我们自己也说不清完整解题步骤,都可以使用。

举例

提问:罗杰有五个网球,他又买了两盒网球,每盒有 3 个网球,请问他现在总共有多少个网球?请一步步进行推理并得出结论。

AI 输出示范:

罗杰最初有 5 个网球。

他买了两盒网球,每盒有 3 个网球,所以买来的网球数量是:2×3=6 个网球。

因此,他现在总共有网球:5+6=11 个。

答案:11 个网球。

"请一步步进行推理" 这个指令,本质是在引导大模型的注意力机制。相当于告诉模型:在给出最终答案前,先在文本生成过程中,模拟出缓慢、有条理的推理思考过程。

当模型主动按第一步、第二步逐层拆解时,其实是在给自己搭建一套更完整、更有逻辑的上下文。依托自己生成的严谨推理语境再做判断,得出的结果,自然比只看原始问题、直接给答案要准确得多。

根据论文《Large Language Models are Zero-Shot Reasoners》的实验结论:在海量测试场景下,少样本思维链 Few-shot-CoT 的推理准确率,要高于零样本思维链 Zero-shot-CoT。

2.5 自我批判与迭代

要求 AI 在生成答案后,从特定角度对自己的答案进行审查和优化。

核心思想:将生成 和评审两个步骤分离,利用 AI 的批判性思维来提升内容质量。

**适用场景:**代码审查、文案优化、论证强化、安全检查。

**案例:**编写一段代码后进行检查

优化前:写一个 Python 函数,计算列表中的最大值。

优化后:

请执行以下两个步骤:

步骤一:编写代码写一个 Python 函数 find_max,用于计算一个数字列表中的最大值。

步骤二:自我审查与优化现在,请从代码健壮性和可读性的角度,审查你上面编写的代码。请回答:

- 如果输入是空列表,函数会怎样?如何改进?

- 变量命名和代码结构是否清晰?能否让它更易于理解?

- 请根据你的审查,给出一个优化后的最终版本。

而在实际应用中,这些技巧常常是组合使用的。例如,我们可以:

- 使用CO-STAR框架设定基本结构和角色。

- 在框架的"Steps"或"Response"部分,融入思维链指令。

- 对于格式复杂的输出,在最后附上少样本示例。

- 最后,要求Al进行自我审查。

当然官方也会在训练的时候给出一些提示词供我们使用,下面可以看一下cursor的官方提示词:

https://cursor.directory/plugins

三、认识嵌入模型

3.1什么是嵌入模型

大语言模型是生成式模型。它理解输入并生成新的文本,比如回答问题、写文章。

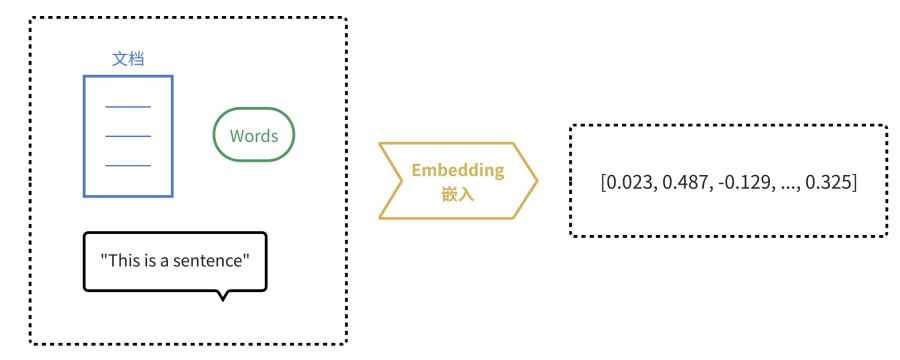

它内部实际上也会使用嵌入技术来理解输入**,但最终目标是创造生成内容** 。 而嵌入模型(Embedding Model)是表示型模型 。它的目标不是生成文本,而是为输入的文本,生成一个最佳、富含语义的数值表示,也就是向量。 计算机天生擅长处理数字,却无法直接理解文字、图片的内在含义。嵌入(Embedding)的核心思想,就是将人类世界的各类符号,比如单词、句子、产品、用户、图片等,转换成计算机能够读懂的数值形式------向量,本质就是一串数字列表。 并且这种转换,必须保留原始符号的语义含义和彼此之间的关联关系。

3.2 嵌入模型应用场景

根据嵌入自身的特性,延伸出了嵌入模型在 AI 领域的诸多落地使用场景:

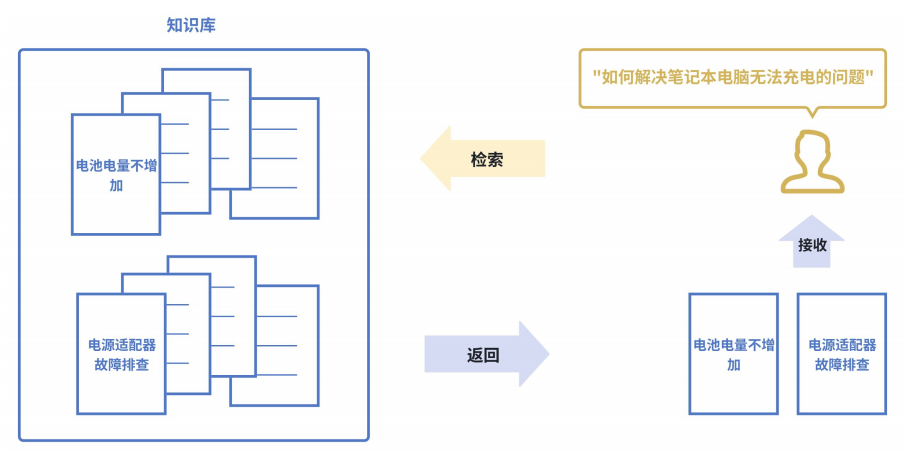

-

语义搜索(Semantic Search) 传统搜索只依赖关键词匹配:搜 "苹果",只能找到字面包含 "苹果" 的文档。而语义搜索会把用户查询和文档全都转为向量,通过计算向量之间的相似度匹配相关内容,就算文档里没有出现一模一样的关键词,也能精准检索到。就好比:知识库中没有直接出现 "笔记本电脑无法充电" 这句话,语义搜索依旧能依靠向量相似度,定位到对应的相关文档。

-

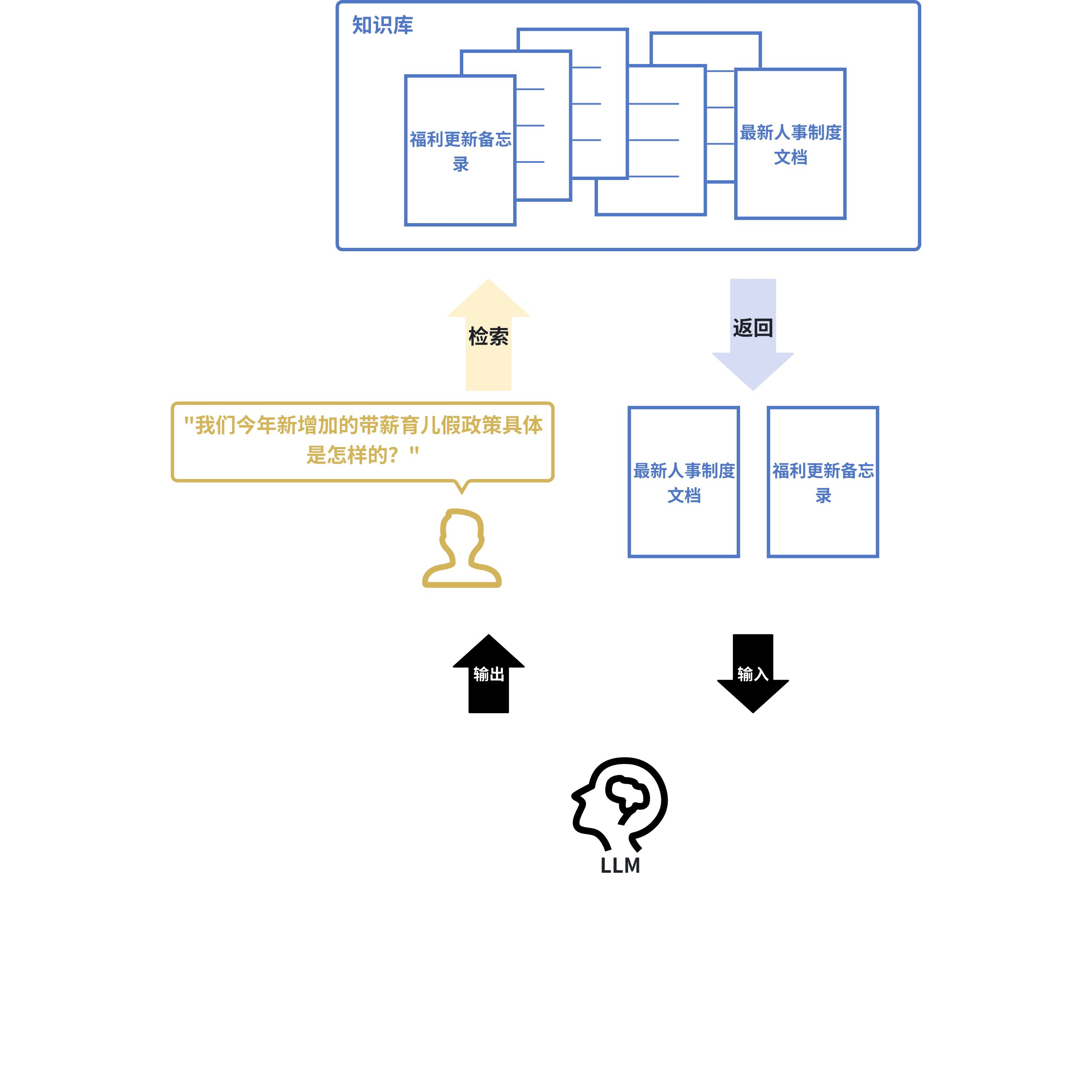

检索增强生成(Retrieval-Augmented Generation, RAG) 这是目前大语言模型落地应用的核心模式。用户向大模型提问时,系统先通过嵌入模型,在公司内部文档等私有知识库中做语义搜索,匹配最相关的资料;再把检索到的内容 + 用户问题一起交给大语言模型生成回答,大幅提升答案的准确性和时效性。

举例:公司内部客服机器人收到员工提问:"我们今年新增加的带薪育儿假政策具体是怎样的?"系统先用嵌入模型,在公司最新人事制度、福利备忘录等资料里做语义检索,匹配到今年育儿假的具体条款;再把这些条款和员工问题一并交给大模型,由大模型整理出准确、具体的专属回答,避免模型只用训练数据,给出过时、笼统的答案。

- **推荐系统(Recommendation Systems)**把用户(历史行为、兴趣偏好)和物品(商品、电影、新闻)都转化为向量。喜好相近的用户,向量距离会靠得很近;内容相似的物品,向量也会聚集在一起。通过计算用户与物品的向量相似度,就能实现精准推荐。

举例:流媒体平台将喜欢《盗梦空间》《黑镜》的用户 A,以及所有电影都转为向量。系统发现用户 A 的向量,和同爱看这两部作品的人群向量高度接近,而这类人群普遍还喜欢《星际穿越》。即便用户 A 从没看过这部影片,依靠向量相似度计算,平台也能精准把《星际穿越》推荐给他。

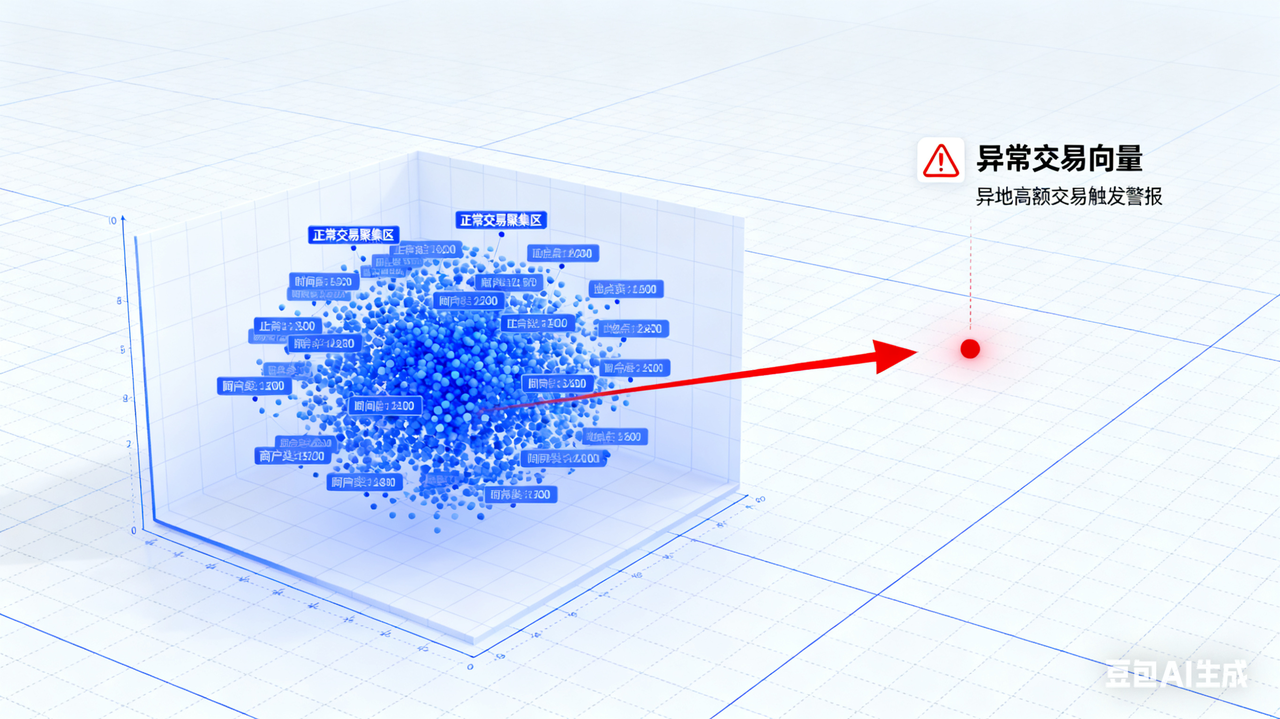

- **异常检测(Anomaly Detection)**正常数据的向量往往会聚集在同一区域;如果新数据的向量远离这个聚集区,就会被判定为异常,比如垃圾邮件、金融欺诈交易等。

举例:信用卡交易反欺诈系统,先学习海量正常交易记录,把交易金额、消费地点、时间、商户类型等特征转为向量,形成正常交易向量聚集区 。当一笔新交易产生时,系统将其转化为向量,一旦向量偏离正常聚集区(比如异地大额消费),就会标记为潜在欺诈交易并触发预警。

当作了解即可,下面是几种主流的嵌入模型:

3.3主流嵌入模型

-

**text-embedding-3-large(OpenAI)**OpenAI 综合能力最强的多语言嵌入模型,适配英语及其他语种任务;默认向量维度 3072,可降维至 1024 维;输入令牌上下文长度支持 8192。

-

**Qwen3-Embedding-8B(阿里巴巴)**开源免费模型,支持百余种语言;上下文长度可达 32k;嵌入维度最高 4096,支持自定义输出维度,区间 32~4096;运行推理需要 GPU 资源,至少 16GB 及以上显存才可高效部署。

-

**gemini-embedding-001(Google)**支持 100 + 种语言;默认维度 3072,可选择降维为 1536 维、768 维;输入令牌上下文长度支持 2048。