概述

贝叶斯定理是概率论中一个非常重要的概念,它提供了一种在已知某些相关事件的概率时,计算另一个事件发生概率的方法。在你提供的内容中,贝叶斯定理被描述为一种"魔法",因为它能够使计算机通过分析大量的数据来预测人们可能想要的结果,例如搜索引擎如何理解用户搜索"自动系鞋带的电影"时可能指的是《回到未来》。

贝叶斯定理的基本公式是:

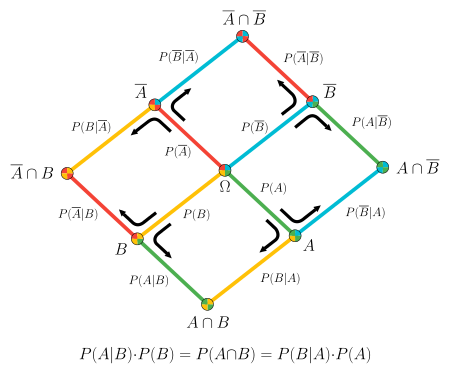

P ( A ∣ B ) = P ( A ) ⋅ P ( B ∣ A ) P ( B ) P(A|B) = \frac{P(A) \cdot P(B|A)}{P(B)} P(A∣B)=P(B)P(A)⋅P(B∣A)

这个公式告诉我们,在事件B发生的条件下事件A发生的条件概率 P ( A ∣ B ) P(A|B) P(A∣B),基于以下几个已知的概率:

- P ( A ) P(A) P(A):事件A发生的先验概率,即没有其他信息时A发生的可能性。

- P ( B ∣ A ) P(B|A) P(B∣A):在事件A发生的条件下事件B发生的条件概率。

- P ( B ) P(B) P(B):事件B发生的先验概率,即没有其他信息时B发生的可能性。

比如用贝叶斯定理被来计算在看到烟雾的情况下发生火灾的概率,以及在多云的早晨计划野餐时下雨的概率。这些例子展示了贝叶斯定理如何在实际情境中应用,帮助我们根据已知信息做出推断。

在机器学习领域,贝叶斯定理尤其重要,因为它是构建贝叶斯分类器的基础。贝叶斯分类器是一种统计分类方法,它使用贝叶斯定理来预测新数据点的类别。这种分类器在面对不完整数据或需要处理不确定性时特别有用。

贝叶斯定理示例

下面我们来举个例子,在判断谁在说谎的游戏场景中,我们可以将贝叶斯定理应用于判断参与者是否在说谎。

在这个假设的场景中,我们有多个参与者(A1、A2、A3),他们中的每一个都可能在说谎或说真话。我们的目标是确定每个参与者说谎的概率,给定他们的证据或行为(B)。这里,B可以是他们的言行、表情、身体语言等,任何可以作为他们是否说谎的证据。

要使用贝叶斯定理,我们需要以下信息:

- 在没有其他信息的情况下,每个参与者说谎的先验概率(P(A1), P(A2), P(A3))。

- 给定某个参与者说谎(或说真话),他们表现出特定行为的似然性(P(B|A1), P(B|A2), P(B|A3))。

贝叶斯定理的公式可以表示为:

P ( A k ∣ B ) = P ( A k ) ⋅ P ( B ∣ A k ) P ( B ) P(A_k|B) = \frac{P(A_k) \cdot P(B|A_k)}{P(B)} P(Ak∣B)=P(B)P(Ak)⋅P(B∣Ak)

其中,P(A_k\|B) 是在观察到证据B的情况下,参与者 A k A_k Ak说谎的后验概率。 P ( A k ) P(A_k) P(Ak)是A_k说谎的先验概率, P ( B ∣ A k ) P(B|A_k) P(B∣Ak) 是在 A k A_k Ak说谎的情况下观察到证据B的似然性,而 P ( B ) P(B) P(B)是观察到证据B的总概率。

在游戏的上下文中,我们可以通过观察每个参与者的行为并结合我们的先验知识和似然性来计算每个参与者说谎的后验概率。例如,如果我们知道某个参与者在紧张时倾向于说谎(P(B|A1)),并且我们知道在没有其他信息的情况下,他们说谎的概率(P(A1)),我们就可以使用贝叶斯定理来更新我们对他们正在说谎的信念。

重要的是要注意,随着我们获得更多关于参与者行为的信息,我们应该更新我们的先验概率,以反映新的证据。这个过程称为"更新先验",它是贝叶斯推理的核心,使我们能够随着新信息的出现不断调整我们的信念。

贝叶斯定理的机器学习应用

在机器学习方面,贝叶斯定理最常见的用法是朴素贝叶斯算法,是因为它假设所有的特征在给定类别的情况下都是相互独立的,这个假设极大地简化了计算过程。

这种算法特别适用于处理大量特征的数据集,如文本数据,其中特征可以是单词的出现与否或其出现频率。尽管朴素贝叶斯的独立性假设在现实世界中往往不成立,但它仍然能够在许多实际应用中提供良好的分类性能。

在Python中,可以使用scikit-learn库来实现朴素贝叶斯分类器。scikit-learn提供了几种朴素贝叶斯分类器的实现,包括多项式朴素贝叶斯、伯努利朴素贝叶斯和高斯朴素贝叶斯。以下是如何使用这些分类器的一些示例:

首先,确保你已经安装了scikit-learn。如果没有安装,可以通过以下命令安装:

bash

pip install scikit-learn1. 多项式朴素贝叶斯(Multinomial Naive Bayes)

假设我们有一个文本分类问题,我们可以使用多项式朴素贝叶斯来处理:

python

from sklearn.feature_extraction.text import CountVectorizer

from sklearn.naive_bayes import MultinomialNB

from sklearn.model_selection import train_test_split

# 示例数据

X = ["这是一个好天气", "今天天气不好", "明天可能会下雨", "我喜欢晴天"]

y = [0, 0, 1, 0] # 假设0表示负面评论,1表示正面评论

# 将文本转换为词频特征

vectorizer = CountVectorizer()

X_vectorized = vectorizer.fit_transform(X)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X_vectorized, y, test_size=0.25, random_state=42)

# 创建多项式朴素贝叶斯分类器实例

clf = MultinomialNB()

# 训练模型

clf.fit(X_train, y_train)

# 预测测试集

predictions = clf.predict(X_test)

print(predictions)2. 伯努利朴素贝叶斯(Bernoulli Naive Bayes)

对于布尔特征(即特征出现或不出现),可以使用伯努利朴素贝叶斯:

python

from sklearn.naive_bayes import BernoulliNB

# 假设我们有一组布尔特征

X = [[1, 0, 1], [0, 1, 1], [1, 0, 0], [0, 1, 0]]

y = [0, 1, 0, 1]

# 创建伯努利朴素贝叶斯分类器实例

clf = BernoulliNB()

# 训练模型

clf.fit(X, y)

# 假设我们有一个新的数据点

new_data = [[1, 1, 0]]

# 预测

prediction = clf.predict(new_data)

print(prediction)3. 高斯朴素贝叶斯(Gaussian Naive Bayes)

当特征是连续的,并且假设它们来自高斯分布时,可以使用高斯朴素贝叶斯:

python

from sklearn.naive_bayes import GaussianNB

# 假设我们有一组连续特征

X = [[5.1, 3.5, 1.4, 0.2], [6.2, 2.8, 4.8, 1.8], [6.3, 2.5, 5.0, 1.9], [5.5, 3.6, 1.0, 0.2]]

y = [0, 1, 1, 0] # 假设0和1分别代表不同的类别

# 创建高斯朴素贝叶斯分类器实例

clf = GaussianNB()

# 训练模型

clf.fit(X, y)

# 假设我们有一个新的数据点

new_data = [[5.0, 3.0, 1.5, 0.3]]

# 预测

prediction = clf.predict(new_data)

print(prediction)