<property>

<name>hadoop.proxyuser.luanhao.groups</name>

<value>*</value>hadoop.proxyuser.luanhao.groups *

2)HDFS配置文件

配置hdfs-site.xml<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> dfs.namenode.http-address Bigdata00:9870

<!-- 2nn web端访问地址-->

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>Bigdata00:9868</value>

</property>

<!-- 测试环境指定HDFS副本的数量1 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

3)YARN配置文件

配置yarn-site.xml<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> yarn.nodemanager.aux-services mapreduce_shuffle

<!-- 指定ResourceManager的地址-->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>Bigdata00</value>

</property>

<!-- 环境变量的继承 -->

<property>

<name>yarn.nodemanager.env-whitelist</name>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAPRED_HOME

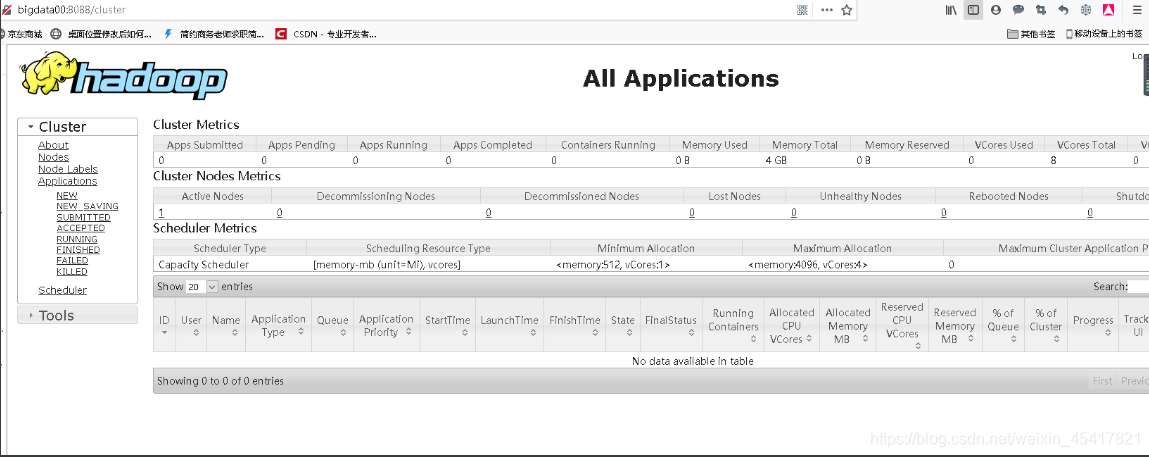

<!-- yarn容器允许分配的最大最小内存 -->

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>512</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>4096</value>

</property>

<!-- yarn容器允许管理的物理内存大小 -->

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>4096</value>

</property>

<!-- 关闭yarn对物理内存和虚拟内存的限制检查 -->

<property>

<name>yarn.nodemanager.pmem-check-enabled</name>

<value>false</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

4)MapReduce配置文件

配置mapred-site.xml<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> mapreduce.framework.name yarn

5)配置workersBigdata00

6)配置hadoop-env.shexport JAVA_HOME=/opt/module/jdk1.8.0_212

#### 配置历史服务器

为了查看程序的历史运行情况,需要配置一下历史服务器。具体配置步骤如下:

配置mapred-site.xmlmapreduce.jobhistory.address Bigdata00:10020 mapreduce.jobhistory.webapp.address Bigdata00:19888

#### 配置日志的聚集

日志聚集概念:应用运行完成以后,将程序运行日志信息上传到HDFS系统上。

日志聚集功能好处:可以方便的查看到程序运行详情,方便开发调试。

注意:开启日志聚集功能,需要重新启动NodeManager 、ResourceManager和HistoryManager。

开启日志聚集功能具体步骤如下:

配置yarn-site.xmlyarn.log-aggregation-enable true yarn.log.server.url http://Bigdata00:19888/jobhistory/logs yarn.log-aggregation.retain-seconds 604800

#### 启动集群

(1)如果集群是第一次启动,需要在Bigdata00节点格式化NameNode(注意格式化之前,一定要先停止上次启动的所有namenode和datanode进程,然后再删除data和log数据)luanhao@Bigdata00 hadoop-3.1.3$ bin/hdfs namenode -format

(2)启动HDFSluanhao@Bigdata00 hadoop-3.1.3$ sbin/start-dfs.sh

(3)在配置了ResourceManager的节点启动YARNluanhao@Bigdata00 hadoop-3.1.3$ sbin/start-yarn.sh

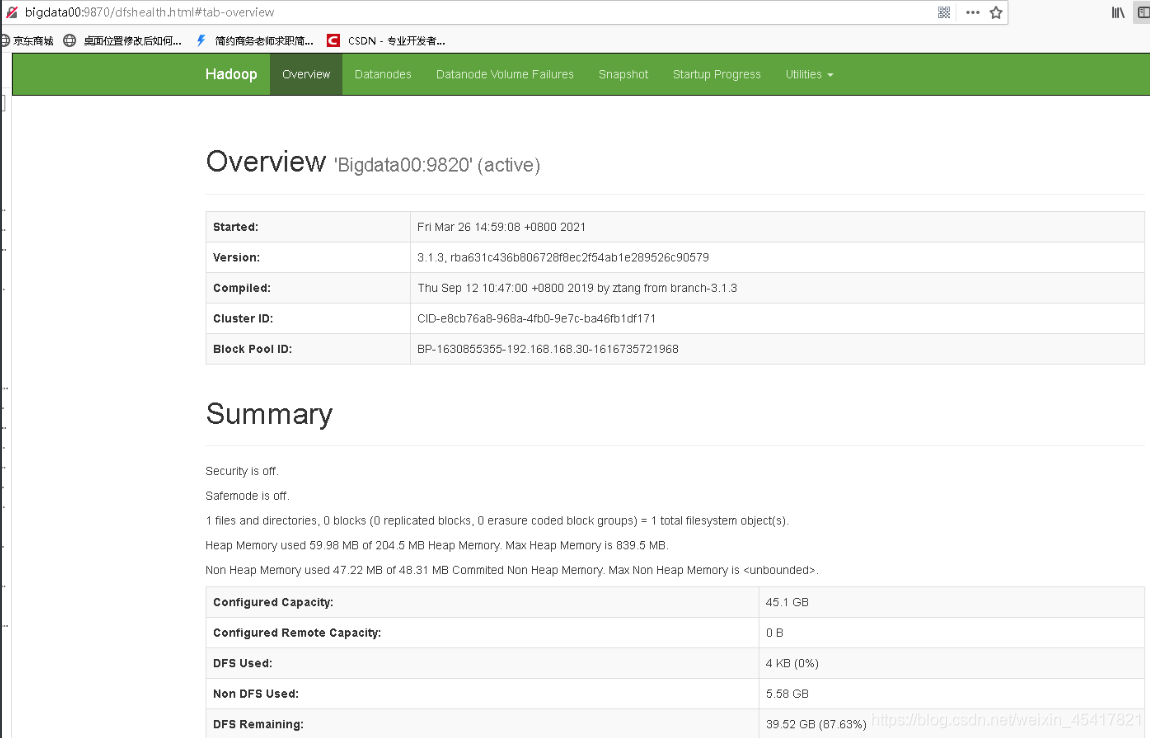

(4)Web端查看HDFS的Web页面:<http://bigdata00:9870>

(5)Web端查看SecondaryNameNode :<http://bigdata00:9868/status.html> (单机模式下面什么都没有)

(6)Web端查看ResourceManager :<http://bigdata00:8088/cluster>

#### LZO压缩配置

1)将编译好后的 hadoop-lzo-0.4.20.jar 放入 hadoop-3.1.3/share/hadoop/common/luanhao@Bigdata00 common$ pwd

/opt/module/hadoop-3.1.3/share/hadoop/common

luanhao@Bigdata00 common$ ls

hadoop-lzo-0.4.20.jar

2)core-site.xml 增加配置支持 LZO 压缩io.compression.codecs org.apache.hadoop.io.compress.GzipCodec, org.apache.hadoop.io.compress.DefaultCodec, org.apache.hadoop.io.compress.BZip2Codec, org.apache.hadoop.io.compress.SnappyCodec, com.hadoop.compression.lzo.LzoCodec, com.hadoop.compression.lzo.LzopCodec io.compression.codec.lzo.class com.hadoop.compression.lzo.LzoCodec

#### Hadoop 3.x 端口号 总结

Hadoop 3.x后,应用的端口有所调整,如下:

| 分类 | 应用 | Haddop 2.x | Haddop 3.x |

| --- | --- | --- | --- |

| NNPorts | Namenode | 8020 | 9820 |

| NNPorts | NN HTTP UI | 50070 | 9870 |

| NNPorts | NN HTTPS UI | 50470 | 9871 |

| SNN ports | SNN HTTP | 50091 | 9869 |

| SNN ports | SNN HTTP UI | 50090 | 9868 |

| DN ports | DN IPC | 50020 | 9867 |

| DN ports | DN | 50010 | 9866 |

| DN ports | DN HTTP UI | 50075 | 9864 |

| DN ports | Namenode | 50475 | 9865 |

| YARN ports | YARN UI | 8088 | 8088 |

### MySQL准备

1)卸载自带的 Mysql-libs(如果之前安装过 mysql,要全都卸载掉)luanhao@Bigdata00 software$ rpm -qa | grep -i -E mysql|mariadb | xargs -n1 sudo rpm -e --nodeps

2)安装 **mysql** **依赖**luanhao@Bigdata00 software$ sudo rpm -ivh 01_mysql-community-common-5.7.16-1.el7.x86_64.rpm

luanhao@Bigdata00 software$ sudo rpm -ivh 02_mysql-community-libs-5.7.16-1.el7.x86_64.rpm

luanhao@Bigdata00 software$ sudo rpm -ivh 03_mysql-community-libs-compat-5.7.16-1.el7.x86_64.rpm

3)安装 **mysql-client**luanhao@Bigdata00 software$ sudo rpm -ivh 04_mysql-community-client-5.7.16-1.el7.x86_64.rpm

4)安装 **mysql-server**luanhao@Bigdata00 software$ sudo rpm -ivh 05_mysql-community-server-5.7.16-1.el7.x86_64.rpm

5)启动 **mysql**luanhao@Bigdata00 software$ sudo systemctl start mysqld

6)查看 **mysql** **密码**luanhao@Bigdata00 software$ sudo cat /var/log/mysqld.log | grep password

配置只要是 root 用户+密码,在任何主机上都能登录 MySQL 数据库。

7)用刚刚查到的密码进入**mysql**(如果报错,给密码加单引号)luanhao@Bigdata00 software$ mysql -uroot -p 'password'

8)设置复杂密码(由于 **mysql** **密码策略,此密码必须足够复杂**)mysql> set password=password("Qs23=zs32");

9)更改 **mysql** **密码策略**mysql> set global validate_password_length=4;

mysql> set global validate_password_policy=0;

10)设置简单好记的密码mysql> set password=password("000000");

11)进入**msyql** **库**mysql> use mysql

**12**)查询 **user** **表**mysql> select user, host from user;

13)修改 **user** **表,把** **Host** **表内容修改为**%mysql> update user set host="%" where user="root";

14)刷新mysql> flush privileges;

15)退出mysql> quit;

### Hive 准备

**1**)把 **apache-hive-3.1.2-bin.tar.gz**上传到 **linux** **的**/opt/software **目录下**

**2**)解压 **apache-hive-3.1.2-bin.tar.gz** **到**/opt/module目录下面luanhao@Bigdata00 software$ tar -zxvf /opt/software/apache-hive-3.1.2-bin.tar.gz -C /opt/module/

**3**)修改 **apache-hive-3.1.2-bin.tar.gz** **的名称为** **hive**luanhao@Bigdata00 software$ mv /opt/module/apache-hive-3.1.2-bin/ /opt/module/hive

**4**)修改/etc/profile,添加环境变量luanhao@Bigdata00 software$ sudo vim /etc/profile

添加内容

#HIVE_HOME

export HIVE_HOME=/opt/module/hive

export PATH= P A T H : PATH: PATH:HIVE_HOME/bin

重启 Xshell 对话框或者 source 一下 /etc/profile 文件,使环境变量生效luanhao@Bigdata00 software$ source /etc/profile

5)解决日志 **Jar** **包冲突,进入**/opt/module/hive/lib 目录(有冲突再做)luanhao@Bigdata00 lib$ mv log4j-slf4j-impl-2.10.0.jar log4j-slf4j-impl-2.10.0.jar.bak

**Hive** **元数据配置到** **MySQL**

**拷贝驱动**

将 MySQL 的 JDBC 驱动拷贝到 Hive 的 lib 目录下luanhao@Bigdata00 lib$ cp /opt/software/mysql-connector-java-5.1.27-bin.jar /opt/module/hive/lib/

**配置** **Metastore** **到** **MySQL**

在$HIVE\_HOME/conf 目录下新建 hive-site.xml 文件luanhao@Bigdata00 conf$ vim hive-site.xml

添加如下内容<?xml version="1.0"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> javax.jdo.option.ConnectionURL jdbc:mysql://Bigdata00:3306/metastore?useSSL=false javax.jdo.option.ConnectionDriverName com.mysql.jdbc.Driver javax.jdo.option.ConnectionUserName root javax.jdo.option.ConnectionPassword 000000 hive.metastore.warehouse.dir /user/hive/warehouse hive.metastore.schema.verification false hive.server2.thrift.port 10000 hive.server2.thrift.bind.host Bigdata00 hive.metastore.event.db.notification.api.auth false hive.cli.print.header true hive.cli.print.current.db true

**启动** **Hive**

**初始化元数据库**

**1**)登陆**MySQL**luanhao@Bigdata00 conf$ mysql -uroot -p000000

**2**)新建 **Hive** **元数据库**mysql> create database metastore;

mysql> quit;

**3**)初始化 **Hive** **元数据库**luanhao@Bigdata00 conf$ schematool -initSchema -dbType mysql -verbose

**启动** **hive** **客户端**

**1**)启动 **Hive** **客户端**luanhao@Bigdata00 hive$ bin/hive

**2**)查看一下数据库hive (default)> show databases;

OK

database_name

default

### Spark 准备

(1)Spark 官网下载 jar 包地址:

http://spark.apache.org/downloads.html

(2)上传并解压解压 spark-3.0.0-bin-hadoop3.2.tgzluanhao@Bigdata00 software$ tar -zxvf spark-3.0.0-bin-hadoop3.2.tgz -C /opt/module/

luanhao@Bigdata00 software$ mv /opt/module/spark-3.0.0-bin-hadoop3.2 /opt/module/spark

(3)配置 SPARK\_HOME 环境变量luanhao@Bigdata00 software$ sudo vim /etc/profile

添加如下内容

SPARK_HOME

export SPARK_HOME=/opt/module/spark

export PATH= P A T H : PATH: PATH:SPARK_HOME/bin

source 使其生效luanhao@Bigdata00 software$ source /etc/profile

(4)在**hive** **中创建** **spark** **配置文件**luanhao@Bigdata00 software$ vim /opt/module/hive/conf/spark-defaults.conf

添加如下内容(在执行任务时,会根据如下参数执行)

spark.master yarn

spark.eventLog.enabled true

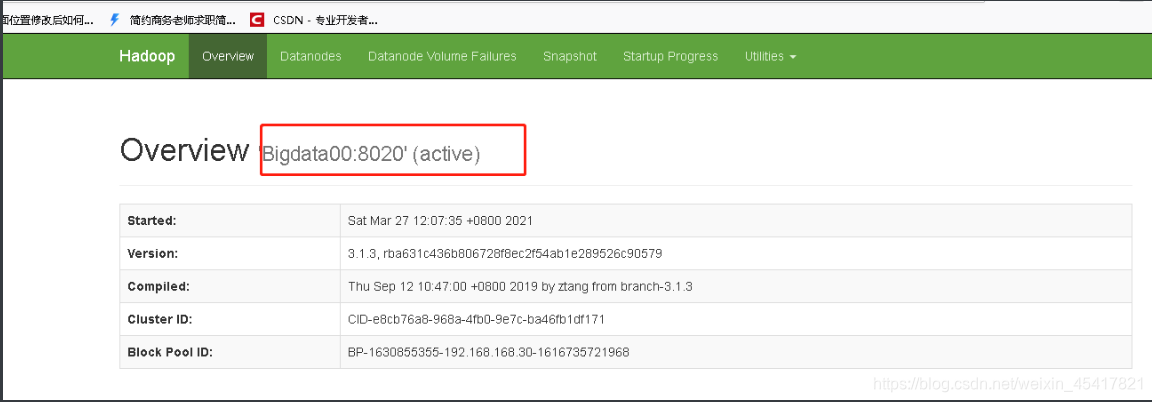

spark.eventLog.dir hdfs://Bigdata00:8020/spark-history

spark.executor.memory 1g

spark.driver.memory 1g

在 HDFS 创建如下路径,用于存储历史日志luanhao@Bigdata00 software$ hadoop fs -mkdir /spark-history

(5)向 **HDFS** **上传** **Spark** **纯净版** **jar** **包**

说明 1:由于 Spark3.0.0 非纯净版默认支持的是 hive2.3.7 版本,直接使用会和安装的Hive3.1.2 出现兼容性问题。所以采用 Spark 纯净版 jar 包,不包含 hadoop 和 hive 相关依赖,避免冲突。

说明 2:Hive 任务最终由 Spark 来执行,Spark 任务资源分配由 Yarn 来调度,该任务有可能被分配到集群的任何一个节点。所以需要将 Spark 的依赖上传到 HDFS 集群路径,这样集群中任何一个节点都能获取到。

(6)上传并解压 spark-3.0.0-bin-without-hadoop.tgzluanhao@Bigdata00 software$ tar -zxvf /opt/software/spark-3.0.0-bin-without-hadoop.tgz

(7)上传 Spark 纯净版 jar 包到 HDFSluanhao@Bigdata00 software$ hadoop fs -mkdir /spark-jars

luanhao@Bigdata00 software$ hadoop fs -put spark-3.0.0-bin-without-hadoop/jars/* /spark-jars

## Hive on Spark 配置

修改 **hive-site.xml** **文件**luanhao@Bigdata00 \~$ vim /opt/module/hive/conf/hive-site.xml

添加如下内容

spark.yarn.jars hdfs://Bigdata00:8020/spark-jars/* hive.execution.engine spark hive.spark.client.connect.timeout 10000ms

**hadoop 3.1.3 默认 NameNode 端口是 9820** **重新在hadoop 下的 core-site.xml 将 9820 修改成 8020 就可以了**

core-site.xmlfs.defaultFS hdfs://Bigdata00:8020

注意:hive.spark.client.connect.timeout 的默认值是 1000ms,如果执行 hive 的 insert 语句时,抛如下异常,可以调大该参数到 10000msFAILED: SemanticException Failed to get a spark session:

org.apache.hadoop.hive.ql.metadata.HiveException: Failed to create Spark

client for Spark session d9e0224c-3d14-4bf4-95bc-ee3ec56df48e

**1**)兼容性说明

注意:官网下载的 Hive3.1.2 和 Spark3.0.0 默认是不兼容的。因为 Hive3.1.2 支持的 Spark版本是 2.4.5,所以需要我们重新编译 Hive3.1.2 版本。

编译步骤:官网下载 Hive3.1.2 源码,修改 pom 文件中引用的 Spark 版本为 3.0.0,如果编译通过,直接打包获取 jar 包。如果报错,就根据提示,修改相关方法,直到不报错,打包获取 jar 包。

Hive on Spark仅使用特定版本的Spark进行测试,因此只能确保给定版本的Hive与特定版本的Spark一起使用。其他版本的Spark可能与给定版本的Hive一起使用,但这不能保证。下面是Hive版本列表及其相应的兼容Spark版本。

| Hive Version | Spark Version |

| --- | --- |

| master | 2.3.0 |

| 3.0.x | 2.3.0 |

| 2.3.x | 2.0.0 |

| 2.2.x | 1.6.0 |

| 2.1.x | 1.6.0 |

| 2.0.x | 1.5.0 |

| 1.2.x | 1.3.1 |

| 1.1.x | 1.2.0 |

2)在 Hive **所在节点部署** **Spark**

如果之前已经部署了 Spark,则该步骤可以跳过,但要检查 SPARK\_HOME 的环境变量配置是否正确。

## Hive on Spark测试

(1)启动 hive 客户端luanhao@Bigdata00 hive$ bin/hive

(2)创建一张测试表hive (default)> create table huanhuan(id int, name string);

建表之后查看表发现报错,此时排障,我们忘了将 hadoop-lzo-0.4.20.jar 放到 /opt/module/hadoop-3.1.3/share/hadoop/common/ 目录下,