一、蓝耘平台是什么

蓝耘智算云(LY Cloud)是蓝耘科技打造的现代化GPU算力云服务平台,深度整合自研DS满血版大模型技术与分布式算力调度能力,形成"模型+算力"双轮驱动的技术生态。平台核心优势如下:

平台定位与技术架构

• 核心目标:为工程师、科研人员及企业提供高效、低成本的算力支持,加速AIGC产业创新。

• 技术架构:基于Kubernetes设计,支持大规模GPU加速工作负载,算力速度较传统云服务商提升35%,成本降低30%。采用自研分布式计算框架支持DS满血版模型的高效运行,技术创新包括:

• 混合精度训练:通过FP16/FP8混合计算,节省40%显存占用

• 动态资源分配:基于实时负载的算力弹性调度算法,资源利用率达92%

• 上下文扩展技术:支持128k tokens长文本处理,集成滑动窗口注意力与记忆压缩算法

• 基础设施:

• 硬件资源:配备丰富的英伟达GPU系列(支持高并发训练与推理),接入中国T3+数据中心,保障稳定性与低时延。

• 存储与网络:分布式容错存储(三重复制机制),支持按需扩展;高速网络架构(可达100Gbps以上),无出口费用,适配高性能计算需求。

二、蓝耘平台注册和使用的基本流程

1. 注册与账号激活

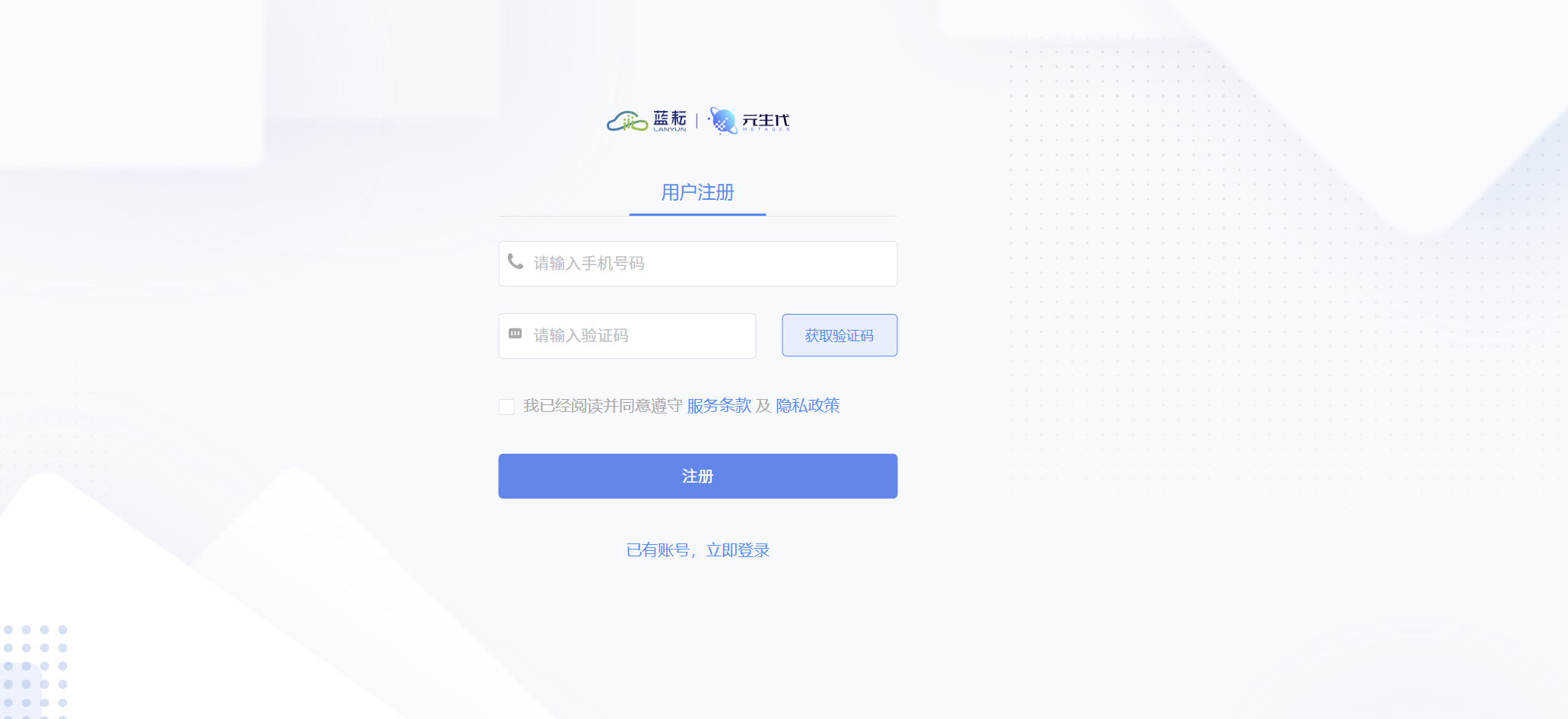

• 注册入口:通过链接:蓝耕平台注册链接进入注册页面。

• 注册步骤:

-

输入手机号/邮箱,获取并填写验证码,设置登录密码。

-

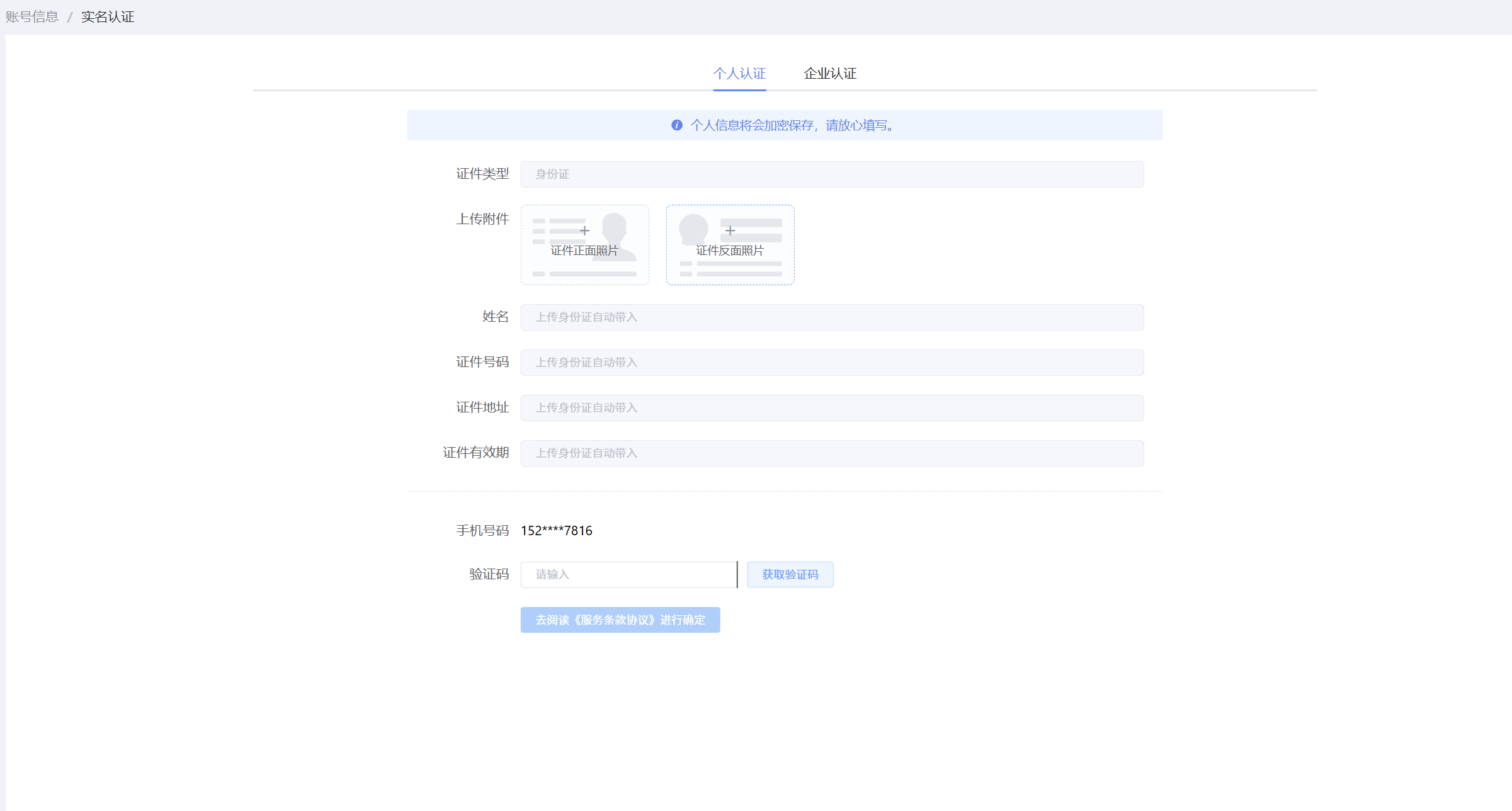

完成实名认证(企业用户需提交营业执照等资质),解锁全功能权限。

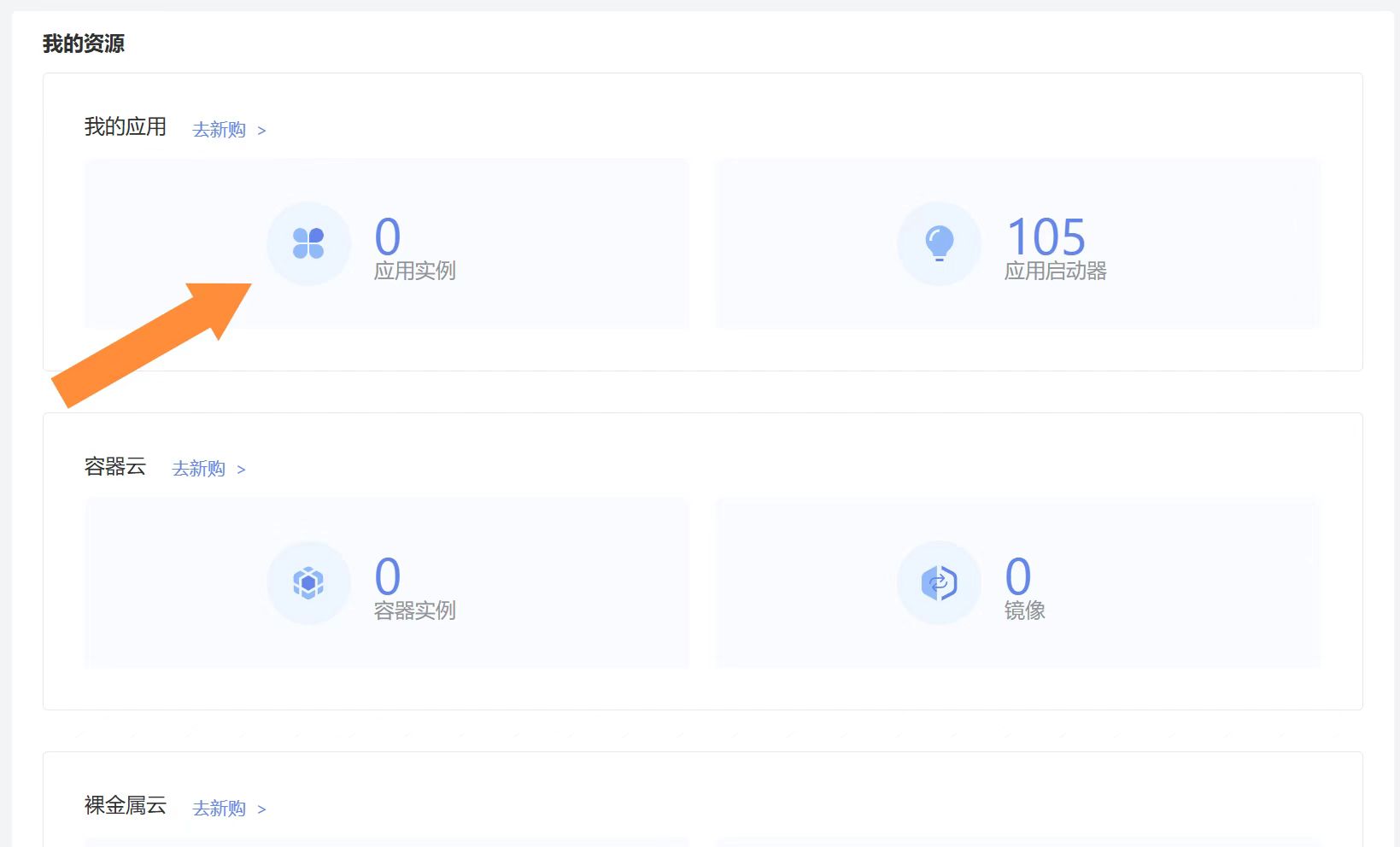

2. 算力使用与应用部署增强功能

• 模型市场预置:提供预装DS满血版(671B参数)及轻量化版本(7B/14B/32B),支持开箱即用。

新人在登陆时就会赠送代金券进行算力体验

• 私有化部署套件:提供模型微调接口与Docker封装方案,支持企业级私有化部署。

• 核心流程:

-

选择应用:进入"应用市场",按需选择预配置环境(如通义万相2.1文生图/视频工具、PyTorch/TensorFlow开发框架等)。

在找到我们需要使用的大模型以后,只需要点击查看详情,就会有对应的使用说明和模型用途

-

配置资源:根据任务需求选择GPU型号(如NVIDIA A100、V100)、存储容量及网络带宽,支持灵活调整配置。

点击部署后,有相应的购买方案可供选择

直接点击购买即可,扣款会按照先代金券再现金额度的顺序扣款

-

启动与操作:

• 点击"立即部署",等待实例初始化(通常数分钟内完成)。

• 进入工作空间后(点击快速进入应用就可以,用完了记得关机),通过可视化界面或代码终端输入任务参数(如文生图场景中填写正向/反向提示词、图片尺寸)。

- 结果获取:任务完成后,直接在平台界面查看生成结果(如图像、视频、训练日志),支持下载或导出至本地。

3. 管理与计费

• 进度监控:通过"控制台"实时查看算力使用状态、任务进度及资源消耗。

• 计费方式:支持按需付费(按小时/分钟计费)或套餐购买。

三、蓝耘平台使用体验

- 易用性:对新手友好的操作界面

• 作为AI创作新手,通过平台教程首次尝试文生图时,无需编写复杂代码,只需输入关键词即可生成高质量图像,平台自动补全提示词功能大幅降低了使用门槛。

• 注册流程简洁,实名认证快速通过。

- 算力性能:高效稳定,满足多元需求

• 在训练小型神经网络时,平台提供的GPU算力明显优于本地设备,训练耗时缩短50%以上,且支持断点续传,避免重复计算。

• 在实际部署DS R1-32B模型中:

• 推理速度对比:相较本地RTX 3090部署,云端RTX 4090实例响应速度提升220%

• 稳定性表现:连续72小时压力测试,API调用成功率保持99.98%

• 成本优势示例:构建智能客服系统时,综合成本较传统方案降低57%

- 生态与服务:资源丰富,支持体系完善

• 开发者支持体系:建立包含快速启动模板(21个)、调试工具集(含分布式追踪系统)、技术资料包(架构图+API规范+代码库)的完整资源矩阵。

• 行业解决方案:已落地金融投研系统(某券商日处理研报1200份)、医疗知识图谱(三甲医院病理分析效率提升40%)等标杆案例。

• 平台定期举办技术沙龙与开发者活动,提供与行业专家交流的机会。

• 客服响应及时,通过工单系统或社群咨询时,技术问题通常在30分钟内得到解答,企业级客户还可申请定制化算力方案。

四、架构升级规划

根据平台演进路线,蓝耘智算云将实现:

-

多模态服务网关:整合图文联合推理引擎,Q3上线视觉API服务。

-

智能算力网络:构建跨区域算力调度系统,预计降低跨域计算时延45%。

总结

蓝耘平台凭借高性能算力、灵活的资源配置及用户友好的设计,成为AI开发者与企业的重要工具。无论是科研探索还是产业落地,其"降本提效"的核心优势显著,适合作为入门级算力平台或企业级算力解决方案。未来随着算力需求的爆发式增长,蓝耘在智算云服务领域的潜力值得期待。