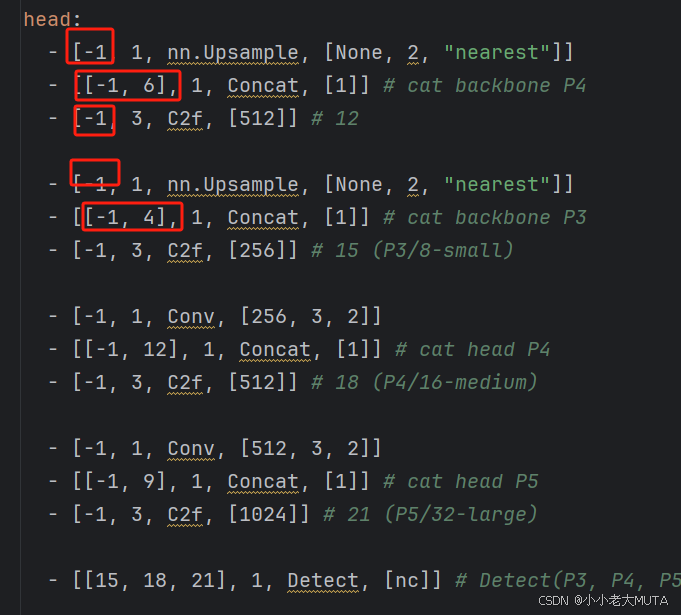

yaml文件中,输入来自上一层和第六层的输入:

是将这两个输入打包成列表

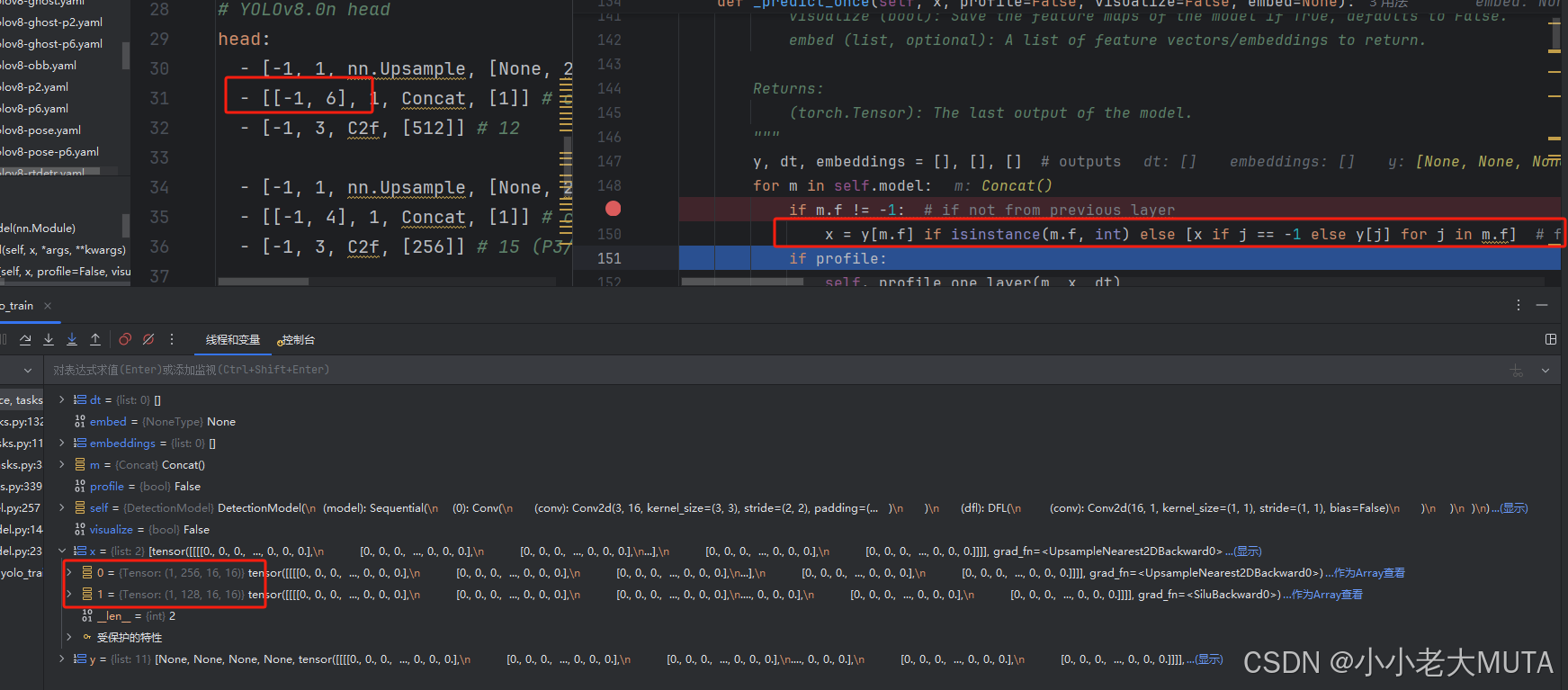

详解这段代码:

python

x = y[m.f] if isinstance(m.f, int) else [x if j == -1 else y[j] for j in m.f] # from earlier layers输入来源

m.f

m.f:表示当前层的输入来源,可以是一个整数或一个列表。这个属性通常在模型的构建阶段定义,指明了当前层的输入是来自哪个层。也就是第一列参数:

检查m.f的类型

isinstance(m.f, int):检查m.f是否是一个整数。如果是整数,说明当前层的输入仅来自于一个特定的前置层。

从y列表中获取输入

y[m.f]:

- 如果

m.f是一个整数,直接使用y[m.f]获取对应层的输出。y列表在模型的前向传播过程中存储了各个层的输出。因此,通过y[m.f]可以获得之前某一层的输出,作为当前层的输入。

从多个层中获取输入

else [x if j == -1 else y[j] for j in m.f]:

- 如果

m.f是一个列表,说明当前层需要从多个前置层获取输入。- 在这个列表推导式中,

x的值取决于m.f中每个元素j的值。x 将通过列表推导式生成一个列表。

这里的y\[\]列表 是根据 parse_model函数中创建 的save列表对save\[\]列表中记录的层数输出进行保存;save只保存明确指定层的层数,-1这种上一层不保存。

假设 f = [-1, 6]。列表推导式的工作方式如下:

-

初始状态:

- 假设当前层的输入(在模型的前向传播中)是一个张量,比如

input_tensor。

- 假设当前层的输入(在模型的前向传播中)是一个张量,比如

-

遍历

m.f:- 对于

j = -1:- 根据条件

if j == -1,将x赋值为当前层的输入,即x = input_tensor。

- 根据条件

- 对于

j = 6:- 根据条件

else y[j],将y[6]的输出添加到x中。

- 根据条件

- 对于

最终,x = input_tensor, y\[6 ]

所以这里,用-1,6 两层concat:

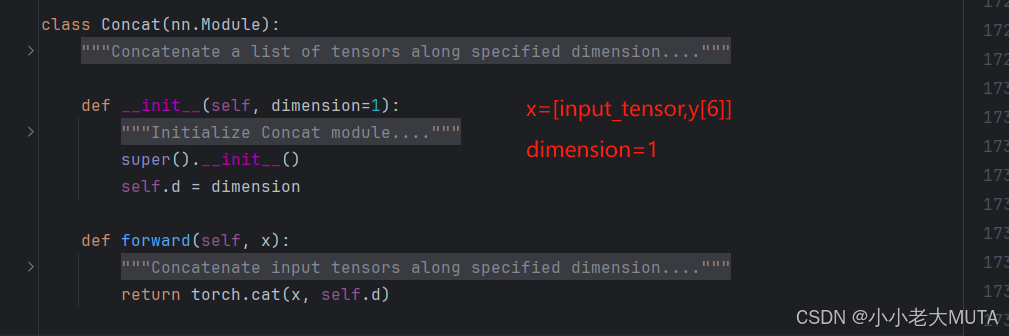

也就是对列表中的两个张量在第1维度进行拼接:

python

import torch

import torch.nn as nn

# 假设我们有两个张量

input_tensor = torch.randn(2, 3, 4, 4) # 形状为 (N=2, C1=3, H=4, W=4)

y_6 = torch.randn(2, 5, 4, 4) # 形状为 (N=2, C2=5, H=4, W=4)

# 将张量放入列表

tensors = [input_tensor, y_6]

# 使用 torch.cat 进行连接

result = torch.cat(tensors, dim=1) # 在通道维度上连接

# 显示结果的形状

print(result.shape) # 输出: torch.Size([2, 8, 4, 4]),其中 8 = 3 + 5