1.什么是卷积神经网络

一种前馈神经网络;受生物学感受野的机制提出专门处理网格结构数据的深度学习模型

核心特点:通过卷积操作自动提取空间局部特征(如纹理、边缘),显著降低参数量

2.CNN的三个结构特征

局部连接;权重共享(不同位置上的卷积核是一样的);空间或时间上的次采样

3.卷积过程及不同类型的卷积

卷积过程:

输入矩阵与卷积核作矩阵乘法得到特征矩阵

javascript

输入矩阵 卷积核(3×3) 输出特征图(3×3)

[1, 1, 1, 0, 0] [1, 0, 1] [4, 3, 4]

[0, 1, 1, 1, 0] [0, 1, 0] → [2, 4, 3]

[0, 0, 1, 1, 1] [1, 0, 1] [2, 3, 4]

[0, 0, 1, 1, 0] (步长=1,无填充)

[1, 1, 0, 0, 0]不同类型卷积:

举出较常见的:

(1)窄卷积:步长step=1,无padding,卷积后输出维数为M-K+1

(2)宽卷积:步长step=1,有padding,在外围补K-1圈0,卷积后输出维数M+K-1

(3)等宽卷积(输出大小不变):步长step=1;有padding,在外围补一圈0即可,卷积后输出维数为M

注:M为输入序列的维数,K为补的大小,以矩阵为例

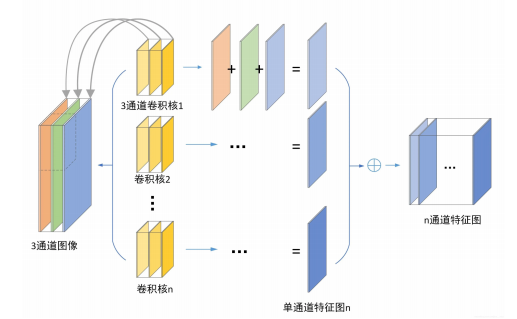

4.卷积核,卷积层,卷积网络结构

卷积核:

一个特征提取器,可以有多个卷积核,比如一个提取水平特征一个提取垂直特征,可以通过增加卷积核的个数来增强卷积层的能力

卷积层:

典型的卷积层为3维结构

卷积网络结构:

由卷积层、池化层,全连接层堆叠而成

(1)数据输入层(input_layer)

(2)卷积计算层(conv_layer)

局部特征提取;训练中进行参数学习;每个卷积核提取特定模式的特征

(3)ReLU激活层(ReLU_layer)

(4)池化层(polling_layer)

降低数据维度,避免过拟合;增强局部感受野;提高平移不变性

为了提炼最主要的特征并降维

(5)全连接层(fc_layer)

特征提取到分类的桥梁

5.残差网络(ResNet)

通过给非线性的卷积层增加直连边的方式来提高信息的传播效率

ResNet通过 "跨层连接 + 残差学习" ,将深层网络训练转化为对微小扰动(残差)的优化,彻底解决深度退化问题,开启千层神经网络时代