基本信息

题目:R3LIVE: A Robust, Real-time, RGB-colored, LiDAR-Inertial-Visual tightly-coupled state Estimation and mapping package

来源:ICRA 2022

学校:港大MARS

是否开源:https://github.com/hku-mars/r3live

摘要:激光视觉惯性SLAM系统,可重建Mesh

在本文中,我们提出了一种新的激光雷达-惯性视觉传感器融合框架,称为R3LIVE,它利用激光雷达、惯性和视觉传感器的测量来实现鲁棒和准确的状态估计。R3LIVE由激光雷达-惯性测程法( LIO )和视觉惯性里程计( VIO )两个子系统组成。LIO子系统( FASTLIO )利用激光雷达和惯性传感器的测量数据,构建了(即3D点的位置)全球地图的几何结构。VIO子系统利用视觉惯性传感器的数据,渲染地图的纹理(即3D点的颜色)。更具体地说,VIO子系统通过最小化帧到地图的光度误差,直接有效地融合视觉数据。 所开发的系统R3LIVE是在我们之前的工作R2LIVE的基础上开发的,并进行了仔细的架构设计和实现。实验结果表明,该系统比现有同类系统具有更强的鲁棒性和更高的状态估计精度。R3LIVE是一个多功能的、面向各种可能应用的精心设计的系统,它不仅可以作为实时机器人应用的SLAM系统,还可以重建稠密的、精确的、RGB颜色的三维地图,用于测绘等应用。 此外,为了使R3LIVE具有更好的可扩展性,我们开发了一系列离线重建和纹理化网格的实用工具,进一步缩小了R3LIVE与模拟器、视频游戏等各种三维应用之间的差距。

Introduction

引言首先介绍了LiDAR传感器在机器人领域的广泛应用,例如自动驾驶车辆和无人机。近年来,低成本固态LiDAR的出现推动了更多基于LiDAR的应用发展。然而,LiDAR-based SLAM系统在缺乏足够几何特征的场景(如狭窄或空旷环境)中容易失败,尤其对于视野(FoV)有限的固态LiDAR。为了解决这一问题,研究者通过融合LiDAR与其他传感器(如相机和超宽带UWB)来提升系统的鲁棒性和精度。特别是LiDAR与视觉的融合(LiDAR-Visual fusion)在机器人社区中成为研究热点。

分析:

- 应用背景:引言明确了LiDAR在机器人领域的关键作用,尤其强调了低成本固态LiDAR的出现降低了技术门槛,推动了更广泛的应用。

- 问题聚焦:指出了LiDAR-based SLAM的局限性,即在几何特征不足的场景中性能下降,尤其是固态LiDAR因FoV受限更容易受到影响。

- 解决方案趋势:提出多传感器融合(特别是LiDAR、视觉和IMU的融合)是解决该问题的有效途径,为后续研究动机奠定了基础。

研究问题与目标

引言明确了本文的研究目标:基于LiDAR、惯性和视觉测量的紧耦合融合,实现实时同时定位、三维建图和地图渲染。目标是构建一个能够在复杂环境中实时生成密集、精确、RGB彩色点云地图的系统。

分析:

- 问题聚焦:传统SLAM系统在纹理缺失或几何特征不足的环境中表现不佳,且实时生成带RGB颜色的密集点云地图具有挑战性。

- 研究意义:提出实时定位、建图和彩色渲染的综合解决方案,填补了现有SLAM系统在纹理渲染和实时性方面的不足。

主要贡献

引言列出了本文的四个主要贡献:

- 提出R3LIVE系统 :

- 包含LiDAR-惯性里程计(LIO)用于几何结构重建,视觉-惯性里程计(VIO)用于纹理渲染。

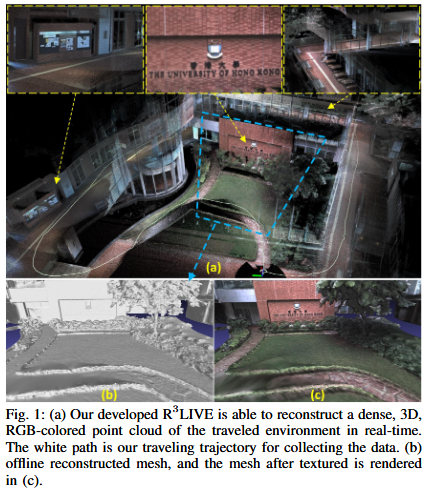

- 系统能够实时生成密集、精确、RGB彩色的三维点云地图(见图1(a))。

- 新型VIO系统 :

- 基于RGB彩色点云地图,通过最小化观测地图点RGB颜色与其在当前图像中的测量颜色之间的光度误差来估计状态。

- 不依赖显著视觉特征,省去特征检测和提取的处理时间,增强了在纹理缺失环境中的鲁棒性。

- 实现完整系统R3LIVE :

- 集成了上述方法,实时构建低漂移的密集RGB彩色点云地图。

- 在室内外多种环境中验证,1.5公里行程后平移漂移仅0.16米,旋转漂移仅3.9度。

- 开源系统与工具 :

- 在Github上开源R3LIVE系统。

- 提供离线工具,用于从彩色点云重建和纹理化网格(见图1(b)和(c))。

- 公开软件工具和设备机械设计,方便社区应用。

分析:

- 技术创新:R3LIVE通过紧耦合融合和新型VIO设计,突破了传统SLAM在纹理缺失环境中的局限性,实现了实时彩色点云建图。

- 性能验证:低漂移性能(0.16米平移误差和3.9度旋转误差)显示了系统的高精度和鲁棒性。

- 开源贡献:开源系统和工具降低了研究门槛,促进了学术界和工业界的进一步开发和应用。

创新点与技术亮点

- 紧耦合融合:R3LIVE继承了R2LIVE的紧耦合框架,通过联合优化LiDAR、IMU和视觉数据,提升了定位和建图精度。

- 光度误差最小化:新型VIO通过光度误差取代传统特征匹配,避免了特征检测的计算开销,特别适合纹理缺失环境。

- 实时RGB点云建图:结合LIO和VIO,R3LIVE不仅重建几何结构,还实现纹理渲染,生成视觉效果丰富的彩色点云。

- 鲁棒性与适应性:系统在室内外复杂场景(如剧烈运动、狭窄环境)中表现优异,验证了其广泛适用性。

- 开源生态:提供完整系统和离线工具,促进了SLAM技术的社区化和产业化。

Related Works

引言回顾了LiDAR、视觉和IMU融合的SLAM系统的发展,分为松耦合(loosely-coupled)和紧耦合(tightly-coupled)两大类:

松耦合方法

- V-LOAM:Zhang和Singh提出了一种早期LiDAR-惯性-视觉融合系统,使用松耦合的视觉-惯性里程计(VIO)作为运动模型,为LiDAR建图子系统提供初始位姿。

- DV-LOAM:Wang等人提出了一种直接视觉-LiDAR融合框架,先通过两阶段直接视觉里程计提供粗略状态估计,再通过LiDAR建图模块优化位姿,最后利用闭环检测纠正累积漂移。这些方法中,LiDAR测量与视觉或惯性测量未进行联合优化。

紧耦合方法

- LIC-Fusion:Zuo等人提出了一种紧耦合框架,在多状态约束卡尔曼滤波(MSCKF)框架内联合优化IMU、稀疏视觉特征和LiDAR特征,支持在线空间和时间校准。

- LIC-Fusion 2.0:进一步提出了一种基于滑动窗口的平面特征跟踪算法,优化多帧LiDAR扫描的位姿轨迹。

- LVI-SAM:Shan等人基于因子图构建了一个紧耦合的LiDAR-视觉-惯性融合框架,支持LiDAR-惯性和视觉-惯性子系统在某一传感器失效时独立运行,或在特征充足时联合优化。

- R2LIVE:作者之前的作品,通过紧耦合融合LiDAR、惯性和视觉数据,提取LiDAR和稀疏视觉特征,使用误差状态迭代卡尔曼滤波最小化特征重投影误差,以实现实时性能,同时通过滑动窗口优化提高视觉建图精度。R2LIVE在复杂场景(如剧烈运动、传感器失效、狭窄隧道)中表现出色。

分析:

- 松耦合 vs 紧耦合:松耦合方法将不同传感器的处理模块相对独立,计算复杂度较低,但精度和鲁棒性受限;紧耦合方法通过联合优化多传感器数据,显著提升了性能,尤其在复杂场景中。

- 现有工作的进步:从早期松耦合的V-LOAM到紧耦合的LIC-Fusion和R2LIVE,研究逐步解决了传感器融合的精度、实时性和鲁棒性问题。

- R2LIVE的地位:作为作者前期工作,R2LIVE在紧耦合融合和实时性能上取得了突破,为本文提出的R3LIVE奠定了技术基础。

Method

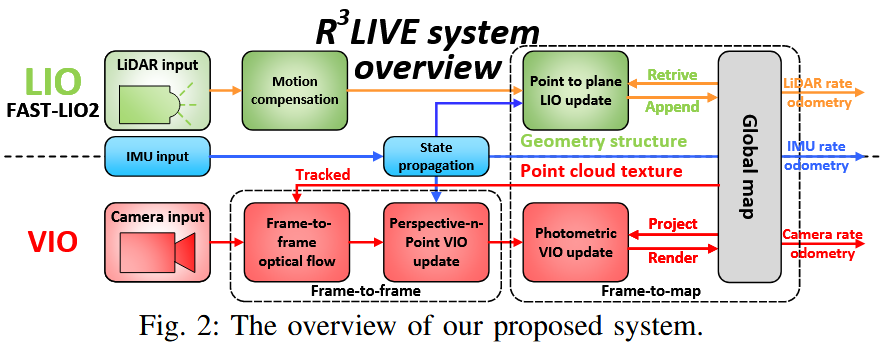

系统分为两个主要子系统:LIO(LiDAR-Inertial Odometry,上半部分)和VIO(Visual-Inertial Odometry,下半部分)。这两个子系统通过紧耦合方式协作,实现实时定位、几何建图和纹理渲染。

关键内容描述

- LIO子系统:负责构建全局地图的几何结构。具体而言,它注册输入的LiDAR扫描数据,通过最小化点到平面的残差(point-to-plane residuals)来估计系统的状态。这是一种典型的LiDAR-惯性融合里程计,用于处理LiDAR点云的配准和位姿估计,确保地图的几何精度。

- VIO子系统:负责地图的纹理构建。它使用输入图像渲染每个点的RGB颜色,通过最小化帧间PnP重投影误差(frame-to-frame PnP reprojection error)和帧到地图的光度误差(frame-to-map photometric error)来更新系统状态。这部分强调了视觉信息的融入,用于增强地图的视觉真实感。

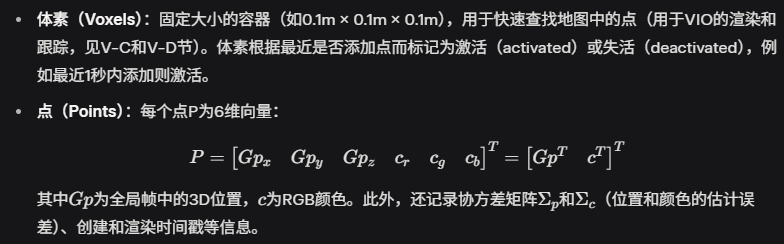

Maps representation

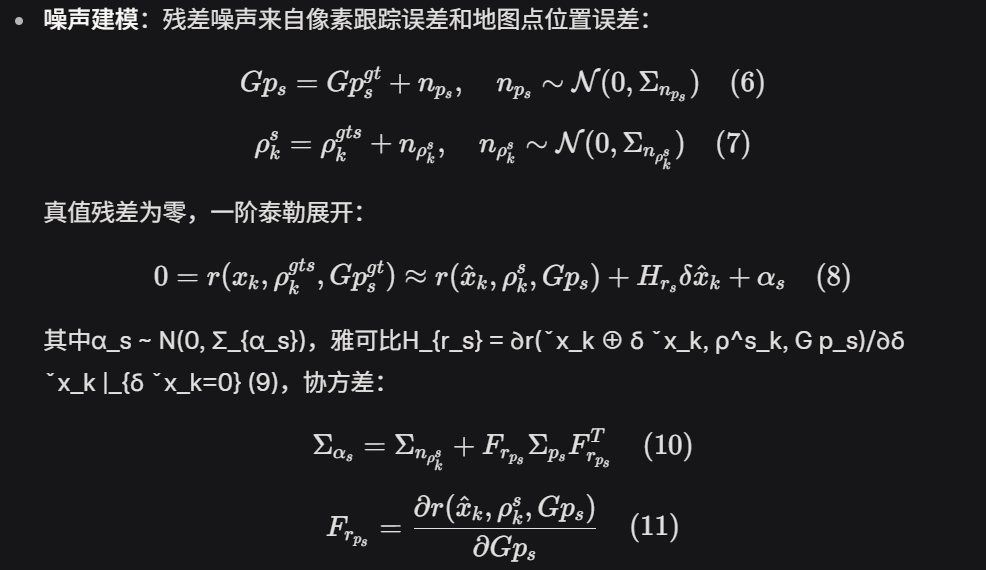

IV. LIDAR-INERTIAL ODOMETRY SUBSYSTEM

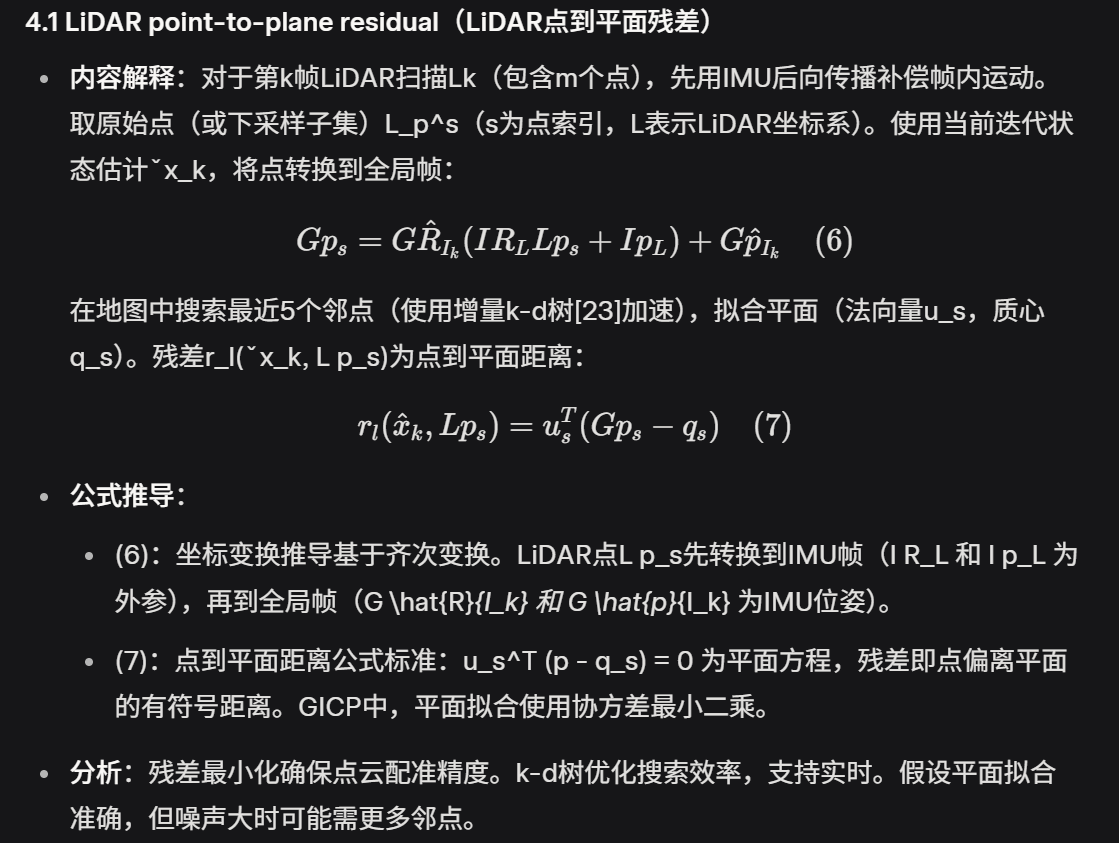

R3LIVE:Fastlio2 + ESIKF求 点到平面的距离。

R3LIVE++:

这一节介绍了R3LIVE系统的LIO子系统,该子系统负责通过注册新LiDAR扫描到全局地图来重建环境的几何结构。采用广义迭代最近点(GICP)方法[46],通过迭代最小化扫描点到地图对应平面距离来估计LiDAR位姿及其他系统状态,然后将新点添加到地图中。LIO聚焦于几何精度,提供VIO的位姿初值。

关键内容解释

- 子系统功能:LIO处理LiDAR扫描,补偿帧内运动[22],使用GICP迭代估计位姿。估计状态用于添加新点到地图,确保地图的几何一致性。

- 创新点:与传统ICP不同,GICP使用点到平面残差,提升鲁棒性。结合IMU后向传播补偿运动畸变。

V. VISUAL-INERTIAL ODOMETRY SUBSYSTEM

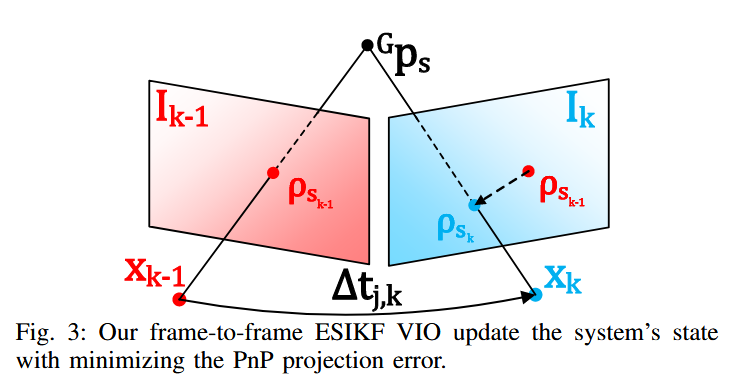

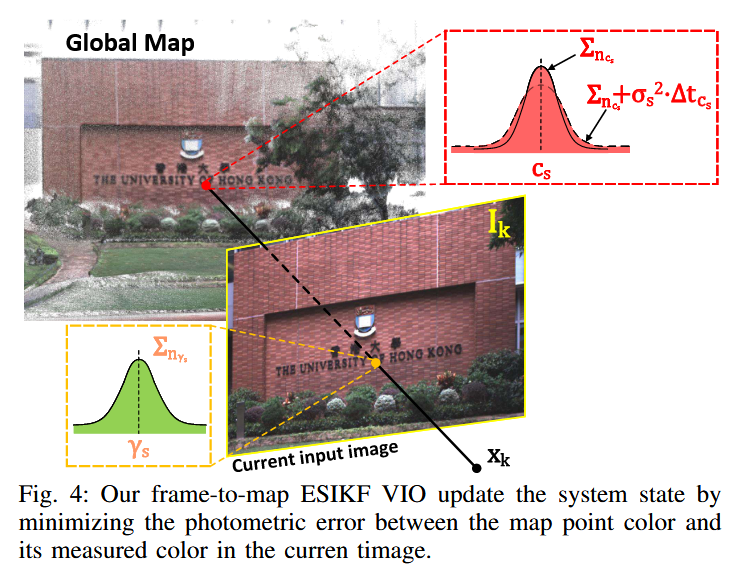

这一节介绍了R3LIVE系统的VIO子系统,该子系统负责渲染全局地图的纹理,同时通过最小化光度误差(photometric error)来估计系统状态。VIO将全局地图中的稀疏跟踪点(tracked points)投影到当前图像上,在误差状态迭代卡尔曼滤波(ESIKF)框架内迭代估计状态。跟踪点采用稀疏设计以提高效率,通常需要构建图像金字塔(pyramid),但金字塔对平移或旋转不不变,需要额外估计。本文创新地使用单个地图点的颜色计算光度误差,该颜色在VIO中同时渲染,是地图点的固有属性,对相机平移和旋转不变。为确保鲁棒性和快速收敛,设计了两步管道(见图2):首先通过帧到帧光流跟踪地图点,并最小化PnP投影误差优化状态(V-A节);然后通过最小化跟踪点的帧到地图光度误差进一步精炼状态估计。

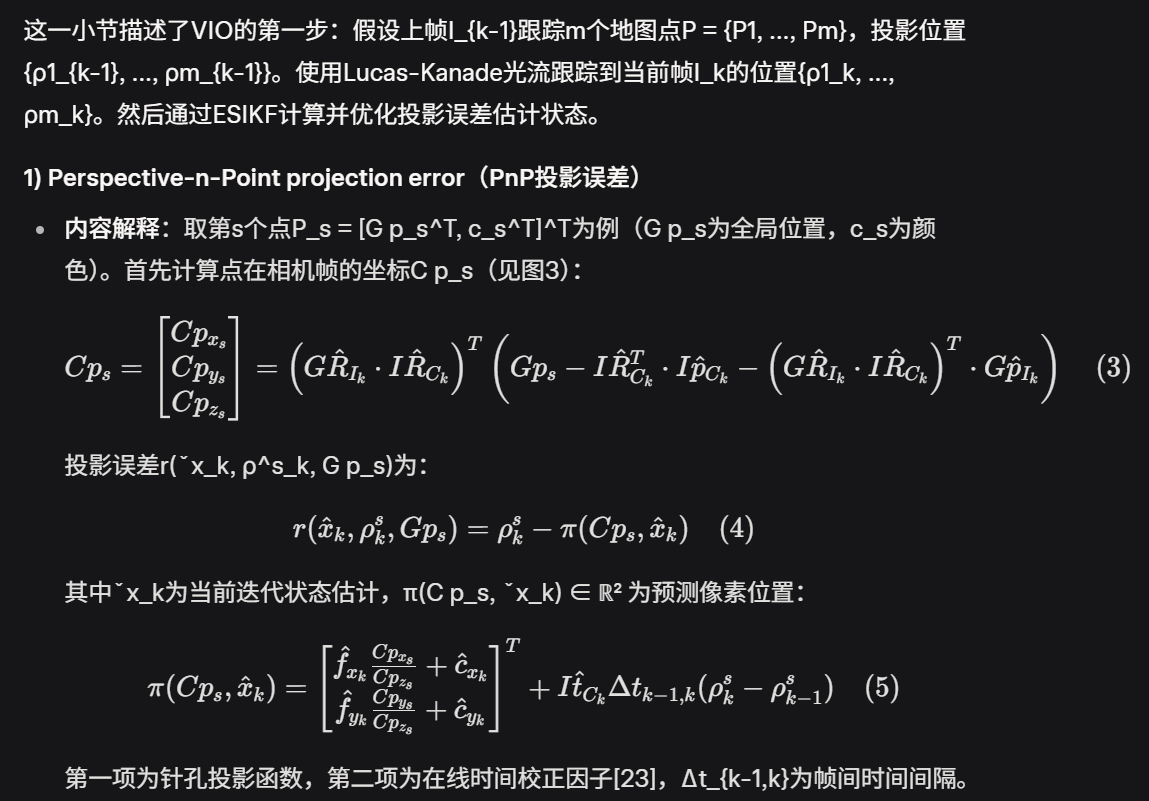

A. Frame-to-frame Visual-Inertial odometry

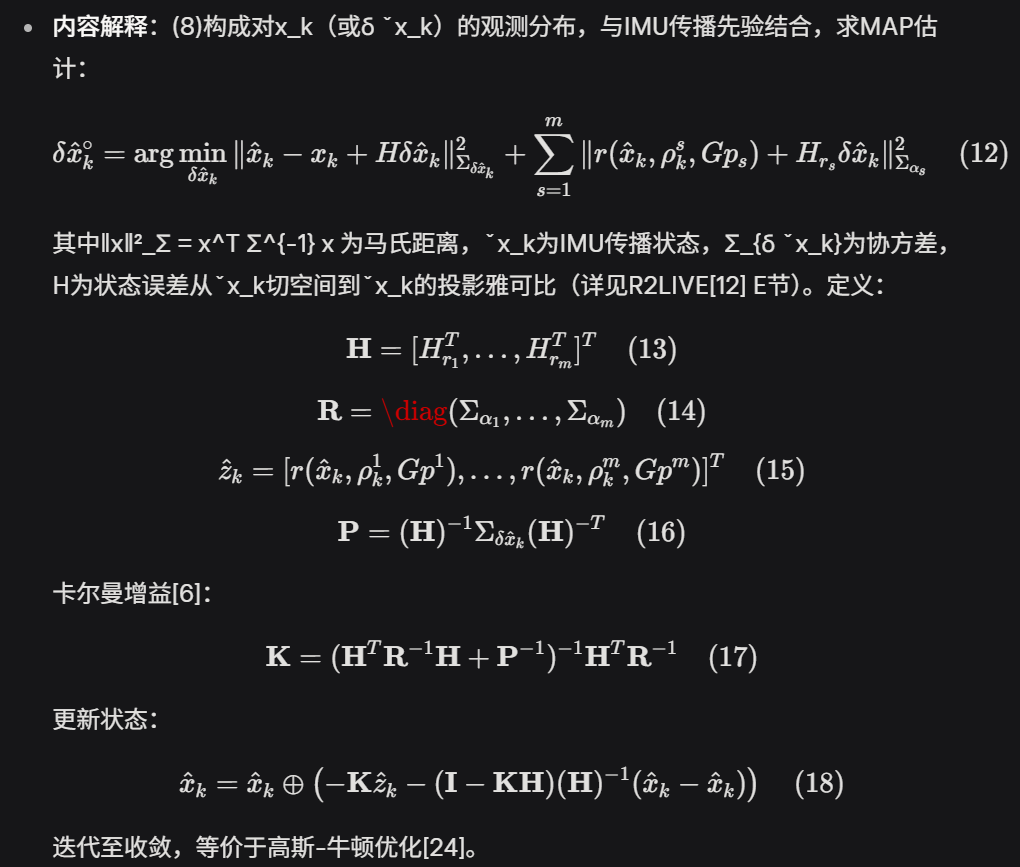

2) Frame-to-frame VIO ESIKF update(帧到帧VIO ESIKF更新)

B. Frame-to-map Visual-Inertial odometry

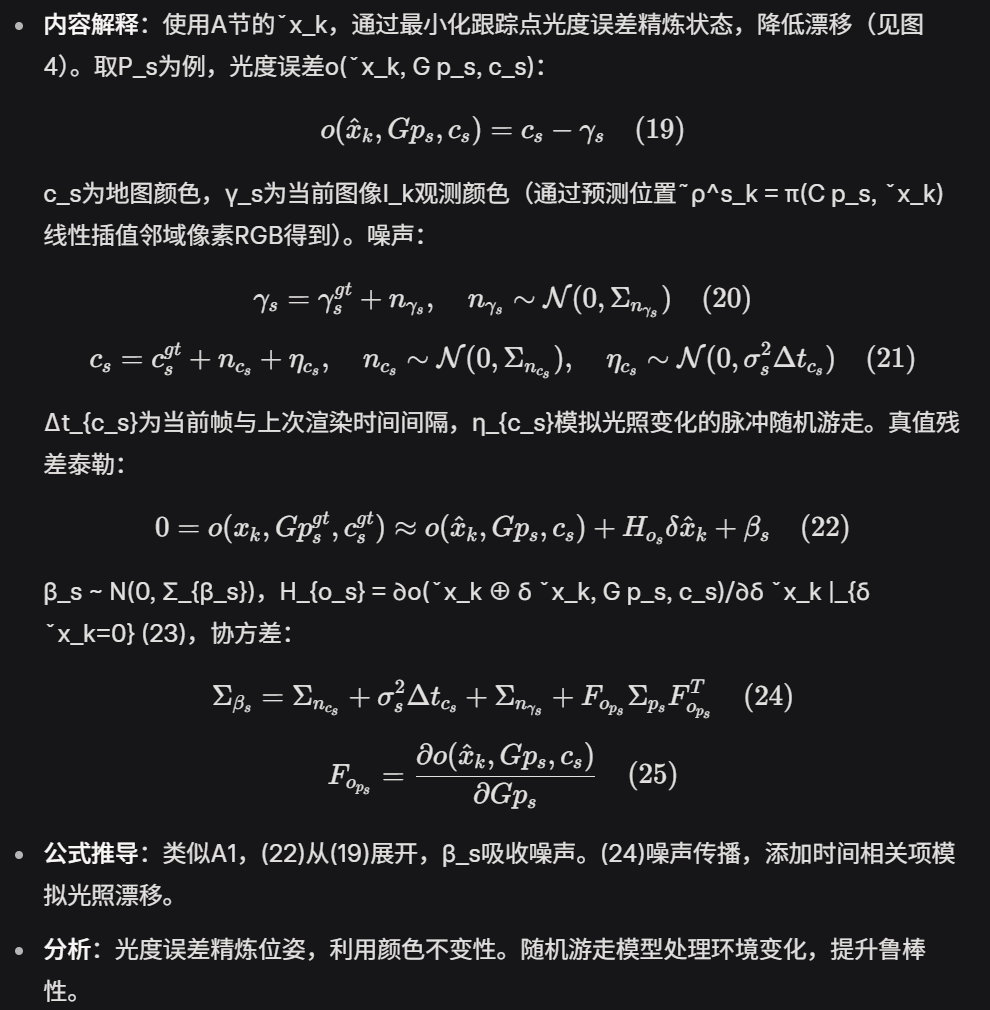

1) Frame-to-map photometric update(帧到地图光度更新)

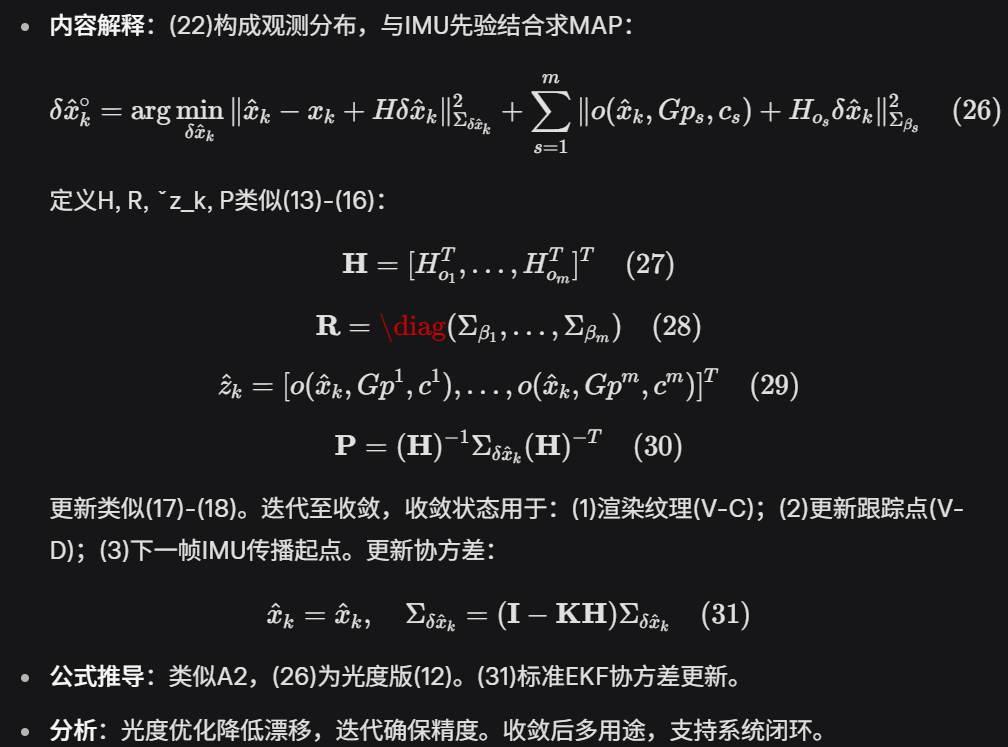

2) Frame-to-map VIO ESIKF update(帧到地图VIO ESIKF更新)

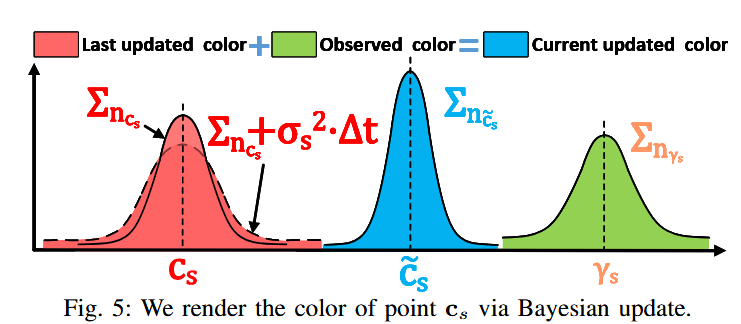

C. Render the texture of global map(渲染全局地图纹理)

D. Update of the tracking points of VIO subsystem

- 内容解释:移除P中投影(4)或光度(19)误差大、或不在I_k FoV的点。将ζ中点投影到I_k,若邻域(e.g., 50像素半径)无跟踪点,添加到P。

- 分析:保持稀疏、均匀分布,确保下一帧覆盖。移除异常点提升鲁棒性。

实验

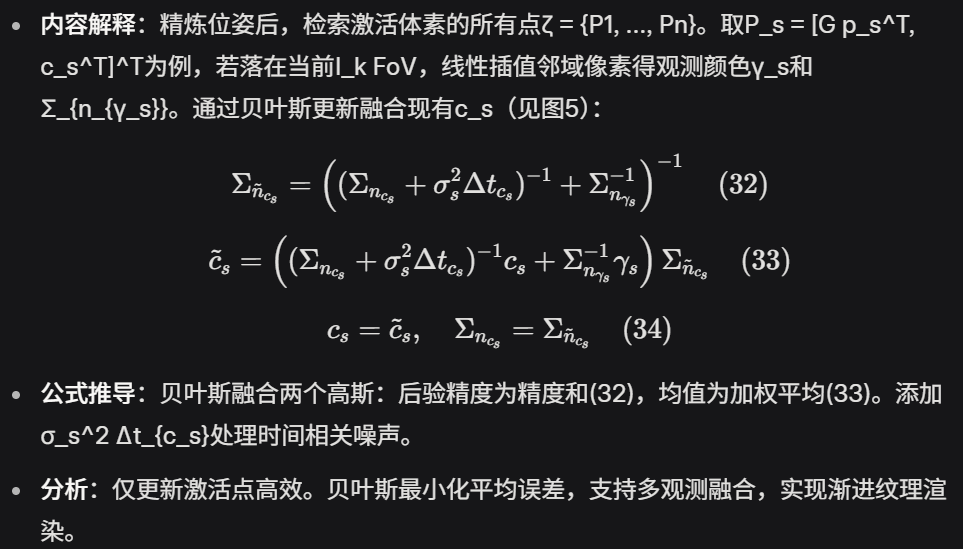

硬件平台

手持设备如图6(a)所示,包括电源单元、DJI Manifold-2C计算平台(Intel i7-8550U CPU + 8GB RAM)、FLIR Blackfly BFS-U3-13Y3C全局快门相机(FoV 82.9° × 66.5°)和Livox Avia LiDAR(FoV 70.4° × 77.2°)。计算平台支持实时处理。

数据集

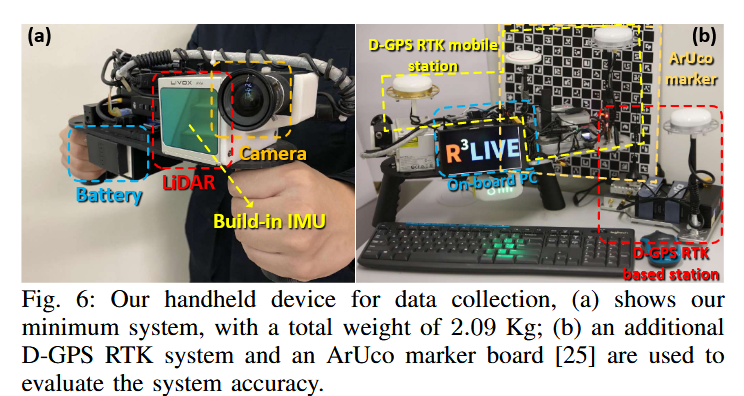

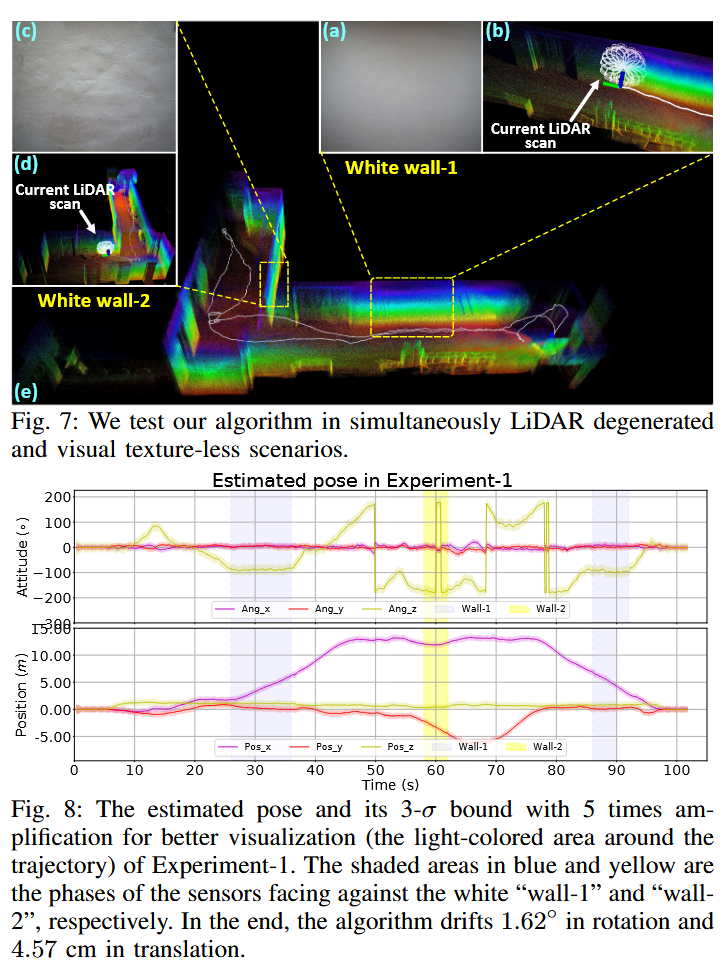

最挑战SLAM场景------狭窄"T"形通道,传感器偶尔面对单平面墙壁(图7)。墙壁提供单一平面约束,导致LiDAR退化;白色墙壁纹理极少(图7(a)和(c)),仅靠光照变化,挑战视觉SLAM。LiDAR退化和视觉无纹理环境的鲁棒性评估)

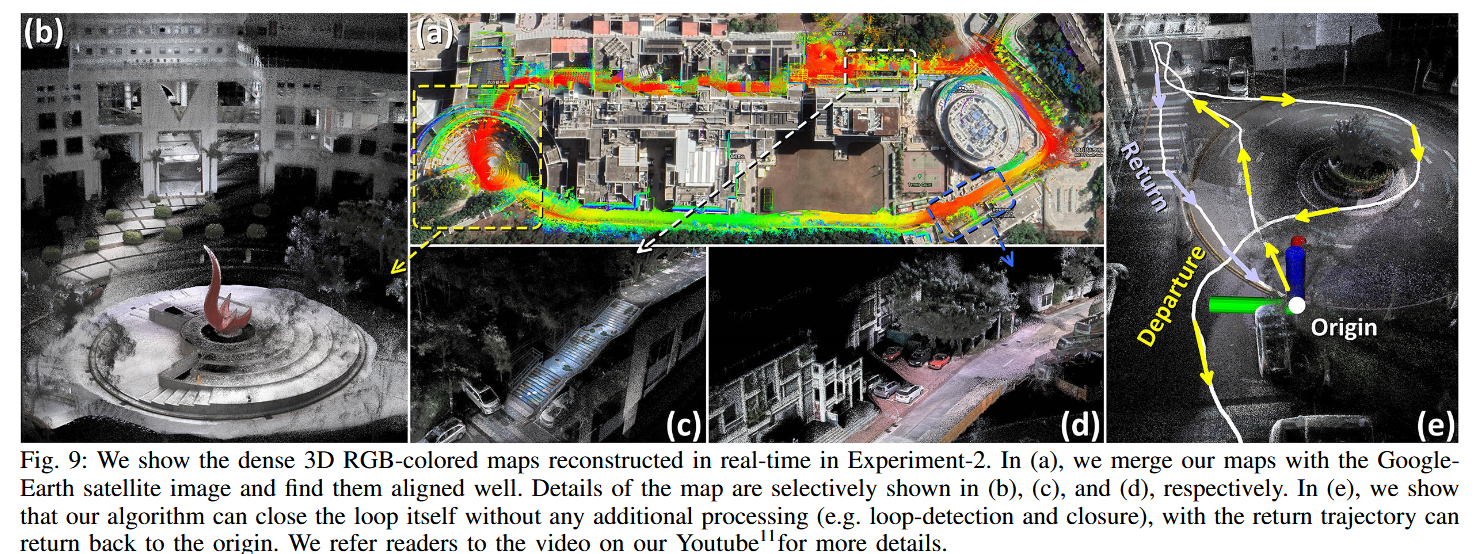

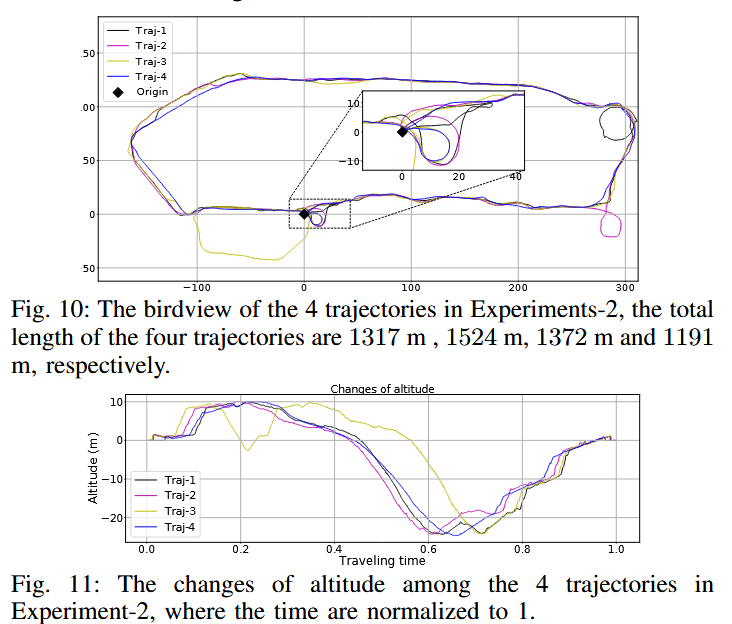

香港科技大学(HKUST)校园,四条不同轨迹(Traj 1-4),总长1317m、1524m、1372m、1191m。鸟瞰图(X-Y投影)见图10,海拔变化见图11。复杂环境包括室内外过渡、行人/车辆干扰。大规模室内外城市环境高精度建图)

Benchmark

Experiment-1: Robustness evaluation in simultaneously LiDAR degenerated and visual texture-less environments

Experiment-2: High precision mapping large-scale indoor & outdoor urban environment

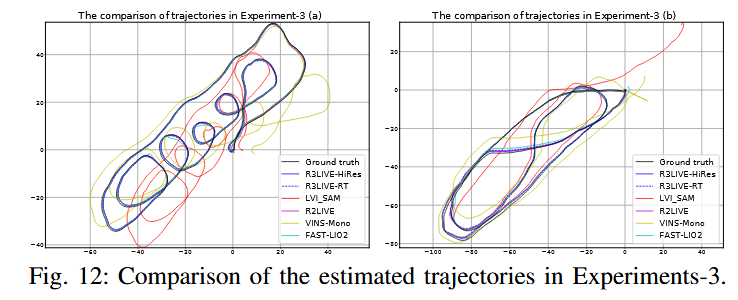

Experiment-3: Quantitative evaluation of precision using D-GPS RTK

- 在桌面PC(Intel i7-9700K + 32GB RAM)和机载计算机(OB,i7-8550U + 8GB RAM)上评估所有实验平均时间(表IV)。VIO时间受图像分辨率和点云地图分辨率(Pt res)影响。

- 结果:详细统计未列,但强调实时(<33ms/帧),VIO为主要瓶颈,受分辨率影响。

初体验

TODO