目录

[1. 深度CNN的架构设计](#1. 深度CNN的架构设计)

[2. 网络深度化的优势分析](#2. 网络深度化的优势分析)

[1. VGG:深度堆叠](#1. VGG:深度堆叠)

[2. GoogLeNet:横向扩展](#2. GoogLeNet:横向扩展)

[3. ResNet(残差网络):跨越连接](#3. ResNet(残差网络):跨越连接)

[1. GPU](#1. GPU)

[2. 分布式学习](#2. 分布式学习)

[3. 运算精度](#3. 运算精度)

[1. 物体检测与图像分割](#1. 物体检测与图像分割)

[2. 多模态与图像描述](#2. 多模态与图像描述)

[3. 生成模型与强化学习](#3. 生成模型与强化学习)

[1. 风格迁移](#1. 风格迁移)

[2. 自动驾驶的环境感知](#2. 自动驾驶的环境感知)

[3. Deep Q-Network(强化学习)](#3. Deep Q-Network(强化学习))

一、深度网络的设计与实现

1. 深度CNN的架构设计

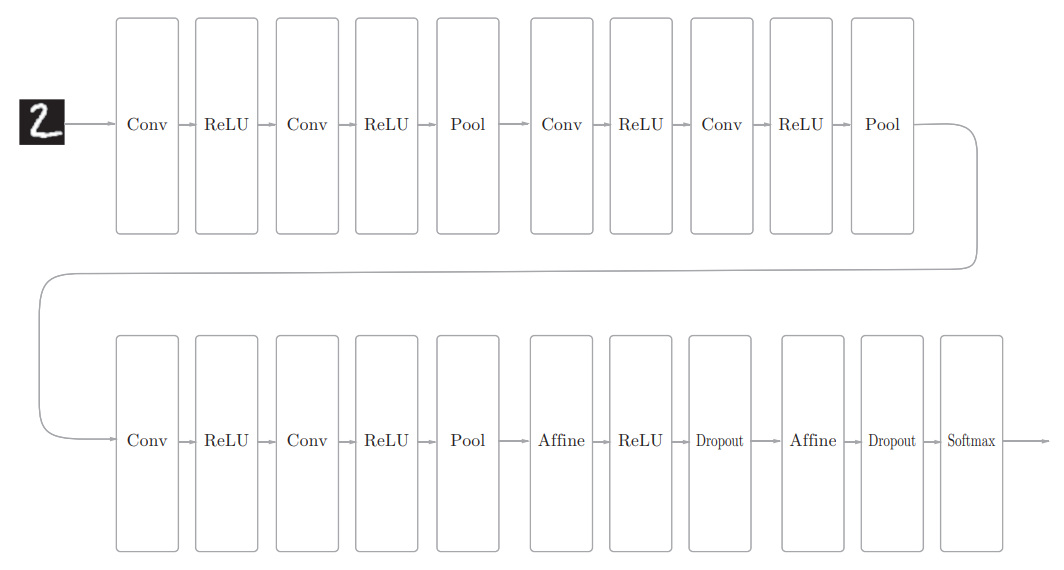

构建了一个比之前更深的CNN网络

网络结构:

核心技术特征:

-

使用3×3的小型滤波器构建所有卷积层

-

激活函数统一采用ReLU

-

全连接层后引入Dropout防止过拟合

-

使用Adam优化器进行参数更新

-

采用He初始值进行权重初始化

通道数增长模式:

16 → 16 → 32 → 32 → 64 → 64

随着网络深度增加,通道数逐步扩大,增强了网络的表达能力。

2. 网络深度化的优势分析

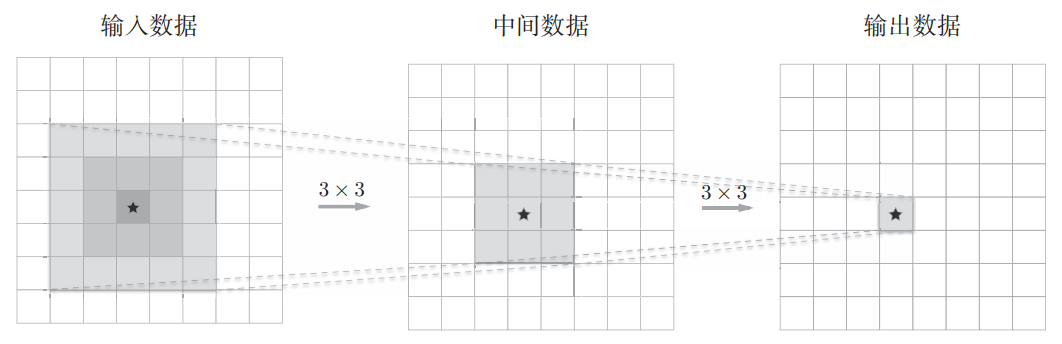

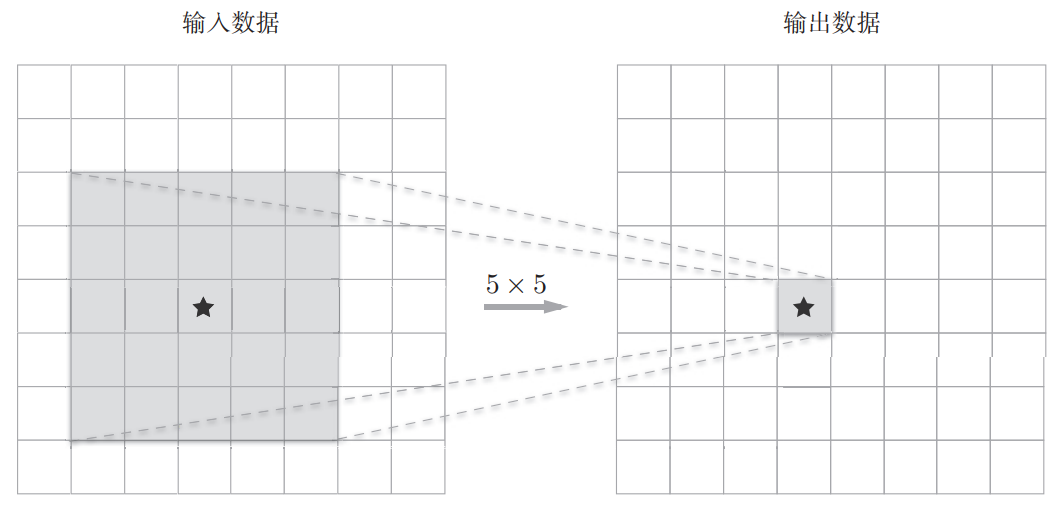

参数效率提升:

通过叠加多个3×3小型滤波器,可以替代单个5×5大型滤波器,显著减少参数数量:

-

2个3×3滤波器:2 × 3 × 3 = 18个参数

-

等效的5×5滤波器:5 × 5 = 25个参数

-

参数减少比例:28%

感受野(receptive field,给神经元施加变化的某个局部空间区域)扩展 :

叠加的3×3滤波器能够建立与大型滤波器相同的感受野,同时引入更多的非线性变换,增强模型表达能力。

分层特征学习 :

深度网络能够将复杂问题分解为层次化的简单子问题:

-

底层学习边缘、角点等基础特征

-

中层组合基础特征形成纹理、形状

-

高层整合为物体部件和完整对象

二、经典深度网络架构演进

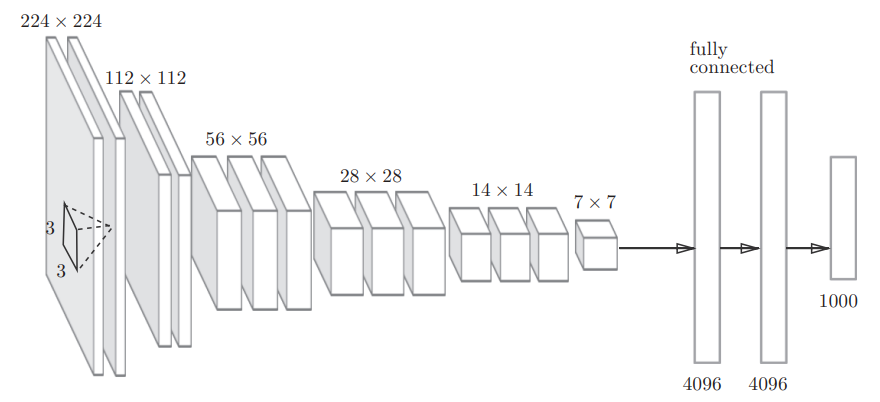

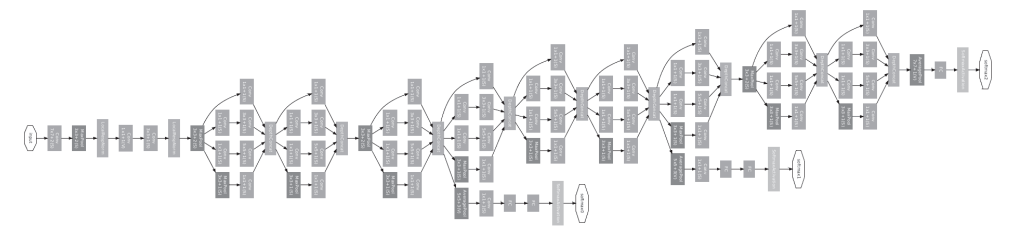

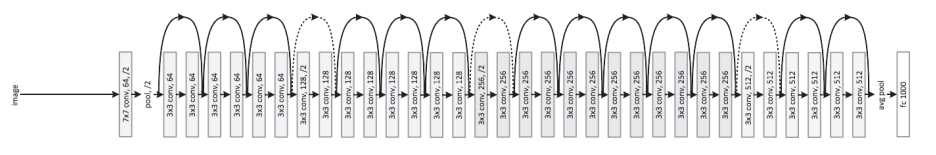

1. VGG:深度堆叠

架构特点:

-

16-19个有权重层

-

连续使用3×3卷积层

-

简单的重复堆叠模式, 形成VGG块

设计哲学 :

通过深度堆叠小型滤波器,在保持感受野的同时减少参数数量,证明了网络深度对性能的关键影响。

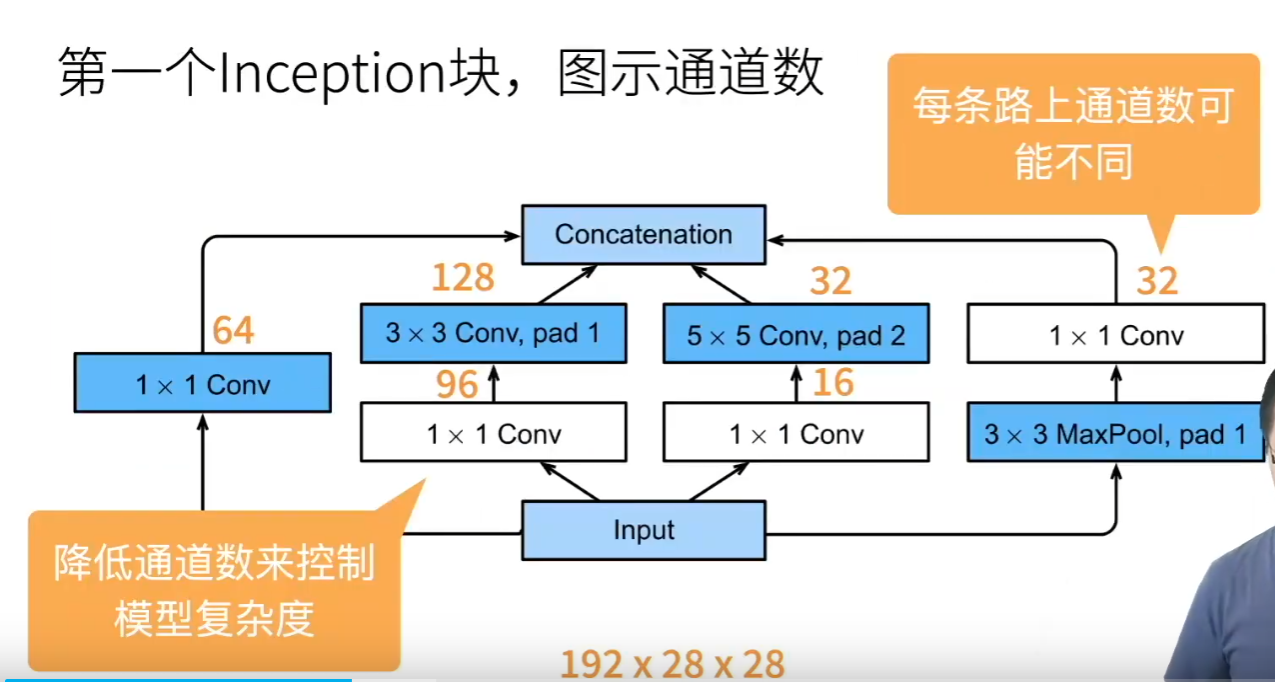

2. GoogLeNet:横向扩展

Inception结构 :

在同一层级使用多种尺寸的滤波器(1×1, 3×3, 5×5),并行处理并融合结果,增加通道数。

技术优势:

-

多尺度特征提取

-

1×1卷积降低通道数 减少计算量 (白色快)

-

横向深度增加网络容量

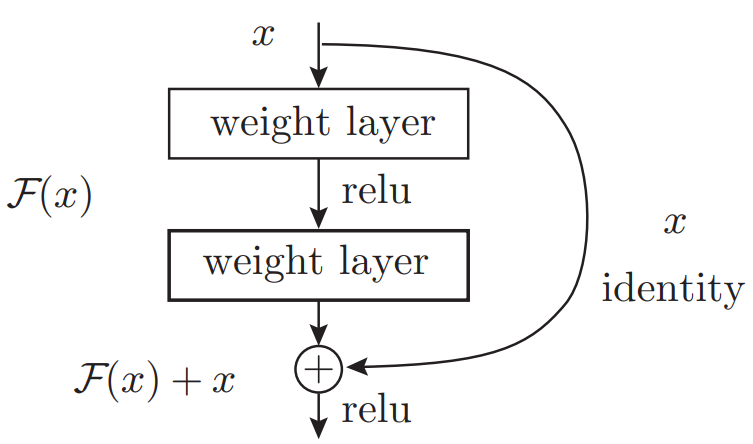

3. ResNet(残差网络):跨越连接

残差学习 :

引入快捷连接(skip connection),学习残差映射F(x) = F(x) + x,而非直接学习F(x)。

核心创新:

解决的关键问题:

-

缓解梯度消失问题

-

支持极深网络训练(150+层)

-

ILSVRC 2015冠军,错误率3.5%

三、深度学习的高速化技术

1. GPU

性能对比:

-

CPU训练AlexNet:40+天

-

GPU训练AlexNet:6天

-

使用cuDNN优化:进一步加速

技术基础:

-

CUDA并行计算架构

-

矩阵运算的硬件优化

-

im2col方法与GPU的天然契合

2. 分布式学习

多GPU训练:

-

线性加速效果

-

数据并行化处理

-

模型参数同步更新

大规模分布式 :

100个GPU可实现56倍加速,将7天的训练缩短至3小时。

3. 运算精度

精度与效率的平衡:

-

32位单精度浮点数:标准选择

-

16位半精度浮点数:2倍加速,精度基本无损

-

1位二值化网络:极致压缩,嵌入式应用

四、深度学习的多样化应用

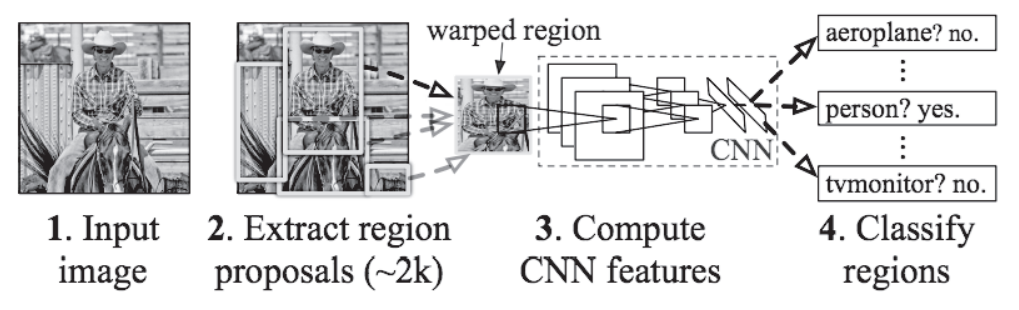

1. 物体检测与图像分割

R-CNN系列:

-

候选区域提取 + CNN分类

-

Fast R-CNN:效率优化

-

Faster R-CNN:端到端训练

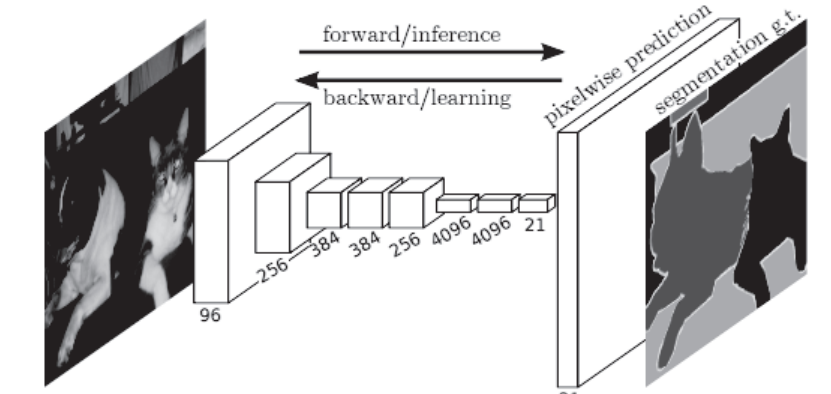

全卷积网络(FCN):

-

全连接1×1卷积层

-

像素级语义分割

-

一次前向处理完成全图分割

-

最终通过逆卷积扩大到原图大小

2. 多模态与图像描述

NIC模型(CNN+RNN):

-

CNN提取视觉特征

-

RNN生成自然语言描述

-

视觉与语言的跨模态理解

技术意义 :

实现了从像素到语义的跨越,展示了深度学习在复杂认知任务上的潜力。

3. 生成模型与强化学习

生成对抗网络(GAN):

-

Generator生成逼真图像

-

Discriminator鉴别真伪

-

对抗训练推动双方进步

五、深度学习的未来展望

1. 风格迁移

-

分离图像内容与风格表示

-

内容损失 + 风格损失联合优化

-

生成具有不同风格的图像

2. 自动驾驶的环境感知

SegNet等分割网络:

-

实时像素级环境理解

-

道路、车辆、行人精确识别

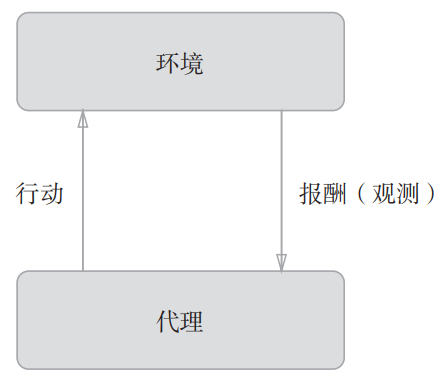

3. Deep Q-Network(强化学习)

从监督到无监督:

-

让AI通过试错自主学习,像人类学习骑自行车一样

-

通过奖励机制来学习最优行为策略

潜在价值 :

减少对标注数据的依赖,解锁更大规模数据的学习潜力。

总结

本文系统介绍了深度学习的网络设计、高速化技术及多样化应用。在网络设计方面,重点分析了VGG、GoogLeNet和ResNet等经典架构的特点与创新,包括深度堆叠、多尺度特征提取和残差连接等技术。在高速化方面,探讨了GPU优化、分布式训练和运算精度平衡等加速方法。应用领域涵盖物体检测、图像分割、多模态理解、生成模型等前沿方向,并展望了风格迁移、自动驾驶和强化学习等未来发展趋势。文章展现了深度学习通过架构创新和技术优化,在计算机视觉等领域的强大表现力和广阔应用前景。