xFormers版本与PyTorch、CUDA对应关系及正确安装方法详解

引言

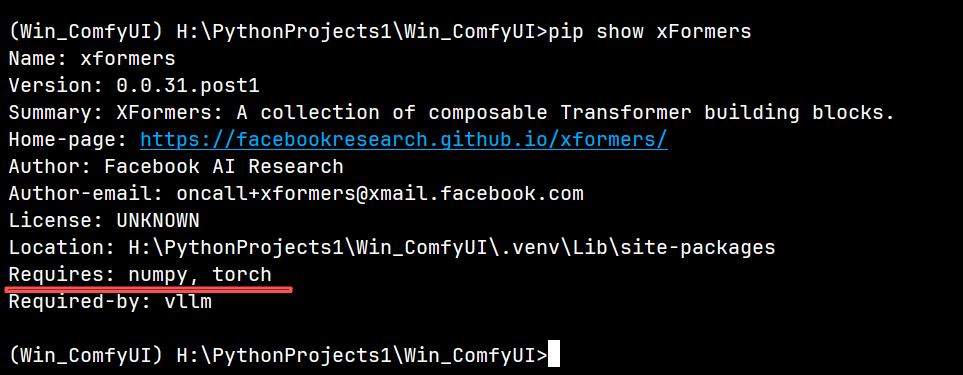

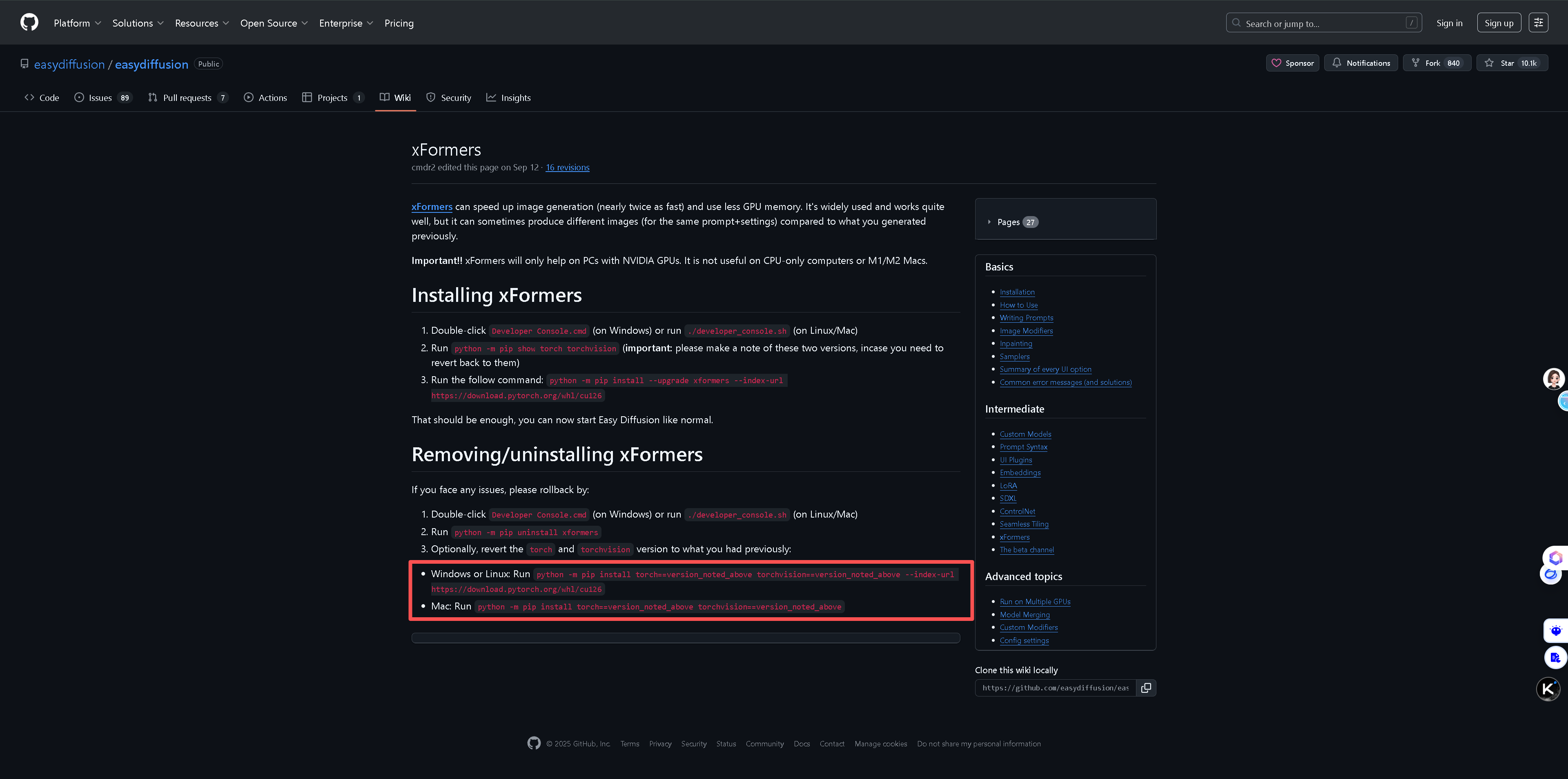

xFormers作为Meta开发的高效Transformer优化库,在AI艺术创作和深度学习领域得到了广泛应用。然而,由于其对PyTorch和CUDA版本的严格要求,很多用户在安装过程中遇到了问题,特别是在已经安装了PyTorch-CUDA版本的虚拟环境中,直接使用pip install xformers往往会导致PyTorch被重新安装,最终变成CPU-only版本。本文将详细分析xFormers与PyTorch、CUDA的版本对应关系,并总结正确的安装方法。

版本对应关系详解

官方版本要求

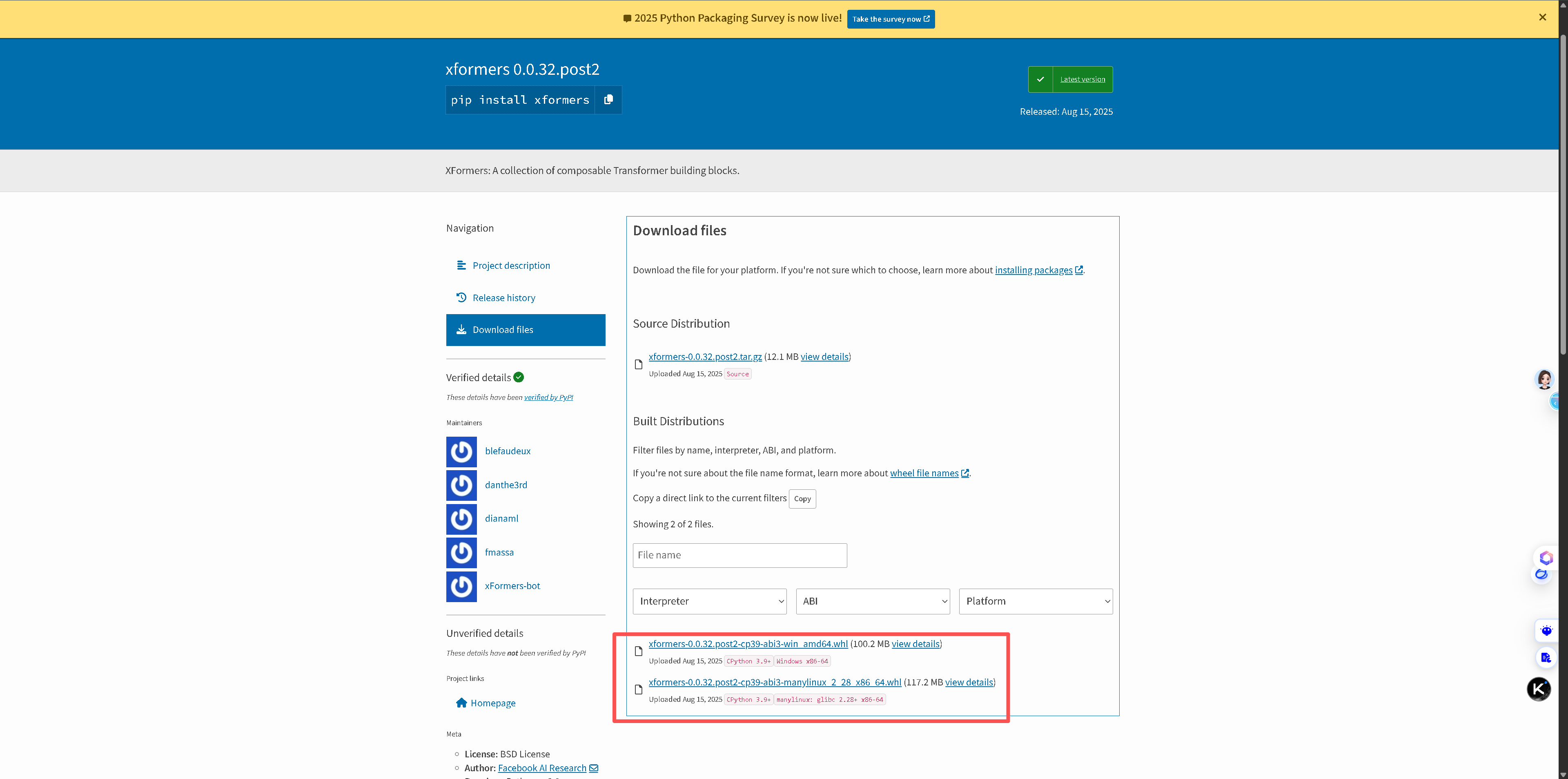

根据xFormers v0.0.32.post2官方文档,其最低要求为:

- PyTorch: 2.8.0+

- CUDA: 11.8+ 或 ROCm 6.4+ (实验性)

- Python: 3.8+

详细版本对应表(参考)

不同显卡和PyTorch版本需要匹配不同的xFormers版本:

| 显卡类型 | 推荐xFormers版本 | 兼容PyTorch版本 | CUDA版本要求 | 注意事项 |

|---|---|---|---|---|

| RTX 20系列 (6-8GB) | 0.0.21 | 2.0.1 | 11.7+ | 0.0.22+版本编译失败 |

| RTX 30系列 (8-12GB) | 0.0.22.post7 | 2.0.1/2.1.0 | 11.8+ | 0.0.23版本导致采样器卡顿 |

| RTX 40系列 (12-24GB) | 0.0.25 | 2.1.0 | 12.1+ | 旧版本不支持DLSS 3加速 |

| RTX 50系列 (Blackwell架构) | 0.0.30+ | 2.7.0+ | 12.8+ | 需要使用PyTorch夜间版本 |

| 笔记本RTX移动版 | 0.0.22.post7 | 2.0.1 | 11.8+ | 新版本导致散热功耗过高 |

| AMD显卡 (RX 6000/7000) | 0.0.23 | 2.1.0 | ROCm 5.6+ | 兼容性较差,需启用ROCm |

| Apple M1/M2 | 0.0.24 | 2.1.0 | Metal | 需编译安装,不支持稀疏注意力 |

CUDA版本与xFormers安装源对应(参考)

| CUDA版本 | 安装命令 | 支持平台 |

|---|---|---|

| 11.8 | pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu118 |

Linux only |

| 12.6 | pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu126 |

Linux & Windows |

| 12.8 | pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu128 |

Linux & Windows |

| 12.9 | pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu129 |

Linux & Windows |

| ROCm 6.4 | pip3 install -U xformers --index-url https://download.pytorch.org/whl/rocm6.4 |

Linux only (实验性) |

问题根源分析

为什么直接pip安装会导致问题?

当在已经安装了PyTorch-CUDA版本的虚拟环境中直接使用pip install xformers时,通常会出现以下问题:

- 依赖解析机制:pip的依赖解析器会检查xFormers的依赖要求,并尝试满足这些要求

- 版本不匹配:PyPI上的xFormers包可能与当前安装的PyTorch版本不兼容

- 自动升级/降级:为了满足依赖关系,pip会自动升级或降级PyTorch

- CUDA支持丢失:在升级/降级过程中,CUDA版本可能不匹配,导致最终安装的是CPU-only版本的PyTorch

【笔记】解决 "AssertionError: Torch not compiled with CUDA enabled" 错误

典型错误场景

bash

# 初始环境:PyTorch 2.7.1+cu126

(venv) user@machine:~$ python -c "import torch; print(torch.__version__); print(torch.cuda.is_available())"

2.7.1+cu126

True

# 直接安装xFormers

(venv) user@machine:~$ pip install xformers

# 安装后检查环境

(venv) user@machine:~$ python -c "import torch; print(torch.__version__); print(torch.cuda.is_available())"

2.8.0

False # CUDA支持丢失!正确安装方法

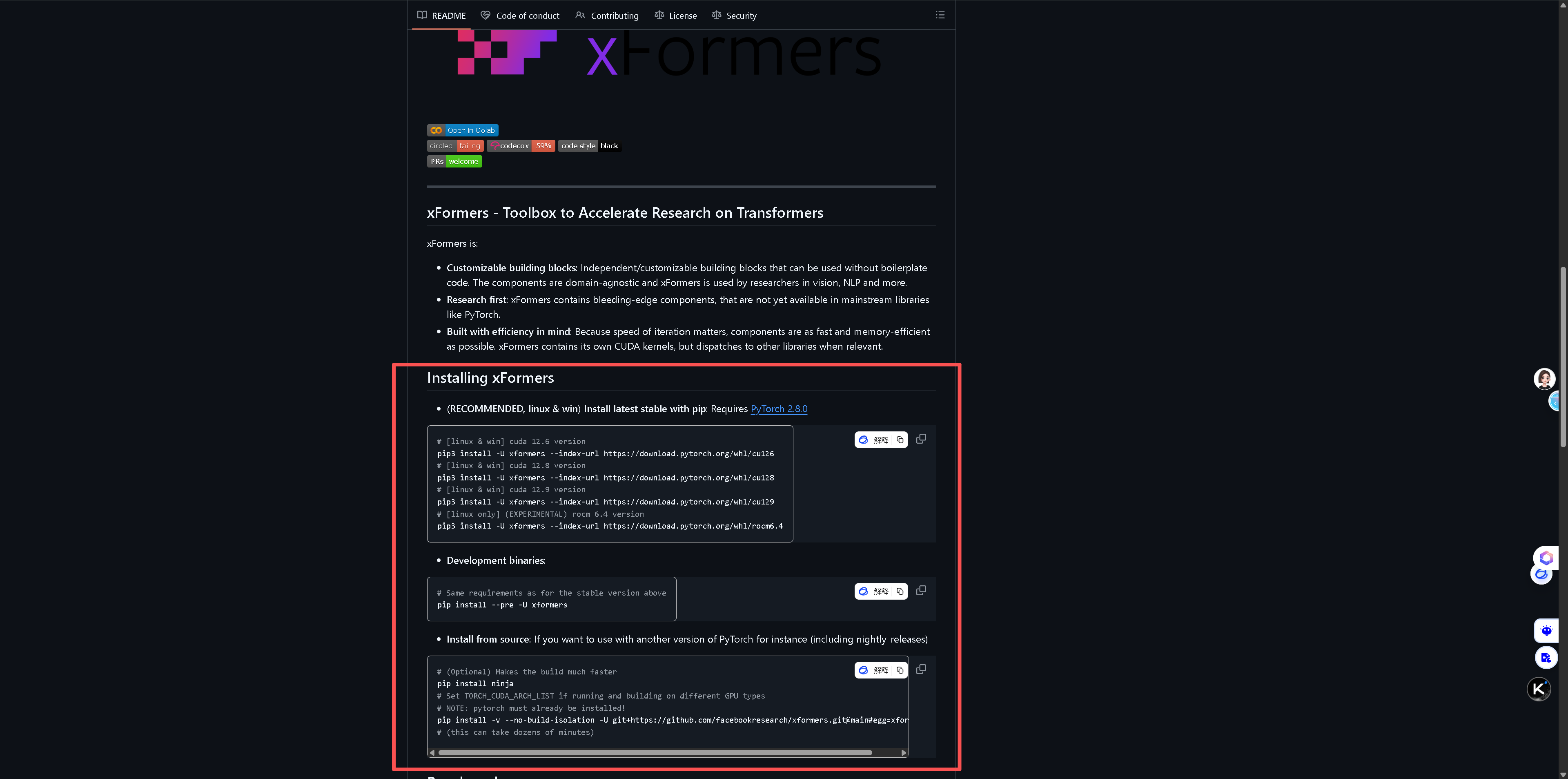

方法一:使用特定index-url安装(推荐)

这是最安全、最推荐的方法,可以确保安装与当前CUDA版本兼容的xFormers:

bash

# 1. 首先检查当前环境

python -c "import torch; print('PyTorch版本:', torch.__version__); print('CUDA版本:', torch.version.cuda); print('CUDA可用:', torch.cuda.is_available())"

# 2. 根据CUDA版本选择对应的安装命令

# CUDA 11.8

pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu118

# CUDA 12.6

pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu126

# CUDA 12.8

pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu128

# CUDA 12.9

pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu129方法二:从源码安装(适用于特殊版本需求)

如果需要使用特定版本的xFormers或与特定PyTorch版本兼容,可以从源码安装:

bash

# 1. 安装编译工具(可选但推荐)

pip install ninja

# 2. 从源码安装xFormers

# 注意:确保PyTorch已经安装并且版本兼容

pip install -v --no-build-isolation -U git+https://github.com/facebookresearch/xformers.git@main#egg=xformers

# 3. 对于特定GPU架构,可以设置TORCH_CUDA_ARCH_LIST

# 例如,针对RTX 3090和RTX 4090

TORCH_CUDA_ARCH_LIST="8.6;8.9" pip install -v --no-build-isolation -U git+https://github.com/facebookresearch/xformers.git@main#egg=xformers方法三:指定版本安装(适用于旧版PyTorch)

如果需要与旧版本的PyTorch兼容,可以指定xFormers版本:

bash

# 查看与当前PyTorch兼容的xFormers版本

pip install xformers== --dry-run

# 根据输出选择合适的版本安装

pip install xformers==0.0.22.post7 --index-url https://download.pytorch.org/whl/cu118安装验证与问题排查

验证安装是否成功

bash

# 1. 检查xFormers版本

python -c "import xformers; print('xFormers版本:', xformers.__version__)"

# 2. 详细检查xFormers配置

python -m xformers.info

# 3. 验证CUDA支持

python -c "import torch; import xformers; print('CUDA可用:', torch.cuda.is_available()); print('xFormers CUDA支持:', xformers._is_cuda_available())"

# 4. 运行简单的注意力测试

python -c "

import torch

import xformers

batch_size = 2

seq_len = 1024

dim = 512

# 创建随机张量

q = torch.randn(batch_size, seq_len, dim, device='cuda')

k = torch.randn(batch_size, seq_len, dim, device='cuda')

v = torch.randn(batch_size, seq_len, dim, device='cuda')

# 测试内存高效注意力

out = xformers.ops.memory_efficient_attention(q, k, v)

print('注意力测试成功,输出形状:', out.shape)

"常见问题及解决方案

问题1:CUDA版本不匹配

RuntimeError: xFormers requires CUDA 11.7 or higher解决方案:

bash

# 检查当前CUDA版本

nvcc --version

nvidia-smi

# 升级CUDA或降级xFormers版本问题2:PyTorch被意外升级/降级

bash

# 检查PyTorch版本变化

python -c "import torch; print(torch.__version__)"

# 如果CUDA支持丢失,重新安装PyTorch

pip uninstall torch torchvision torchaudio

pip install torch==2.7.1+cu126 torchvision==0.18.1+cu126 torchaudio==2.7.1 --index-url https://download.pytorch.org/whl/cu126

# 然后重新安装xFormers

pip install xformers --index-url https://download.pytorch.org/whl/cu126问题3:编译失败

nvcc fatal : Unknown option -extended-lambda解决方案:

bash

# 升级CUDA工具包至11.6+

# 或降低xFormers版本

pip install xformers==0.0.20问题4:RTX 50系列显卡支持

RTX 50系列采用Blackwell架构,可能会需要特殊处理:

bash

# 需要PyTorch 2.7.0+和CUDA 12.8

pip install torch==2.7.0+cu128 torchvision==0.18.0+cu128 torchaudio==2.7.0 --index-url https://download.pytorch.org/whl/cu128

# 安装对应的xFormers

pip install xformers --index-url https://download.pytorch.org/whl/cu128最佳实践建议

1. 环境备份

在安装任何新包之前,建议备份当前环境:

bash

# 导出当前环境

pip freeze > environment_backup_$(date +%Y%m%d_%H%M%S).txt

# 创建环境快照(conda环境)

conda env export > conda_environment_backup.yml2. 使用虚拟环境隔离

bash

# 创建专门的虚拟环境

python -m venv comfyui_env

source comfyui_env/bin/activate # Linux/Mac

comfyui_env\Scripts\activate # Windows

# 或使用conda

conda create -n comfyui_env python=3.10

conda activate comfyui_env3. 版本锁定策略

bash

# 创建requirements.txt文件,锁定版本

cat > requirements.txt << EOF

torch==2.7.1+cu126

torchvision==0.18.1+cu126

torchaudio==2.7.1

xformers==0.0.32.post2

EOF

# 使用requirements.txt安装

pip install -r requirements.txt --index-url https://download.pytorch.org/whl/cu1264. 自动化安装脚本

创建一个自动化安装脚本,确保环境一致性:

bash

#!/bin/bash

# install_comfyui_env.sh

# 检查CUDA版本

CUDA_VERSION=$(nvcc --version | grep -oP 'release \K[0-9]+\.[0-9]+')

echo "检测到CUDA版本: $CUDA_VERSION"

# 根据CUDA版本选择安装命令

case $CUDA_VERSION in

11.8)

INDEX_URL="https://download.pytorch.org/whl/cu118"

TORCH_VERSION="2.0.1+cu118"

XFORMERS_VERSION="0.0.22.post7"

;;

12.6)

INDEX_URL="https://download.pytorch.org/whl/cu126"

TORCH_VERSION="2.7.1+cu126"

XFORMERS_VERSION="0.0.32.post2"

;;

12.8)

INDEX_URL="https://download.pytorch.org/whl/cu128"

TORCH_VERSION="2.7.0+cu128"

XFORMERS_VERSION="0.0.30"

;;

*)

echo "不支持的CUDA版本: $CUDA_VERSION"

exit 1

;;

esac

# 安装PyTorch和xFormers

pip install torch==$TORCH_VERSION torchvision==0.18.1+cu126 torchaudio==2.7.1 --index-url $INDEX_URL

pip install xformers==$XFORMERS_VERSION --index-url $INDEX_URL

# 验证安装

python -c "

import torch

import xformers

print('PyTorch版本:', torch.__version__)

print('CUDA可用:', torch.cuda.is_available())

print('xFormers版本:', xformers.__version__)

"总结

xFormers的安装问题主要源于其对PyTorch和CUDA版本的严格要求。通过本文介绍的方法,您可以:

- 了解版本对应关系:根据显卡型号和PyTorch版本选择合适的xFormers版本

- 采用正确的安装方法:使用特定的index-url来避免PyTorch被重新安装

- 验证安装结果:通过多种方式验证安装是否成功

- 解决常见问题:掌握常见安装问题的排查和解决方法

正确安装xFormers对于充分利用GPU性能、加速模型训练和推理至关重要。希望本文能帮助您顺利安装和使用xFormers,避免常见的版本兼容性问题。