摘要

深度多视图聚类旨在充分利用来自多个视图的丰富信息,以提升聚类性能。然而,现有的大多数聚类方法往往未能充分挖掘多视图数据中的结构信息,也缺乏对多视图数据分布特性的深入建模,从而在一定程度上限制了聚类效果。

为克服上述不足,本文提出了一种结构引导的深度多视图聚类模型 。具体而言,设计了一种基于邻域关系的正样本选择策略,并配套构建相应的损失函数。该策略通过构建多视图最近邻图,对正样本对进行动态重定义,从而有效挖掘多视图数据内部的局部结构信息,并提升正样本选择的可靠性。

此外,本文引入高斯分布模型 以刻画潜在的结构信息,并通过设计损失函数来减少不同视图嵌入表示之间的差异。这两种策略从多视图结构信息 和数据分布特性两个不同角度对多视图数据进行建模,有效增强了视图间表示的一致性,并提升了簇内的紧致性。

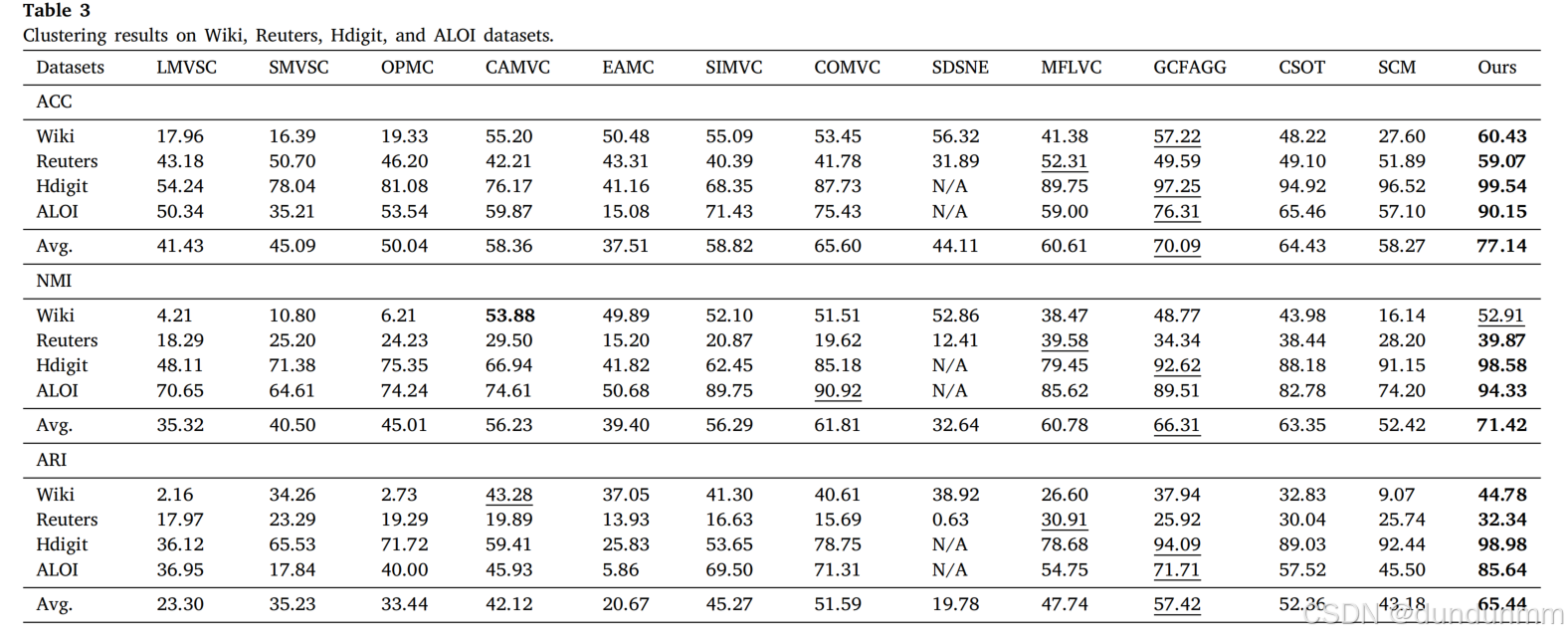

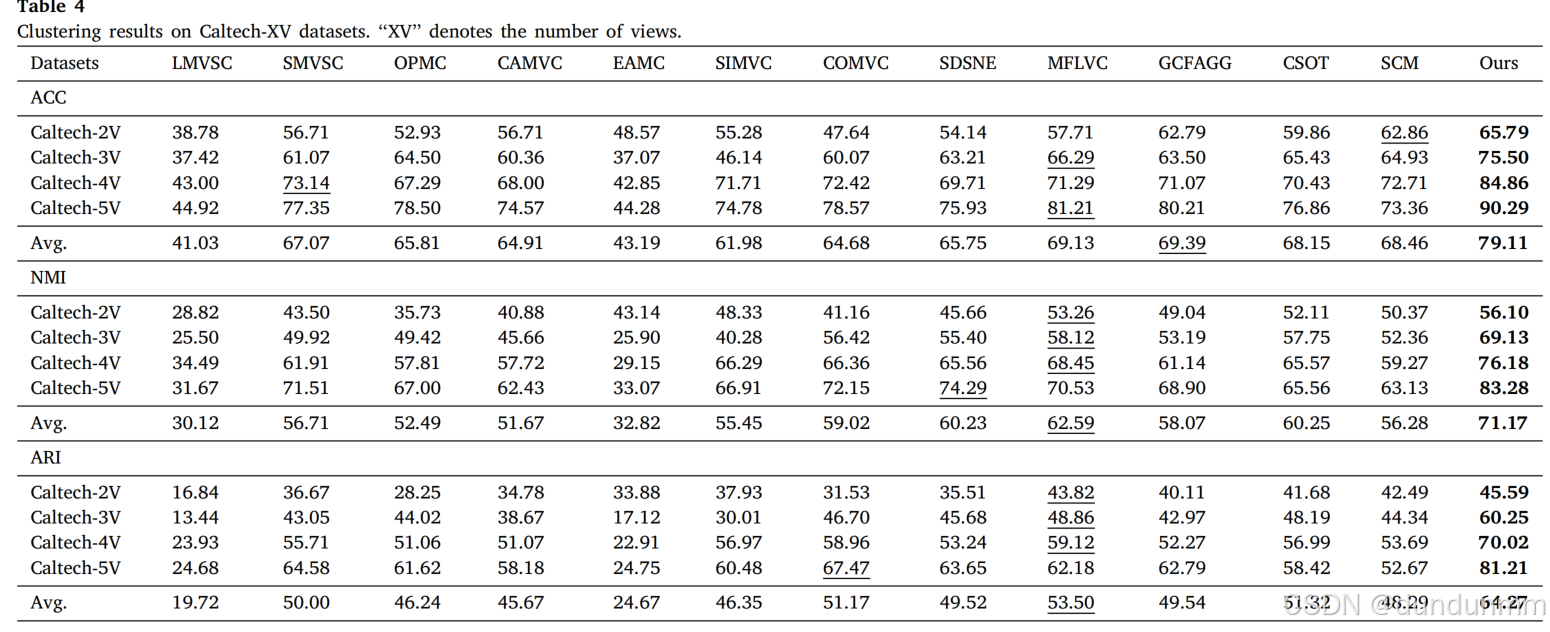

大量实验结果表明,所提出的方法在多个基准数据集上均显著优于现有的先进多视图聚类方法,验证了其在聚类性能方面的有效性与优越性。

引言

聚类是机器学习中无监督学习的重要研究内容,其目标是在无需标签信息的情况下,将内在相关的样本划分为若干簇。聚类技术在多个领域展现出广泛的应用潜力,包括图像分割 [1,2]、跨模态哈希 [3,4] 以及数据挖掘 [5--7] 等。随着数据来源的日益丰富与多样化,从多个角度对数据进行描述的形式逐渐普遍,这类数据通常被称为多视图数据。在此背景下,多视图聚类(Multi-View Clustering, MVC)逐渐成为研究热点。

传统的多视图聚类方法主要包括子空间方法 [8--10]、基于图的方法 [11--13]、张量方法 [14,15] 以及基于矩阵分解的方法 [16--18]。其中,子空间方法旨在从各视图的高维特征空间中学习低维嵌入子空间,并进一步获得统一的子空间表示;基于图的方法通过构建图结构来挖掘数据内在关系,并结合图划分算法实现最优聚类;基于矩阵分解的方法利用矩阵分解技术处理多源数据,从而揭示数据的潜在结构;而张量方法则通过高阶数据结构来建模不同视图之间的高阶关联关系。然而,传统 MVC 方法普遍存在特征提取能力有限、对噪声敏感性较高等问题,这在一定程度上制约了其聚类性能。

深度神经网络在特征表示学习方面具备强大的非线性映射能力,这一优势显著推动了深度多视图聚类方法的发展 [19--23],并引起了研究者的广泛关注。深度 MVC 方法通过构建编码器网络,为各视图学习高质量的特征表示,从而有效捕获多视图数据中的复杂模式。此外,这类方法通常在实例级、视图级等不同粒度上设计损失函数,以进一步挖掘数据中的深层语义信息,显著提升聚类性能。得益于上述优势,一系列基于深度学习的多视图聚类方法在多视图数据集上取得了优异表现,展现出处理复杂聚类任务的巨大潜力。

尽管近年来提出了大量 MVC 方法,尤其是基于深度学习的聚类方法,但它们仍面临若干关键挑战,限制了模型性能的进一步提升。(1)许多基于对比学习的深度 MVC 方法忽视了视图内部的局部结构信息。这类方法通常将同一实例在不同视图中的表示视为正样本对,将其他实例视为负样本对。尽管该策略能够保证正样本对的准确性,但却忽略了样本所蕴含的丰富语义信息。在构建正样本对的过程中,与样本语义相关的结构信息被削弱,限制了判别性特征的学习,从而影响聚类效果。(2)部分方法致力于实现跨视图表示对齐,但未能有效融合各视图中的共享信息与潜在信息。过于严格的对齐策略可能导致跨视图嵌入空间中潜在结构信息的丢失,从而削弱模型充分利用多视图数据丰富信息的能力。

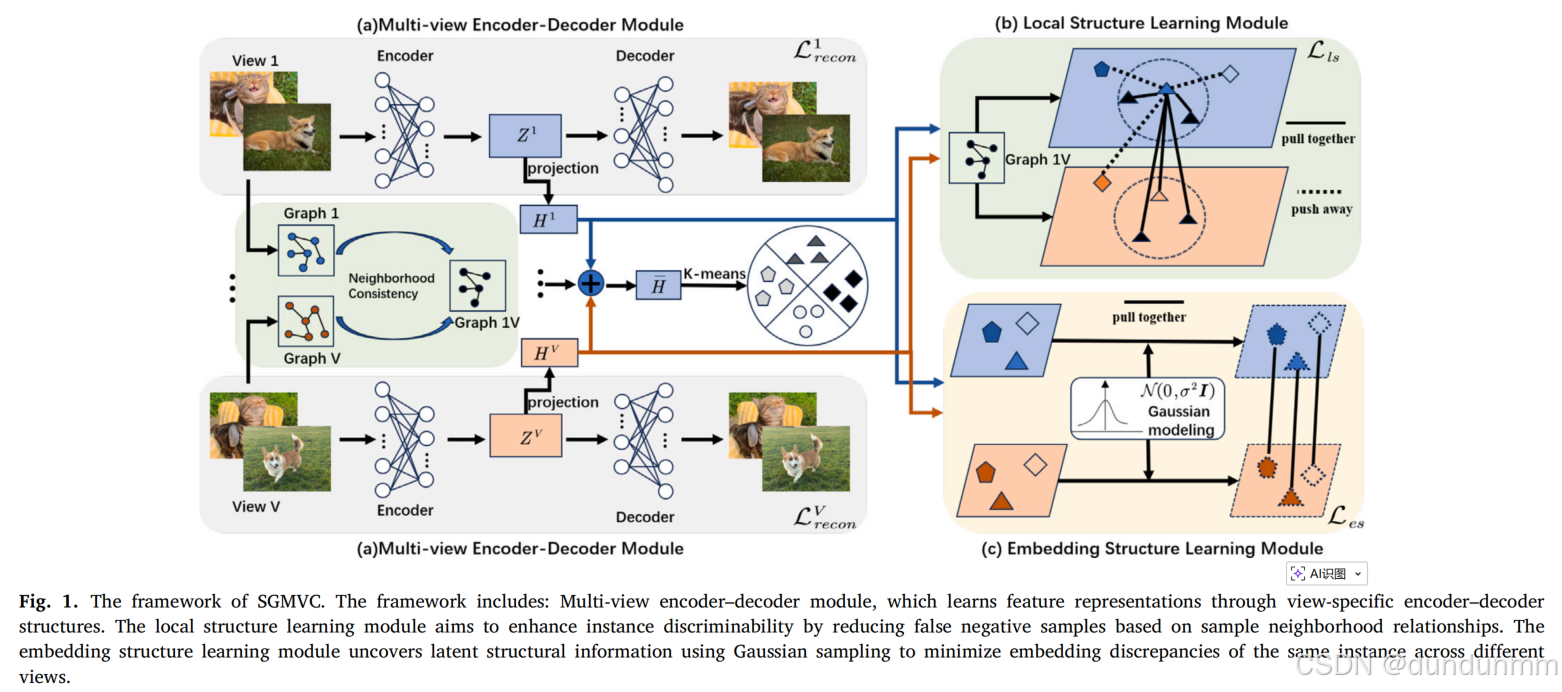

针对上述问题,本文提出了一种结构引导的深度多视图聚类框架 (Structure-Guided deep Multi-View Clustering, SGMVC),其整体结构如图 1 所示。该框架主要由三个模块组成:多视图编码--解码模块 、局部结构学习模块 以及嵌入结构学习模块。其中,多视图编码--解码模块用于从各视图中学习潜在表示;局部结构学习模块通过引入一种精细化的跨视图一致邻域选择策略,增强局部结构信息的提取能力,有效增加可靠的正样本对数量,从而促进样本判别性特征的学习,有利于聚类任务的开展。同时,为进一步挖掘数据中的结构信息,嵌入结构学习模块引入高斯分布以刻画嵌入空间中的结构特征,并通过优化嵌入表示之间的差异,实现更加一致的结构对齐,从而提升聚类性能。

本文的主要贡献总结如下:

-

提出了一种深度多视图聚类模型,通过多视图邻域构建与高斯建模,有效挖掘数据中的局部结构信息与潜在结构信息。

-

设计了一种基于跨视图一致性的邻域选择策略,并结合邻域一致性引导的对比损失函数,用于捕获视图内部的结构信息。

-

在五个多视图数据集上进行了大量实验,实验结果验证了所提出 SGMVC 方法的有效性。

方法

任务描述(Task Statement)

给定一个多视图数据集

其中包含 V 个视图和 N 个样本,dv表示第 v个视图的特征维度。多视图聚类的目标是将这 N 个样本划分为 C个互不重叠的簇。

表 1 总结了本文模型中所使用的变量及其含义。本节将结合图 1,详细介绍模型的三个核心模块。

3.1 多视图编码--解码模块(Multi-view Encoder--Decoder Module)

在多视图聚类任务中,原始多视图数据通常包含三类信息:

(1)各视图中特有且具有判别性的关键信息;

(2)不同视图之间共享的一致性表示;

(3)冗余噪声信息。

鉴于自编码器在无监督模型中具备较强的特征提取能力,本文为每个视图引入一个专用的自编码器,以提取该视图对应的潜在表示。具体而言,fv 表示第 v 个视图的编码器,gv表示其对应的解码器。对于第 v个视图中第 i 个样本,其潜在表示定义为:

其中,ziv 表示提取到的潜在特征表示,d 为潜在表示的维度,ϕv 为第 v 个视图编码器的参数。

通过解码器对 xiv 进行重构,得到重构样本:

其中,x^iv表示第 v 个视图中第 i 个样本的重构结果,ψv为对应解码器的参数。

为了训练所有视图的自编码器,本文采用如下重构损失函数:

3.2 局部结构学习模块(Local Structure Learning Module)

在多视图场景下,为了挖掘不同视图之间的一致性与复杂关联关系,可以采用对比学习(Contrastive Learning, CL)对各视图的特征分布进行对齐。在对比学习中,通常将同一样本在不同视图中的表示构造成正样本对,而来自不同样本的实例则构成负样本对。该学习过程旨在最大化正样本对之间的相似度,并最小化负样本对之间的相似度,从而同时捕获多视图数据的一致性与判别性特征。

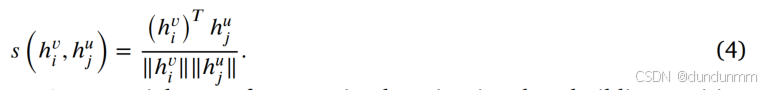

类似于 SimCLR,本文引入实例级特征投影头,将第 v 个视图的潜在表示 Zv投影到低维嵌入空间 Hv,以促进高效的对比学习。在新的嵌入空间中,采用余弦相似度度量两个样本之间的相似性:

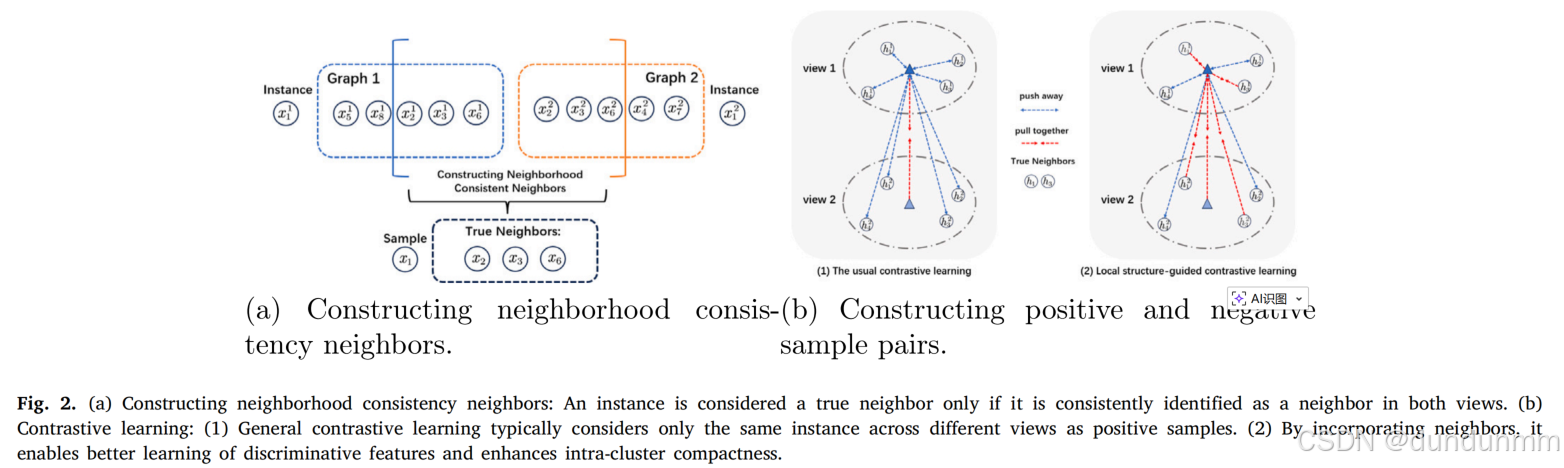

构建正样本对与负样本对是对比学习中的关键环节。然而,传统策略在构造样本对时过于简化,未能充分挖掘视图中的结构信息,也未能有效引入潜在的正样本对。这一局限性会削弱样本间的一致性与判别能力,从而对聚类性能产生不利影响。

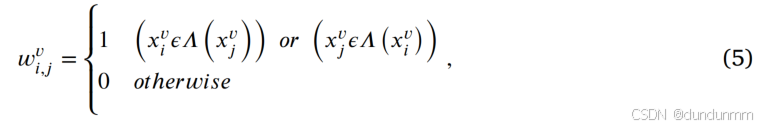

直观而言,在每个视图的原始特征空间 Xv中距离较近的样本更有可能属于同一簇。已有研究表明,引入邻域信息有助于提升聚类性能 [43]。基于这一观察,本文为每个视图构建最近邻图,并利用邻域关系生成额外的正样本对,从而缓解上述问题。对于第 v个视图,其最近邻图的构建方式定义为:

其中,Λ(xiv)表示在第 v 个视图中与样本 xiv距离最近的邻居集合。

然而,在多视图聚类中,不同视图往往由于特征空间差异而具有不同的最近邻结构。为此,本文提出一种精细化的邻居选择准则,以确保跨视图的一致性。

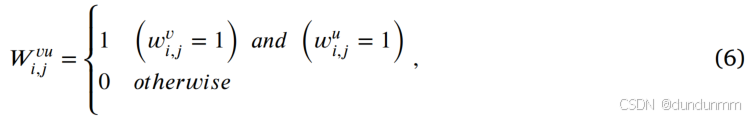

如图 2(a) 所示,对于任意一对视图,只有当某实例在至少两个视图中均被识别为邻居时,才将其视为真实邻居。由此可构建如下精炼邻接图:

其中 W_{i,j}^{vu}与 W_{i,j}^{uv}是对称的。

该策略能够有效减少由噪声引入的错误正样本对。通过在多视图之间保持邻域选择的一致性,可构建可靠的正样本集合:

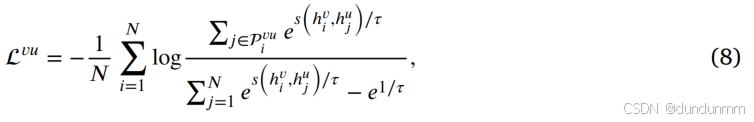

在图 2(b) 所示的正负样本构建方式基础上,本文在新的嵌入空间中计算跨视图对比损失,其定义为:

其中,τ为温度参数。

最终,总体对比学习损失函数定义为:

3.3 嵌入结构学习模块(Embedding Structure Learning Module)

数据来源的异构性与多样性导致不同视图的特征空间之间存在显著差异。这种视图间的异构性不仅影响聚类性能,也增加了视图对齐的难度,尤其是在学习共享嵌入表示时。本文的目标是在嵌入学习过程中有效捕获跨视图的共享信息,同时保留嵌入空间中潜在的结构信息。

在由高斯分布建模的连续嵌入空间中,中心点与其周围样本之间天然存在内在关联关系 [44]。基于这一观察,本文引入一种基于高斯分布的概率建模方法,以挖掘嵌入空间中的潜在结构信息。具体而言,对于给定视图中的每个样本,在嵌入空间中引入一个高斯分布模型 [45],并假设样本的特征表示服从如下分布:

其中,η为控制采样方差的参数,I 为单位矩阵,piv 表示通过采样得到的样本。

基于上述分布,对样本表示进行高斯采样:

其中,ϵ 为从标准高斯分布中采样得到的随机噪声。

通过该方式生成的样本 piv可被视为与原始样本 hiv 属于同一类别的正样本,从而在嵌入空间中构造潜在的结构邻域。

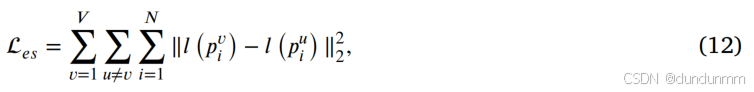

为了进一步挖掘跨视图的潜在结构信息,本文设计如下损失函数:

其中,l(⋅)表示预测网络(prediction network) [46]。

通过引入上述概率建模框架,该损失函数旨在最小化同一样本在不同视图中经高斯采样后得到的嵌入表示之间的差异。这不仅有助于挖掘潜在的结构信息,同时也能够有效增强跨视图特征对齐能力。

3.4 总体目标函数(Overall Objective Function)

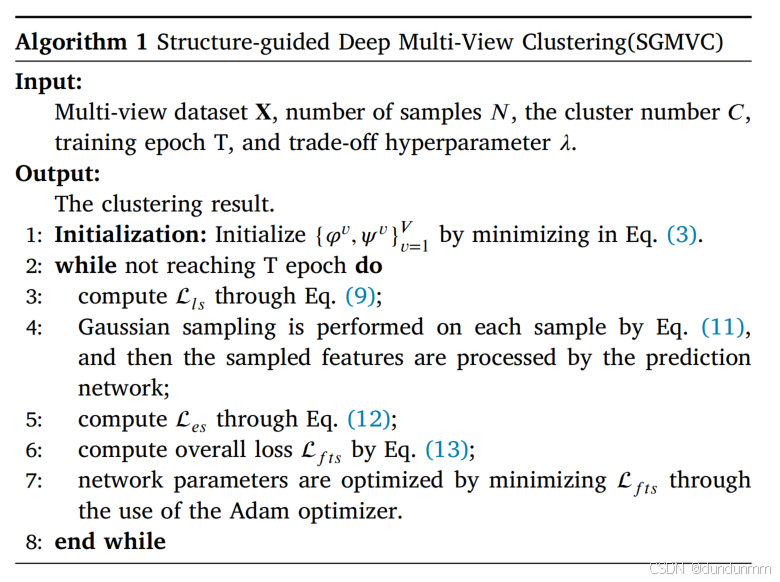

为优化所提出的模型,本文采用两阶段训练策略,包括预训练阶段与微调阶段。

在预训练阶段,为每个视图训练一个深度自编码器,目标是最小化原始样本与其重构样本之间的重构损失,如公式 (3) 所示。

在微调阶段,将局部结构学习模块 与嵌入结构学习模块引入整体训练过程,并优化如下目标函数:

其中,λ 为平衡两项损失的权重参数。网络整体训练流程如算法 1 所示。

以往研究通常采用加权融合 或特征拼接 的方式对多视图信息进行整合,但这些策略各自存在局限性:特征拼接会显著增加最终表示的维度,而加权融合往往引入额外的可学习参数,从而增加模型复杂度。为克服上述问题,本文采用简单平均融合策略来获得最终的统一表示,并将该表示作为输入送入 K-means 算法中,得到最终的聚类结果。

实验