论文标题:Frequency Dynamic Convolution for Dense Image Prediction

论文原文 (Paper) :https://openaccess.thecvf.com/content/CVPR2025/html/Chen_Frequency_Dynamic_Convolution_for_Dense_Image_Prediction_CVPR_2025_paper.html

代码 (code) :https://github.com/Linwei-Chen/FDConv

GitHub 仓库链接(包含论文解读及即插即用代码) :https://github.com/AITricks/AITricks

哔哩哔哩视频讲解 :https://space.bilibili.com/57394501?spm_id_from=333.337.0.0

目录

-

-

- [1. 核心思想](#1. 核心思想)

- [2. 背景与动机](#2. 背景与动机)

-

- [2.1 文本背景总结](#2.1 文本背景总结)

- [2.2 动机图解分析](#2.2 动机图解分析)

- [3. 主要创新点](#3. 主要创新点)

- [4. 方法细节](#4. 方法细节)

-

- [4.1 整体网络架构](#4.1 整体网络架构)

- [4.2 核心创新模块详解](#4.2 核心创新模块详解)

- [4.3 理念与机制总结](#4.3 理念与机制总结)

- [4.4 图解总结](#4.4 图解总结)

- [5. 即插即用模块的作用](#5. 即插即用模块的作用)

- [6. 实验部分简单分析](#6. 实验部分简单分析)

- [7. 获取即插即用代码关注 【AI即插即用】](#7. 获取即插即用代码关注 【AI即插即用】)

-

1. 核心思想

本文针对现有动态卷积(Dynamic Convolution, 如 CondConv, ODConv)存在的参数冗余 和核相似性高 的问题,提出了一种名为 FDConv (Frequency Dynamic Convolution) 的新型算子。其核心思想是将卷积核的生成过程转移到傅里叶频域 进行。通过在频域中学习一个固定的参数预算(Parameter Budget),并利用核空间调制 (KSM) 和 频带调制 (FBM) 两种机制动态调整频率响应,最后通过逆傅里叶变换(IFFT)还原为空间卷积核。这种方法在大幅降低参数量的同时,显著提升了卷积核的频率多样性和表达能力。

2. 背景与动机

2.1 文本背景总结

动态卷积(Dynamic Conv)通过根据输入图像动态聚合多个并行卷积核(Experts),显著提升了模型的容量。然而,现有方法面临两个主要痛点:

- 参数爆炸 :参数量随卷积核数量 K K K 线性增长( K × P a r a m s K \times Params K×Params),导致模型臃肿。

- 核同质化(High Similarity):研究发现,训练好的多个动态核在空间上往往非常相似,这意味着大量的参数被浪费在了重复的特征提取上,并未真正提供多样性的"专家知识"。

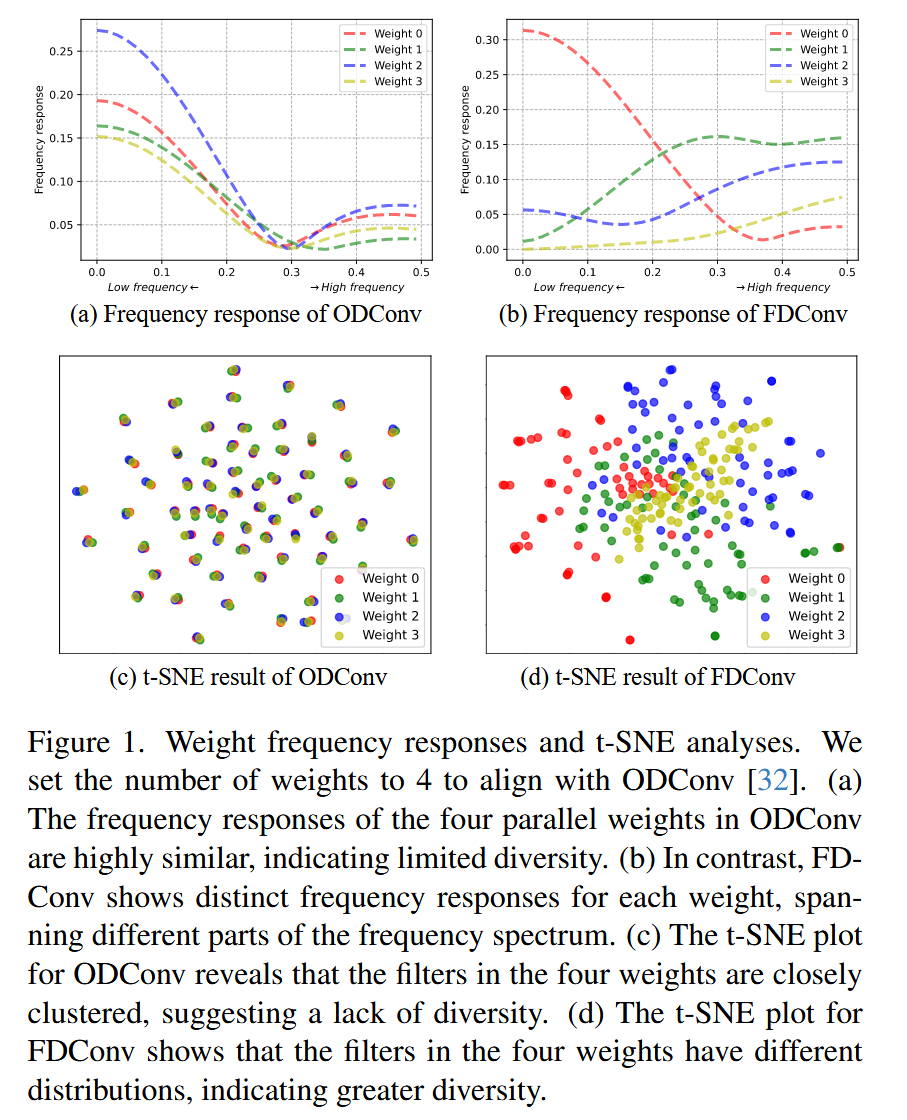

2.2 动机图解分析

看图说话与痛点分析:

- 现有方法的局限性(左图) :传统的 DY-Conv 直接在空间域学习 K K K 个完整的卷积核。可视化显示,这些核的频率响应(频谱图)非常相似,说明它们都在关注类似的图像成分(比如都只看低频轮廓),缺乏互补性。

- FDConv 的突破(右图) :FDConv 不直接存储空间核,而是存储频域系数。它将频域划分为不同的频带组(Frequency Groups),每个组负责不同的频率成分(互不相交)。通过组合这些正交的频率成分,FDConv 能够以极低的代价构建出形态各异、功能互补的空间卷积核,完美解决了"同质化"问题。

3. 主要创新点

- 频域参数预算 (Frequency Parameter Budget):首创性地在频域定义卷积参数,利用傅里叶变换的性质,通过学习少量的频域系数来重构复杂的空间卷积核。

- 正交频率分组:将频域预算划分为互不相交的组(Disjoint Indices),确保生成的不同基核(Basis Kernels)在频谱上是正交互补的,最大化了特征提取的多样性。

- 双重调制机制 :

- 核空间调制 (KSM):在空间域动态调整卷积核的幅度。

- 频带调制 (FBM):在频域动态调整不同频段的权重。两者协同工作,赋予了卷积核强大的自适应能力。

- 极致的参数效率 :在保持甚至超越 SOTA 性能(如 ODConv)的前提下,参数量仅为传统动态卷积的 1/K 甚至更低。

4. 方法细节

4.1 整体网络架构

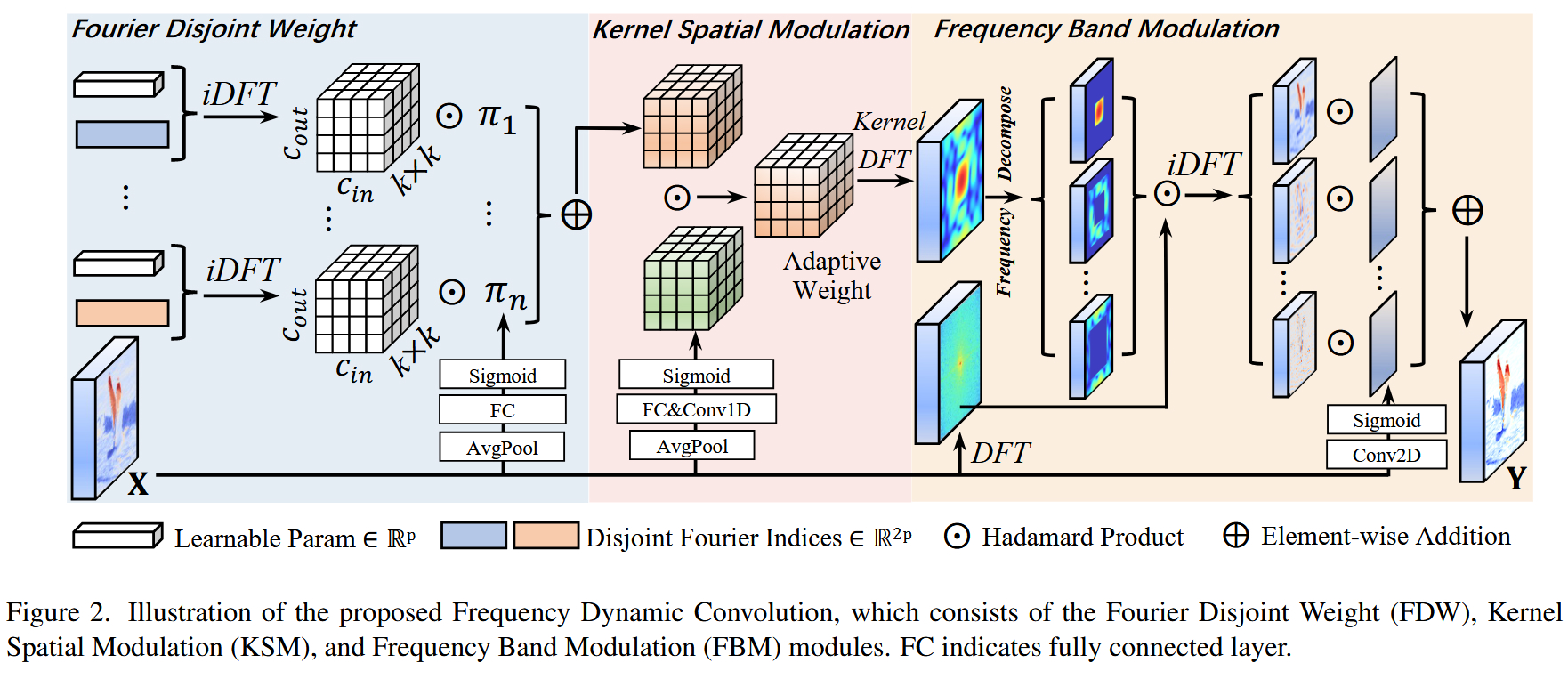

数据流详解 :

FDConv 是一个可以直接替换 nn.Conv2d 的即插即用模块,其内部数据流如下:

- 输入 (Input) :特征图 X X X。

- 注意力生成 (Attention Generation) :

- 利用全局平均池化(GAP)和全连接层(FC),从输入 X X X 中预测出两组动态系数:空间调制系数 α \alpha α 和 频带调制系数 β \beta β。

- 频域核构建 (Frequency Kernel Construction) :

- 预定义一个可学习的频域张量 W f W_f Wf(Parameter Budget)。

- FBM 调制 :利用系数 β \beta β 对 W f W_f Wf 的不同频带进行加权增强或抑制。

- 逆傅里叶变换 (IFFT) :

- 将调制后的频域张量通过 IFFT 变换回空间域,得到一组基卷积核(Basis Kernels)。

- 空间核聚合与调制 (Spatial Aggregation & KSM) :

- KSM 调制 :利用系数 α \alpha α 对基卷积核进行空间层面的动态加权。

- 将加权后的核聚合为一个最终的动态卷积核 W d y n a m i c W_{dynamic} Wdynamic。

- 卷积操作 :使用 W d y n a m i c W_{dynamic} Wdynamic 对输入 X X X 进行标准卷积,输出结果。

4.2 核心创新模块详解

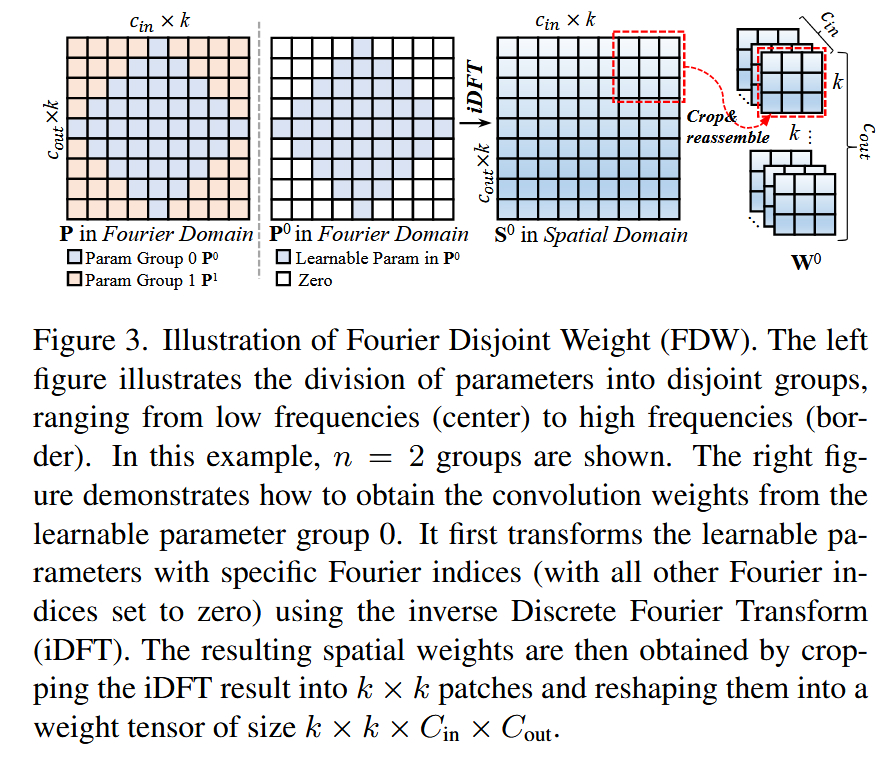

模块 A:频域权重生成与分组 (Frequency Weight Generation)

- 设计理念:利用 DFT 的共轭对称性,只需要存储一半的频域系数即可还原实数卷积核,节省一半参数。

- 分组策略 :将总的参数预算切分为 G G G 组,每组只负责频谱中的一部分(例如一组负责低频,一组负责高频)。这强制每个"专家"核专注于不同的纹理特征。

模块 B:双重调制 (KSM & FBM)

- KSM (Kernel Spatial Modulation) :

- 作用于空间域。

- 类似于 SE-Net 的通道注意力,但这里是对卷积核本身进行加权。它决定了"使用哪个基核"。

- FBM (Frequency Band Modulation) :

- 作用于频域。

- 这是一个细粒度的控制。它允许网络根据输入图像的模糊程度或噪声水平,动态地增强高频(细节)或抑制高频(去噪)。

- 协同工作:FBM 调整核的"内涵"(频率成分),KSM 调整核的"强度"(组合方式),两者实现了对卷积核性质的全方位控制。

4.3 理念与机制总结

FDConv 的核心理念是 "频域稀疏性与正交性"。

- 机制 :它认为在空间域学习 N N N 个相似的 3 × 3 3 \times 3 3×3 矩阵是浪费的。不如在频域学习几个正交的"波",然后通过组合这些波来生成千变万化的卷积核。

- 公式解读 : W = IFFT ( FBM ( W f ) ) ⊙ α W = \text{IFFT}(\text{FBM}(W_f)) \odot \alpha W=IFFT(FBM(Wf))⊙α。

4.4 图解总结

回到动机图解:

- IFFT 机制 解决了参数爆炸问题,因为频域参数通常比空间域参数更紧凑且易于压缩。

- 频率分组 解决了核同质化问题。由于每组基核来源于不同的频带,它们在物理上就不可能相似,从而保证了特征提取的多样性(Diversity)。

5. 即插即用模块的作用

FDConv 设计为通用的卷积算子,具有极广的适用性:

- 适用场景 :

- 密集预测任务:语义分割、目标检测、深度估计。这些任务对多尺度和多频率特征非常敏感。

- 底层视觉任务:图像去噪、去雨、超分辨率。FBM 能够动态调节滤波器的通带,非常适合处理频率相关的退化。

- 具体应用 :

- 替换 ResNet/Swin 中的 Conv :将 ResNet 中的 3 × 3 3 \times 3 3×3 卷积替换为 FDConv,可以直接获得精度提升。

- 轻量化模型设计:在 MobileNet 或 EfficientNet 中使用 FDConv,可以在不增加参数量的前提下,大幅提升模型的表达能力(Capacity)。

6. 实验部分简单分析

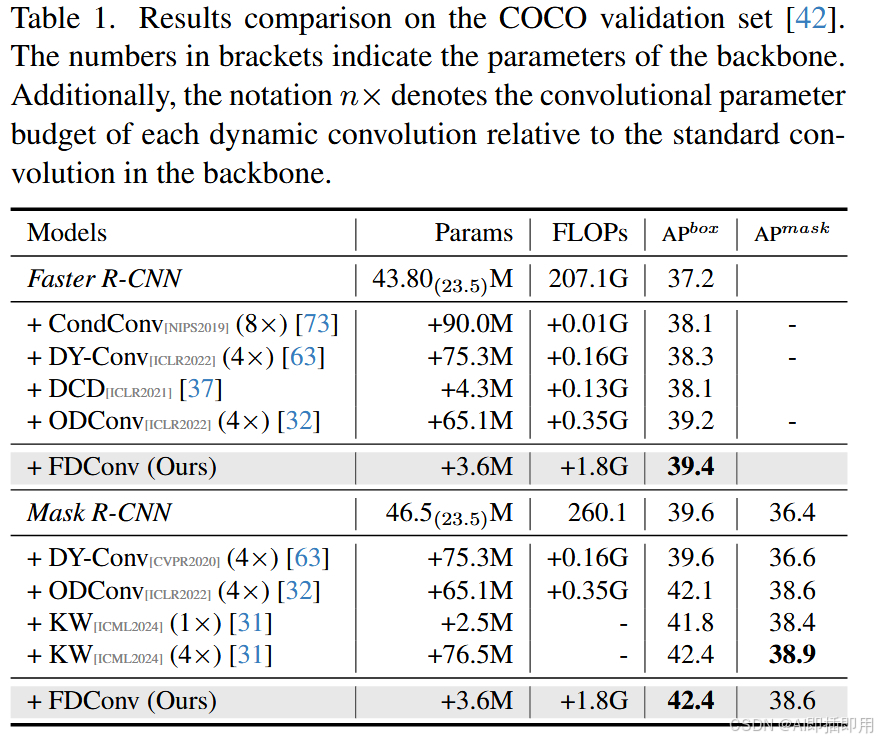

论文在 ADE20K (分割) , COCO (检测) , SIDD (去噪) 等多个数据集上进行了验证。

-

语义分割 (Semantic Segmentation):

- 在 ADE20K 上,使用 ResNet-50 作为 Backbone,FDConv 相比标准的 ResNet 提升了 +3.4 mIoU ,相比 ODConv 提升了 +1.2 mIoU。

- 关键点 :FDConv 的参数量仅为 ODConv 的 1/4 甚至更少,实现了"少马跑快车"。

-

目标检测 (Object Detection):

- 在 COCO 数据集上,FDConv 在 Mask R-CNN 框架下带来了显著的 AP 提升,证明了其在实例级任务上的有效性。

-

图像去噪 (Image Denoising):

- 在 SIDD 数据集上,FDConv 展现了强大的频率适应能力,PSNR 指标优于传统的动态卷积方法。

- 可视化 :去噪后的图像纹理保留更好,说明 FBM 成功地在去噪(低通滤波)和保边(高频保留)之间找到了动态平衡。

总结:FDConv 是一篇极具洞察力的论文。它跳出了空间域"堆参数"的内卷怪圈,利用经典的信号处理理论(FFT)为深度学习算子注入了新的活力。对于追求极致效率和模型性能的 CV 工程师来说,这绝对是一个值得尝试的"黑科技"算子。

到此,所有的内容就基本讲完了。如果觉得这篇文章对你有用,记得点赞、收藏并分享给你的小伙伴们哦😄。