⭐ 深度学习入门体系(第 11 篇): 卷积神经网络的卷积核是如何学习到特征的?

------从边缘到高级语义,一篇文章帮你看懂

上一篇我们讲了为什么 CNN 比 MLP 更适合图像。

这一篇我们聚焦 卷积核(Convolutional Filter):

它们到底学的是什么?

为什么浅层卷积学边缘,深层卷积学语义?

卷积核是怎么在训练中自动变聪明的?

很多初学者看到卷积核都是数字矩阵,完全不理解它的意义。

本文用生活化类比 + 直观解释 + 工程视角,让你读完就明白。

文章目录

- [⭐ 深度学习入门体系(第 11 篇): 卷积神经网络的卷积核是如何学习到特征的?](#⭐ 深度学习入门体系(第 11 篇): 卷积神经网络的卷积核是如何学习到特征的?)

- [🎯 一、卷积核的本质](#🎯 一、卷积核的本质)

- [🧱 二、浅层卷积学"边缘和纹理"](#🧱 二、浅层卷积学“边缘和纹理”)

- [📊 三、深层卷积学"局部组合和语义"](#📊 三、深层卷积学“局部组合和语义”)

- [⚡ 四、卷积核是如何学会这些的?](#⚡ 四、卷积核是如何学会这些的?)

- [🧩 五、生活化理解:卷积核就像"爱挑东西的眼睛"](#🧩 五、生活化理解:卷积核就像“爱挑东西的眼睛”)

- [🖼 六、可视化卷积核](#🖼 六、可视化卷积核)

- [📌 七、卷积核的几个关键点总结](#📌 七、卷积核的几个关键点总结)

- [🧭 八、工程实战启示](#🧭 八、工程实战启示)

- [🔑 九、全文核心总结](#🔑 九、全文核心总结)

- [🔜 下一篇](#🔜 下一篇)

🎯 一、卷积核的本质

卷积核本质上是一组可训练的小矩阵:

- 尺寸常见 3×3、5×5

- 每个数字都是权重

- 卷积操作 = 小矩阵在图像上滑动,提取局部特征

直观理解:

卷积核就是"一个小型的探测器",专门找特定的局部模式。

类比:

- 就像你戴了一副特定花纹的眼镜,眼镜只能看到斜线或者圆点

- 当你走过一张图片时,眼镜会帮你突出某些形状

- 卷积核就是这种"花纹眼镜",通过训练自动调整花纹,去发现最重要的图案

🧱 二、浅层卷积学"边缘和纹理"

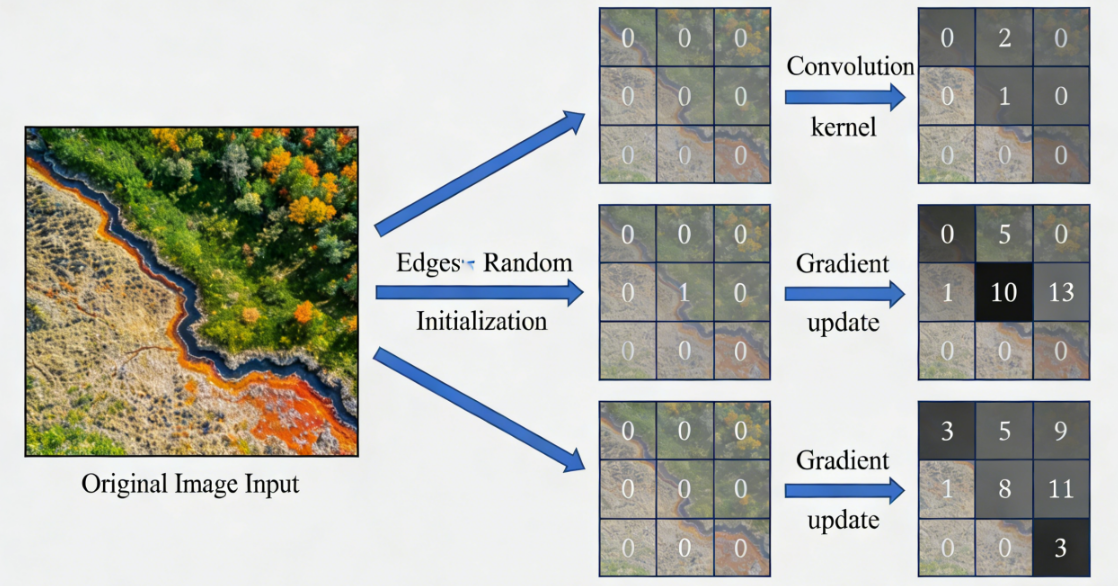

在 CNN 浅层:

- 输入是原始图像

- 卷积核随机初始化(通常接近 0 或小随机数)

- 训练过程中,梯度更新让卷积核"慢慢学会"检测有用特征

观察卷积结果:

- 边缘(水平、垂直、斜线)

- 纹理(点状、条纹、网格)

类比:

浅层卷积就像小朋友学习画画:先学画线条和简单图案

边缘 = 线条

纹理 = 小图案

这是网络理解图像的第一步。

📊 三、深层卷积学"局部组合和语义"

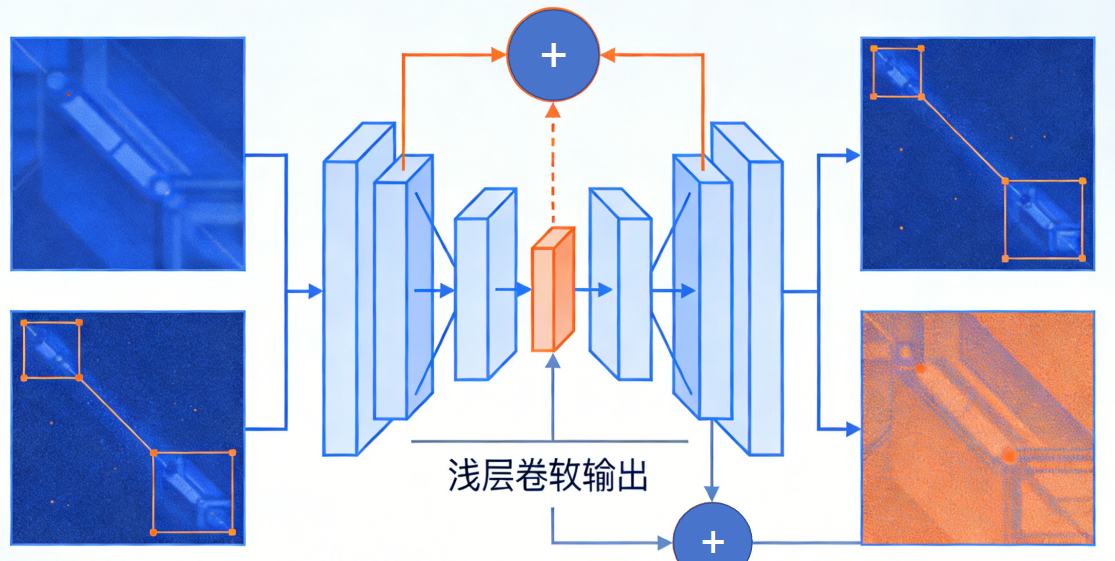

浅层卷积输出的是 特征图 Feature Map。

深层卷积看到的不是原始像素,而是浅层卷积提取出的特征:

- 小边缘组合成角

- 小角组合成局部形状

- 局部形状组合成物体部位

- 最后形成完整语义(脸、猫耳、车轮)

类比:

- 从小学画线条 → 学拼图 → 最终能画出完整画面

- 深层卷积就像孩子长大了,能理解"耳朵、鼻子、猫脸"这些高级特征

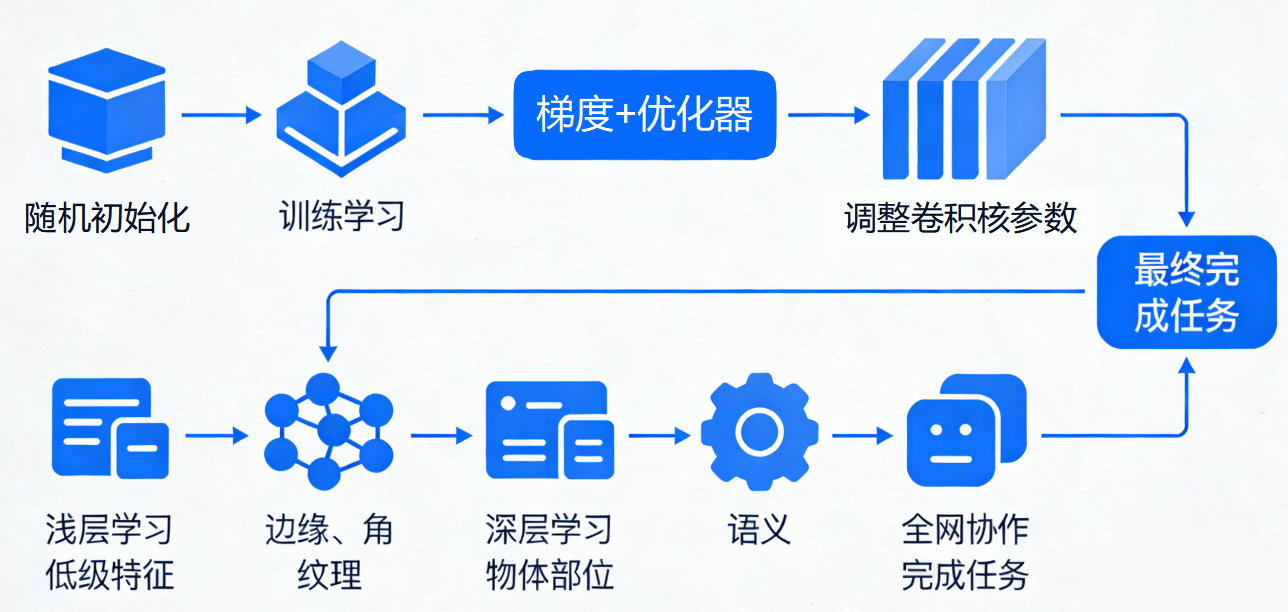

⚡ 四、卷积核是如何学会这些的?

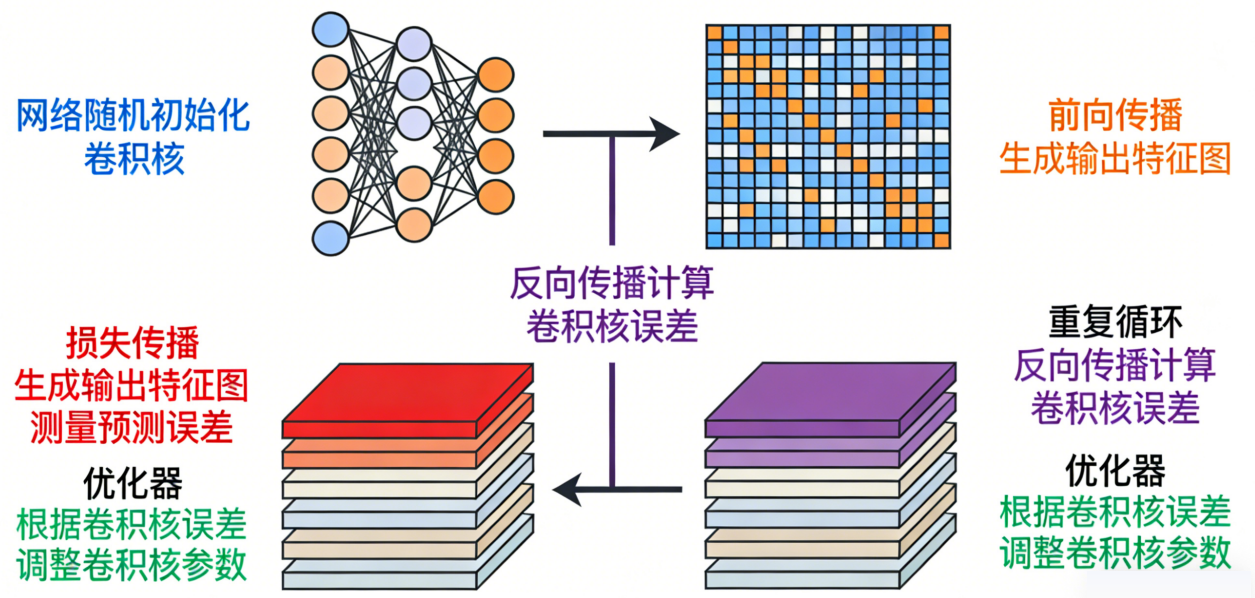

原理核心非常直白:

- 网络随机初始化卷积核

- 前向传播生成输出特征图

- 损失函数衡量预测误差

- 反向传播计算卷积核梯度

- 优化器根据梯度调整卷积核参数

- 重复循环 → 卷积核变聪明

关键点:

卷积核不是你手动设计的,而是网络自己通过训练自动调整,学会对任务最有用的特征。

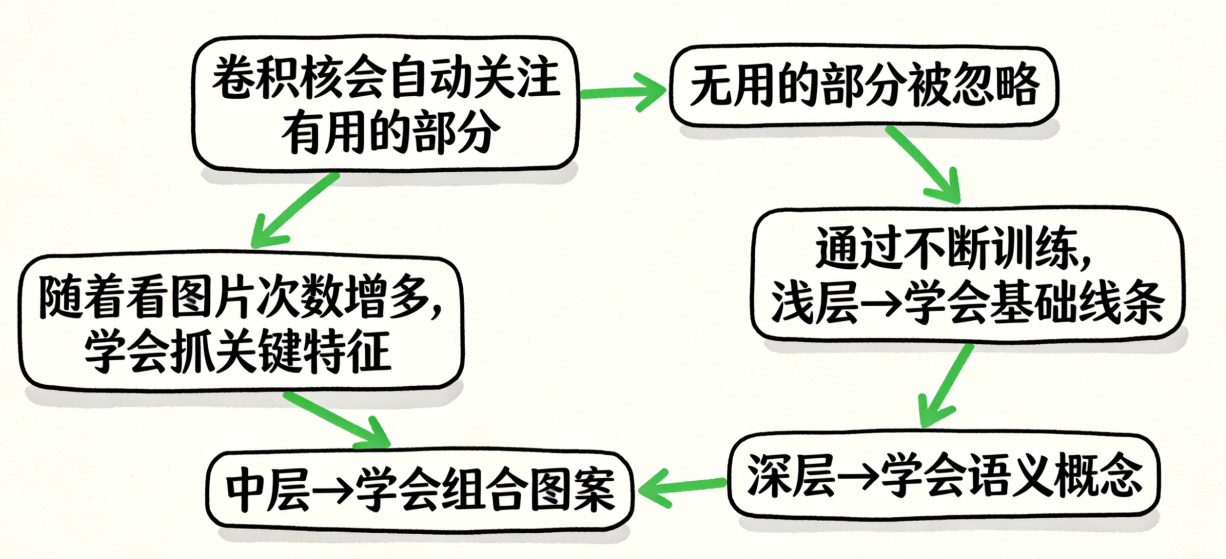

🧩 五、生活化理解:卷积核就像"爱挑东西的眼睛"

想象你有一双特殊的眼睛,每次看图片:

- 它会自动关注有用的部分

- 无用的部分被忽略

- 随着你看图片的次数越来越多,它学会抓关键特征

卷积核就是这种"眼睛",通过不断训练:

- 浅层 → 学会基础线条

- 中层 → 学会组合图案

- 深层 → 学会语义概念

🖼 六、可视化卷积核

在工程实践中,可以把卷积核可视化:

- 浅层卷积核看起来像 Sobel 边缘检测器

- 中层卷积核出现纹理组合

- 深层卷积核难以直接用眼睛看懂,但对分类有强区分力

实际操作方法:

python

# PyTorch 例子

import matplotlib.pyplot as plt

# 假设 model.conv1 是第一层卷积

kernels = model.conv1.weight.data.clone()

for i in range(kernels.shape[0]):

plt.subplot(1, kernels.shape[0], i+1)

plt.imshow(kernels[i,0].cpu(), cmap='gray')

plt.show()你会看到浅层卷积核多像"线条检测器",训练的直观结果非常有趣。

📌 七、卷积核的几个关键点总结

- 随机初始化 → 训练学习

- 梯度 + 优化器 → 调整卷积核参数

- 浅层学习低级特征 → 边缘、角、纹理

- 深层学习高级特征 → 物体部位、语义

- 全网协作 → 最终完成任务

一句话总结:

卷积核是网络的"感官",通过训练,它能自动从低级特征到高级语义逐层构建理解。

🧭 八、工程实战启示

-

可视化卷积核

- 可以直观理解网络学到什么

-

卷积层深度

- 浅层卷积 → 捕捉纹理

- 深层卷积 → 捕捉语义

-

卷积核大小选择

- 3×3 是最常用

- 大卷积核参数多,学习慢

-

卷积核数量

- 决定网络能学习多少不同特征

-

训练卷积核无需手动干预

- 网络会通过反向传播和优化器自动学习

🔑 九、全文核心总结

卷积核是 CNN 的感官:

- 浅层卷积核学边缘和纹理

- 深层卷积核学语义

- 它们通过反向传播和优化器自动调整

- 让 CNN 从局部到全局理解图像

- 这是 CNN 能在图像任务中胜过 MLP 的关键

🔜 下一篇

《深度学习入门体系(第 12 篇):卷积神经网络的池化层为什么重要?从下采样到特征增强解析》