引言:安防开发的"深水区"痛点

在深耕安防行业十年的架构师生涯中,我目睹了无数集成商和ISV(独立软件开发商)倒在"最后一公里"。传统的视频监控项目往往陷入以下泥潭:

- 硬件碎片化严重:海康、大华、宇视等厂商协议私有化,GB28181国标对接调试周期长,RTSP/RTMP流媒体服务稳定性难以保障。

- 异构算力适配难:客户现场环境复杂,既有x86架构的GPU服务器,又有ARM架构的NPU边缘盒子。为不同芯片(如华为昇腾、英伟达、瑞芯微)单独编译算法模型,导致运维成本指数级上升。

- 开发成本高企:从流媒体转发、AI推理引擎封装到告警业务逻辑,重复造轮子现象普遍。据统计,一个标准的企业级AI视频平台,若从零自研,约95%的代码量其实是在处理通用的基础设施问题,而非核心业务价值。

如何解耦底层硬件与上层应用?如何实现"一次开发,全域部署"?今天,我们将深度解析一款支持源码交付 、私有化部署的企业级AI视频管理平台,看它如何通过微服务架构和容器化技术,将开发成本降低95%。

-

一、核心架构:异构计算与容器化编排

该平台最显著的技术特征在于其全硬件适配能力。它并非简单的软件堆砌,而是基于云原生理念设计的异构计算调度中心。

1.1 跨指令集的统一抽象层

平台底层构建了统一的硬件抽象层(HAL),屏蔽了x86与ARM指令集的差异,同时兼容CUDA(NVIDIA GPU)与CANN(华为NPU)等异构算力。

- 部署灵活性:支持Docker容器化部署。无论是中心机房的Intel Xeon + T4显卡,还是边缘端的ARM + 瑞芯微NPU,只需加载对应的镜像标签,即可实现算法模型的无缝迁移。

- 资源动态调度:通过K8s或Docker Swarm集群管理,平台能根据视频路数和算法复杂度,动态分配推理资源。

架构逻辑示意(伪代码):

yaml

# docker-compose.yml 片段展示异构节点配置

version: '3.8'

services:

ai-inference-node:

image: yihecode/inference-engine:v2.0

deploy:

resources:

reservations:

devices:

- driver: nvidia # 或 huawei/npu

count: 1

capabilities: [gpu]

environment:

- HARDWARE_ARCH=${TARGET_ARCH} # 自动识别 x86 or ARM

- ALGORITHM_MODEL=yolo_v8_person_detect

ports:

- "8080:8080" # 统一推理服务端口1.2 微服务解耦设计

平台采用微服务架构,将视频流媒体服务 、AI推理引擎 、告警分发中心 、数据标注平台完全解耦。

- 流媒体服务:独立模块处理RTSP拉流、RTMP推流及GB28181信令交互,支持H.265/H.264硬解码。

- 算法商城:作为独立服务运行,支持热插拔加载新模型,无需重启主服务。

- 告警中心:基于消息队列(如RabbitMQ/Kafka)异步处理告警事件,确保高并发下系统不阻塞。

二、协议兼容:构建万物互联的视频底座

对于集成商而言,设备接入的兼容性是项目交付的生死线。该平台内置了强大的协议转换网关,真正实现了"芯片、算法、应用"的全流程打通。

2.1 全协议栈支持

- 国标GB28181:完整支持28181-2016/2022标准,可作为SIP服务器主动注册前端设备,或通过SIP客户端向上级平台级联。

- 通用流协议:原生支持RTSP/RTMP推流与拉流,兼容ONVIF协议发现与控制。

- 私有协议转译:针对主流大厂私有SDK,平台内部进行了封装转译,对外统一输出标准RTSP流,上层应用无需关心底层设备品牌。

2.2 边缘协同机制

在"边云协同"场景下,边缘盒子负责实时视频流的初步分析与告警,中心平台负责汇聚管理与大屏展示。

边缘控制逻辑模拟:

python

# 模拟边缘盒子算法下发与参数配置

def configure_edge_device(device_id, algorithm_config):

"""

向边缘盒子下发算法配置

:param device_id: 边缘盒子ID

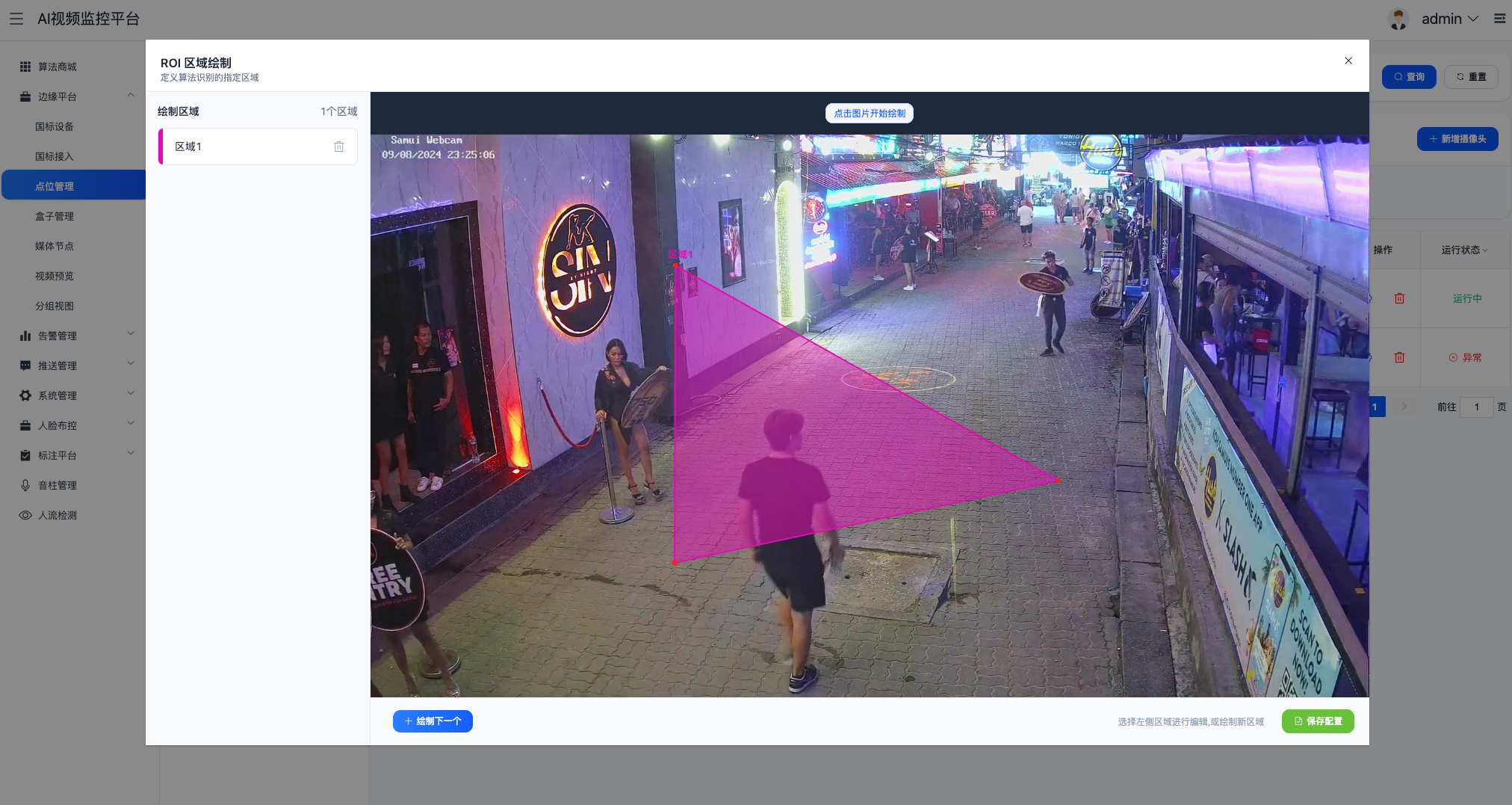

:param algorithm_config: 包含模型版本、阈值、ROI区域等

"""

payload = {

"cmd": "UPDATE_ALGORITHM",

"model_version": algorithm_config['version'], # 支持版本升降级

"inference_interval": algorithm_config['interval'], # 控制识别间隔,节省算力

"roi_points": algorithm_config['drawn_region'] # 绘制区域坐标

}

# 通过MQTT或gRPC下发至边缘端

edge_channel.publish(f"edge/{device_id}/config", json.dumps(payload))

# 边缘端实时返回日志与状态

return edge_channel.subscribe(f"edge/{device_id}/logs")三、二次开发与源码交付:集成商的终极武器

对于寻求差异化竞争的ISV,源码交付意味着掌握了核心主动权。该平台不仅提供API,更提供完整的工程源代码,支持OEM贴牌(Logo替换、系统改名)。

3.1 极低成本的定制化

传统模式下,定制一个人脸识别轨迹功能可能需要2人/月的开发量。基于该平台的源码,开发者仅需关注业务逻辑层:

- 算法自定义:支持上传用户自训练的PyTorch/TensorFlow模型文件,平台自动完成格式转换与部署。

- 告警联动 :通过Webhook或SDK,轻松对接钉钉、飞书、企业微信、语音电话甚至户外LED屏。

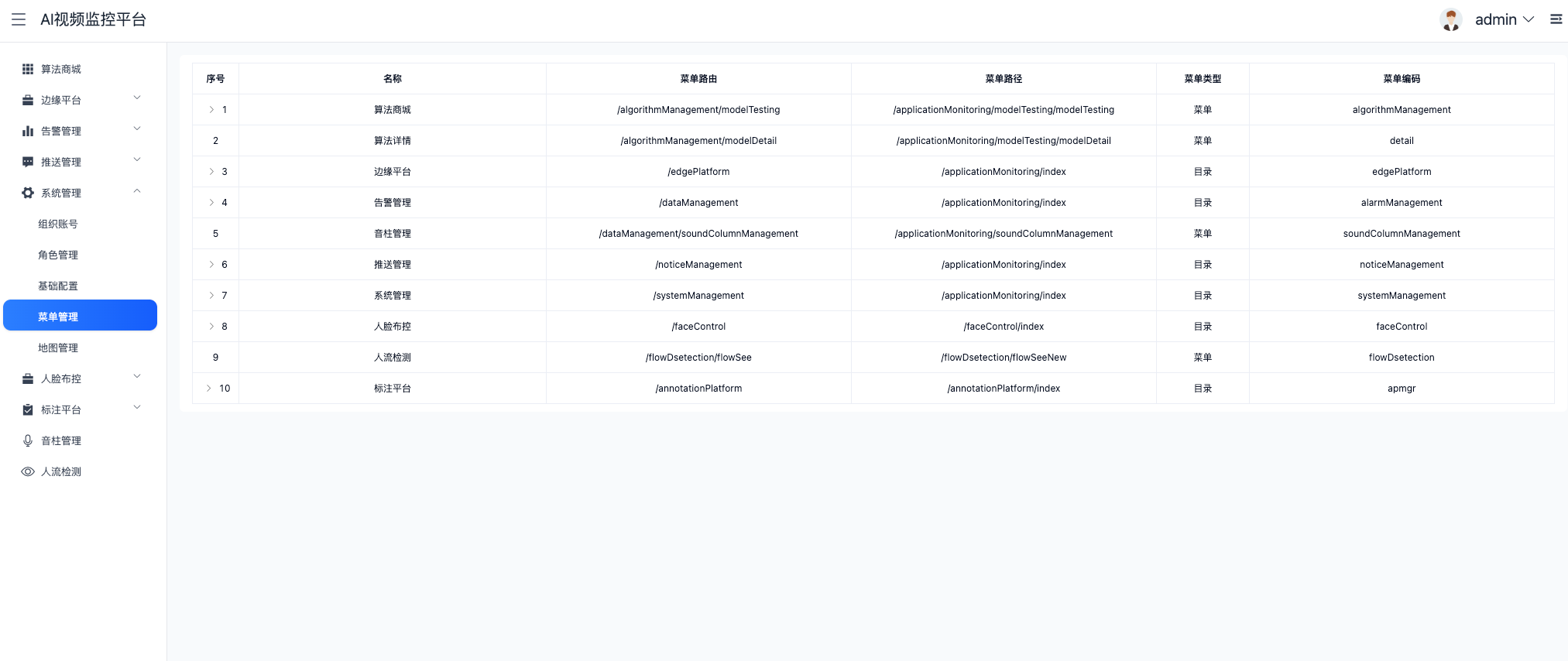

3.2 丰富的API生态

平台提供了RESTful API覆盖全业务流程,从设备接入到告警查询,再到人流量统计数据分析。

API调用示例:获取人流量统计趋势

http

GET /api/v1/statistics/crowd-flow/trend

Params:

camera_id: cam_007

start_time: 2026-03-08T00:00:00Z

end_time: 2026-03-09T00:00:00Z

granularity: hour

Response:

{

"code": 200,

"data": {

"total_enter": 1250,

"total_leave": 1180,

"current_remain": 70,

"trend": [

{"time": "10:00", "enter": 120, "leave": 80},

{"time": "11:00", "enter": 150, "leave": 140}

// ...

]

}

}这种开放架构使得企业可以将精力集中在垂直场景的业务创新上,而非底层的音视频编解码与AI推理优化,从而切实实现减少约95%的开发成本。

四、功能全景:从标注到大屏的一体化闭环

除了核心的流媒体与AI能力,平台还构建了完整的数据闭环:

- 数据标注平台:内置标注工具,支持对采集的视频帧进行人工标注,直接用于模型迭代训练,形成"采集-标注-训练-部署"的MLOps闭环。

- AI监控大屏:可视化展示多路视频、实时告警、人流量热力图及设备在线状态,支持自定义布局。

- 精细化告警管理 :

- 支持按时间、摄像头、算法类型多维筛选。

- 告警图片自动清理策略(默认保留24小时,可配置),有效节省存储成本。

- 支持告警原图导出与回溯。

- 人流量统计进阶:不仅统计进出人数,还能计算区域剩余人数(可为负数修正),并以图表形式展示长周期变化趋势,为商业选址、安保调度提供数据支撑。

五、总结与展望

在国产化替代与数字化转型的双重浪潮下,拥有一套自主可控、架构灵活、支持异构算力的视频管理平台,已成为安防企业的核心竞争力。该平台通过解耦的微服务设计 、广泛的协议兼容 以及彻底的源码交付策略,为技术决策者提供了一条通往高效、低成本开发的捷径。

无论你是需要快速交付项目的集成商,还是希望构建自有品牌的初创团队,这套架构都能让你站在巨人的肩膀上,专注于业务价值的创造。

🚀 演示环境与技术支持

为了让大家更直观地体验该平台的架构设计与功能细节,我们搭建了公开的演示环境。

- 演示地址:请联系作者获取最新演示链接 (注:出于安全考虑,公开文章通常不直接暴露公网IP,建议通过下方方式联系)

- 开源仓库 :Gitee - YiheCode Server

技术交流 :

如果您对该平台的源码交付细节 、NPU适配方案 或GB28181集群部署 有深入探讨的需求,欢迎在评论区留言或私信我。作为拥有10年经验的架构师,我很乐意分享更多关于低代码视频开发 与边缘计算落地的实战经验。