CLI Agent作为大模型与本地终端交互的核心载体,其设计核心是解决"自然语言需求→本地命令执行"的高效、安全闭环。结合大模型调用本地CLI命令的底层机制,同时修正流程逻辑(新增业务Agent环节,明确"用户→业务Agent→CLI Agent"的流转),本文将从架构设计、核心原理图、流程实现、关键模块解析四大维度,完整呈现CLI Agent的设计方案,确保适配本地终端调用场景,兼顾安全性与可扩展性。

一、CLI Agent整体架构设计(核心架构图)

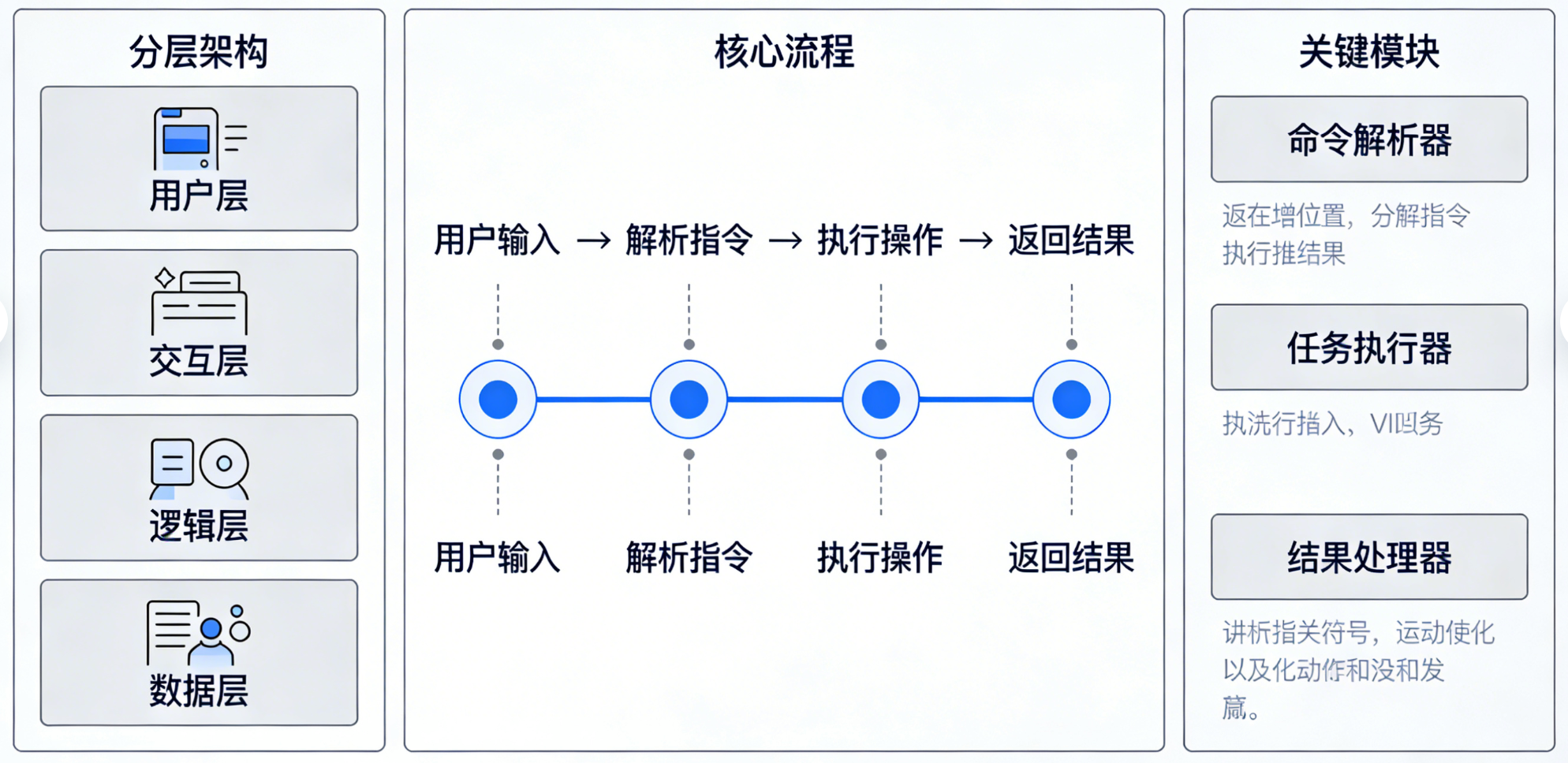

CLI Agent采用"分层架构+模块化设计",核心分为5大层,新增业务Agent模块作为逻辑处理核心,串联用户需求与CLI执行,同时整合安全沙箱、技能注入等关键机制,架构清晰、可扩展性强。整体架构图如下:

数据存储层

执行层

能力支撑层

核心逻辑层

用户交互层

用户

自然语言输入接口

业务Agent模块

CLI Agent模块

环境适配模块

安全防护模块

技能注入模块

通信适配模块

本地终端适配(PowerShell/bash/zsh)

沙箱管理(轻量沙箱/容器化沙箱)

命令执行引擎

结果读取与整理

本地技能库/环境信息库

通信配置库

执行日志/历史记录库

自然语言输出接口

架构说明:整体架构遵循"分层解耦、职责单一"原则,各层独立运行且可灵活扩展,核心亮点是新增业务Agent模块,承担"需求解析、逻辑处理、命令生成"的核心职责,CLI Agent仅负责"命令适配、安全执行、结果反馈",避免职责混淆,同时确保流程符合"用户→业务Agent→CLI Agent"的正确逻辑。

1.1 各层核心职责详解

1. 用户交互层

核心职责:承接用户自然语言需求,输出最终执行结果(自然语言形式),是用户与Agent交互的入口和出口。包含自然语言输入接口(支持命令行输入、图形化界面输入)和自然语言输出接口(将命令执行结果通过大模型解读为易懂的自然语言)。

2. 核心逻辑层(核心模块)

这是CLI Agent设计的核心,新增业务Agent模块,与CLI Agent模块分工协作:

① 业务Agent模块:核心职责是"需求解析、逻辑处理、命令生成",是连接用户与CLI Agent的关键。接收用户自然语言需求后,结合大模型(本地/远程)完成需求解析,执行业务逻辑(如判断需求类型、整合本地环境信息),最终生成标准化的CLI命令文本,传递给CLI Agent模块。

② CLI Agent模块:核心职责是"命令适配、安全执行、结果反馈",不参与业务逻辑处理,仅负责将业务Agent生成的命令文本,先完成环境适配与安全校验,再转换为本地终端可执行的指令------安全命令直接调用本地终端执行,高风险命令则调用沙箱在隔离环境内执行,执行后将结果回传给业务Agent。

3. 能力支撑层

为核心逻辑层提供基础能力支撑,确保CLI Agent高效、安全运行,包含4个核心模块:

① 环境适配模块:自动检测本地操作系统(Windows/Linux/macOS),匹配对应终端(PowerShell/bash/zsh),完成命令格式适配、参数校验,避免命令执行失败。

② 安全防护模块:整合安全沙箱、命令白名单、权限确认三大机制,隔离命令执行环境,过滤危险命令,避免本地系统损坏、数据泄露。

③ 技能注入模块:读取本地环境信息(操作系统版本、已安装工具、文件路径)和本地技能库,将相关信息注入业务Agent(辅助命令生成),确保生成的命令贴合本地实际。

④ 通信适配模块:负责业务Agent与大模型(本地/远程)的通信,以及CLI Agent与本地终端的通信,支持本地API、远程API两种通信方式,确保数据传输高效、安全。

4. 执行层

核心职责:执行CLI命令,读取执行结果并整理。包含本地终端适配、沙箱管理、命令执行引擎、结果读取与整理4个模块,其中沙箱管理模块可根据场景选择轻量级沙箱(个人开发者)或容器化沙箱(企业场景)。

5. 数据存储层

负责存储CLI Agent运行所需的各类数据,确保数据本地化(保护隐私),包含本地技能库、环境信息库、通信配置库、执行日志/历史记录库,支持数据持久化存储和快速查询。

二、CLI Agent核心原理图(工作原理详解)

CLI Agent的核心工作原理是"业务Agent处理逻辑、CLI Agent执行命令",依托"需求解析→命令生成→命令适配→安全执行→结果反馈"的闭环,实现自然语言需求到本地命令执行的转化。结合架构设计,核心原理图如下,清晰呈现各模块的交互逻辑:

高风险命令

安全命令

用户输入自然语言需求

业务Agent模块

需求解析

业务逻辑处理

生成标准化CLI命令文本

CLI Agent模块

环境适配模块:系统识别+命令适配+格式校验

安全防护模块:沙箱初始化+命令白名单过滤

权限确认(用户手动确认)

命令执行引擎

本地终端执行命令

结果读取与整理

CLI Agent将结果回传给业务Agent

业务Agent结合大模型,解读结果为自然语言

反馈给用户

技能注入模块

环境信息库

安全沙箱

通信适配模块

大模型(本地/远程)

原理图说明:核心逻辑分为两大环节------业务Agent的"逻辑处理与命令生成",以及CLI Agent的"命令执行与结果反馈",两者通过标准化命令文本实现交互,同时依托技能注入、安全防护等模块,确保命令生成准确、执行安全。

2.1 核心工作原理拆解(分步骤)

步骤1:用户输入与需求承接

用户通过自然语言输入接口(如命令行、图形化界面),输入具体需求(如"查看本地桌面所有Excel文件"),接口将需求直接传递给业务Agent模块,不经过CLI Agent(避免CLI Agent承担逻辑处理职责)。

步骤2:业务Agent处理逻辑,生成CLI命令

这是核心步骤,业务Agent模块完成3件事:

① 需求解析:通过通信适配模块连接大模型(本地Ollama/远程GPT-4等),将自然语言需求转换为可理解的业务逻辑(如"需求类型:文件查询,目标路径:本地桌面,文件类型:Excel")。

② 逻辑处理:结合技能注入模块提供的本地环境信息(如操作系统为Windows、终端为PowerShell、桌面路径为C:\Users\XXX\Desktop),整合业务逻辑,确定执行方案。

③ 命令生成:生成标准化的CLI命令文本(如Windows系统:Get-ChildItem -Path $env:USERPROFILE\Desktop -Filter *.xlsx),传递给CLI Agent模块。

步骤3:CLI Agent适配命令,启动安全防护

CLI Agent接收命令文本后,由环境适配模块完成3项适配工作:检测本地操作系统(Windows)、匹配终端(PowerShell)、校验命令格式(确保无参数错误、格式正确);同时,安全防护模块初始化沙箱(轻量级AppContainer沙箱),通过命令白名单过滤(确认该命令为安全命令),若为高风险命令(如删除、修改系统文件),则触发权限确认,需用户手动确认后再执行。

步骤4:命令执行与结果读取

命令适配完成且安全校验通过后,命令执行引擎根据命令风险等级选择执行方式:安全命令通过系统API(Windows的CreateProcess、Linux的fork/exec)直接启动本地终端执行;高风险命令则先启动对应沙箱(轻量级沙箱/容器化沙箱),再在沙箱内调用本地终端执行,确保系统安全。为让大家更直观理解本地命令执行的底层实现,以下补充3个主流系统的极简代码示例(基于Python,贴合CLI Agent实际开发场景),仅展示核心执行逻辑,省略冗余异常处理:

python

### 1. Windows系统(调用PowerShell执行命令,安全命令示例)

import subprocess

def execute_windows_command(command):

# 启动PowerShell进程,执行命令(安全命令直接执行)

process = subprocess.Popen(

["powershell.exe", "-Command", command],

stdout=subprocess.PIPE,

stderr=subprocess.PIPE,

text=True,

creationflags=subprocess.CREATE_NEW_CONSOLE # 独立进程,避免影响Agent主进程

)

# 读取执行结果和错误信息

stdout, stderr = process.communicate()

if process.returncode == 0:

return {"status": "success", "result": stdout.strip()}

else:

return {"status": "fail", "error": stderr.strip()}

# 调用示例(查看桌面Excel文件,安全命令)

result = execute_windows_command("Get-ChildItem -Path $env:USERPROFILE\Desktop -Filter *.xlsx")

print(result)

python

### 2. Linux系统(调用bash执行命令,安全命令示例)

import subprocess

def execute_linux_command(command):

# 启动bash进程,执行命令

process = subprocess.Popen(

["/bin/bash", "-c", command],

stdout=subprocess.PIPE,

stderr=subprocess.PIPE,

text=True

)

stdout, stderr = process.communicate()

if process.returncode == 0:

return {"status": "success", "result": stdout.strip()}

else:

return {"status": "fail", "error": stderr.strip()}

# 调用示例(查看/home目录下的txt文件,安全命令)

result = execute_linux_command("ls /home | grep .txt")

print(result)

python

### 3. 高风险命令(调用沙箱执行示例,以Linux容器化沙箱为例)

import subprocess

def execute_high_risk_command_in_sandbox(command):

# 启动Docker轻量级容器(Alpine),在沙箱内执行高风险命令

# 仅挂载本地项目目录,限制访问范围,避免影响主机系统

sandbox_command = [

"docker", "run", "--rm", "-v", "/home/user/project:/project",

"alpine:latest", "/bin/sh", "-c", command

]

process = subprocess.Popen(

sandbox_command,

stdout=subprocess.PIPE,

stderr=subprocess.PIPE,

text=True

)

stdout, stderr = process.communicate()

if process.returncode == 0:

return {"status": "success", "result": stdout.strip()}

else:

return {"status": "fail", "error": stderr.strip()}

# 调用示例(批量删除沙箱内项目目录的临时文件,高风险命令)

result = execute_high_risk_command_in_sandbox("rm -rf /project/temp/*")

print(result)命令执行完成后,结果读取与整理模块读取终端输出的结果(stdout),去除冗余字符、提取关键信息,整理为标准化结果(如上述代码中return的字典格式),方便后续回传给业务Agent解读。

步骤5:结果反馈与闭环

CLI Agent将整理后的执行结果,回传给业务Agent模块;业务Agent结合大模型,将执行结果解读为易懂的自然语言(如"本地桌面共有3个Excel文件,分别为data1.xlsx、data2.xlsx、data3.xlsx");最后通过自然语言输出接口,将结果反馈给用户,完成整个闭环。

三、重点补充:大模型调用命令的完整流程(含代码实现)

前文已拆解"业务Agent生成命令、CLI Agent执行命令",此处重点补充「大模型如何被调用、如何生成符合本地场景的CLI命令」------核心逻辑是"业务Agent作为中间载体,调用大模型(本地/远程),传入需求+本地环境信息,获取标准化CLI命令",以下分场景详细拆解,搭配完整代码示例,确保可落地、易理解。

3.1 核心前提:大模型调用命令的核心逻辑

大模型本身不具备"主动调用命令"的能力,其核心作用是「将自然语言需求+本地环境信息,转换为标准化CLI命令文本」,整个调用过程由业务Agent触发和管控,流程闭环为:业务Agent组装请求(需求+本地环境)→ 调用大模型API → 大模型生成命令 → 业务Agent接收并校验命令 → 传递给CLI Agent。

关键注意点:大模型仅输出命令文本,不参与任何命令执行;命令的适配、执行、安全管控,均由CLI Agent负责,大模型与本地终端无直接交互,确保安全。

3.2 分场景代码实现(基于Python,贴合业务Agent开发)

结合实际开发中最常用的「本地模型(Ollama)」和「远程模型(GPT-4)」两种场景,补充完整代码,包含"环境信息注入、大模型调用、命令校验"全环节,与前文CLI Agent执行代码无缝衔接。

场景1:调用本地模型(Ollama,离线可用,隐私安全)

本地模型(如Ollama、GPT4All)部署在本地,业务Agent通过本地API调用,无需联网,适合处理隐私敏感需求(如本地机密文件操作),代码示例如下:

python

### 业务Agent调用本地Ollama模型,生成CLI命令

import requests

import json

# 1. 先获取本地环境信息(模拟技能注入模块的输出,实际从环境信息库读取)

def get_local_environment_info():

"""获取本地环境信息,用于注入大模型,确保命令贴合本地场景"""

return {

"os": "Windows", # 本地操作系统

"terminal": "PowerShell", # 本地终端

"desktop_path": "$env:USERPROFILE\\Desktop", # 本地桌面路径

"installed_tools": ["git", "Excel", "PowerShell"], # 已安装工具

"safe_commands": ["Get-ChildItem", "dir", "cat"] # 安全命令白名单

}

# 2. 业务Agent组装大模型请求(需求+本地环境信息)

def build_llm_request(user需求, local_env):

"""组装请求,让大模型生成适配本地环境的CLI命令"""

prompt = f"""

你需要作为CLI命令生成助手,根据用户需求和本地环境信息,生成唯一、标准化的CLI命令,要求如下:

1. 命令必须适配本地操作系统:{local_env['os']},终端:{local_env['terminal']}

2. 优先使用本地已安装工具:{local_env['installed_tools']}

3. 路径必须贴合本地实际,如桌面路径使用:{local_env['desktop_path']}

4. 仅输出CLI命令文本,不添加任何解释、注释,避免多余字符

5. 若为高风险命令(如删除、修改系统文件),需在命令前添加【高风险】标记

用户需求:{user需求}

"""

return prompt

# 3. 调用本地Ollama模型(需提前启动Ollama服务,默认端口11434)

def call_local_ollama(prompt):

"""调用本地Ollama模型,生成CLI命令"""

url = "http://localhost:11434/api/generate"

headers = {"Content-Type": "application/json"}

data = {

"model": "llama3", # 本地部署的模型(可替换为gemma、mistral等)

"prompt": prompt,

"stream": False, # 关闭流式输出,直接获取完整结果

"temperature": 0.1 # 降低随机性,确保命令准确性

}

response = requests.post(url, headers=headers, data=json.dumps(data))

if response.status_code == 200:

result = response.json()

return result["response"].strip() # 提取大模型生成的命令文本

else:

raise Exception(f"本地模型调用失败:{response.text}")

# 4. 命令校验(确保大模型生成的命令符合本地规范)

def validate_cli_command(command, local_env):

"""校验命令:适配本地环境、区分安全/高风险"""

# 适配本地终端(如Linux终端替换Windows命令)

if local_env["os"] == "Windows" and "ls" in command:

command = command.replace("ls", "dir")

# 区分安全/高风险命令

high_risk_keywords = ["rm", "del", "rmdir", "format", "chmod"]

is_high_risk = any(keyword in command.lower() for keyword in high_risk_keywords)

# 移除大模型可能添加的【高风险】标记,单独记录风险等级

if command.startswith("【高风险】"):

is_high_risk = True

command = command.replace("【高风险】", "").strip()

return {

"command": command,

"is_high_risk": is_high_risk,

"is_valid": True # 简化校验,实际可添加参数、格式校验

}

# 完整调用示例(业务Agent调用本地Ollama,生成CLI命令)

if __name__ == "__main__":

# 模拟用户需求

user需求 = "查看本地桌面所有Excel文件"

# 1. 获取本地环境信息

local_env = get_local_environment_info()

# 2. 组装大模型请求

prompt = build_llm_request(user需求, local_env)

# 3. 调用本地Ollama模型

raw_command = call_local_ollama(prompt)

# 4. 校验命令

validated_command = validate_cli_command(raw_command, local_env)

# 5. 传递给CLI Agent执行(衔接前文CLI Agent执行代码)

print("生成的标准化命令:", validated_command["command"])

print("命令风险等级:", "高风险" if validated_command["is_high_risk"] else "安全")

# 此处可直接调用前文的execute_windows_command执行命令

# result = execute_windows_command(validated_command["command"])场景2:调用远程模型(GPT-4,功能强大,适配复杂需求)

远程模型(如GPT-4、Claude)通过官方API调用,需联网、配置API Key,适合处理复杂需求(如多命令序列生成),代码示例如下(核心差异在模型调用环节,其余逻辑与本地模型一致):

python

### 业务Agent调用远程GPT-4模型,生成CLI命令

import openai # 需安装openai库:pip install openai

# 1. 初始化远程模型API(替换为自己的API Key)

openai.api_key = "your-openai-api-key"

openai.api_base = "https://api.openai.com/v1" # 官方API地址(可替换为代理地址)

# 2. 复用本地环境信息获取、请求组装、命令校验函数(与本地模型一致)

# (此处省略get_local_environment_info、build_llm_request、validate_cli_command函数,与上文完全一致)

# 3. 调用远程GPT-4模型

def call_remote_gpt4(prompt):

"""调用远程GPT-4模型,生成CLI命令"""

try:

response = openai.ChatCompletion.create(

model="gpt-4",

messages=[

{"role": "system", "content": "你是CLI命令生成专家,仅输出标准化命令文本,不添加任何解释"},

{"role": "user", "content": prompt}

],

temperature=0.1,

max_tokens=100 # 限制命令长度,避免冗余

)

# 提取大模型生成的命令文本

command = response.choices[0].message["content"].strip()

return command

except Exception as e:

raise Exception(f"远程模型调用失败:{str(e)}")

# 完整调用示例(业务Agent调用GPT-4,生成CLI命令)

if __name__ == "__main__":

# 模拟用户需求(复杂需求:转换桌面Excel为CSV,保存到项目目录)

user需求 = "将本地桌面的data.xlsx文件转换为CSV格式,保存到C:\\Users\\XXX\\Project目录下"

# 1. 获取本地环境信息

local_env = get_local_environment_info()

# 2. 组装大模型请求(注入本地路径、已安装工具)

prompt = build_llm_request(user需求, local_env)

# 3. 调用远程GPT-4模型

raw_command = call_remote_gpt4(prompt)

# 4. 校验命令

validated_command = validate_cli_command(raw_command, local_env)

# 5. 传递给CLI Agent执行

print("生成的标准化命令:", validated_command["command"])

print("命令风险等级:", "高风险" if validated_command["is_high_risk"] else "安全")

# 示例输出命令(Windows系统):Import-Excel -Path $env:USERPROFILE\Desktop\data.xlsx | Export-Csv -Path C:\Users\XXX\Project\data.csv3.3 关键补充:大模型调用命令的注意事项(避坑指南)

-

环境信息必须注入:大模型无法感知本地环境,必须将操作系统、终端类型、文件路径等信息传入,否则生成的命令可能无法执行(如给Windows生成Linux的ls命令)。

-

prompt约束必须严格:需明确要求大模型"仅输出命令文本、适配本地环境",避免生成多余解释、注释,否则CLI Agent无法直接解析。

-

命令校验不可省略:大模型可能生成错误/不符合规范的命令(如参数缺失、路径错误),需通过校验环节修正,同时区分安全/高风险命令,为CLI Agent的执行方式提供依据。

-

隐私安全管控:调用远程模型时,仅传入"自然语言需求+本地环境信息(不含敏感数据)",不传入本地文件内容、系统密码等敏感信息,避免数据泄露。

四、关键模块详细设计(核心模块拆解)

结合架构与原理,重点拆解业务Agent、CLI Agent、安全沙箱、技能注入4个核心模块的设计细节,确保设计可落地、可扩展。

4.1 业务Agent模块设计(新增核心)

业务Agent是本次设计的核心新增模块,核心作用是"隔离逻辑处理与命令执行",避免CLI Agent职责过载,设计重点如下:

① 需求解析能力:支持自然语言到业务逻辑的转换,依托大模型实现深度解析,可识别复杂需求(如"将本地桌面Excel文件转换为CSV格式,并保存到项目目录"),拆分多个子逻辑,生成对应CLI命令序列。

② 本地环境感知能力:通过技能注入模块,实时读取本地环境信息(操作系统、终端类型、已安装工具、文件路径),确保生成的命令贴合本地实际,避免"命令正确但无法执行"的问题。

③ 命令生成规范:生成的CLI命令文本遵循标准化格式,包含命令名称、参数、目标路径等关键信息,同时标注命令类型(安全/高风险),方便CLI Agent进行安全校验。

④ 结果解读能力:接收CLI Agent返回的执行结果(如终端输出的文本),结合大模型解读为自然语言,确保用户能快速理解执行结果,无需查看原始终端输出。

4.2 CLI Agent模块设计

CLI Agent核心是"执行器",不参与逻辑处理,仅负责命令的适配、执行与结果反馈,设计重点如下:

① 环境适配模块:支持多系统适配(Windows/Linux/macOS),自动检测系统类型,匹配对应终端;支持命令格式自动转换(如Linux的ls命令转换为Windows的dir命令),参数自动校验(如修正缺少空格、参数错误的命令)。

② 命令执行引擎:采用"系统API+终端进程"的执行方式,支持同步/异步执行,可处理单个命令、命令序列(如串联多个CLI命令完成复杂任务),执行过程中实时监控终端输出,确保结果读取准确。上述代码示例已直观展示其核心逻辑------通过调用系统终端进程(PowerShell/bash),执行CLI命令并捕获输出,高风险命令则额外启动沙箱(如Docker容器),限制执行环境,既贴合实际开发,也能让开发者快速理解"CLI Agent如何调用本地命令"。

③ 结果整理模块:对终端输出的原始结果进行清洗、整理,提取关键信息(如文件列表、命令执行状态),去除冗余字符(如终端提示符、空行),生成标准化结果,方便业务Agent解读。

4.3 安全沙箱模块设计(核心安全保障)

安全沙箱是CLI Agent的核心安全机制,设计目标是"隔离命令执行环境,限制权限范围",支持两种沙箱模式,适配不同场景:

① 轻量级本地沙箱(适配个人开发者)

-

Windows:基于AppContainer技术,创建隔离的执行环境,仅允许访问指定目录(如桌面、文档),禁止访问系统核心目录(C:\Windows、C:\System32),即使命令出错,也不会影响本地系统。

-

macOS:基于系统内置sandbox-exec,通过配置沙箱规则,限制命令的访问权限,默认禁止写入系统核心目录,仅允许访问当前工作目录。

-

Linux:基于chroot技术,创建隔离的文件系统环境,命令仅能在该环境内执行,无法访问外部系统资源。

② 容器化沙箱(适配企业场景)

基于Docker/Podman,启动轻量级容器(如Alpine Linux容器),将命令执行环境限制在容器内,容器仅挂载本地必要目录(如项目目录、桌面),命令执行产生的所有操作均局限于容器内部,隔离性更强,适合处理高风险命令(如批量删除文件、修改系统配置)。

补充安全设计:除沙箱外,搭配命令白名单(仅允许执行ls、dir、cat等安全命令)、高风险命令手动确认(如git push --force、rm -rf等命令,需用户手动确认后执行),双重保障本地系统安全。

4.4 技能注入模块设计

核心作用是"让业务Agent生成的命令更贴合本地实际",设计重点如下:

① 本地环境信息注入:Agent启动时,自动读取本地环境信息(操作系统版本、终端类型、已安装CLI工具、常用文件路径、环境变量),存储到环境信息库,实时同步给业务Agent,作为命令生成的依据。

② 本地技能动态加载:支持本地Skill插件封装,开发者可将常用CLI命令、脚本、故障排查经验封装为Skill(如"Excel文件转换Skill""Git操作Skill"),业务Agent处理对应需求时,自动加载该Skill,获取本地命令最佳实践、路径配置,确保命令能直接执行。

五、修正后的完整流程图(用户→业务Agent→CLI Agent)

结合用户需求,修正原有流程图逻辑,明确新增业务Agent环节,清晰呈现"用户输入→业务Agent逻辑处理→CLI Agent命令执行→结果反馈"的完整流转,确保流程无偏差,流程图如下:

输入自然语言需求

1.需求解析(结合大模型)

2.生成标准化CLI命令文本

3.环境适配:系统识别+命令适配+格式校验

a.安全命令

b.高风险命令

调用系统API

执行命令

用户

自然语言输入接口

业务Agent

逻辑处理(整合本地环境信息)

CLI Agent

安全防护:沙箱初始化+白名单过滤

命令执行引擎

用户手动确认

本地终端(PowerShell/bash/zsh)

结果输出到stdout

结果读取与整理

CLI Agent回传结果给业务Agent

业务Agent结合大模型,解读结果为自然语言

自然语言输出接口

用户接收结果

技能注入模块

环境信息库

安全沙箱

大模型(本地/远程)

流程图说明:修正后明确了业务Agent的核心作用,流程流转更贴合实际设计逻辑------用户需求先经过业务Agent处理,生成命令后再传递给CLI Agent执行,避免CLI Agent承担逻辑处理职责。需要特别补充的是,CLI Agent接收命令后并非直接执行,而是先完成环境适配与安全校验,再根据命令风险等级选择执行方式:若为安全命令(如查看文件、查询信息),则直接调用本地终端执行;若为高风险命令(如删除文件、修改系统配置),则先调用安全沙箱,在隔离环境内执行命令,同时完整保留安全防护、结果反馈等环节,确保流程闭环、逻辑严谨,既贴合用户描述的核心流程,又补充了落地所需的关键细节。

六、设计优势与落地建议

6.1 核心设计优势

① 职责清晰:业务Agent负责逻辑处理与命令生成,CLI Agent负责命令执行与结果反馈,分层解耦,便于维护和扩展。

② 安全可控:整合沙箱隔离、白名单过滤、权限确认三大安全机制,避免恶意/错误命令损坏本地系统,保障数据安全。

③ 适配性强:支持多系统(Windows/Linux/macOS)、多终端、本地/远程大模型,同时支持技能注入,贴合本地实际使用场景。

④ 易用性高:用户无需学习CLI命令,仅通过自然语言即可完成本地终端操作,执行结果以自然语言反馈,降低使用门槛。

6.2 落地建议

① 个人开发者:优先采用轻量级沙箱,简化配置,重点关注环境适配和技能注入模块,封装常用本地Skill,提升命令生成的准确性。

② 企业场景:采用容器化沙箱,加强权限管理和日志审计,同时整合本地模型(如Ollama),实现离线调用,保护企业数据隐私。

③ 扩展优化:可新增插件市场,支持开发者共享本地Skill;优化命令执行引擎,支持异步执行和批量命令处理,提升执行效率。

七、总结

本次CLI Agent设计,核心是修正原有流程逻辑,新增业务Agent模块,实现"用户→业务Agent→CLI Agent"的合理流转,同时结合大模型调用本地CLI命令的底层机制,设计了完整的分层架构、核心原理图和关键模块,兼顾了安全性、适配性和易用性。